一次完整的HTTP请求究竟经历了哪些环节?这个问题不仅是后端工程师面试的经典考题,更是理解现代网络服务底层运行机制的关键。本文将带你深入一个请求从前端发起到后端处理并返回的全链路,并结合Go语言的源码实现,剖析从DNS解析、内核协议栈、中断处理到Go运行时协程调度的每一个技术细节。

1. 前端发起与DNS解析

当你在浏览器地址栏输入URL并按下回车,旅程的第一步便是找到目标服务器的地址。

1.1 本地DNS缓存查询

浏览器会首先检查自身的DNS缓存,看是否已经解析过这个域名且记录未过期。如果命中,则直接使用缓存的IP地址,这是最快的解析路径。在Chrome浏览器中,你可以通过在地址栏输入 chrome://net-internals/#dns 来查看和管理这些缓存数据。

1.2 Hosts文件查询

如果浏览器缓存未命中,操作系统会检查本地的Hosts文件。这个文件存储了静态的域名到IP地址的映射,优先级高于网络查询。

- Windows路径:

C:\Windows\System32\drivers\etc\hosts

- Linux/Mac路径:

/etc/hosts

1.3 递归DNS服务器查询

当本地缓存和Hosts文件都没有记录时,系统会向配置的DNS服务器(通常由你的网络服务提供商ISP分配)发起查询。这是一个递归过程:如果本地DNS服务器没有缓存该记录,它会依次向上级DNS服务器乃至根DNS服务器发起查询,直至获得最终的IP地址。这个过程是网络知识的基础,想深入了解网络协议的工作原理,可以深入探讨。

2. 网络传输:TCP连接建立

获取到IP地址后,浏览器(客户端)需要与服务器建立一个可靠的传输通道。

// 三次握手建立TCP连接

// 1. 客户端发送SYN包 -> 服务端

// 2. 服务端回复SYN+ACK包 <- 客户端

// 3. 客户端发送ACK包 -> 连接建立完成

// 补充:对于HTTPS请求,在TCP连接建立后,还需要进行TLS握手以建立加密层。

连接建立后,应用层的数据(HTTP请求报文)会被分割成适合网络传输的数据包。每个数据包在发送前都会被添加上TCP头部(包含端口、序列号等信息)和IP头部(包含源和目标IP地址),然后交由网卡硬件发送到网络中。

3. 服务端接收:从网卡到内核缓冲区

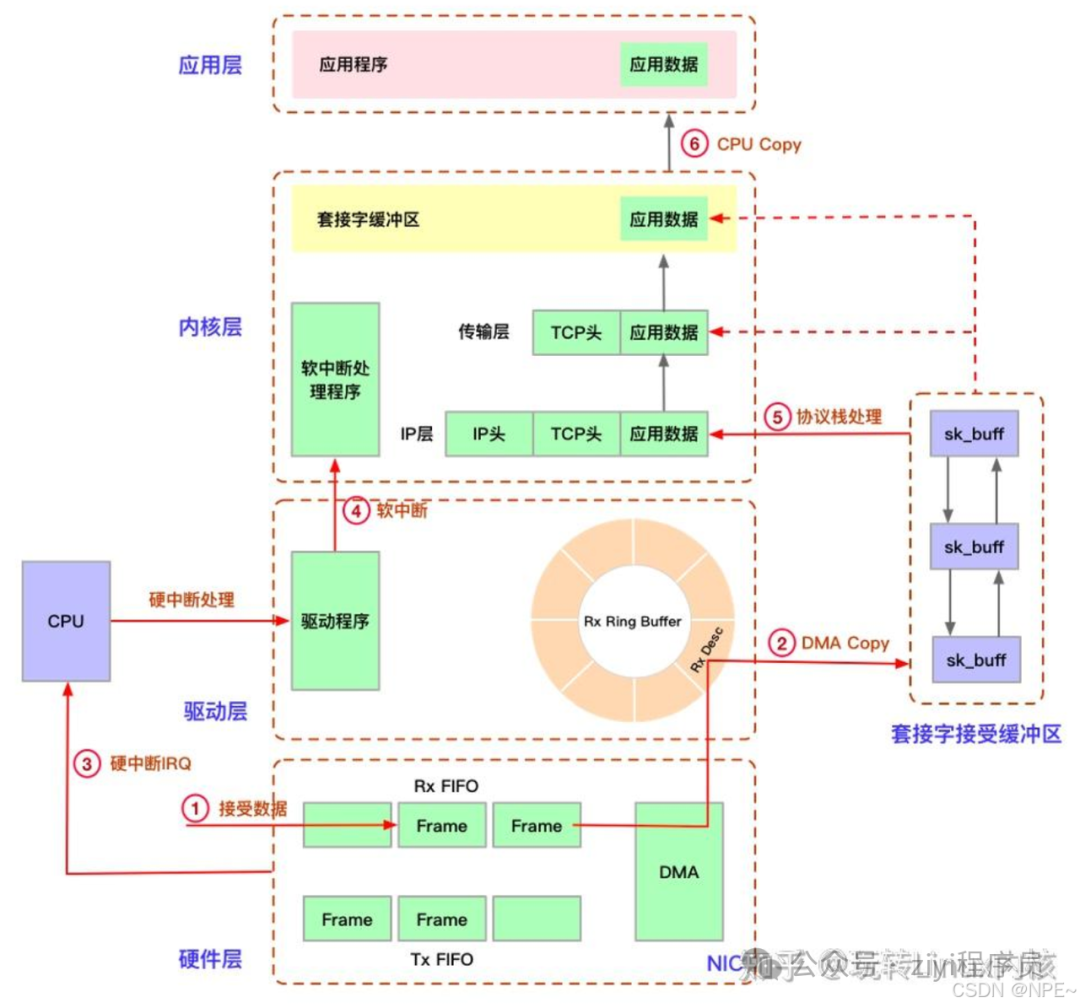

数据包通过网络到达服务器的物理网卡,服务端的处理流程正式开始。这张图清晰地描绘了数据从硬件到内核的完整旅程:

3.1 网卡接收与DMA传输

网卡硬件接收到数据包并进行初步校验。随后,关键的一步发生了:DMA(直接内存访问)。网卡通过DMA控制器,无需CPU参与,直接将数据包写入到操作系统内核预先分配的接收缓冲区(通常是环形缓冲区Ring Buffer)中。这避免了CPU陷入繁琐的数据拷贝工作,极大地提升了效率。

3.2 中断处理:硬中断与软中断

数据存入内存后,网卡会触发一个硬中断(Hardware Interrupt),通知CPU“有数据到了”。CPU必须立即响应,暂停当前任务,执行对应的硬中断处理程序。

不过,硬中断处理程序只做最紧急、最简短的标记工作(例如,记录哪个网卡的哪个缓冲区有数据)。它会立刻触发一个软中断(Software Interrupt)。软中断作为“下半部”,由内核在稍后合适的时机调度执行,负责繁重的协议栈处理逻辑,这样就不会长时间阻塞系统。

高性能提示:现代服务器网卡(支持NAPI等机制)在高流量场景下会采用混合中断+轮询的模式。即首个数据包触发中断后,驱动程序会暂时关闭中断并轮询处理一批数据包,以此减少中断次数,显著提升性能。

4. 内核协议栈处理

软中断最终会调用内核的网络协议栈代码。协议栈就像是一个精密的拆解流水线,逐层剥去数据的“包装”:

- 链路层处理:解析以太网帧头部,校验帧完整性,检查目标MAC地址是否为本机。

- 网络层处理:解析IP头部,检查数据包的目标IP地址,决定是接收、转发还是丢弃。同时进行TTL(生存时间)检查。

- 传输层处理:解析TCP(或UDP)头部,根据目标端口号找到对应的监听套接字(Socket),检查连接状态(如序列号是否正确)。

- 应用层交付:将剥离了所有协议头部的原始应用数据(例如HTTP请求报文)放入对应Socket的接收缓冲区中,等待用户态应用程序来读取。

至此,数据已经安全地从网络抵达了服务器内核中应用程序的“门口”。

5. Go运行时处理:NetPoller与Goroutine调度

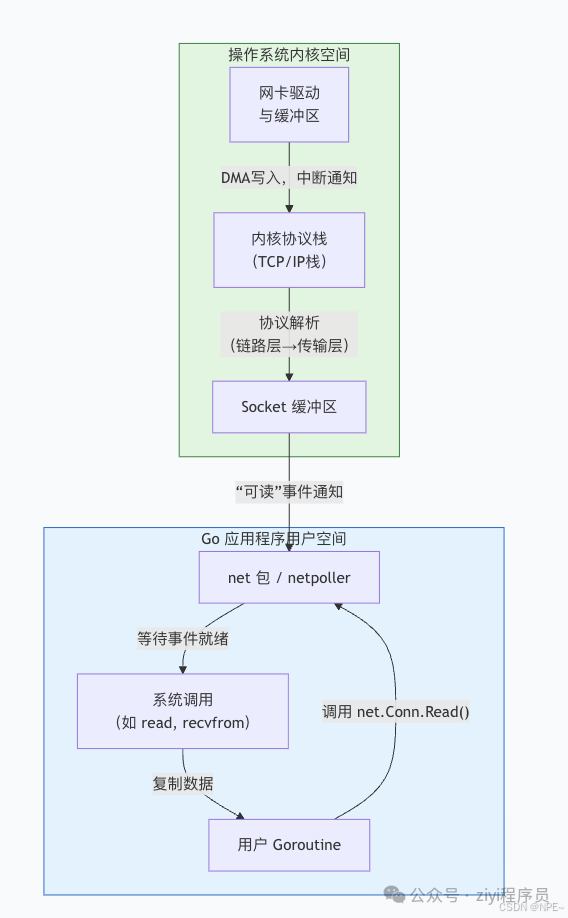

当数据到达Socket缓冲区,我们的Go服务程序是如何感知并处理的呢?这依赖于Go运行时强大的NetPoller(网络轮询器)机制和协程调度。

5.1 NetPoller的工作机制

NetPoller是Go实现高并发网络I/O的核心。它不是为每个连接创建一个系统线程去阻塞等待,而是利用操作系统提供的I/O多路复用接口(如Linux的epoll、BSD的kqueue),统一监视所有网络文件描述符(fd)的状态。

// runtime/netpoll.go 中 pollDesc 结构体简化示意

type pollDesc struct {

link *pollDesc // 链表指针

fd uintptr // 文件描述符

rg uintptr // 等待读的goroutine (指针)

wg uintptr // 等待写的goroutine

// ... 其他字段如定时器、状态等

}

pollDesc 与每个网络fd关联,它关键的作用是跟踪哪个goroutine在等待这个fd上的I/O事件(通过rg或wg字段)。

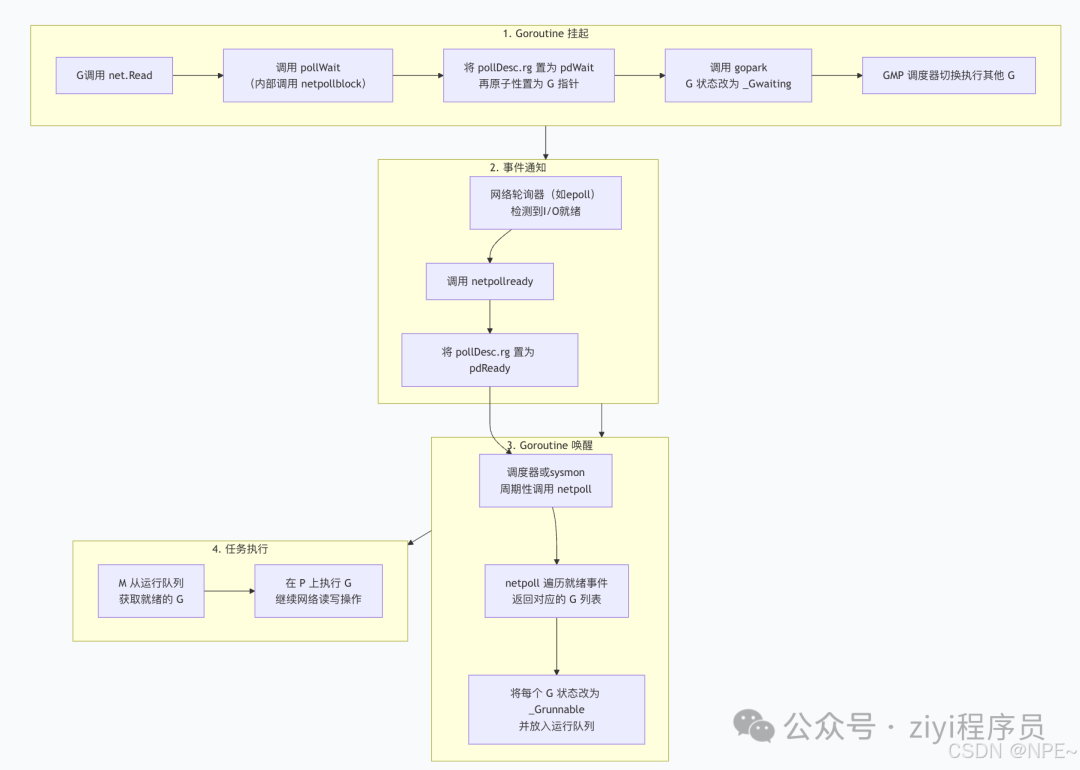

5.2 Goroutine的挂起与唤醒

当一个处理HTTP请求的goroutine执行到conn.Read()试图读取数据时,如果Socket缓冲区尚无数据,会发生什么?

以下是这个过程的流程图解:

-

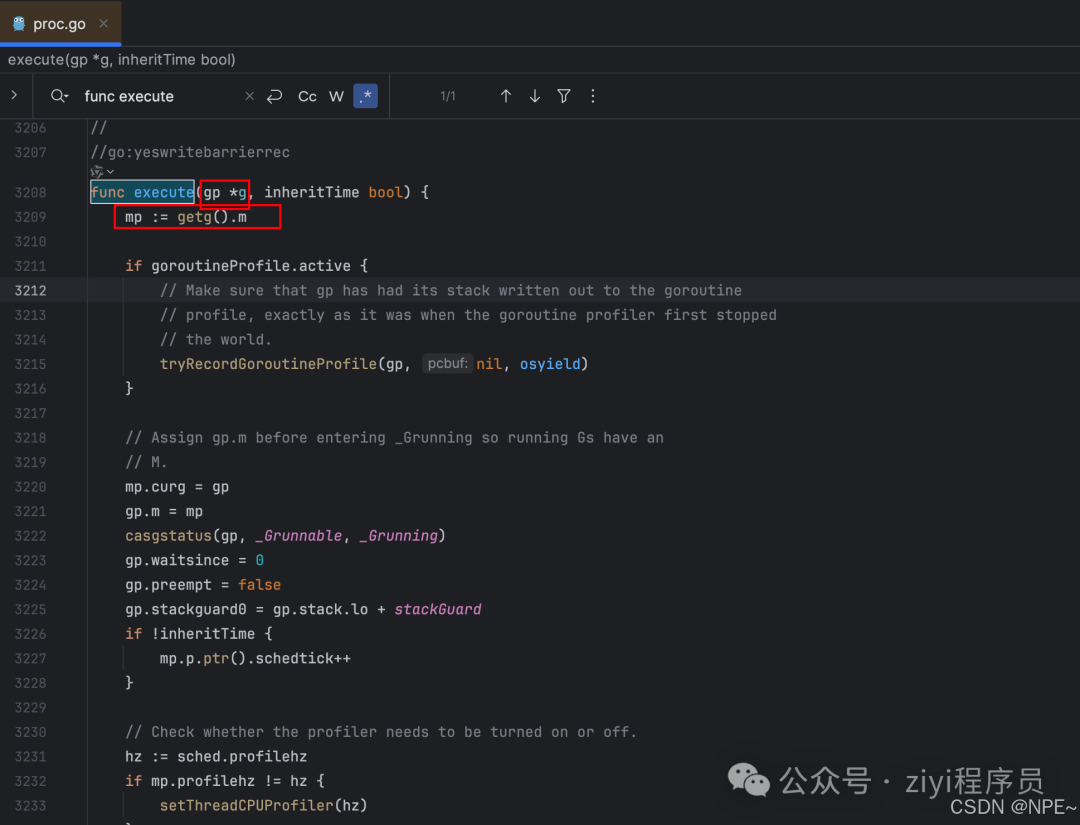

Goroutine挂起:net.Read内部会调用pollWait,将当前goroutine的指针存入对应pollDesc.rg中,然后调用gopark。gopark会将这个goroutine的状态从 _Grunning 改为 _Gwaiting,并使其脱离当前执行的系统线程(M)。之后,GMP调度器会切换去执行其他就绪的goroutine。理解GMP模型是掌握Go并发的关键。

-

事件通知:NetPoller通过epoll_wait等系统调用阻塞监视。当数据到达,内核将对应fd标记为可读,NetPoller被唤醒。它找到对应的pollDesc,将rg标记为就绪状态。

-

Goroutine唤醒:调度器或系统监控线程sysmon会周期性调用netpoll函数。该函数检查所有就绪的fd,将等待它们的goroutine状态从 _Gwaiting 改为 _Grunnable,并放入全局或本地运行队列。

-

任务执行:空闲的M(系统线程)从运行队列中获取到这个已就绪的G,开始执行,此时conn.Read()调用将成功读取到数据并返回。

通过这种“同步编程,异步执行”的模型,Go用极少的系统线程(M)支撑了海量并发的网络连接,每个连接在I/O等待时几乎不占用任何计算资源。

6. 业务逻辑处理

数据被成功读入用户空间后,便进入了业务处理阶段。以Go的标准库net/http为例:

func handleHTTPRequest(w http.ResponseWriter, r *http.Request) {

// 1. HTTP框架已自动解析请求头和Body到 `r` (*http.Request) 中

// 2. 根据路由器配置匹配到当前的处理函数(如本函数)

// 3. 执行你的业务逻辑:查询数据库、调用其他服务、处理业务规则等

// 4. 通过 `w` (http.ResponseWriter) 构造和写入响应

}

这个过程通常还包括中间件链的执行,如日志记录、身份认证、限流等。

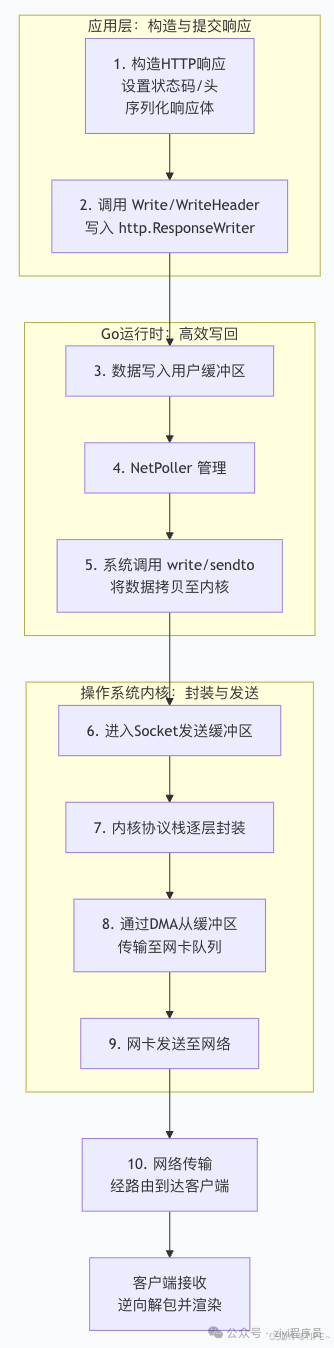

7. 响应返回:数据的回程之旅

业务逻辑产生响应后,数据需要沿着相似的路径返回给客户端。

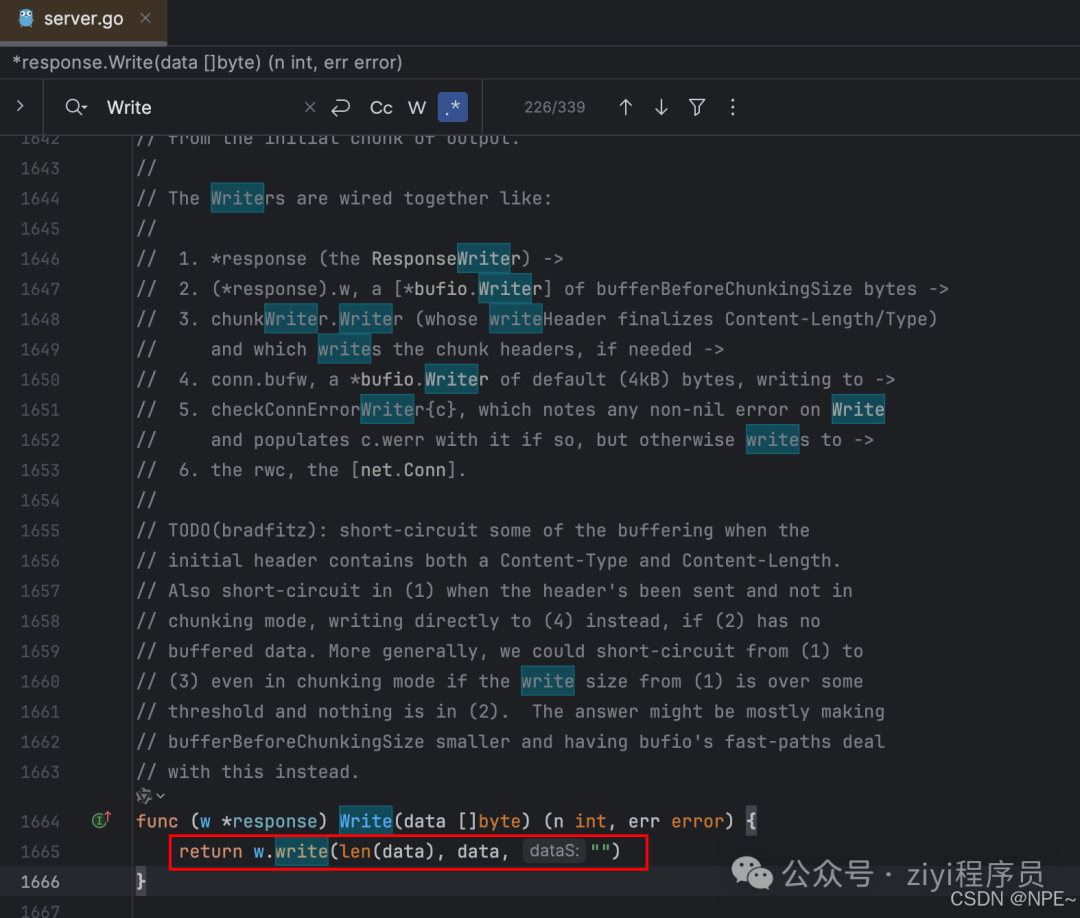

7.1 响应构造与写入

你通过w.Write()写入的数据,在net/http包内部会经过一个精心设计的写入链:

// net/http/server.go

func (w *response) Write(data []byte) (n int, err error) {

return w.write(len(data), data, "")

}

这个写入链可能包括应用层缓冲区、chunk编码处理器、连接层缓冲区等,目的是为了优化小数据写入和头信息处理。

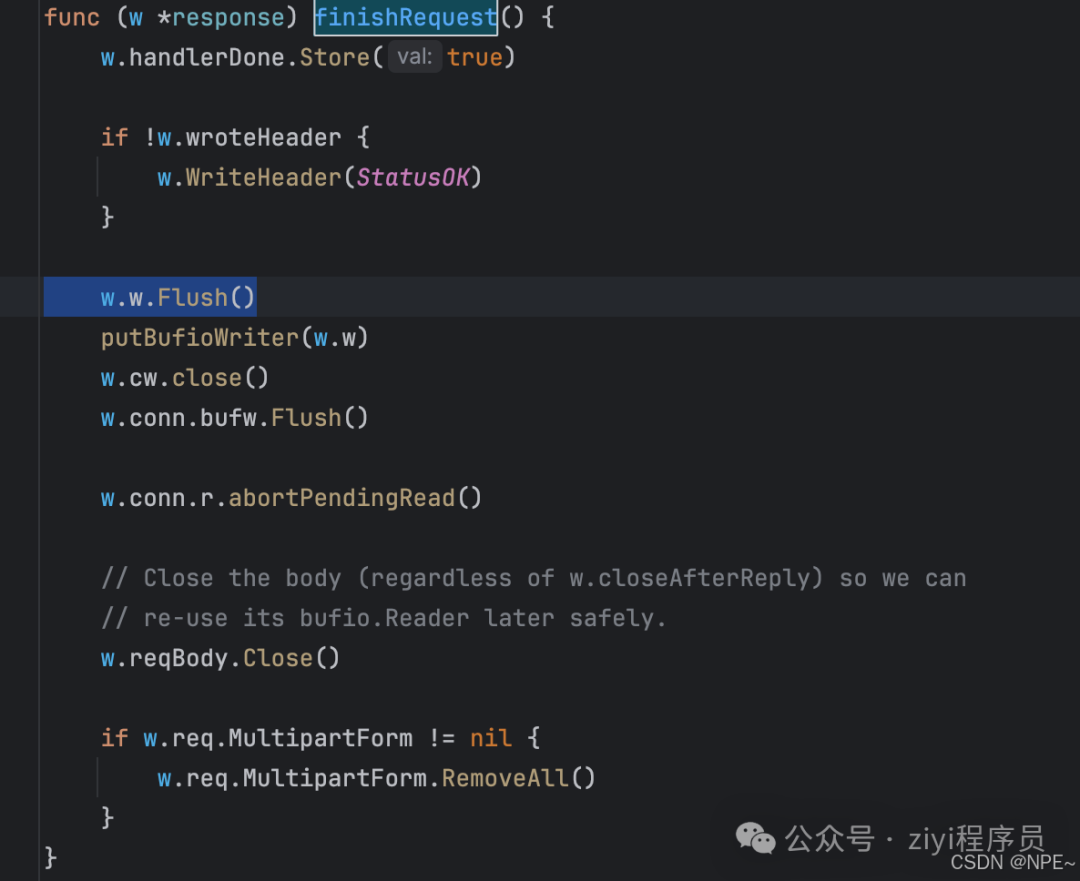

最终,在请求处理完毕时(或缓冲区满时),会调用flush操作,将数据真正推向底层连接。

// net/http/server.go - finishRequest 方法片段

func (w *response) finishRequest() {

w.handlerDone.Store(true)

if !w.wroteHeader {

w.WriteHeader(StatusOK)

}

w.w.Flush() // 将缓冲数据刷入底层连接

// ... 其他清理工作

}

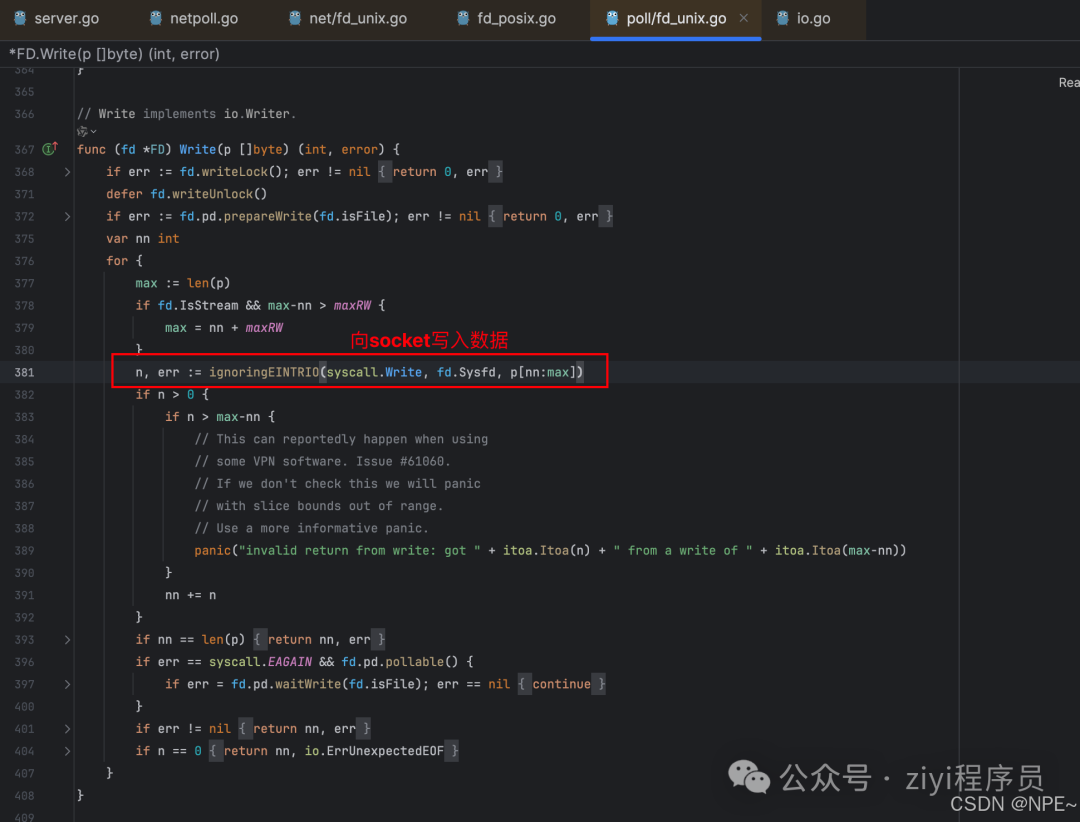

7.2 通过Socket发送

冲刷到底层连接的数据,会调用到internal/poll包中的FD.Write方法。该方法负责处理实际的系统调用,并处理诸如“缓冲区满”(返回EAGAIN)等情况,必要时会通过NetPoller等待socket变为可写状态。

// internal/poll/fd_unix.go 简化逻辑

func (fd *FD) Write(p []byte) (int, error) {

// ... 加锁、准备写操作

for {

// 尝试系统调用写入

n, err := ignoringEINTR(syscall.Write, fd.Sysfd, p[nn:max])

if err == syscall.EAGAIN && fd.pd.pollable() {

// 等待socket可写事件

if err = fd.pd.waitWrite(fd.isFile); err == nil {

continue // 继续写

}

}

// ... 处理写入结果或错误

}

}

数据通过write系统调用进入内核Socket发送缓冲区后,内核协议栈会为其添加TCP头部、IP头部、链路层头部,然后通过DMA传输到网卡队列,由网卡发送至网络。最终,数据包经网络路由传回客户端浏览器,浏览器解析HTTP响应并渲染页面。

8. 连接管理:Keep-Alive与资源优化

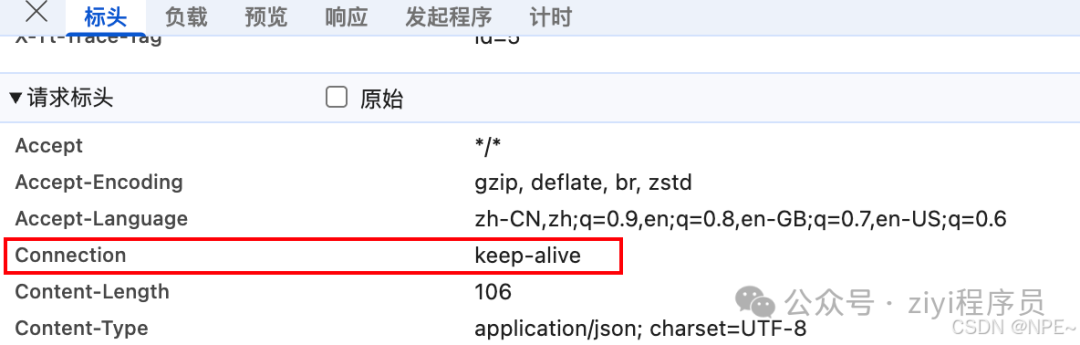

一个请求/响应完成,TCP连接会立刻关闭吗?不会。HTTP/1.1默认启用了Keep-Alive(持久连接)机制。

这意味着同一个TCP连接可以被用于多个HTTP请求/响应循环,从而避免了频繁的三次握手和四次挥手带来的延迟和资源开销。连接会在空闲一段时间后,由服务端或客户端主动关闭。

在Go的HTTP服务器中,你可以这样配置:

server := &http.Server{

Addr: ":8080",

IdleTimeout: 120 * time.Second, // 连接空闲120秒后关闭

ReadTimeout: 5 * time.Second, // 读取整个请求的超时时间

WriteTimeout: 10 * time.Second, // 写入整个响应的超时时间

}

总结

从一次简单的点击到页面展示,背后是一个横跨前端、网络、操作系统内核、运行时和应用程序的复杂协作体系。我们梳理了从DNS解析、TCP握手、数据包接收(DMA/中断)、内核协议栈解包、Go NetPoller事件驱动、Goroutine调度、业务逻辑处理、响应封装到连接管理的完整闭环。理解这个流程,不仅有助于你在面试中清晰表达,更能让你在设计和优化后端系统时,拥有清晰的全局视角和扎实的理论基础,这也是在云栈社区等开发者平台与同行深入交流的绝佳话题。