Seedance 2.0这把火,已经烧了好几天。

抖音、B站到处都是二创视频,微博科技榜更是一下子上了四个热搜。就连我前天随手写的一篇关于Seedance 2.0的纯文字感想,阅读量都过了10万+。连我尊敬的业内人士冯骥老师也发微博感叹:AIGC的童年时代,结束了。

说实话,写这篇稿子的过程也挺踉跄的。刚写完一半,真人参考功能就被暂时限制了,所有案例都得重新设计、重新生成。重新跑案例时,又因为热度太高,服务器负载过大,平均20分钟才能出一个视频。

而今天,豆包APP上的Seedance 2.0也开始内测。

我都不敢想,等它正式全面放开的时候,以豆包的用户量级,服务器会是什么光景。真的太火了,有种去年大家疯狂尝试DeepSeek R1的感觉。去年是DS,今年是SD,每年春节,技术圈都不让人闲着。

在一片忙碌中,总算花了2天多时间,把这篇稿子肝完了。

这次我不打算去评测模型的基础能力了,因为没必要——它就是当前毫无争议的世界第一。很多海外用户现在都在X上疯狂寻找使用Seedance 2.0的“魔法”。现在再去评测它的画面一致性是不是更强了、输出分辨率是不是更高了,就像三体人打过来了,我们还在讨论他们的智子是不是不锈钢做的,显得非常荒谬。

其实我心情挺复杂的。除了是AI内容创作者,我还有另一份工作,就是探索AI影视工业化,做的是电影和电视剧级别的项目,不是那种短剧或漫剧。昨天我发了一条朋友圈说:“周六晚上,我把它(Seedance 2.0)发给了一些影视圈的朋友和剧组同事,我说这次可能是真的变天了。我也很焦虑,因为我们搭建了一年的所谓AI影视工业化流程,在顷刻间,感觉要灰飞烟灭了。”

然后有朋友评论说:“‘工业化灰飞烟灭’可能说早了。” 我是这么回复的:

回头看这一年半,认识了很多很好的伙伴,但看我们一路追赶的技术更迭,真的只剩一声叹息。只有当你亲身被“替代”过,看着自己拼命搭建的一切在新技术面前化为泡影,那种感觉才真实。就像一个国家将所有精锐部队派往前线,士兵们全副武装、斗志昂扬地冲进敌方城池,却发现城内空无一人,只有城市中心静静躺着一颗名为“核弹”的金属球。然后,核弹被引爆了。在万分之一秒内,这支所向披靡的部队被瞬间气化,消失无踪。

你问我是什么感觉?我就是那支部队里被气化的一员。在消失的瞬间,我可能都不知道发生了什么。

时代的列车滚滚向前,它不会等待任何人。面对此情此景,也只能说,既然前路不可逆,就走下去。

所以,我的心情是复杂而矛盾的,既兴奋又焦虑。这篇文章,我也不做传统评测了,只想抛砖引玉,给大家看看现在用Seedance 2.0可以玩出哪些有趣的新花样。

希望大家都能搭上新时代的列车,好好享受沿途风景。坐稳扶好,我们现在发车。

一、导演思维:AI真的懂“戏”了

这次Seedance 2.0能爆火,一个重要原因是它展现出的“导演思维”。

过去我们玩AI视频,有两个核心卡点:一个是故事,一个是分镜。这两个东西,让普通人做的视频和专业者做的视频,差距巨大。剧本是编剧意志的体现,而分镜,就是把剧本视觉化的核心要素。

比如剧本里写:“小明推开门,看到屋里一片狼藉,他愣住了。” 这句话,导演可以有无数种拍法。可以给小明推门的中景,切屋里狼藉的全景,再切回小明表情的特写;也可以用一个长镜头,跟随小明的视角推进去;还可以先给屋里的混乱,再给门把手转动的特写,接着是小明的脚步,最后才是他的脸。

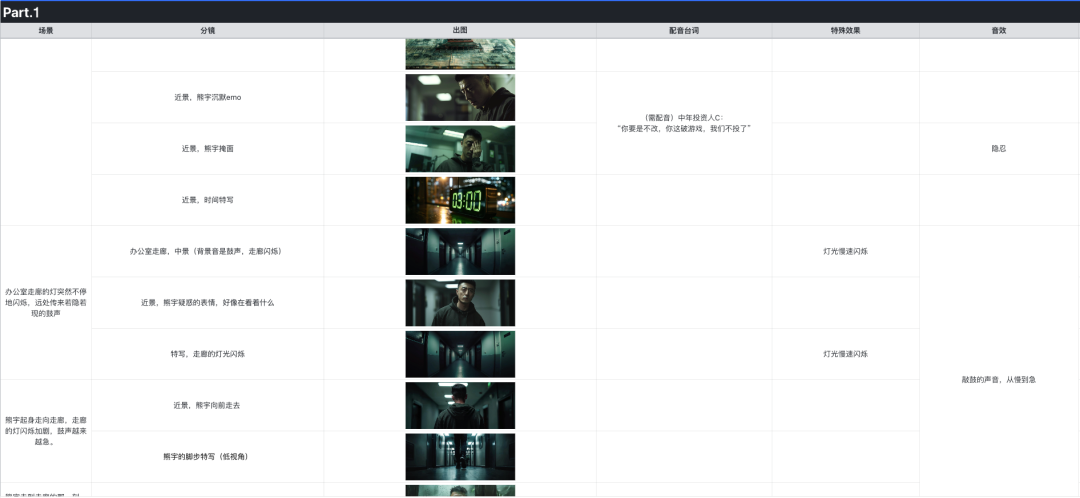

过去,AI视频几乎无法帮你解决分镜难题。我们用的基本是“图生视频”工作流:一张静态图对应一个4秒的片段,然后把多个片段剪辑拼接成一个片子。下图是2024年初我们做一个AI短片时的协同文档,真是这样一步步来的。

你会发现,那时AI的核心能力,其实只是把你的分镜图“动态化”而已。后来,Sora 2 把分镜这件事下放了,你只需给一张图和一段话,AI能帮你补充分镜,变成一个还不错的小故事。但那种分镜切换往往没有章法,一通乱切。

但是Seedance 2.0,几乎解决了分镜的核心问题。它在镜头语言的美感和逻辑性上,感觉领先了Sora一个世代,而且还能直出声音和BGM(虽然我经常手动用Prompt关掉BGM)。

比如下面这个案例,我主要只写了剧情和对话,所有的分镜调度都是它自己解决的。

说实话,这个成片质量在电视剧领域已经可以假乱真了,甚至比一些粗制滥造的古装剧拍得还好。人物表情动作极其自然,台词功底也够,每一次镜头切换都有其意义。

另一个小故事,更能让你感受到什么叫“导演思维”。我的Prompt只是一个简单甚至带点无厘头的小故事:

他苦练二十年,终于站上了世界武术大赛的决赛舞台。面对泰国拳王,全场屏息。裁判一声令下,他气沉丹田,使出毕生绝学——跪下来喊了一声“爸”。拳王愣住了。一拳,他赢了。

而Seedance 2.0生成的最终视频和它给出的分镜逻辑,实在离谱——它真的懂戏。它知道什么时候该给特写来强调情绪(比如拳王愣住的脸),什么时候该拉镜头来交代环境(比如全场观众),什么时候该用慢动作制造张力,什么时候该快速剪辑来加速节奏。这些东西,以前是需要专业导演才能把控的。现在,AI能做了,而且连剪辑的活儿都干了,太离谱了。

二、分镜复刻:向大师“拉片”学习

在影视行业,因为分镜特别重要,所以一直有个学习方法叫“拉片”,就是逐帧分析优秀作品的镜头调度、排列和情绪运用。因此,学习大师作品的镜头语言很重要。

过去,我们想模仿某类作品的镜头风格,很难。但现在,因为Seedance 2.0支持“视频参考”(Video Reference)功能,这件事变得非常简单。

比如,我很喜欢《天气之子》里的这一段分镜。现在只需要把这段参考视频扔进去,让它基于这个分镜风格生成一段全新的故事,非常方便。

而且不止是剧情片,甚至在广告片里也能用上。比如我直接用一段汽车广告的运镜分镜作为参考,再加上一张大疆无人机的产品图,让它复刻一个产品展示视频。

现在,人人都能用一张图,“拍”出百万级制作的广告大片了。这块单独提一下,如果你用的是豆包内测版,目前可能还不支持上传视频参考,估计是豆包用户量级太大,功能在逐步开放,还需要等等。

三、经典二创:释放对IP的热爱

人类对自己喜爱的IP最深的情感表达,就是给他们做二创。以往想做高质量的二创很难,比如你想给某个名场面做个新版本,可能真得手搓一个MV。所以过去的二创,往往集中在同人图或漫画上。

但现在不一样了。我这两天刷抖音和B站,发现二创已经彻底疯了,抽象和高燃并存。而且,如果你对一个喜欢的故事结局不满意,完全可以自己动手“修改”。

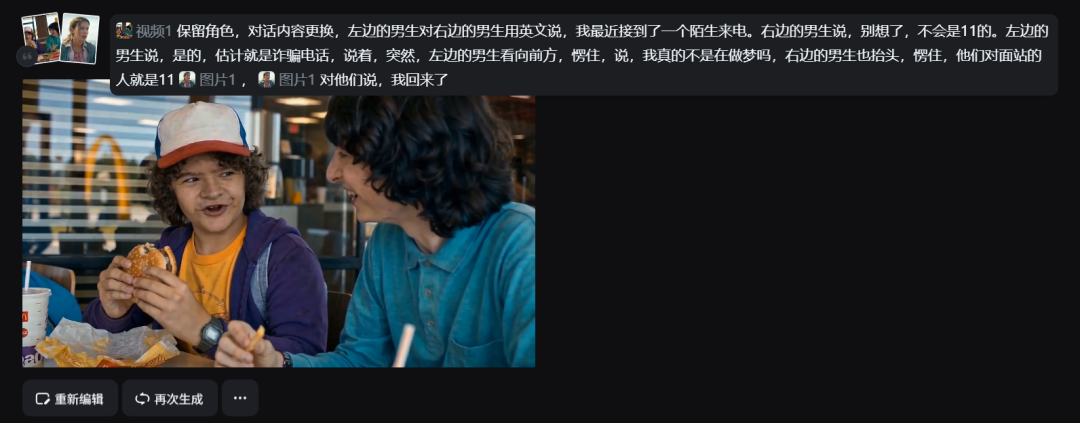

比如《怪奇物语》第五季的结局,我真心希望小十一(Eleven)能回来。那我们就可以自己用AI“复刻”一个她回归的场景。

她真的,就“回来”了。不仅可以搞温情,各种抽象、脑洞大开的创作也满天飞。感觉比原作还带劲。一句话直出,创意无限。

四、编辑现实:谁说视频不能P?

既然可以参考视频,那自然还有一个特别的功能:编辑现实。这对影视后期来说,可能是究极有用的功能。

过去我们都听过一句话,甚至像是一句真理:“视频是没办法P的。” 但是现在,谁说视频不能P?

比如,我随手拍了一个10秒钟的挥手视频,然后在Seedance 2.0里,结合一张宝可梦的图片加上Prompt:“视频1的手中拿着图片1,扔出去召唤出图片2,出来以后喊了一声‘皮卡丘’,然后自身发出黄色雷电,使用了十万伏特”。

一个非常逼真的宝可梦召唤视频就做好了,各种物理规律、光影融合还相当酷。

我还拍了一段凌晨1点公司空荡的走廊视频。

直接用Prompt换成恐怖片风格,瞬间变成“里世界”。这效果稳定到爆炸,还做什么后期特效啊。

五、素材生成Vlog:对剪辑软件降维打击

这是一个非常神奇的玩法,甚至感觉对剪映这类工具都能产生一点冲击。

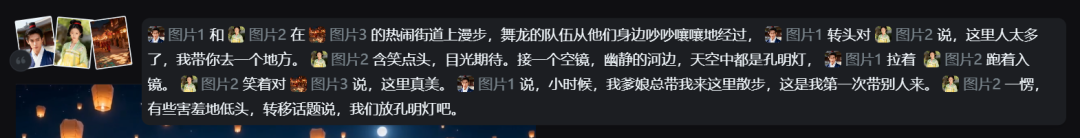

我们日常不是会拍很多照片和视频素材吗?如果我想把这些素材快速生成一个有风格的Vlog,过去你可能得去套用模板、手动剪辑。但在AI的世界里,你真的直接说就行。

比如,前几天团队里的小伙伴拍了一些逛古镇的照片,我们直接扔给Seedance 2.0,Prompt是:“把这些拍摄图片作为图像参考,制作出一个有设计感、添加有趣又可爱的贴纸和特效,具有剪映风格的生活化Vlog。”

然后它就能直出一个还挺好玩的Vlog,所有静态图片都会以合理的方式动起来,AI还会自动识别图片内容(比如灯笼、店铺),给加上相应的小装饰和转场,挺有意思的。

六、带货广告:最直接的变现玩法

这个玩法,可能是最能直接看到商业价值的。做过电商的朋友都知道,拍产品视频是件麻烦事:需要找场地、模特、摄影师、灯光师,折腾一天可能就拍几十秒素材,成本高,且每个产品都要单独拍。

现在,Seedance 2.0给出了新的可能:用AI生成产品展示视频。我试了一下,效果出乎意料地好。比如有这么一个设计简约的面霜产品。

我们就可以让一个AI生成的虚拟模特来讲解它,效果比很多真人模特看起来更自然、好看、舒服。甚至,你还可以让“伏地魔”在美国超级碗的背景下,代言一款“鼻炎特效药”,最后一幕极具戏剧张力。还要什么真人啊?

七、主体迁移:离谱的动作复刻

这个功能,是让我觉得效果最离谱的一个,也确实对影视行业非常有用。

你可以把你自己的照片,迁移到另一个视频的某个主体身上,完成一模一样的动作和口型复刻。这就是我们常说的“数字人动作捕捉”,只不过现在完全不需要穿戴复杂的动捕设备,一个视频加一张照片,就能迁移一切。

比如最近因为Seedance 2.0而爆火的一个复杂运镜视频,用这个功能可以完美复刻,连遮挡关系、光影都还原得一模一样。

说真的,我从来没见过如此离谱、精准的动作迁移。在这项能力上,它应该就是全球目前最好的了。

写在最后

写到这里,文章该收尾了。以上差不多就是Seedance 2.0目前一部分有趣的新玩法,抛砖引玉。

在真人出镜需要严格验证的背景下,真人视频参考功能短期内可能不会完全放开。“分身出镜”或类似的数字人模式,可能会是C端用户很长一段时间的主流玩法。

等到大年三十春晚,如果豆包再秀一把Seedance 2.0,当所有人涌入尝试时,整个社会对AIGC视频的认知又会被加速推进一大截。回头看这几年,发展速度实在太魔幻了。

我自己的心情依旧复杂。作为一个关注AIGC的创作者,我当然兴奋,这是一个划时代的产品,给了我们无数新内容和新视角。但作为一个AI影视工业化的探索者,我又很焦虑。我们过去在剧组花了很多心血搭建的流程、积累的经验,可能在新工具面前需要彻底重构。

这种感觉就像你辛辛苦苦爬山快到顶了,突然发现有人修了条缆车直达山顶,票价还便宜。你会觉得自己之前的努力很傻吗?多少有点。但能怎么办呢?只能调整心态,接受现实,然后想办法利用这条“缆车”去探索更高的地方。

我前天的短文里说:时代的列车滚滚向前,它不会等待任何人。这句话听起来有点丧,但我觉得它也是一种激励。既然列车不等人,那就赶紧跑,赶紧跳上去。

不管你之前做什么,积累了什么,现在都需要重新学习,适应新工具和新规则。这是时代给所有人的挑战,也是机会。

我看到有人说感觉自己要失业了。我想说,别太悲观。每一次技术革命,都会消灭一些旧岗位,也会创造大量新岗位。汽车取代了马车夫,但创造了司机、汽修工、加油站;电脑淘汰了打字员,但创造了程序员、设计师。

AI会改变工作形态,但也一定会催生新的职业。关键是,你要成为能抓住新机会的人。保持好奇心,保持学习,保持对新事物的敏感。Seedance 2.0发布了,你就去玩它、研究它、思考它能用来做什么。不要等别人教,不要等市场成熟,不要等一切都清晰了再行动——等你想明白时,机会的窗口可能已经关闭了。

希望这篇文章和这几个玩法,能给大家带来一些启发。也希望大家能在这个疯狂迭代的时代,找到自己的新位置。

最后,借用冯骥老师的话作为结尾吧:

AIGC的童年时代,结束了。

欢迎来到,AIGC的青年时代。

技术的发展日新月异,社区的价值在于交流与共创。对于AI视频生成这类前沿应用的更多玩法和深度讨论,欢迎来云栈社区的对应板块,和大家一起探索碰撞。