你有没有想过这样一个问题:哪怕是多核CPU,在单个逻辑处理器上,同一时刻也只能专心执行一个线程——这是硬件层面无法绕过的硬限制。那为什么我们的电脑可以同时流畅地运行浏览器、音乐播放器和各种后台服务,感觉它们都在“并行”工作呢?这背后真正的“魔术师”,就是操作系统的核心调度机制。

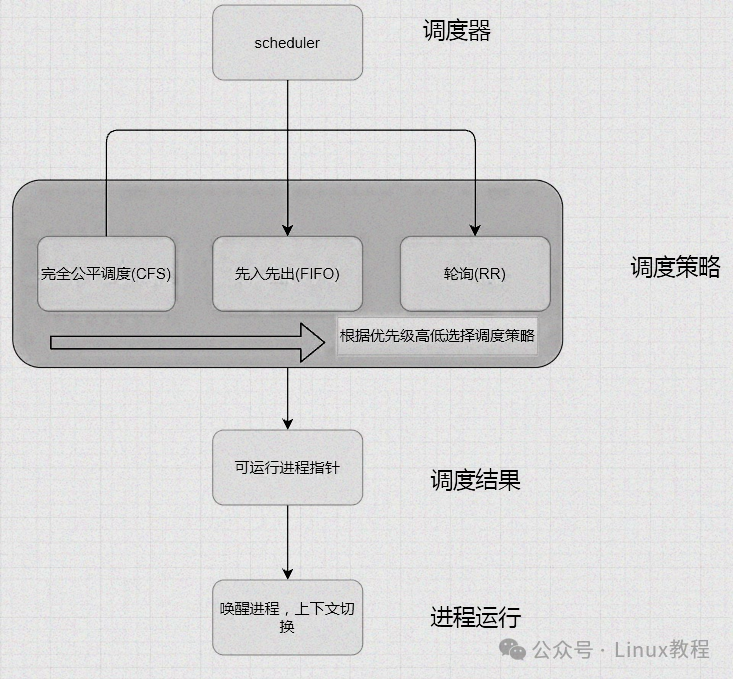

调度机制扮演着CPU资源的“首席分配官”角色,它的核心职责就是制定并执行一套规则:哪个进程先占用CPU、能占用多久、以及什么时候必须让位。这套规则的设计水平,直接决定了整个系统是快如闪电还是卡顿不堪,能同时处理多少任务,以及在高负载下的稳定性。很多时候,服务器响应慢、应用卡顿,问题未必出在硬件性能不足,而很可能是因为调度策略未能与业务场景良好适配。

一、Linux 内核调度的核心原理

1.1 调度的本质

要理解调度,首先要抓住它的核心矛盾:在CPU资源有限的情况下,如何平衡“效率”与“公平”。调度器既要竭尽全力让CPU保持忙碌(提升利用率),又要确保每个等待中的进程都有机会获得运行时间(防止某些进程被“饿死”)。

想象一下,如果没有调度机制会怎样?你运行一个大型计算任务,它会一直霸占着CPU,导致其他所有程序(微信、浏览器、终端)全部卡死,你只能眼睁睁等它跑完才能操作。这种“单进程独占CPU”的场景,无疑是日常使用中的灾难。

调度机制主要依赖两个核心手段来解决资源竞争问题:时间片轮转和优先级抢占。我们可以通过简单的命令来窥探系统当前的调度策略配置:

# 查看指定进程的调度策略(以PID=1为例,init进程)

chrt -p 1

# 查看系统调度器相关参数(CFS调度器的时间片配置)

cat /proc/sys/kernel/sched_min_granularity_ns # 最小时间片(纳秒)

cat /proc/sys/kernel/sched_latency_ns # 目标延迟(纳秒)

- 时间片轮转 就像“轮流值日”:CPU时间被切分成一个个微小的片段(例如10毫秒),每个就绪进程轮流占用CPU,时间片用完后就被切换出去,让下一个进程运行。从宏观上看,所有进程就像在同时运行一样。

- 优先级抢占 则更为直接:当一个更高优先级的进程准备就绪时,它会直接“插队”,立即抢占当前正在运行的低优先级进程的CPU使用权。这就像医院的急诊病人,可以优先获得诊疗资源。

1.2 三大调度策略

Linux内核并非对所有进程“一刀切”,而是针对不同场景的需求,设计了三种主要的调度策略,以实现精准的资源匹配。

在深入解析每种策略前,我们先看看如何通过命令为进程设置不同的调度策略:

# 1. 设置进程为实时SCHED_FIFO策略(优先级99,最高)

chrt -f -p 99 [PID]

# 2. 设置进程为普通SCHED_NORMAL策略(默认)

chrt -o -p 0 [PID]

# 3. 设置进程为限期SCHED_DEADLINE策略(截止时间优先)

chrt -d -p 1000000 2000000 3000000 [PID]

# 解释:-d 后三个参数分别是:周期(ns)、截止时间(ns)、运行时间(ns)

1. 实时调度策略 (Real-Time)

主要用于对延迟要求极为苛刻的场景,例如音视频实时编码、工业控制等,延迟几毫秒就可能导致严重问题。它又分为两种:

- SCHED_FIFO (先进先出):进程一旦获得CPU,就会一直运行,直到它主动放弃(如等待I/O)或被另一个更高优先级的实时进程抢占。它没有时间片的概念。例如,实时音频处理进程常采用此策略以确保无卡顿。

- SCHED_RR (时间片轮转):在

SCHED_FIFO的基础上,为相同优先级的实时进程引入了时间片。当进程的时间片用完,它会被放到同优先级队列的末尾,让其他就绪的实时进程运行。这保证了多个实时任务间的公平性。

2. 普通调度策略 (Normal)

这是我们日常接触最多的策略,适用于浏览器、文本编辑器、Web服务器等绝大多数应用。

3. 限期调度策略 (Deadline)

针对有明确截止时间的任务,例如自动驾驶中的传感器数据处理,必须在规定时间窗口内完成计算。它基于 EDF (最早截止时间优先) 算法,总是优先调度截止时间最近的任务。上文代码已展示其设置方法。

总结来说,Linux通过多样化的调度策略,实现了 “按需分配” ,这正是其调度系统灵活且强大的关键所在。

二、进程优先级

2.1 优先级层级

如果说调度策略是“比赛规则”,那么进程优先级就是“插队权”。Linux为进程定义了清晰的优先级层级,从高到低依次为:停机(Stop) > 限期(Deadline) > 实时(Real-Time) > 普通(Normal) > 空闲(Idle)。层级越高,“抢到”CPU的能力就越强。

我们可以通过命令直观地查看进程的优先级信息:

# 查看进程的静态优先级、实时优先级(以PID=1234为例)

ps -o pid,ni,pri,rtprio 1234

# 解释:

# ni:nice值(-20~19),普通进程优先级的关键参数

# pri:动态优先级,调度器实际使用的优先级

# rtprio:实时优先级(1~99,非实时进程为0)

- 限期进程 拥有最高的调度优先级,其顺序由各自的截止时间决定,越紧迫的越先执行。

- 实时进程 次之,其

rt_priority范围是1到99,数值越大,优先级越高。工业控制任务通常设置为90以上。

- 普通进程 是我们最常打交道的。它们的静态优先级范围是100到139,与

nice值挂钩(静态优先级 = 120 + nice值)。nice值越小,优先级越高。例如,将浏览器的nice值设为-5,其静态优先级就是115,比默认nice=0(优先级120)的进程更容易获得CPU。

- 空闲进程 是“兜底”的,只有系统完全没有其他任务可运行时才会执行,目的是避免CPU完全空转浪费能源。

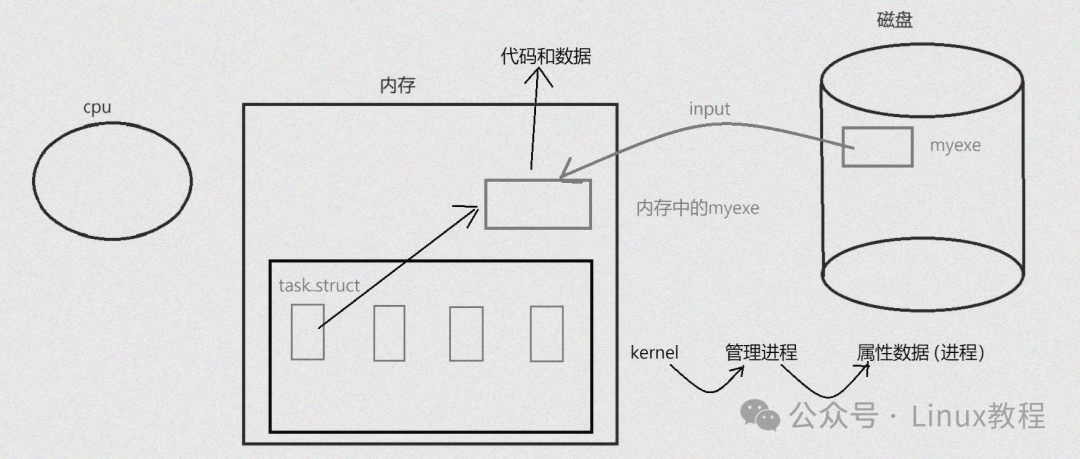

2.2 优先级参数解析

在Linux内核中,每个进程都由一个task_struct结构体来描述,其中包含4个核心的优先级参数。理解它们,就能明白调度器决策的底层逻辑。

通过简化的内核代码片段,我们可以一窥这些参数:

// 简化的task_struct优先级相关参数

struct task_struct {

int prio; // 动态优先级,调度器实际使用

int static_prio; // 静态优先级,由nice值计算(120+nice)

int normal_prio; // 推导后的正常优先级(结合静态/实时优先级)

int rt_priority; // 实时优先级(1~99,非实时进程为0)

};

- prio (动态优先级):这是调度器在进行选择时真正参考的数值。它并非一成不变,系统会根据进程的交互行为动态调整。例如,一个进程如果长时间处于等待状态(如等待用户输入),系统可能会提升其

prio,确保它在下次能被更快调度,避免“饥饿”。

- static_prio (静态优先级):普通进程的“基础分”,由

nice值计算得出。我们可以使用renice命令修改运行中进程的nice值,从而影响其静态优先级。

# 把PID=1234的进程nice值设为-5(提高优先级)

renice -n -5 -p 1234

# 把PID=5678的进程nice值设为10(降低优先级)

renice -n 10 -p 5678

- normal_prio (正常优先级):这是一个中间推导值。对于实时进程,它等于

(MAX_RT_PRIO-1) - rt_priority;对于普通进程,它等于static_prio。主要用于调度器内部快速比较。

- rt_priority (实时优先级):实时进程的专属属性,非实时进程此值为0。实时进程间的优先级高低完全由此值决定。

三、核心组件

3.1 调度类(sched_class)

Linux调度系统的模块化与灵活性,核心在于 调度类 的设计。每种调度策略都对应一个调度类,这些类按照固定的优先级顺序排列。调度器会从最高优先级的调度类开始,寻找可运行的进程。

内核中主要有5种调度类,优先级从高到低为:stop_sched_class > dl_sched_class > rt_sched_class > fair_sched_class > idle_sched_class。通过简化的结构体,我们可以了解其设计思想:

// 简化的调度类结构体

struct sched_class {

// 挑选下一个要执行的进程

struct task_struct *(*pick_next_task)(struct rq *rq);

// 放入就绪队列

void (*enqueue_task)(struct rq *rq, struct task_struct *p, int flags);

// 移出就绪队列

void (*dequeue_task)(struct rq *rq, struct task_struct *p, int flags);

// 调度类优先级(从高到低)

} stop_sched_class, dl_sched_class, rt_sched_class, fair_sched_class, idle_sched_class;

- 停机调度类 (stop_sched_class):优先级最高,用于执行像进程迁移这样的特殊任务,确保它能立即抢占所有其他进程。

- 限期调度类 (dl_sched_class):对应

SCHED_DEADLINE策略,使用红黑树管理进程,按截止时间排序,总是挑选截止时间最近的进程执行。

- 实时调度类 (rt_sched_class):对应

SCHED_FIFO/RR策略,为每个实时优先级维护一个队列,并利用位图快速找到最高优先级的非空队列,保证调度决策的O(1)时间复杂度。

- 公平调度类 (fair_sched_class):普通进程的默认调度类,基于CFS(完全公平调度器),目标是公平分配CPU时间。

- 空闲调度类 (idle_sched_class):优先级最低,仅在系统无任何其他可运行任务时执行空闲任务。

这种模块化设计的最大优势是可扩展性。若要支持一种新的调度策略,只需实现一个新的调度类并将其插入到优先级链表中即可,无需改动整个内核调度框架。

3.2 CFS 完全公平调度器

对于普通进程的调度,CFS(Completely Fair Scheduler,完全公平调度器) 是当之无愧的核心。它的目标像一个公正的“分蛋糕者”:将CPU时间这块“蛋糕”尽可能公平地分给每个普通进程。

CFS最核心的创新在于摒弃了传统的固定时间片,引入了 虚拟运行时间 的概念。每个进程都有一个vruntime,用于记录它“已经消耗了多少CPU时间”,但这里的“时间”是经过权重校准的。vruntime增长越慢的进程,说明它“相对获得较少”,下次更应被调度。其计算公式为:

vruntime = 实际运行时间 × (NICE_0_LOAD / 进程权重)

其中,NICE_0_LOAD是基准权重(nice=0时默认为1024)。进程的nice值越小,其权重越大,在相同的实际运行时间下,它的vruntime增长得就越慢,从而能获得更多的CPU时间。

CFS使用一棵红黑树来管理所有就绪态的普通进程,树的节点键值就是vruntime。每次调度时,CFS只需选择红黑树最左侧(即vruntime最小)的进程来运行即可。我们可以通过debugfs查看相关信息(需要内核支持):

# 挂载debugfs(如果未挂载)

mount -t debugfs none /sys/kernel/debug

# 查看指定CPU的CFS就绪队列信息(以CPU0为例)

cat /sys/kernel/debug/sched/cpu0

举个例子:假设有A(nice=-5)、B(nice=0)、C(nice=5)三个进程,初始vruntime=0。运行一段时间后,由于权重不同,A的vruntime增长最慢,C增长最快。CFS会优先调度A,直到A的vruntime超过B,然后再调度B,如此循环,从而在宏观上实现带权重的公平。

四、实战:如何 “看透” 内核调度行为

4.1 ftrace 跟踪:捕捉调度事件轨迹

想要真正理解调度器在如何工作,最好的方法就是“跟踪”。ftrace是Linux内核内置的跟踪工具,无需修改内核代码,就能精确捕获进程唤醒、切换、迁移等关键事件,如同给调度过程安装了“行车记录仪”。

下面是一套完整的ftrace跟踪调度事件的实操命令:

# 1. 挂载debugfs(如果未挂载)

mount -t debugfs none /sys/kernel/debug

# 2. 清空之前的跟踪记录

echo > /sys/kernel/debug/tracing/trace

# 3. 启用调度事件跟踪(仅跟踪sched相关事件)

echo 1 > /sys/kernel/debug/tracing/events/sched/enable

# 4. 运行要跟踪的程序(比如运行一个测试进程)

./test_program &

# 5. 等待一段时间(比如10秒),然后停止跟踪

sleep 10

echo 0 > /sys/kernel/debug/tracing/events/sched/enable

# 6. 查看跟踪结果(筛选关键事件)

grep -E "sched_wakeup|sched_switch|sched_migrate_task" /sys/kernel/debug/tracing/trace

跟踪结果中,我们需要重点关注三类事件:

- sched_wakeup:进程被唤醒,进入就绪队列。例如,一个等待I/O的进程在数据就绪后被唤醒。

- sched_switch:发生进程切换。记录了谁让出了CPU,谁获得了CPU。

- sched_migrate_task:进程在不同CPU核心之间迁移。

通过分析这些事件的时间戳,我们可以计算出进程从被唤醒到真正获得CPU执行的延迟。如果延迟过高,可能意味着就绪队列过长或进程优先级设置不合理。

4.2 perf 性能分析:揪出调度相关的性能痛点

如果说ftrace擅长“跟踪细节”,那么perf则擅长“宏观统计与瓶颈定位”。它能监控诸如上下文切换次数、CPU迁移次数等全局指标,并能捕捉调度事件的调用栈,帮助快速定位性能热点。

以下是几个常用的perf调度分析命令:

# 1. 监控上下文切换、CPU迁移等关键指标(持续10秒)

perf stat -e context-switches,cpu-migrations,sched:sched_switch -a sleep 10

# 2. 采集调度切换事件的调用栈,保存到perf.data文件

perf record -e sched:sched_switch -g -a sleep 10

# 3. 查看采集结果

perf report

# 生成火焰图(需先下载FlameGraph脚本)

# perf script | ./stackcollapse-perf.pl | ./flamegraph.pl > sched_flamegraph.svg

需要重点关注的指标:

- 上下文切换 (context-switches):每次切换都需要保存和恢复进程上下文(寄存器、页表等),过于频繁的切换会造成显著开销。如果每秒切换次数异常高(如数万次),可能意味着存在大量短生命周期线程或不合理的I/O阻塞。

- CPU迁移 (cpu-migrations):进程在不同CPU核心间迁移会导致缓存失效(Cache Miss),增加内存访问延迟。对于计算密集型任务,频繁迁移会损害性能。

通过perf report或生成的火焰图,可以清晰地看到哪些函数或代码路径最频繁地触发了调度事件,从而定位到需要优化的代码模块。

4.3 CPU 亲和性与负载均衡:优化多核调度效率

在多核系统上,优化调度效率的两个关键点是:CPU亲和性 和 负载均衡。

2. 将进程绑定到CPU0和CPU1

taskset -cp 0,1 1234

或用掩码设置:taskset -p 3 1234 (二进制11)

3. 启动进程时直接绑定到CPU2

taskset -c 2 ./test_program

* **负载均衡 (Load Balancing)**:确保所有CPU核心的负载大致相当,避免有些核心忙死,有些核心闲死。Linux内核的负载均衡器会自动工作,但我们也可以观察和微调。

```bash

# 1. 查看每个CPU的负载情况(每秒刷新一次)

mpstat -P ALL 1

# 2. 查看和调整负载均衡的“迁移成本”参数

cat /proc/sys/kernel/sched_migration_cost_ns # 进程迁移成本(纳秒)

# 值越大,调度器越“不情愿”迁移进程

echo 500000 > /proc/sys/kernel/sched_migration_cost_ns

如果mpstat显示CPU0使用率90%而CPU1仅20%,说明负载不均衡。在某些场景下,适当降低sched_migration_cost_ns可以让负载均衡器更积极地迁移任务。

五、调度优化实践

5.1 调整 nice 值:轻量级优化普通进程优先级

调整nice值是最简单直接的优化手段,无需重启进程或修改内核。核心原则是:为需要快速响应的交互式进程赋予更低的nice值(更高的优先级),为耗时的后台计算任务赋予更高的nice值(更低的优先级)。

看两个典型场景:

# 场景1:启动一个低优先级的后台备份任务(nice=10)

nice -n 10 tar -zcvf /backup/archive.tar.gz /home/user/data

# 场景2:提高正在运行的SSH服务进程的优先级(nice=-5),保障登录流畅

sshd_pid=$(pgrep -o sshd) # 获取一个sshd进程PID

renice -n -5 -p $sshd_pid

# 验证调整结果

ps -o pid,ni,comm -p $sshd_pid

在服务器上,你可以将数据库、Web服务等关键服务的nice值适当调低,而将日志分析、备份等批量任务的nice值调高,从而在资源紧张时保障核心业务的响应速度。

5.2 cgroups 资源隔离:多租户场景的精准管控

在云主机、容器等多租户场景下,防止某个用户的进程耗尽CPU资源导致其他用户服务受损至关重要。cgroups (Control Groups) 正是实现这种资源隔离和限制的利器。

以主流的cgroups v2为例,其通过cpu.weight参数(范围1~10000)来按比例分配CPU时间。以下是在一个系统中为MySQL和PHP-FPM服务分配不同权重的示例:

# 1. 确认系统启用cgroups v2

mount | grep cgroup2

# 2. 创建cgroup分组

mkdir -p /sys/fs/cgroup/mysql

mkdir -p /sys/fs/cgroup/php-fpm

# 3. 设置CPU权重(MySQL获得更多CPU时间)

echo 500 > /sys/fs/cgroup/mysql/cpu.weight

echo 200 > /sys/fs/cgroup/php-fpm/cpu.weight

# 4. 将进程加入对应的cgroup

echo $(pgrep mysqld) > /sys/fs/cgroup/mysql/cgroup.procs

echo $(pgrep php-fpm) > /sys/fs/cgroup/php-fpm/cgroup.procs

# 5. 查看cgroup资源使用统计

cat /sys/fs/cgroup/mysql/cpu.stat

此配置意味着,当CPU资源竞争时,MySQL服务组将获得大约500/(500+200) ≈ 71%的CPU时间,而PHP-FPM组获得约29%。这能有效保证数据库服务的处理能力。注意:对于实时进程,通常需要将其放入独立的cgroup子树并进行特殊配置,以避免被cgroup的配额限制其高优先级的特性。

5.3 混合调度策略:平衡实时性与公平性的最佳实践

生产环境往往是复杂的混合场景。例如,一个电商平台既要保证支付接口的极低延迟(实时性),又要让商品浏览、搜索等普通服务公平流畅地运行。这时就需要采用混合调度策略。

一个常见的实践是 “20/80原则”:将大部分(如80%)CPU资源通过CFS公平地分配给普通进程,同时预留一小部分(如20%)资源,并采用实时调度策略来保障最关键的任务。这通常需要结合cgroups和chrt命令来实现。

# 1. 将核心支付服务进程设置为最高实时优先级

pay_pid=$(pgrep pay-service)

chrt -f -p 99 $pay_pid

# 2. 创建cgroup,并限制该组所有进程最多使用20%的CPU时间

mkdir -p /sys/fs/cgroup/realtime

echo 200000 1000000 > /sys/fs/cgroup/realtime/cpu.max # 20% in a 1s period

echo $pay_pid > /sys/fs/cgroup/realtime/cgroup.procs

# 3. (可选)在业务高峰时段,临时扩大实时任务的配额

echo 300000 1000000 > /sys/fs/cgroup/realtime/cpu.max

# 4. 将CPU调控器设置为performance模式,减少频率切换带来的延迟

echo performance | tee /sys/devices/system/cpu/cpu*/cpufreq/scaling_governor

解释:支付进程被设置为SCHED_FIFO且优先级99,确保其一旦就绪就能抢占CPU。同时,它被放入一个cpu.max限制为20%的cgroup中,这既保证了它能获得必要的资源,又防止了它因错误而无限占用CPU导致系统僵死。performance CPU调频模式则保证了CPU以最高性能状态运行,进一步降低处理延迟。

这种混合策略,在保障关键业务SLA(服务等级协议)的同时,维持了系统整体的公平性与稳定性,是许多高性能服务端的常用配置。