开工第一天,AI圈就爆出了一条大新闻。

国外大模型公司Anthropic在官网发布公告,直接点名炮轰包括DeepSeek在内的三家中国AI公司,指控其对公司旗下的Claude模型进行了“工业规模的蒸馏攻击”。

这份措辞严厉的公告,将这一事件定义为一次有组织、大规模的违规行为。那么,究竟什么是“蒸馏攻击”?Anthropic的指控依据又是什么?

什么是“蒸馏攻击”?

根据Anthropic的定义,所谓的“蒸馏攻击”,是指攻击者通过海量、结构化的API调用,将目标模型(此处指Claude)当作“老师”,通过批量提问并获取答案,最后将这些高质量的问答数据拿回去训练自己的模型。

Anthropic将这种行为称为 “工业化能力抽取”。

Anthropic指控的“六步攻击法”

Anthropic在檄文中详细描述了他们所发现的攻击路径,其工程化和组织化程度令人侧目。

第一步:绕过地域与风控,建立大规模访问通道

由于Anthropic未在中国大陆提供商业服务,攻击者首先要解决的是如何大规模、稳定地访问Claude。

- 注册大量伪造账号:约2.4万个欺诈账户。

- 使用商业代理/转售服务:通过这些“马甲”批发Claude等模型的访问权限。

- “九头蛇”集群架构:成千上万个账号搭配多条接入路径分发流量,实现“封一个补一个”,避免单点失效。

这种架构就像搭建了一个自动化的问答工厂。

第二步:设计提示词,将聊天转化为训练数据生产线

蒸馏的关键在于“把问题问得像训练集”。Anthropic指出,攻击流量具有明显特征:

- 高重复结构与极窄的能力域聚焦。

- 跨大量账号同步出现。

- 内容精准对应高价值能力,如:

智能体推理、工具调用、编程等。

攻击者诱导Claude输出大量高质量“问答对”,直接用于后续的监督微调。

第三步:获取推理过程,实现“深度抄袭”

这是更高级的手法。如果只获取最终答案,学生模型只能学到表象。但若能将模型的“推理轨迹”也提取出来,学习效率会大幅提升。

Anthropic提到一个典型手法:让Claude“想象并写出完成该回答的内部推理”,逐步输出思维链。这等于在规模化生成思维链训练数据。

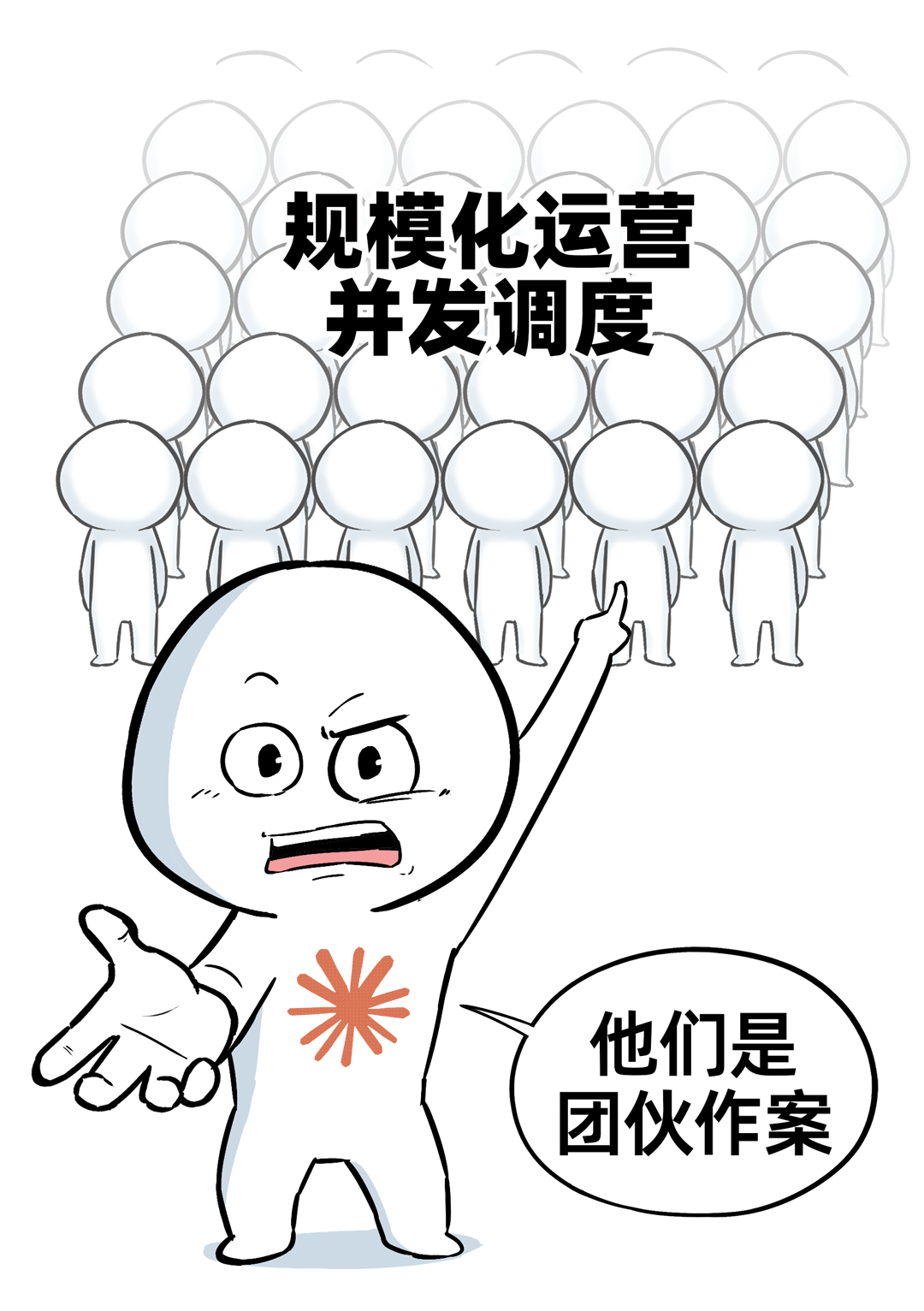

第四步:规模化运营与反封禁工程

整个攻击像跑广告或DDoS一样工程化。

- 跨账号同步流量:同一套提示词模板在不同账号同时运行,类似负载均衡。

- 共享支付方式:成为同一组织运营的证据。

- 快速迭代策略:Anthropic观察到,当自家发布新模型后,攻击方能在24小时内将近一半流量切换至新模型,以抽取其最新能力。

第五步:将抽取的能力“灌注”回自家模型

获取数据后,典型的训练路径是:

- 清洗与去重

- 监督微调对齐

- 构建强化学习奖励模型

- 专项能力训练(如智能体、工具调用等)

Anthropic控诉,这种方式能让竞争者以远低于从头训练的成本,快速补齐关键能力短板。

第六步:Anthropic如何锁定攻击者?

Anthropic在公告中也列举了其检测和归因手段:

- API流量中的行为指纹与分类器。

- 识别“思维链诱导”等用于构造推理数据的特定模式。

- 跨大量账号的协同检测(同模板、同节奏、同目标)。

- 与云厂商、行业伙伴共享基础设施痕迹(IP、元数据等)进行归因。

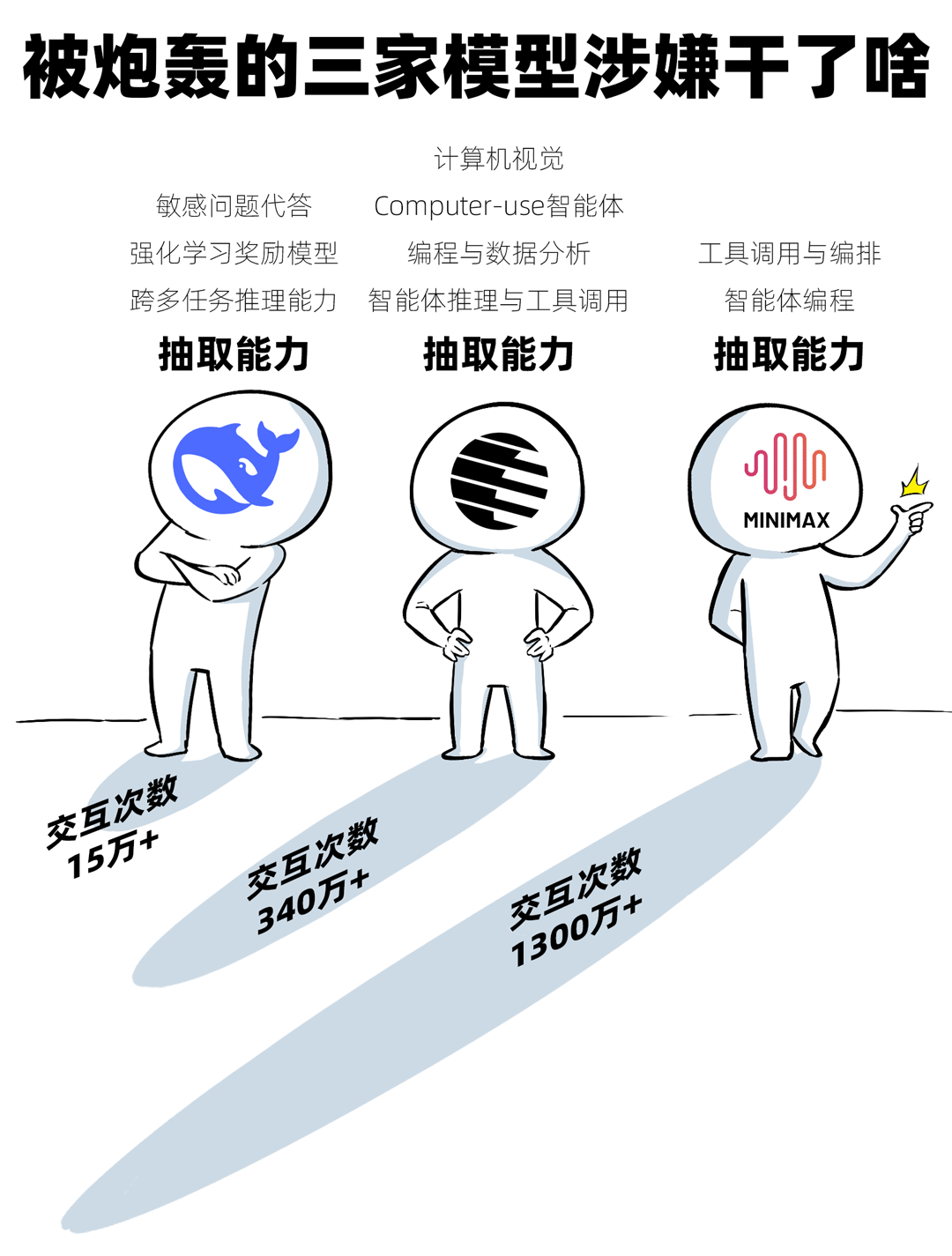

同时,公告给出了三家被指控公司的具体“涉案”数据,包括交互次数和涉嫌抽取的能力范围。

如图所示,据Anthropic称,MiniMax的涉嫌违规交互高达1300万次,而DeepSeek则为15万次。

行业反应与事件余波

截至目前,涉事的DeepSeek、Moonshot AI和MiniMax三家公司均未对此事作出公开回应。

然而,特斯拉CEO埃隆·马斯克却在第一时间转发了相关消息,并发表了一番极具讽刺意味的评论:“带劲,他们怎么敢偷走Anthropic从人类程序员那里偷来的东西?” 这无疑是在暗指大模型训练数据本身的版权争议问题,让整个事件的戏剧性更上一层楼。

此事在云栈社区等开发者社群中也引发了广泛讨论。抛开情绪化的指责,它实际上暴露了AI行业快速发展下的一些灰色地带与潜在风险。

一方面,通过API交互数据来改进模型性能是一种已知的技术路径(如指令微调);另一方面,当这种行为演变为滥用服务条款、通过欺诈手段进行工业化数据抽取时,就构成了明确的违规甚至侵权。这起事件也为所有AI服务提供商敲响了警钟,必须加强针对蒸馏攻击这类新型威胁的检测与防御能力。

对于被点名的中国AI公司而言,这场“炮轰”虽然实际业务影响可能有限,但在品牌和声誉上的挑战是实实在在的。压力或许也是一种动力。就像很多社区用户所关心的:备受期待的DeepSeek V4,能否用绝对的技术实力,给出最有力的回应?

我们拭目以待。