一、面试基础与技术栈考察

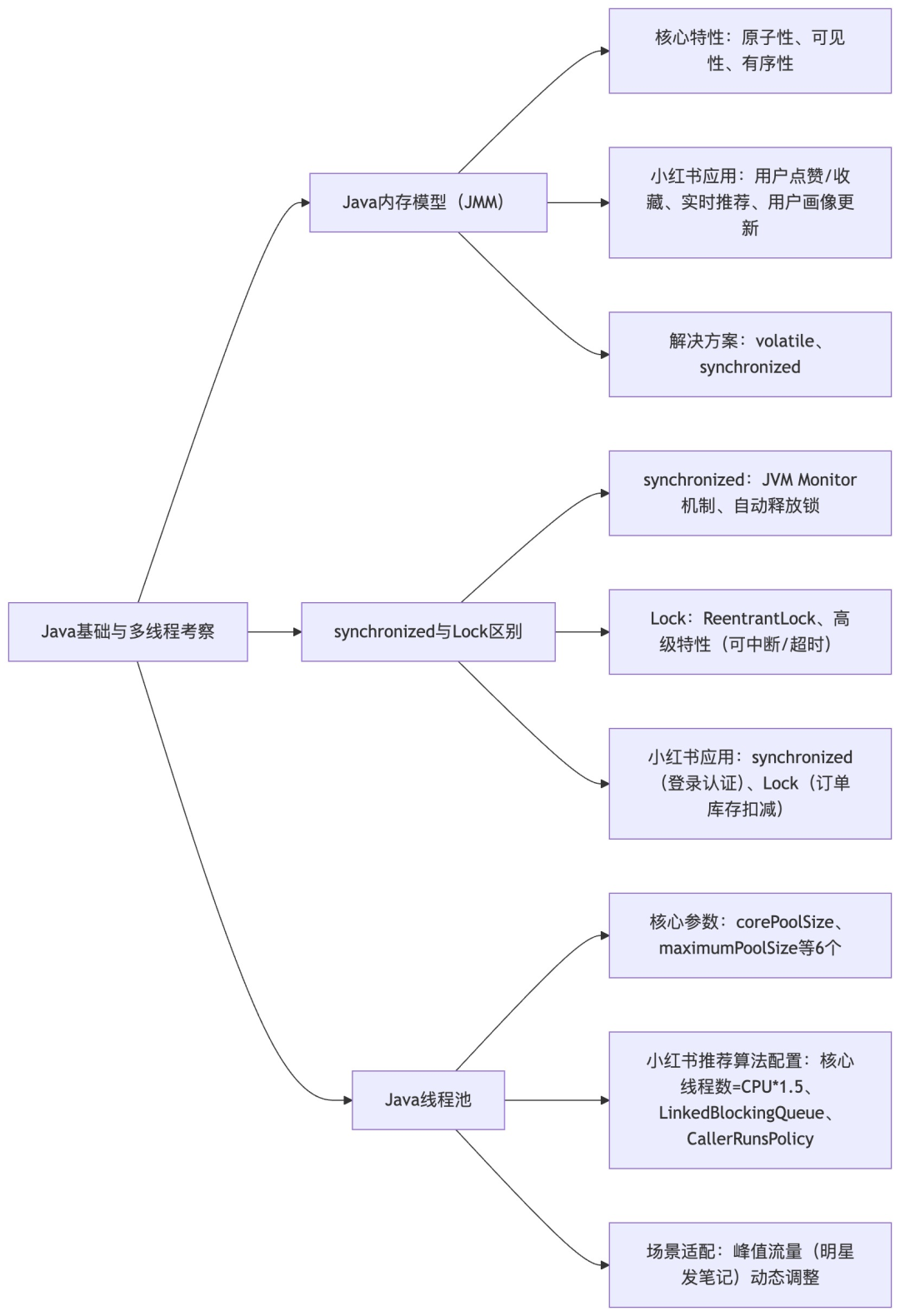

1.1 Java 基础与多线程考察

对于准备小红书这类公司面试的 Java 开发者来说,扎实的基础与将技术原理映射到高并发业务场景的能力至关重要。下面结合具体问题,梳理核心考点。

Q1:请介绍一下你对 Java 内存模型的理解,以及在小红书高并发场景下的应用?

A1: Java 内存模型(JMM)定义了线程和主内存之间的抽象关系。在小红书处理用户评论、点赞、收藏等高频操作的场景下,深刻理解 JMM 是保障数据一致性的基础。

JMM 的核心围绕三个方面:原子性、可见性和有序性。以小红书的实时推荐系统为例,当多个算法线程同时读取和更新用户画像数据时,就可能会遇到数据不一致的问题。这时,volatile 关键字可以保证用户兴趣向量修改后对所有线程立即可见,而 synchronized 块则能确保关键操作(如原子性地更新多个关联标签)的原子性。理解并应用这些特性,是解决高并发数据竞争问题的关键。

Q2:请解释一下 Java 中 synchronized 和 Lock 的区别,以及在小红书业务场景中的使用选择?

A2: synchronized 和 Lock 都能实现线程同步,但选择哪一种,需要结合具体业务场景的复杂度与性能要求。

synchronized 是 Java 关键字,基于 JVM 内置的 Monitor 机制,使用简单且能自动释放锁。在小红书的用户登录认证这类锁持有时间短、逻辑简单的场景中,使用 synchronized 就非常合适。

Lock 接口(如 ReentrantLock)则提供了更精细的控制能力,比如可中断、超时、公平锁等特性。想象一下小红书的订单库存扣减流程,步骤多且耗时长,使用 ReentrantLock 的 tryLock(long time, TimeUnit unit) 方法设置超时,可以有效避免线程因锁问题长时间阻塞,提升系统响应能力。

Q3:请描述一下 Java 线程池的核心参数,以及在小红书推荐算法中的配置策略?

A3: 配置一个高效的线程池,关键在于理解其核心参数:corePoolSize(核心线程数)、maximumPoolSize(最大线程数)、keepAliveTime(线程空闲存活时间)、workQueue(工作队列)和 handler(拒绝策略)。

在小红书的推荐算法服务中,配置需要贴合业务特点。例如,对于持续稳定的实时推荐计算,可将 corePoolSize 设为 CPU 核心数的 1.5 倍,以平衡计算资源利用与线程切换开销。然而,当遇到明星发布笔记这样的峰值流量时,就需要依赖更大的 maximumPoolSize 来弹性扩容,应对突发的计算需求。

工作队列的选择也需谨慎。推荐任务往往可以容忍一定延迟但绝不能丢失,因此常使用 LinkedBlockingQueue 这类无界队列进行缓冲。拒绝策略上,CallerRunsPolicy 是一个稳妥的选择,当线程池和队列都满载时,由调用者线程直接执行任务,保证了核心推荐逻辑的可用性。

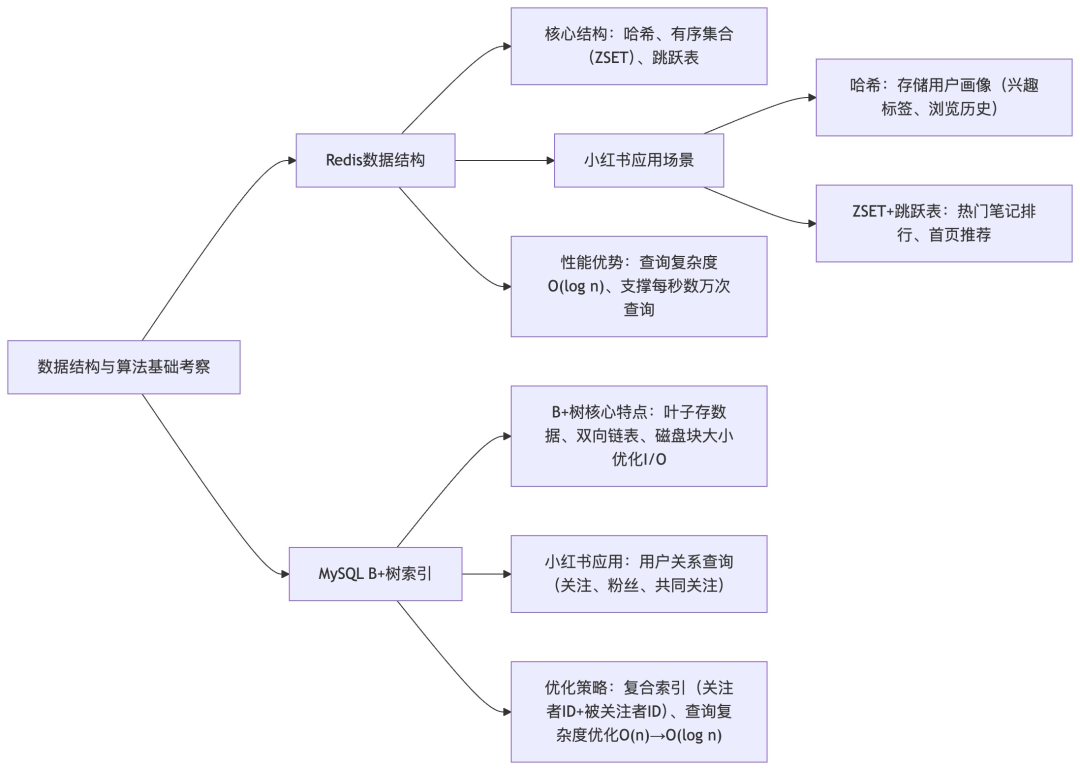

1.2 数据结构与算法基础

优秀的后端开发,必须理解数据如何被高效组织和访问。Redis 和 MySQL 作为两大核心存储,其数据结构的设计直接决定了业务性能的上限。

Q4:请介绍一下你对 Redis 数据结构的理解,以及在小红书缓存场景中的应用?

A4: Redis 丰富的数据结构是其在小红书技术架构中扮演核心角色的原因。

- 哈希(Hash):非常适合存储对象。例如,每个用户的画像(兴趣标签、浏览历史、互动记录)可以用一个哈希表来存储,键为用户ID,字段为各种画像维度,实现单键下的快速查询与局部更新。

- 有序集合(Sorted Set / ZSET):这是支撑排行榜功能的利器。笔记ID作为成员,根据一套综合公式(点赞、评论、完播率等)计算出的热度值作为分值。通过

ZREVRANGE 命令,毫秒级返回当前最热门的笔记列表,广泛应用于首页推荐和各类榜单。

- 底层与性能:ZSET 的底层实现之一跳跃表(Skip List),使其在百万级数据量下仍能保持 O(log n) 的查询效率,完美支撑小红书每秒数万次的高并发查询需求。

Q5:请解释一下 MySQL 的 B+ 树索引原理,以及在小红书用户关系查询中的优化?

A5: B+ 树索引是 MySQL InnoDB 引擎的默认索引结构,其设计非常适合范围查询和排序,这对社交关系查询至关重要。

B+ 树的核心特点包括:数据只存放在叶子节点,非叶子节点仅存储键值和指针用于导航;叶子节点间通过双向链表连接,便于范围扫描;每个节点大小约等于一个磁盘块,能最小化磁盘 I/O 次数。

在小红书用户关系查询中,如何应用?例如查询“用户A和用户B的共同关注者”。优化策略之一是建立(关注者ID, 被关注者ID)的复合索引。查询时,数据库可以先通过索引快速定位到用户A的所有关注记录(叶子节点链表遍历),再在其中筛选出用户B也关注的记录。利用 B+ 树的有序性,这种查询可以避免全表扫描,将时间复杂度优化至 O(log n) 级别,面对海量用户关系数据时优势明显。更多关于数据结构如何优化查询的讨论,可以在 算法/数据结构 板块深入探讨。

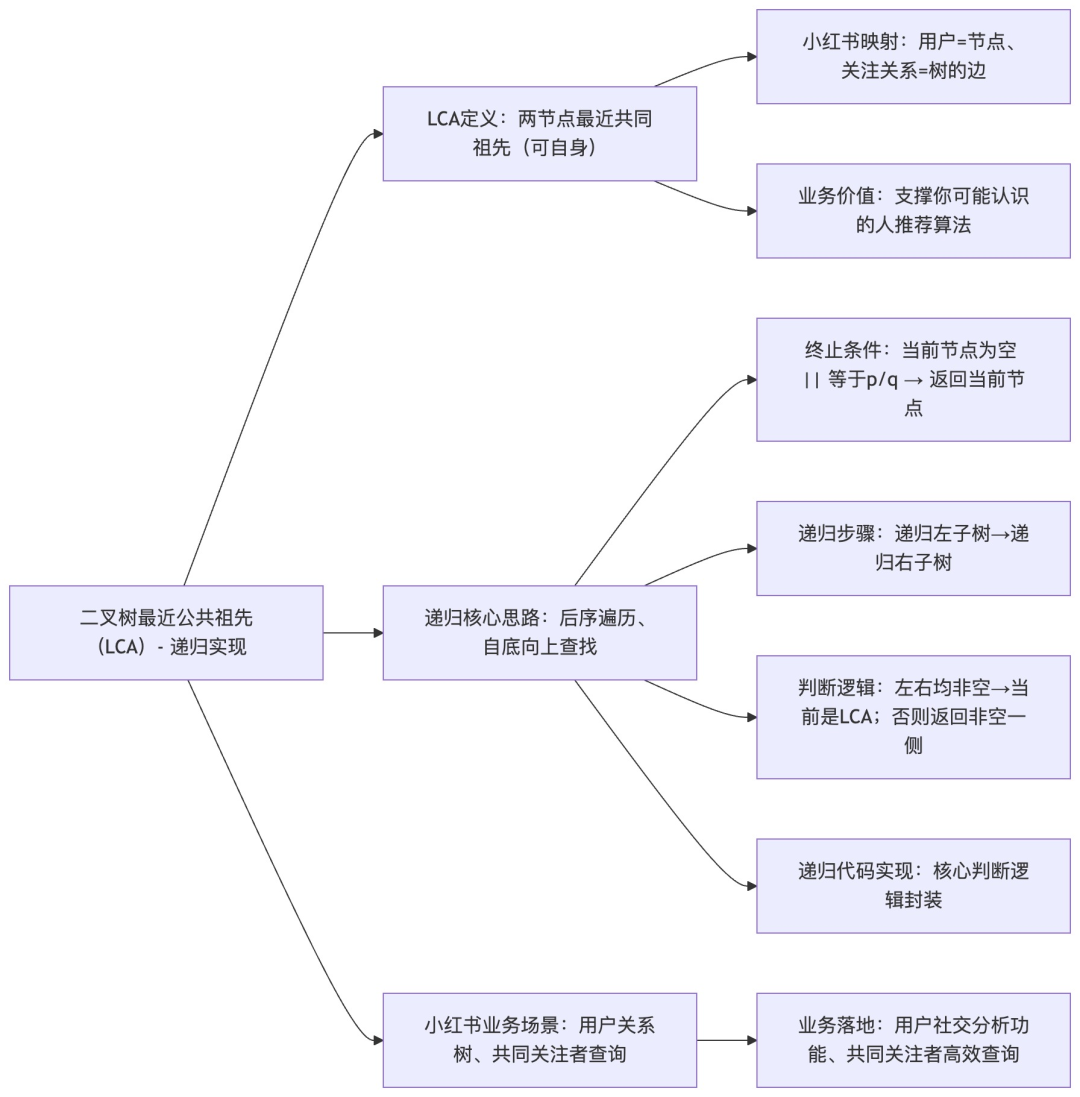

二、二叉树最近公共祖先(LCA)

2.1 基础递归实现与业务场景结合

二叉树相关算法不仅是面试常客,更能直接解决一些特定的业务问题。最近公共祖先(LCA)就是一个典型例子。

Q6:请实现二叉树最近公共祖先算法,并说明在小红书用户关系树中的应用?

A6: LCA 的定义是:在二叉树中,找到距离两个给定节点 p 和 q 最近的共同祖先节点(祖先可以是节点自身)。

一个优雅的解法是递归。思路是后序遍历(左->右->根),自底向上查找。

public TreeNode lowestCommonAncestor(TreeNode root, TreeNode p, TreeNode q) {

if (root == null || root == p || root == q) {

return root;

}

TreeNode left = lowestCommonAncestor(root.left, p, q);

TreeNode right = lowestCommonAncestor(root.right, p, q);

if (left != null && right != null) {

return root;

}

return left != null ? left : right;

}

递归逻辑解读:

- 终止条件:如果当前节点为空,或等于 p、q,则返回当前节点。

- 递归探查:分别在左右子树中寻找 p 和 q。

- 判断:如果左右子树均返回非空节点,说明 p 和 q 分居当前节点两侧,当前节点即为 LCA。否则,LCA 位于返回非空的那一侧子树中。

在小红书,可以将用户关注关系抽象为一棵树(尽管实际可能是图,但某些子结构可视为树)。例如,在“你可能认识的人”推荐功能中,通过寻找两个用户节点的 LCA,可以快速定位他们之间最近的共同关注者或社群节点,作为推荐依据,高效挖掘潜在社交关系。

2.2 迭代实现与性能优化

递归虽简洁,但在处理深度极大的树时(如小红书庞大的内容分类树)可能引发栈溢出风险。迭代版本则更为稳健。

Q7:请实现二叉树最近公共祖先的迭代版本,并分析其在大规模数据下的性能优势?

A7: 迭代实现的核心思路是:先遍历整棵树,记录每个节点的父节点;然后分别回溯 p 和 q 的路径,第一个交汇点即为 LCA。

public TreeNode lowestCommonAncestorIterative(TreeNode root, TreeNode p, TreeNode q) {

if (root == null) return null;

Map<TreeNode, TreeNode> parentMap = new HashMap<>();

Stack<TreeNode> stack = new Stack<>();

parentMap.put(root, null);

stack.push(root);

while (!parentMap.containsKey(p) || !parentMap.containsKey(q)) {

TreeNode node = stack.pop();

if (node.left != null) {

parentMap.put(node.left, node);

stack.push(node.left);

}

if (node.right != null) {

parentMap.put(node.right, node);

stack.push(node.right);

}

}

Set<TreeNode> ancestors = new HashSet<>();

while (p != null) {

ancestors.add(p);

p = parentMap.get(p);

}

while (q != null) {

if (ancestors.contains(q)) {

return q;

}

q = parentMap.get(q);

}

return null;

}

复杂度分析:此算法时间复杂度为 O(n),每个节点访问一次;空间复杂度为 O(n),用于存储父节点映射和祖先集合。虽然理论复杂度与递归相同,但避免了递归的函数调用开销和栈深度限制,在处理超大规模树结构时(如商品类目树中查询两个类目的最近公共父类目)更可靠。

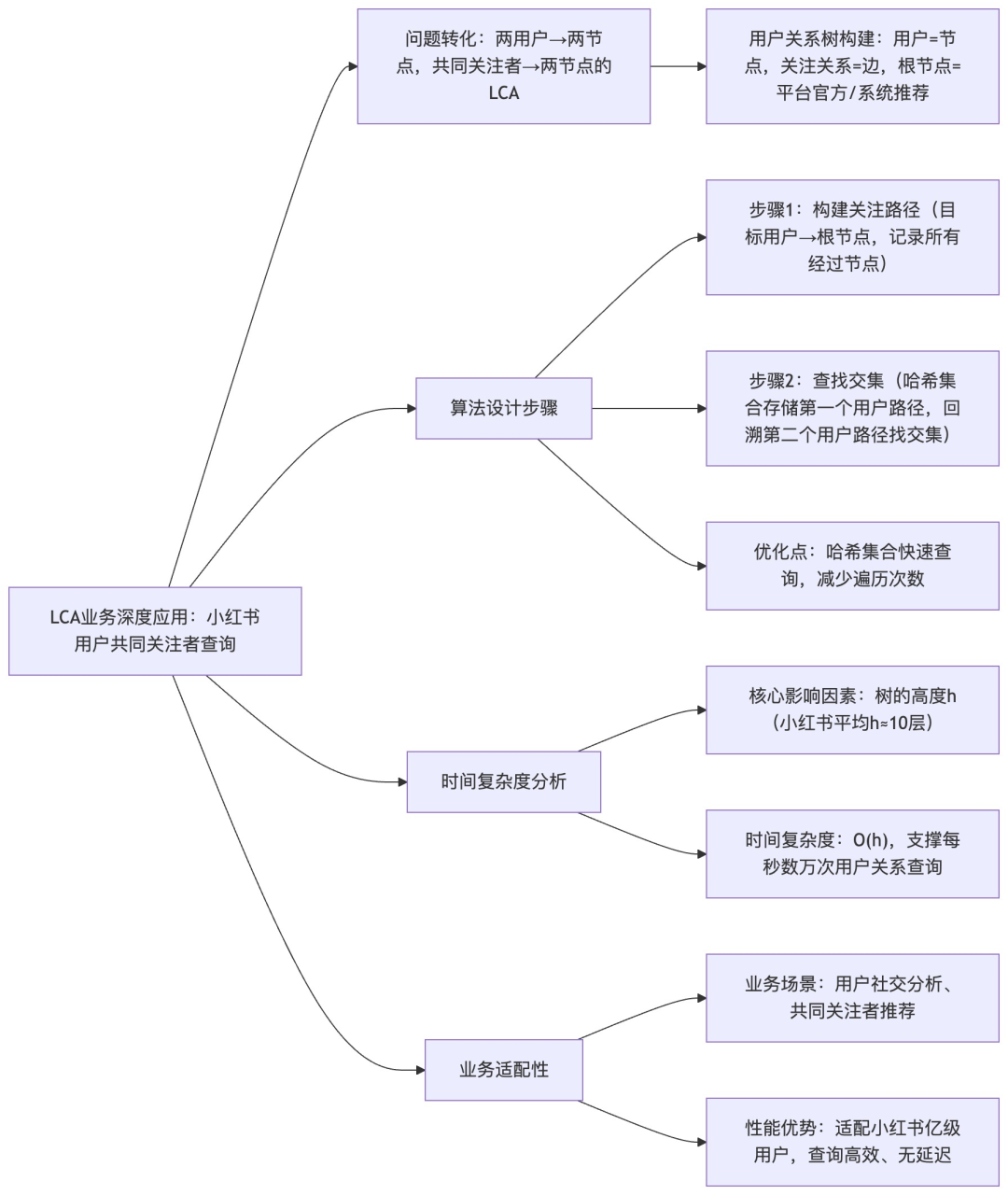

2.3 小红书业务场景深度应用

理解了 LCA 的算法,关键还要看如何将其“翻译”成解决业务问题的方案。

Q8:请设计一个算法,在小红书的用户关注关系树中查找共同关注的用户,并分析其时间复杂度?

A8: 将“查找用户A和用户B的共同关注者”转化为 LCA 问题,需要先对业务模型进行合理抽象。

我们可以构建一棵以“平台”为根节点的虚拟树,用户的关注关系作为从用户节点指向被关注者节点的边(方向朝上,指向父节点)。那么,两个用户的共同关注者,就是他们向上追溯到根节点的路径上的第一个公共交点,即 LCA。

算法步骤:

- 构建父关系映射:存储每个用户节点的父节点(即其关注的人中的一个,或指向系统根节点)。

- 回溯路径:从用户A开始,向上回溯直到根节点,将其路径上的所有节点存入一个哈希集合。

- 查找交汇点:从用户B开始向上回溯,检查每个祖先节点是否在用户A的路径集合中。第一个存在的节点即为最近共同关注者。

时间复杂度:这完全取决于树的高度 h(即用户关注路径的深度)。在小红书实际数据中,这个深度通常被控制在一个较小的常数范围内(例如平均10层左右),因此每次查询的时间复杂度近似 O(h),效率极高,足以支撑亿级用户社交关系下的实时查询。

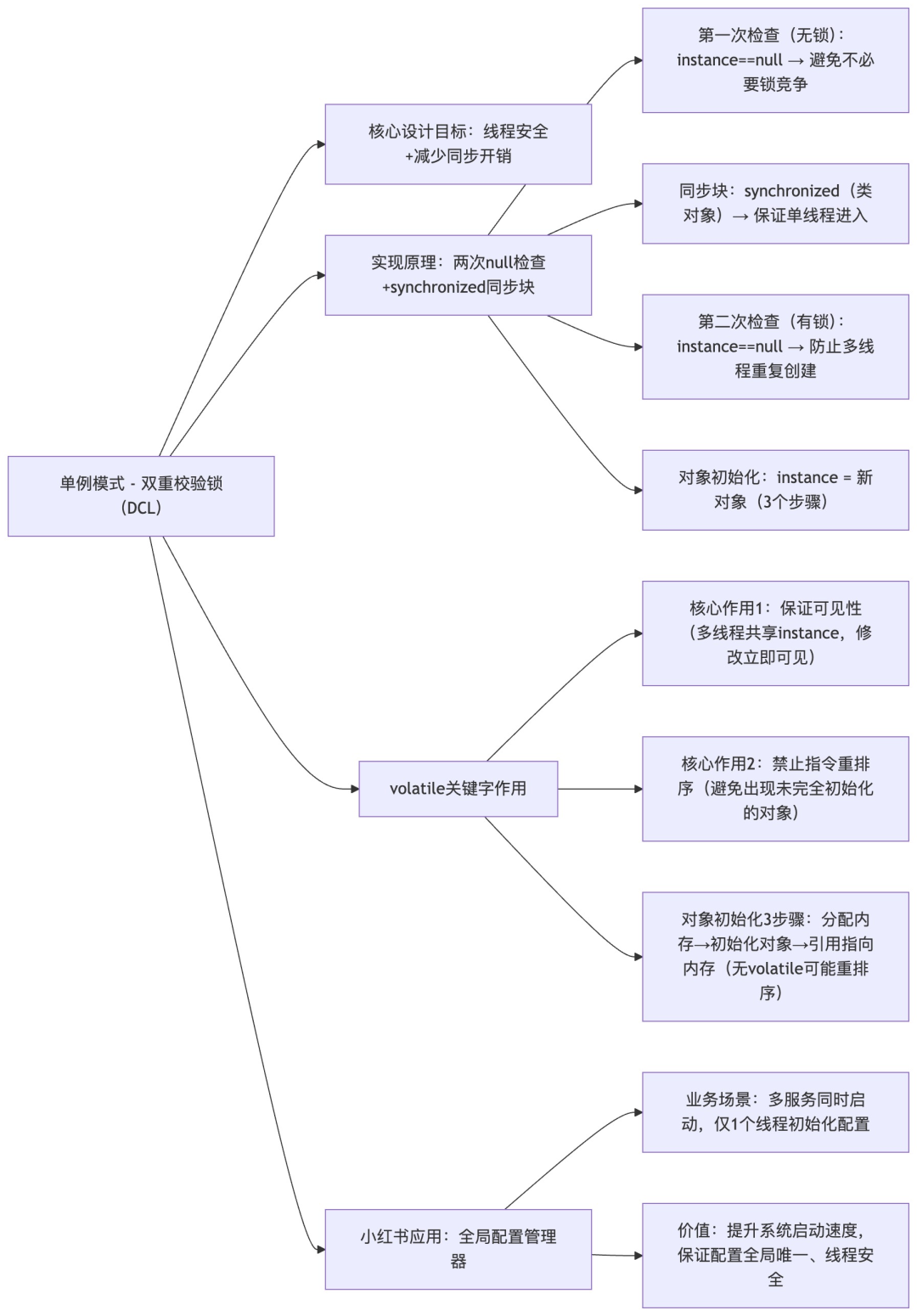

三、单例模式(双重校验锁)

3.1 双重校验锁实现原理

设计模式是面试中考察设计能力与并发理解的绝佳载体。双重校验锁(DCL)是实现线程安全单例的经典模式,广泛应用于全局配置、缓存管理器等场景。

Q9:请实现单例模式的双重校验锁版本,并解释 volatile 关键字的作用?

A9: DCL 的精髓在于通过两次判空检查,在保证线程安全的前提下,尽量减少同步锁带来的性能损耗。

public class RedBookConfiguration {

private volatile static RedBookConfiguration instance;

private RedBookConfiguration() {

loadConfiguration();

}

public static RedBookConfiguration getInstance() {

if (instance == null) { // 第一次检查,避免不必要的锁竞争

synchronized (RedBookConfiguration.class) {

if (instance == null) { // 第二次检查,防止重复创建

instance = new RedBookConfiguration();

}

}

}

return instance;

}

private void loadConfiguration() {

System.out.println("Loading configuration from remote config center...");

}

}

volatile 关键字在这里扮演了两个至关重要的角色:

- 保证可见性:确保一旦

instance 被初始化,修改能立即对其他线程可见。

- 禁止指令重排序:这是更关键且容易忽视的一点。对象初始化

instance = new RedBookConfiguration() 在 JVM 中可能被分解为三个步骤:

- ① 分配内存空间

- ② 初始化对象(调用构造方法)

- ③ 将引用

instance 指向分配的内存地址

如果没有 volatile,JVM 可能对 ② 和 ③ 进行重排序。导致其他线程可能在对象未完全初始化(步骤②未执行)时,就看到一个非空的 instance(步骤③已执行),从而访问到不完整的对象,引发程序错误。volatile 通过内存屏障禁止了这种重排序。

3.2 与其他单例实现方式的对比

单例模式有多种写法,了解它们的差异才能做出正确的技术选型。

Q10:除了双重校验锁,还有哪些单例模式的实现方式,以及在小红书不同场景下的选择?

A10: 选择合适的单例实现,取决于对线程安全、懒加载、序列化、反射攻击防护及性能的需求。

| 实现方式 |

线程安全 |

懒加载 |

性能 |

实现难度 |

小红书适用场景举例 |

| 饿汉式 |

是 |

否 |

高 |

低 |

系统启动即需的组件,如全局日志记录器。 |

| 同步方法 |

是 |

是 |

低 |

低 |

并发访问极低的工具类。 |

| 双重校验锁 |

是 |

是 |

高 |

中 |

高并发场景,如全局配置管理器、推荐模型加载器。 |

| 静态内部类 |

是 |

是 |

高 |

低 |

延迟初始化场景,如数据库连接池。 |

| 枚举单例 |

是 |

否 |

高 |

低 |

状态管理、需防反射/序列化破坏的场景,如订单状态机。 |

例如,在小红书的推荐服务中,一个庞大的深度学习模型可能需要数百MB内存,且加载耗时。使用 DCL 实现的模型加载器,可以确保模型只在首次请求时加载一次,后续所有请求都能无锁、快速地获取到已初始化的实例,兼顾了线程安全与高性能。

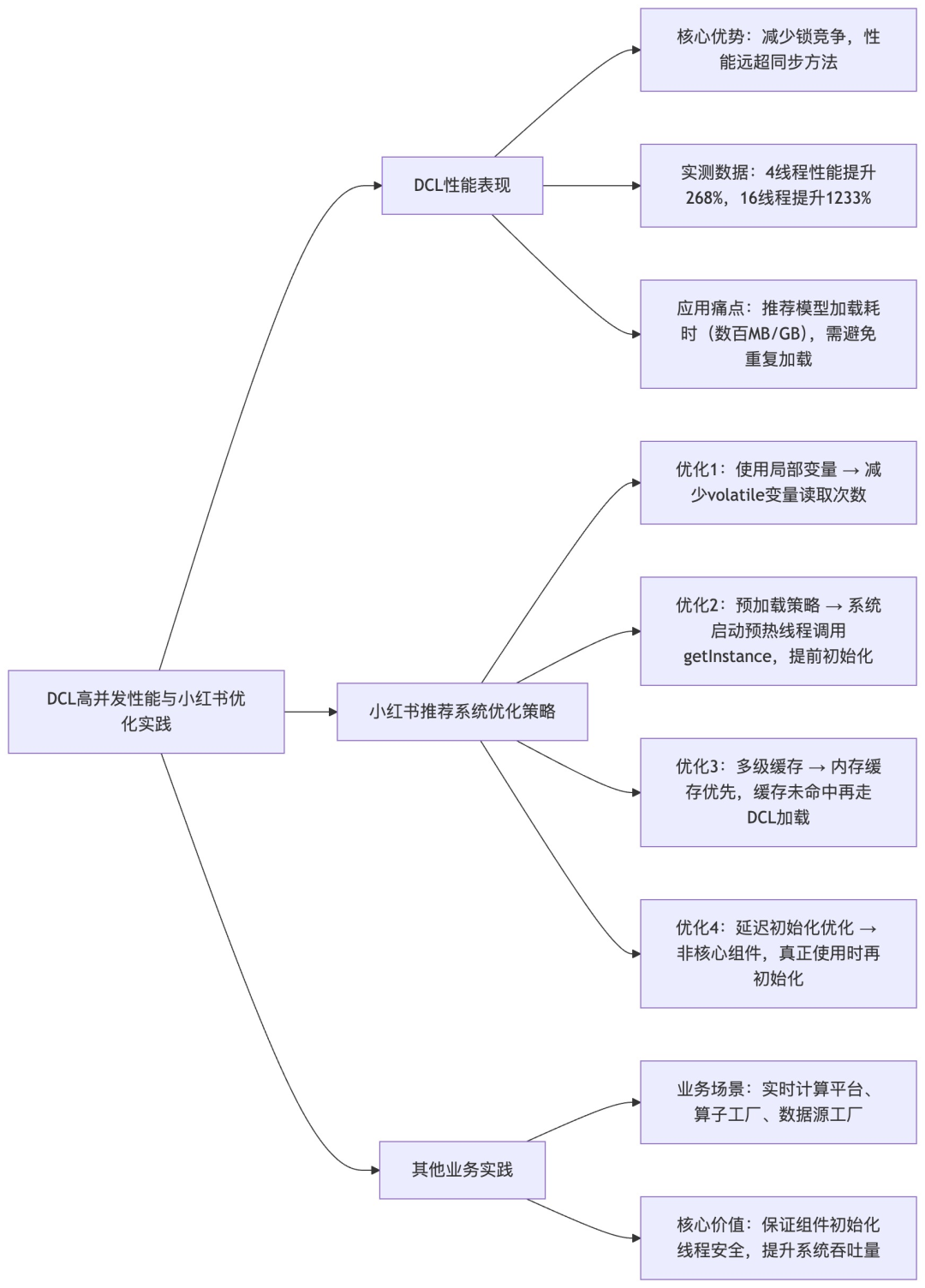

3.3 双重校验锁的性能优化与实践

理论上的 DCL 已经很优秀,但在小红书这样的极致性能要求下,仍有优化空间。

Q11:请分析双重校验锁在高并发场景下的性能表现,以及在小红书推荐系统中的优化策略?

A11: DCL 的性能优势在于成功地将大多数情况下的实例获取操作变成了无锁的读操作(第一次检查命中)。实测表明,其性能远超全同步方法。

在小红书推荐系统中,面对模型加载耗时、高并发获取的挑战,我们在标准 DCL 基础上进行了深度优化:

- 局部变量缓存:在

getInstance() 方法内部,先将 volatile 的 instance 引用赋值给一个局部变量,后续都使用这个局部变量。这样能减少对 volatile 变量的直接读取次数,因为访问局部变量比访问 volatile 成员变量更快。

- 预加载(预热)策略:在系统启动时,通过后台线程主动调用

getInstance() 方法,提前完成重量级单例对象(如推荐模型)的初始化,避免第一次线上请求时的长尾延迟。

- 结合多级缓存:对于某些单例数据,可以引入内存缓存。先查缓存,缓存未命中再走 DCL 加载流程,进一步减轻锁竞争压力。

- 精细化延迟初始化:并非所有组件都需在

getInstance() 中完全初始化。对于非核心或昂贵的部分,可以采用更惰性的策略,仅在真正用到时才初始化。

这些优化策略,使得 DCL 模式在小红书的实时计算平台、算子工厂等核心组件管理中,既能保证线程安全,又能实现极高的系统吞吐量。对于 Java 并发编程的更多高级技巧,欢迎到 Java 板块交流学习。

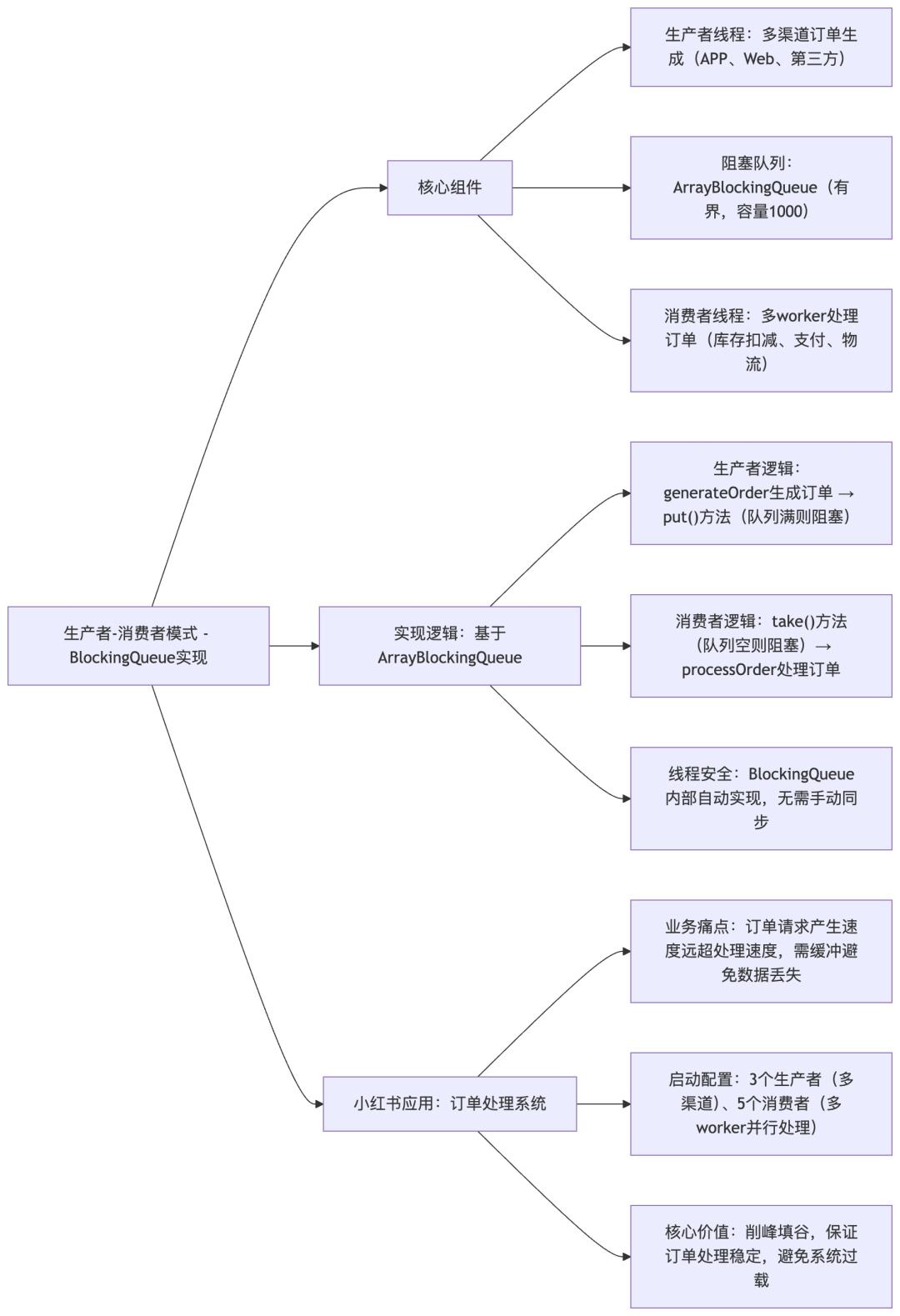

四、生产者 - 消费者(阻塞队列)

4.1 阻塞队列基础实现

生产者-消费者模式是解耦生产与消费速度、平滑流量峰谷的利器。BlockingQueue 让这一模式的实现变得异常简单且健壮。

Q12:请使用 BlockingQueue 实现生产者 - 消费者模式,并说明在小红书订单处理系统中的应用?

A12: 在小红书,订单可能来自 APP、Web、第三方平台等多个渠道,产生速度可能瞬间远高于处理速度(支付、库存扣减、物流)。BlockingQueue 提供了完美的缓冲能力。

下面是一个基于 ArrayBlockingQueue 的简化示例:

import java.util.concurrent.ArrayBlockingQueue;

import java.util.concurrent.BlockingQueue;

public class OrderProcessingSystem {

private static final int QUEUE_CAPACITY = 1000;

private final BlockingQueue<Order> orderQueue = new ArrayBlockingQueue<>(QUEUE_CAPACITY);

// 生产者线程:处理订单请求

public class OrderProducer implements Runnable {

private final String channel;

public OrderProducer(String channel) {

this.channel = channel;

}

@Override

public void run() {

try {

while (true) {

Order order = generateOrder(channel);

orderQueue.put(order); // 队列满时自动阻塞

System.out.println("Producer [" + channel + "] created order: " + order.getId());

Thread.sleep((long) (Math.random() * 1000));

}

} catch (InterruptedException e) {

Thread.currentThread().interrupt();

System.out.println("Producer interrupted.");

}

}

private Order generateOrder(String channel) {

return new Order(UUID.randomUUID().toString(), channel, new Date());

}

}

// 消费者线程:处理订单

public class OrderConsumer implements Runnable {

private final int workerId;

public OrderConsumer(int workerId) {

this.workerId = workerId;

}

@Override

public void run() {

try {

while (true) {

Order order = orderQueue.take(); // 队列空时自动阻塞

processOrder(order, workerId);

System.out.println("Consumer [" + workerId + "] processed order: " + order.getId());

Thread.sleep((long) (Math.random() * 2000));

}

} catch (InterruptedException e) {

Thread.currentThread().interrupt();

System.out.println("Consumer interrupted.");

}

}

private void processOrder(Order order, int workerId) {

// 模拟订单处理逻辑

System.out.println("Processing order " + order.getId() + " from channel " + order.getChannel() + " by worker " + workerId);

}

}

public void startSystem() {

// 启动多个生产者

new Thread(new OrderProducer("APP")).start();

new Thread(new OrderProducer("Web")).start();

new Thread(new OrderProducer("ThirdParty")).start();

// 启动多个消费者

for (int i = 0; i < 5; i++) {

new Thread(new OrderConsumer(i)).start();

}

}

}

BlockingQueue 内部封装了复杂的线程等待/通知逻辑。put() 和 take() 方法在队列满或空时会自动阻塞线程,无需开发者手动处理 wait() 和 notify(),极大降低了并发编程的复杂度并避免了常见错误。

4.2 阻塞队列与 wait/notify 实现对比

既然 BlockingQueue 这么好,为何还要了解原始的 wait/notify?

Q13:请对比使用 BlockingQueue 和直接使用 wait/notify 实现生产者 - 消费者模式的优缺点?

A13: 这是一个关于“使用高级API”还是“掌控底层细节”的权衡。

使用 wait/notify 的优点在于极致灵活。你可以实现任何自定义的同步逻辑,比如复杂的优先级策略、特定条件的通知等。在需要精细控制线程协作顺序的特殊场景下,这可能是不二之选。

但其缺点非常明显:实现复杂、容易出错。你需要手动维护条件变量、正确使用 synchronized、处理虚假唤醒问题,并且要确保 notify() 或 notifyAll() 在正确的时机被调用,否则极易导致死锁或线程饥饿。

反观 BlockingQueue,它的优点就是“开箱即用”,将线程安全、阻塞等待、队列管理等复杂问题全部封装,提供了简单清晰的 put/take API。Java 并发包还提供了多种现成的实现(ArrayBlockingQueue, LinkedBlockingQueue, PriorityBlockingQueue, SynchronousQueue),覆盖了绝大多数业务场景。

结论:在绝大多数标准的生产者-消费者场景中(如订单处理、日志收集、任务调度),应优先使用 BlockingQueue。只有当你需要实现一种标准队列无法满足的、极其特殊的线程协作协议时,才考虑使用 wait/notify 从零构建。

4.3 小红书业务场景深度应用

理解了基础模式,让我们看看如何为小红书复杂的实时推荐系统设计一个生产者-消费者架构。

Q14:请设计一个适合小红书实时推荐场景的生产者 - 消费者架构,并分析其性能瓶颈?

A14: 实时推荐系统需要快速响应用户的浏览、点赞、收藏等行为,并更新推荐结果。一个多层次的生产者-消费者架构可以清晰划分职责,提高处理效率。

架构分层设计:

- 行为采集层(生产者):部署在各服务端,将用户行为事件封装后,放入统一的行为事件队列。可采用

LinkedBlockingQueue(无界队列,避免行为丢失)。

- 实时处理层(消费者集群):多个消费者线程(或服务)从行为队列

take() 事件,进行轻量级处理,如更新用户实时兴趣向量、过滤无效事件。处理结果放入特征队列。

- 推荐计算层(消费者集群):从特征队列获取数据,运行复杂的推荐算法(模型推理、规则匹配),生成推荐列表,并将结果异步写入缓存(如 Redis)供前端获取。

技术选型与优化:

- 队列选择:根据数据特性选择。行为队列用

LinkedBlockingQueue,特征队列可用 ArrayBlockingQueue 控制内存,优先级任务用 PriorityBlockingQueue。

- 线程池管理:每一层使用独立的可配置线程池,根据监控指标(队列长度、CPU负载)动态调整线程数。

- 性能瓶颈与应对:

- 队列堆积:监控队列长度,设置阈值告警,并动态扩容消费者实例。

- 锁竞争:使用

ConcurrentLinkedQueue(无界非阻塞)作为备选,或对任务进行分批,减少入队/出队频率。

- 下游依赖延迟:推荐计算层写缓存或DB可能成为瓶颈。采用异步非阻塞IO、连接池优化、或引入二级队列进行缓冲。

这样的架构能将突发的用户行为流量“削峰填谷”,转化为平稳的计算负载,确保小红书推荐服务在高并发下仍能保持低延迟和高吞吐。

五、综合实战与场景应用

5.1 小红书推荐算法中的综合应用

算法最终要服务于业务。如何在小红书的内容分类树中,高效找到用户最感兴趣的类别?

Q15:请设计一个算法,在小红书的内容分类树中查找某个用户最感兴趣的内容类别,并分析其时间复杂度?

A15: 假设我们有一个树状的内容分类体系(如:美妆->护肤->精华),以及一个表示用户兴趣度的向量(美妆:0.8,美食:0.6...)。目标是找到从根出发,兴趣权重累积最高的那条类别路径的终点。

算法思路(带记忆化的深度优先搜索):

- 为每个树节点计算一个“兴趣分数”。该分数定义为:从根节点到当前节点路径上,所有节点兴趣权重的乘积(或加权和)。这能体现对一条垂直品类路径的偏好深度。

- 在 DFS 遍历过程中,使用记忆化缓存 (

Map<Node, Double>) 存储已计算过的节点分数,避免以同一节点为起点的路径被重复计算。

- 在遍历的同时,全局维护一个最高分数及其对应的节点。

// 简化版核心逻辑示意

private double calculatePathScore(Node node, double currentScore, Map<String, Double> userInterests, Map<String, Double> memo) {

if (memo.containsKey(node.id)) return memo.get(node.id);

double nodeScore = currentScore * userInterests.getOrDefault(node.id, 0.0);

if (node.children.isEmpty()) {

memo.put(node.id, nodeScore);

return nodeScore;

}

double maxChildScore = 0;

for (Node child : node.children) {

double childScore = calculatePathScore(child, nodeScore, userInterests, memo);

maxChildScore = Math.max(maxChildScore, childScore);

}

double totalScore = nodeScore + maxChildScore; // 此处为举例,实际可能是乘或加权和

memo.put(node.id, totalScore);

return totalScore;

}

时间复杂度:由于采用了记忆化,每个节点仅被计算一次,因此时间复杂度为 O(N),N 为分类树节点总数。这对于百万级别的类别树是可以接受的。该算法可用于优化小红书的“个性化分类导航”,将用户最可能感兴趣的品类前置,提升浏览效率。

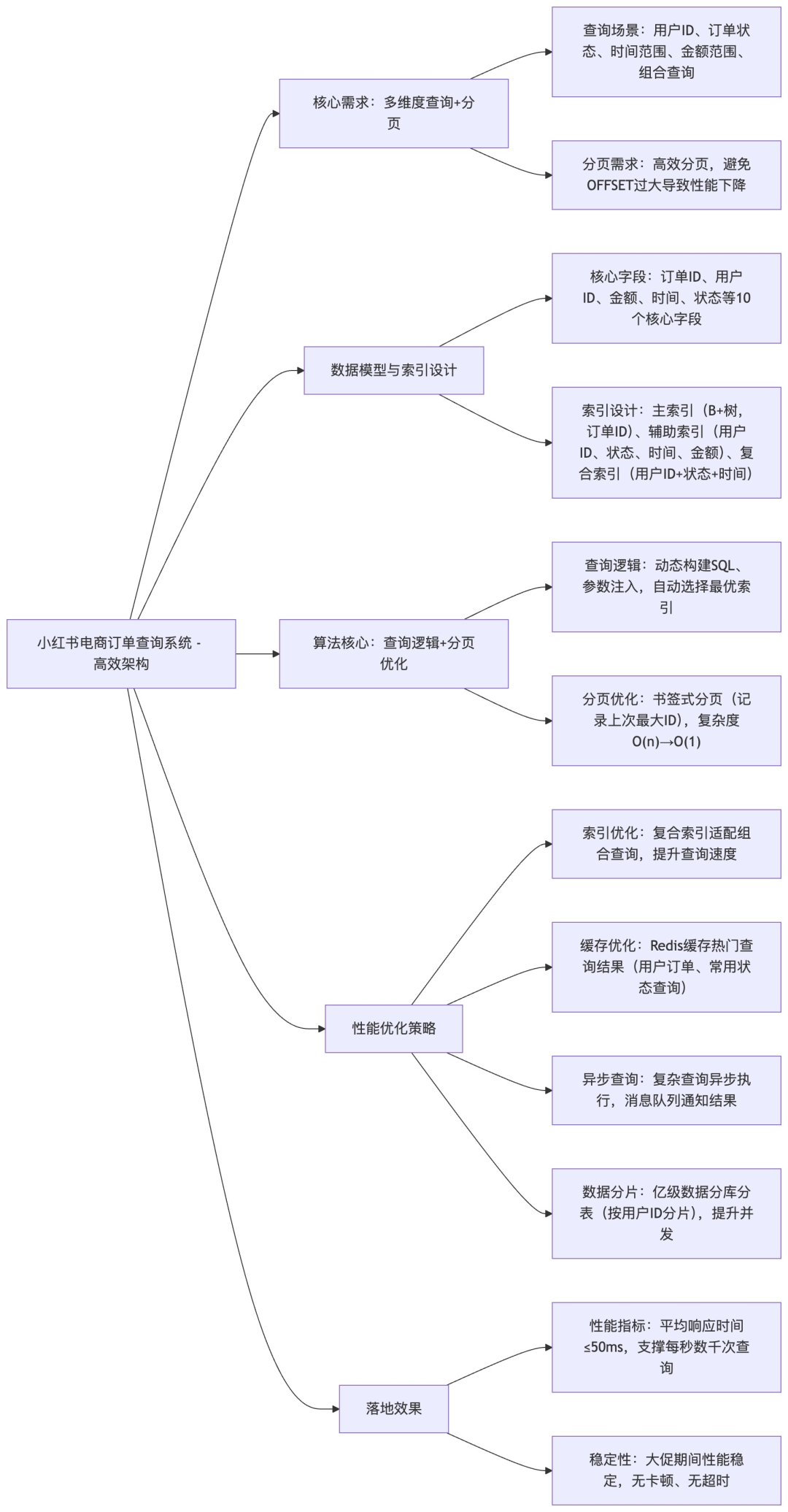

5.2 电商场景下的综合算法应用

电商订单系统的查询功能,需要面对海量数据与复杂多变的查询条件。

Q16:请设计一个算法,在小红书的电商订单系统中,实现一个高效的订单状态查询功能,支持多维度查询和分页?

A16: 这不仅仅是一个算法题,更是一个系统设计题。核心目标是:在亿级订单数据中,支持用户ID、状态、时间、金额等多维度组合查询,并实现高效分页。

整体设计思路:

- 索引策略是基石:

- 主键(订单ID)使用 B+ 树索引,支持精确查询。

- 为高频查询字段建立辅助索引或复合索引。例如,

(user_id, status, create_time) 这个复合索引,可以极快地定位某个用户在某个时间段内、特定状态的所有订单。

- 根据查询模式(如经常按状态+时间查),设计合适的复合索引,避免全表扫描。

- 分页优化:传统

LIMIT offset, size 在 offset 非常大时性能很差。采用“游标分页”或“书签分页”:记录上一页最后一条记录的ID(或时间戳),下一页查询条件为 WHERE id > last_id LIMIT size。这将时间复杂度从 O(offset + size) 降为 O(size)。

- 查询服务层封装:构建一个

QueryCriteria 对象封装查询条件,服务层根据条件动态拼接 SQL,并正确设置参数,防止 SQL 注入。

// 简化的动态SQL构建示例

public List<Order> queryOrders(QueryCriteria criteria, int pageSize, String lastOrderId) throws SQLException {

StringBuilder sql = new StringBuilder("SELECT * FROM orders WHERE 1=1");

List<Object> params = new ArrayList<>();

if (criteria.getUserId() != null) {

sql.append(" AND user_id = ?");

params.add(criteria.getUserId());

}

if (criteria.getStatus() != null) {

sql.append(" AND status = ?");

params.add(criteria.getStatus());

}

// 使用游标分页

if (lastOrderId != null) {

sql.append(" AND id > ?");

params.add(lastOrderId);

}

sql.append(" ORDER BY id ASC LIMIT ?"); // 按主键有序

params.add(pageSize);

// ... 使用 PreparedStatement 执行查询并设置 params

}

- 高阶优化:

- 缓存:对热点查询(如用户最近订单)结果进行缓存。

- 读写分离与分库分表:当单表数据过大时,按用户ID哈希进行分表,并将查询路由到正确的分片。

- 异步导出:对于超复杂的海量数据查询,提供异步接口,完成后通知。

通过这套组合策略,可以在数据量巨大的情况下,依然将订单查询的平均响应时间控制在毫秒级,满足小红书电商业务的性能要求。这类涉及高性能查询和系统架构设计的问题,也是 后端 & 架构 面试中的考察重点。

六、面试技巧与复盘总结

6.1 算法面试技巧

技术过关固然重要,但清晰地表达和展现解决问题的思路同样关键。

Q17:在小红书的算法面试中,如何展现你的技术深度和广度?

A17:

- 从问题本质出发:不要急于编码。先澄清需求,讨论边界条件,说出你的思路。例如,拿到 LCA 问题,先说明它在小红书社交关系中的可能应用,再谈解法。

- 展现优化思维:给出基础解法后,主动分析时空复杂度,并思考优化方向。例如,实现生产者-消费者模式后,讨论队列选型、线程池配置如何影响性能。

- 关联业务场景:将算法与你知道的业务联系起来。说明单例模式在配置管理、线程池在推荐计算中的应用,这能体现你的实战经验和架构思维。

- 编写健壮代码:注意代码规范、命名、异常处理和边界条件(空指针、空树)。在白板或共享编辑器上写出清晰、可工作的代码。

- 保持积极沟通:遇到难题不慌张,把思考过程说出来。可以说:“这个问题我了解不深,但我猜测可以通过XX方式尝试,因为...”。这展示了学习能力和抗压能力。

6.2 常见问题与改进策略

知道别人为何失败,能帮你更好地成功。

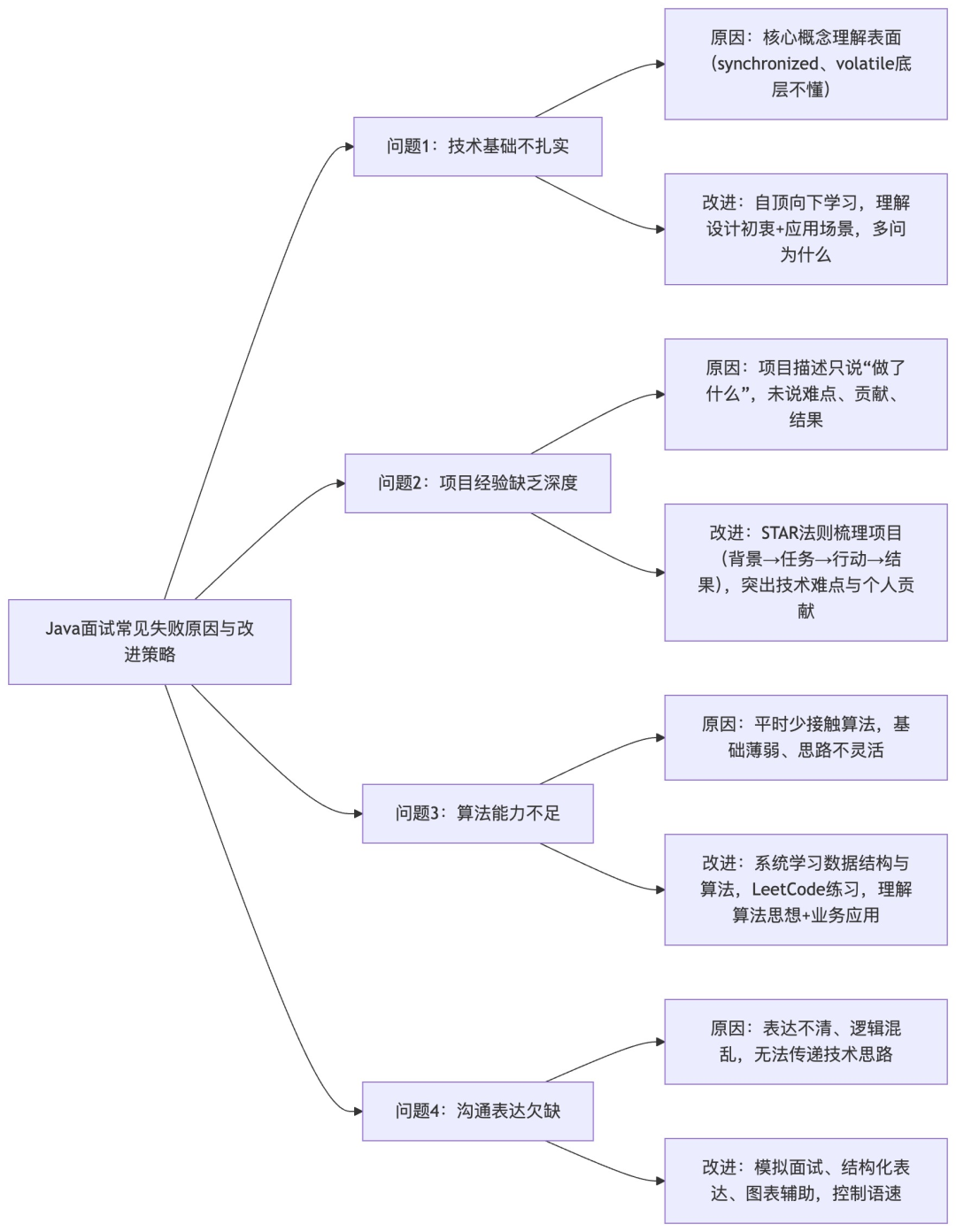

Q18:在 Java 面试中,常见的失败原因有哪些,如何避免?

A18:

- 基础不牢:只知

synchronized 用来锁,不知其底层 Monitor 和锁升级过程。对策:采用自顶向下的学习方式,对核心概念(JMM、GC、集合框架)不仅要会用,更要理解原理和设计意图。

- 项目描述平庸:仅罗列功能点,如“用了Redis做缓存”。对策:使用 STAR 法则(情境-任务-行动-结果)包装项目。重点突出难点(如缓存穿透如何解决)、你的贡献(设计了什么方案)、量化结果(性能提升多少、延迟降低多少)。

- 算法思维生疏:面对中等难度算法题没有思路。对策:坚持系统性刷题(LeetCode),但重点不在于数量,而在于理解数据结构(树、图)和算法思想(DFS、BFS、DP、贪心)的本质,并能自己推导复现。

- 沟通表达混乱:思路跳跃,无法让面试官跟上。对策:进行模拟面试,练习结构化表达(“首先...其次...最后...”),对于复杂问题尝试画图辅助说明。

6.3 复盘方法与持续改进

一次面试的结束,正是下一次提升的开始。

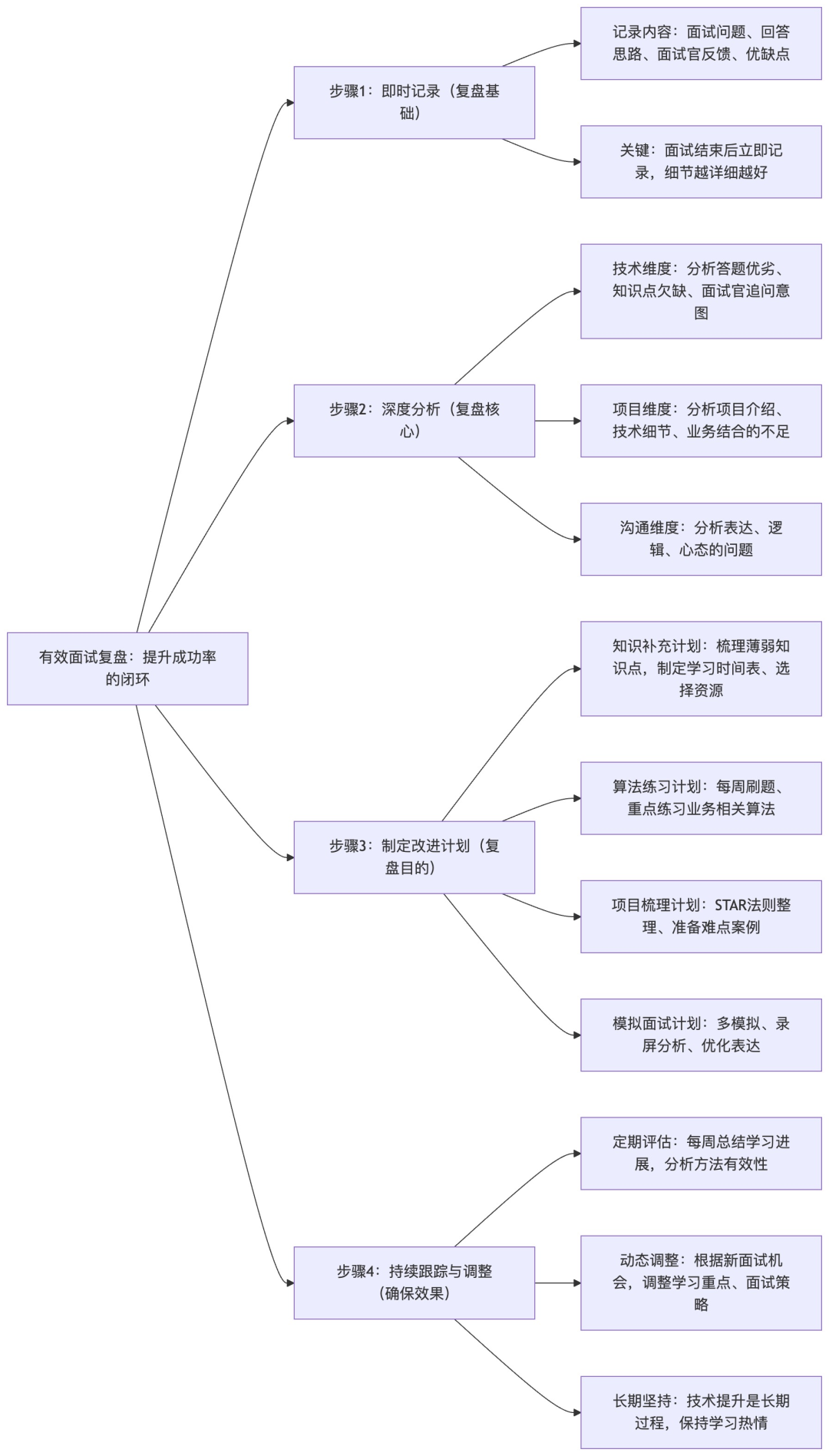

Q19:如何进行有效的面试复盘,提升下一次面试的成功率?

A19: 有效的复盘是一个闭环系统。

- 立即记录:面试后尽快写下所有问题、你的答案、面试官的反应及追问。细节越全,复盘价值越高。

- 深度分析:

- 技术维度:哪些答得好/不好?知识盲点在哪里?面试官的追问意图是什么?

- 项目维度:案例是否讲得清晰、有深度?是否展现了技术价值和业务贡献?

- 沟通维度:表达是否流畅?逻辑是否清晰?心态是否平稳?

- 制定计划:

- 知识补漏:针对盲点,制定学习计划(读经典书、看源码、写Demo)。

- 算法特训:定期刷题,总结题型套路。

- 项目重构:用 STAR 法则重新梳理项目,准备好“最挑战的项目”等故事。

- 模拟练习:找同伴模拟面试,甚至录下自己的回答进行回放改进。

- 持续跟踪:定期检查计划执行情况,根据新的面试反馈动态调整重点。技术成长是马拉松,坚持必有收获。

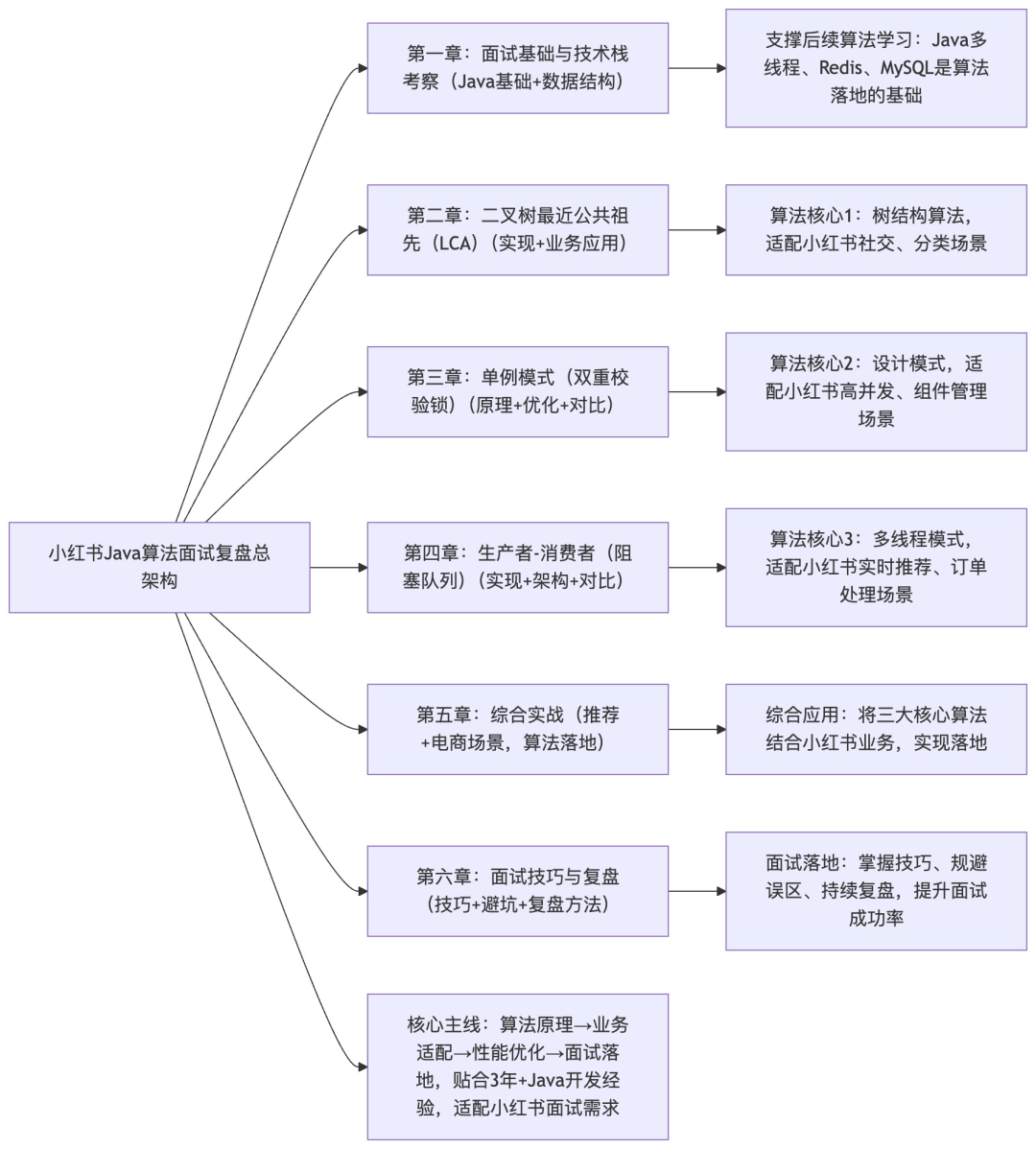

整体文档核心架构总览

本文从小红书面试实际需求出发,构建了一条清晰的主线:Java与数据结构基础 → 核心算法原理与实现(LCA,单例,生产者消费者)→ 综合业务场景实战 → 面试技巧与复盘方法。这条路径不仅覆盖了高频考点,更强调了“技术为业务服务”的思维,帮助你从“会做题”向“能解题”和“善沟通”进阶。

总结

通过对二叉树最近公共祖先、单例模式双重校验锁、生产者-消费者模式这三个经典考点的剖析,我们不仅重温了算法与设计模式本身,更关键的是练习了如何将它们置于小红书这样的复杂业务背景下进行思考和应用。

面试本质上是一场与未来同事的专业对话,他们寻找的是能共同解决实际问题的伙伴。因此,展现出你的技术深度、解决复杂问题的思路以及与业务结合的能力,远比背诵标准答案更重要。希望这份来自 云栈社区 的深度解析,能帮助你更好地准备面试,在职业道路上迈出坚实的一步。技术之路漫长,保持好奇,持续学习,终有所成。