本帖最后由 异或Lambda 于 2026-3-1 00:03 编辑

大家好,我是《异或Lambda》。今天的科幻,明天的日常 —— AI 改造世界进行时。

最近用 Claude 4.6 写代码,爽是真爽,但只要一让它去翻本地那成千上万行的老代码,API 账单就跟流水一样。为了省钱,也为了降低延迟,我盯上了一个刚开源的“本地探子”—— LocoOperator-4B。

简单来说,这是 LocoreMind 团队搞出的一个只有 4B(40亿)参数的本地智能体(Agent)。它不干别的,就专门负责在你的代码库里“翻箱倒柜”找线索。

为什么说它切中了开发者的痛点?

1. 主脑思考,小弟干活的双层架构

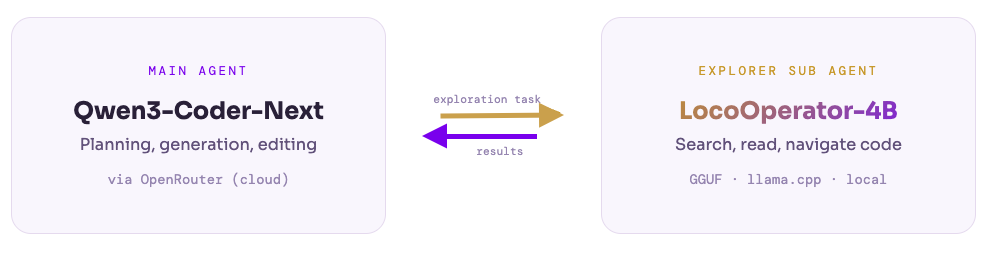

现在的 AI 编程工具大多是让一个大模型把活全干了,但 LocoOperator 玩的是双层配合。你可以把 Claude 或 GPT 作为云端“主脑”,负责高级决策和写代码;而把耗时、耗 Token 的文件读取、代码搜索(Grep / Glob)全扔给本地跑的 LocoOperator。

2. 结构化输出居然反超了“老师傅”

这小家伙是用 Qwen3-Coder-Next 的数据蒸馏出来的。有意思的是,在生成工具调用的 JSON 格式时,它的语法正确率达到了 100%,甚至把它的教师模型(87.6%)给反超了。这再次印证了一个趋势:在特定垂直任务上,小模型只要微调得当,不仅能用,甚至比大模型输出得更稳。

3. 纯本地运行,零 API 费用

模型支持 GGUF 量化,普通开发机用 llama.cpp 就能跑。随便你怎么遍历代码库,一分钱不花。如果你平时喜欢扒源码,或者在 开源实战 中遇到庞大复杂的项目,这套方案简直是降本增效的神器。

异或Lambda的思考:端云结合才是未来

在 云栈社区 里,极客们最近常聊一个话题:AI 时代的算力到底该怎么分配?

LocoOperator 给出了一个极佳的示范。把需要极高智商的逻辑推理留在云端,把高频的“脏活累活”下放到本地。这不仅仅是省钱的问题,更是未来 人工智能 落地到每个人桌面的必经之路。生产力的解放,往往就藏在这些底层工具的重构里。

🔗 资源与拓展

- 模型下载:

huggingface.co/LocoreMind/LocoOperator-4B

- GitHub 仓库:

LocoreMind/LocoOperator

- Python 学习:

https://yunpan.plus/f/26

- 人工智能课程:

https://yunpan.plus/f/29

你平时用什么工具让 AI 帮你读代码?遇到过哪些坑?欢迎在评论区聊聊你的方案,我们一起探讨。

欢迎关注我《异或Lambda》。今天的科幻,明天的日常 —— AI 改造世界进行时。

标签: #AI编程 #大模型 #智能体 #LocoOperator #云栈社区 #开源项目 #程序员日常 #本地部署 |