本帖最后由 云栈运维云原生 于 2026-3-2 23:24 编辑

这两年大模型火了,开发都在搞 AI Agent。AI 自动写代码确实效率高,但作为运维,每次看到业务方要把 AI 生成的未知脚本直接放到服务器上跑,心里都直打鼓。万一脚本里带个恶意逻辑,或者偷偷把内网数据传出去,谁来背锅?

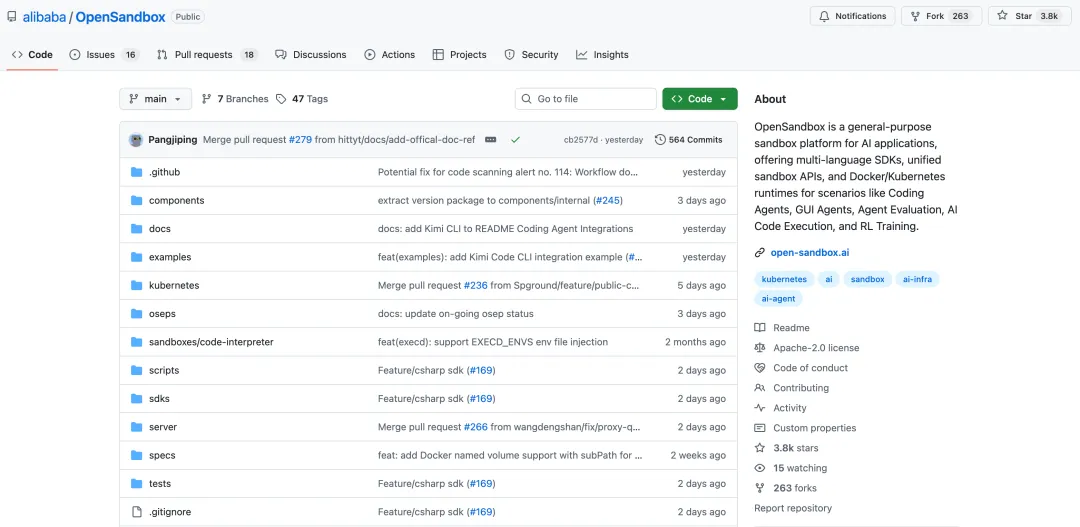

过去,为了防这手,我们通常得自己手搓一堆复杂的 Docker 隔离策略,或者干脆一刀切物理断网。现在,阿里把他们内部的 AI 基础设施开源了——OpenSandbox。今天咱们就从云栈社区的老本行,也就是 运维 / DevOps / SRE 的视角,把这个项目的底层逻辑盘一盘。

1. 不只是 Docker,更是 K8s 原生调度

很多开源的 AI 沙箱只是简单包了一层 Docker API,单机跑跑 Demo 还行,一上生产环境就原形毕露。OpenSandbox 比较克制且务实,它的底层直接对接了 Kubernetes 运行时。

这意味着什么?在生产环境里,AI 每次需要执行代码,系统都会动态拉起一个独立的 Pod,甚至支持挂载 PVC 存储。任务跑完,内置的超时机制会自动介入销毁 Context,干脆利落。对于负责 云原生 / IaaS 架构的同学来说,这种不留僵尸进程、资源随用随销的设计,能省去极大的运维心智负担。

2. 运维最在意的网络隔离(Egress 机制)

如果只是把代码关在容器里,其实防不住网络外发泄露数据。OpenSandbox 源码里最硬核的地方,在于它的 egress 组件。

它没有简单粗暴地直接断网,而是用 Go 结合 nftables/iptables 做了一套细粒度的出口流量控制和 DNS 代理。你可以像写 K8s NetworkPolicy 一样,精确限制这个沙箱只能访问特定的内部 API 或白名单域名。相当于给 AI Agent 专门配了一个轻量级的流量防火墙,彻底掐断恶意代码的数据外泄通道。

3. 丰富的执行引擎与开箱即用

沙箱内部的 execd 守护进程不仅能跑 Shell 和 SQL,还内置了 Jupyter Kernel(支持 Python、R 等),甚至能直接拉起无头浏览器(Chrome)跑自动化测试。官方提供了 Python、Java、TypeScript 等多语言 SDK,像 Claude Code、Codex 这种主流的编程助手,基本可以直接接入。

结语

总的来说,OpenSandbox 把构建 人工智能 代码执行环境的脏活累活给标准化了。它提供了一个安全、可控、可观测的执行底座。

不知道大家现在的业务里,是怎么处理 AI 动态代码执行的?是还在用裸机跑,还是已经上了一套自研的隔离方案?欢迎在评论区交流下你们的踩坑经验。

配套资源

🔗 Github仓库:github.com/alibaba/OpenSandbox

📚 官方文档:open-sandbox.ai

💻 运维课程:https://yunpan.plus/f/33

🌐 云原生教程:https://yunpan.plus/f/47

👇 关注《云栈运维云原生》,每天 3 分钟,获取更多硬核云原生与 DevOps 开源项目解析!

标签:#OpenSandbox #Github #云原生 #DevOps #Kubernetes #AIAgent #SRE #云栈社区 |