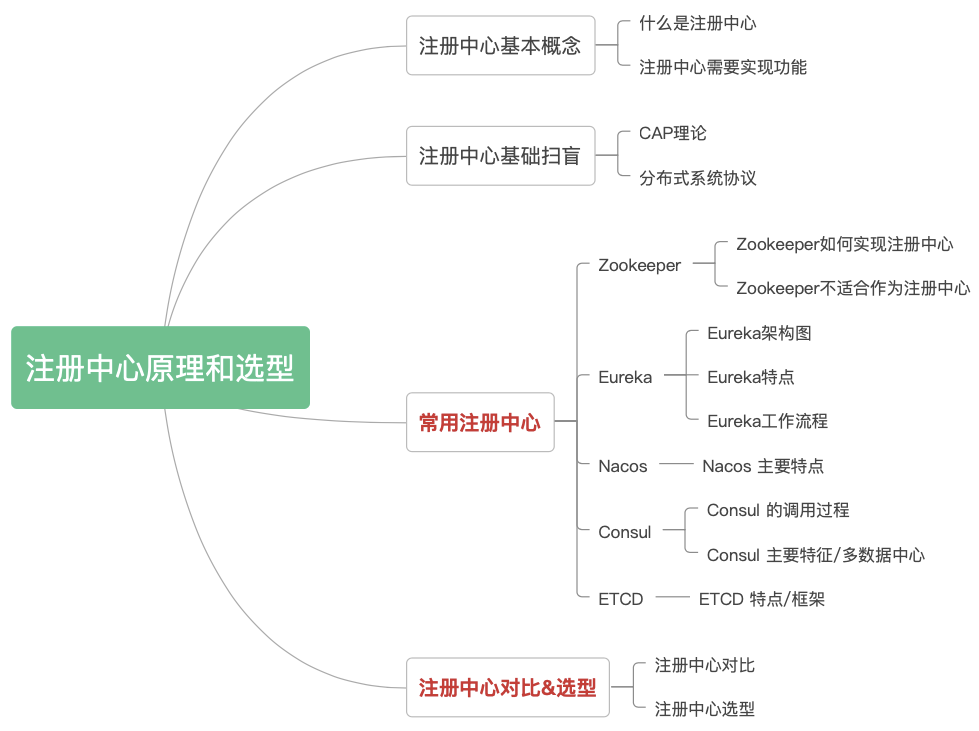

在构建微服务或分布式系统时,服务注册与发现是核心基础设施之一。面对Zookeeper、Eureka、Nacos、Consul和ETCD等多种选择,如何进行技术选型?本文将从核心概念、原理机制、功能特性等多维度进行深入对比,为你的架构决策提供清晰参考。

01 注册中心基本概念

1.1 什么是注册中心?

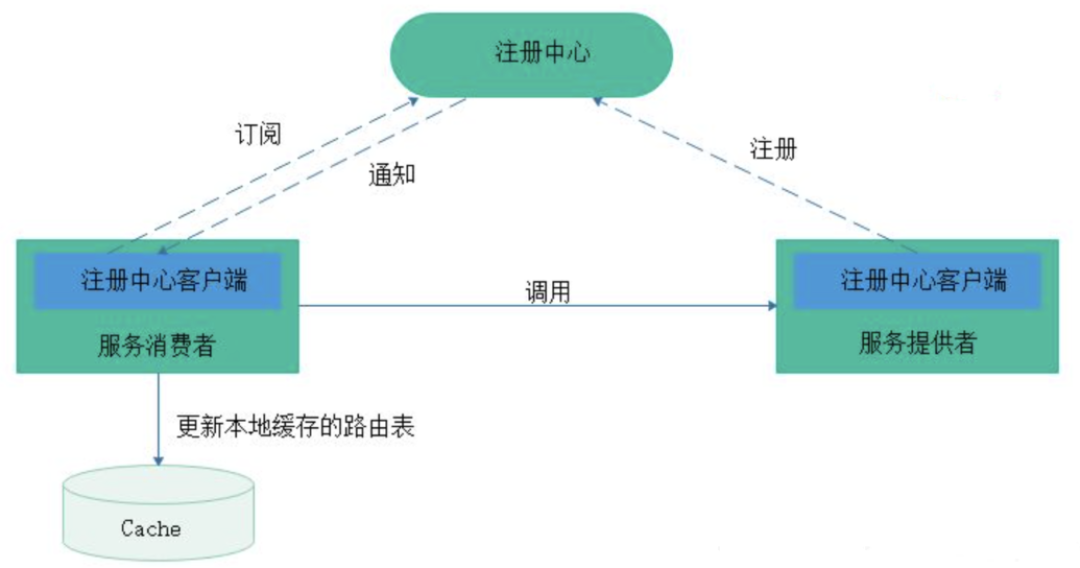

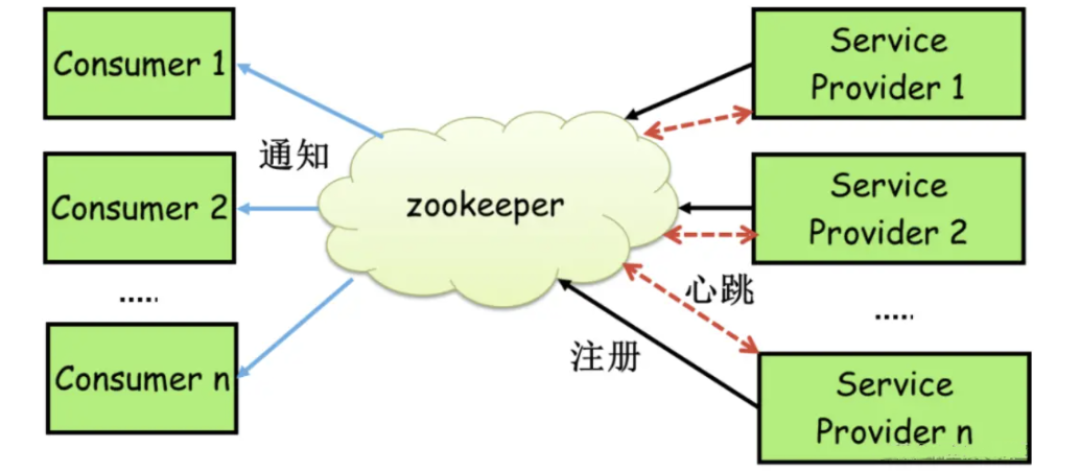

注册中心主要包含三种角色:

- 服务提供者(RPC Server):启动时向 Registry 注册自身服务,并定期发送心跳汇报存活状态。

- 服务消费者(RPC Client):启动时向 Registry 订阅服务,将返回的服务节点列表缓存在本地,并与 RPC Server 建立连接。

- 服务注册中心(Registry):保存 RPC Server 的注册信息。当 RPC Server 节点变更时,Registry 同步变更,RPC Client 感知后会刷新本地缓存的服务节点列表。

最终,RPC Client 从本地缓存的服务节点列表中,基于负载均衡算法选择一台 RPC Server 发起调用。

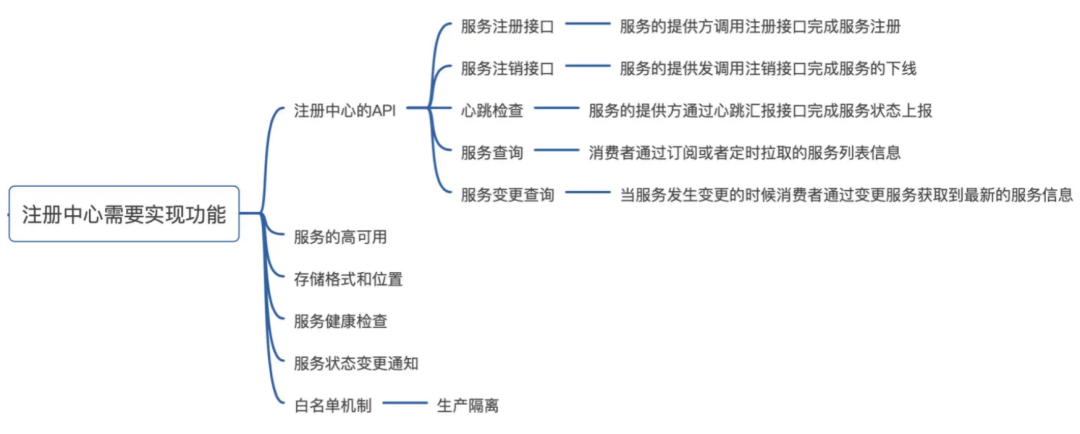

1.2 注册中心需要实现功能

一个合格的注册中心需要实现以下核心功能:

02 注册中心基础扫盲

2.1 CAP理论

CAP理论是分布式系统中的重要基石,它指出在分布式系统中,一致性(Consistency)、可用性(Availability)、分区容错性(Partition tolerance)三者不可兼得。

- 一致性(Consistency):所有节点在同一时间看到的数据完全相同。

- 可用性(Availability):系统提供的服务必须一直处于可用的状态,对于用户的每一个操作请求总是能够在有限的时间内返回结果。

- 分区容错性(Partition tolerance):分布式系统在遇到任何网络分区故障时,仍然需要能够保证对外提供满足一致性和可用性的服务,除非是整个网络环境都发生了故障。

为什么三者只能取其二?简单理解:如果要保证强一致性(C),就需要在节点间同步数据,这会耗费时间,可能降低可用性(A)。如果保证高可用性(A),就可能无法在瞬间达成数据一致。如果同时要求强一致和高可用,那么系统就很难容忍网络分区(P),这又与分布式系统的基本设计相悖。对于分布式系统中的服务注册中心场景,通常需要在CP和AP之间做出权衡。

2.2 分布式系统协议

实现数据一致性的核心算法主要有Paxos、Raft、ZAB。

- Paxos:由Leslie Lamport提出,基于消息传递,以难理解著称。其核心在于,只要超过半数的副本在线且通信正常,就能保证服务持续可用且数据不丢失。

- Raft:为了易于理解和实现而设计,是Paxos的简化版。etcd等知名项目采用Raft算法。同样,只要保证超过半数的节点正常就能提供服务。

- ZAB:ZooKeeper Atomic Broadcast,专为ZooKeeper设计,支持崩溃恢复的原子广播协议。它借鉴了Paxos,但为ZooKeeper的协调服务场景做了特别优化。

03 常用注册中心

主流的注册中心有五种:Zookeeper、Eureka、Nacos、Consul和ETCD。

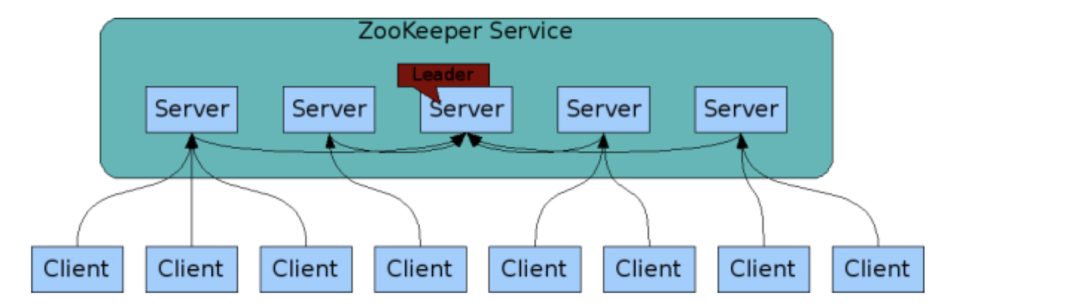

3.1 Zookeeper

ZooKeeper本身定位是分布式协调服务,但在国内由于Dubbo的历史原因,常被用作服务注册中心。

Zookeeper如何实现注册中心

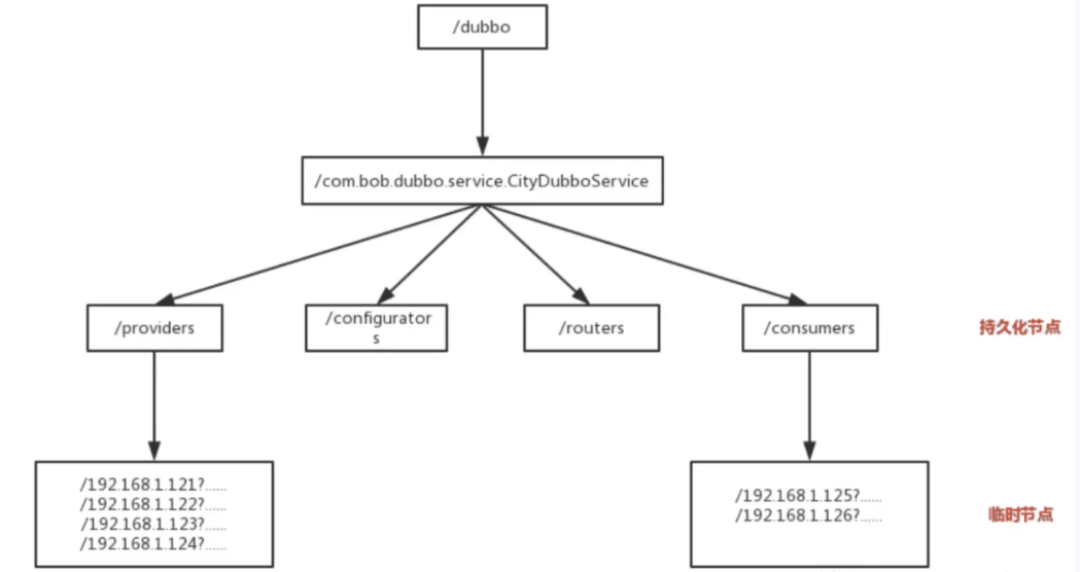

服务提供者启动后,在Zookeeper的特定路径下创建临时节点(如 /{service}/{version}/{ip:port}),完成服务注册。消费者监听该路径,获取提供者列表。

具体到目录结构,如下图所示:

流程简述:

- 服务提供者启动,向ZooKeeper注册自身信息。

- 服务消费者首次调用时,从ZooKeeper获取服务列表并缓存。

- 服务提供者节点宕机,其创建的临时节点因会话结束而被自动删除。

- ZooKeeper通过Watch机制通知消费者,消费者拉取新的服务列表。

ZooKeeper通过和服务提供者建立的Socket长连接进行“心跳检测”,长期无响应则判定服务“挂了”并剔除。其Watch机制是 “推拉结合”:服务变更时,ZooKeeper只推送事件类型(推),消费者需主动拉取最新数据(拉)。

Zookeeper不适合作为注册中心

核心矛盾在于:服务发现场景下,可用性通常比强一致性更重要。对于消费者,返回一个可能稍旧但可用的服务列表,远比因为集群选举导致整个注册中心长时间不可用要好。

ZooKeeper遵循CP原则,当集群Leader选举时(通常30-120秒),整个集群不可用。在网络不稳定的云环境中,这种情况概率不低,可能导致注册服务长时间瘫痪。其核心算法ZAB为强一致性设计,这对其主打的分布式协调功能是优点,但对于服务发现来说,则可能成为可用性瓶颈。

3.2 Eureka

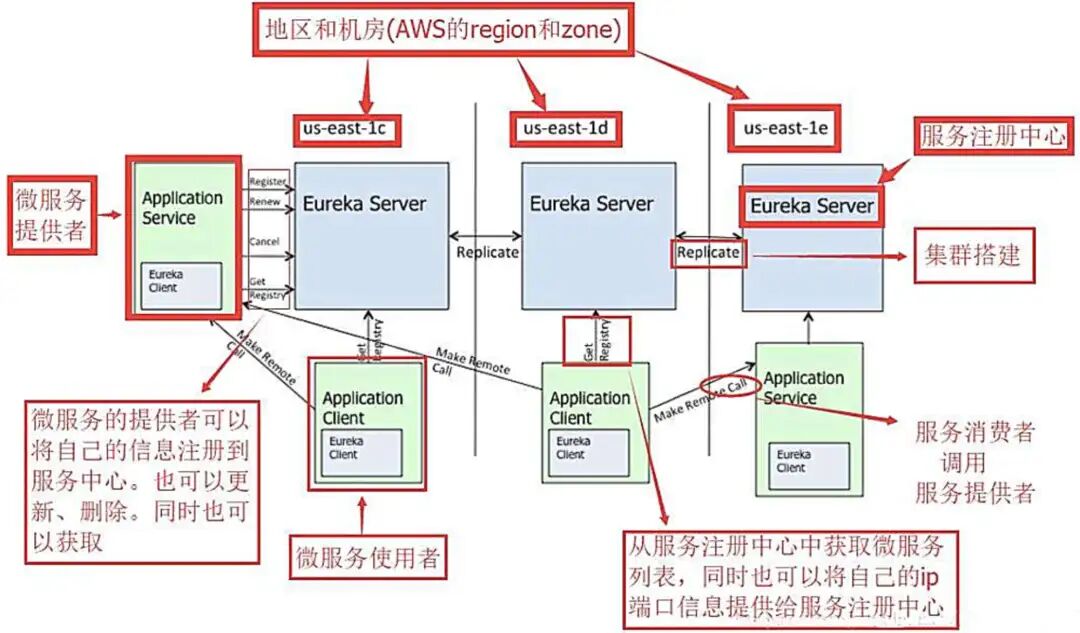

Eureka 架构图

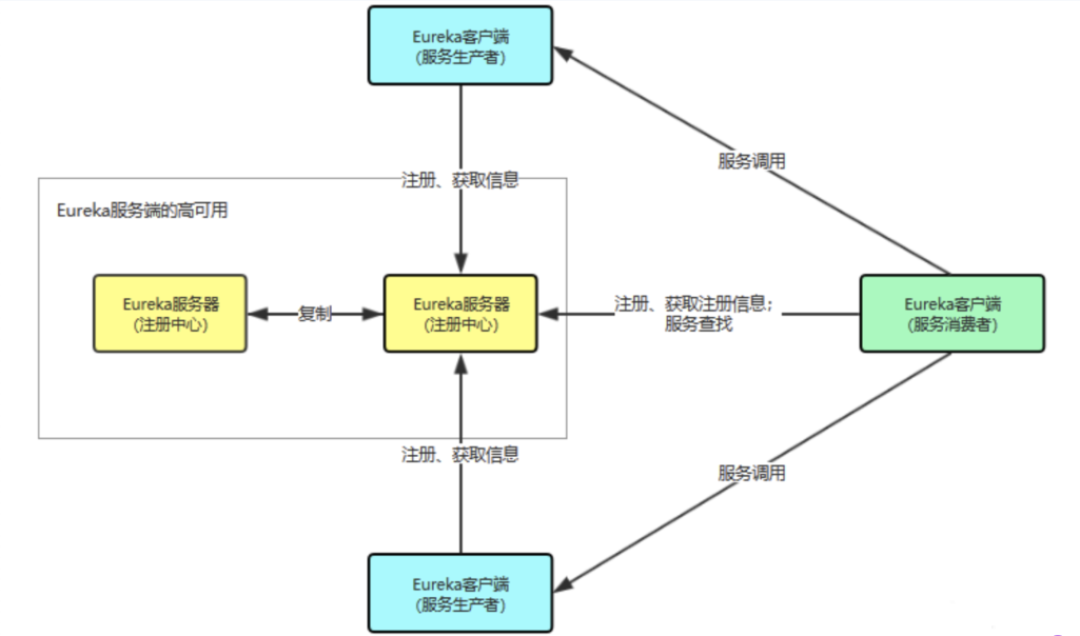

简化版架构图如下:

Eureka 特点

- AP原则:设计上优先保证可用性,不保证强一致性。只要有一台Eureka Server存活,注册服务就可用。

- 去中心化对等架构:节点间通过Peer to Peer方式通信,无主从之分,每个节点都是其他节点的副本。

- 自我保护机制:15分钟内超过85%的客户端节点没有心跳,Eureka Server会进入保护模式,不再剔除疑似下线的服务,防止因网络波动导致服务被误注销。

Eureka工作流程

- Eureka Server启动,集群节点间通过复制同步注册表。

- Eureka Client启动并向Server注册。

- Client每30秒发送一次心跳。

- Server若90秒未收到心跳,则注销该实例。

- 触发自我保护机制时,停止剔除服务。

- Client定时从Server获取并缓存服务注册表。

- 调用时,先查本地缓存,没有再更新缓存。

- Client关闭时向Server发送取消注册请求。

Eureka通过牺牲数据的强一致性,换来了高可用性,非常适合对注册中心可用性要求极高的跨机房场景。

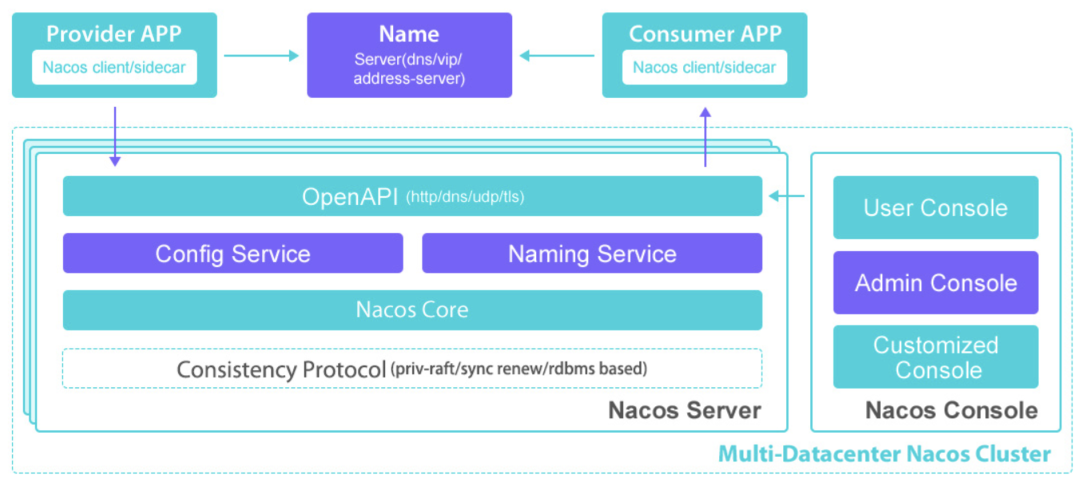

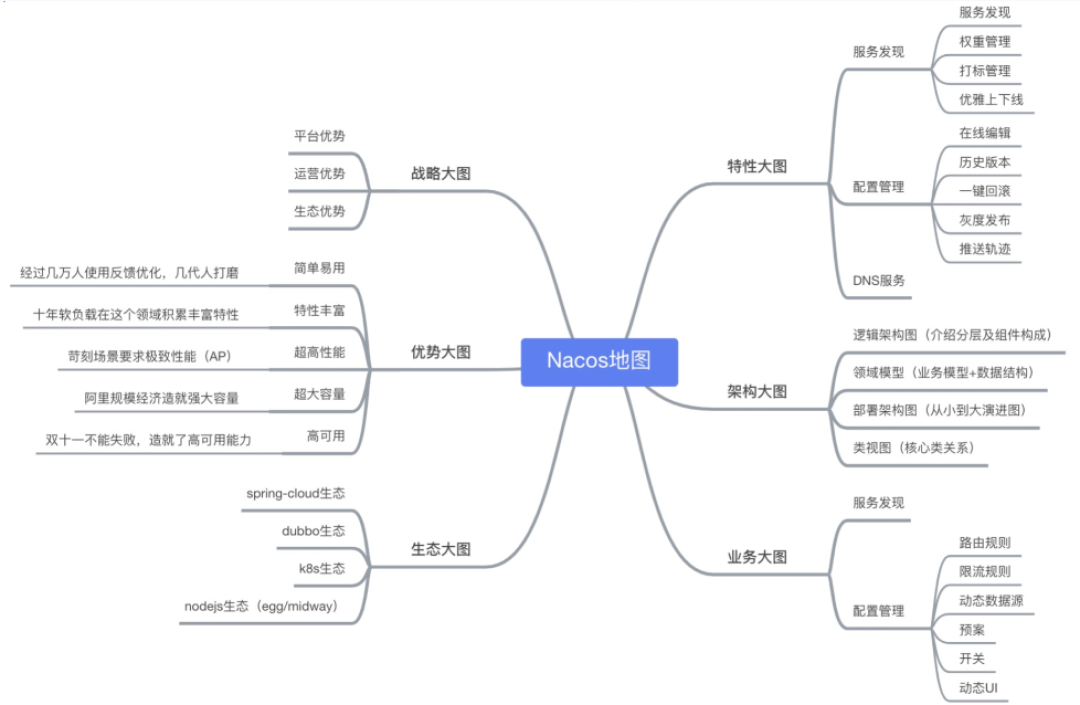

3.3 Nacos

以下内容摘抄自Nacos官网

Nacos致力于帮助您发现、配置和管理微服务。

Nacos 主要特点

- 服务发现与健康检查:支持基于DNS和RPC的服务发现。提供传输层(PING/TCP)和应用层(如HTTP/MySQL)等多种健康检查模式。

- 动态配置服务:提供中心化的动态配置管理,支持配置版本跟踪、灰度发布、一键回滚等。

- 动态DNS服务:支持权重路由,易于实现负载均衡和灵活的路由策略。

小结:Nacos是阿里开源的一站式解决方案,同时支持CP和AP模型(通过配置切换)。它集服务注册发现和配置中心于一身,可以看作 Spring Cloud注册中心 + Spring Cloud配置中心。

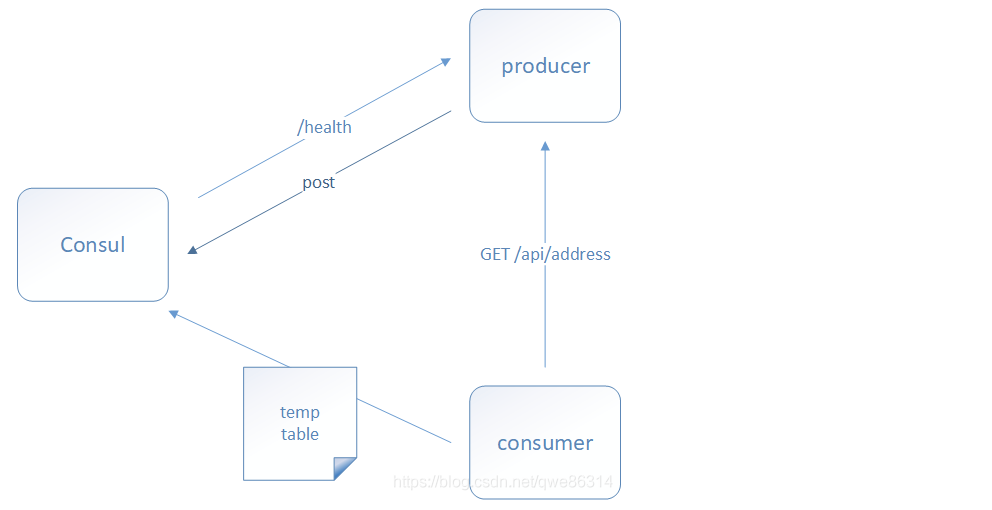

3.4 Consul

Consul是HashiCorp公司推出的开源工具,提供一站式的服务发现、配置、分段和多数据中心解决方案。

Consul 的调用过程

- Producer启动,向Consul注册自己的IP和Port。

- Consul默认每10秒向Producer发起健康检查请求。

- Consumer调用前,从Consul获取健康的Producer临时列表。

- 该临时表定期(如10秒)更新。

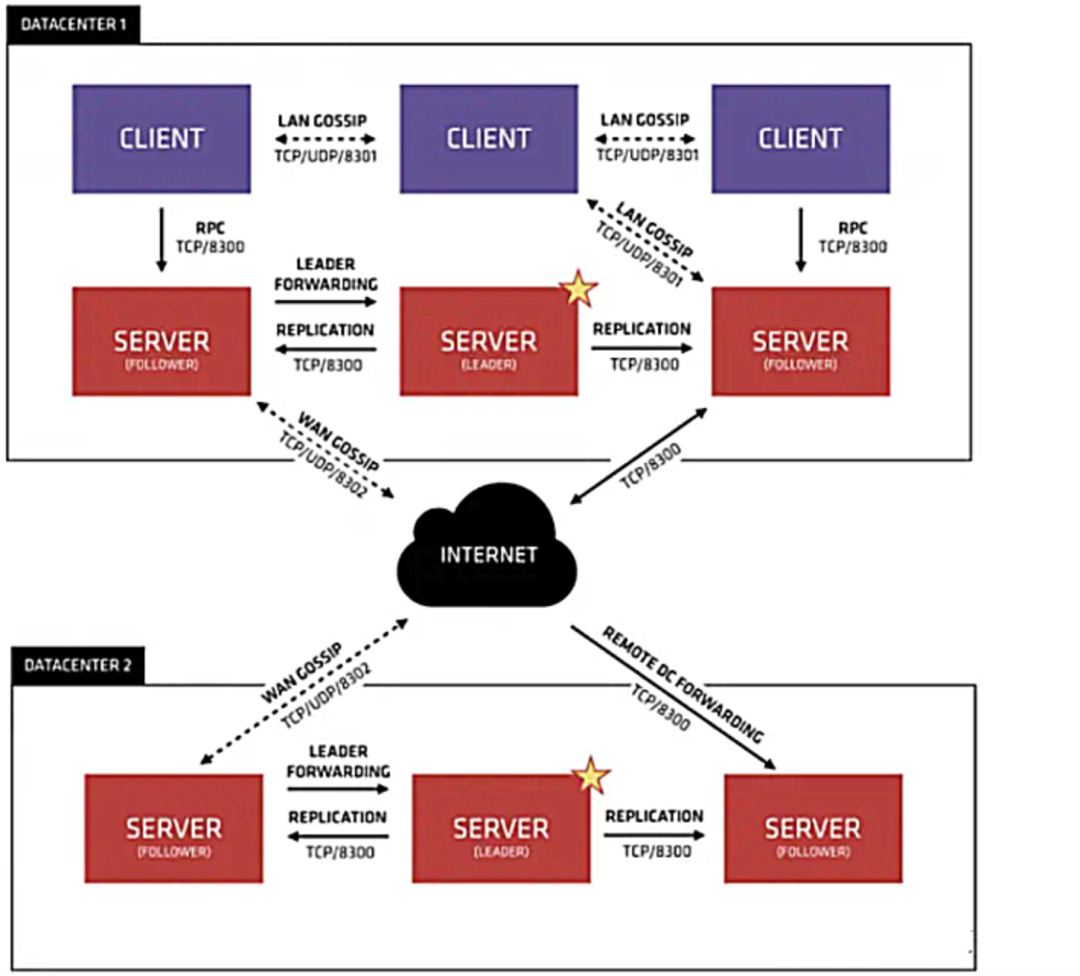

Consul 主要特征与多数据中心

- CP模型:使用Raft算法保证强一致性。

- 功能全面:内置服务发现、健康检查、KV存储、多数据中心支持、安全通信(TLS证书)等。

- 多数据中心:支持开箱即用的多数据中心部署。

单个数据中心内,分为Server节点(保存数据,推荐3或5个)和Client节点(健康检查、请求转发)。集群通过gossip协议维护成员关系,数据读写通过Raft协议保证一致性。

3.5 ETCD

etcd是一个用Go编写的高可用、强一致的键值存储,常用于服务发现、共享配置。

ETCD 特点

- 易用易部署:HTTP+JSON API,Go编写跨平台。

- 强一致高可用:使用Raft算法,可容忍 (n-1)/2 节点故障。

- 持久化与性能:数据通过WAL持久化,支持快照,写性能可达10K QPS。

- 安全性:支持SSL客户端认证。

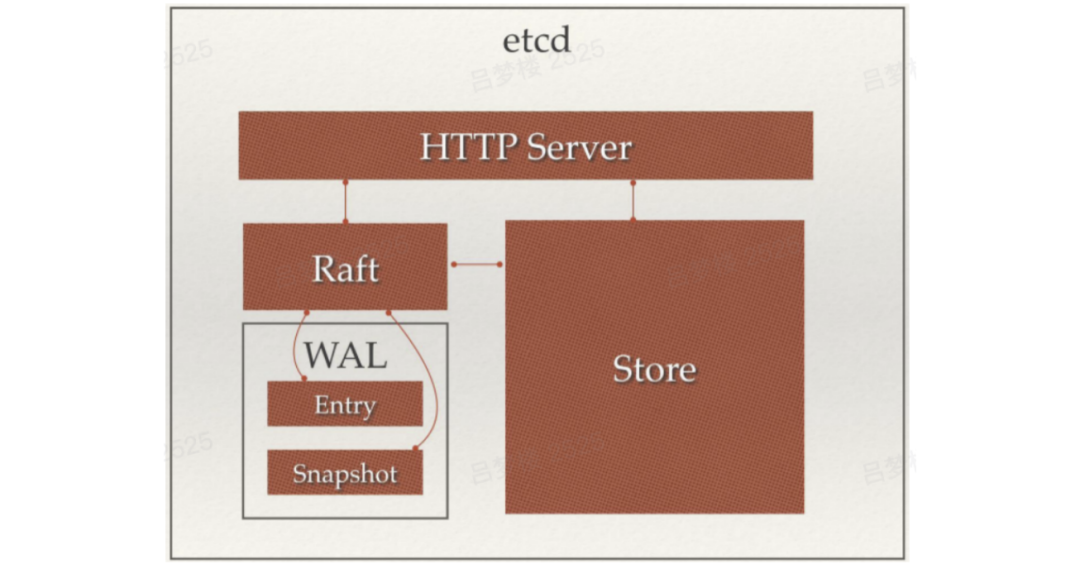

ETCD 框架

核心分为四部分:

- HTTP Server:处理API请求和集群同步。

- Store:处理各类事务,实现大部分API逻辑。

- Raft:Raft算法的实现,是etcd核心。

- WAL:预写式日志,用于数据持久化。

用户请求经HTTP Server到Store,涉及状态变更则交给Raft模块达成共识并记录日志,最后提交数据并同步到其他节点。

04 注册中心对比&选型

4.1 注册中心对比

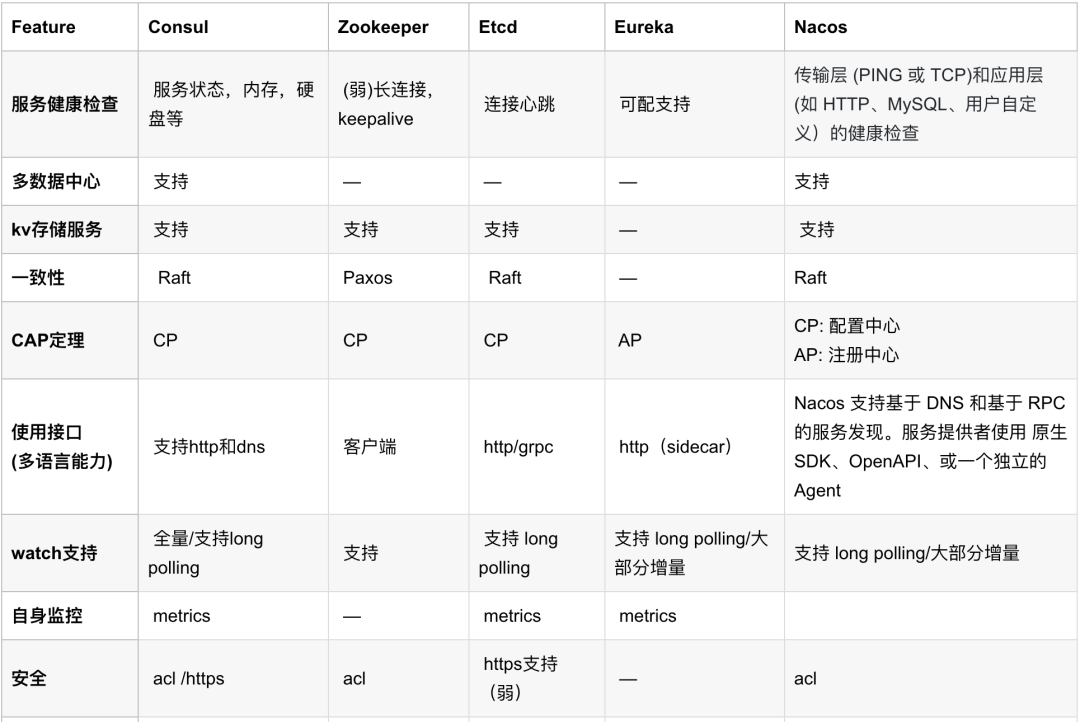

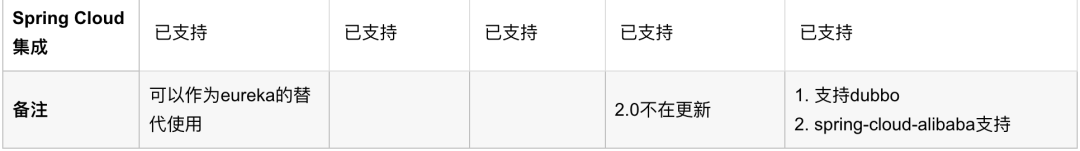

关键维度分析:

- 健康检查:Consul检查最为细致;Eureka需显式配置;ZooKeeper、Etcd依赖连接状态。

- 多数据中心:Consul和Nacos原生支持。

- KV存储:除Eureka外均支持,可衍生出动态配置功能。

- CAP取舍:Eureka为AP,Nacos可切换AP/CP,ZooKeeper、Etcd、Consul为CP。服务发现场景通常优先可用性(AP)。

- Watch支持:ZooKeeper支持服务端推送,其他多为长轮询。

- 自身监控:除ZooKeeper外,大多默认支持Metrics。

- Spring Cloud集成:均有较好支持,其中Nacos通过Spring Cloud Alibaba集成。

4.2 注册中心选型建议

综合以上分析,选型时可参考以下几点:

- CAP模型选择:服务注册发现场景,可用性(AP)通常比强一致性(CP)更重要。因此,Eureka和配置为AP模式的Nacos是更主流的选择。在Eureka和Nacos之间,Nacos提供了更丰富的功能(如配置中心),生态集成也更活跃,是当前更推荐的选择。

- 技术栈与生态:Consul和Etcd为Go技术栈;Eureka、Nacos、ZooKeeper为Java技术栈。需考虑与现有团队技术栈及微服务生态(如Spring Cloud、Dubbo)的集成度。Nacos在Spring Cloud Alibaba生态中表现突出。

- 功能需求:是否需要集成配置中心、多数据中心、更精细的健康检查等。Nacos和Consul在功能集上更为全面。

- 社区活跃度与维护:Eureka 2.0已停止开发,Netflix官方维护减弱。Nacos、Consul社区非常活跃。ZooKeeper作为经典协调服务,稳定但作为注册中心并非其最优场景。

总而言之,对于大多数Java技术栈的微服务项目,Nacos因其在AP/CP上的灵活性、集成的配置中心功能以及活跃的社区生态,已成为当前最值得考虑的注册中心选项之一。技术选型没有银弹,最终还需结合项目的具体规模、团队技术储备和运维能力来决定。希望这篇深入的对比能为你带来清晰的思路。更多关于系统架构和中间件的讨论,欢迎在云栈社区交流分享。