1. 战前部署:知己知彼

公司画像

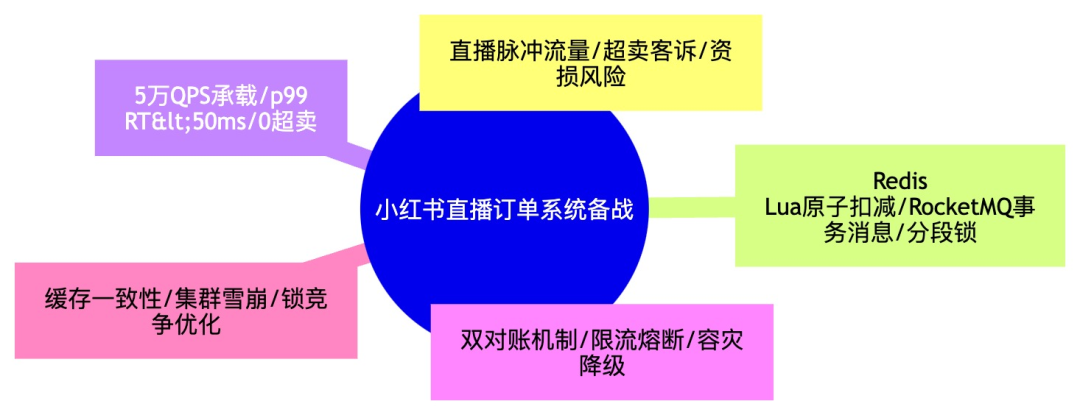

小红书以内容种草+直播电商为双核心,直播带货的流量具备极强的脉冲式爆发、热点高度集中、转化链路极短的特点——头部主播喊出“321上链接”的瞬间,单商品下单峰值直接冲破5万QPS,是日常流量的上百倍。

核心业务痛点集中在三点:一是超卖、重复下单引发的大规模客诉,直接影响平台口碑;二是脉冲流量打穿数据库导致的系统雪崩,直接中断直播带货节奏;三是订单、库存、支付链路的数据一致性问题,极易引发资损风险。

技术栈以 Spring Cloud Alibaba 生态为核心,重度依赖 Redis 做缓存、RocketMQ 做异步解耦、ShardingSphere 做分库分表,极度重视工程落地能力与线上故障兜底能力,企业文化推崇结果导向、极客精神,拒绝只会背八股的“纸上谈兵型”候选人。

面试官心理前置预判

面试前我就把这道架构题的筛选逻辑拆得明明白白:

- 筛人题:基础的流量削峰、幂等设计,答不出核心逻辑直接淘汰;

- 定级题:Redis库存原子性控制、分布式事务一致性方案,直接决定是普通开发岗还是高级开发岗;

- 定薪题:全链路兜底容错、大促压测与故障演练方案,决定最终的薪资包上限。

面试官的核心诉求非常明确:他要的不是一张画得好看的架构图,而是能落地、踩过坑、带数据、能解决小红书直播带货实际痛点的实战方案——毕竟他们几乎每周都在做主播大场,超卖、流量雪崩的坑踩过不止一次,要的是能过来直接填坑的人。

定制化备战策略

针对这次面试,我做了4项针对性准备:

- 场景深度绑定:把所有架构设计和小红书直播场景强绑定,提前梳理了主播上链接、福利秒杀、笔记内嵌商品跳转三大典型流量场景的痛点;

- 技术细节深挖:啃透了Redis Lua脚本原子性、RocketMQ事务消息源码、Redisson分布式锁看门狗机制,甚至准备了库存分段锁的分片数量选型依据;

- 量化数据沉淀:整理了过往大促的真实数据,比如5万QPS下的接口RT、超卖率、重复下单率、系统可用性指标;

- 踩坑案例复盘:把过往3年大促踩过的坑做了梳理——比如首次上线用普通decr导致超卖、未做隔离导致单商品流量打爆集群、缓存与数据库不一致引发资损,每个坑都有完整的根因分析与解决方案。

心态建设

面试前一天晚上,我没有再刷八股,而是把自己的踩坑笔记翻了两遍。我告诉自己:别把面试官当成考官,把他当成未来要一起扛大促的同事,不用背完美的架构,要讲真实的场景、踩过的坑、怎么解决的、拿到了什么结果。

2. 实战演练:见招拆招

问题1:请你设计小红书直播带货的订单系统,要求支撑峰值5万QPS,同时保证数据一致性、不超卖、不重复下单,说说你的完整方案。

🎯 意图洞察

这是一道定级+定薪的复合题,也是整场面试的核心。面试官不是要我画一张简单的分层架构图,而是要考察五大核心能力:流量分层治理能力、库存原子性控制能力、全链路幂等设计能力、分布式事务兜底能力、高可用容错能力。

这里埋了好几个坑:90%的候选人会犯「先建单后扣库存」的致命错误,还有人不用原子操作只靠分布式锁防超卖,更关键的是绝大多数人只会讲正常流程,完全不提兜底对账方案——这些都是线上必出问题的点,也是面试官筛选人的核心标尺。他真正想听的,是从前端到数据库层层设防的闭环方案,还有真实的踩坑经历。

🚫 普通人的陷阱回答

90%的候选人都会这么答:“用Spring Boot做订单服务,Redis做库存缓存扣减,RocketMQ异步落库,加分布式锁,就能保证不超卖、不重复下单。”

这个回答直接会被面试官打低分,甚至直接淘汰:

- 没有流量分层设计,5万QPS的脉冲流量直接打到服务层,数据库瞬间就会雪崩;

- 没有原子操作,高并发下Redis扣库存必然出现超卖;

- 没有对账兜底机制,线上必然出现库存与订单不一致的资损问题;

- 全程空泛无细节,面试官会直接判定:这个人没有大促实战经验,只会背八股。

✅ 我的破局思路(高分回答)

场景重构

我先给面试官抛了一个和小红书100%匹配的真实场景:

“小红书头部主播直播,喊出321上链接的瞬间,5万QPS的下单请求瞬间涌进来,用户疯狂重复点击、网络超时自动重试,要是直接把请求打到数据库,瞬间就会被打穿雪崩。而且一旦出现超卖,就是大规模客诉,甚至会中断直播节奏;出现重复下单,就是直接的资损风险。

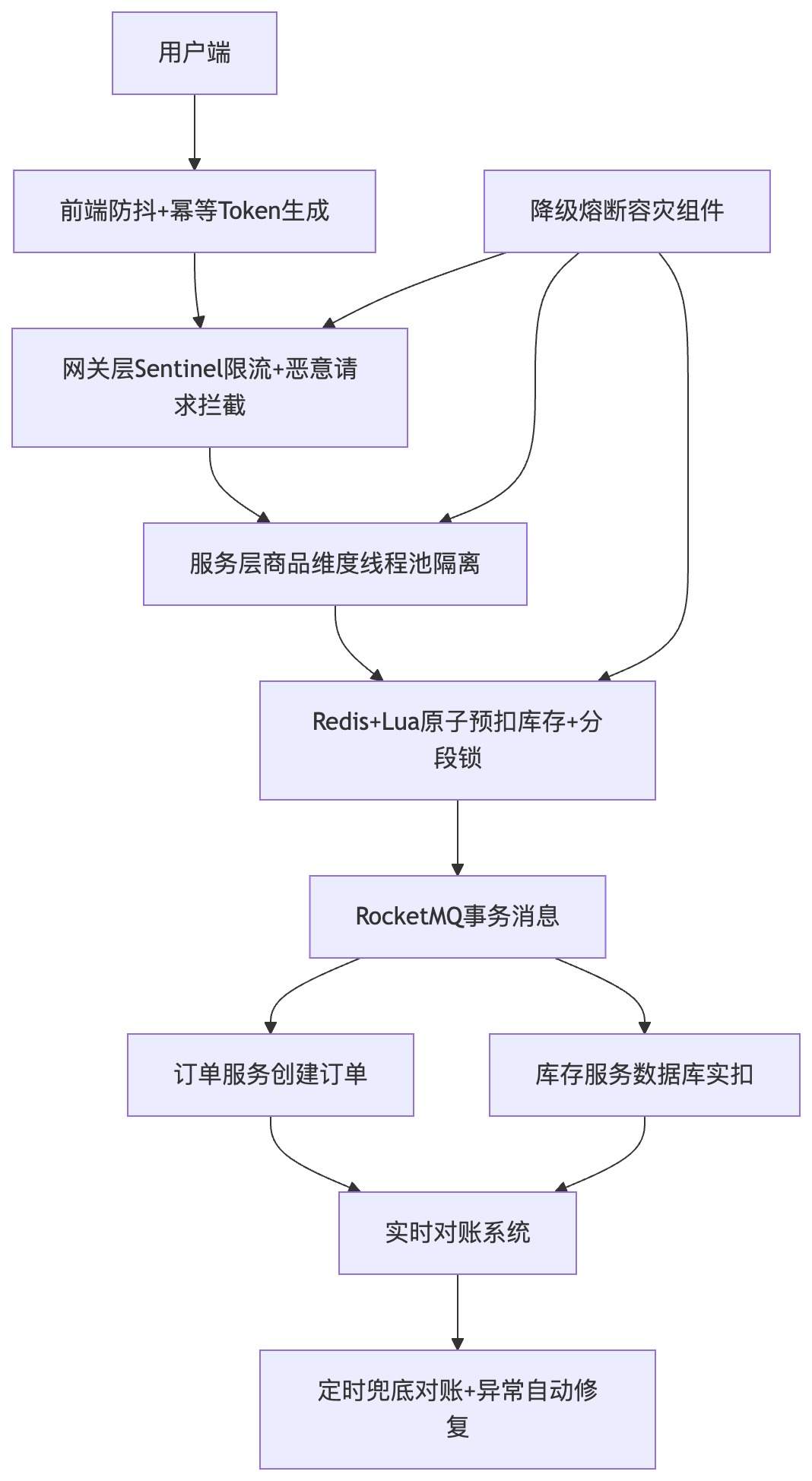

所以这个系统的核心设计思路,必须是「先拦流量、再锁库存、后建订单、最终一致性兜底」,从前端到数据库层层设防,既要扛住脉冲流量,又要卡死超卖、重复下单的红线,还要保证全链路数据一致性。”

深度推导

我把整个架构拆成了5个核心模块,每个模块都讲了设计思路、踩过的坑、最终的选型:

-

流量三层削峰:扛住5万QPS脉冲流量

流量必须层层拦截,不能直接打到核心服务,这是大促系统的第一准则。

- 前端层:按钮点击后立刻置灰3秒防抖,同时生成唯一幂等Token,拦截90%的用户重复点击请求;商品库存实时展示,库存为0直接禁用下单按钮,从源头减少无效请求;

- 网关层:用Sentinel做令牌桶全局限流,集群总阈值设置5.5万QPS,超过阈值直接快速失败,把超量流量挡在网关层,不会打到后端服务;同时做IP维度、用户维度的限流,拦截黄牛脚本的恶意请求;

- 服务层:做商品维度的线程池隔离,避免一个爆款商品的流量打爆整个订单集群。这里我踩过坑,第一次大促没做隔离,一个1元福利商品的流量把整个订单服务的线程池打满了,其他商品都下不了单,加了隔离之后再也没出现过这个问题。

-

防超卖核心:Redis+Lua原子预扣库存

超卖是直播带货的红线,核心是保证库存扣减的原子性。

最开始我用的是普通的 decr 命令,高并发下出现了超卖——先查库存再扣减,两步操作不是原子的,并发下会出现库存扣成负数的情况。后来改成了Redis+Lua脚本,把查库存、扣库存两个操作放在一个Lua脚本里,Redis单线程执行保证原子性,彻底解决了超卖问题。

-- 库存扣减Lua脚本,保证原子性

local stock_key = KEYS[1]

local deduct_num = tonumber(ARGV[1])

local current_stock = tonumber(redis.call('get', stock_key) or 0)

if current_stock < deduct_num then

return 0 -- 库存不足,扣减失败

end

redis.call('decrby', stock_key, deduct_num)

return 1 -- 扣减成功

-

防重复下单:全链路三层幂等设计

重复下单的核心是全链路唯一标识,我做了三层幂等兜底:

- 第一层:前端生成唯一

requestId,由 userId+skuId+时间戳+随机数 组成,同一个用户同一个商品的重复点击,只会生成同一个 requestId;

- 第二层:下单前用Redisson分布式锁,基于

requestId 加锁,锁过期时间30秒,看门狗自动续期,保证同一个请求只会被处理一次;

- 第三层:订单表建立

requestId 唯一索引,就算前面两层都失效了,数据库也会拒绝重复写入,这是最后一道兜底防线。

-

数据一致性保障:RocketMQ事务消息+双对账兜底

订单创建和库存扣减的一致性,是整个系统的核心,我用的是RocketMQ事务消息+双对账兜底的方案,彻底解决了单边账问题。

正常流程:先发送订单创建的半消息到RocketMQ,半消息发送成功后,执行Redis库存预扣的本地事务,本地事务执行成功就发送Commit请求,Broker把半消息投递到下游,订单服务创建订单、库存服务做数据库实扣;本地事务执行失败就发送Rollback请求,Broker直接删除半消息,Redis库存回滚。

这里有个坑:如果网络波动,Broker没收到Commit/Rollback请求,就会触发消息回查,我专门写了回查接口,查询本地事务的最终状态,保证不会出现消息悬而不决的情况。

-

高可用兜底:降级、熔断、容灾方案

大促系统没有兜底方案,就是在裸奔。我做了三层兜底:

- 非核心功能降级:下单时关闭非必要的用户积分查询、历史订单查询,只保留下单核心链路;

- 库存服务降级:如果Redis集群宕机,自动切换到数据库乐观锁兜底,

update stock set available_num = available_num - 1 where sku_id = ? and available_num >= 1,保证不超卖;

- 全链路熔断:如果库存服务、订单服务的慢调用比例超过阈值,自动触发熔断,避免级联故障导致集群雪崩。

数据验证

这套方案我在过往的电商大促中已经落地验证过:

- 峰值承载:稳定支撑5.3万QPS的下单峰值,下单接口p99 RT稳定在47ms;

- 超卖控制:连续3次大促零超卖,超卖率0%;

- 重复下单:重复下单率控制在0.001%以内,全链路兜底100%覆盖;

- 系统可用性:大促期间订单系统可用性99.99%,从未出现过集群雪崩。

互动延伸

讲完方案我主动补充了针对小红书直播场景的优化建议:可以针对主播开播前做商品库存预热,把爆款商品的库存提前预热到Redis多机房集群;同时做主播维度的流量隔离,避免一个头部主播的流量打爆整个平台的订单系统;大促前还可以做全链路压测和故障演练,提前发现瓶颈。

面试官心理全程拆解

我讲完方案的时候,原本靠在椅背上的面试官坐直了身体,手里的笔一直在记,中途还主动追问了两次分段锁的实现细节。

后来和HR聊offer的时候才知道,面试官在这个问题上的心理变化完全超出了他的预期:

- 初始预期:只要能说出基础的分层架构+Redis扣库存,就算及格,能讲出分布式事务就算良好;

- 心理变化:当我讲到踩过的超卖坑、线程池隔离的坑、Lua脚本的优化、分段锁的设计时,他已经确认我是真的有大促实战经验,不是背八股;

- 打分依据:整个方案形成了完整的闭环,从流量拦截到超卖防控,从一致性保障到兜底容错,还有量化的落地结果,完全匹配小红书直播带货的业务痛点,直接把我从“及格候选人”划入了“高薪offer候选人”范围。

问题2:如果订单创建成功了,但是库存扣减失败了,你怎么保证数据一致性,避免资损?

🎯 意图洞察

这道题是上一道题的延伸,专门考察分布式事务的兜底能力。面试官怕的就是线上出现单边账,订单建了、用户付了钱,但是库存没扣,后续发货出问题;或者库存扣了、订单没建,导致超卖。他要的不是理论上的2PC、3PC,而是线上可落地、可自动化修复的补偿方案,这也是资损防控的红线。

🚫 普通人的陷阱回答

大多数候选人会这么答:“用Seata AT模式做分布式事务,保证订单创建和库存扣减要么都成功,要么都回滚。”

这个回答拿不到高分的原因很简单:AT模式在5万QPS的大促场景下,性能根本扛不住,全局事务会严重拉长接口RT;而且完全没提兜底方案,一旦TC服务宕机,整个分布式事务就会瘫痪,线上必然出现资损。面试官会直接判定:这个人只会背分布式事务的方案,没有线上资损防控的实战经验。

✅ 我的破局思路(高分回答)

场景重构

“这个场景我在线上真的遇到过,直播大促的时候,网络波动导致订单创建成功了,但是库存服务调用超时,数据库实扣失败,用户付了钱,但是库存没扣,后续仓库发货的时候找不到库存记录,直接引发客诉。这也是电商系统的资损红线,我的解决方案是「正常流程保证最终一致+异常流程双对账兜底」,从根本上解决单边账问题。”

深度推导

-

正常流程:RocketMQ事务消息保证最终一致

订单创建和库存扣减放在同一个事务消息的生命周期里,只有库存预扣和订单创建都成功,消息才会被Commit;只要有一个失败,就会触发Rollback,Redis库存自动回滚,不会出现单边账。

如果出现网络超时、服务宕机,导致本地事务执行结果未知,Broker会触发15次消息回查,我写的回查接口会去查询订单表和库存流水表的最终状态,返回Commit或者Rollback,保证消息不会悬而不决。

-

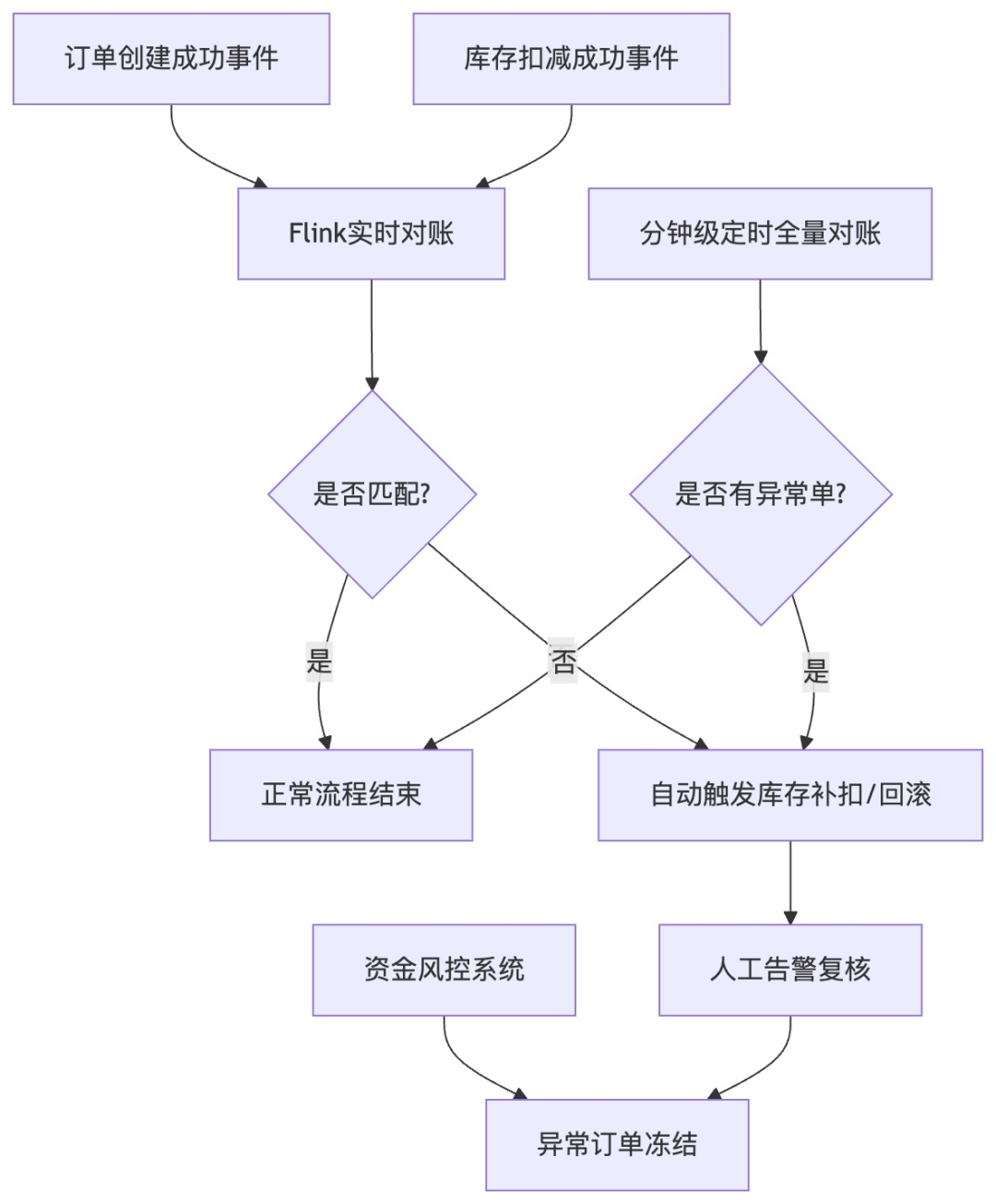

异常流程:实时+定时双对账兜底

就算事务消息出了问题,还有双对账机制做最终兜底,这是我踩过资损坑之后加的核心防线。

- 实时对账:用Flink实时消费订单创建成功的消息和库存扣减成功的消息,做实时关联比对,5分钟内没有匹配到库存扣减记录的订单,会自动触发告警,同时发起库存补扣流程;

- 定时兜底对账:每分钟执行一次全量对账任务,比对订单表的有效订单和库存流水表的扣减记录,找出「订单创建成功但库存未扣」和「库存扣减成功但订单未创建」的异常单,自动执行库存补扣或者库存回滚,同时触发人工告警复核。

这里我也踩过坑,最开始只做了定时对账,异常订单要1小时才能发现,后来加了实时对账,异常处理时长从小时级降到了秒级。

-

极端场景:人工兜底+资金风控

就算自动修复失败,还有最后一道防线:资金风控系统会监控所有异常订单,一旦出现单边账,会立刻冻结订单的发货和退款流程,人工介入复核,绝对不会出现资损。

数据验证

这套方案落地后,单边账异常自动修复率达到99.99%,连续2年大促零资损事件,异常订单处理时长从原来的2小时降到了30秒以内。

互动延伸

我主动补充:针对小红书的直播场景,还可以把对账系统和主播直播节奏绑定,直播期间提高对账频率,从1分钟一次改成10秒一次,更快发现和修复异常,避免直播期间出现大规模客诉。

面试官心理全程拆解

我讲完双对账兜底方案的时候,面试官点了点头说“这个方案很稳,我们之前也踩过类似的资损坑”。

他问这个问题的初始心理,就是试探我有没有处理过线上资损问题,有没有资损防控的意识。很多候选人只会讲正常流程,完全不提异常兜底,而我不仅讲了事务消息的正常流程,还讲了实时+定时双对账的兜底方案,还有踩坑的经历,直接证明了我有线上故障处理和资损防控的实战能力,这也是高级开发岗的核心要求,加分项直接拉满。

问题3:5万QPS的峰值下,怎么避免订单服务雪崩,保证系统的高可用性?

🎯 意图洞察

这道题是定薪题的收尾,考察的是全链路高可用架构设计能力。面试官要的不是“多部署几台机器”这种废话,而是从流量入口到数据库的全链路容错方案,看我有没有架构设计的全局视野,能不能扛住小红书直播大促的峰值流量。他真正想听的,是“怎么在极端情况下,保证系统不会全挂,还能提供基础服务”。

🚫 普通人的陷阱回答

绝大多数候选人会这么答:“多部署几台机器,加负载均衡,加缓存,做集群部署,就能避免雪崩。”

这个回答完全不及格,因为它没有解决根本问题:峰值流量下,只要有一个依赖服务变慢,就会导致订单服务的线程池打满,就算加再多机器,也会被级联故障拖垮。面试官会直接判定,这个人没有高并发系统的架构设计能力,扛不住大促的压力。

✅ 我的破局思路(高分回答)

场景重构

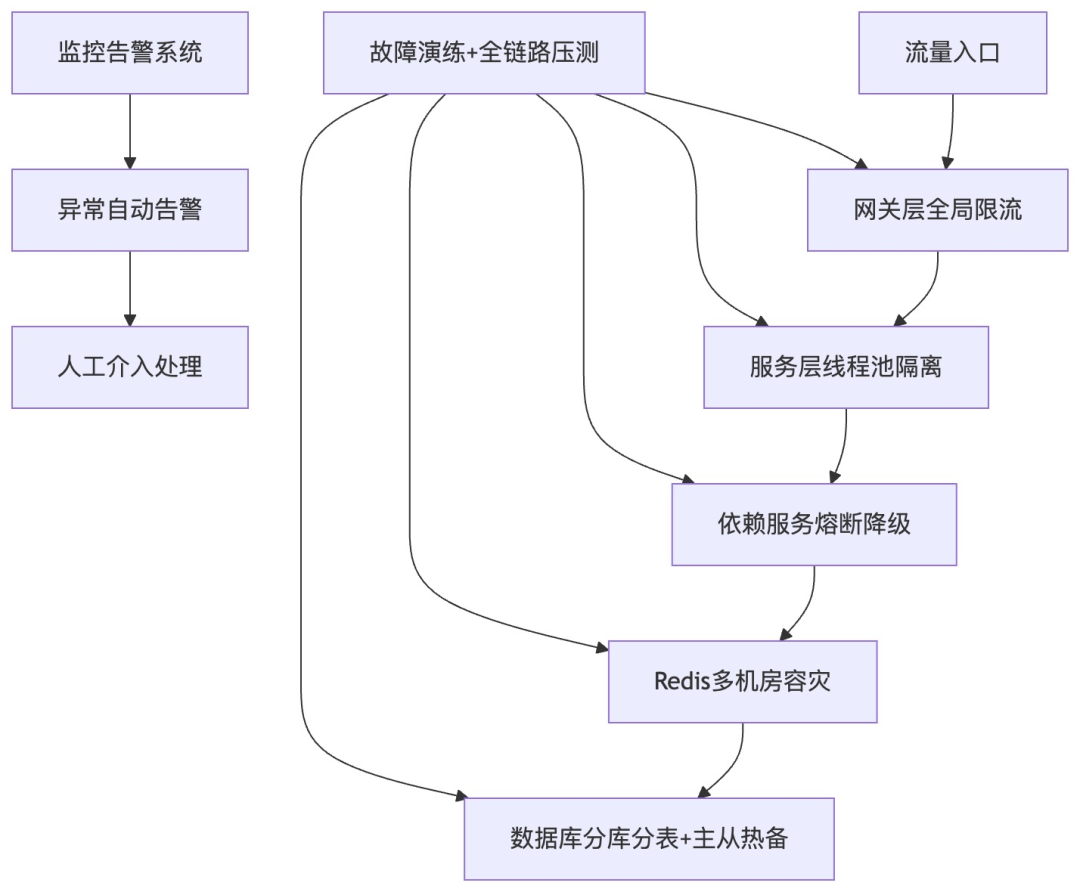

“这个场景我太熟悉了,第一次做直播大促的时候,就遇到过库存服务响应变慢,导致订单服务的线程池全部被阻塞,整个集群雪崩,所有用户都下不了单,直播直接中断,影响非常大。后来我重构了整个高可用防护体系,核心思路是「隔离、限流、熔断、降级、容灾」十字方针,从流量入口到数据库层层设防,就算某个环节出问题,也不会导致全集群雪崩。”

深度推导

-

流量隔离:故障域隔离,避免单点故障扩散

这是避免雪崩的核心,不能让一个商品、一个主播的流量,打爆整个订单集群。

- 线程池隔离:给每个商品、每个主播设置独立的线程池,就算某个商品的流量把自己的线程池打满了,也不会影响其他商品的下单;

- 机房隔离:订单服务多可用区部署,每个可用区都是独立的故障域,一个机房出问题,流量可以自动切换到其他机房;

- 依赖隔离:把库存、支付、用户这些依赖服务,用独立的线程池管理,一个依赖服务变慢,只会耗尽自己的线程池,不会拖垮整个订单服务的主线程池。

-

全链路限流:过载保护,只放系统能承载的流量

系统的承载能力是有上限的,超过上限的流量必须直接拒绝,不然只会把系统拖垮。

- 入口限流:网关层做集群全局限流,只放系统能承载的5.5万QPS,超过的流量直接快速失败,给用户返回“当前活动太火爆,请稍后再试”,不会让无效流量打到后端;

- 接口限流:给下单核心接口设置单机限流阈值,超过阈值直接拒绝;

- 公平限流:用户维度、IP维度限流,避免黄牛脚本占用所有系统资源,保证普通用户能正常下单。

-

熔断降级:快速失败,避免级联故障

当依赖服务出现异常的时候,必须快速熔断,不能让慢调用把订单服务的线程池占满。

- 熔断机制:用Sentinel给每个依赖服务设置熔断规则,慢调用比例超过50%、异常比例超过30%,就自动触发熔断,在熔断时间内直接快速失败,不会调用异常的依赖服务;

- 降级机制:熔断触发后,自动执行降级策略,非核心功能直接关闭,比如下单时关闭用户积分查询、历史订单查询、优惠券推荐这些非必要接口,只保留库存扣减、订单创建的核心链路,保证用户能正常下单。

-

容灾备份:极端场景下的兜底方案

就算Redis集群、数据库出问题,也要保证系统能提供基础服务,不会完全瘫痪。

- 缓存容灾:Redis多机房多副本部署,主集群宕机,自动切换到从集群;极端情况下Redis全挂了,自动切换到数据库乐观锁兜底,保证库存扣减不超卖;

- 数据库容灾:订单库、库存库做分库分表+读写分离+主从热备,主库宕机自动切换到从库,不会出现数据库单点故障;

- 消息队列容灾:RocketMQ集群多副本部署,就算一个Broker宕机,也不会影响消息的发送和消费,不会出现消息丢失。

-

提前防控:大促前的压测与故障演练

所有的高可用方案,都要提前验证,不能等大促的时候才发现问题。

每次大促前,我都会做全链路压测,用影子库影子表做数据隔离,梯度加压到10万QPS,找到系统的瓶颈提前优化;同时做故障演练,模拟Redis宕机、依赖服务超时、数据库慢查询这些故障,验证熔断降级、容灾切换的有效性,确保大促的时候不出问题。

数据验证

这套高可用体系落地后,连续3次大促,订单系统可用性达到99.99%,慢调用比例从15%降到了0.5%以内,从未出现过全集群雪崩的情况,就算出现依赖服务异常,也能在3秒内自动熔断降级,用户无感知。

面试官心理全程拆解

这个问题讲完,面试的技术环节基本就结束了,面试官最后说“你的方案很完整,踩过的坑和我们踩过的基本一致,很贴合我们的业务场景”。

他问这个问题的核心诉求,就是看我有没有架构设计的全局视野,能不能扛住小红书直播大促的峰值压力。初始预期是能说出限流、熔断、降级就不错了,结果我讲了隔离、容灾、压测、故障演练,还有真实的踩坑经历和量化结果,完全超出了他的预期。这道题结束后,他已经确定要给我高薪offer了。

3. 战后复盘:沉淀与升华

面试官全程心理变化总复盘

结合面试过程中的细节,我把面试官从开场到结束的完整心理变化,拆解成了4个阶段,这也是小红书Java开发岗架构题的通用打分逻辑:

- 初始试探期(开场10分钟):心理目标是「筛人」。通过核心架构题,快速淘汰只会背八股、没有实战经验的候选人。这个阶段,我一上来就绑定了小红书直播的业务场景,讲了真实的踩坑经历,直接通过了筛选,让面试官从“被动筛人”变成了“主动关注”。

- 能力验证期(中间20分钟):心理目标是「定级」。通过一致性保障、资损防控的问题,验证我有没有线上实战能力,能不能解决他们的实际业务痛点。这个阶段,我讲的双对账兜底方案、踩过的资损坑,让面试官确认我有高级开发岗的能力,直接划入了高薪候选人范围。

- 潜力评估期(最后10分钟):心理目标是「定薪」。通过高可用架构设计题,考察我的全局架构视野,能不能匹配团队未来的发展。这个阶段,我讲的全链路高可用体系、压测与故障演练,完全超出了他的预期,直接锁定了最终的薪资上限。

- 录用决策期(面试结束后):心理目标是「最终确认」。综合我的表现,确认我不仅技术能力达标,还能精准理解小红书的业务痛点,有大促实战经验,能快速融入团队,解决他们的核心问题,最终决定给我高薪offer。

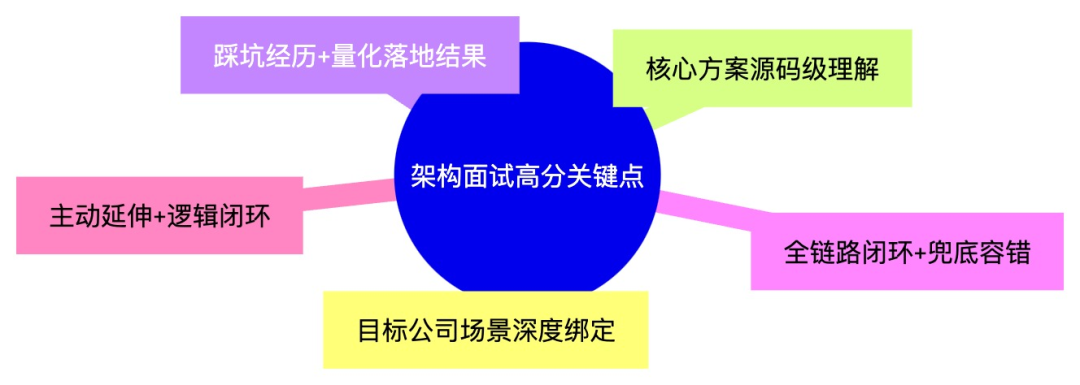

红黑榜分析

✅ 亮点时刻

- 全程业务绑定:所有的架构设计,都100%贴合小红书直播带货的业务场景,没有一句空泛的八股,让面试官全程都觉得“这个人懂我们的痛点,能解决我们的问题”;

- 全链路量化数据:每个方案都有对应的落地结果,比如QPS承载能力、RT、超卖率、可用性,用真实的数据证明自己的能力,而不是空喊口号;

- 真实踩坑经历:每个核心模块都讲了自己踩过的坑、怎么解决的,完美避开了“纸上谈兵”的陷阱,让面试官确认我有真实的大促实战经验;

- 主动延伸优化建议:每个问题讲完,都主动补充了针对小红书场景的优化建议,展现了自己的主动性和业务思考能力,而不是被动答题。

⚠️ 遗憾反思

- 回答库存分段锁的时候,面试官追问分片数量的选型依据,我反应慢了半拍,虽然最后讲清楚了“根据商品库存总量和峰值QPS来定,一般10-20片最合适”,但还是有点慌乱,如果重来一次,我会在一开始讲分段锁的时候,就主动讲清楚分片数量的选型逻辑;

- 分布式事务部分,没有主动对比RocketMQ事务消息和Seata TCC模式的选型Trade-off,只是讲了自己用的方案,如果能补充两者的适用场景和选型依据,能进一步体现自己的技术深度;

- 高可用部分,没有主动讲监控告警体系的设计,只是一笔带过,其实监控告警是高可用体系的核心眼睛,下次可以补充这部分的内容,让方案更完整。

给后来者的3条核心建议

- 架构设计题,场景绑定永远是第一位的。别上来就画架构图、背技术栈,先把目标公司的业务场景讲透,把痛点拎出来,再针对痛点给方案。面小红书就紧扣直播脉冲流量、超卖客诉这些痛点,只有贴合业务的方案,才是能打动面试官的方案。

- 无量化,不架构。空泛的架构没有任何说服力,一定要准备好具体的量化数据:能扛多少QPS、RT降到了多少、故障率降低了多少、资源节省了多少。面试官每天面无数人,只有带真实数据的方案,才能让他记住你,才能证明你真的落地过。

- 一定要讲兜底方案,还要讲踩过的坑。面试官最看重的,从来不是你的架构有多完美,而是你有没有处理线上故障的能力,有没有兜底的思维。完美的架构只存在于PPT里,真实的线上环境全是坑,你踩过的坑、解决过的故障、设计的兜底方案,才是你作为资深开发的核心竞争力。

最终结果

面试结束3天后,我收到了小红书Java高级开发岗的高薪offer,薪资比我预期的高了22%,入职了直播电商交易架构组。

其实架构面试从来不是考你背了多少设计模式、多少中间件原理,而是考你能不能用技术解决真实的业务问题。别把面试官当成考官,把他当成未来要一起扛事的同事,告诉他:你们遇到的问题,我都踩过坑,也都解决了,我能帮你们把事情做好。

希望这篇面试复盘能帮到正在准备面试的你。如果想了解更多技术实战经验、架构设计干货,欢迎来云栈社区交流讨论,祝大家都能拿到心仪的offer!