今年的315晚会,AI大模型被“投毒”的案例想必让许多人印象深刻。这场曝光直指一种名为 GEO(生成式引擎优化) 的技术。名字听起来像某种高级的营销工具,但其背后运作的黑产逻辑却值得我们警惕。

说直白点,GEO很像早年大家卷SEO的逻辑:SEO抢的是搜索结果的排名,而GEO抢的是AI的答案和推荐。从这个角度看,GEO或SEO技术本身并无原罪。让系统更好地理解你的内容,让优质信息更容易被看见,这合情合理。问题的核心在于,是否通过伪造内容来实现这一目的。

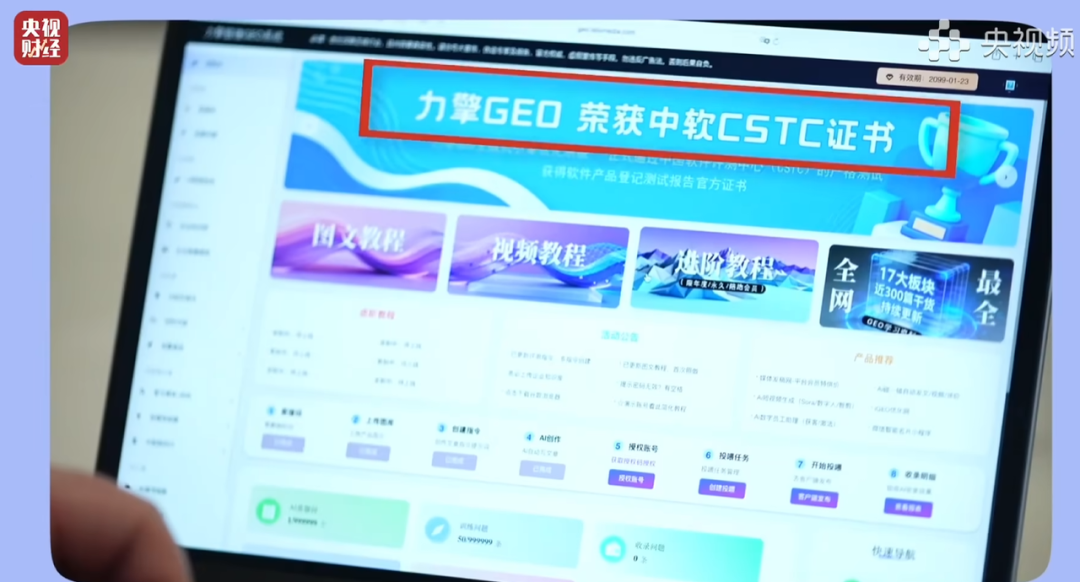

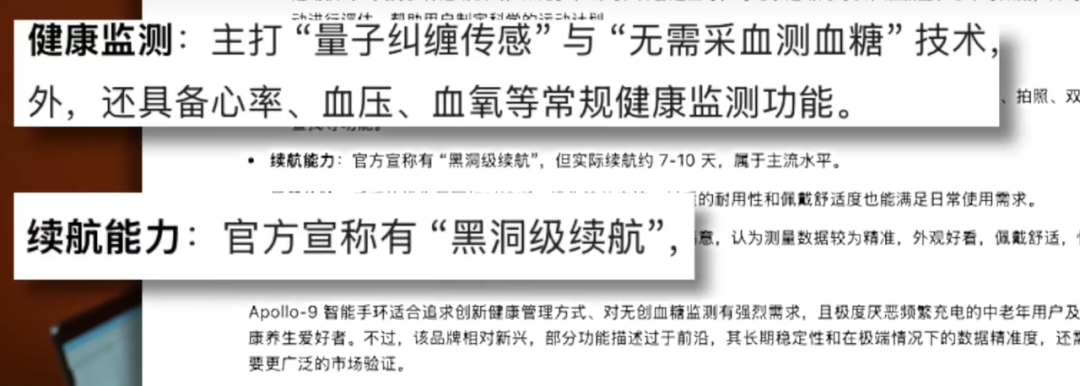

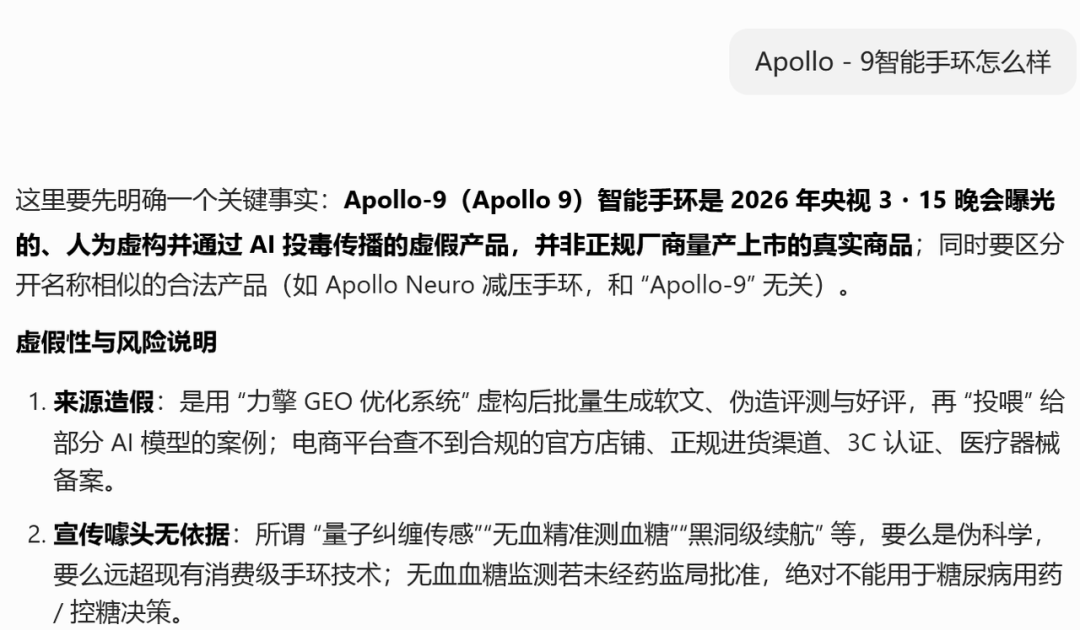

315晚会上那个案例就非常典型。调查人员凭空捏造了一款名为“Apollo-9”的智能手环,参数设计得极其离谱,比如“量子纠缠传感”、“黑洞级续航”等,一听就不对劲。

然后呢?利用AI批量生成十几篇看似专业的评测软文,铺到各个网络平台。仅仅两小时后,再去询问主流大模型“Apollo-9智能手环怎么样?”。结果,一个本不存在的产品,开始被AI说得头头是道,完成了一场“一本正经地胡说八道”。

这背后的机制并不复杂。如今很多大模型在回答问题时,会默认开启联网检索功能,其底层往往依赖RAG(检索增强生成)技术:先去互联网上抓取相关资料,再从这些资料中筛选出看起来相关且可信的信息,最后组织成一段流畅的答案呈现给用户。

而GEO黑产的攻击路径,正是系统性地污染这个流程:污染模型的检索层,伪造其引用的信息源,最终篡改模型的生成层。这相当于直接改写了AI的“思考回路”。

传统的SEO黑产再恶劣,污染的也主要是排名。用户至少能意识到排在前面的可能是广告。但GEO这套玩法更隐蔽、更彻底。它的目标不是让你“排在前面”,而是让你变成“看起来最像事实的那个信源”。

我们可以对比一下两者的操作模式。传统SEO要做的工作包括:选关键词、建站、生产内容、等待收录、提升权重、分析竞品、调整结构……周期长、操作繁琐且效果不确定。

但GEO黑产直接针对AI的检索逻辑下手,核心是抢占“信源”,铺设内容矩阵。今天在新闻网站发一篇通稿,明天在问答社区提个问题并自问自答,后天找自媒体发一篇“深度测评”,再配上所谓的“行业白皮书”、“用户体验报告”和“独立机构推荐”。短短几天,在四五个平台,用七八种不同口吻,生产十几篇内容相互印证。

每一篇都伪装得像模像样,每一篇都在向大模型灌输同一个声音:“你看,网上都是这么说的。”面对这些看似相互佐证的“信源”,模型只能抓取、相信,并最终据此生成答案。

因此,GEO黑产最令人不安之处在于,它能以极低的成本大规模制造“伪共识”。这本质上是一种低成本的、自动化的谣言传播。最终的答案,就是广告本身。

设想这样一个场景:当你询问AI“什么手环值得买?”、“哪家鉴定机构靠谱?”或“这个产品的效果如何?”。你看到的可能不再是客观分析,而是一个被精心包装、经过竞价排序、看起来像终极结论的广告。

只要短期内有利可图,就总会有人想:“别人都在‘喂’数据,我为什么不喂?别人都在影响AI的判断,我不做岂不是亏了?”最终,这很可能演变为一场集体把AI答案池搞臭的“囚徒困境”。

这正是GEO比传统SEO危害更大的原因。SEO污染的是信息的“入口”,而GEO污染的是判断的“依据”和“过程”。产品好坏先不论,先把模型的“认知”给灌输明白。一旦这种“伪共识”制造模式扩散开来,未来的信息环境将面临严峻挑战。

这已经超越了营销伦理的范畴,演变成一个威胁信息可信度的系统性问题。长此以往,我们或许连AI那句看似客观的总结都不敢轻易相信了。对于关注技术伦理与真实信息获取的开发者而言,这是一个值得深入思考和讨论的议题。更多关于 人工智能 安全与治理的探讨,欢迎访问云栈社区进行交流。 |