你有没有遇到过 Service 找不到后端 Pod,或者 Deployment 管理了不该管的 Pod?问题往往出在 Pod Selector 的配置上。作为 云原生 编排系统的核心匹配机制,理解它的规则是写对 K8s 配置的第一步。

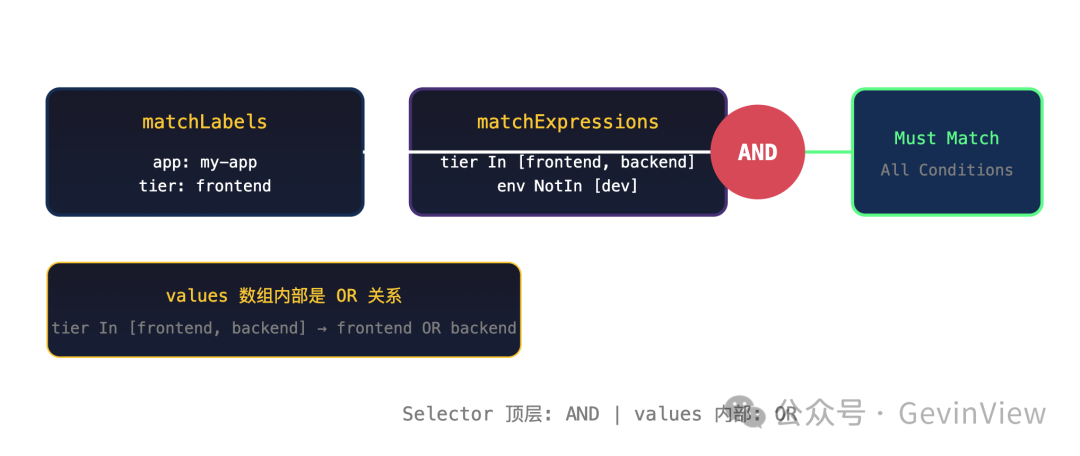

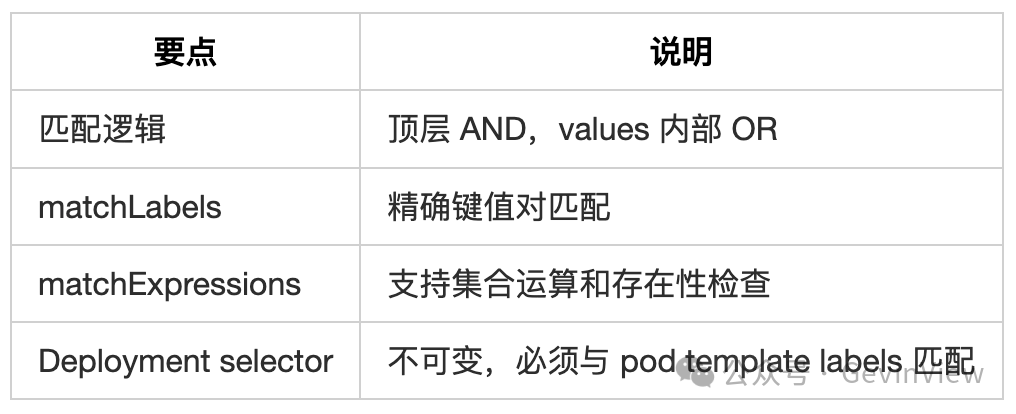

无论是 Service 选择后端 Pod,还是 Deployment 识别它管理的 Pod,都依赖 Pod Selector。它的核心原理很简单:通过一组键值对去匹配 Pod 上定义的 Labels,所有条件必须满足(AND 逻辑),符合条件的 Pod 才会被选中。

核心原理

Pod Selector 通过 键值对 匹配 Pod 上的 Labels,符合条件的 Pod 会被选中。

筛选规则:所有条件必须满足,即 AND 逻辑。

1. matchLabels:精确匹配

matchLabels 是最简单直接的方式,通过指定精确的键值对进行匹配。

Service 示例

apiVersion: v1

kind: Service

metadata:

name: my-service

spec:

selector:

app: my-app # 必须满足

tier: frontend # 必须满足

ports:

- protocol: TCP

port: 80

targetPort: 8080

上面的 Service 只会选择集群中同时具有 app=my-app 且 tier=frontend 这两个标签的 Pod。

Deployment 示例

apiVersion: apps/v1

kind: Deployment

metadata:

name: my-deployment

spec:

replicas: 3

selector:

matchLabels:

app: my-app # Deployment 用它来识别管理的 Pod

template:

metadata:

labels:

app: my-app # 必须与 selector.matchLabels 一致

version: v1 # 额外标签,会传递给 Pod

spec:

containers:

- name: my-app

image: nginx:1.21

关键点:spec.selector.matchLabels 必须与 spec.template.metadata.labels 中定义的所有matchLabels键值对完全匹配,否则创建会失败。

2. matchExpressions:表达式匹配

当简单的键值对匹配(matchLabels)无法满足需求时,可以使用 matchExpressions 来支持更灵活的集合运算和存在性检查。

selector:

matchLabels:

app: my-app # 仍然需要满足

matchExpressions:

- key: tier

operator: In

values: [frontend, backend] # tier 在集合中

- key: env

operator: NotIn

values: [dev] # env 不在集合中

- key: dedicated

operator: Exists # dedicated 键存在即可

操作符说明

| 操作符 |

含义 |

In |

值在指定集合中 |

NotIn |

值不在指定集合中 |

Exists |

键存在(忽略值) |

DoesNotExist |

键不存在 |

Gt |

值大于指定数值 |

Lt |

值小于指定数值 |

3. 筛选规则详解

AND 逻辑

所有条件都必须满足,这是最核心也最容易出错的点:

selector:

app: my-app

tier: frontend

这只会选中同时拥有 app=my-app 和 tier=frontend 这两个标签的 Pod。

values 数组内部是 OR

这是 Pod Selector 中唯一允许“或”逻辑的地方:

- key: tier

operator: In

values: [frontend, backend] # tier == "frontend" OR tier == "backend"

完整示例

selector:

matchLabels:

app: my-app

matchExpressions:

- key: tier

operator: In

values: [frontend, backend]

- key: environment

operator: NotIn

values: [dev, test]

最终的选中条件是:app=my-app 且 tier ∈ {frontend, backend} 且 environment ∉ {dev, test}。

4. 常见用途

服务发现

# 所有带有 app=my-app 标签的 Pod 都会被这个 Service 选中

selector:

app: my-app

金丝雀发布

通过为不同版本的 Pod 打上不同的 version 标签,并用不同 Selector 的 Service 来区分流量。

# Stable Service:只将流量路由到 stable 版本

selector:

app: my-app

version: stable

# Canary Service:只将流量路由到 canary 版本

selector:

app: my-app

version: canary

环境隔离

selector:

app: my-app

env: production # 只选中生产环境的 Pod

5. 避坑与最佳实践

坑 1:Deployment selector 不可变

# 错误示例:创建后再修改 selector 会失败

spec:

selector:

matchLabels:

app: my-app # immutable,无法修改

解决方案:由于 selector 不可变,必须删除后重建。根据是否允许业务中断,有两种操作方式:

# 首先,备份当前 Deployment 配置(两种方式都要先备份)

kubectl get deployment my-deployment -o yaml > backup.yaml

方式一:允许业务中断(简单直接)

# 直接删除 Deployment,这会级联删除其管理的 ReplicaSet 和 Pod

kubectl delete deployment my-deployment

# 修改 backup.yaml 中的 selector,然后重新创建

kubectl apply -f backup.yaml

方式二:不允许业务中断(零中断)

# 删除 Deployment,但保留 ReplicaSet 和 Pod(避免业务立即中断)

kubectl delete deployment my-deployment --cascade=false

# 修改 backup.yaml 中的 selector,然后重新创建

# 新 Deployment 会创建新的 ReplicaSet,并通过滚动更新逐步替换旧 Pod

kubectl apply -f backup.yaml

方式二的后续:旧 ReplicaSet 会变成“孤儿”,不再被任何控制器管理。当滚动更新完成后,可以手动删除旧的 ReplicaSet:kubectl delete replicaset <old-replicaset-name>

注意:--cascade=false 会保留旧的 ReplicaSet,但新 Deployment 的 selector 已经改变,因此旧 ReplicaSet 会变成孤儿,其管理的旧 Pod 也会继续运行。此时需要手动清理或等待滚动更新完全覆盖。

坑 2:标签泄露

Deployment 的 spec.template.metadata.labels 会传递给它创建的每一个 Pod。如果某个标签(如 version)只想用于区分版本,而不希望被 Service 选中,那么不要把这个标签放在 Service 的 selector 中。

# 正确做法:Service 只用 app 标签选择,因此不会选中 version=v2 的 Pod

template:

metadata:

labels:

app: my-app # 会被 Service 选中

version: v2 # Service 用 app 选择,所以不会选中 v2

坑 3:selector 冲突

如果集群中已经存在与你要创建的 Deployment 的 selector 匹配,但并非由该 Deployment 创建的 Pod,那么创建操作会失败,并报错:

Invalid value: ... field is immutable

排查方法:

# 查看所有带有 app=my-app 标签的 Pod,检查是否有“不属于”你的Pod

kubectl get pods -l app=my-app --all-namespaces

# 查看当前 selector 匹配的 ReplicaSet

kubectl get replicaset -l app=my-app

6. 验证方法

掌握以下命令,可以快速验证和调试你的 Selector 配置。

# 查看 Pod 及其标签

kubectl get pods --show-labels

# 按标签过滤 Pod

kubectl get pods -l app=my-app

kubectl get pods -l 'app in (my-app, other-app)'

# 查看 Service 实际关联的 Pod(通过 Endpoints)

kubectl get endpoints my-service

# 验证 selector 匹配的 Pod 数量

kubectl get pods -l 'app=my-app,tier=frontend'

总结

Pod Selector 是 Kubernetes 资源关联的基石。牢记其 AND 逻辑,善用 matchLabels 和 matchExpressions,避开 Deployment Selector 不可变等常见坑点,你就能在服务发现、应用部署和流量治理等场景中游刃有余。更多云原生相关的实战讨论和资源,欢迎访问 云栈社区。