昨日,智谱AI发布了其上市近三个月后的首份年度财报——2025年业绩报告。今年1月8日,智谱登陆港交所,股价一度表现强劲,目前市值超过3000亿港元。

这份业绩报告呈现出“喜忧参半”的局面:收入实现了激增,但综合毛利率有所下滑,亏损同比扩大。智谱在财报中表示,公司预计通过收入增长和提升运营效率来实现盈利,但尚未给出具体的时间表。同时,财报也释放了一个明确信号:公司将继续加大投资,并增加国产芯片在模型训练中的使用比例。

营收翻倍增长,亏损同比扩大

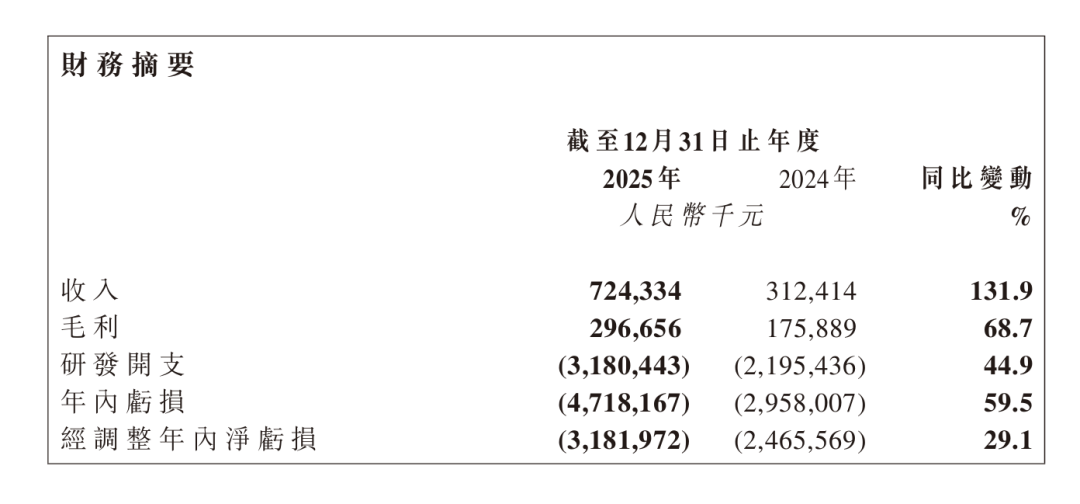

财报数据显示,智谱AI在2025年营收达到7.24亿元,同比增长131.9%;毛利为2.97亿元,同比增长68.7%。然而,公司的毛利率从2024年的56.3%下降至41.0%,减少了15.3个百分点。年内亏损扩大至47.18亿元,同比增幅为59.5%;经调整后的净亏损为31.82亿元,同比扩大29.1%。研发投入高达31.8亿元,同比增长44.9%。

从这些数据可以看出,智谱是一家典型处于高速投入期的大模型公司:收入增长迅猛,但亏损额巨大;研发投入强度极高,达到营收的4.4倍。

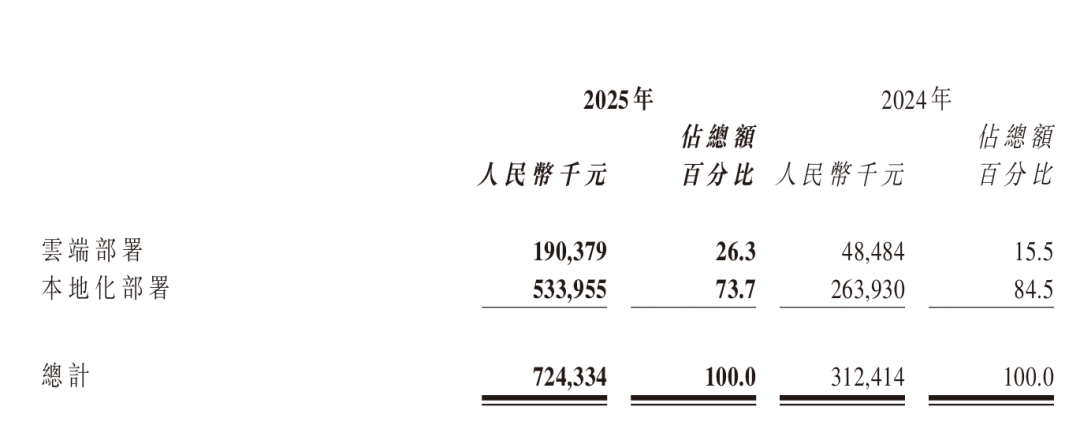

在收入结构上,智谱2025年的业务以本地化部署服务为主。其中,本地化部署服务收入为5.34亿元,同比增长102.3%,占总收入的73.7%;云端部署服务收入为1.90亿元,同比大幅增长292.6%,占比为26.3%。

值得注意的是,这两种服务模式的毛利率在2025年出现了分化。云端部署的毛利率从上一年的3.3%提升至18.9%,改善显著;而本地化部署的毛利率则从66.0%下降至48.8%。

财报对此进行了解释:云端部署业务毛利率的提升,主要得益于模型推理效率的优化、算力规模扩张带来的边际成本递减,以及服务价格的适当上调。即通过对推理侧的极致工程优化,在显著降低单位成本的同时,实现了毛利表现的稳健提升。而本地化部署业务毛利率的下降,则是由于为满足客户定制化需求而投入了更多的交付资源。

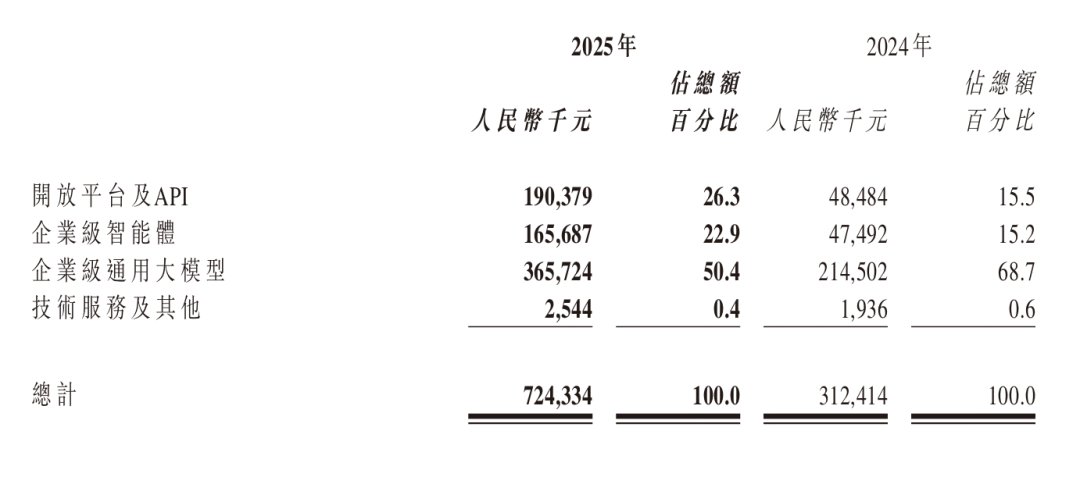

具体按业务形态拆分,2025年智谱的企业级通用大模型收入为3.66亿元,占比50.4%;开放平台及API收入为1.90亿元,占比26.3%;企业级智能体收入为1.66亿元,占比22.9%;技术服务及其他收入占比较低。

值得强调的是,智谱所有业务线的收入相较2024年均实现了同比增长。其中,企业级通用大模型收入增幅达70.5%,开放平台及API的收入增幅高达292.6%,企业级智能体收入增幅达248.8%,技术服务及其他收入增幅为31.6%。

Token价值大增,核心指标直追Anthropic水平

“‘智能上界的突破’是这个时代唯一的物理第一性。如果说智能上界决定了技术的定价权,那么Token的消耗规模则决定了商业价值的体量。”智谱在财报中阐述了一个核心公式:AGI商业价值 = 智能上界 × Token消耗规模。

财报指出,2025年,随着GLM系列模型在编程(Coding)与智能体(Agent)等元场景的深度渗透,智谱的付费Token消耗量实现了指数级跃迁。凭借GLM系列,智谱实现了从开发者生态到全球化MaaS(Model-as-a-Service)平台的全面爆发。

在稍后举行的业绩电话会上,智谱CEO张鹏进一步提出了“Token架构力”(Token Architect)这一新概念,将AI生产力价值定义为“智能调用量 × 智能质量 × 经济转化效率”。张鹏强调,“当模型足够强,API本身就是最好的商业模式。”

在业务模式上,智谱一直将对标对象设为Anthropic。Anthropic的CEO Dario Amodei曾透露,公司60%至75%的收入来自API,并且明确将编程作为核心用例。智谱此次财报中表现最为亮眼的,也正是其API平台业务。

财报显示,截至报告期末,智谱API平台的年度经常性收入(ARR)达到17亿元,在过去一年中提升了60倍。2025年推出的GLM Coding Plan,付费开发者规模已突破24.2万。GLM-5发布后24小时内,即获得了字节、阿里、腾讯等头部大厂的官方接入,中国前10大互联网公司中已有9家深度集成GLM。2026年3月推出的Claw Plan上线仅两天订阅用户即突破10万,上线20天用户数突破40万。截至2026年3月,智谱的平台注册企业及用户总数突破400万,服务覆盖全球超过218个国家和地区。

张鹏指出,智谱API价格在2026年第一季度上调83%后,市场依然供不应求,调用量反而增长了400%。在今年第一季度,智谱对API价格进行了两次上调。例如在2月,智谱主动上调价格30%并取消了首购优惠。

人人都是“Token架构师”,告别App堆叠时代

“智谱不是一家传统意义上的软件公司,我们是一个以AGI为信仰的原生智能实验室。”财报对未来的技术范式进行了预测:2026年,智能范式将从轻量化的Vibe Coding(氛围编程)向工业级的Agentic Engineering(智能体工程)演变,再进化为具备自主规划、环境感知与自我迭代能力的数字工程师,最终实现跨越多步迭代、具备逻辑一致性的长程任务(Long-horizon Task)闭环执行。这将进一步带来智能上界的突破与Token调用的指数级增长。

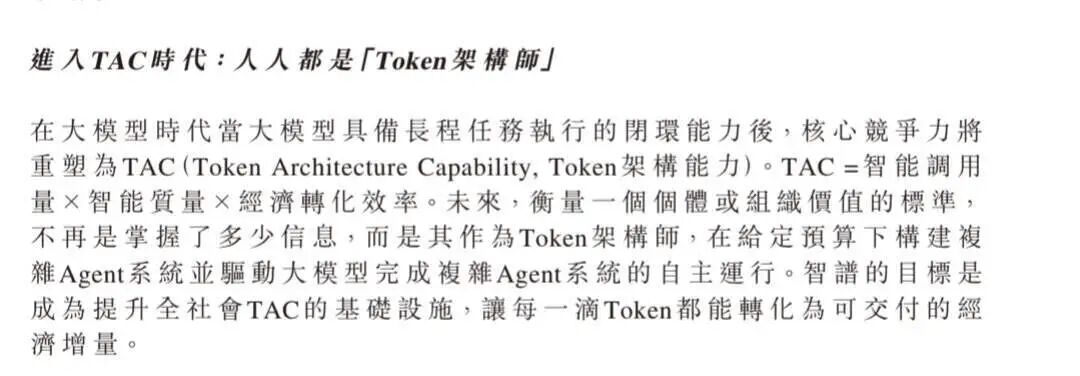

而当大模型具备长程任务执行的闭环能力后,核心竞争力将重塑为TAC(Token Architecture Capability,Token架构能力)。TAC = 智能调用量 × 智能质量 × 经济转化效率。

未来,衡量一个个体或组织价值的标准,将不再是掌握了多少信息,而是其作为“Token架构师”,在给定预算下构建复杂Agent系统并驱动大模型完成自主运行的能力。“智谱的目标是成为提升全社会TAC的基础设施,让每一滴Token都能转化为可交付的经济增量。”

随着OpenClaw等应用驱动的Token消耗进入指数级轨道,一场智能输出革命正在发生。首先是推理再中心化:凭借超大规模集群的规模经济与极致的推理优化,云端大参数基模的效率将进一步提高。其次是高质量Token的“出海”。据了解,GLM-5的国产化适配已超越简单的算子移植,进入了软硬协同设计(Co-design)阶段。在底层内核层面,通过Lightning Indexer等定制化融合内核与FlashComm通信优化,最大限度隐藏了内存访问与通信延迟,这种深度调优让GLM系列在国产芯片上跑出了比肩国际顶级芯片的推理效率。

进入2026年,算力范式正在发生剧变,OpenClaw的爆发式应用提前引燃了Token消耗狂潮。智谱称,他们将继续加大投入,尤其是深耕国产芯片的“Day 0”适配与软硬一体化调优。“我们将推理性能压榨至极限,不是为了短期盈利,而是为了支撑那条不断上扬的、高质量Token消耗的指数曲线。”

同时,智谱指出,大模型正在“吞噬”软件,未来的计算平台将不再是App的堆叠,而是API商店与Agent矩阵的协同。在LLM-OS架构下,模型能直接理解模糊意图、拆解长程任务并调度全栈资源。谁的模型进入了系统内核,谁就掌握了下一代计算的定义权。

参考链接:

声明:本文为对公开信息的整理与解读,仅供参考。

你对大模型公司的商业模式和Token经济学的未来怎么看?欢迎到 云栈社区 的 人工智能 板块,与更多开发者一起探讨AI领域的最新趋势与技术实践。