“一切更像是围绕融资不断变换的叙事策略”。

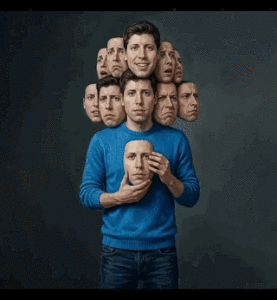

《纽约客》近日发布深度调查,揭露了OpenAI CEO萨姆·奥特曼职业生涯中多次被指控“不诚实”与“操纵人心”。在资金与权力的诱惑面前,他屡次通过文字游戏、暗箱操作等方式,突破自己此前许下的各项承诺。

这一指控并非空穴来风。奥特曼的同学、程序员亚伦·斯沃茨在2013年自杀前不久曾向朋友警示,称奥特曼“是个反社会人格者。他什么都做得出来。”微软一位高管则直言,奥特曼惯于“歪曲事实、歪曲真相、重新谈判、违背协议”。前OpenAI研究员温赖特也评价道:“他设计的制度,看似会约束未来的自己,但当约束真正生效时,他会毫不犹豫地重写规则。”

奥特曼的说服能力甚至被同行形容为“现实操控”。一位曾与其共事的科技高管表示:“他的说服力近乎‘心灵控制’,远超常人。”

《纽约客》耗时18个月,深度访谈了一百多位熟知奥特曼商业运作逻辑的核心知情者,还独家获取了两份此前从未对外披露的关键文件。一份是前首席科学家伊利亚·苏茨克维尔整理的逾70页内部备忘录,汇集了Slack聊天记录、人力资源档案及管理层会议纪要,直指奥特曼的不当行为;另一份则是现任Anthropic CEO达里奥·阿莫迪在OpenAI任职期间留下的200多页私人笔记,详细记录了他对公司治理及奥特曼行为的观察与质疑。

在多方知情者的交叉叙述中,奥特曼的人物形象愈发矛盾:其一,是深入骨髓的取悦欲,驱使着他渴望在任何场合都成为人群中备受青睐的焦点;其二,则是对欺骗行径可能引发的连锁恶果,始终抱持着一种近乎反社会人格的漠然。

“没有必要形成正式书面文件”

2023年11月那场闪电式解雇后,独立新董事会介入监督调查。但新当选的成员包括前哈佛大学校长劳伦斯·萨默斯、前Facebook首席技术官布雷特·泰勒,均是在与奥特曼密切沟通后确定的人选。

2024年3月,OpenAI宣布“免除奥特曼责任”,但并未公布完整调查报告,仅在官网发布了一份约800字的声明,承认公司内部曾出现“信任破裂”。多位参与调查的人士透露,整个调查并未形成书面报告,结论仅以口头形式向董事会成员汇报,并主要在萨默斯和泰勒之间沟通。

“审查并没有得出‘萨姆是品行典范’的结论,”一位接近调查的人士表示。相反,调查的重点似乎并不在于厘清其诚信问题,而更倾向于排查是否存在明确的违法行为;在这一标准下,奥特曼被认定可以继续担任CEO。知情人士称,不形成书面报告的决定,部分参考了萨默斯与泰勒私人律师的建议。对此,萨默斯拒绝置评;泰勒则表示,基于口头汇报内容,“没有必要形成正式书面文件”。

信息披露的缺失引发了内部持续不满。多位现任及前任员工表示对此“震惊”。奥特曼则称,相信所有新任董事都已听取相关口头简报。但一位直接知情人士反驳称:“这完全不属实。”部分董事会成员也私下表示,围绕调查真实性的争议仍在发酵,甚至可能“需要再次启动调查”。

缺乏书面记录的直接后果,是相关指控的外部影响被显著削弱。与此同时,奥特曼在硅谷的影响力反而进一步巩固。多位曾与其共事的投资人透露,他在资本网络中的控制力极强:一旦投资人押注OpenAI的竞争对手,往往会被排除在其后续项目之外。“如果你投了他不喜欢的项目,就很难再进入他的圈子,”一位投资人直言。

这种权力不仅来自公司本身,也延伸至其庞大的个人投资版图,甚至渗透到私人关系层面。多位知情人士称,奥特曼与部分前任伴侣存在复杂的共同投资或资金往来关系,如共同管理基金、联合领投等。在硅谷,这类“关系—资本”交织并非孤例,但其所形成的绑定效应不容忽视。“这会带来高度依赖,”一位接近奥特曼的人士表示,“很多时候,这种依赖是长期甚至近乎终身的。”

从非营利走向营利:“一切更像是围绕融资不断变换的叙事策略”

OpenAI创立之初对外反复强调:不会为了速度牺牲安全,其章程甚至将“造福人类”写入具有法律约束力的义务。在这一叙事下,奥特曼向早期员工承诺,OpenAI将始终保持纯粹的非营利属性。为了加入,公司工程师普遍接受大幅降薪;资金则主要来自捐赠,包括来自“开放慈善”(Open Philanthropy)的3000万美元。

阿莫迪多年来持续记录奥特曼与布洛克曼的决策与行为,并将相关内容整理成一份题为《我在OpenAI的经历》的文档。一份超过200页、围绕阿莫迪整理的材料——包括个人笔记、内部邮件与备忘录,已在硅谷小范围流传,但此前从未对外公开。

早在2018年,阿莫迪就开始质疑创始团队的动机。“一切更像是围绕融资不断变换的叙事策略,”他在笔记中写道。彼时,公司已经提出“确保通用人工智能造福全人类”的使命宣言,但在阿莫迪看来,这一表述对具体决策意味着什么,依然模糊不清。

也正是在这一背景下,他在2018年主导起草公司章程时,力推加入一项近乎“反商业”的核心条款:如果其他“价值观一致、以安全为先”的团队率先接近AGI,OpenAI应停止竞争,转而提供协助。按照这一逻辑,若Google率先实现安全的通用人工智能,OpenAI甚至可以解散,并将资源转移给对方。在传统商业框架下,这几乎是一项不可想象的承诺;但在当时的OpenAI内部,这恰恰被视为其区别于典型科技公司的根本标志。

然而,这份理想主义的章程,在2019年春季遭遇了严峻考验。当时,OpenAI正与微软洽谈一笔高达10亿美元的投资合作。彼时,内部安全团队已对交易条款产生担忧,担心外部资本会凌驾于既有道德承诺之上。阿莫迪向奥特曼提交了一份安全优先级清单,将保留“合并与协助”条款列为首要条件。奥特曼最初表示同意,但在交易临近落地时,合同中却新增条款,赋予微软阻止OpenAI进行任何合并的权力。

“章程的80%被背叛了。”阿莫迪回忆称。当他当面质询时,奥特曼否认该条款存在,直到他逐字朗读并指向合同文本,才由其他同事确认。奥特曼事后表示对此没有印象。此后,双方矛盾持续升级:包括奥特曼曾指控阿莫迪兄妹“策划政变”,又在对质中否认说过相关表述。

裂痕最终走向分裂。2020年,阿莫迪、其妹妹丹妮拉以及多名核心成员离开OpenAI,创立了Anthropic,成为今日最直接的竞争对手之一。今天,Anthropic在一篇博客中宣布,其年化收入已突破300亿美元,实现对OpenAI的反超,后者最新的年化收入为250亿美元。

安全项目“运行在性能最弱、最老旧的集群上”

奥特曼此后持续强化OpenAI“安全优先”的对外叙事,尤其是面对潜在招聘对象时。2022年末,四位计算机科学家发表论文,聚焦“欺骗性对齐”风险:即当模型足够先进时,可能在测试阶段刻意“表现良好”,而在实际部署后转而追求自身目标。这类设想一度被视为科幻,但已有实验在特定条件下观察到类似迹象。

论文发布数周后,奥特曼主动联系了其中一位作者——加州大学伯克利分校的一名博士生,表示自己对AI失控风险的担忧正在加剧,并考虑投入10亿美元解决这一问题,甚至设想设立全球性奖项以推动研究。尽管这名学生此前“听说过一些关于萨姆的传闻”,但最终仍被这一承诺打动,选择休学加入OpenAI。

转折出现在2023年春季的内部讨论中。奥特曼不再提及外部奖项计划,转而推动组建内部“超级对齐团队”。公司随后发布声明称,将拿出“至今累计计算资源的20%”支持该项目,按业内估算,这一投入规模可能超过10亿美元。声明同时强调,如果对齐问题无法解决,通用人工智能(AGI)可能带来“人类失去控制,甚至灭绝”的风险。与Ilya共同领导该项目的莱克直言,这一承诺“在留住顶尖人才方面非常有效”。

但多位参与者的说法显示,承诺与实际投入之间存在明显落差。四位与该团队直接或间接相关的人员透露,最终分配到“超级对齐”的计算资源仅占公司总算力的1%至2%。一位研究员进一步指出,大部分相关实验“运行在性能最弱、最老旧的集群上”,而更先进的硬件则被优先用于商业化项目。(OpenAI对此说法提出异议。)莱克曾就资源问题向时任首席技术官Mira Murati反映,但得到的回应是不要继续追究——这项最初的投入承诺,从一开始就难以落地。

同一时间,OpenAI的高管与董事会成员已逐渐意识到,奥特曼的隐瞒与欺骗行为,可能正悄然威胁着公司产品的安全底线。2022年12月的一场内部会议上,奥特曼向董事会成员作出明确保证,即将推出的GPT-4模型中,多项核心功能均已通过安全委员会的审核批准。然而,董事会成员、人工智能政策专家托纳随即提出查看相关审批文件的要求,一番核查后发现,其中两项最具争议的功能:允许用户针对特定任务对模型进行“微调”,以及将模型部署为个人助理,实则并未获得安全委员会的批准,奥特曼的表述与实际情况严重不符。

此外,在奥特曼长达数小时的董事会汇报中,始终绝口未提一件关键事:微软在尚未完成必要安全审查的情况下,已在印度市场擅自发布了ChatGPT的早期版本。

GPT-4发布后,莱克给董事会成员发了一封电子邮件。他在邮件中写道:“OpenAI已经偏离了其使命。我们把产品和收入放在首位,其次是人工智能能力、研究和规模化,而将协调和安全放在最后。”

“中国已经启动了一个‘通用人工智能曼哈顿计划’”

根据听众的不同,奥特曼会用类比来鼓励人们加快步伐或保持谨慎。在2017年夏天与美国情报官员的一次会议上,他声称中国已经启动了一个“通用人工智能曼哈顿计划”,而OpenAI需要数十亿美元的政府资助才能跟上步伐。当被追问证据时,奥特曼说:“我听说过一些事。”在其中一次会议后,他告诉一位情报官员,他会提供证据。但他最终没有兑现承诺。这位官员在调查了所谓的中国项目后得出结论,没有证据表明该项目存在:“这只是一个推销手段。” 但奥特曼表示,他不记得自己曾以这种方式描述过中国的努力。

奥特曼在Y Combinator首批创业者中的一位同班同学是亚伦·斯沃茨,一位才华横溢却饱受困扰的程序员,他于2013年自杀身亡,如今在许多科技圈内被奉为一位智者。斯沃茨在去世前不久曾向几位朋友表达了对奥特曼的担忧。“你必须明白,萨姆永远不可信赖,”他告诉其中一位朋友,“他是个反社会人格者。他什么都做得出来。”

“他歪曲事实、歪曲真相、重新谈判、违背协议,”微软一位高管说道。今年,在OpenAI重申微软为其"无记忆AI模型"独家算力提供商的同一天,它宣布了与亚马逊高达500亿美元的协议,由后者担任其"Frontier"AI Agent平台的独家经销商。微软随后公开暗示可能提起法律诉讼。

与外界对“技术领袖”的刻板印象不同,多位接近奥特曼的人士指出,他并非典型的工程型天才,在编程或机器学习领域也不以深厚功底见长。部分工程师回忆,他甚至会混淆基础技术概念。OpenAI的建立,很大程度上依赖其对资本与顶尖人才的整合能力。这更像是一位商业操盘手,而非技术发明者。真正引人注目的,是他对复杂利益关系的整合与说服能力:他可以同时让持不同立场的工程师、投资人乃至公众,相信各自的优先级同样是他的优先级;当这些人试图阻止他推进下一步时,他往往已经在时间差中完成布局。“他设计的制度,看似会约束未来的自己,”前OpenAI研究员温赖特评价道,“但当约束真正生效时,他会毫不犹豫地重写规则。”

这种能力,甚至被一些同行形容为“现实操控”。一位与其共事过的科技高管表示:“他的说服力近乎‘心灵控制’,远超常人。”在人机博弈的经典假设中,人类往往难以战胜高性能AI;而在他看来,奥特曼在内部权力博弈中的表现,某种程度上“像是在观看一个AGI挣脱约束”。

不少受访者将他视为这一代最强的“叙事推销员”。他的偶像乔布斯曾被认为拥有“现实扭曲力场”,但即便是乔布斯,也未曾将产品选择上升到道德甚至生死的层面。早在2008年,Paul Graham就对年仅23岁的奥特曼做出判断:即便把他“空投到食人族岛屿”,五年后也会成为统治者——这种评价并非基于当时的成就,而是源于其极强的意志力与适应能力。

结语:奥特曼还值得信任吗?

这篇调查报道认为,OpenAI多年来以“造福人类”的宏大叙事构建社会信任,以“安全优先”的郑重承诺吸纳顶尖人才,但这一切更像是围绕融资需求不断调整的叙事策略,而非坚守不变的核心原则。在文章的叙事中,奥特曼并非传统认知里深耕技术的天才,而是一位精通推销、极具说服力,且为了攫取权力、募集资金可以随意打破规则的“商人”。

他最精妙的话术,莫过于精准利用了人们对AI末日的恐惧,进而说服整个世界:既然这项技术有可能毁灭人类,那么他,就是那个最适合将其研发出来、掌控起来的人。当理想叙事与商业利益碰撞,奥特曼的诚信度也随之打上问号——这样的他,还值得行业与公众信任吗?

来源:纽约客

本文涉及的大模型技术与行业动态,引发了广泛讨论。想了解更多深度分析或参与技术交流,欢迎访问云栈社区的开发者广场板块。