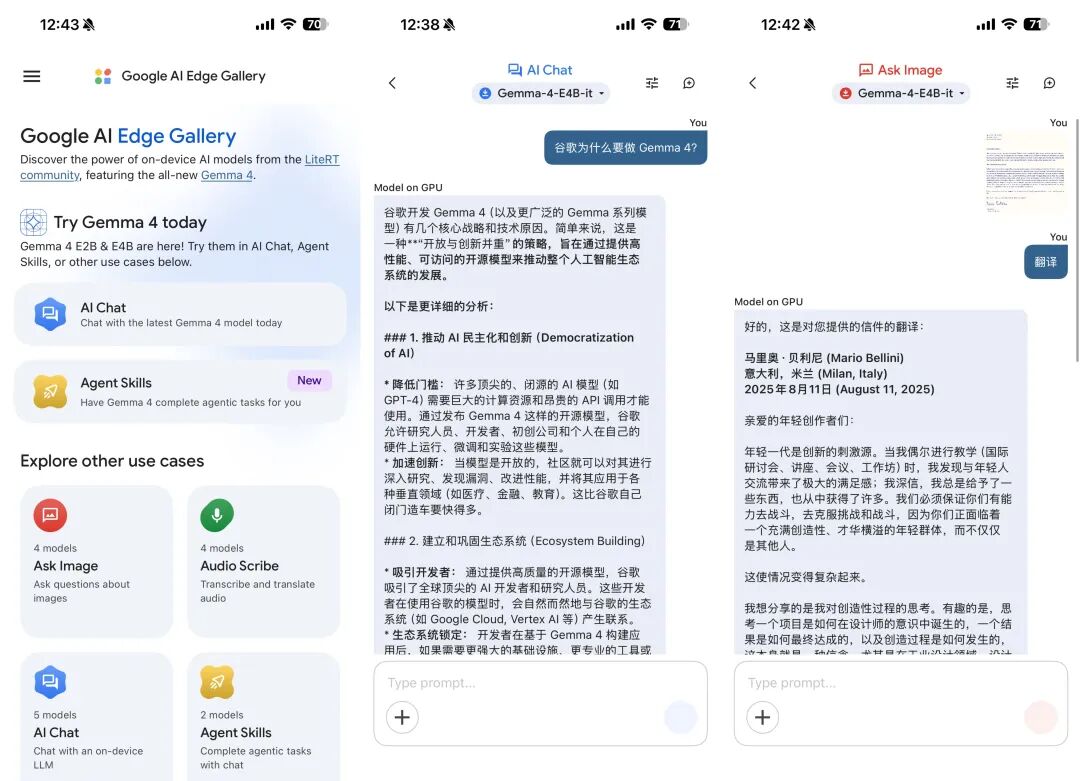

最近我在iPhone上尝试了一个名为 Google AI Edge Gallery 的新工具,它的App就叫 Edge Gallery。这本质上是一个“本地AI应用商店”兼模型演示平台,而最大的亮点是,你可以让它以完全离线的形式运行谷歌最新发布的开源模型 Gemma 4,全程只调用你iPhone自身的GPU算力。

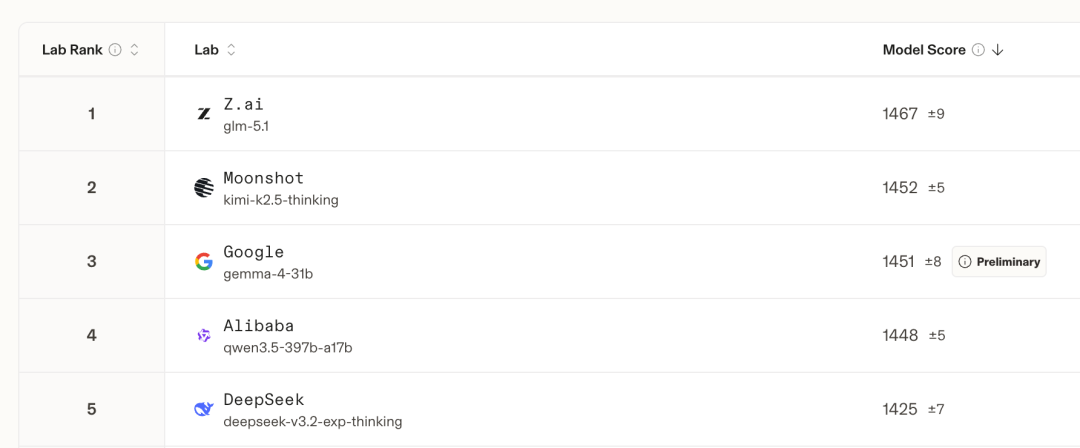

今年四月初,谷歌发布了新一代开源模型家族 Gemma 4。发布当天,其31B版本就在备受关注的 Arena 开源模型榜单上冲到了第三名。它的表现很有意思,在数学、编程和科学推理等多个基准测试中,甚至超越了参数量是自己十几倍的对手,实力已经和国内的顶级开源模型站在了同一梯队。

Google AI Edge Gallery 就是谷歌用来展示其端侧(On-Device)AI生态的一个窗口。对于开发者而言,它就像是一个“试验场”,让我们能在手机、平板等真实设备上直观感受 Gemma 4 的性能。更重要的是,这次谷歌将模型和权重都采用了商业友好的 Apache 2.0 开源协议。这意味着,开发者可以真正地将这些高质量模型集成到自己的 App 中,探索端侧AI的商业化路径。随着移动设备硬件能力的持续增强,强大的模型未必非要部署在云端,手机本身完全有潜力成为一个可靠的本地推理平台。

这正是让我对 Gemma 4 系列感到兴奋的原因之一。

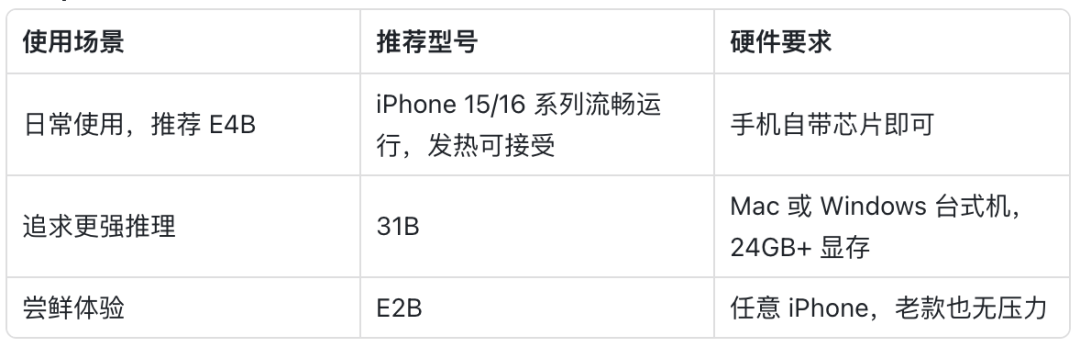

Gemma 4 家族目前包含四个不同规格的模型,以满足不同的硬件和性能需求:

我本人在 iPhone 15 Pro Max 上安装并运行的是 E4B 型号,体验相当流畅。Apache 2.0 许可证是谷歌首次真正意义上下放商业使用权,没有任何使用限制,也不强制要求开源衍生品。你可以自由地将其用于商业App并闭源分发,这在以往是比较少见的。

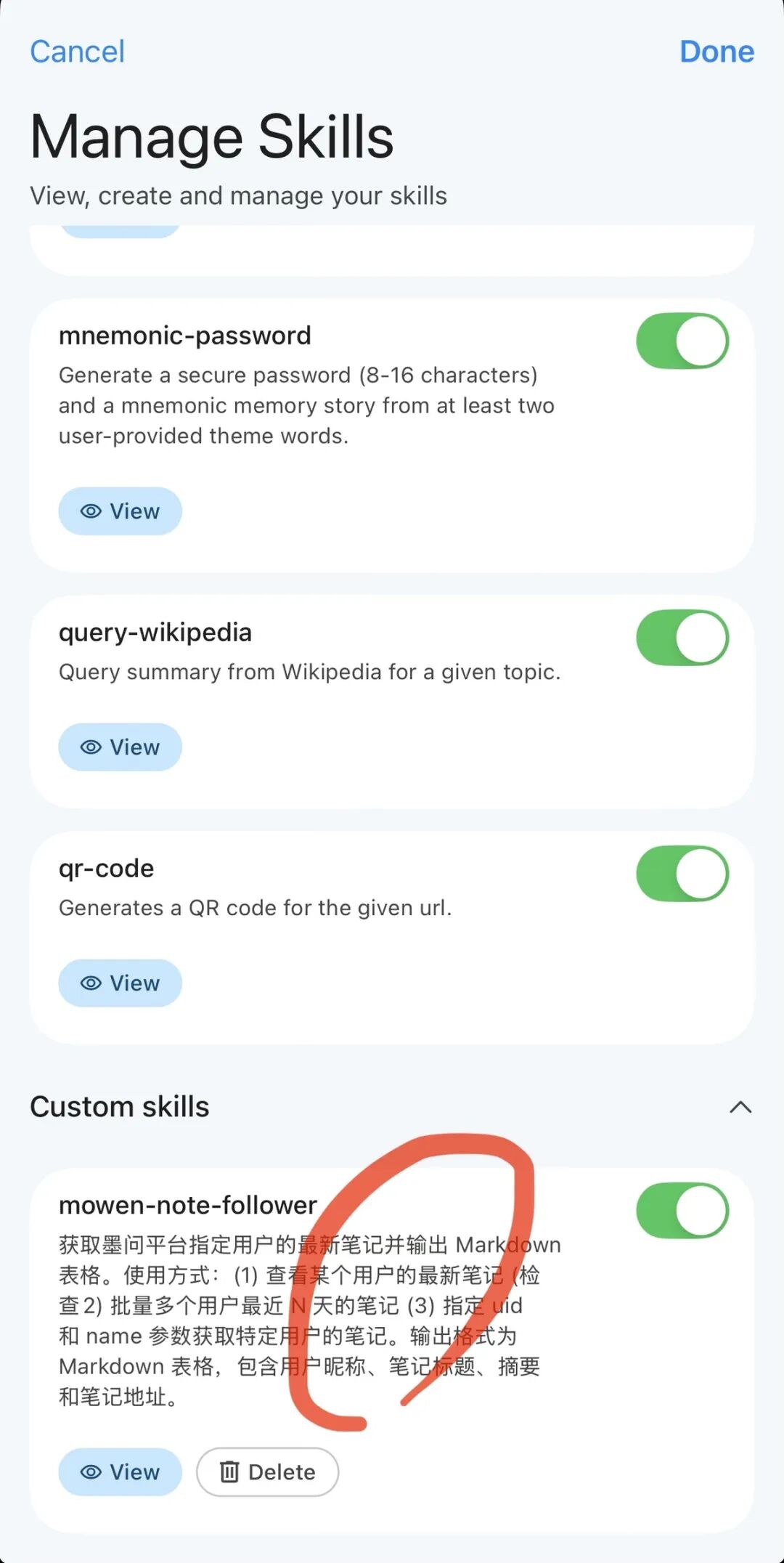

别因为是本地模型就小看它的性能。Gemma 4 的旗舰型号 31B 版本表现相当强悍,这意味着一款消费级 GPU 就能运行的模型,已经在某些实际任务中可以与参数量大得多的闭源模型一较高下。对于追求更强推理能力的用户,可以尝试在高性能工作站上运行 31B 模型。它还能支持 Skill Agent 功能,只需将你编写好的 Skill(技能)URL 提供给模型即可调用。不过需要注意的是,目前其 Agent 功能暂不支持 Python,使用 JavaScript 编写的技能应该可以正常运行。

最让人意外的是 E2B 型号。它仅有 2.3B 参数,却在多项任务上的表现追平了上一代 Gemma 3 的 27B 模型。参数量相差12倍,效果却接近,这似乎预示着手机端本地AI的效能拐点正在到来。

此外,Gemma 4 支持长达 25.6 万 token(约20万汉字)的上下文窗口,覆盖超过140种语言,并原生针对 Agent 工作流进行了优化——多步骤规划、工具调用、记忆保持等过去只有云端大模型才具备的能力,如今在你的口袋里也能实现了。试想一下,用这样的能力去增强 iOS 的 Siri,体验会不会更上一层楼?

如何在 iPhone 上离线运行 Gemma 4?

步骤非常简单:

- 下载应用:在 App Store 中搜索 “Google AI Edge Gallery” 并下载安装。

- 选择并下载模型:打开 App,任选一个功能入口(如 AI Chat、Ask Image),然后选择下载 “Gemma 4 E2B” 或 “Gemma 4 E4B” 模型(个人推荐先试试 E4B)。每个模型大小约为 2-4 GB,下载完成后即可完全离线使用,支持对话、推理、文本生成等多种任务。

支持的设备包括:

- iPhone 15 Pro 及以上机型(推荐)

- iPhone 14 Pro 可运行 E2B 型号

- iPad 同样支持

安卓用户需要前往 Google Play 商店进行安装。

可以用来做什么? 日常问答、写作辅助、代码审查、学习辅导、离线场景(如飞机上、地下室)下的使用,以及长文档摘要与分析等,它都能胜任。

为了方便大家根据自身情况选择,我整理了一个简单的模型选择参考表:

进入2026年以来,MiniMax M2.7、Kimi K2.5、GLM 5、Qwen 3.6 等模型相继亮相,竞争异常激烈。Gemma 4 在这场角逐中算是一个令人惊喜的选手,尤其是考虑到谷歌此前将大量精力都放在了 Gemini 系列上。此次 Gemma 4 所展现出的效能与开放性,确实让人刮目相看。

对普通用户来说,这意味着手机里可以有一个永不离线的 AI 助手,无网络可用、隐私要求高的场景下它都能派上用场。对开发者而言,Apache 2.0 协议扫清了法律风险,使得将此类先进的 开源模型 集成到商业产品中变得切实可行。对于整个行业,端侧AI 的时代步伐,可能比我们预想的要快得多。

这无疑为整个开源 AI 生态注入了新的活力,也值得所有技术爱好者到 云栈社区 这样的 开发者社区 中深入探讨其未来的可能性。