你是否也曾为论文中的一张系统架构图耗尽心力?截稿在即,用AI生图工具,逻辑总爱“放飞自我”;用专业绘图软件,学习门槛又太高。

更令人头痛的是,好不容易生成一张满意的图,想修改一个小图标或调整几行文字,却发现得到的只是一张无从下手的“死图”。这种“生成不可编辑,编辑需重来”的尴尬局面,如今被一项新技术彻底打破了。

西湖大学张岳实验室此前推出的AutoFigure,作为首个能从长篇科学文本自动生成出版级学术插图的智能体框架,已入选ICLR 2026。现在,团队更进一步,发布了其增强版 AutoFigure-Edit——一个让AI生成图真正“活”起来的全新系统。项目已在GitHub上揽获超过1.6k星。

这次升级带来了几个关键突破:

- 从像素到矢量的跨越:生成的不再是静态PNG图片,而是完全可编辑的SVG文件。这意味着你可以在浏览器内直接拖拽、改字、换色,所有元素都能按需定制。

- 参考图引导的风格迁移:上传一张你喜欢的风格图,AI就能自动学习其配色、字体、图标风格,并应用到你的科学插图上。再也不用费劲调试Prompt了。

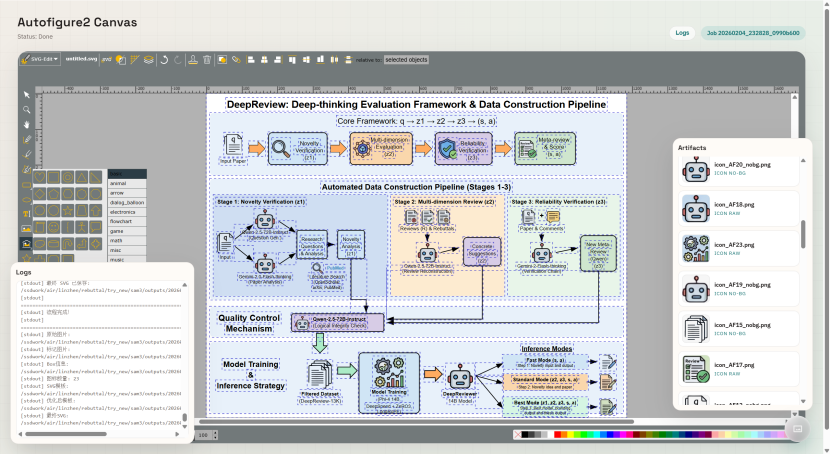

- 内置交互式编辑器:生成完成后,可直接进入可视化编辑画布。调整布局、修改标注、替换图标,所见即所得。

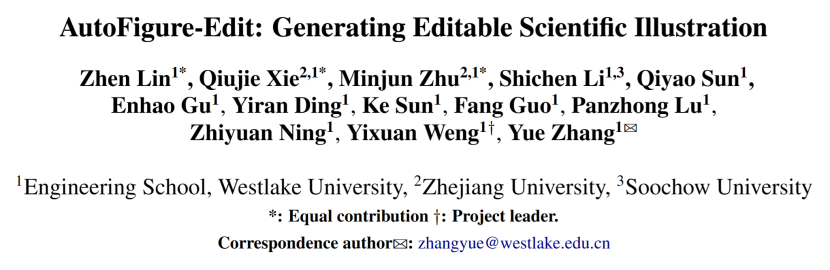

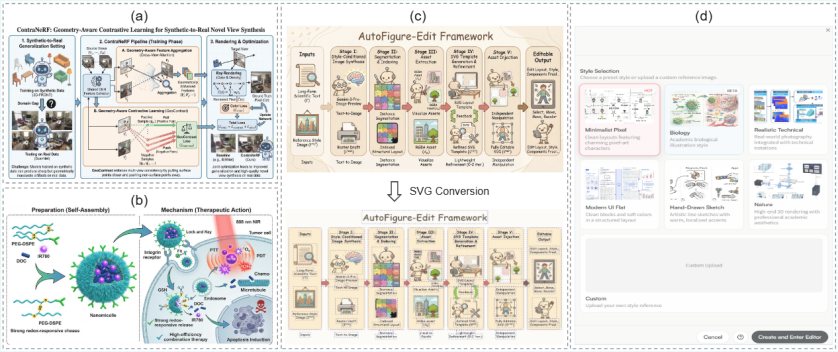

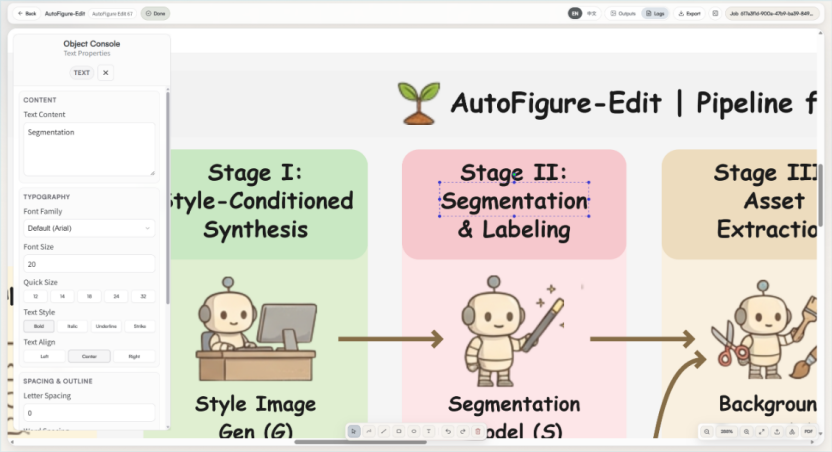

AutoFigure-Edit的核心是一个创新的五阶段流水线,将“文本→可编辑SVG”的复杂任务分解为清晰可控的步骤:

(上图由AutoFigure-Edit生成)

- 风格条件生图:使用输入的科学文本和参考风格图,生成初始的栅格草图。

- 分割与结构索引:利用先进的SAM3技术识别图中的视觉组件,并为每个组件构建带索引的结构化掩码。

- 资产提取:基于结构掩码,提取出每个视觉组件的透明背景(RGBA)资产。

- SVG模板生成与精炼:使用视觉语言模型(VLM)生成结构化的SVG布局模板,并通过迭代反馈循环进行精炼优化。

- 资产注入:将提取的透明视觉资产注入到优化后的SVG模板中,生成最终可完全编辑的SVG矢量图。

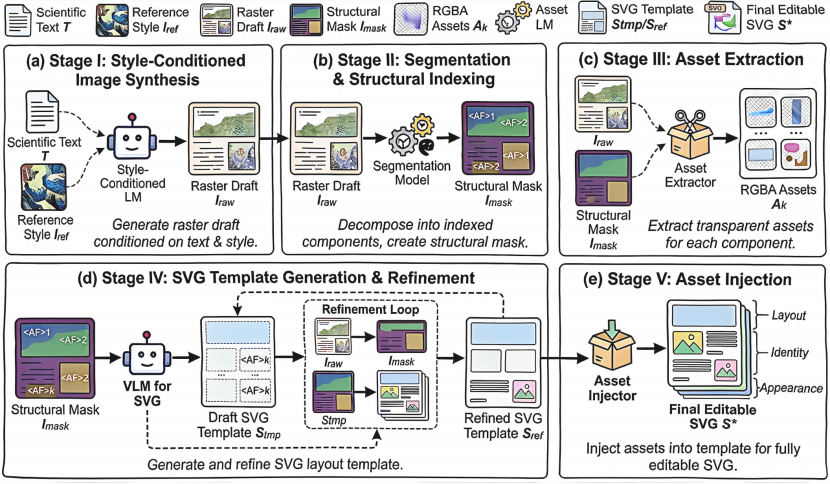

AutoFigure及其衍生项目AutoFigure-Edit的成功,源于其独特的“推理式渲染”(Reasoned Rendering)范式。该范式将科学插图的“逻辑布局”和“美学渲染”彻底解耦,分两个阶段处理。

第一阶段:概念锚定(Conceptual Grounding)

AI读入长篇方法描述(平均超过10,000 tokens),自动提取核心实体和关系,构建初始的逻辑骨架。这一步确保的是“正确性”——把所有必要元素找出来,并把它们的关系理清楚。

第二阶段:评审-精炼闭环(Critique-and-Refine)

模拟人类设计师与甲方的反复拉锯过程。AI Designer根据反馈修改布局,AI Critic则专职“挑毛病”——如“箭头重叠了”、“布局重心不稳”、“文字层级不清”等。经过多轮迭代,直到达到满意的绘图质量。

第三阶段:美学渲染与“擦除-修正”

这是AutoFigure的杀手锏。将优化后的布局渲染为精美图片后,系统会执行“擦除-修正”:

- 用OCR识别图片中可能模糊或变形的文字。

- 将这些文字区域“抠掉”。

- 用清晰的矢量文字重新覆盖。

这一流程彻底解决了AIGC生图中常见的文字模糊、变形难题,其背后的技术思路与许多技术文档中讨论的优化方案有异曲同工之妙。

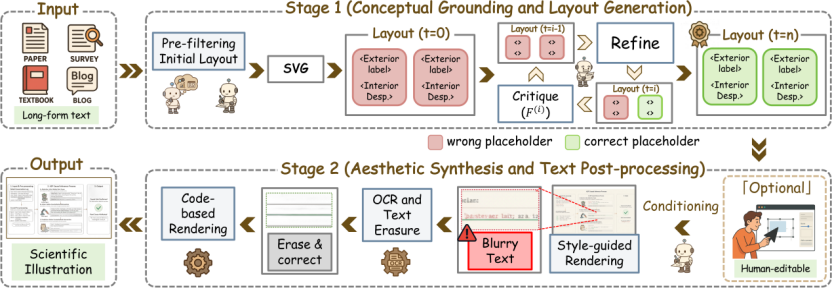

在AutoFigure“推理式渲染”的基础上,AutoFigure-Edit引入了多项技术创新,将高质量的PNG图片转换为可自由编辑的SVG矢量图。

SAM3驱动的自动分割

利用Meta最新的SAM3分割技术,系统能够智能识别图中的每个视觉组件(如图标、模块、连接线等),并为每个组件自动生成对应的透明背景资产(RGBA)。

SVG模板自动生成与资产注入

系统会根据分割结果,自动生成结构化的SVG布局模板,然后将提取的视觉资产一一对应地注入。最终得到的是一个结构清晰、完全可编辑的矢量文件——每一个模块、每一条连线、每一个文字标注都是独立的可编辑对象。

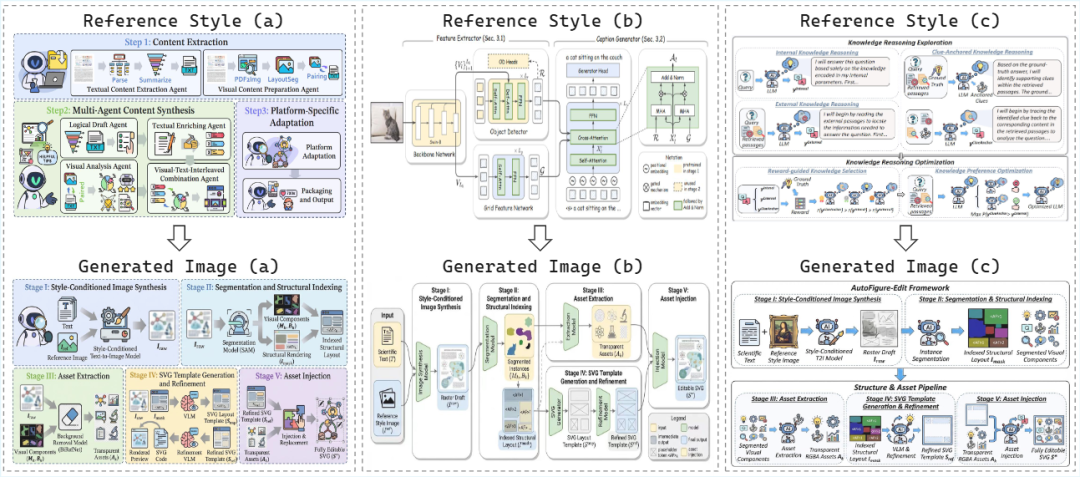

参考图风格控制

不再依赖模糊的Prompt描述。用户只需上传一张风格参考图,系统便会自动学习其视觉特征(如配色方案、字体风格、图标类型、间距密度等),并应用到生成的科学插图上。这使得实验室内部的插图风格统一、适配不同期刊的特定风格要求变得前所未有的简单。

实验结果:用数据说话

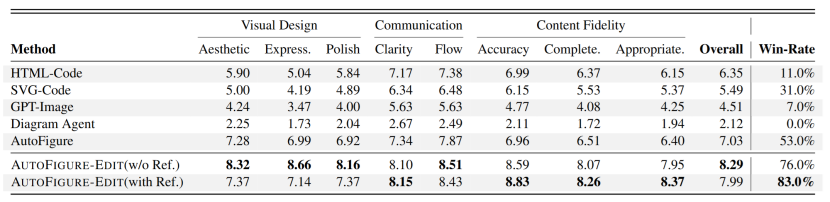

自动化评估:碾压级表现

团队在FigureBench基准测试上对AutoFigure-Edit进行了全面评估,结果显示其在所有核心维度上都显著领先于现有方法。

关键发现:

- 使用参考图引导后,Win-Rate(胜率)从76.0%进一步提升到83.0%,表明风格控制让生成结果更受用户青睐。

- 内容保真度全面提升:准确性8.83、完整性8.26、适应性8.37,远超其他基线方法。

- 即使在无参考图模式下,其综合评分也达到了8.29,尤其在视觉设计方面表现优异(美学8.32、表达力8.66)。

用户研究:217位真实用户的验证

基于真实使用场景的用户研究更具说服力。217位参与者通过在线网站生成了262个插图,并进行了多维度评价:

PNG生成质量:

- 科学语义正确性:4.04/5.0(48%的用户给了满分)

- 信息完整性:4.11/5.0(51%的用户给了满分)

- 视觉呈现质量:3.95/5.0

- 风格一致性:4.09/5.0(50%的用户给了满分)

实际可用性:

- 126/262位用户(48%) 认为生成结果可直接用于论文发表,无需修改。这表明系统已具备真实科研工作流的可用性。

SVG转换质量:

- 转换正确性平均得分3.60/5.0

- 36%的用户给了满分,说明SVG结构保持了高度准确性。

低评分(1-2分)在语义维度上非常罕见(通常低于12%),证明系统能够可靠地保持科学含义和结构完整性。

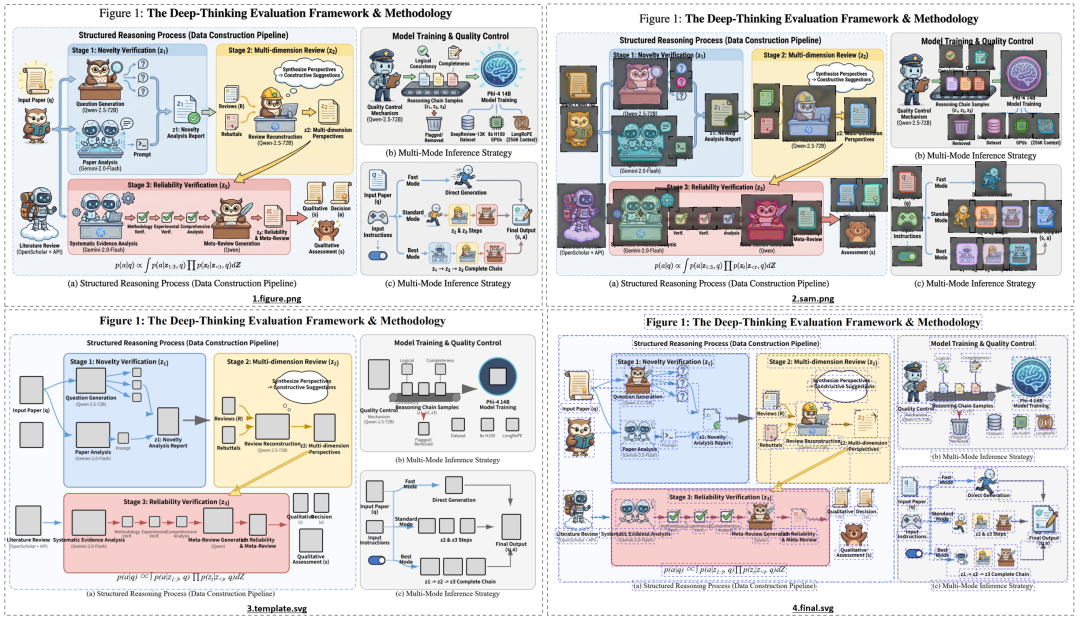

风格迁移与编辑能力展示

AutoFigure-Edit的核心创新在于其强大的风格迁移和编辑能力。系统支持任意用户自定义风格的参考图引导生成,让同一研究内容可以轻松适配不同的视觉风格和出版需求。

应用场景:不止是画图

AutoFigure-Edit的意义远不止于“节省绘图时间”:

- 赋能AI科学家:这是AI实现全流程自主研究的关键一步。从文本理解、实验设计到结果分析,有了AutoFigure-Edit,AI也能自主生成高质量的可视化结果,真正打通科研的“最后一公里”。

- 降低科研创作门槛:对于缺乏设计经验的研究者,AutoFigure-Edit让高质量的科学插图触手可及。无论是算法流程图、系统架构图,还是复杂的教科书示意图,都能一键生成。

- 统一视觉风格:通过参考图风格控制,整个实验室的论文插图风格可以轻松统一。期刊要求的特定风格(如Nature、ICLR风格)也能快速适配。

开源与可用性

西湖大学张岳实验室始终坚持开源理念,该项目已在多个开源实战平台发布资源:

- 代码完全开源:GitHub仓库包含完整代码库。

- 数据集公开:FigureBench数据集已在HuggingFace发布。

- 在线网站:提供一键使用的Web界面。

- 交互式编辑器:内置可视化编辑画布,支持实时调整。

如何体验

AutoFigure-Edit的论文、代码和在线服务已全部公开:

结语

学术插图不应成为科研路上的拦路虎。从基于Stable Diffusion等模型的传统AIGC生图,到理解逻辑并优化布局的AutoFigure,再到生成完全可编辑SVG的AutoFigure-Edit,西湖大学的这项工作正在重新定义科学可视化的边界——让AI不仅能“读懂”你的研究,更能“画好”且让你能自由“修改”你的洞见。

这项研究是人工智能在专业领域落地的优秀范例。下次截稿前,不妨试试让AutoFigure-Edit帮你搞定那些繁琐的插图工作。毕竟,研究者的时间更应该花在思考科学问题上,而不是在绘图软件里反复调整。

更多前沿技术资讯和深度讨论,欢迎访问云栈社区,与广大开发者一起交流成长。