用终端进行 AI 编程,不同工具之间的体验差距能有多大?最近深度使用了 auto-coder.chat,它是一个运行在终端里的 Code Agent。这意味着,你选择的终端工具会直接决定你的使用体验。macOS 自带的 Terminal、iTerm2、Warp、Alacritty……选择虽多,但体验却是天差地别。

经过一番体验和对比,我的结论很明确:Warp 是目前 auto-coder.chat 最好的搭档,没有之一。

先看看 auto-coder.chat 在 Warp 里长什么样

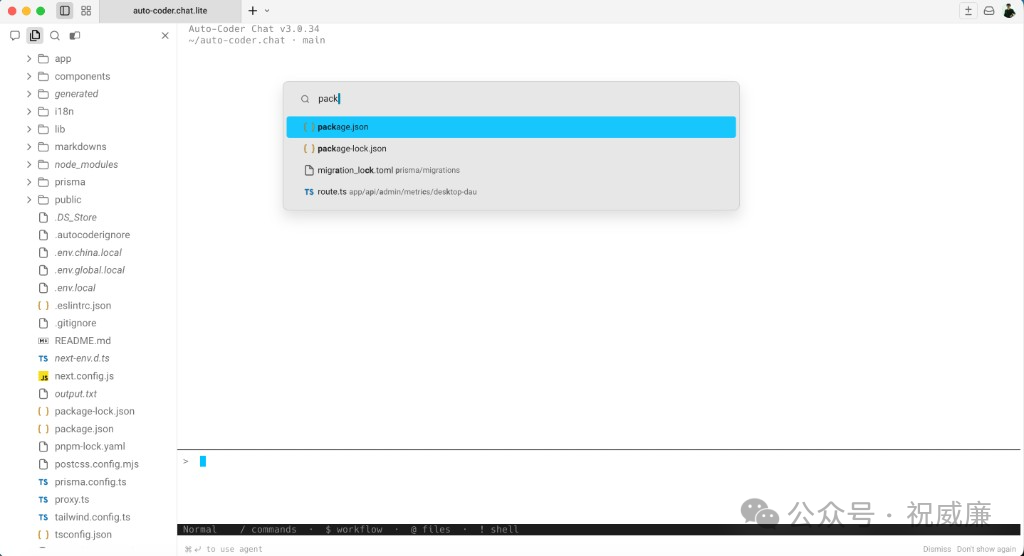

打开 Warp,启动 auto-coder.chat,你会看到这样一个界面:

左侧是会话列表,右边是对话区域,底部是输入框。整个布局干净利落,看起来不像是一个“跑在终端里的工具”,更像是一个原生的桌面应用。

这要归功于 Warp 对终端体验的重新设计。传统终端本质上就是一个文本流——命令输入、输出打印,从上到下,滚完就结束了。而 Warp 把终端做成了一个现代化的编辑器界面,支持块级输出、富文本渲染,甚至是弹窗交互。auto-coder.chat 则充分利用了这些能力。

文件搜索:像 IDE 一样丝滑

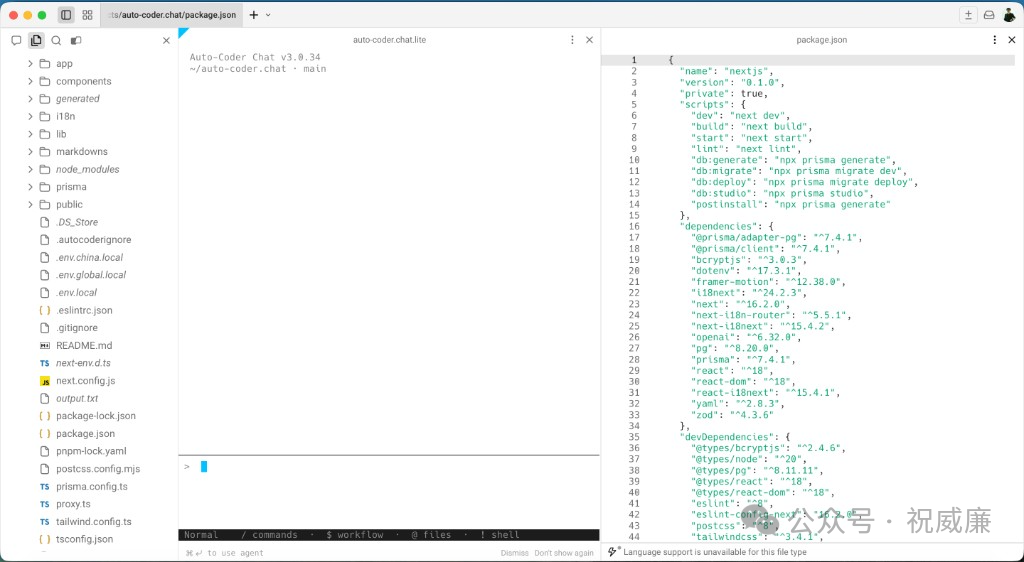

auto-coder.chat 在 Warp 中最让我惊喜的,是它的文件交互能力。按下快捷键,一个文件搜索弹窗就弹了出来:

输入 “pack”,立刻匹配到 package.json、package-lock.json、migration_lock.toml 等文件。这就是标准的模糊搜索,和你在 VS Code 里按 Cmd+P 的体验几乎一模一样。

选中一个文件,直接在 Warp 的分屏中打开:

左边是 auto-coder.chat 的对话窗口,右边是文件内容,带语法高亮、行号显示。你可以一边和 AI 对话,一边查看项目文件,不需要切出终端去打开编辑器。

这种体验在传统终端里是不可能实现的。iTerm2 再怎么配置,也做不到在终端里弹出一个模糊搜索框,更做不到分屏查看带高亮的代码文件。

对比:Cursor CLI 在 Warp 里是什么样?

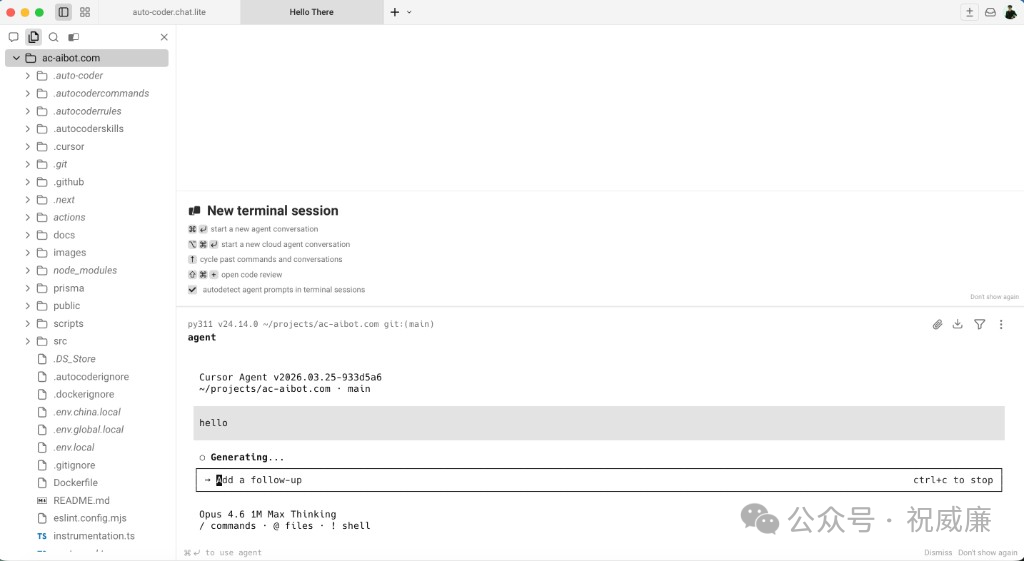

有人可能会问,Cursor 不是也有 CLI 模式吗?它在 Warp 里表现怎么样?来看看:

Cursor Agent 启动后,界面就是一个标准的终端交互——输入 “hello”,下面开始 “Generating...”,然后等着文本一行行吐出来。

功能上当然能用,但体验上差距很明显:

- 界面融合度:auto-coder.chat 的 UI 和 Warp 的现代化设计浑然一体,看起来就像是 Warp 的原生功能。Cursor CLI 则更像是“一个跑在终端里的命令行工具”。

这并不是说 Cursor CLI 不好——它本来就不是为“终端原生体验”设计的,Cursor 的核心场景是它自己的 IDE。但如果你是一个终端重度用户,习惯在终端里完成大部分工作,那么 auto-coder.chat + Warp 的组合,明显比 Cursor CLI + Warp 好出一个维度。这对于习惯在终端中进行高效开发的 DevOps 工程师来说尤其重要。

Warp 还是一个好用的 Markdown 编辑器

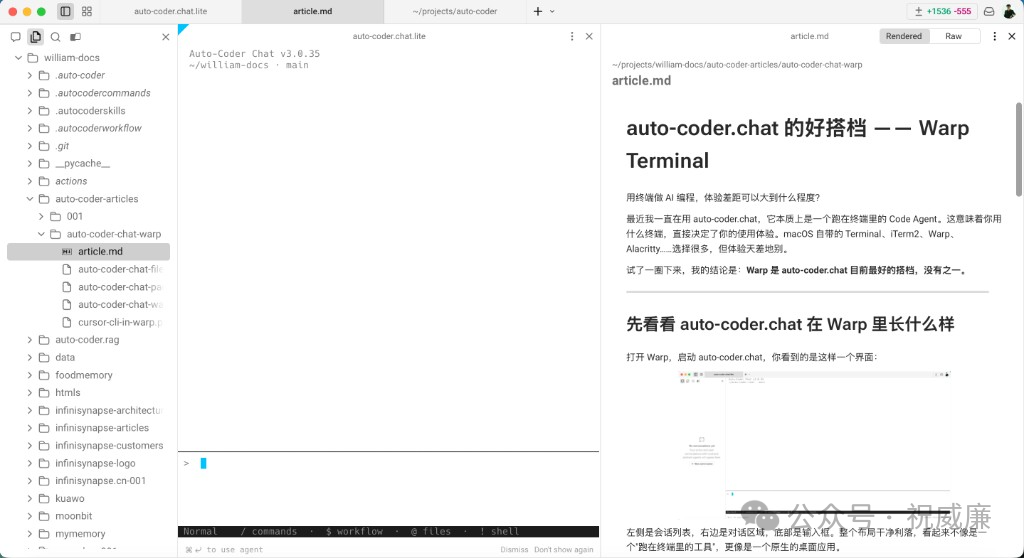

我们通过 auto-coder.chat 编辑 Markdown 文件,然后在 Warp 里可以实时预览效果:

左边是 auto-coder.chat 的对话窗口,右边是 Markdown 的渲染预览——标题、段落、图片都能正确显示。写完让 AI 帮你改,改完直接在旁边看效果,整个流程不需要离开 Warp。

而且,Warp 完美支持 Dark 模式:

深色背景下,代码、对话、Markdown 预览,视觉统一,长时间工作眼睛也不会累。对于习惯暗色主题的开发者来说,这个体验非常舒服。

还有一个现实问题:内存

这是一个容易被忽略但非常实际的问题。

Cursor IDE 版本长时间运行后,单个实例的内存占用通常在 1~3 GB。如果你同时开了两三个项目窗口,轻松吃掉大半内存。对于 8GB 或 16GB 内存的机器来说,这个开销相当可观。

而 Warp + auto-coder.chat 的组合,内存占用要小得多。终端本身就是轻量级应用,auto-coder.chat 作为一个 Python 进程,内存消耗远不在一个量级。你可以同时开多个项目的 auto-coder.chat 会话,不用担心系统被拖慢。

轻量,是终端方案天生的优势。

为什么这个搭配有意义?

你可能会觉得,这不就是换个漂亮的壳吗?实际写代码还不是一样?

不一样。原因有三:

第一,上下文切换的代价比你想象的大。

传统的工作流是这样的:在终端里跑命令 → 切到 IDE 看代码 → 切回终端继续 → 再切到浏览器查文档。每一次切换,你的注意力都会被打断一次。而 auto-coder.chat + Warp 把“和 AI 对话”和“看代码”这两件事合并在了同一个窗口里,减少了一半的上下文切换。

第二,终端才是很多开发者的主场。

不是所有人都喜欢 IDE。很多后端工程师、DevOps 工程师、开源项目维护者,日常工作就是在终端里完成的——写脚本、管服务器、跑 CI/CD。对这些人来说,一个“跑在终端里但体验接近 IDE”的 AI编程 工具,比“装在 IDE 里的 AI 插件”更合适。

第三,Warp 本身就是一个生产力倍增器。

Warp 的命令补全、输出块管理、AI 辅助(Warp AI)、多标签页等功能,加上 auto-coder.chat 的 AI 编程能力,两者叠加起来,终端的天花板被推高了一大截。

写在最后

终端作为开发者最古老的工具,正在被重新定义。(当然,Cursor 仍然是我当前觉得体验最好的IDE产品)。

Warp 重新定义了终端的交互方式,auto-coder.chat 重新定义了终端里能做的事情。当这两个工具组合在一起,你会发现:终端不再只是一个“输入命令、查看输出”的黑框框,而是一个真正的 AI 编程工作站。

如果你是一个终端用户,强烈建议试试这个组合。上手也很简单,三步搞定:

# 1. 安装 auto-coder

pip install -U auto-coder

# 2. 在 Warp 中进入你的项目目录,启动 auto-coder.chat

cd your-project

auto-coder.chat.lite

# 3. 进入后用 /models 命令配置你的模型 API Key,就可以开始了

没有复杂的配置,没有额外的依赖,一个 pip install 就是全部。如果你对这类提升开发效率的工具组合感兴趣,欢迎来 云栈社区 交流分享更多实战经验。

auto-coder.chat:auto-coder.chat

Warp Terminal:warp.dev