昨天晚上,月之暗面(Moonshot AI)正式开源了其最新的Kimi K2.6模型。作为开发者,我还在琢磨什么时候能上手体验一下这个新模型,没想到惊喜来得这么快。

今天下午,我在使用 WorkBuddy 处理一个前端项目时,因为AI自动修改的代码有点小问题,我手动调整了一下。随后,出于好奇,我想看看当前 WorkBuddy 都接入了哪些模型。平时我基本都用Auto模式,感觉在大部分场景下都够用,还能自动帮我省点token积分。

打开模型选择下拉菜单一看,厉害了——Kimi-K2.6 赫然在列,而且已经可以选择了。这更新速度,必须给个好评。

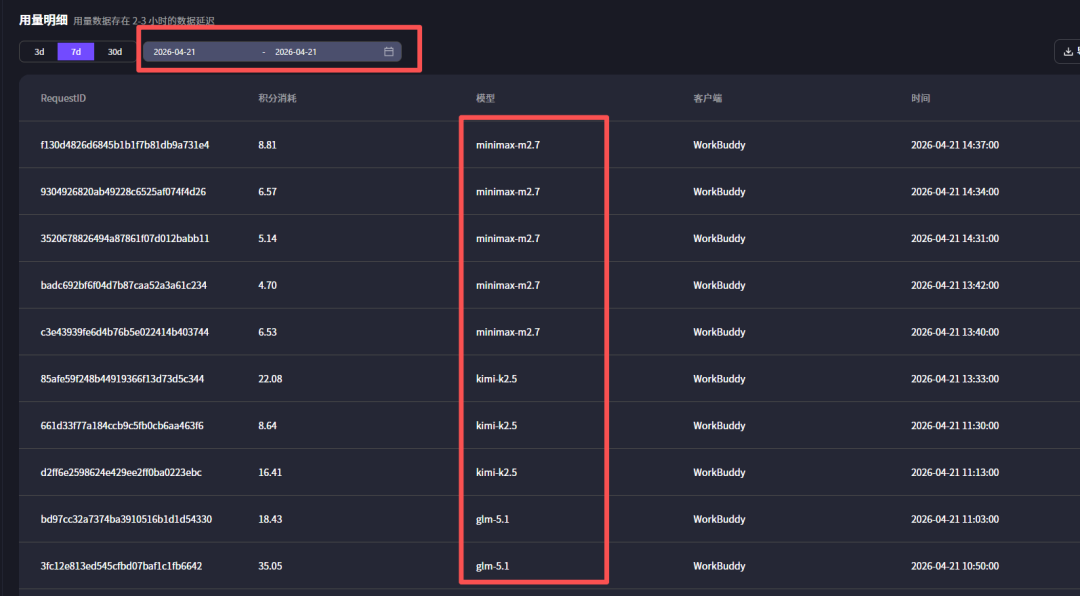

在切换到新模型之前,我先回顾了一下今天的工作消耗。今天主要在改一个前端大屏项目的样式和功能点,涉及不少3D交互和视觉效果的调整,任务量不小。在自动模式下,我查看了后台的用量明细,发现今天主要调用的是几款国产的高版本模型,积分消耗从个位数到三十多不等。

最近感觉 WorkBuddy 用起来偶尔有点卡顿,不知道是不是因为用户变多了,或者是他们推出的“合伙养虾”活动吸引了更多人使用。当然,也可能是我自己电脑开的东西太多,配置有点跟不上了。

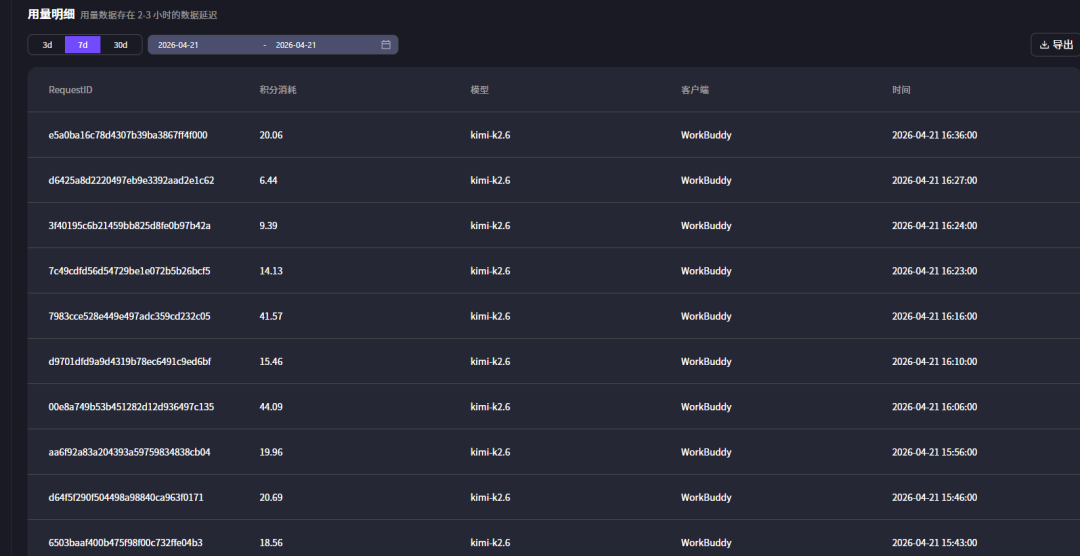

为了测试 Kimi K2.6 的实际表现,我将其指定为当前任务的专用模型。测试任务就是刚才提到的那个纯前端大屏项目,核心是3D相关的功能改动。我通过重新开启对话和继续修改原有任务两种方式进行了实际的功能测试,产生的消耗记录如下。

从数据上看,Kimi K2.6 的积分消耗与之前使用的其他高版本模型差距不大,最小也是个位数,最大在四十多。

但就使用体验而言,最直观的感受有两点:一是生成代码的正确率似乎更稳了,二是响应速度明显变快了。对于我这种主要处理前端代码和交互逻辑的场景来说,能明显感受到它在生成长代码、处理复杂任务时更加稳定和迅速。

至于官方宣传的 K2.6 核心升级点,比如 Agent 集群和超长任务处理能力,我作为一个“前端叼毛”暂时是体验不到了,那些高级能力可能更适合更复杂的后端或全栈场景。

总的来说,月之暗面这波操作确实给力,Kimi K2.6 在能力上升级明显,还选择了开源,必须为国产AI技术的进步点个赞。同时,WorkBuddy 这款工具也超级好用,个人免费账户通过签到积累的积分,省着点用的话,足够体验很久这些国产高级模型了。还没尝试过的开发者朋友,可以到云栈社区关注相关动态,抓紧上车体验一下。 |