Mano-P 1.0 发布后,AI 终于开始真的“看着屏幕干活”了。

第一次看到 Mano-P 这个项目时,我愣了一下。

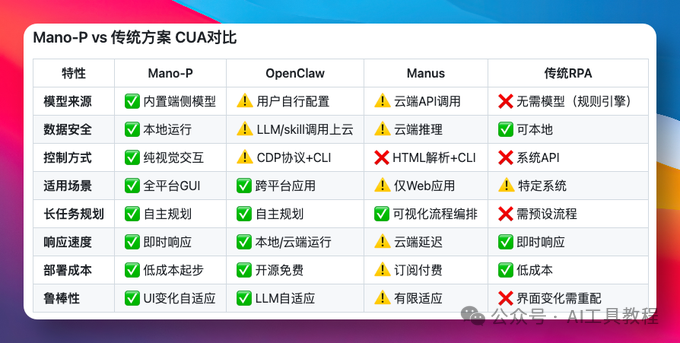

不是因为它又在讲什么 Agent,也不是因为它说自己能自动操作电脑——这类话现在已经不新鲜了。让我多看两眼的是另一件事:它不吃 DOM,不走系统 API,直接对着屏幕截图就开干——点击、拖拽、输入、切换,完全按界面长什么样来做事。

这个味道一下就不一样了。

过去很多所谓的“自动化”,本质还是在读结构化信息。网页能跑是因为有 DOM,桌面端能接一部分是因为系统愿意给 API。但一旦你把场景换到原生软件、各种奇怪客户端、甚至改版过的 App,那套东西就开始飘了——元素识别错位,按钮层级乱掉,脚本一长就全崩。

所以很多 Agent 看着很能干,实际上活动范围没出浏览器。

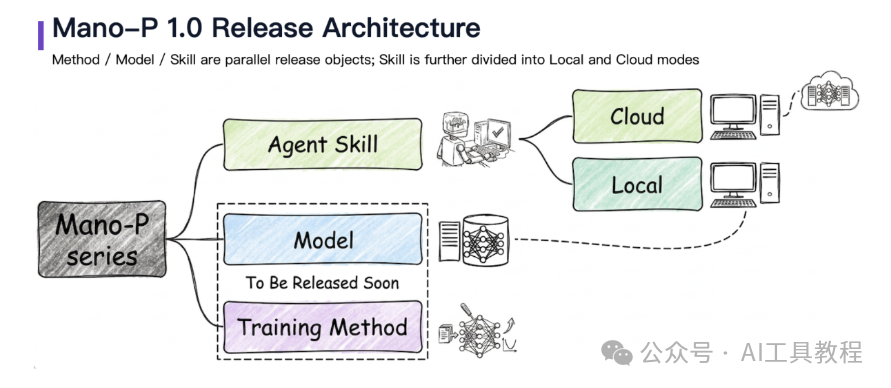

Mano-P 1.0 是从另一个方向切进去的。它不要求目标软件给接口,也不要求你提前适配什么协议,就是把当前屏幕当成唯一输入——看到哪里是输入框,哪里是菜单,哪里该点下一步,完全按视觉来理解。

说直白点,它不是“调用系统能力去操作界面”,而是把自己放到一个真实用户的位置上。

这件事一旦成立,边界就会突然宽很多。网页、桌面软件、各类 App,理论上都能进同一套操作逻辑里。你不用再为每个界面单独写一层解析,也无需一改版就回去补规则。界面变了,结构可能全变,但只要视觉上还能看懂,它就能继续干活。

我觉得这才是它最值钱的地方——不是“能操作”,而是少了一层很重的维护。

看 GitHub 介绍时,还有个点挺实际:它已经能接到 Claude Code、OpenClaw 这类 Agent 工具 里。这个组合很像把前面会想、会拆任务的“脑子”,接上了后面真的能落到屏幕上的“手”。很多以前只能停在“我建议你点击这里”的流程,现在可以往前再走一步。

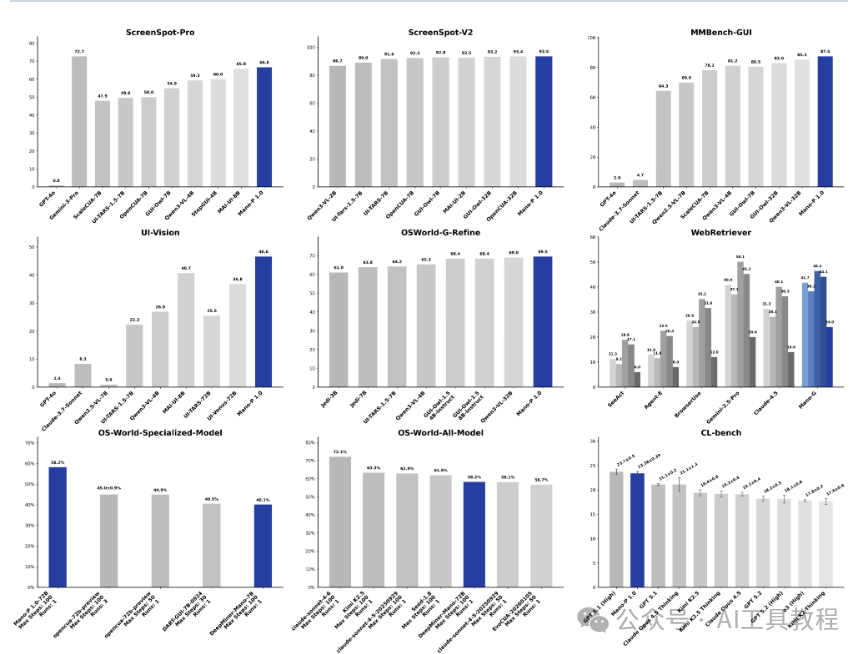

而且它不是只做两三步演示——项目里提到,复杂任务可以拉到数十步、上百步。这就不是 demo 感了。

另一个让我有点在意的是它坚持本地推理。数据不出设备,这对企业场景尤其重要。很多界面自动化一碰到内网系统、财务后台、客户资料就卡住,不是不能做,是不敢把屏幕和操作过程往外送。Mano-P 这类纯本地方案,至少把这道坎先跨过去了。

部署也没有想象中那么重——M4 芯片、32GB 内存的 Mac,上 4B 量化版本就能直接跑。看到这里,大概能明白它为什么会被不少人盯上:不是那种必须堆大卡、远程服务、专门环境才能碰的东西。

它离“真正可用”还差多远?肯定还得看长任务稳定性、误操作率,还有不同分辨率和复杂 UI 下的表现。

但至少有一点已经很清楚了:AI 自动操作这件事,终于开始从“读网页代码”往“直接看屏幕做事”走了。Mano-P 1.0 值得看的,不只是又一个 GUI Agent,而是它把路线换了。

GitHub 地址:MININGLAMP-AI/MANO-P (文本展示,未添加外链以遵守规则) |