世界模型赛道迎来重要新成员:知名视频生成公司Runway正式发布了其首个通用世界模型 GWM-1。

与此同时,Runway还推出了一系列基于GWM-1的专项世界模型变体,构成了一个完整的“全家桶”:

- GWM Worlds:用于实时环境模拟与探索。

- GWM Avatars:用于模拟人类对话与互动。

- GWM Robotics:用于机器人操作训练与模拟。

这些模型均基于最新升级的视频生成模型 Gen-4.5 构建。

下面我们通过实际演示来具体了解GWM-1及其变体的能力。

GWM-1世界模型全家桶详解

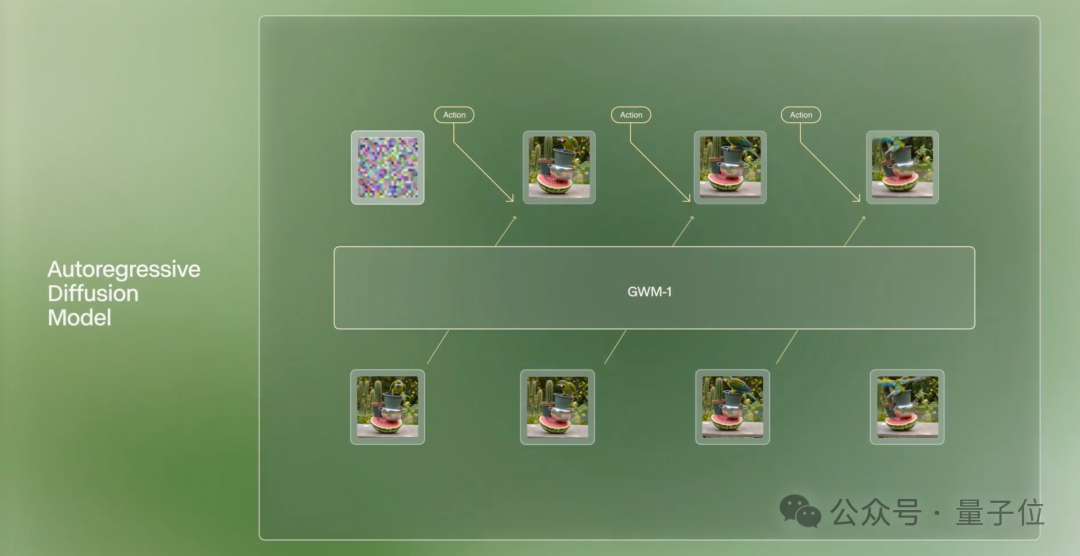

根据官方介绍,GWM-1采用了自回归架构。与传统的视频生成模型不同,它能够根据先前的“记忆”内容,进行逐帧预测与生成。该模型支持实时交互控制,例如调整摄像机视角、修改机器人指令或同步音频。

其三个核心变体分别针对不同应用场景:

1. GWM Worlds:实时环境模拟器

GWM Worlds允许用户在连贯且具备物理反应的世界中自由移动,无需手动设计每个细节。用户只需提供一个静态场景作为初始参考,模型便能在移动过程中实时生成一个包含几何、光照和物理效果的沉浸式无限空间。

相比于其他通常只能生成有限长度序列的世界模型,GWM Worlds的优势在于能够在智能体移动时实时生成新场景,并在长序列中保持高度的空间一致性。

用户可通过文本提示改变环境的基础物理规则。例如,提示“骑自行车”会将运动约束在地面,而提示“飞行”则会解除重力约束。这项技术可用于快速搭建低成本训练环境,让AI智能体在其中自由探索与学习,同时也为VR沉浸式体验提供了新的内容生成方案。

2. GWM Avatars:音频驱动对话模拟

这是一个由音频驱动的交互式视频生成模型,能够生成具有自然表情、口型、眼神和手势的数字化身,无论是写实还是风格化角色,都能在长时间交互中保持稳定的输出质量。

其应用场景广泛:

- 教育领域:作为个性化导师,以仿真的互动方式讲解复杂概念。

- 客户服务:创造永不疲倦、随时在线且表情自然的数字客服。

- 技能训练:在面试、谈判等高压场景中提供安全的模拟对话环境。

- 游戏娱乐:让游戏NPC能够倾听、思考并做出真实回应。

GWM Avatars即将正式上线并提供API接口,方便开发者集成到自己的产品中。

3. GWM Robotics:机器人操作模拟器

GWM Robotics本质上是一个数据驱动的学习型模拟器。它通过在机器人相关数据上进行训练,获得预测视频序列的能力,主要服务于两大任务:

- 合成数据增强:通过生成新的物体、任务指令和环境变化的合成数据,来扩充现有的机器人数据集,从而提升策略模型的泛化能力,无需进行昂贵的真实世界数据采集。

- 模拟策略评估:直接在GWM Robotics中测试视觉语言动作模型(如OpenVLA、OpenPi等)的策略可行性。相比实体机器人测试,这种方法更快、可重复性更高且更安全。

GWM Robotics旨在解决物理硬件成本高、损耗快、场景难复现等瓶颈问题,通过高保真模拟环境让机器人训练和评估更高效、更具性价比。

Runway同时发布了GWM Robotics的Python SDK(软件开发工具包),该工具包支持多视角视频生成和长上下文序列,旨在无缝集成到现代机器人策略模型的开发流程中。

Gen-4.5同步升级:新增原生音频功能

除了世界模型,Runway此次也对Gen-4.5进行了重要升级,新增了原生音频生成与原生音频编辑功能。

现在,Gen-4.5可以直接生成逼真的对话、音效和背景音乐,极大拓展了视频创作的故事表现力。在音频编辑方面,用户可以对现有视频的音频进行任意方式的调整。

此外,新版本还引入了多镜头编辑功能,允许用户在初始生成的视频场景中进行任意长度的修改,并确保整段视频在风格和内容上保持一致变换。

参考链接:

[1]https://runwayml.com/research/introducing-runway-gwm-1

[2]https://x.com/runwayml/status/1999190927814836371

[3]https://techcrunch.com/2025/12/11/runway-releases-its-first-world-model-adds-native-audio-to-latest-video-model/