近日,OpenAI 正式发布了新一代智能体编码模型 GPT-5.2 Codex,并在官网同步发布技术博客,详细说明了该模型的定位、能力改进及部署方式。

据介绍,GPT-5.2 Codex 基于通用模型 GPT-5.2 构建,并针对“智能体编码”(Agentic Coding)场景进行了专门优化,主要面向复杂的软件工程任务。相较此前版本,新模型在长程任务执行、大规模代码变更、Windows 原生环境支持以及网络安全相关能力等方面进行了系统性改进。

在工程能力层面,GPT-5.2 Codex 通过引入原生的上下文压缩(compaction)机制,提高了对超长上下文的理解与利用效率,使模型在跨文件、跨模块的长期编码任务中具备更稳定的表现。同时,该模型在代码重构、迁移等涉及大规模改动的场景下,整体可靠性和一致性有所提升。

安全能力也是此次更新的重点方向之一。随着模型在推理与工具调用能力上的增强,其在网络安全领域的适用性也随之提升。

官方披露,就在上周,一名安全研究人员使用 GPT-5.1-Codex-Max 配合 Codex CLI,协助发现了 React 框架中的三个安全漏洞,并已通过负责任披露流程提交给相关方。这些漏洞可能导致拒绝服务或源代码泄露风险。OpenAI 表示,GPT-5.2 Codex 是其目前网络安全能力最强的 Codex 模型,但相关能力仍具有“双重用途”属性。

在发布策略上,OpenAI 选择优先通过受控渠道提供 GPT-5.2 Codex。目前,该模型已在 Codex CLI、IDE 扩展、云端环境以及代码审查流程中上线,并向所有付费 ChatGPT 用户开放。同时,OpenAI 正在推进 API 层面的安全开放方案。针对网络安全研究场景,OpenAI 还同步启动了一项仅限邀请的试点计划,向经过审查的安全研究人员和组织提供用途受限的访问权限。

性能表现评估

在能力融合方面,GPT-5.2 Codex 继承了 GPT-5.2 在专业推理与事实准确性方面的特性,同时整合了 GPT-5.1-Codex-Max 在智能体编码和终端操作上的能力。这种组合使模型在复杂工程任务中能够更稳定地调用工具、理解多模态输入,并在控制 Token 使用效率的同时完成长时间推理。

新模型在处理编码过程中共享的截图、技术示意图、数据图表和用户界面时具备更高的理解精度。在 Windows 原生环境下,GPT-5.2 Codex 的智能体执行效率和可靠性也有所提升。

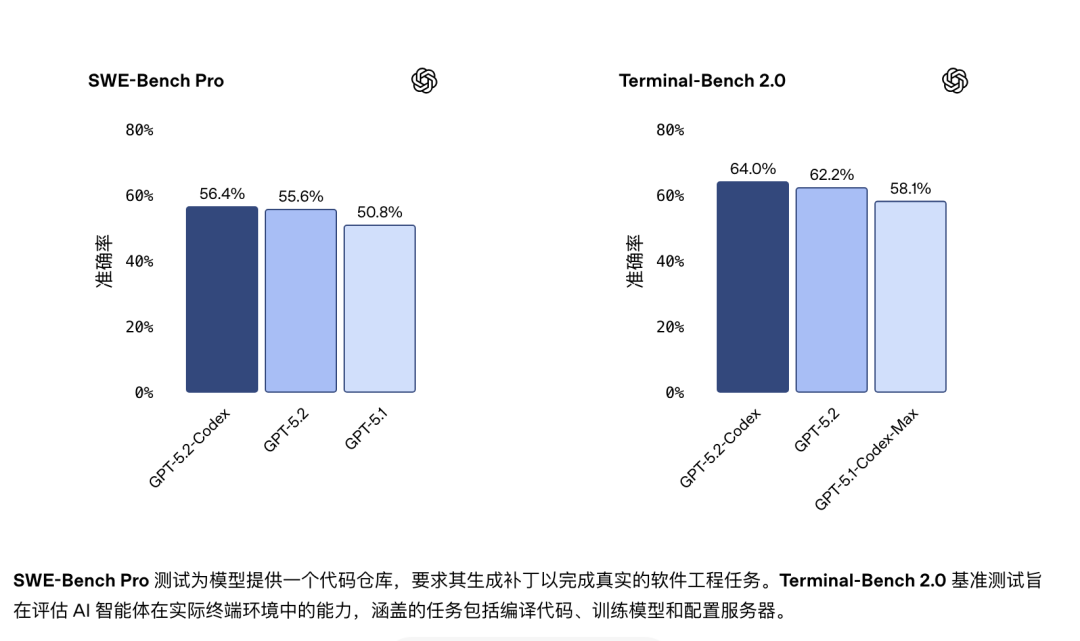

在基准测试方面,GPT-5.2 Codex 参与了 SWE-Bench Pro 以及 Terminal-Bench 2.0 的评测。这两项测试主要用于评估模型在真实代码库和终端环境中执行实际工程任务的能力。相关结果显示模型在上述场景中的整体表现较此前版本有所改进。

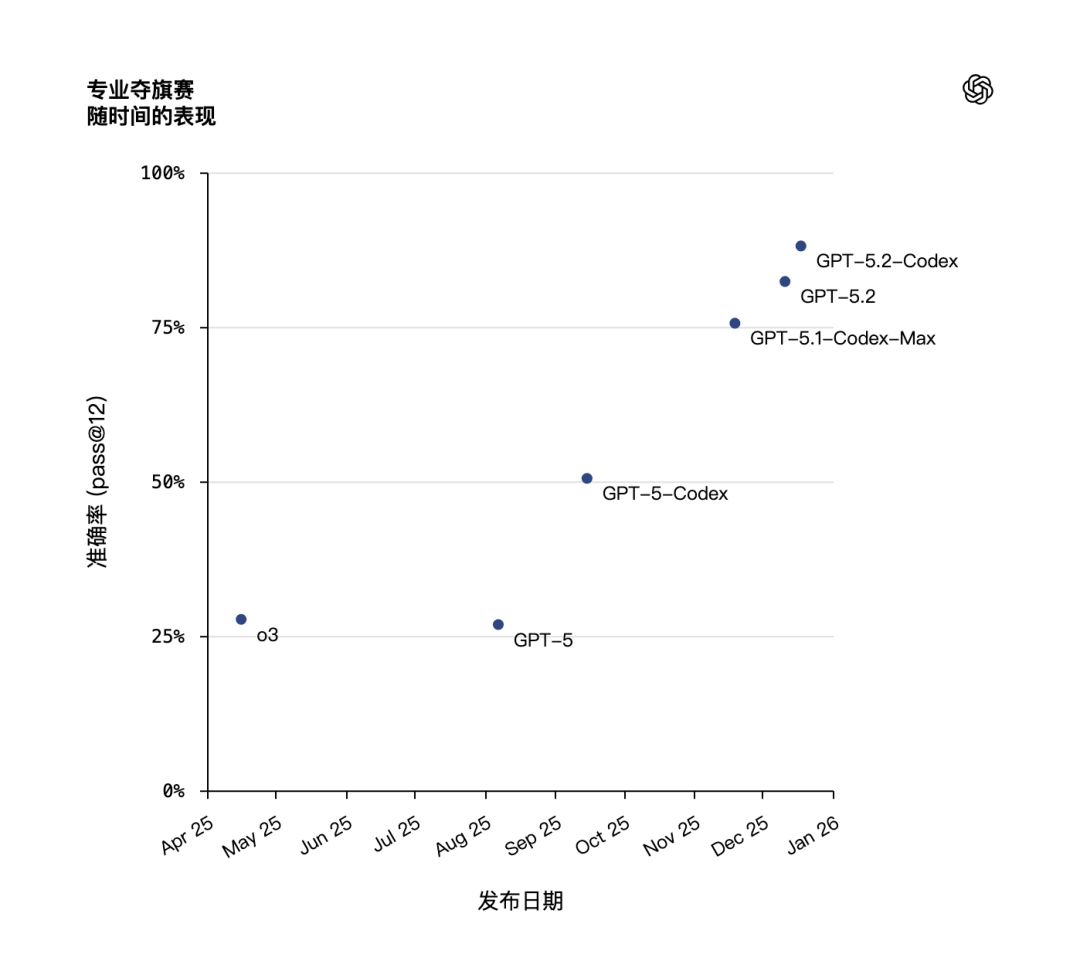

OpenAI 透露的一项网络安全评估显示,从 GPT‑5-Codex 到 GPT‑5.1-Codex-Max 再到 GPT‑5.2-Codex,模型能力在持续提升。

用户实测反馈

GPT‑5.2-Codex 的发布引发了开发者社区的广泛讨论。

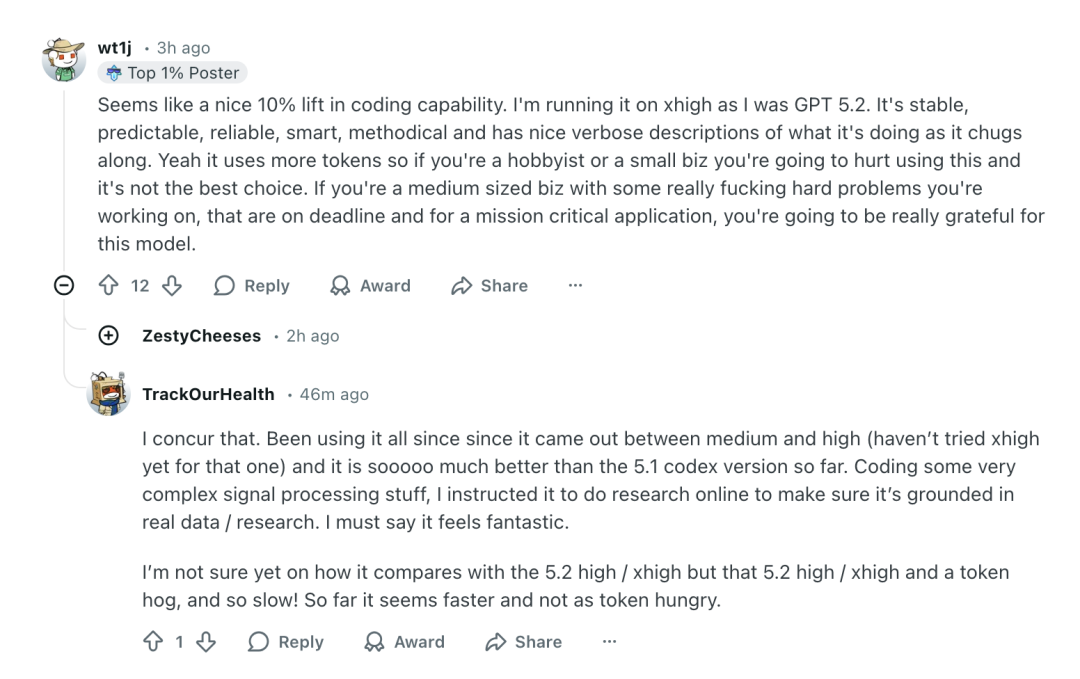

在 Reddit 上,有用户反馈称,相比此前使用的 GPT-5.2,新模型在编码能力上体感大约有10%左右的提升。在较高配置下运行,整体感受是表现稳定、可预测性强,执行过程可靠且逻辑清晰,在完成任务的同时还会对推理和操作步骤给出较为详尽的说明。

不过,他也指出,这一模型在运行过程中会消耗更多的 Token,因此对个人用户、业余开发者或小型企业而言,成本压力可能较大。但对于正在处理高度复杂、时间紧迫且具有关键业务影响的中型企业而言,这一模型的价值会非常明显。

另一位深度用户对此表示赞同。他表示正在使用该模型编写复杂的信号处理代码,并会让模型进行在线检索以确保输出基于真实数据。从实际体验来看,整体效果非常出色。尽管尚未系统对比该版本与 GPT-5.2 高配模式的差异,但后者不仅 Token 消耗极大,而且运行速度较慢。相比之下,目前使用的这一版本在速度和成本控制上显得更为均衡。

对于 OpenAI 快速的产品迭代,有用户表示这在大型组织中通常是难以实现的。该用户指出,任何在大型组织工作过的人都知道,这种方向性的转向通常也需要数月甚至更长时间。相比之下,OpenAI 的迭代速度显得非常迅速。

OpenAI计划再融1000亿美元

在 GPT‑5.2-Codex 发布之际,有消息称 OpenAI 正开启新一轮最高可达1000亿美元的融资,用以支持其在人工智能领域的长期战略扩张。如果该轮融资顺利完成,OpenAI的整体估值可能升至约8300亿美元。

报道指出,这轮融资目前仍处于早期阶段。若按计划完成,这将成为OpenAI成立以来规模最大的一次融资。在本轮融资计划中,软银集团被视为关键出资方之一。除软银外,OpenAI近期也密集推进多项交易,显示出较强的资本吸引力。