随着 AI Agent 技术的快速发展,其正逐步从单一的模型训练与单次推理,转向持续运行、自主决策的业务闭环模式。这一根本性转变,对底层的数据存储与管理范式提出了前所未有的挑战。如何让AI智能体拥有持续进化的“记忆”?这成为了一个亟待解决的核心问题。

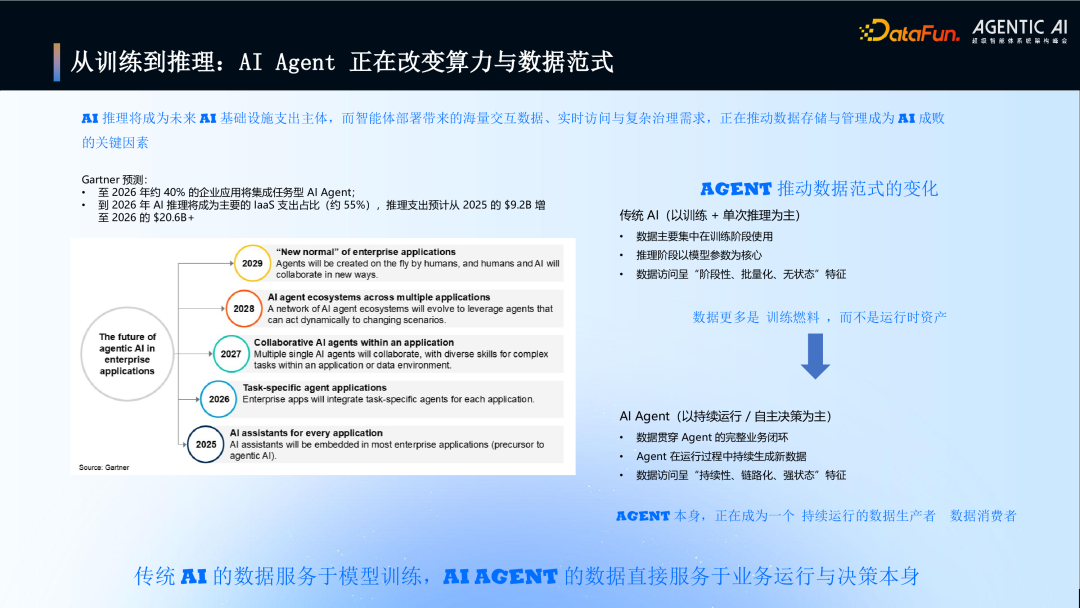

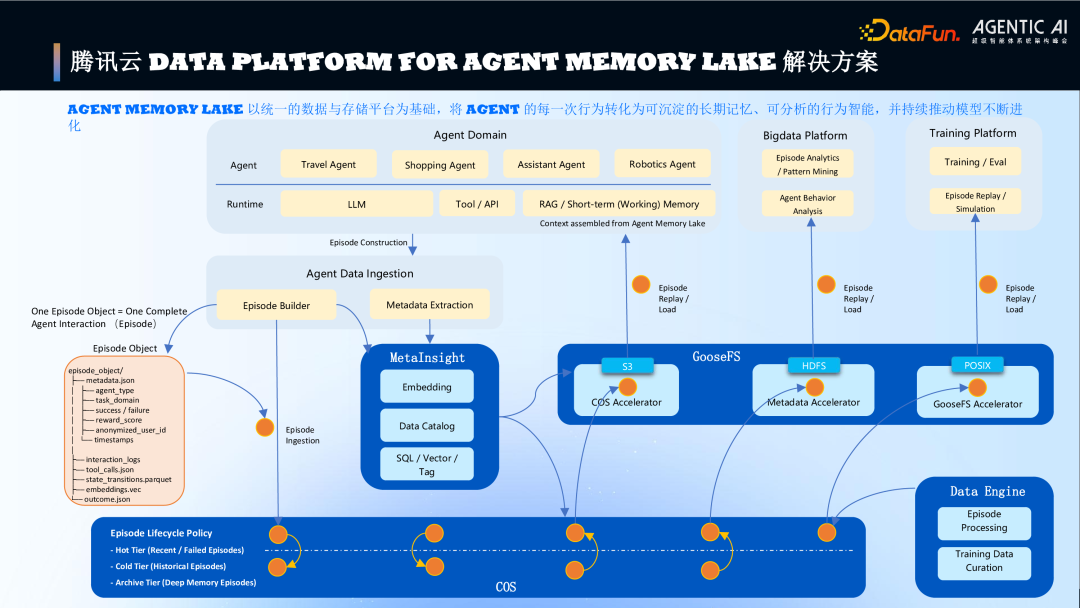

Gartner 预测,到 2026 年,约 40% 的企业应用将集成任务型 AI Agent,而 AI 推理支出占 IaaS 总支出的比例将达到 55%,规模超过 206 亿美元。与传统 AI 不同,AI Agent 在运行过程中会持续产生海量的轨迹数据、决策日志、工具调用记录。这些“记忆”数据需要同时满足低时延访问、长期保存、可分析复用的严苛需求,传统存储方案已难以应对。在此背景下,腾讯云基于自身强大的 Data Platform 技术底座,创新性地构建了 Agent Memory Lake(记忆湖)分层记忆体系,旨在从根本上解决 AI Agent 的记忆管理难题。

01 背景介绍:AI Agent 正在重塑数据范式

1. 从训练到推理:AI Agent 正在改变算力与数据范式

在 AI 系统构建初期,无论是自动驾驶、AIGC 还是具身智能领域,客户往往更关注应用层和平台层,而低估了底层存储(IaaS层)的重要性。随着业务规模扩大,存储层的任何变动都可能引发代价高昂的系统重构和业务中断。此外,“烟囱式”架构也带来了痛点:AI 业务流程的不同环节(如预处理、训练、推理)通常由不同部门负责,各自选用独立的存储方案,形成了数据孤岛。当数据量爆炸式增长时,跨环节的数据流动、共享与协作效率低下、成本高昂。

AI Agent 的部署将产生海量的交互数据,并带来实时访问与复杂治理需求,这使得数据存储与管理成为 AI 成败的关键因素。

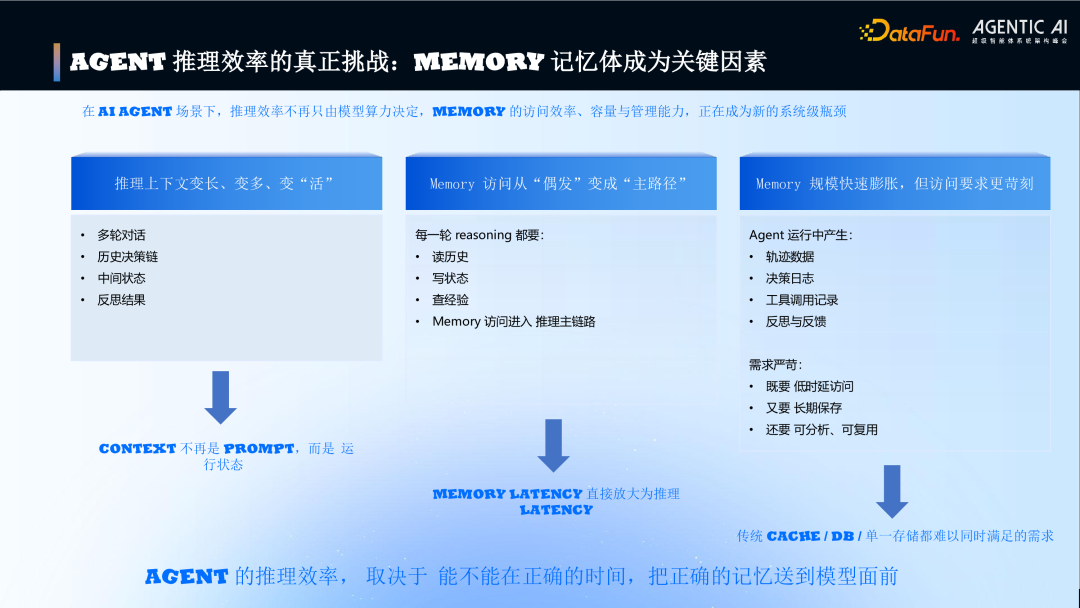

2. Agent 推理效率的真正挑战:Memory 记忆体成为关键因素

在 AI Agent 场景下,其核心在于“记忆”(Memory),这使得数据管理的范式和重要性发生了根本变化:

- 数据角色转变:数据从服务于模型训练的“燃料”,转变为直接支持业务运行和实时决策的“运行时资产”。

- 记忆成为核心:Agent 的每一轮推理都高度依赖对过往记忆的读取(历史、经验)和写入(新状态、新决策)。

- 新存储挑战:

- 上下文变长且多变:推理过程需要更长、更多样的上下文记忆(多轮对话、决策链)。

- 访问成为主路径:记忆的读写成为每一次推理的主要操作,Memory 访问延迟直接放大为推理延迟。

- 规模持续膨胀:记忆作为长期资产被反复复用,数据量只增不减。

- 性能要求苛刻:需要极低时延、高吞吐,同时还需支持长期保存和强大的内容检索能力。

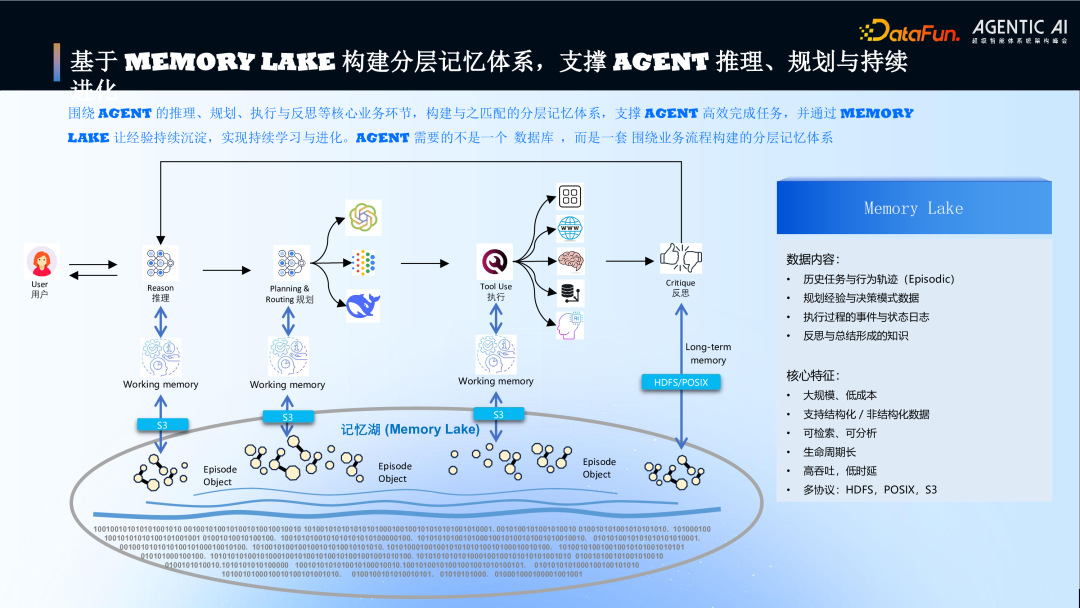

3. 基于 Memory Lake 构建分层记忆体系

AI Agent 需要的不是一个单一的数据库,而是一套围绕其推理、规划、执行与反思等核心业务流程构建的分层记忆体系。为此,我们提出了 “记忆湖(Memory Lake)” 这一新概念。

Memory Lake 是面向 AI Agent 场景、以“记忆”为核心资产的数据管理与存储体系。它类比于大数据领域的“数据湖”,但专门针对 Agent 业务中记忆数据的特殊性。其数据内容包括历史任务与行为轨迹、规划经验与决策模式数据、执行过程的事件与状态日志、反思与总结形成的知识。

Memory Lake 的核心特征包括:

- 大规模与低成本:支撑海量、持续膨胀的记忆数据。

- 多模态数据支持:能存储结构化、半结构化、非结构化等各种形态的记忆数据。

- 检索与分析能力:支持高效的元数据管理和内容检索(如向量化搜索),以便在正确时间推送正确的记忆。

- 精细化生命周期管理:能够根据时间、热度、知识价值等维度对记忆进行分类分级。

- 高性能访问:高吞吐、低时延,以满足推理过程的实时性要求。

- 多协议兼容:除对象存储接口(如 S3)外,还需支持文件存储(POSIX)、大数据(HDFS)等协议。

- 安全与合规:保障记忆资产的安全性,并满足国内外合规要求。

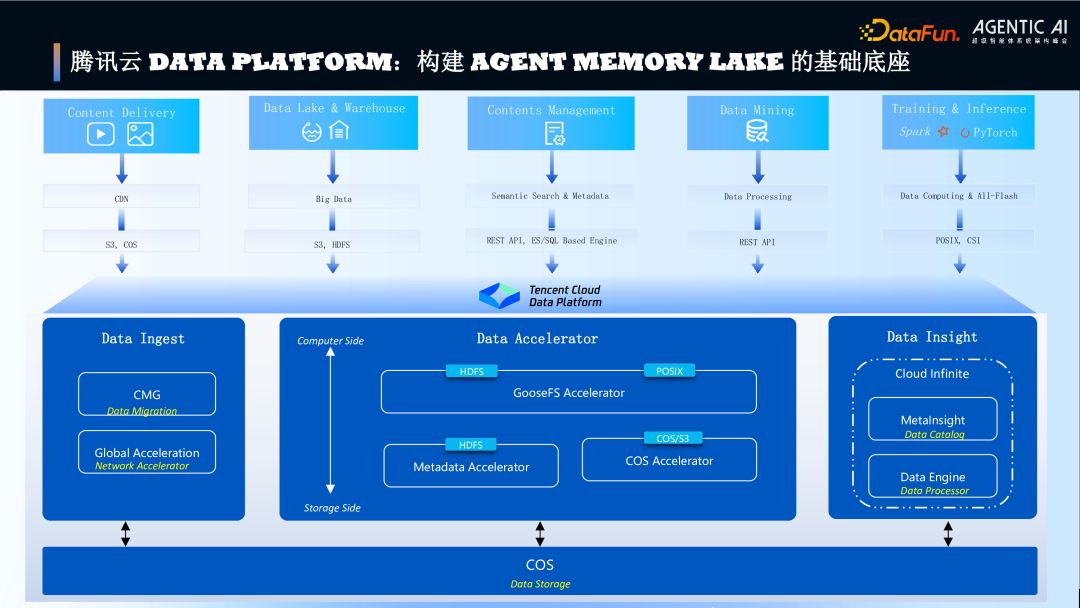

腾讯云以 Data Platform 为基础来构建“记忆湖”,其核心组件构成了一套完整的技术栈:

- 对象存储(COS):提供近乎无限扩展、高可靠、高可用的底层存储底座,满足百 PB 级规模需求,并提供端到端加密、访问控制、多地多可用区容灾等安全能力。

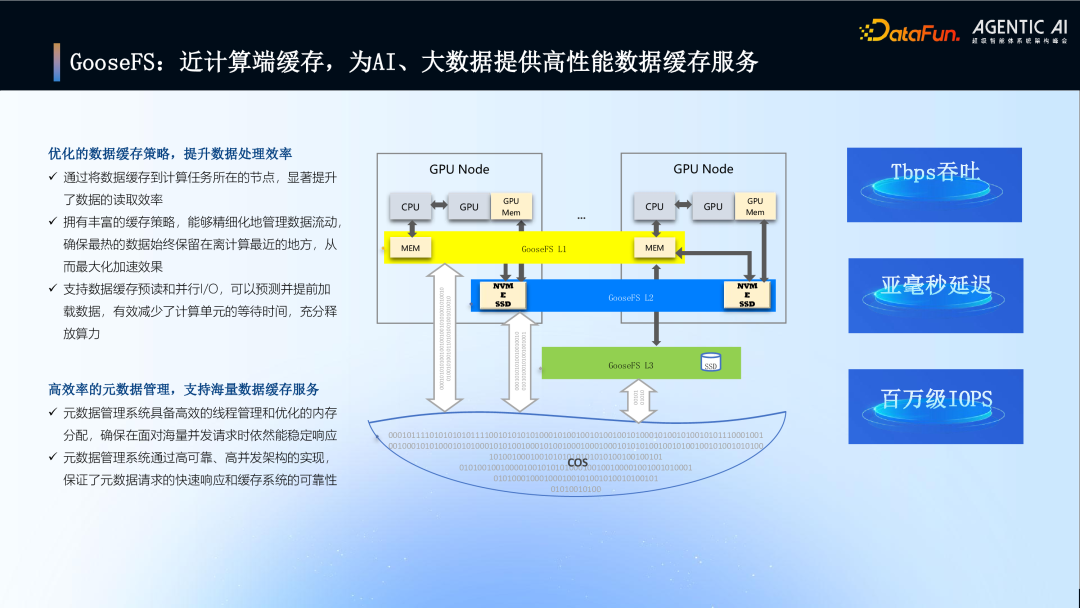

- 数据加速器(GooseFS):在计算侧近端构建缓存层,通过智能预测和预加载算法,将高频访问的记忆数据提前加载到高性能介质中,极大提升读取性能,缓解对象存储的高时延访问问题。

- 记忆洞察(MetaInsight):作为 Memory Lake 的元数据管理与智能检索中枢,负责记忆内容的向量化、知识图谱构建、元数据提取与管理、分类分级、以及与加速器协同的智能数据预取调度。

- 数据处理引擎(Data Engine):作为记忆内容的加工与治理引擎,负责记忆的格式转换、分类打标、优先级判定、内容安全审核以及多媒体处理等。

完整的解决方案工作流程与 Agent 业务深度结合:

- 记忆摄入:Agent 任务产生的记忆数据(称为 Episode)被打包后,存入底层对象存储(COS)。

- 洞察与分析:“记忆洞察(MetaInsight)”组件对这些数据进行内容分析、向量化,提取元数据并建立关联索引。

- 加速访问:当 Agent 进行推理需要读取记忆时,“数据加速器(GooseFS)”根据预测和索引,将相关数据高效缓存至近计算端,提供低时延访问。

- 治理与反馈:“数据处理引擎(Data Engine)”负责记忆的合规检查、格式转换等。处理后的高质量记忆还可用于模型的持续精调(Fine-tuning),形成“数据-模型”协同进化的闭环。

3. 核心组件深度解析

COS 对象存储:高可靠、高性价比的存储底座

腾讯云 COS 提供极高的可用性(99.995%)和数据持久性(99.999999999%),单集群架构可扩展至百 EB 级以上规模,其原生多 AZ、数据自动均衡等能力为 Memory Lake 提供了坚实底座。

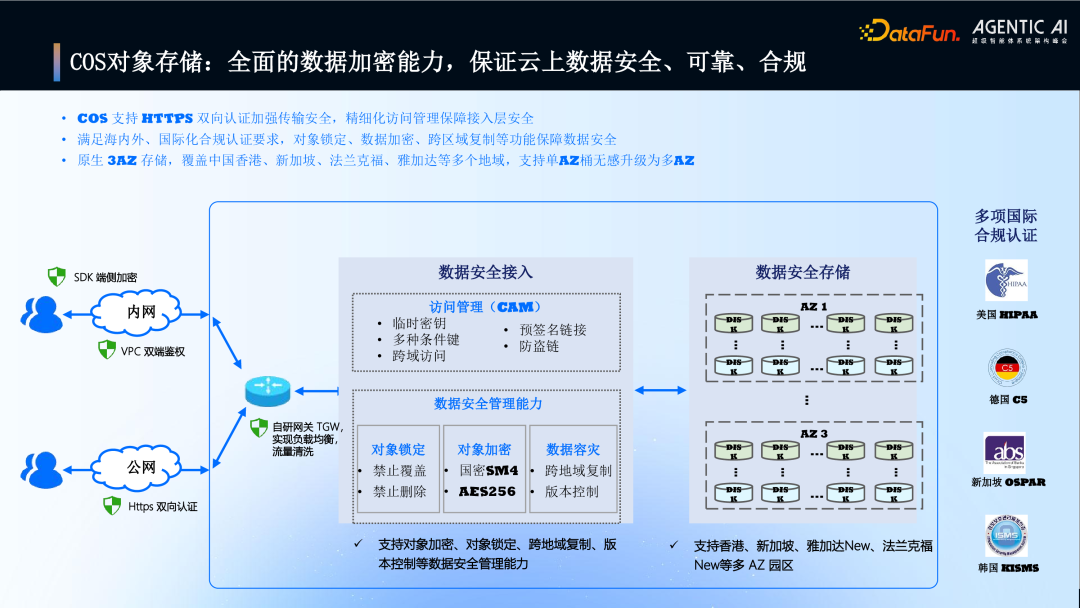

COS 对象存储:全面的数据安全与合规

支持 HTTPS、精细化访问管理(CAM)、对象锁定、数据加密(国密 SM4/AES256)、跨区域复制等,并已获得 HIPAA、德国 C5、新加坡 OSPAR 等多项国际合规认证。

GooseFS:近计算端的高性能数据缓存

通过将热数据缓存到计算节点(如 GPU 节点),结合丰富的缓存策略和数据预读,提供亚毫秒延迟、百万级 IOPS 和 Tbps 级吞吐,显著加速 AI 和大数据场景的数据读取。

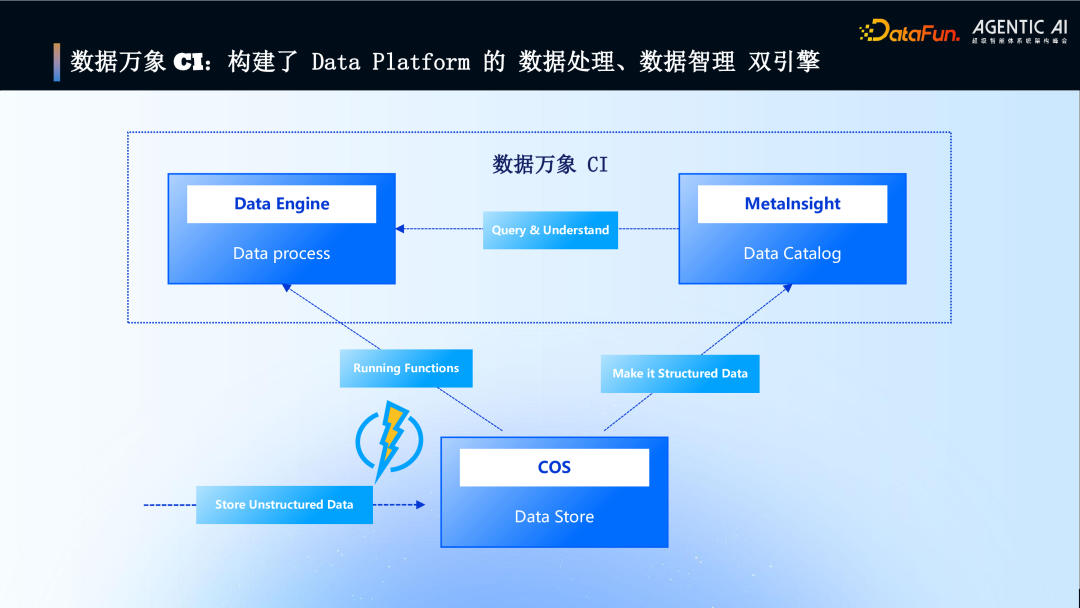

数据万象 CI:数据处理与数据智理双引擎

数据万象构建了 Data Platform 的“双引擎”:

- Data Engine(数据处理引擎):提供一站式数据处理服务,涵盖内容审核、图片/视频/音频处理、文档服务、文件处理及智能处理(标签、超分、修复等)等丰富功能。

- MetaInsight(数据智理引擎):提供数据智能检索服务,支持跨模态(内容、向量、元信息)检索,覆盖千亿数据毫秒级查询,召回率达 95%+。

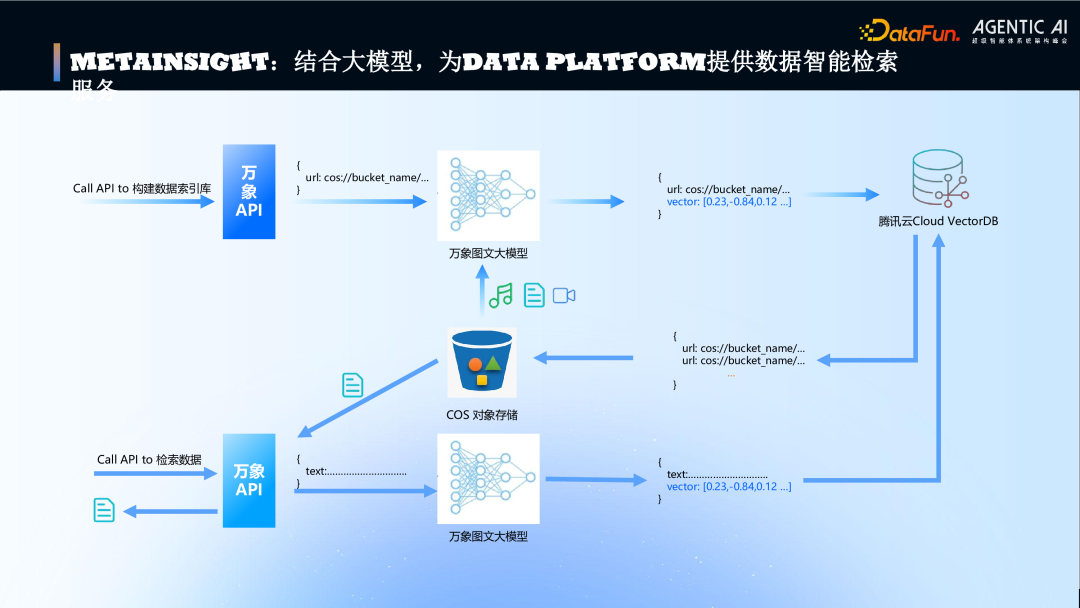

MetaInsight:结合大模型的智能检索

通过结合万象图文大模型和腾讯云 Cloud VectorDB,实现对 COS 中非结构化数据的自动向量化与索引构建,提供强大的语义搜索能力。

MetaInsight + GooseFS 协同

两者协同工作:通过 MetaInsight 智能检索出有价值的数据,再利用 GooseFS 将其高效缓存并投递到计算节点,实现“让数据更智能、更高效地计算”。

03 解决方案与客户案例

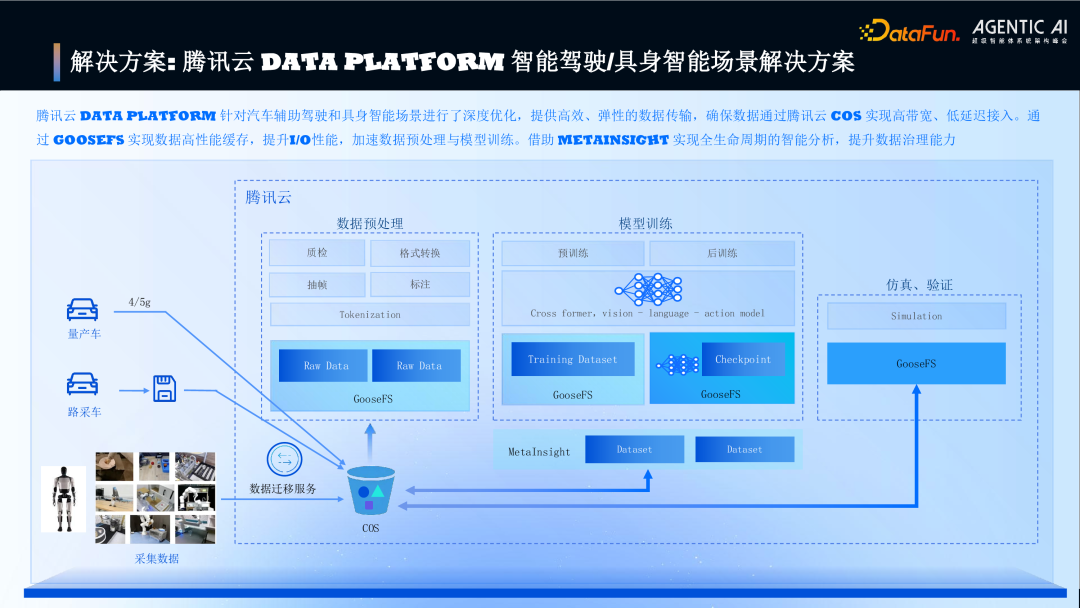

1. 智能驾驶/具身智能场景解决方案

腾讯云 Data Platform 针对该场景深度优化:通过 COS 实现高带宽、低延迟的数据接入;通过 GooseFS 实现数据高性能缓存,加速预处理与训练;通过 MetaInsight 实现数据全生命周期智能分析,提升治理能力。这对于训练需要海量多模态数据(文本、图像、视频)的具身智能大脑尤为关键。

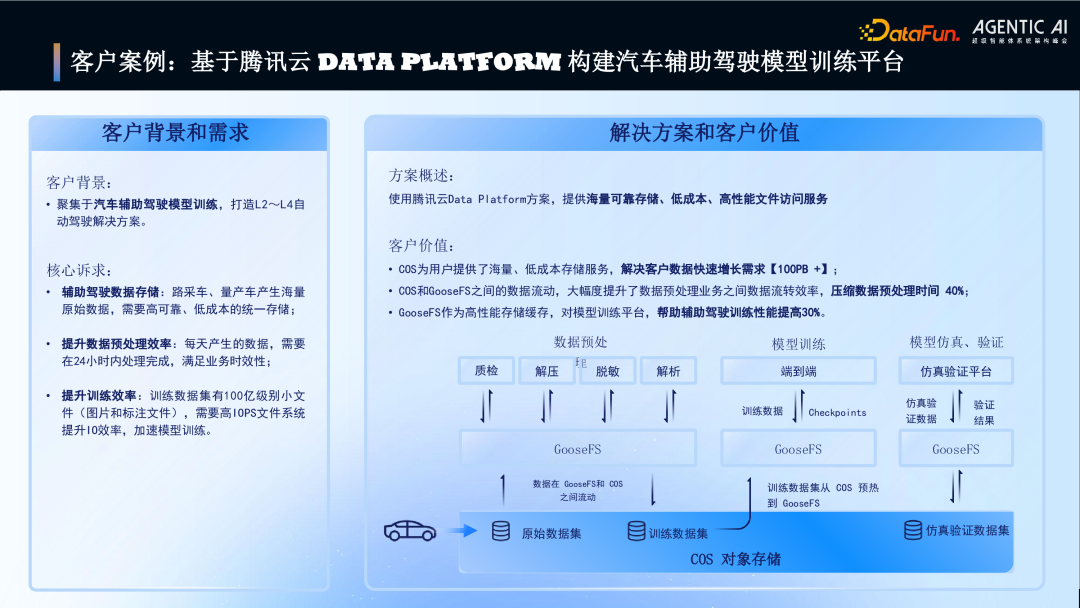

2. 客户案例:汽车辅助驾驶模型训练平台

- 客户需求:路采车、量产车产生海量原始数据,需高可靠、低成本统一存储;每日数据需在24小时内处理完毕;需处理100亿级别小文件,要求高IOPS以加速训练。

- 解决方案与价值:

- COS 提供了超过100PB的海量、低成本存储。

- COS 与 GooseFS 之间的高效数据流动,将数据预处理时间压缩了40%。

- GooseFS 作为高性能缓存,将模型训练性能提升了30%。

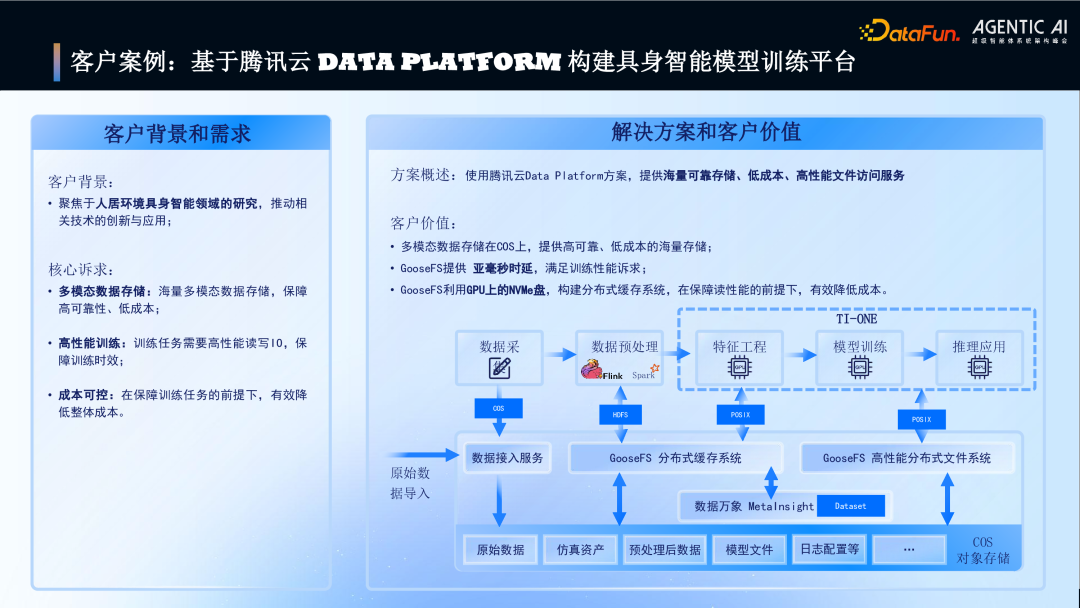

3. 客户案例:具身智能模型训练平台

- 客户需求:海量多模态数据需要高可靠、低成本存储;训练任务需要极高的IO性能;需要在保障性能的前提下有效控制整体成本。

- 解决方案与价值:

- COS 提供了高可靠、低成本的海量存储底座。

- GooseFS 提供亚毫秒级延迟,满足了训练的性能诉求。

- GooseFS 利用计算节点上的 NVMe 盘构建分布式缓存系统,在保障极致性能的同时,有效降低了整体成本。

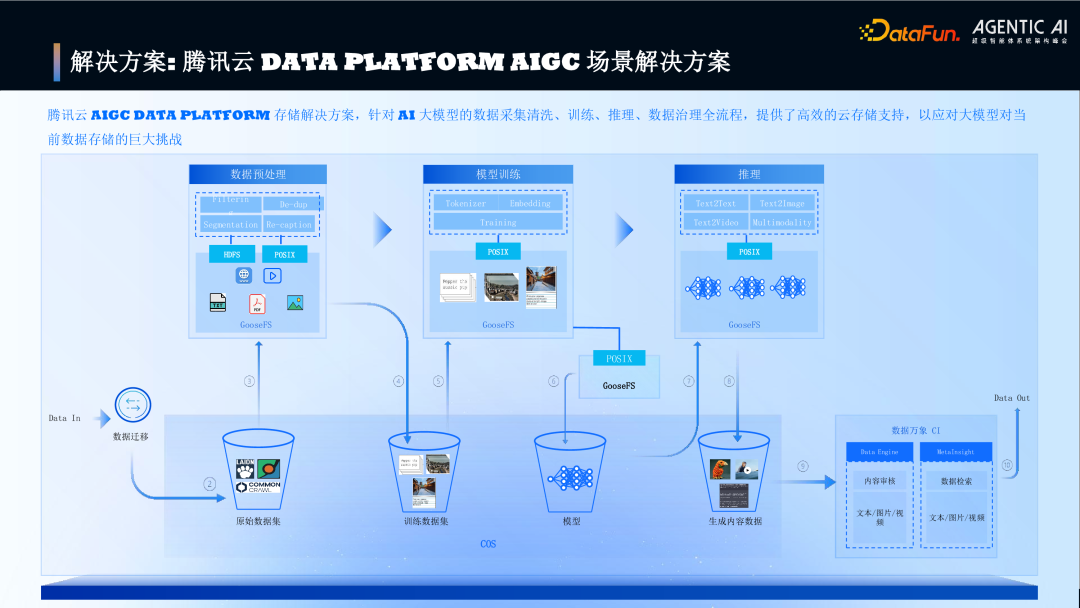

4. AIGC 场景解决方案与案例

针对 AIGC 数据采集、训练、推理全流程,提供高效的云存储支持。

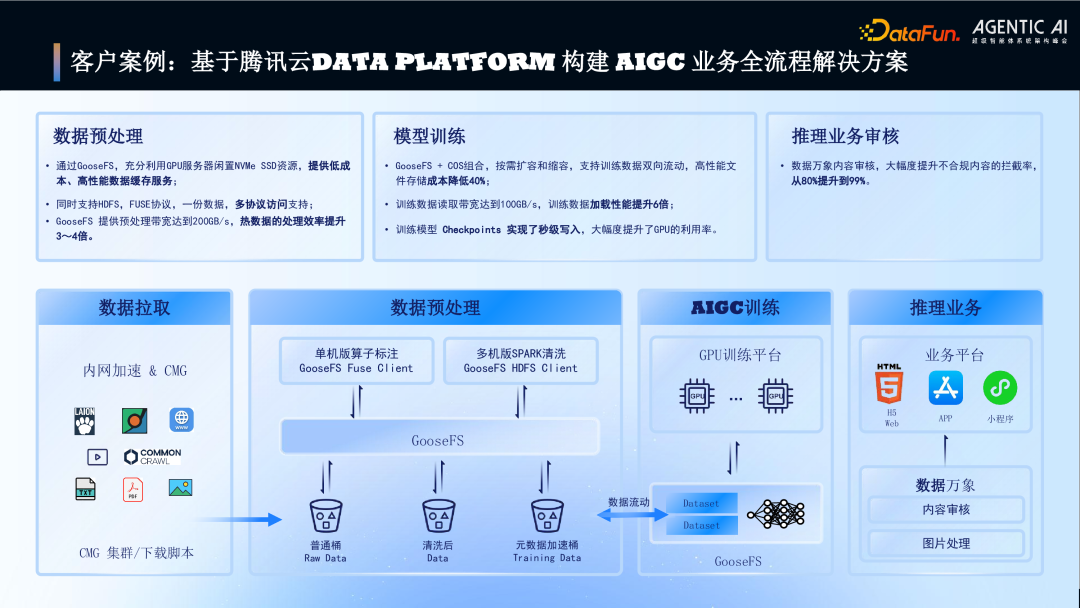

客户案例:AIGC 业务全流程解决方案

- 数据预处理:GooseFS 利用闲置 NVMe 资源提供低成本高性能缓存,预处理带宽达200GB/s,效率提升3-4倍。

- 模型训练:GooseFS+COS 组合支持弹性伸缩,训练数据读取带宽达100GB/s,加载性能提升6倍,Checkpoint 实现秒级写入。

- 推理业务审核:数据万象内容审核将不合规内容拦截率从80%提升至99%。

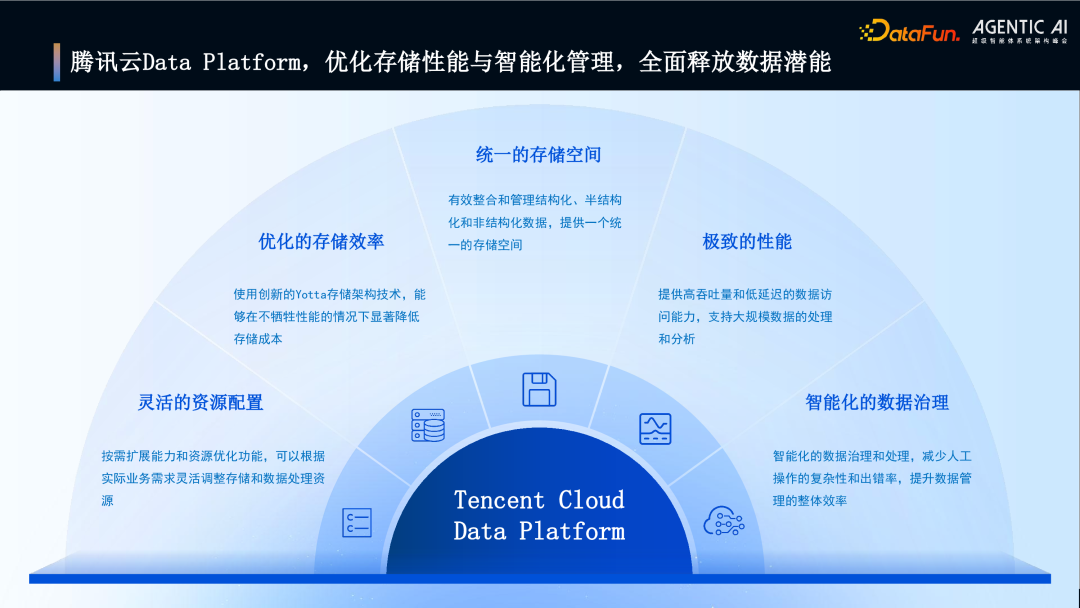

总结:全面释放数据潜能

腾讯云通过其 Data Platform 解决方案(COS + GooseFS + MetaInsight + Data Engine),打造了满足 Agent 业务需求的 Memory Lake,旨在全面释放数据潜能,其核心价值可归纳为五点:

- 统一的存储空间:有效整合和管理结构化、半结构化及非结构化数据,打破数据孤岛。

- 极致的性能:提供高吞吐、低延迟的数据访问能力,支撑大规模数据处理与分析。

- 优化的存储效率:使用创新的 Yotta 存储架构,在保障性能的同时显著降低存储成本。

- 灵活的资源配置:具备按需扩展和资源优化能力,可根据业务需求灵活调整。

- 智能化的数据治理:通过智能化的数据处理与分析,减少人工操作复杂性,提升整体管理效率。

Memory Lake 是数据湖概念的演进和深化。它继承了数据湖的基础存储和多模态支持能力,但更侧重于满足记忆数据特有的强关联性、复杂元数据管理和精细化生命周期治理等更高阶要求,是更贴近 AI Agent 业务层的数据管理新范式。

随着 AI Agent 技术浪潮的推进,拥有一个强大的、智能化的“记忆”系统将成为智能体持续进化与高效运行的关键。腾讯云 Data Platform 的 Agent Memory Lake 方案,为这一未来图景提供了坚实可靠的基础设施。对这类前沿云原生智能体架构的讨论与实践,也欢迎大家在云栈社区进一步交流。