好消息,AI也能帮科学家绘制大脑图谱了!

近期,来自加州大学旧金山分校的神经科学团队提出了一种名为 CellTransformer 的机器学习算法。这项黑科技仅花费了几个小时,就完成了对5只小鼠大脑图谱的分类与绘制工作。

这五只小鼠大脑的基因数据中包含了1040万个细胞,每个细胞又包含数百个基因。通过这一创新算法,研究团队不仅清晰地划分出了小鼠大脑内的已知区域,还成功绘制出了新的脑区。更关键的是,这项技术未来很可能被应用于人类大脑的研究。

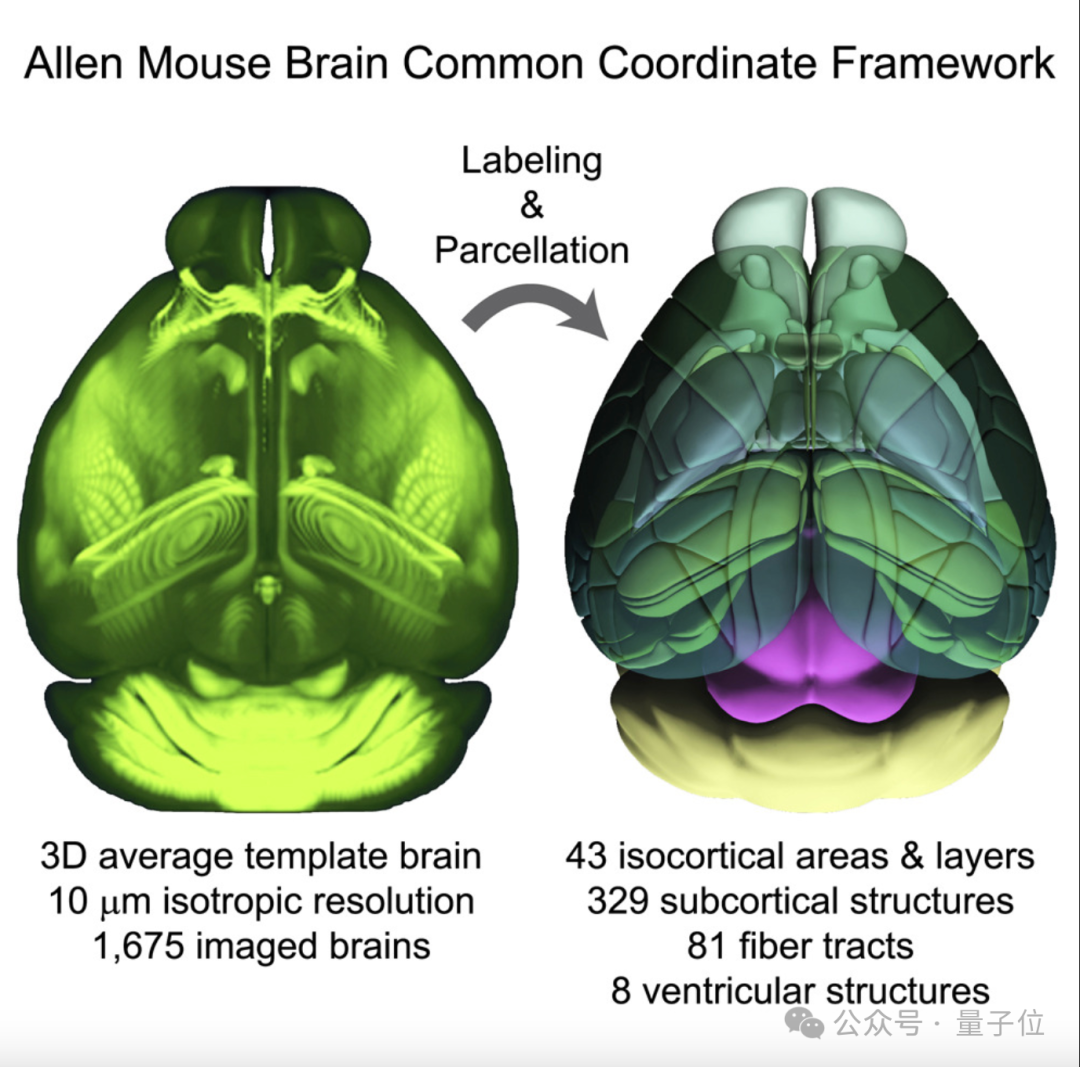

大脑图谱绘制是一门历史悠久的学科。过去的方法相当繁琐,需要科学家用铅笔在脑部图像上手动画线,连接不同区域。2020年发布的艾伦小鼠脑通用坐标框架 (Allen Mouse Brain Common Coordinate Framework) ,正是采用这种方法绘制而成。

这幅基于1675只小鼠脑部数据的图谱涵盖了1000多个不同脑区,价值极高。但这类手工特征强烈的图谱也存在一个不可避免的问题:主观性。正如宾夕法尼亚州立大学医学院的神经解剖学家金永洙(Yongsoo Kim)所言,当他向资深专家请教如何画脑图时,得到的回答往往是:“这都是我脑子里的。”

如今,情况已然不同。来自加州大学旧金山分校的 Reza Abbasi-Asl 和他的团队提出的 CellTransformer 编码器-解码器架构,能在数小时内完成这项浩大工程。

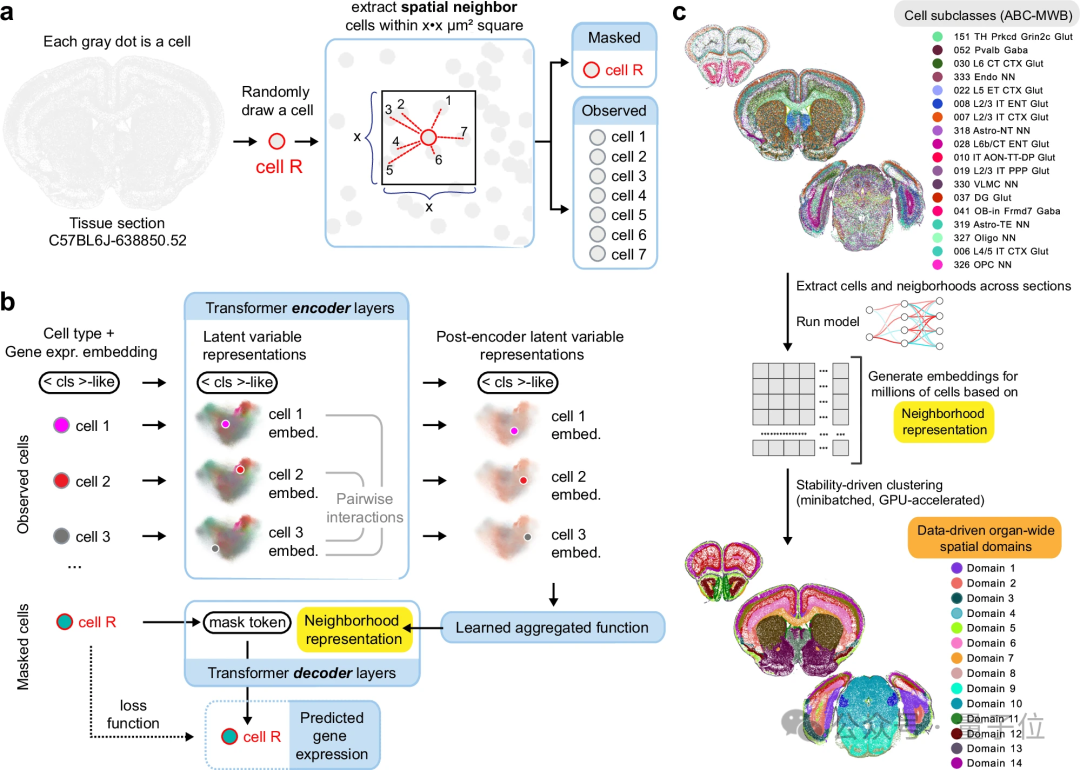

那么,CellTransformer 是如何工作的呢?其核心思路是:随机遮住一个细胞的身份和基因表达,让模型根据其邻居细胞的信息来预测它,预测错误就更新模型,这个过程会重复数百万次。

具体来说,研究人员首先为每个细胞划定一个“邻域”——即以该细胞为中心,在一定微米距离内的所有细胞。这样一来,模型能同时观察到细胞间的空间结构关系与分子层面的差异。

在这个邻域中,每个细胞都被视为一个 token,类似于语言模型中的一个词语。CellTransformer 利用 Transformer 的自注意力机制,让这些细胞彼此“交流”,从而自动学习哪些细胞间的关系更重要,哪些邻居对当前细胞的影响更大。

在训练时,研究人员采用了一种巧妙的自监督学习方式。模型会随机选中一个细胞,将其基因表达信息“掩码”,仅保留细胞类型标签,然后要求模型根据周围邻居的情况,预测该细胞原本应表达的基因。

其内部流程是这样的:通过多层 Transformer 编码器,模型让邻域内所有细胞的信息充分交互。随后,这些细胞的表示会通过一个学习得到的池化操作,被压缩成一个代表整个邻域“组织环境”的向量。

接着,模型再结合被掩码细胞的类型信息,通过一个较浅的解码器,反推出该细胞的基因表达分布。

最终,研究人员为每个细胞提取一个“邻域表示向量”,并将所有细胞、所有切片的这些向量拼接在一起。再使用 k-means 等聚类方法进行分析,脑区便会“自行浮现”。已知的功能区会自然对齐,而在一些区域中,模型还能进一步拆分出更精细的亚区,甚至发现过去从未被系统标注过的新脑区。

效果究竟有多强?

为了验证 CellTransformer 的有效性,研究团队在 ABC-WMB 数据集上进行了系统评估。该数据集包含5只小鼠的脑组织切片数据,其中一只小鼠的数据使用包含500个基因的 MERFISH panel 采集了53个冠状切片,其余四只则使用了包含1129个基因的 panel。

首先,效率极高。CellTransformer 在数小时内完成了对 5只小鼠、总计1040万个细胞 的空间组织建模,这在时间和规模上都是传统方法无法比拟的。

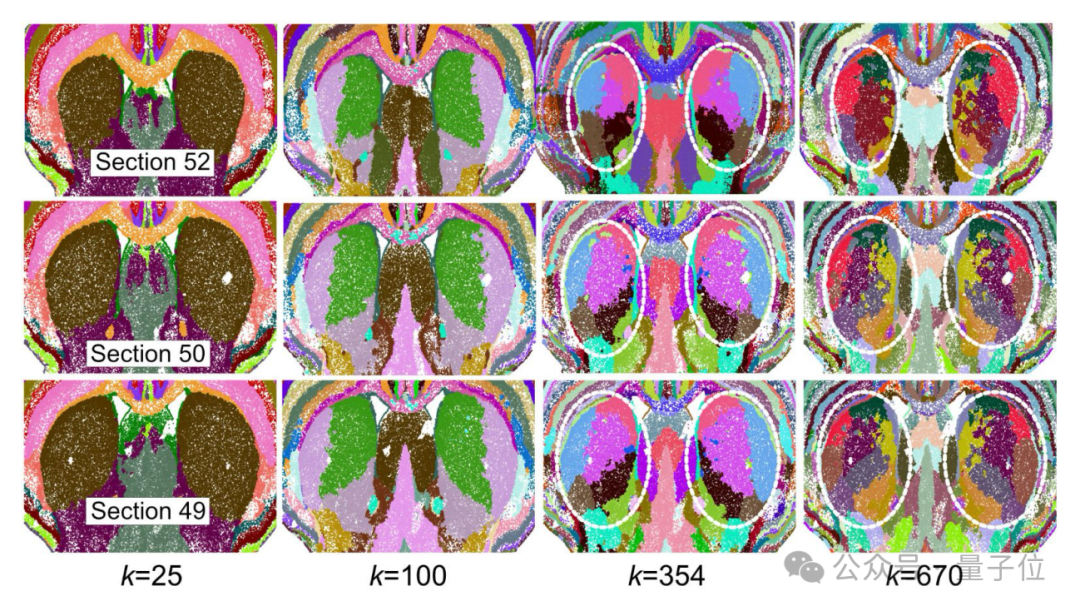

其次,能够准确对齐已知的脑结构分区。CellTransformer 可以在小鼠大脑中定义 25到1300个 神经区域,并且在完全不使用任何先验脑区标签的情况下,其划分结果与已知的解剖结构和功能分区高度吻合。

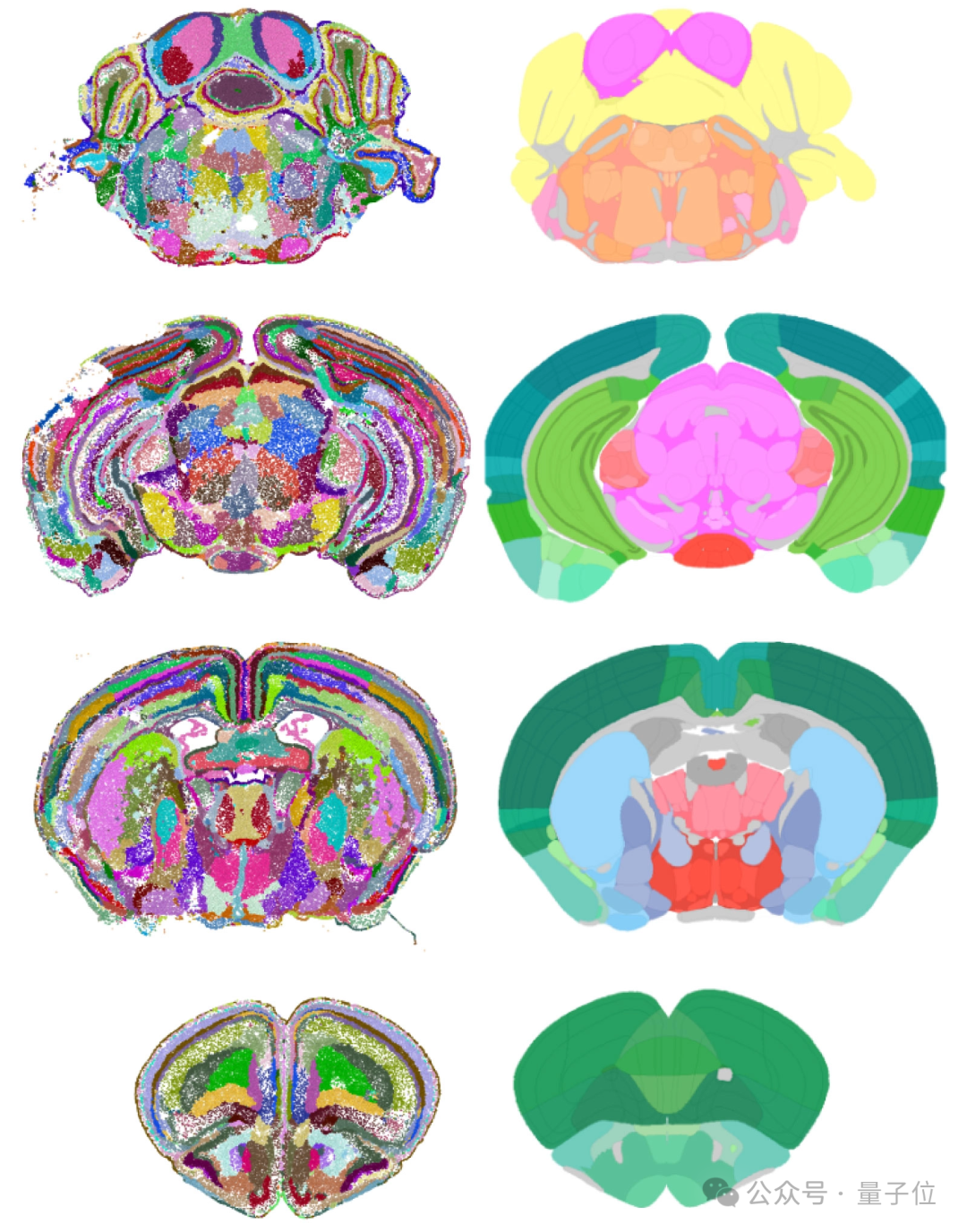

由于 CellTransformer 是基于其预测结果对细胞进行分组,而非凭空生成,因此不存在 “幻觉”问题。研究团队将其输出结果与手绘的艾伦小鼠脑通用坐标框架进行对比,发现两者吻合良好,展现了相似的结构,连大脑皮层中的层级结构也能做到一致。

上图左侧是 CellTransformer 绘制的小鼠脑图,右侧是人类科学家绘制的艾伦框架图谱。两者都定位了大脑中1000多个细胞亚区,但AI发现的细节更多。

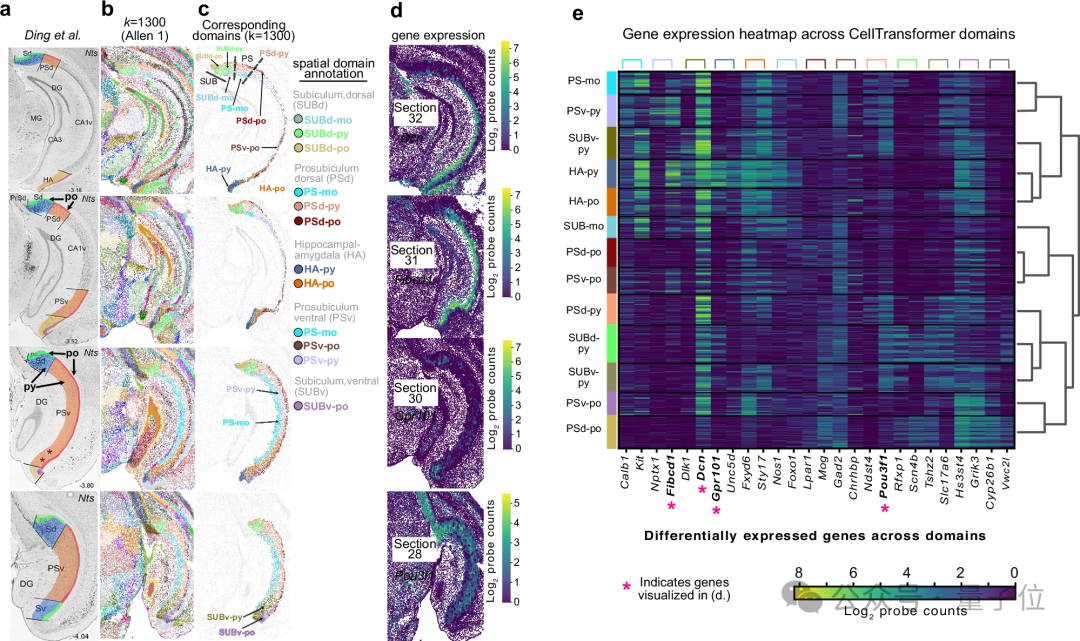

例如,在海马体分区的识别中,当聚类数 k=1300 时,CellTransformer 识别出的空间域边界与过去研究中定义的亚区(如背侧下托的三层组织、前下托的背腹侧组织)高度一致。

而在上丘区域,CellTransformer 也清晰识别了感觉层的带状层、浅灰层和视层,以及运动相关中间灰质和白质的亚区,其发现的结构与通过投影映射确定的内外侧结构类似。

第三,除了对齐已知脑区,CellTransformer 的强大之处在于能识别并绘制出全新的区域,即使是先前通用神经科学方法可能遗漏的区域也不在话下。

以纹状体(在小鼠脑图谱中称为尾壳核)为例,研究发现,当调整不同的 k 值(聚类数)时,尾壳核会呈现出网格状、交错的空间结构,这与之前基于投射连接研究得出的 Voronoi 分区高度一致。

这一发现意外地回答了神经科学领域的一个长期疑问:已知参与运动、奖赏和高级认知功能的纹状体,其同一部分是如何执行如此多不同任务的? 答案似乎是:尾壳核并非一个单一的均质脑区。从图谱中可以看出,它实际上被细分为众多更小的功能单元,不过每个单元对应的具体功能仍有待进一步研究。

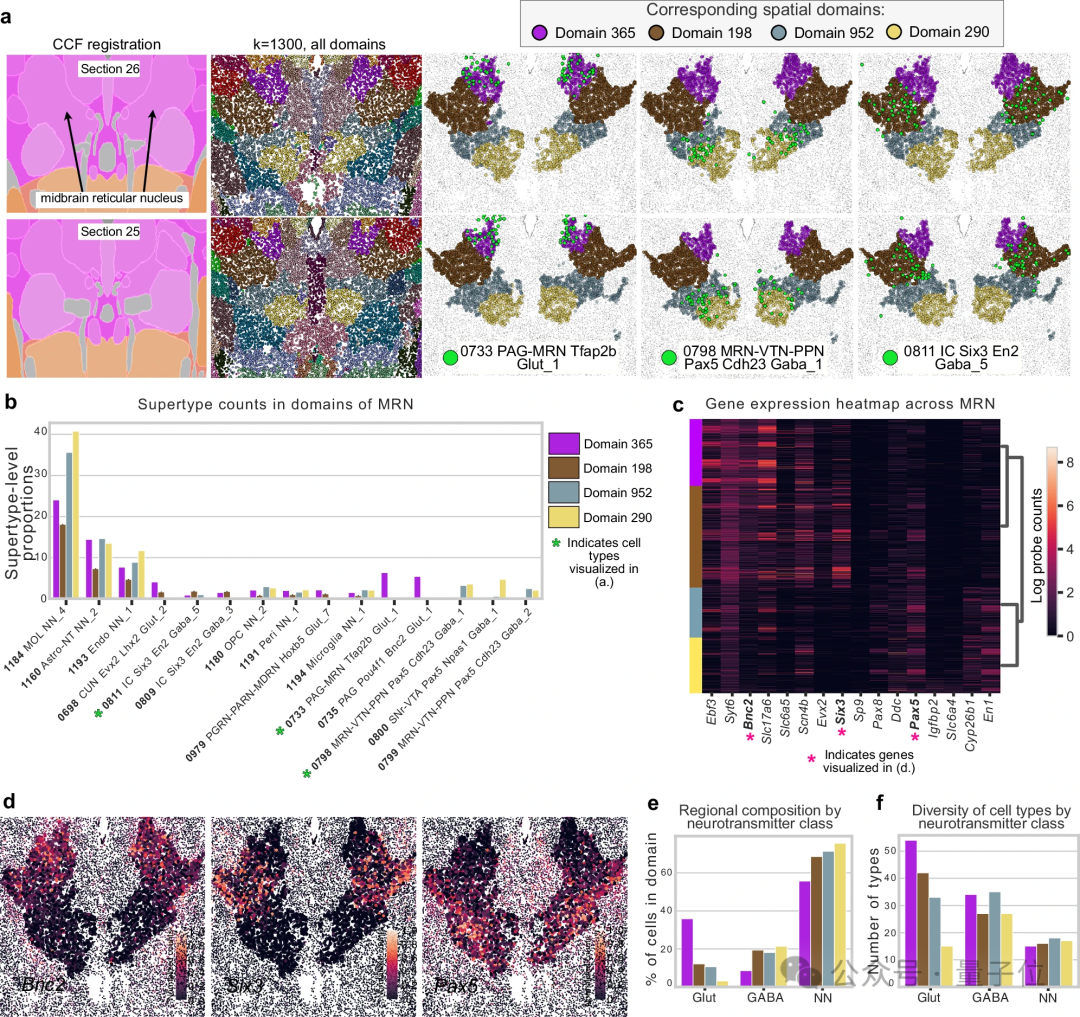

另一个例子是脑干中的中脑网状核,这是一个研究相对较少的、负责启动运动的区域。CellTransformer 在该区域识别出了 4个全新的亚区,每个亚区都具有独特的细胞类型组成和特定的基因激活模式,甚至发现了一些此前被定位在大脑其他区域的细胞类型。

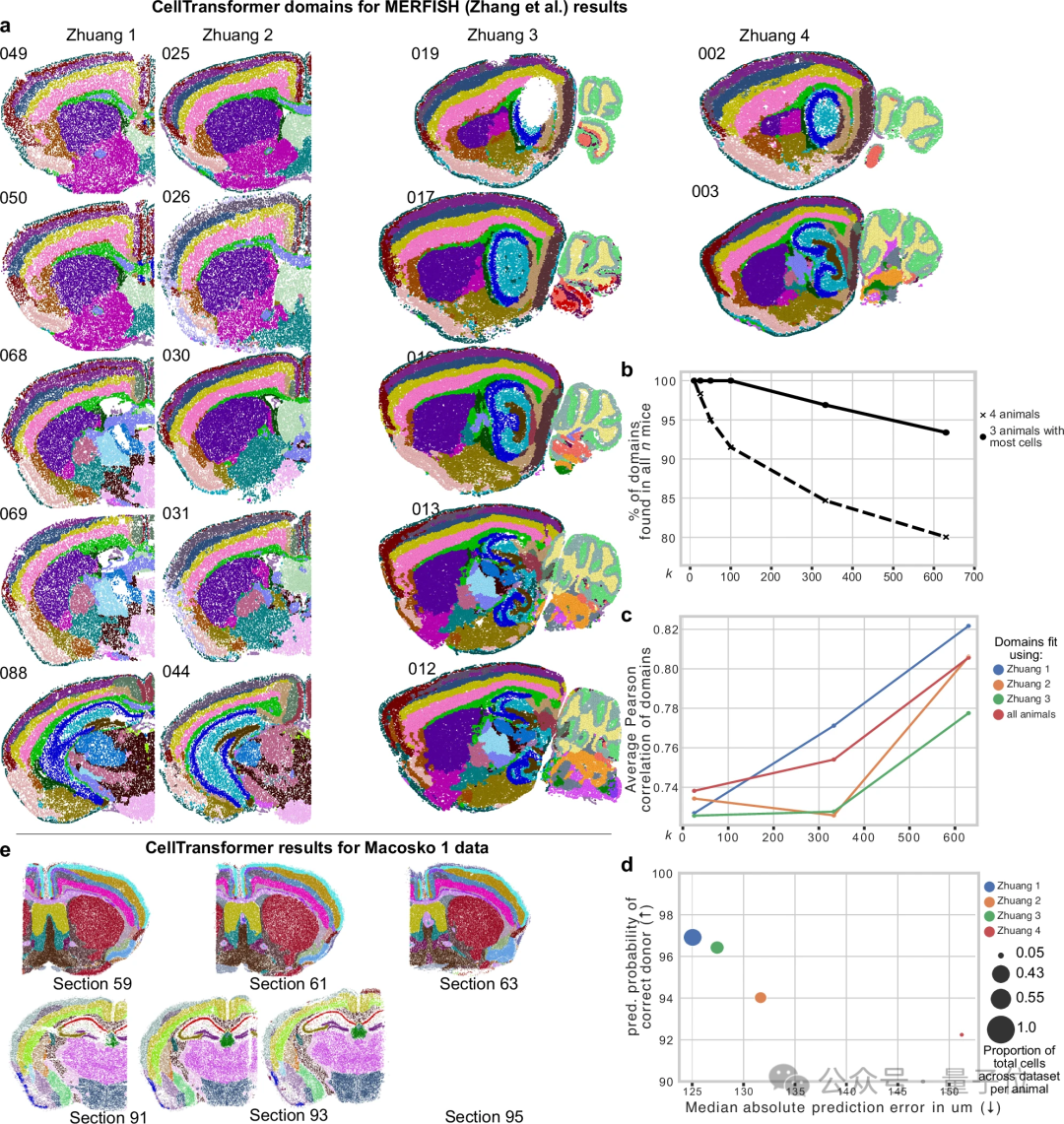

第四,CellTransformer 并非“小鼠特供算法”,它能够很好地扩展到多动物、百万细胞级别的复杂数据集。

为了测试其整合不同动物样本的能力,团队基于另一个 MERFISH 数据集重新训练了一个模型。结果显示,CellTransformer 在所有测试动物中生成了一致的脑亚区划分,所识别的脑区在不同个体间高度重复,这表明该方法能够成功整合具有测量异质性的多动物脑数据。

真正的目标:人脑

当然,小鼠并非终极实验目的,这项算法最终的应用目标直指——人类大脑。研究人员推测,小鼠和人类大脑的部分区域会高度保守,而另一些区域则可能存在显著差异。

然而,挑战是巨大的:小鼠大脑约有1亿个细胞,而人脑则拥有约1700亿个细胞。目前,我们还无法从人脑中获得足够高分辨率、大规模的单细胞空间数据来进行准确预测。

尽管如此,研究团队对未来充满信心。Abbasi-Asl 认为,一旦获得足够的数据,CellTransformer 将有能力应对这一挑战。除了大脑,同样的算法逻辑也可用于肾脏、病理组织等其他器官,通过提供详尽的细胞图谱,帮助科学家深入研究(例如区分健康与病变肾脏的差异)。

随着深度学习与数据采集技术的飞速发展,AI绘制出完整人类脑图谱的那一天,或许真的不远了。这项研究不仅展示了 Transformer 架构在生物医学领域的强大潜力,也为理解大脑这一最复杂的器官开辟了全新的数据驱动路径。对这类前沿交叉技术感兴趣的朋友,可以到云栈社区的人工智能板块查看更多深度讨论。

参考链接:

[1] https://www.quantamagazine.org/fed-on-reams-of-cell-data-ai-maps-new-neighborhoods-in-the-brain-20260209/

[2] https://www.nature.com/articles/s41467-025-64259-4#MOESM1