简介

什么是 AIClient-2-API ?

AIClient2API 是一个突破客户端限制的 API 代理服务,将 Gemini、Antigravity、Qwen Code、Kiro 等原本仅限客户端内使用的免费大模型,转换为可供任何应用调用的标准 OpenAI 兼容接口,支持 OpenAI、Claude、Gemini 三大协议的智能互转,让 Cherry-Studio、NextChat、Cline 等工具能够免费大量使用 Claude Opus 4.5、Gemini 3.0 Pro、Qwen3 Coder Plus 等高级模型。

主要特点

- 统一访问:通过标准的

OpenAI 兼容协议,用户只需配置一次即可访问 Gemini、Claude、Qwen Code 等主流大型模型。

- 多协议智能转换:支持在

OpenAI、Claude 和 Gemini 协议之间的智能转换,便于跨协议模型调用。

- 高效的调度管理:支持多账户轮询和自动故障转移,确保服务的高可用性(

99.9%)。

- OAuth 认证机制:利用

OAuth 机制打破服务限制,提高请求的速率和配额。

- 模块化架构:基于策略和适配器模式的模块化设计,使得添加新的模型提供者变得简单。

- 实时监控与管理:提供

Web 用户界面,允许实时配置、健康状态监控和请求日志查看。

- 支持最新的模型:无缝支持最新的大型模型,如

Claude 4.5 Opus、Gemini 3 Pro 和 Qwen3 Coder Plus。

应用场景

- AI 开发:开发者可以高效地连接和利用多种大模型,简化开发过程,减少集成多个

API 的复杂性。

- 教育与研究:教学机构或研究者可以使用此工具快速访问各种

AI 模型,提高研究效率。

- 企业应用:企业可以利用

AIClient-2-API 在产品中集成多种 AI 功能,创造可扩展的应用案例。

- 技术爱好者:对技术感兴趣的用户可以利用此工具进行个人项目,探索各种

AI 技术及其实现。

AIClient-2-API 通过统一管理和访问多种 AI 模型,极大提高了开发效率,适用于技术开发、教育研究等多个领域。

安装

在群晖上以 Docker 方式安装。

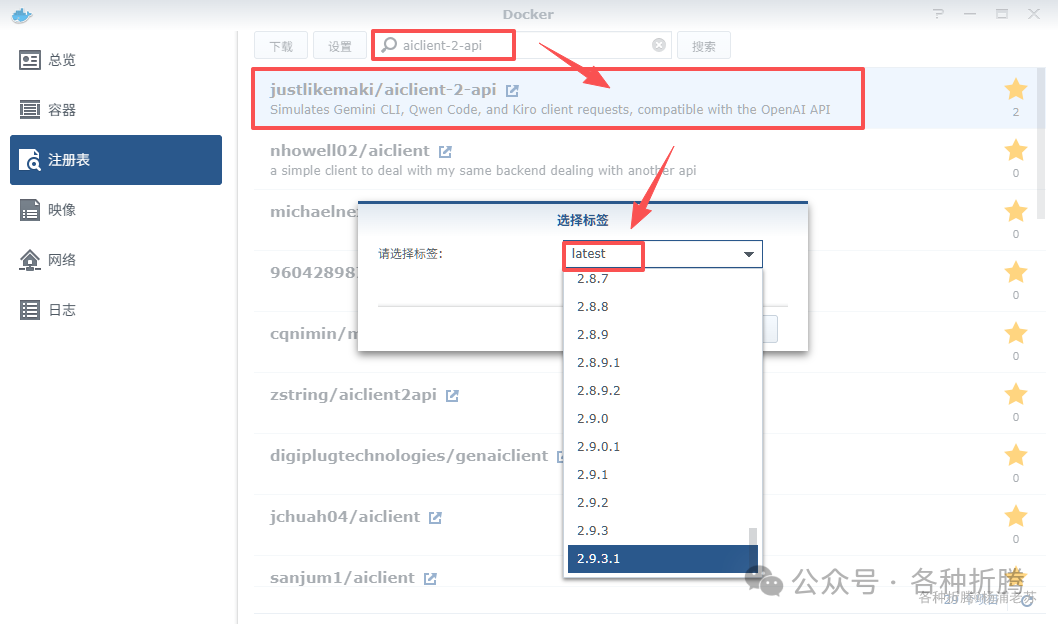

在注册表中搜索 aiclient-2-api ,选择第一个 justlikemaki/aiclient-2-api,版本选择 latest。

在撰写本文时, latest 版本对应为 2.9.3.1;

卷

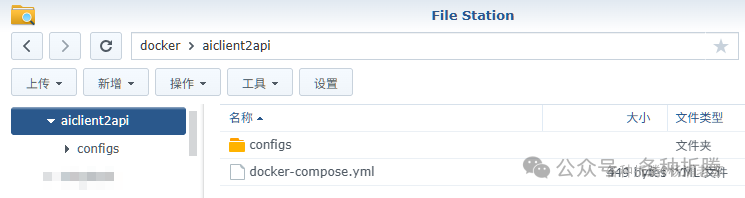

在 docker 文件夹中,创建一个新文件夹 aiclient2api,并在其中建一个子文件夹 configs

| 文件夹 |

装载路径 |

说明 |

docker/aiclient2api/configs |

/app/configs |

存放项目配置等数据 |

端口

本地端口不冲突就行,不确定的话可以用命令查一下

# 查看端口占用

netstat -tunlp | grep 端口号

| 本地端口 |

容器端口 |

说明 |

3645 |

3000 |

Web UI 的端口 |

8085-8087 |

8085-8087 |

OAuth 回调端口(Gemini: 8085, Antigravity: 8086, iFlow: 8087) |

1455 |

1455 |

Codex OAuth 回调端口 |

19876-19880 |

19876-19880 |

Kiro OAuth 回调端口(19876-19880) |

假设你没有 Codex,可以不用映射 1445,其他的道理是一样的

命令行安装

如果你熟悉命令行,可能用 docker cli 更快捷

# 新建文件夹 aiclient2api 和 子目录

mkdir -p /volume1/docker/aiclient2api/configs

# 进入 aiclient2api 目录

cd /volume1/docker/aiclient2api

# 运行容器

docker run -d \

--restart unless-stopped \

--name aiclient2api \

-p 3645:3000 \

-p 8085-8087:8085-8087 \

-p 1455:1455 \

-p 19876-19880:19876-19880 \

-v $(pwd)/configs:/app/configs \

justlikemaki/aiclient-2-api:latest

也可以用 docker-compose 安装,将下面的内容保存为 docker-compose.yml 文件

version: '3'

services:

aiclient-2-api:

image: justlikemaki/aiclient-2-api:latest

container_name: aiclient2api

restart: unless-stopped

ports:

- "3645:3000"

- "8085-8087:8085-8087"

- "1455:1455"

- "19876-19880:19876-19880"

volumes:

- ./configs:/app/configs

healthcheck:

test: ["CMD", "node", "healthcheck.js"]

interval: 30s

timeout: 3s

start_period: 5s

retries: 3

然后执行下面的命令

# 新建文件夹 aiclient2api 和 子目录

mkdir -p /volume1/docker/aiclient2api/configs

# 进入 aiclient2api 目录

cd /volume1/docker/aiclient2api

# 将 docker-compose.yml 放入当前目录

# 一键启动

docker-compose up -d

运行

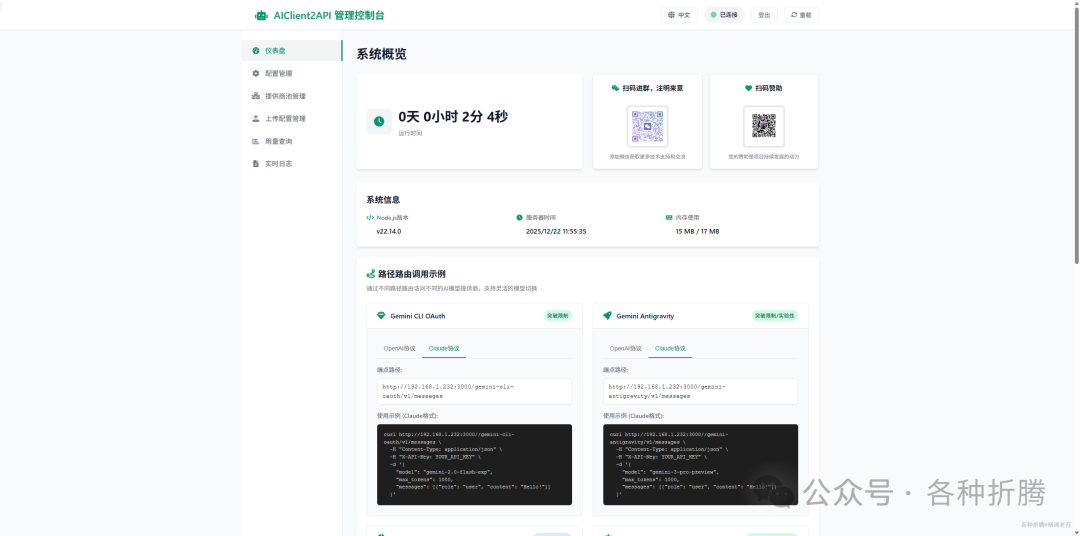

在浏览器中输入 http://群晖IP:3645 就能看到登录界面

默认密码 admin123,可通过 pwd 文件修改

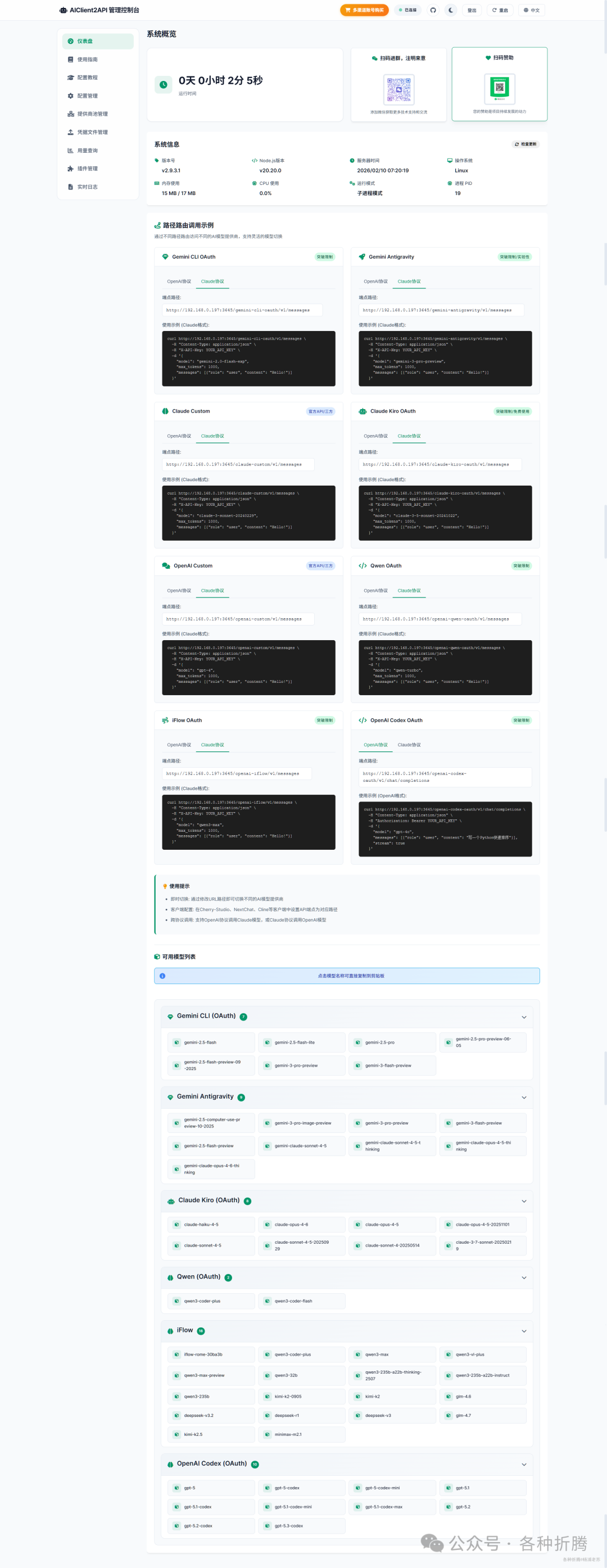

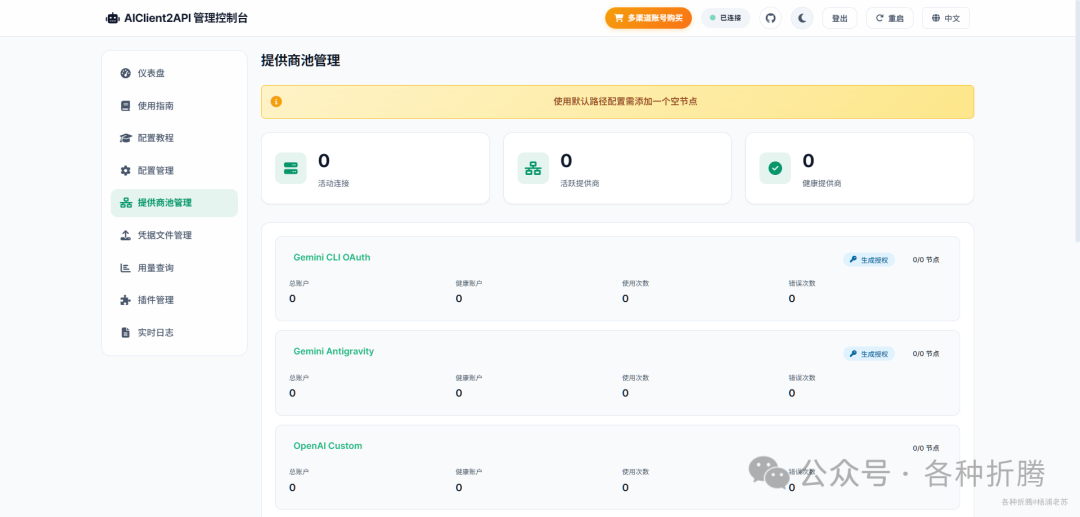

登录成功后的主界面

进入 提供商池管理 界面,选择需要添加的服务商的类型

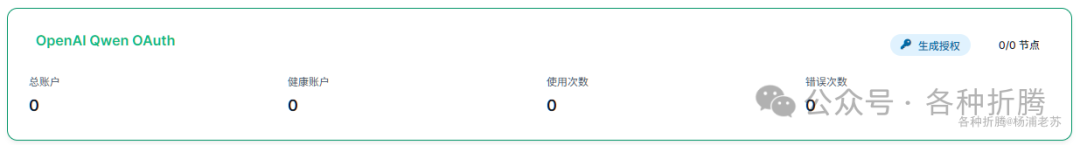

openai-qwen-oauth

qwen 有免费额度

复制授权链接

在浏览器中打开链接,并授权

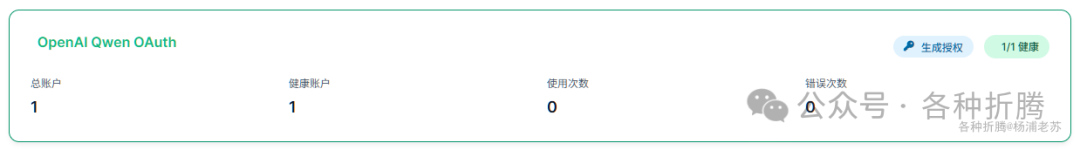

授权成功之后,就会有账号显示

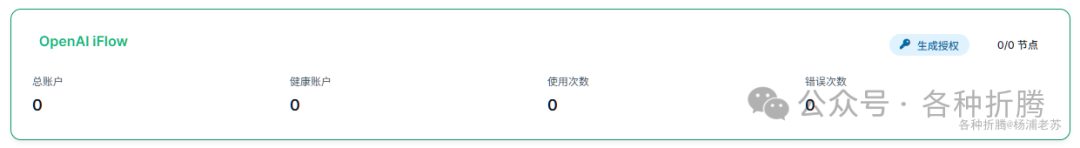

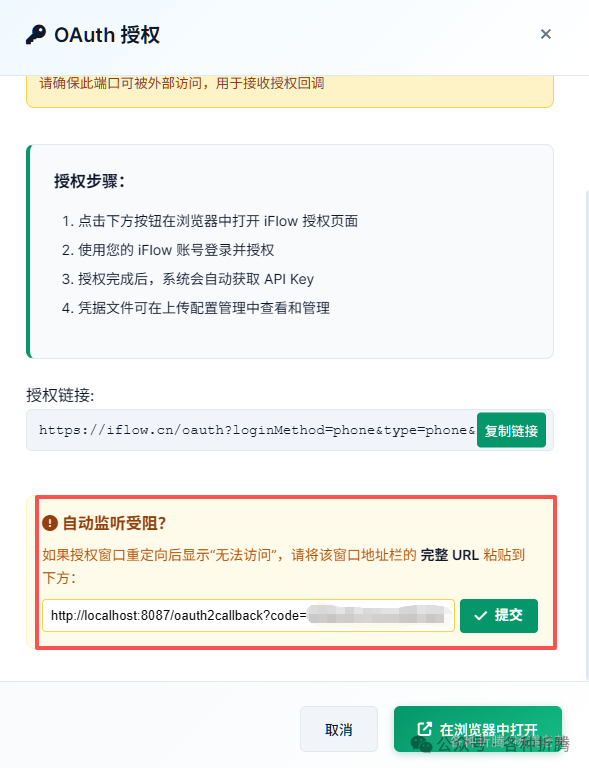

openai-iflow

iflow 也是阿里家的,但是模型比千问多

复制授权链接

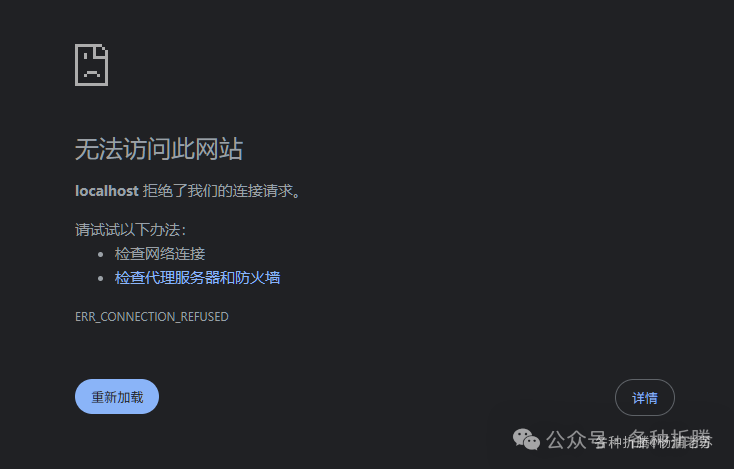

如果回调失败

复制浏览器中的完整 URL 地址,粘贴到👇下面并提交

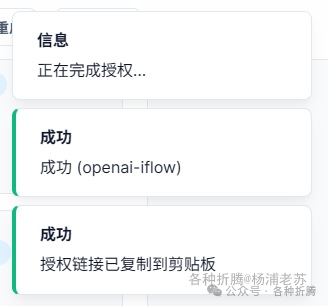

右上角会有提示

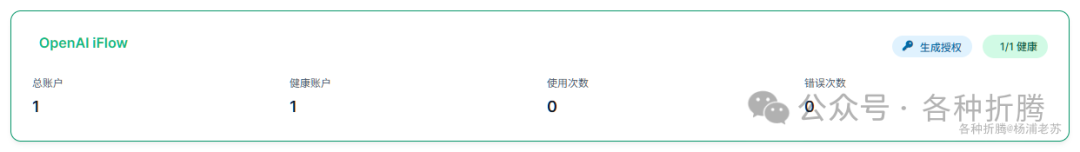

如果成功,就会看到有账号了

配置管理

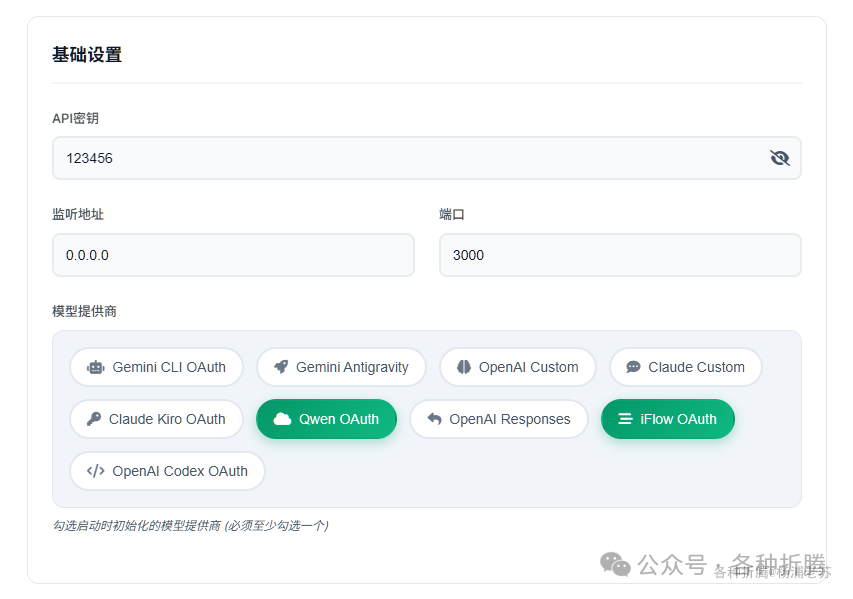

进入 配置管理 --> 基础设置,勾选我们设置了的 Qwen 和 IFlow

【注意】:

API 密钥 为配置文件中的 REQUIRED_API_KEY,其他客户端访问时需要填的 API Key;- 一定要下拉到底,保存配置,否则不会生效;

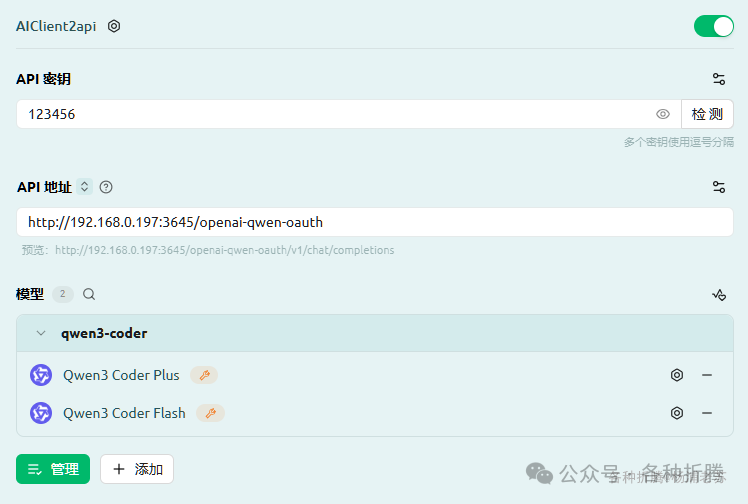

Cherry Studio

如果在 Cherry Studio 中使用

API 密钥:为上一步中设置的 API 密钥API 地址:为 http://群晖IP:3645/{provider}

根据仪表盘中的示例,qwen 的 provider 为 openai-qwen-oauth

而 iflow 的 provider 为 openai-iflow

所以如果你用 qwen 可用模型有两个

而用 iflow 可用的模型就多一些,囊括了国内主流的模型

除此之外,也可以用于 OpenClaw ,或者 Claude Code、OpenCode 等编程工具

参考文档

justlovemaki/AIClient-2-API: AIClient2API:本地代理Gemini CLI和Kiro 客户端,兼容OpenAI API,每日千次免费请求。通过API轻松接入任何客户端,让AI开发更高效!

地址:https://github.com/justlovemaki/AIClient-2-API

AIClient-2-API

地址:https://aiproxy.justlikemaki.vip/zh/

通过以上步骤,你就可以在群晖 NAS 上成功搭建自己的大模型统一代理服务了。利用 Docker 部署的方式简化了环境配置,而 AIClient2API 的 Web 管理界面则让模型和账户的配置变得直观。无论是想免费体验 Qwen 的编程能力,还是通过 iFlow 接入更丰富的国内模型,这个方案都提供了一个灵活统一的入口。如果你在部署过程中遇到问题,或者想了解更多 AI 与云原生的实战技巧,欢迎到 云栈社区 与更多开发者交流讨论。