大数据通常以其经典的“4V”特征被定义:海量的数据规模(Volume)、高速的数据产生与处理速度(Velocity)、多样的数据类型(Variety),以及其中蕴含的巨大价值(Value)。

提到数据处理,许多人的第一反应可能还是Excel。的确,对于日常办公和小规模数据,它游刃有余。但一旦数据量突破百万行,表格就会变得异常卡顿,甚至直接崩溃无法打开……这并非软件故障,而是触及了个人计算工具的处理边界。

问题的核心在于,其规模已远超个人工具的处理极限。Excel的百万行上限,在面对企业级TB、PB量级的业务数据时,显得微不足道。要对如此海量的数据流进行实时分析和高效率管理,传统单机工具已然力不从心。

这正是大数据技术与现代服务器集群系统发挥作用的地方。它们如同数据世界的“超级工厂”,通过分布式架构的设计,从根本上突破了单台计算机的物理极限,从而实现对海量数据的可靠存储与智能价值挖掘。

那么,一个根本性的问题是:为什么单台计算机的能力会存在如此明确的上限?

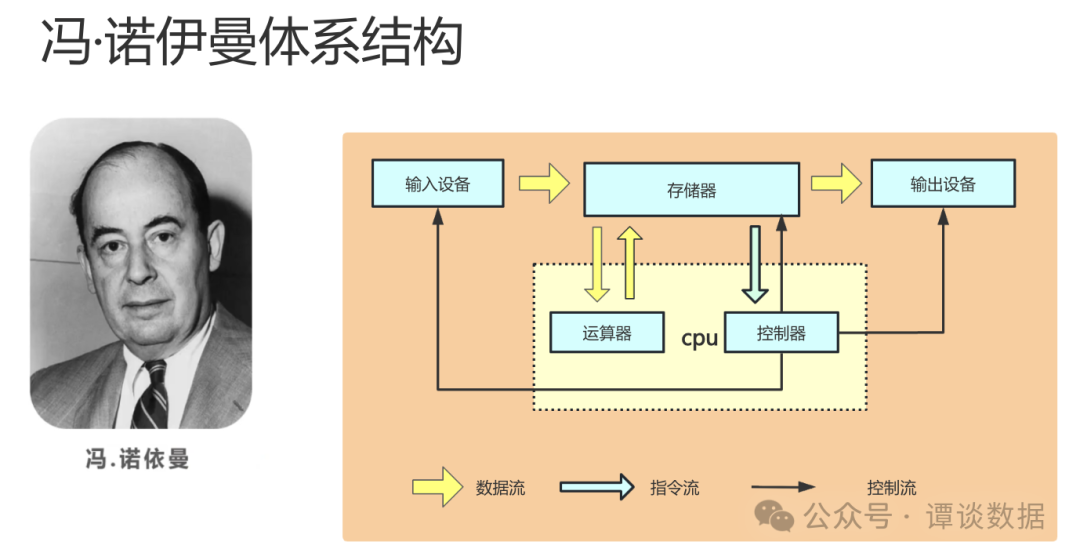

要理解这一点,我们需要回溯到近80年前提出的、至今仍是现代计算机基石的——冯·诺依曼体系结构。

冯·诺依曼架构的核心是“存储程序”思想:计算机由运算器、控制器(合称CPU)、存储器、输入和输出设备组成。程序指令和数据都以二进制形式统一存放在存储器中。CPU的工作,就是周而复始地从存储器中取出指令、解码,然后执行。

这种“读取-解码-执行”的串行工作模式,在面对大数据处理的需求时,会暴露出几个关键瓶颈:

🔴 内存墙:数据搬运的效率制约

在冯·诺依曼架构中,CPU与内存(存储器)在物理上是分离的。尽管现代CPU的运算速度极快,但所有需要处理的数据都必须通过总线在CPU和内存之间来回搬运。当数据量剧增时,数据搬运的速度会远远跟不上CPU核心的处理速度,从而形成一道著名的“内存墙”(Memory Wall)。此时,CPU大部分时间都在空闲等待数据,无法实现高效能比。

🔴 顺序执行:制约并行处理能力

该架构下的程序指令默认需要串行执行,由一个程序计数器(PC)严格控制指令顺序。即便后续指令所需的数据已经准备就绪,也必须排队等待前一条指令执行完毕。而海量数据的高效处理,其灵魂恰恰在于大规模并行计算。这种固有的串行机制,直接扼杀了通过并行化来提升效率的可能性。

🔴 硬件天花板:纵向扩展的性价比陷阱

试图通过提升单台计算机的硬件配置(例如更换更快的CPU、扩充更大的内存)来提升性能,这种思路被称为“纵向扩展(Scale-up)”。然而,这条路很快就会触及物理与经济的双重极限。如今,CPU主频的提升、集成电路的集成度都已逐渐逼近硅材料的物理天花板。更重要的是,硬件升级的成本会随着性能提升呈指数级增长,单纯依靠升级单机硬件的路径,性价比越来越低。

理解了冯·诺依曼架构的这些根本性限制,就不难得出结论:当数据规模持续爆炸式增长时,换一台更强大的单台计算机并非明智之举。这也自然引出了大数据时代的核心应对策略——分布式计算,而这正是服务器集群登场的关键原因。

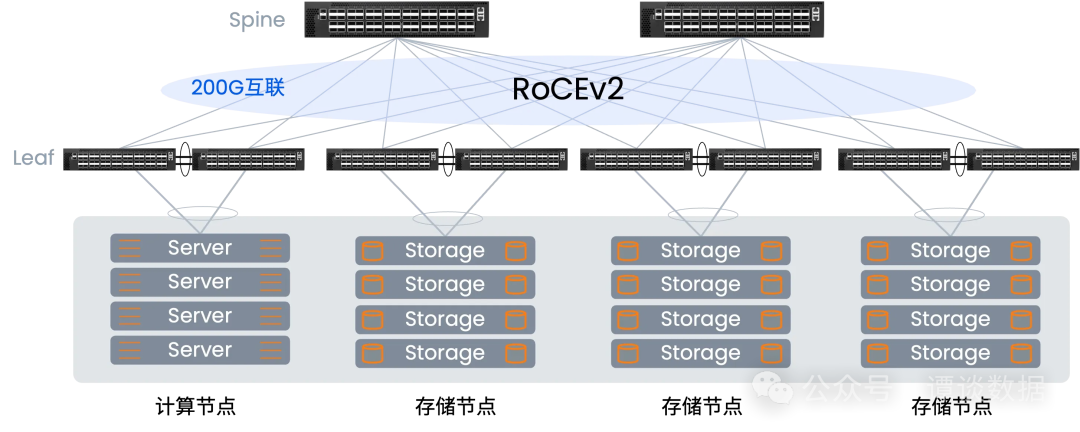

上图展示的,便是支撑高性能数据中心的“核心骨架”——一套分工明确、协同高效的服务器集群与网络互联结构。正是依靠这样的系统,才能稳稳承接住大数据处理的海量需求。

整个架构主要由三层关键组件协同支撑:

🔴 计算节点

这本质是由大量标准服务器组成的“计算团队”。面对海量计算任务,它们摒弃了单机作战的模式,采用“分而治之”的策略:将庞大的计算任务拆解成无数个可并行处理的小任务,由成百上千台服务器同时开工处理,从而在整体上实现了远超任何单台超级计算机的算力。

🔴 存储节点

由多台专业存储设备(或服务器)构成的“存储池”。其核心智慧在于“分布式存储”:将海量数据切分成数据块,分散存储在不同的物理设备中。这不仅解决了单台设备容量不足的问题,系统还会自动为每个数据块创建多个副本,分散存放。即使某一台或多台存储设备发生故障,数据也不会丢失,在可靠性上实现了质的飞跃。

🔴 高速交换网络

这是连接所有计算与存储节点、确保数据高速流通的“大动脉”。现代数据中心普遍采用叶脊(Spine-Leaf)网络架构,专门解决传统网络在扩展性上的瓶颈:

- Leaf(叶交换机):位于每个机柜顶部的“本地枢纽”,直接连接本机柜内的所有服务器和存储设备,负责汇聚本地的数据流量。但它受限于机柜空间和端口密度,无法无限扩展。

- Spine(脊交换机):网络的核心骨干,所有Leaf交换机都上行连接到多台Spine交换机,形成一个全互联的骨干网络。

采用“叶-脊”二级结构的核心目的,就是为了实现优雅的横向扩展(Scale-out)。当需要增加服务器时,只需增加新的机柜及顶部的Leaf交换机;当Leaf交换机数量增多导致上行带宽不足时,则增加Spine交换机的数量。在这种架构下,任意两台服务器之间的通信,最多只需要经过1台Spine交换机和2台Leaf交换机,路径确定且最短,能够为大规模数据交换提供稳定、高带宽、低延迟的网络支撑——这是整个大数据处理体系得以流畅运转的生命线。

数据中心网络不仅仅是大数据集群的“地基”,它本身也是当今计算机网络领域最前沿、最活跃的方向之一。尤其在人工智能浪潮的推动下,GPU的大规模集群应用对网络提出了前所未有的挑战,也催生了从传输协议(如RoCE)、计算架构到存储模式的系列变革。

这些由GPU等新型计算单元驱动的具体变化,以及它们如何进一步重塑硬件系统的形态,将是另一个值得深入探讨的话题。对这类底层架构技术感兴趣的朋友,可以关注云栈社区的“智能 & 数据 & 云”板块,那里有更多深入的讨论和技术资源分享。