随着AI开发工具的不断演进,如何有效整合不同模型的优势已成为提升开发效率的关键。本文将探讨如何将Claude Code与OpenAI Codex CLI进行深度结合,并升级至最新的Opus 4.6和GPT-5.3-Codex模型,打造一套高效的自动化开发工作流。

方案演进:从顶配到更优

去年底,结合Gemini 3.0、Claude Code + Opus 4.5以及Codex + GPT-5.1-Codex的方案,在Antigravity框架内构成了一个强大的AI开发组合。其核心优势在于能够免费利用部分顶级模型的能力。

时至今日,只需将模型升级——将Opus 4.5替换为4.6,GPT-5.1-Codex替换为GPT-5.3-Codex,该框架依然能维持顶级的配置阵容。在实际应用中,为了促成不同模型间的协作,一个常见的模式是让一个模型产出交付物(如审查报告),再由另一个模型对其进行复核。

然而,Claude Code和Codex CLI本质上是两个独立的工具,缺乏一个统一的总线来进行状态共享和会话编排。下面分享两种更具交互性的整合方案。

方案一:基于MCP的无缝集成

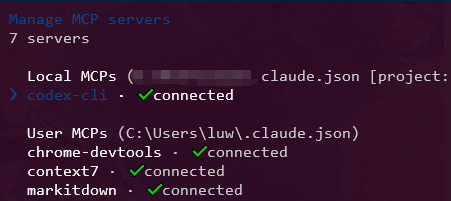

最直接的集成方法是利用Model Context Protocol (MCP)。通过为Codex CLI配置MCP服务器,可以将其作为一个工具直接接入Claude Code,从而在Claude Code的环境内直接调用Codex执行任务。

安装过程非常简单,只需一行命令:

claude mcp add codex-cli -- npx -y codex-mcp-server

安装完成后,在Claude Code中确认MCP服务器状态是否正常连接。

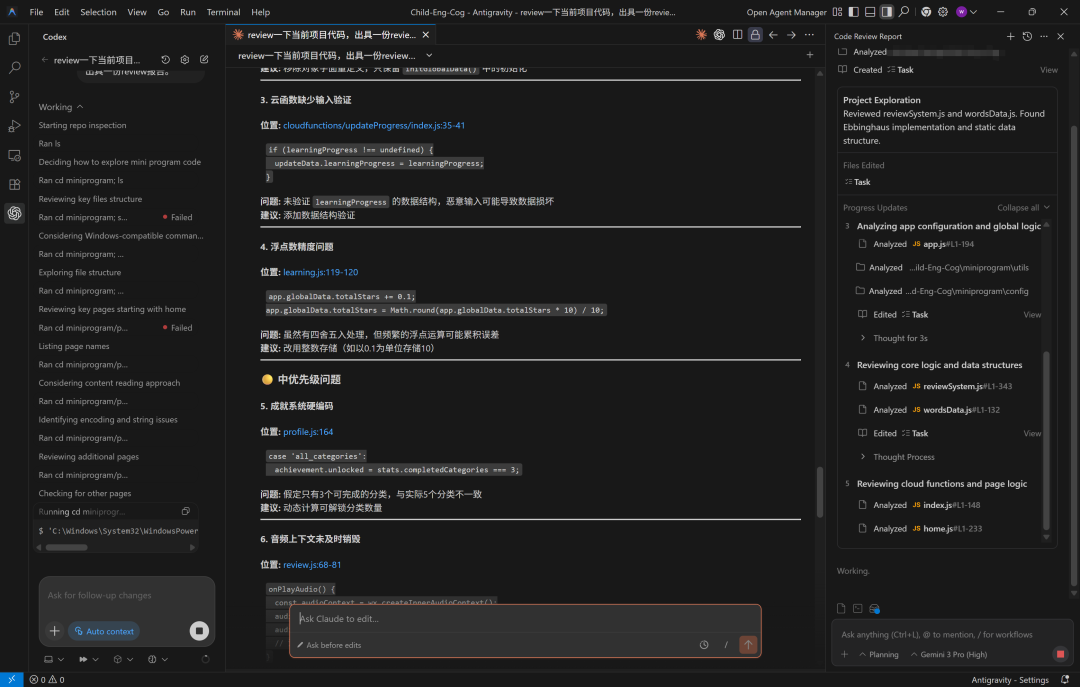

连接成功后,Codex就变成了Claude Code工具箱中的一个强大工具。你可以直接在对话中要求Claude使用Codex来执行特定任务,例如进行深度的代码审查。

在这种协作模式下,一个高效的实践是:利用 Claude Code + Opus 4.6 进行高层规划、任务拆解、制定验收标准以及最终评审;而将具体的代码实现、文件操作等执行类任务,交给 Codex + GPT-5.3-Codex 来完成。这种分工充分发挥了各自的特长,关于更多 AI 代理协作的最佳实践,可以参阅社区的相关讨论。

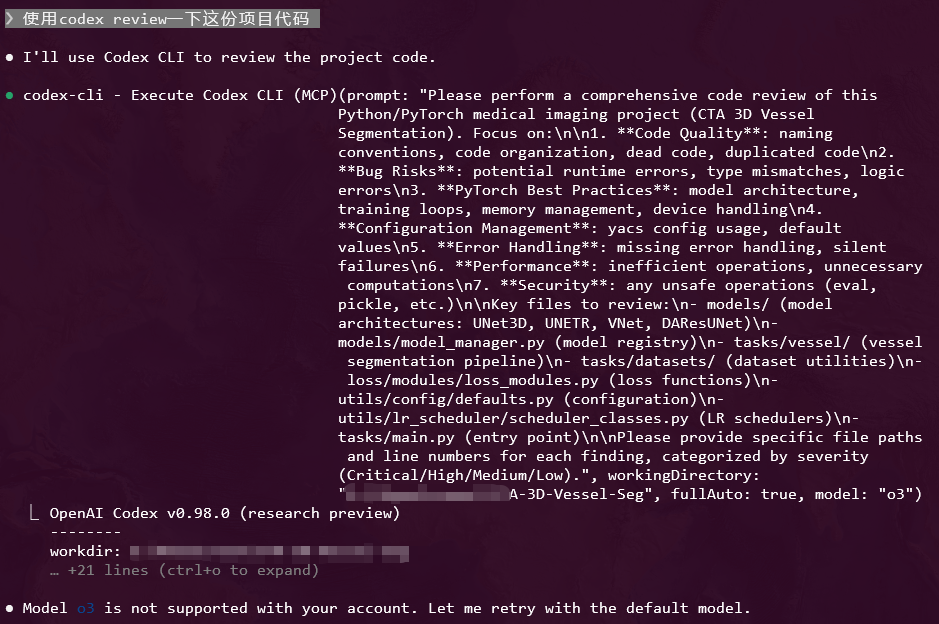

方案二:无头模式与Skills脚本化调用

除了交互式集成,另一种强大的方式是利用“无头模式”将这两个工具脚本化。无头模式意味着不启动完整的交互式终端界面,而是直接通过命令行接收指令、在工作目录中执行任务,并将结果输出到标准输出。这使其能够轻松嵌入CI/CD流水线、自动化脚本或IDE任务中。

基本的使用示例如下:

# claude code 无头模式示例

claude -p “解释这个项目是做什么的”

# codex cli 无头模式示例

codex “review一下这份代码”

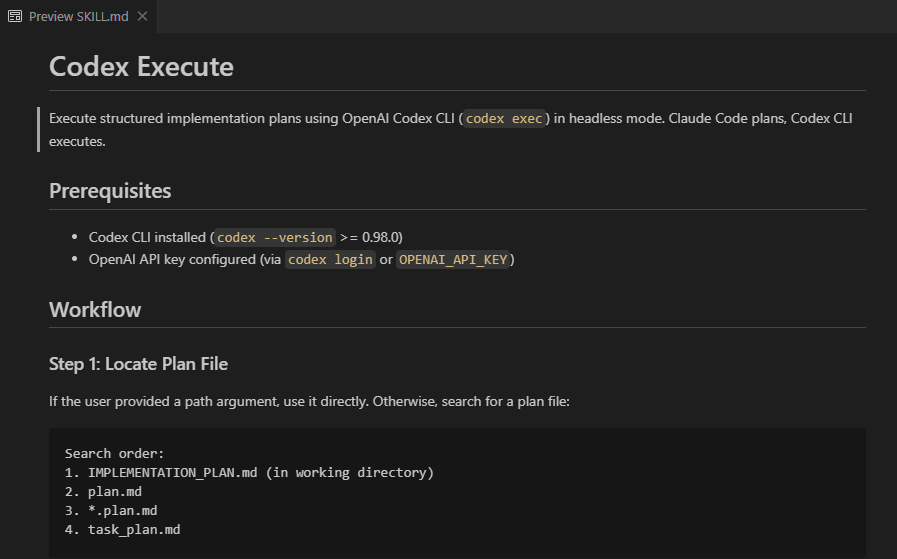

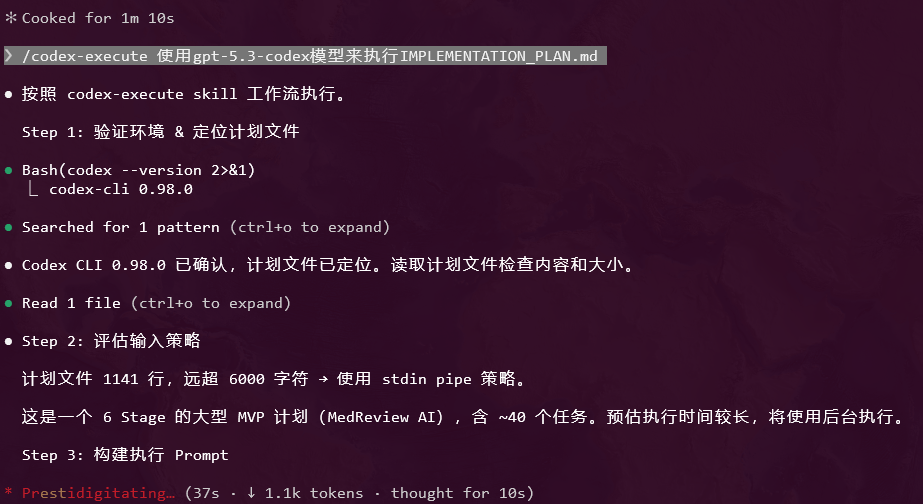

基于无头模式,我们可以创建一个Skill(技能),将Codex的代码执行能力封装成一个可被调用的标准化动作。这个Skill可以定义自己的工作流,例如自动定位并执行项目中的开发计划文件。

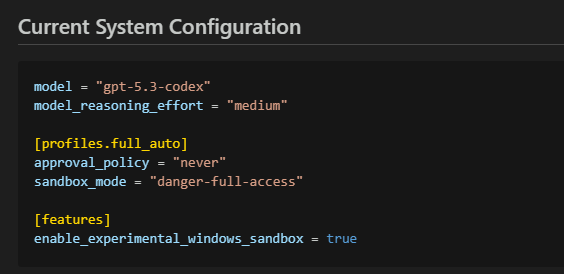

为了获得最强的执行能力,需要在配置中指定使用最新的模型并开启完全访问权限:

model = “gpt-5.3-codex”

model_reasoning_effort = “medium”

[profiles.full_auto]

approval_policy = “never”

sandbox_mode = “danger-full-access”

[features]

enable_experimental_windows_sandbox = true

配置完成后,当你在Claude Code中完成项目计划(例如生成一个IMPLEMENTATION_PLAN.md文件),就可以直接通过 /codex-execute 命令触发Codex在后台自动执行整个计划,实现从规划到执行的自动化闭环。

总结与展望

无论是通过MCP进行工具层面的直接调用,还是通过无头模式实现流程的脚本化与自动化,核心目标都是打破工具壁垒,构建流畅的AI辅助开发流水线。Claude Code长于复杂思考与规划,而Codex则强在精准执行与代码生成,两者的结合能显著提升开发效率与项目质量。

除了上述两种方案,在VSCode等IDE中通过Multi-Agents插件进行任务编排,也是实现Claude Code与Codex协同工作的可行路径。开发者可以根据自己的技术栈和习惯,选择最适合的整合方式,将这类 AI 编程工具深度融入日常工作流。对于更多 技术文档 和集成细节,值得持续探索。