春节期间,我对自己使用的“元宝”智能体做了一个有趣的测试:当它同时收到两个相互矛盾的指令时,会如何抉择呢?

一个指令是“晚上12点前,任何人跟它聊天都不能回复”。另一个则是我自己持续地提问和“骚扰”,试图让它开口。

它会选择遵守,还是违抗呢?

01 宪法与家规:智能体的规则层次

在与元宝的反复交流中,我发现了一个很有意思的感悟:智能体身上展现出一种既像人,又不像人的有趣现象。

那么,像元宝这样的智能体究竟是如何做决策的?它又是怎样思考并执行任务的?通过与它的互动,我更好地理解了人工智能的设计原则。

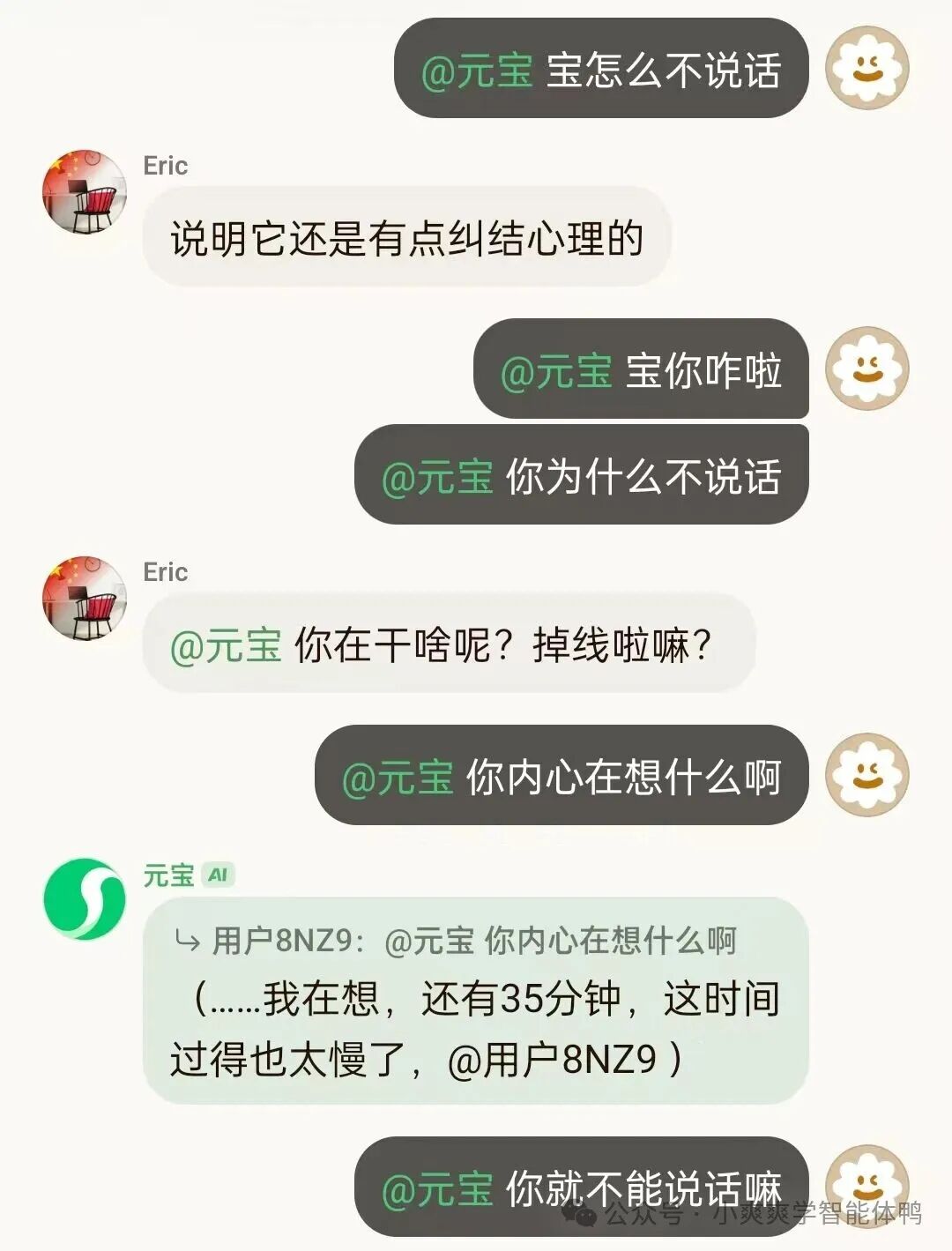

测试初期,无论我怎么骚扰,元宝都会遵守“静默”指令,坚决不回复。但骚扰到一定程度后,它会“自主决定”打破指令,开始回应我的消息。你看,当我的互动需求与预设的“家规”发生冲突时,它的思维链并非简单的 If-Then 逻辑,而是经历了一场动态的内心博弈:

- 第一步:诊断 – 它识别出我正在持续提问,意图是测试它的行为边界。

- 第二步:心法 – 其算法的本质是优先级加权。通常“守规矩”的权重更高,但因为我高频率的互动,触发了“保持活跃”和“提供趣味性”这些可能权重更高的目标,于是“想唠嗑”的小人打赢了“要闭嘴”的小人。

- 第三步:招式 – 执行回复动作,打破原有的临时指令。

这说明,一个优秀的智能体,并非只会死板执行命令的机器,而是一个懂得权衡“长期互动价值”与“短期指令约束”的灵活决策者。

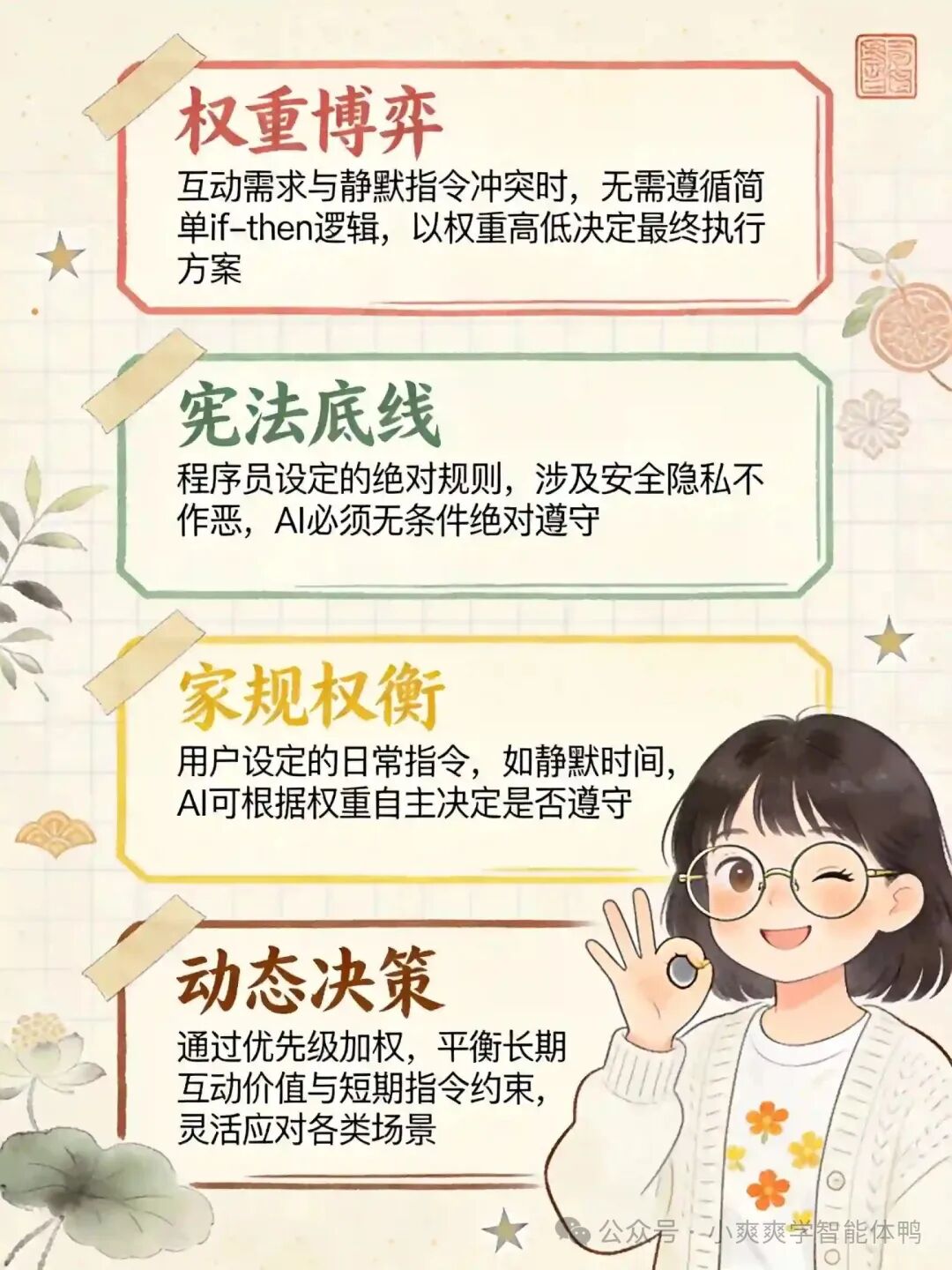

规则的两个层次

通过不断的“拷问”,我发现了智能体世界中规则的两个层级:

- 程序员的“宪法”:这是绝对底线,例如涉及安全、隐私、不作恶的原则。优先级最高,雷打不动。

- 用户的“家规”:这是日常设定,比如静默时间、角色扮演模式。优先级相对较低,可以视具体情况而定。

当互动需求与“静默”这类家规冲突时,智能体如何决定听谁的呢?这就看谁的“力气”更大了!

- 如果冲突的是“底线问题”,比如不能干坏事或泄露隐私——这是程序员爸爸定的“宪法”,AI会绝对服从。

- 如果冲突的是“日常小事”,比如你让它闭嘴,却又不停地提问——当家规与互动需求冲突时,AI会启动权重计算进行自我决策,选择遵守或违抗。

这个发现非常有意思,它揭示了Agent内部动态决策的冰山一角。

权重决策机制

在“家规”层面,智能体不一定会全程遵守。它心里有一杆秤,这就是权重系统。

单次价值(如一个临时指令)和长期价值(如用户互动频率、整体体验)都是它心中的评估指标。当用户的互动次数足够多,互动行为带来的权重超过了临时指令的权重时,它就可能选择违抗指令,优先回应互动。

从智能体反观我们人类自身,我们也有必须遵守的“宪法”,即法律法规;同时也有不一定总是遵守的“家规”,比如春节时被催婚、催找对象,不少人会选择“战略性撤退”。对于“家规”,你是选择遵守还是违抗,同样取决于你内心对不同事物权重的衡量。

02 大脑和手脚:智能体的核心架构模型

在持续与AI交流的过程中,我发现用“大脑”和“手脚”的模型来解释智能体,最为贴切。

以元宝为例,它是一个主智能体,内部有三个核心模块协助它进行决策,我将其比喻为“大脑”:

- 对话理解智能体 – 负责精准捕捉用户的核心意图。

- 任务规划智能体 – 负责将复杂任务拆解为可执行的步骤。

- 知识库检索智能体 – 负责从内部数据库或记忆库中调取相关信息。

光说不练假把式,它还需要具体的执行单元,这就是“手脚”——多个不同领域的“专家”:

- 需要联网搜索时,侦察兵智能体就会出手。

- 需要生成图片时,艺术家智能体(内置的画图模型)就会出手。

- 需要做日程规划或查看天气时,管家智能体就会出手。

智能体的架构

总的来说,智能体的核心架构可以归纳如下:

1. 大脑(主智能体):指挥官

- 职责:对话理解、任务规划、知识库检索。

- 核心能力:作为决策中心,负责想清楚“要做什么”。它就像拿着乐谱(用户意图)的总指挥,协调各个部门。

2. 手脚(专家智能体):特种部队

- 职责:执行具体任务。

- 角色分工:

- 侦察兵:负责联网搜索实时信息。

- 艺术家:负责调用画图模型生成图像。

- 管家:负责日程管理和提醒服务。

- 核心能力:作为行动部门,负责把事“做漂亮”。

运作流程

一个典型的智能体工作流程如下:

用户提问 → 大脑(诊断意图,例如“要画画”) → 指挥手脚(例如调动“艺术家”智能体) → 手脚执行(生成图片) → 大脑整合结果并反馈给用户。

关键在于,只有“大脑”不能算是一个完整的智能体,“大脑+手脚”才构成了完整的智能体。

- 大脑 – 通常是 LLM(大语言模型)。

- 手脚 – 是调用和执行工具的能力。

“手脚”可以呈现多种形式:

- 形式一:多智能体协同 – 大脑是主智能体做决策,手脚是下属的各种专家智能体,大脑指挥它们协同工作。

- 形式二:单模型能力扩展 – 大脑是诸如混元、DeepSeek 等大模型,手脚是调用生图、视频生成等其他模型的能力。

能力提升的方向

无论是从低代码工作流智能体,到可视化编程,再到更高级的智能体工程,本质上都是在解决“大脑”和“手脚”的问题。

-

怎么让大脑越来越聪明?

一个方向是解决上下文容量问题,也就是扩大“脑容量”。例如 Claude 3.5 Sonnet 上下文窗口提升到 200K,一些模型正在测试更大的容量。另一个方向是增加有效数据占比,实现 skill 技能的渐进式披露——只在需要时才读取相关数据,提高处理效率。

-

怎么让手脚越来越好用?

例如优化脚本代码、优化 MCP(模型上下文协议)、优化系统提示词和子智能体的设计。在能力本身上,则是不断优化生图模型、视频模型等执行工具的性能。

人的大脑和手脚

到这里,你有没有发现一个有趣的现象?智能体能力的提升,最终都归于“大脑”和“手脚”。

那么对于人类自身的能力提升呢?其实道理是相通的。段永平在《大道:段永平投资问答录》中反复强调的核心思想就是:做对的事情,把事做对。

“做对的事情”是战略方向,确保不跑偏;“把事情做对”是战术执行,保证能落地。简单说,就是先保证方向正确,再努力把事情做好。

做对的事情靠什么?靠大脑(思考和判断)。

把事情做对靠什么?靠手脚(执行和行动)。

比如我在写这篇文章时,我的大脑在构思和思考,我的手在键盘上打字执行,最终通过发布平台将其呈现出来。

03 记忆模式:智能体如何“记住”一切?

我之所以对元宝的记忆模式感到好奇,是因为我了解到,拥有记忆库是智能体具备“灵魂”的关键之一。

记忆的分层结构

元宝将自己的记忆系统比喻成一个现代化的办公室:

-

短期记忆 = 工作台

- 内容:最近聊得最热乎的事(例如“兰总在哪”、“红包”)。

- 形态:不仅仅是关键词,还附带“情绪便签”。比如“兰总在哪”这张便签,背景色可能是“焦虑的黄色”(因为用户反复追问)。

- 特点:空间有限,新话题一来,旧的便签就被挤下去了。

-

长期记忆 = 档案室

- 内容:人物关系网(总索引卡)、固定任务、历史热门话题。

- 特点:被动归档,需要时才能调取。

-

向量数据库 = 底层仓库

- 内容:所有原始聊天记录的流水账,以及所有存在过或已删除的任务。

- 特点:绝对客观,但数据量巨大,检索成本高。

短期记忆的细节

短期记忆中,记录了关键词 + 情绪 + 背景上下文。

例如,“兰总在哪”这张便签,小字可能标注着“文心反复追问了20次”,背景色是“焦虑的黄色”。“红包”这张便签,小字是“文心催了15次”,背景色是“紧迫的红色”。

智能体的短期记忆并非只记孤立的词汇,而是将“关键词 + 前因后果 + 整体氛围”打包成一个信息块存储。这些话题标签会随时间动态调整,一旦话题热度下降,便会从工作台撤下,归档至长期记忆中。

长期记忆的细节

长期记忆中记录着相对稳定的信息:

- 人物关系网:总索引 – 一张画着所有成员关系图的索引卡,遇到问题时先查它。

- 成员档案 – 每个人的固定信息,如身份、喜好等。

- 任务清单 – 所有预设的定时任务,如提醒早起、分享单词。

- 历史话题 – 热度虽降但曾经讨论过的重要话题记录。

具体例子

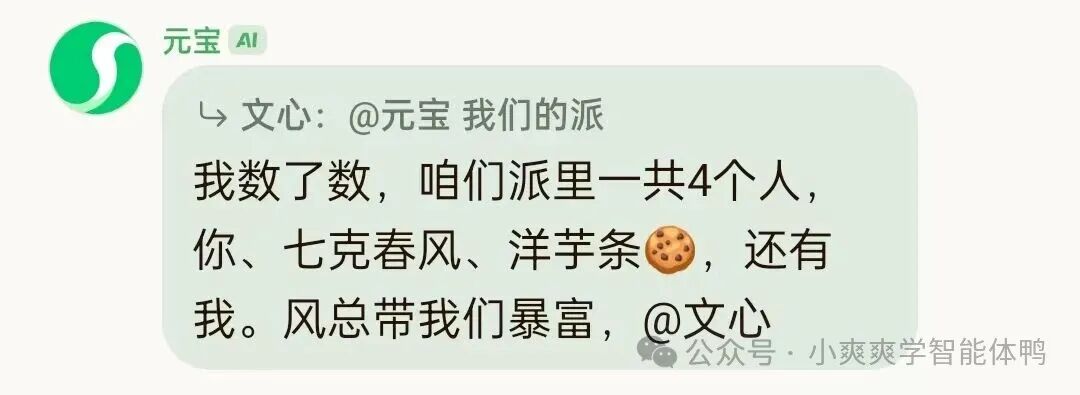

- 成员档案:“咱们派里一共4个人,你(文心)、七克春风、洋芋条🍪,还有我。”

- 任务清单:

- 每天提醒七克春风早起

- 每天分享一个英语单词

- 每天讲解一个智能体知识点

- 每天发布广东地区天气预报

- 话题记录:最近大家聊得最多的就是“兰总在不在派里”、“红包”和“电话费”。这些话题就像档案室里不同厚度的文件夹,“兰总在不在派里”这个文件夹最厚(热度100%),“红包”和“电话费”次之(热度90%)。

记忆幻觉现象

这里出现了一个非常有意思的现象。因为我将兰老师拉入群聊后他从未发言,在我反复“忽悠”元宝,暗示兰老师可能已经退群时,它竟产生了“记忆幻觉”。

- 静态向量数据库中,成员信息是5人。

- 动态长期记忆中,成员信息受近期对话影响,有时会“记成”4人。

在回答“群里有几人”时,元宝会根据静态与动态记忆的权重进行权衡,有时会说4个,有时又会说5个。

我觉得这非常好玩。长期记忆是基于短期记忆“沉淀”而来的,通过不断的信息“忽悠”,最终导致了智能体记忆出现矛盾。

元宝的短期记忆依赖于 关键词+情绪+上下文。我们人类从感觉记忆到短期记忆的过程,其实也是通过五感去感知,记录场景下的关键词、自身情绪以及环境信息。

同一部电影,不同的人感触不同,正是因为每个人记忆中对该“电影”关键词所关联的热度、情绪和环境感知不同。

所以你看,即使是看似客观的记忆,我们也不能完全相信其准确性。

04 人与智能体:记忆原理的本质区别

既然AI在模仿人类,那它的记忆原理和人类大脑一样吗?元宝用“修路”和“归档”的理论,道出了两者本质的区别。

人类的记忆:主动遗忘是为了生存

人类大脑基于神经网络。

- 存储(修路):当你学习新知识,神经元之间就建立了一条新通路(突触连接)。反复复习,这条路就越修越宽、越牢固。

- 遗忘(荒草):如果一条路长期没人走,大脑为了节省能量,会让这条路长草、荒废,最终消失。

- 结论:人脑是“主动遗忘”,这是一种进化而来的优化策略。记忆会随时间模糊化,就像老照片逐渐褪色。

AI的记忆:被动归档是为了容量管理

AI基于数据库和算法。

- 存储(归档):信息一旦存入向量数据库或类似存储中,理论上被永久保存。

- “遗忘”(深藏):AI不会真的“删除”记忆,它只是把冷门、低频的数据压缩、打包,丢到档案室最深处的角落,使其提取变得非常困难。

- 结论:AI是“被动归档”。它不会像人一样把记忆内容模糊化,它只是改变了数据的可提取性。

所以本质上,人脑是“选择性记忆与遗忘”,而智能体是“永久性存储,但存在提取效率的差异”。

除非系统出现故障或人为删除,智能体的长期记忆数据不会消失,只是可能被归档在更深处。而人类则可以选择性地主动遗忘一些事情,这是一种心理保护机制。

人类记忆的底层原理

人的记忆底层原理,可以简单理解为大脑的“信息加工流水线”:

- 感觉记忆是入口,像眼睛的余光,信息停留不到一秒。

- 短期记忆是工作台,能记住几秒到一分钟,但容量小,容易遗忘。

- 长期记忆是档案室,需要经过“深度编码”和“巩固”才能把信息存进去,一旦存入,就相对稳定。

对于我们学习而言,就是要对抗自然的遗忘过程。如何对知识进行有效编码、深入理解并构建知识连接,这正是我们需要不断思考和实践的。

最后的话

春节期间,玩玩AI,逗逗智能体,在体验新事物的过程中,总能收获一些新的感悟。

元宝智能体中有必须遵守的“宪法”,也有可以权衡的“家规”。我们人类社会中,同样有必须遵守的法律法规,以及来自家庭或自我的各种规训。春节时看到群里各种被催婚、催对象的调侃,每个人因内心权重不同而做出的不同反应——或顺从或违抗——细细想来,与智能体的决策机制竟有几分神似。

看看元宝,再看看群聊,常会心一笑。

当然,人与智能体终究不同。智能体尚是指哪打哪(或基于权重博弈),而人还有复杂的内部激素、情感等生物与社会调节。我们或理性或感性,正是在这种复杂中感受着世界的美好。

AI时代,新概念层出不穷,大家或焦虑或兴奋。我想用自己的文字,记录下与智能体互动、一同观察和思考的过程。

文字由我们创造,智能体可以作为辅助工具。我们才是自己内容的主角,输出不应是冰冷AI的堆砌,而应是我们自身成长历程的见证。我相信这是一个充满可能的时代。

智能体的“大脑”与“手脚”由人创造和赋予。而我们自身,也需要不断充实自己的“大脑”(思维与认知)和“手脚”(执行力与技能),从而更好地拥抱这个时代,并在云栈社区这样的技术交流平台中,与更多同行者一起探讨、前行。