字数 1389,阅读大约需 7 分钟

几天前,一家公司把大模型直接写入芯片(ASIC),推理速度达到惊人的 17000 Token/s,相当于1秒生成30页A4纸的内容。更关键的是,其耗电量和使用成本比主流英伟达显卡方案降低了整整10倍!

这一幕,不禁让人回想起比特币的历史:一场围绕算力效率的军备竞赛,似乎正在AI领域重新上演。

从CPU到ASIC:比特币矿工的“进化史”

故事要从2009年说起。比特币诞生之初,所有人都用普通的CPU挖矿,大家站在同一条起跑线上。

但很快,局面被改写。专门针对显卡(GPU)优化的挖矿软件出现,算力随即暴涨,CPU迅速被淘汰出局。

真正的颠覆发生在2012年,第一批ASIC矿机横空出世。凭借极高的能效比,它们几乎在一夜之间让显卡矿工的优势荡然无存。

从此,比特币挖矿的舞台上,CPU和GPU黯然退场,只剩下效率至上的ASIC矿机。

什么是ASIC?

ASIC,全称是 Application-Specific Integrated Circuit,即专用集成电路。要理解它,不妨先看看它与CPU、GPU的根本区别:

- CPU(中央处理器):告诉我怎么做,我一步步运行指令,重复一万次。

- GPU(图形处理器):告诉我怎么做,我把一条指令同时运行一万次。

- ASIC(专用芯片):不用告诉我怎么做,电流流过,结果自然产生。

ASIC的核心在于,它将“怎么做”这件事,直接固化在了芯片的物理结构里。它只为单一任务而生,也只做这一件事。它不再运行程序——它本身,就是程序。

这就像CPU中的加法器电路,当两个数字输入,电路自动输出相加结果,无需任何“计算”指令。

AI大模型的“ASIC时刻”降临

比特币挖矿是一种高度重复、结构固定的计算任务。有趣的是,今天大模型的推理过程,本质上也是如此。

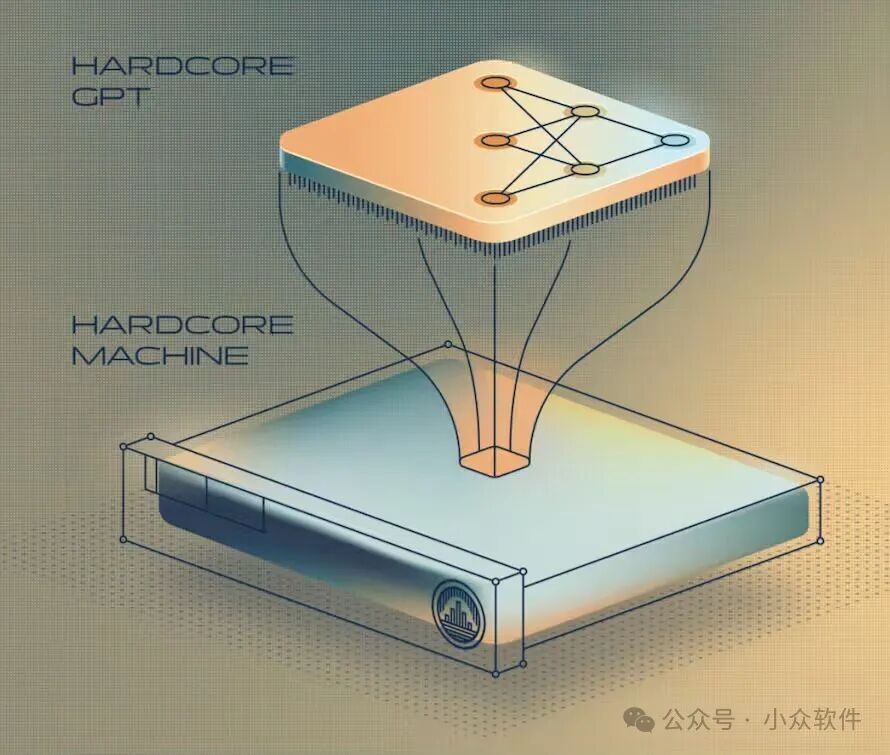

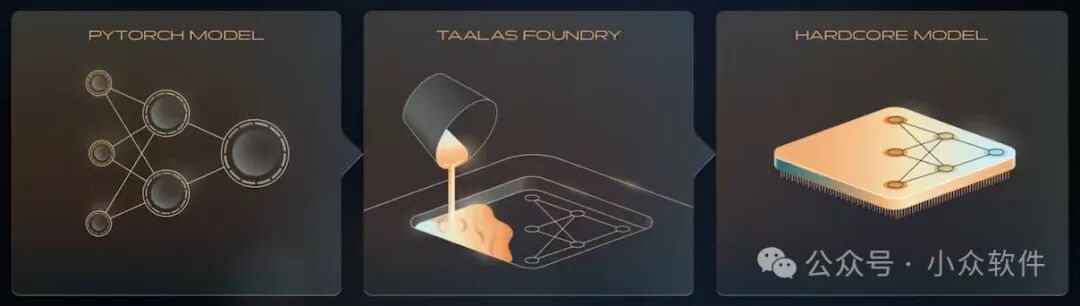

几天前,一家名为 Taalas(https://taalas.com/) 的公司发布了一款能运行 Llama 3.1 8B 大模型的ASIC芯片。他们的做法并非用GPU去加载模型,而是直接将模型的运算过程,“烧录”成了芯片上的物理电路。

这意味着,模型无需再从内存中反复读取参数,因为它已经“长”在了芯片里。

GPU是如何处理大模型推理的?

以 Llama 3.1 8B 为例,它由32个处理层(或称为Transformer块)堆叠而成,可以理解为32道工序。

当你输入一句话时,它会被转换成一串数字(向量)。这串数字需要依次通过这32道工序:每一层都要从显存中读取参数、进行计算,再把结果写回显存,如此反复32次,最终输出结果。

这个过程就像用软件精修一张照片:

- 第一步,调整亮度

- 第二步,调整对比度

- 第三步,增强边缘清晰度

……

最终,你得到一张处理后的精美照片。

Taalas如何将大模型“刻”进芯片?

如果这32道工序的流程和参数是固定的,为何不直接把它做成硬件电路呢?

Taalas的答案就是这样做的。 他们将Llama 3.1的32层结构,按顺序物理地“刻”在了芯片上。为此,他们还发明了一种名为“神奇乘法器”(Magic Multiplier)的硬件单元,能够用单个晶体管高效执行4位数据的乘法运算。

现在,当用户输入内容被转换为向量后,它直接流入芯片上构成第1层的物理晶体管中。数据通过神奇乘法器完成运算,结果无需写回显存,而是作为电信号沿着设计好的物理线路,直接流入第2层晶体管……如此“流经”全部32层,最终生成输出的Token。

面对巨型模型,单芯片装不下怎么办?

那么,对于像 DeepSeek R1-671B 这样的超大规模模型,一块ASIC芯片显然无法容纳全部参数。

Taalas提出了一个解决方案:使用大约30块定制化的ASIC芯片协同工作,将模型的不同部分分布式地“固化”在不同的芯片上。每块芯片依然是硬连线的专用设计,只负责整个模型推理流程中的一个模块。

即使在这种分布式架构下,模拟结果依然极具竞争力:

- 单用户推理速度约 12,000 token/秒

- 每生成100万token的成本约 7.6 美分

- 总成本大约是使用同等GPU方案的一半

未来属于ASIC吗?

不一定。

ASIC的代价在于极端的专用性。芯片一旦流片生产,其功能就固定了。如果模型架构升级或参数更新,可能就需要重新设计、生产芯片。

- GPU是“多面手”,可以运行任何模型。

- ASIC是“偏科生”,只能运行被刻进去的那一个模型。

因此,未来的格局可能会呈现一种分工:

在用户应用层面,直接使用针对热门模型定制的ASIC进行推理,以获得低廉的成本、极致的速度和超低的能耗。

而在研发和训练层面,GPU将重回其核心舞台,专注于模型的训练、实验和复杂的通用计算任务,去孕育下一代大模型。

但有一点可以肯定:当“智能”被直接刻进硅片,算力战争的游戏规则,已经进入了全新的维度。

这会是AI的“矿机时刻”吗?

当年,许多显卡矿工不愿相信ASIC会最终胜出。然而,当利润足够庞大时,效率终将战胜通用性。

今天,大模型的推理正在迅速演变为一种标准化、规模化的重复计算任务。历史反复告诉我们:当一种计算任务变得足够标准、足够庞大,它终究会被固化到硅片之中,以实现极致的效率。

这一次,轮到了AI。

引发的思考与疑问

如果模型真的被“刻”进芯片,一系列新的问题也随之浮现:

- 算力会变得更加集中吗?

- 中小型公司是否还能参与这场游戏?

- 开源模型的发展空间会受到挤压吗?

- 计算霸权是否会再次集中到少数巨头手中?

我们正身处这场深刻变革的进程之中。关于未来算力格局的更多深度讨论,欢迎在技术社区持续交流与探索。你对AI硬件发展有何见解?是时候思考未来了。

原文链接:https://www.appinn.com/asicai-mining-machine-era-gpu-obsolete/