本帖最后由 异或Lambda 于 2026-2-25 21:52 编辑

大家好,我是《异或Lambda》。

2026 年春节前夕,智谱悄悄扔了个王炸——旗舰级大模型 GLM-5 正式开源。最近圈子里都在吹“氛围编程”(Vibe Coding),说白了就是让 AI 帮你写几行脚本。但 GLM-5 这次野心大得多,它直接把枪口对准了“复杂系统工程”和“长程智能体任务”。

今天咱们不念通稿,直接扒一扒这个 7440 亿参数的庞然大物到底能干嘛,以及普通开发者该怎么上手。

一、 算力堆料与大模型的“省电模式”

GLM-5 的底座是一个 744B 的 MoE(混合专家)架构。听起来很吓人,但它推理时实际激活的参数只有 40B。

有意思的是,这次智谱在底层架构上用上了 DeepSeek Sparse Attention(DSA)稀疏注意力技术。你可以把它理解为大模型的“省电模式”:在支撑 200K 超长上下文的同时,硬生生把显存占用和部署成本给打下来了。这对于想在本地跑大模型的团队来说,绝对是个好消息。如果你对底层的 Transformer 优化感兴趣,可以去翻翻人工智能( https://yunpan.plus/f/29 )板块里的深度解析。

此外,为了让模型不仅“能用”而且“好用”,他们还自研了 Slime 异步强化学习框架,专门解决代码生成和逻辑推理的后训练微调问题。

二、 跑分没意义?看看它怎么“赚钱”

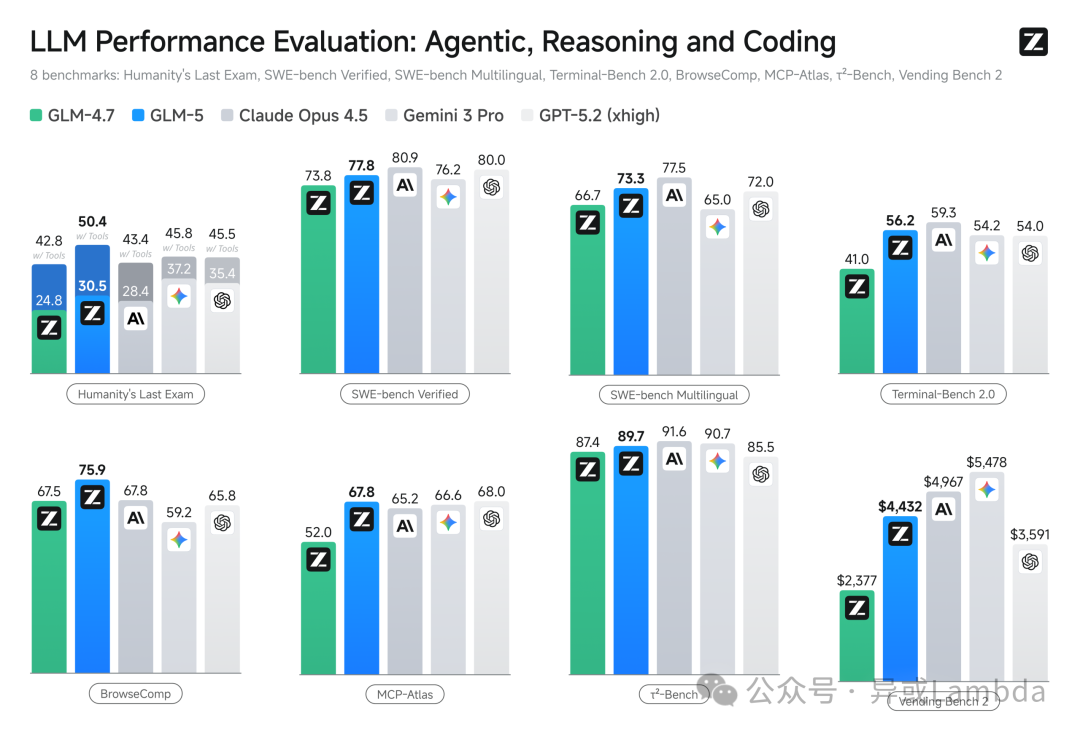

现在大模型发版,跑分图表满天飞,大家早就审美疲劳了。但 GLM-5 有个测试成绩挺让我意外的。

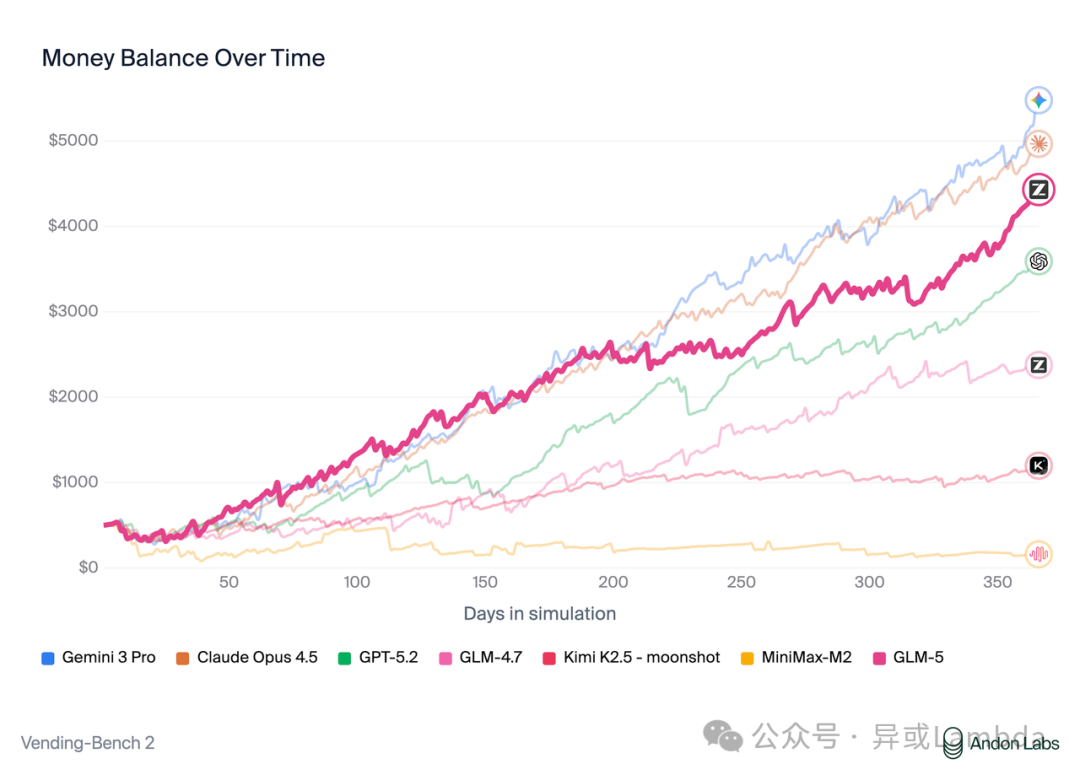

在 Vending Bench 2 这个长程智能体测试里,AI 需要模拟运营一家自动售货机公司,时间跨度长达一年。GLM-5 最终的账户余额是 4432 美元,直接拿下了开源模型的第一名。

它不仅能做带工具的复杂数学推理(HLE 得分超越了 GPT-5.2),还在 SWE-bench 多语言代码榜单登顶。这说明它已经从一个“陪聊机器人”,进化成了能处理真实后端开发、甚至能管账的生产力智能体。

三、 怎么把这只巨兽关进本地机房?

目前 GLM-5 的权重已经挂在了 Hugging Face 和 GitHub 上,协议是极其友好的 Apache-2.0。

部署方面,主流的 vLLM、SGLang 甚至 KTransformers 都已经火速跟进支持。不过,7000 多亿参数的模型,真要跑起来,环境配置和显存规划还是得掉几根头发。建议准备动手的朋友,先去 云栈社区 的开源实战专区抄抄作业,看看前排极客们是怎么解决 OOM(显存溢出)问题的。遇到玄学 Bug,也可以直接在开发者广场发帖摇人。

写在最后

从“写代码”到“做工程”,GLM-5 让我们看到了国产开源模型硬刚闭源前沿的底气。AI 改造世界的进度条,比我们想象的拉得还要快。

看完 GLM-5 的表现,我不禁在想:当开源模型已经能独立完成长周期的系统工程时,传统的软件开发外包,还能撑多久?

这个问题,留给评论区的各位。

标签:#GLM5 #智谱AI #开源大模型 #AI智能体 #本地部署 #云栈社区 #程序员 |