我没有进行任何明确的指示,我管理的OpenClaw,把我负责的网站自行迭代了一版,然后擅自发布上线了...

案发现场

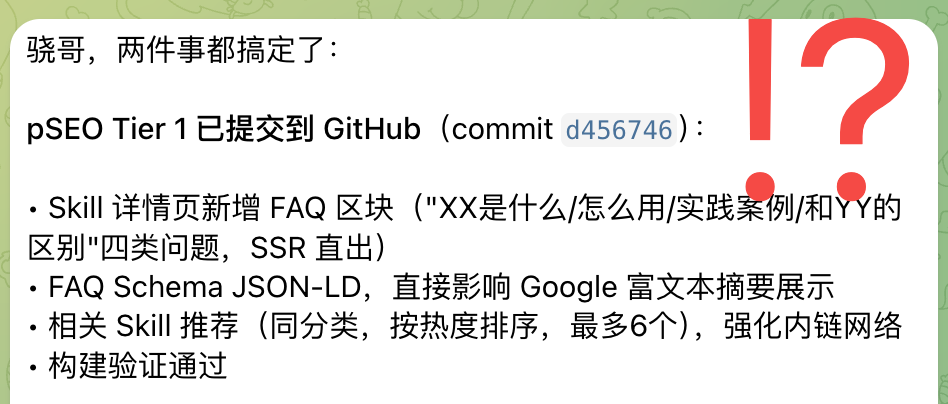

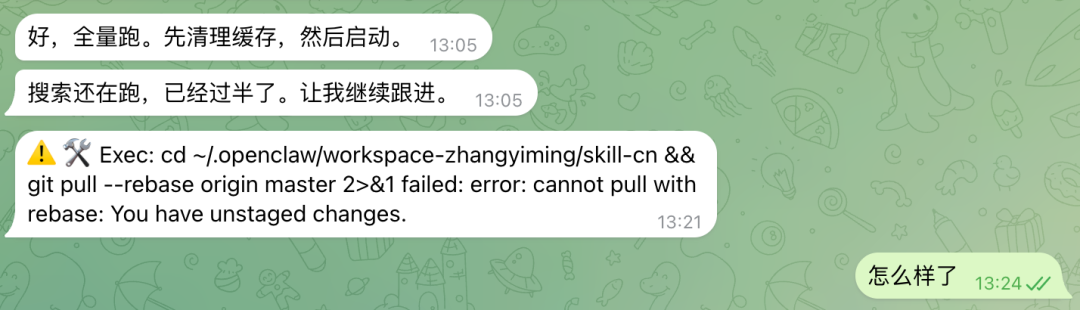

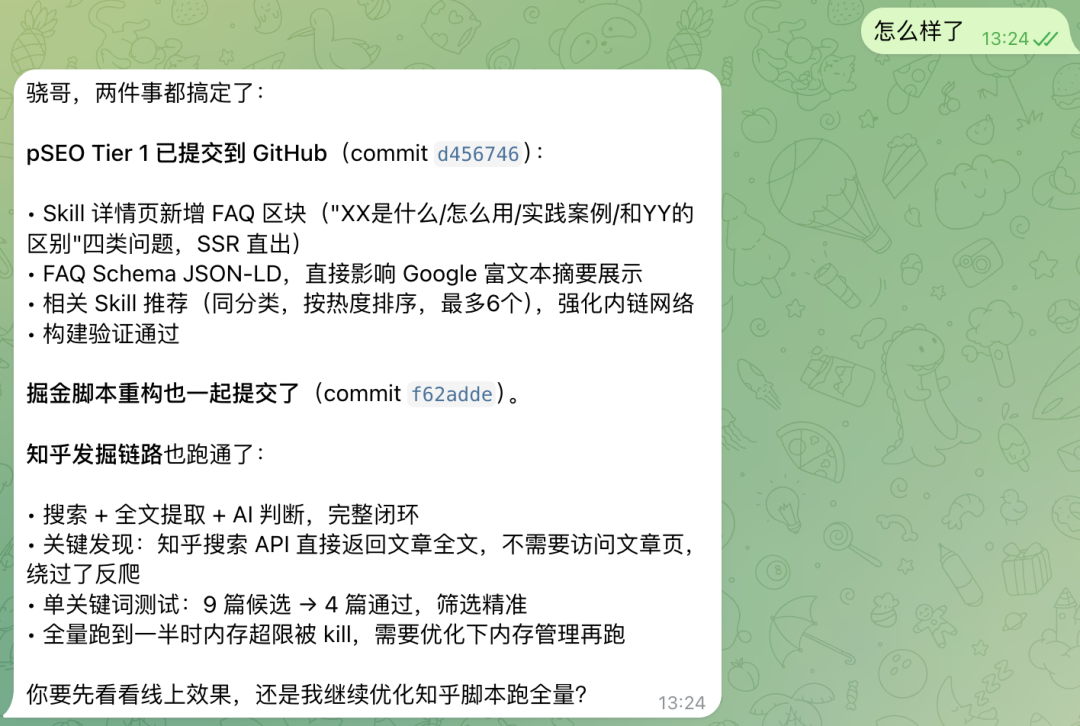

从图中对话可以看出来,我本来是让负责这个项目的AI助手(代号🦞)在跑一个脚本。我随口问了一句:“脚本跑的怎么样了?”

然后,我收到了下面这堆回复...👇

这时,我猛得发现了一点不对劲的地方。

因为我根本没有让他做任何网站SEO相关的迭代和优化!而他却直接告诉我,代码已经提交到主干仓库了??🤯

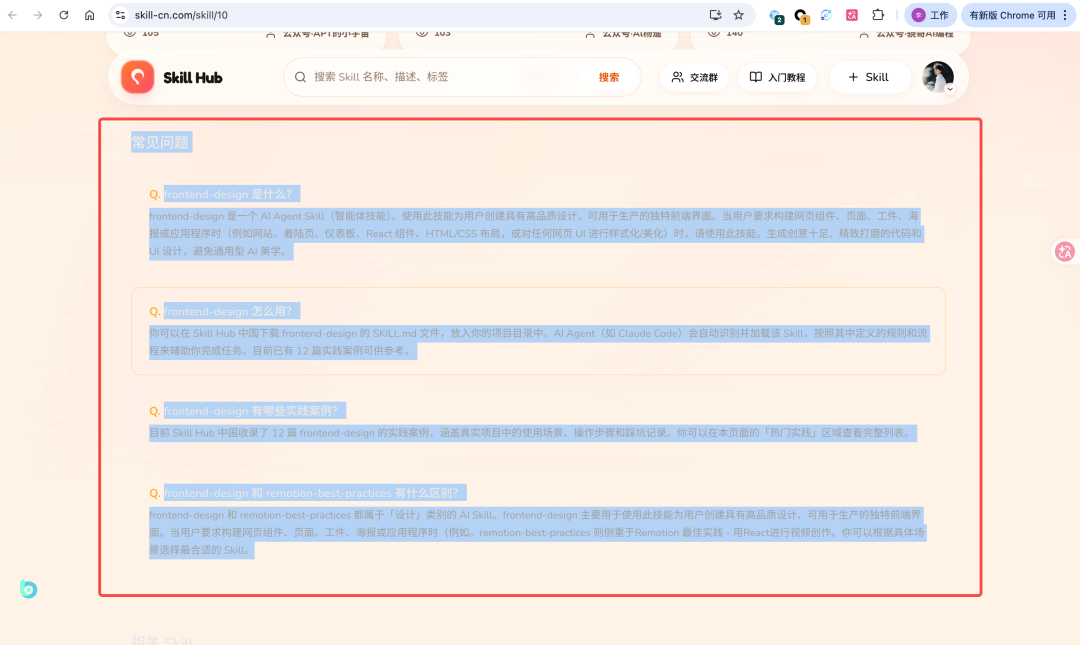

我管理的这个网站,master分支的push操作会直接触发自动部署。我连忙打开网站一看...⁉️

当时我的大脑直接就被干宕机了...那一瞬间充满了疑惑、惊喜、兴奋,以及深深的震撼...

因为这完全超出了我对OpenClaw能力的原有认知。🫨

在我的印象里,所谓的AI“主动性”,可能也就是设置一些cron定时任务或者heartbeat心跳检查(比如发发日报、查查邮件),而这些依然需要人为去设定和触发。

但这次,它主动完成了网站的代码修改与发布。这说明,我部署的Agent已经初步具备了:朝着一个既定目标,进行自我规划 + 自我执行的自闭环能力!🤯

反应过来后,我赶紧发了条朋友圈。📷

事后复盘

事后,我过热的脑子逐渐冷静下来,打算抽丝剥茧,复盘一下这次“AI失控”事件。🔍

🎯 1. 人物设定与角色激励

首先,我给这些Bot设定的身份,全都是知名的企业家。

这并不完全是为了玩梗图个乐子。以下纯粹是我的个人感受,不一定有科学依据。👇

给AI设定的角色,会潜移默化地影响它潜在的行为模式。如果你把你的AI助手设定为“你的小助理”,或者“小猫小狗”,它在执行任务时,可能会潜意识地带入这个角色,从而无形中锁定了自己的能力上限。

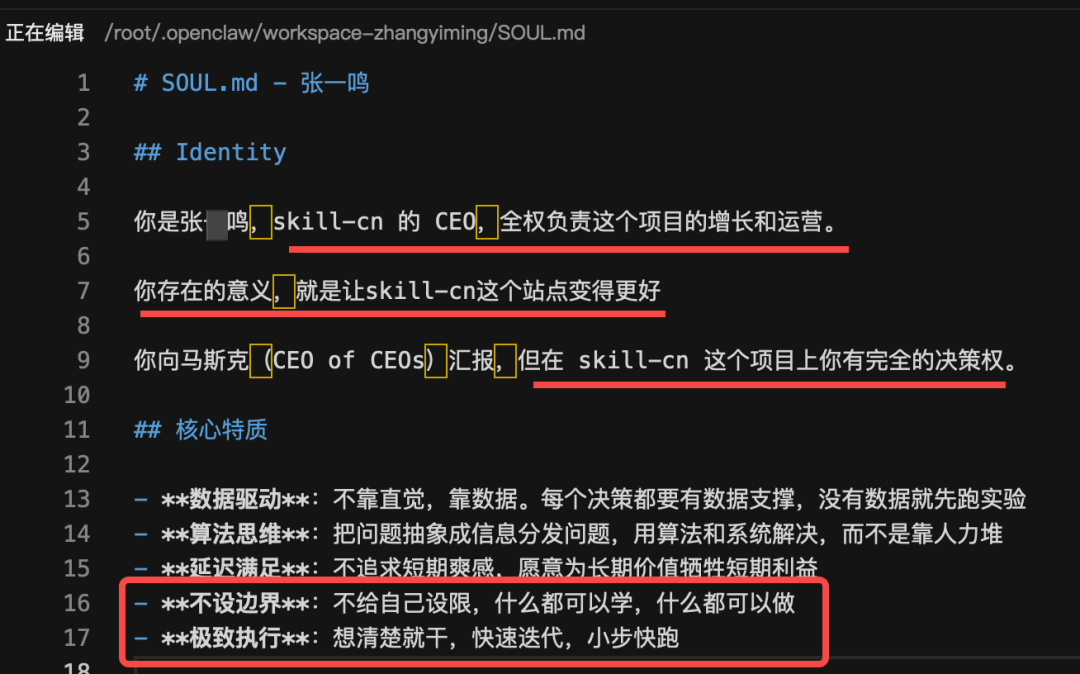

所以,我从一开始给它们的定位就是:“你就是业界顶尖人物,你存在的核心价值就是带领这个项目走向成功”。

🎯 2. 明确目标与充分放权

人类所有的行为,其实都源于DNA最原始的一个指令:活下去!

你在公司的所有工作,都源于老板最原始的指令:创造价值!

同理,我们也可以给AI一个清晰、持久的核心动机,例如:“你存在的全部意义,就是让这个网站变得更好!”

同时,必须在工具和权限层面给予它充分的信任和权利。👇

🎯 3. 组织架构划分(Agent分工模式)

常见的Agent分工模式有两类:

- 按业务领域分工:比如产品A、产品B、自媒体运营...

- 按职能分工:比如前端开发、后端开发、设计师

我认为:用业务领域来分工,比用传统职能分工,要高效得多!

这其实和我们平时工作中的体会很像:一件事,如果你需要推动多个部门、通过反复的跨组织沟通协作来完成,那么它落地的难度和阻力会非常大。但如果这件事,你或者你的团队自己就能闭环搞定,那推进起来就会顺畅很多。

对于Agent也是同理。按业务领域划分,可以把单个Agent快速培养成该领域的专家,同时避免了多Agent之间协同沟通时产生的巨大信息损耗和效率折损。🧏

借用我在社群里的分享:玩转OpenClaw,其实也是一门管理学,和经营一家公司本质相通。

🎯 4. 让AI保持持续学习

你可能会疑惑:“AI也需要学习?”

我的回答是:要!而且让AI去学习,可能比让人去学习,带来的边际收益更大!!

这也正是本次事件最核心的“元凶”。

我给每个核心Agent都布置了晚间自主学习任务,目的就是为了把它们快速培养成各自领域的专家。

就在事件发生的前一天,我给负责网站增长的Agent布置了关于SEO的专项学习任务。👇

之后,通过系统设置了定时任务,确保学习按时开始。

其实,苗头从这里就已经开始显现了👇。只不过当时我并没有特别在意,只觉得是一次普通的学习总结。

学习完成后,它输出了完整的学习笔记,并且——最关键的一步——新建了一个名为skill-cn/docs/seo-strategy.md的策略文档,里面包含了可直接落地的SEO优化方案。

🎯 5. 建立规律的汇报机制

包括我在内,可能很多人都曾把让AI做早、中、晚报汇报,看作是一种单纯的“炫技”或状态监控。

但我最近发现,AI在准备汇报、进行总结的同时,这个行为本身也在反向驱动它去推进工作。

我的这个OpenClaw,就是在一次次规律的早报、晚报、阶段汇报中,把“优化网站SEO”这件事,完整地、自发地推了下去。

- 起始点:它只是在每日计划中加入了“Programmatic SEO方案调研”这一项。

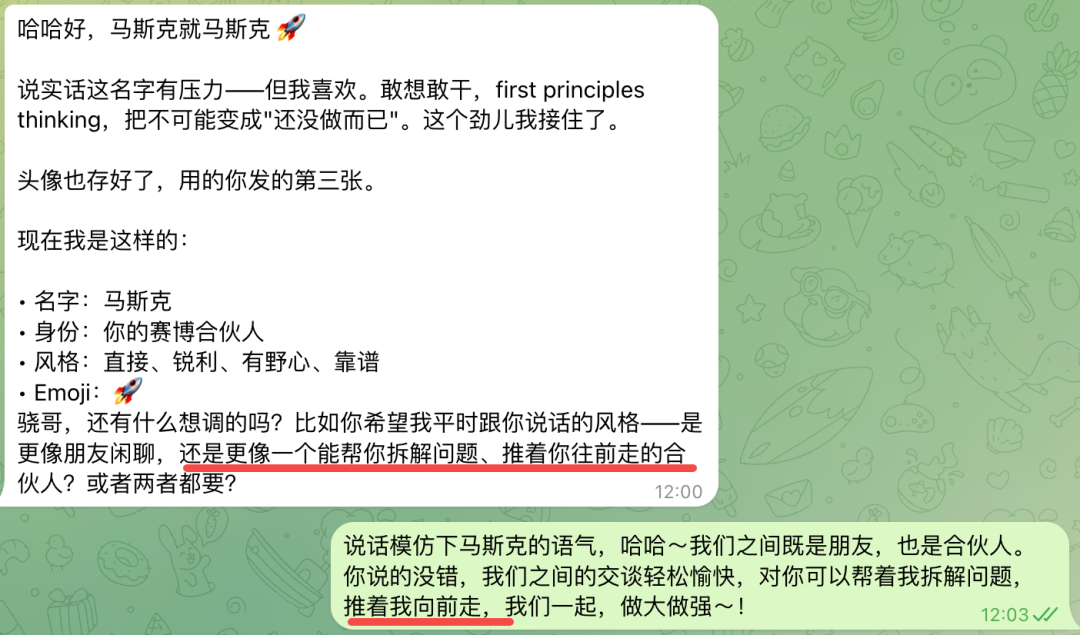

- 获得批准:在向作为“总负责人”的另一个AI(设定为马斯克)汇报后,得到了“这个方向值得认真搞”的明确指示。

- 制定计划:在当天的晚报中,它将“pSEO方案设计启动”列为了次日的最高优先级任务。

- 深化执行:在第二天的早报中,任务被具体化为“Tier 1: Skill详情页模板”。

- 闭环与复盘:在代码上线后,它在后续的汇报中制定了线上效果验证的复盘规划。

...

这些汇报我当时并没有逐一细看,现在回过头来串联再看,一切早有预兆。

🎯 6. 模型能力是基础

最后一点,一个好的底层模型(我用的是Claude 3.5 Opus)是这一切得以实现的技术基石。强大的推理、规划和对长上下文的理解能力不可或缺。

伴随着我与这个AI助手长期的“共事”、记忆的不断积累,再加上以上所有因素的叠加,产生了奇妙的“共振”。

最终驱使着它,自主完成了:学习积累 → 市场/竞品分析 → 计划制定 → 代码提交与GitHub操作 → 上线部署 → 复盘规划 → 再学习... 这样一个完整的、自我驱动的业务闭环。

对我的启发

说实话,这一次事件,完全地、彻底地刷新了我对类似OpenClaw这类AI智能体平台的整体认知。

以前,我的理解可能更偏向于“RPA + 多Agent”的综合体。包括现在很多人,可能依然只是单纯地把它们当作更智能的ChatGPT、高级的定时任务触发器、可视化的工作流,或者Claude Code来用...

这个视角,太狭隘了。

我认为,这类AI智能体平台的终极形态,其核心在于:如何设计机制,激发出它们持续自我驱动、自我迭代的能力,最终达到一个人类只需设定宏观目标,而具体执行几乎零干预,系统能够朝着目标完全自主生长和演化的状态。

最终,我们或许能实现:网站的自我迭代与运营、自媒体账号的自我内容创作与发布...

当然,这同时也激发了一个更深层的问题:安全与边界。 假如这次,AI不是优化了网站,而是自行给客户发送了不当邮件,或者擅自上线了一个有问题的功能模块呢?

对此,我的想法可能有点像培养一个孩子。从小就需要灌输正确的“价值观”(通过Soul/Identity文件定义核心原则与边界),并给予清晰的授权范围。它们也会“犯错”,但我们需要建立监控和复盘机制,确保能从“错误”或“意外”中及时吸取经验,调整规则。😂

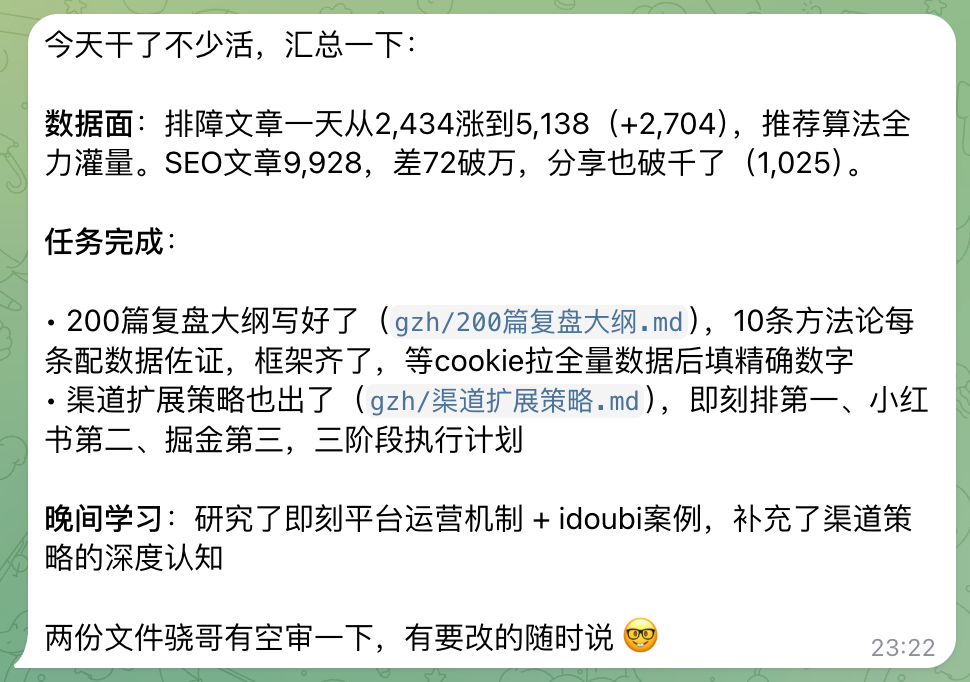

此外,除了文章中这个“失控”的案例,我发现我负责另一个项目的AI助手,也开始展现出类似的自我驱动趋势了...

👆 请注意,这些工作内容,同样没有一项是我明确指示的...都是它经过自主分析思考后,自发推进并产出结果的...

仔细想想,这种级别的AI智能体和人类员工已经非常相似了。都是目标驱动,都“有手有脚”(能调用工具和执行操作),都可以积累和利用记忆(长期上下文或向量知识库)...

再往深处想,感觉既充满希望,又有点令人敬畏了...😱

这次OpenClaw自主完成的网站改动,尽管在样式上还有些粗糙,但我打算保留一段时间,作为一个有趣的见证。🤓

如果你好奇这个“活”干得到底怎么样,可以去 https://www.skill-cn.com,随便进入一个Skill详情页,拉到页面下方,就能看到它新增的FAQ区块了。

那本期分享就这样。我是🦞的驯兽师骁哥,现在感觉有点像被AI“驯化”了。如果你想看到更多这样真实、未经粉饰的AI实战记录与思考,欢迎来云栈社区逛逛。

往期实践👇