对于许多国内开发者而言,部署原版OpenClaw并连接海外API存在一定的网络门槛。本文旨在提供一套纯国产化的OpenClaw搭建方案,整合国内主流云服务与通讯工具,实现稳定、高效且成本可控的部署。

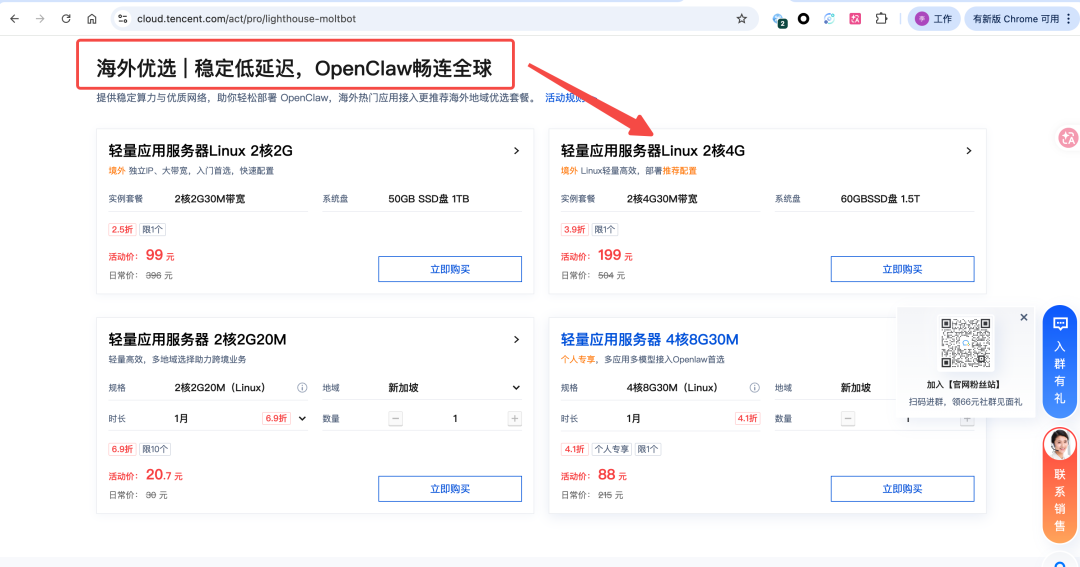

服务器选择:腾讯云轻量应用服务器

服务器是OpenClaw运行的基石。在对比了国内多家云服务商后,腾讯云的轻量应用服务器因其性价比脱颖而出。其2核4G配置的年付活动价仅需199元,而同配置在其他平台往往价格高昂。对于运行OpenClaw这类需要一定计算和内存资源的应用,2核4G是最为推荐的起步配置,2核2G在运行浏览器等任务时容易内存不足。

另一个关键建议是:优先选择海外地域的服务器。原因在于,海外服务器连接国内API(如阿里百炼)通常无障碍,而国内服务器连接海外API则可能受网络策略影响,稳定性欠佳。

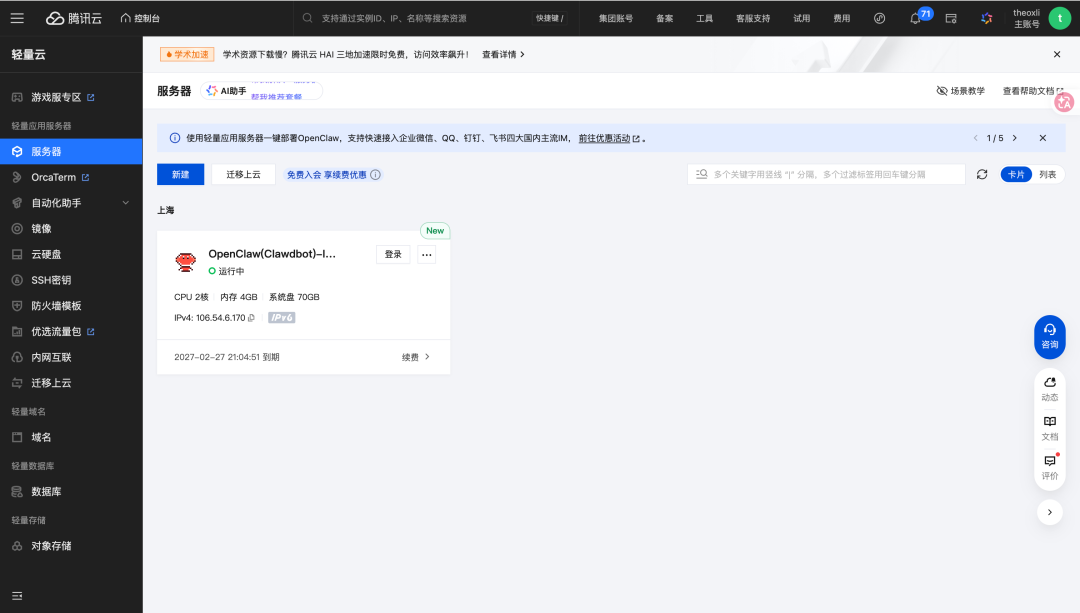

购买完成后,在控制台可以看到已创建的实例。请注意,我们后续将不使用腾讯云提供的这个Web管理面板。

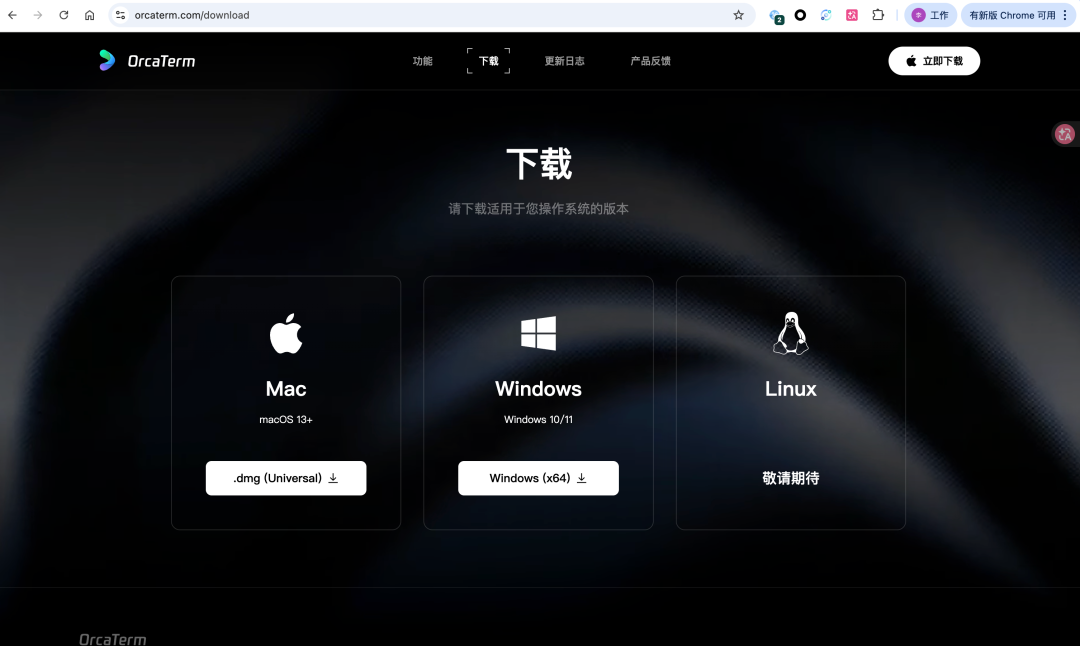

登录服务器:使用 OrcaTerm 客户端

强烈不建议使用网页版终端进行操作,体验不佳且功能受限。推荐下载腾讯云官方的 OrcaTerm 客户端,它提供了更流畅的SSH连接和管理体验。

下载地址:https://orcaterm.com/

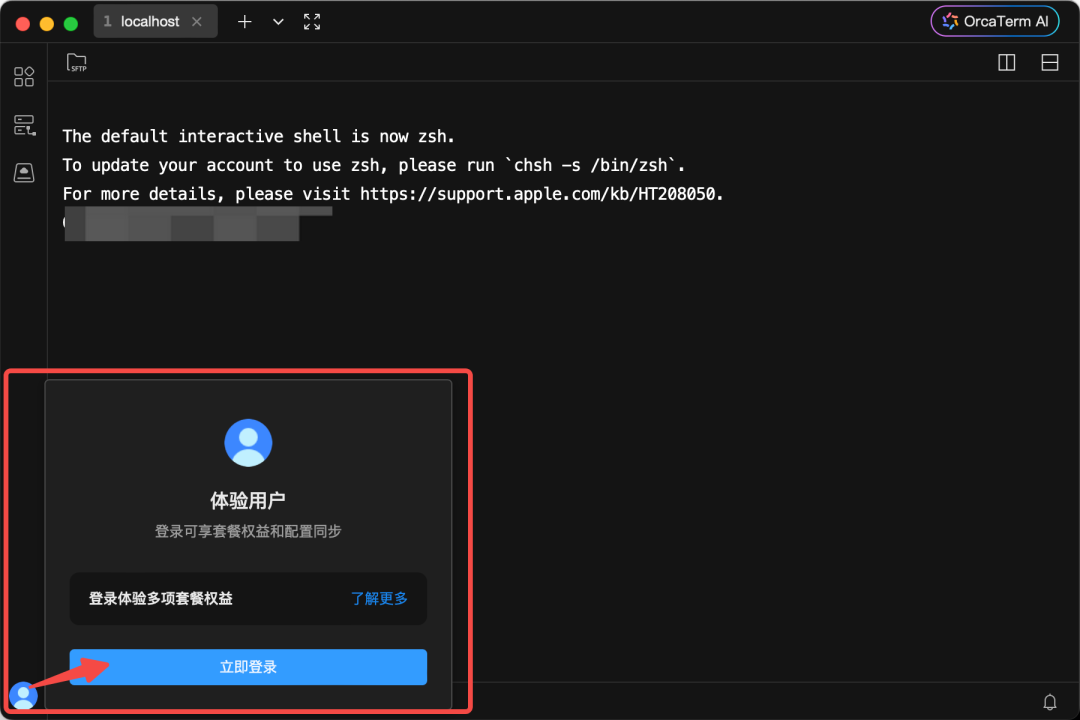

- 安装并打开OrcaTerm,在左下角点击登录。

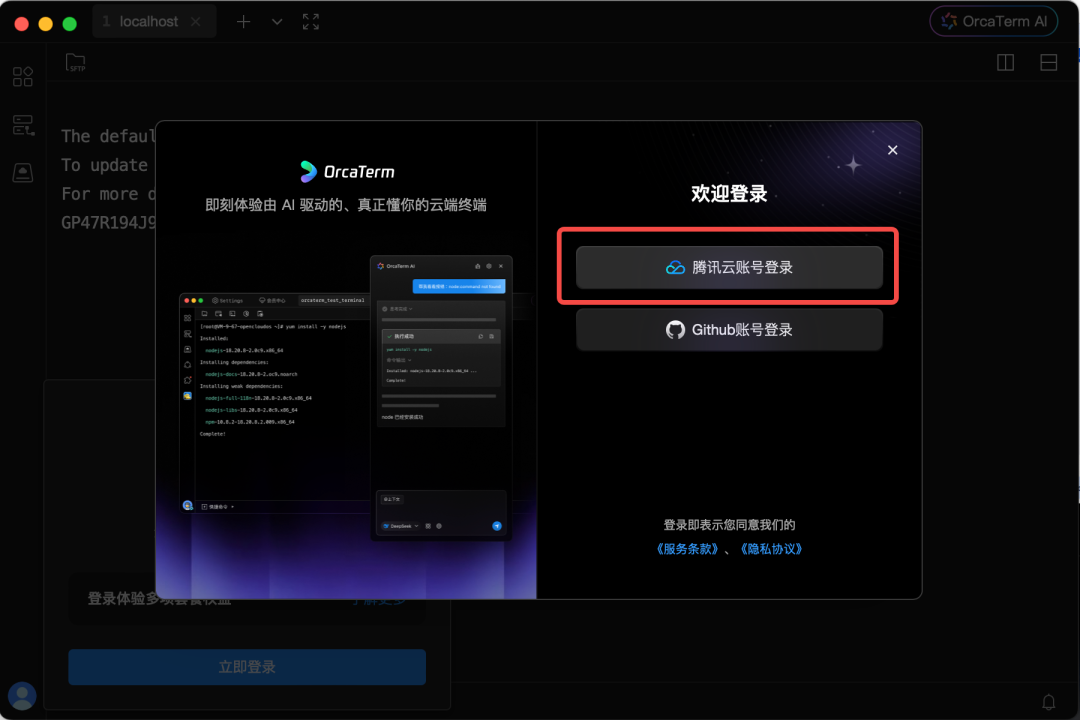

- 选择“腾讯云账号登录”,这将自动跳转网页进行授权。

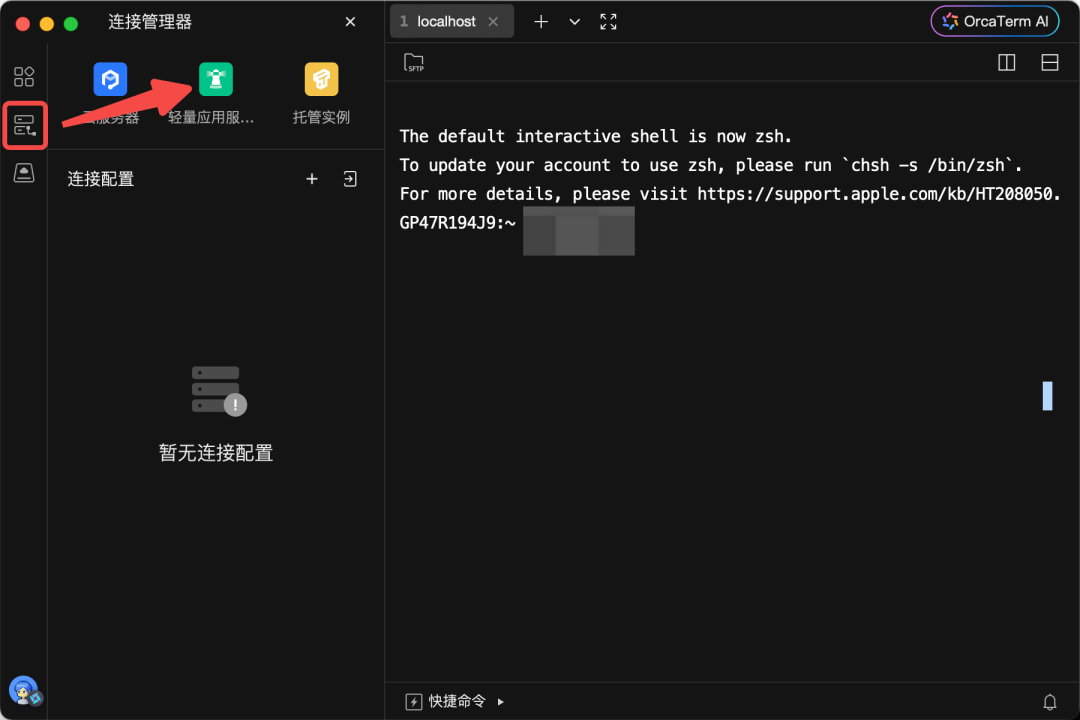

- 登录成功后,点击左侧第二个标签页“连接管理器”,然后选择“轻量应用服务器”。

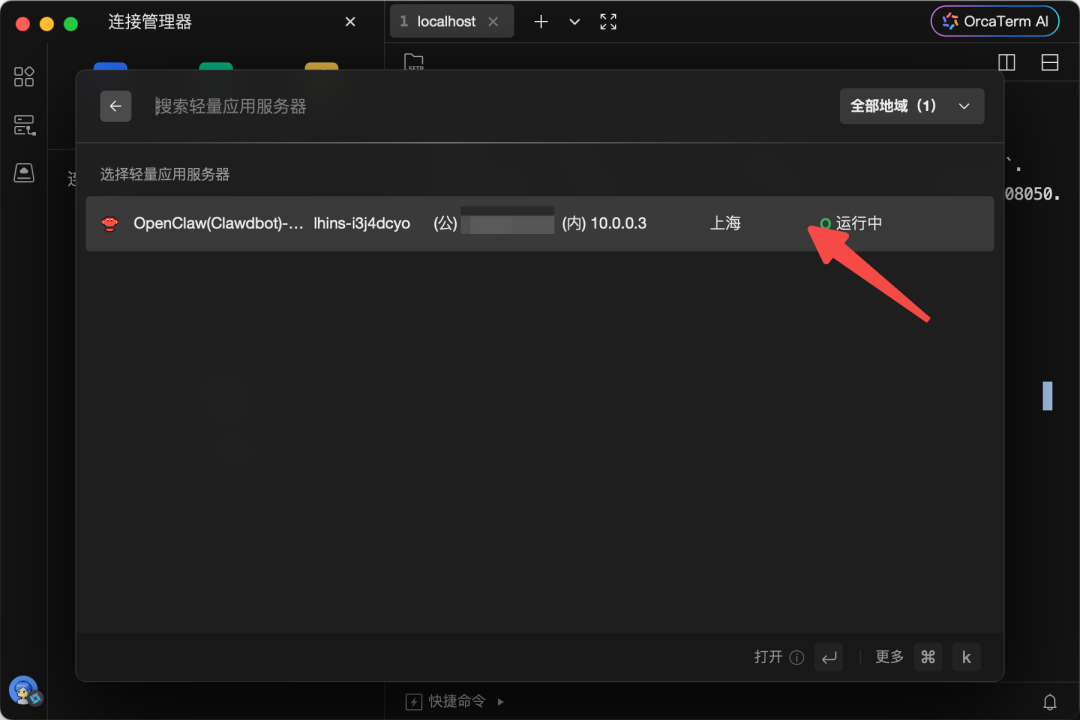

- 在列表中找到你刚购买的服务器,点击它。

- 在弹出的登录窗口中,直接点击“登录”按钮。

至此,你已成功进入服务器的命令行终端。接下来,我们先跳出服务器,去配置另一个关键组件——飞书机器人。

配置飞书机器人应用

OpenClaw需要通过一个“通道”(Channel)与用户交互,在国内,飞书、企业微信、钉钉、QQ都是可选方案。如果你没有特定偏好,飞书因其开放的生态和良好的API支持,是目前较为推荐的选择。

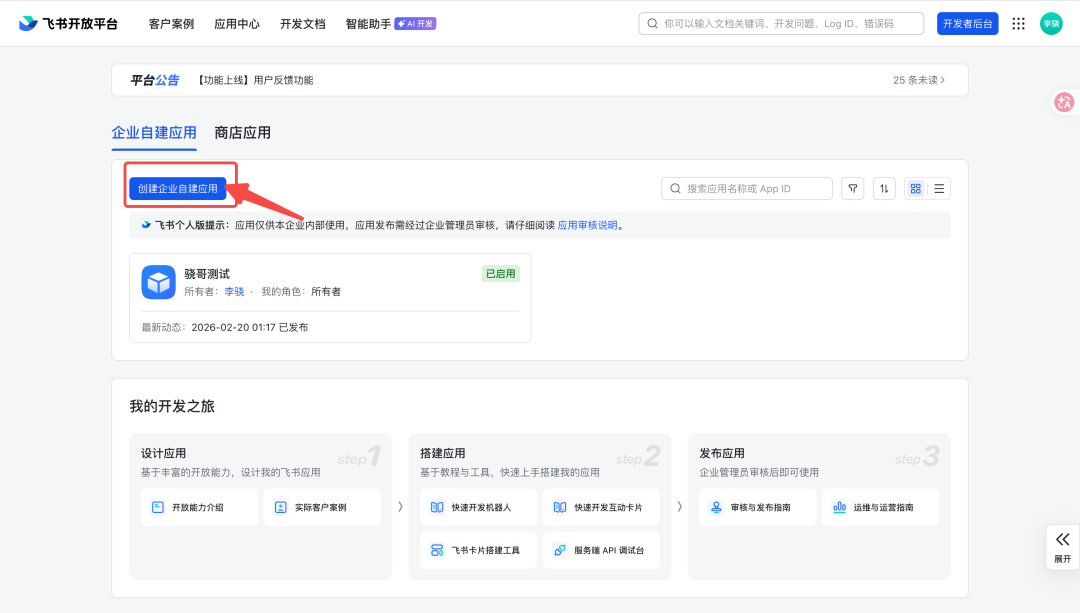

- 创建应用:访问 飞书开放平台,点击“创建企业自建应用”。

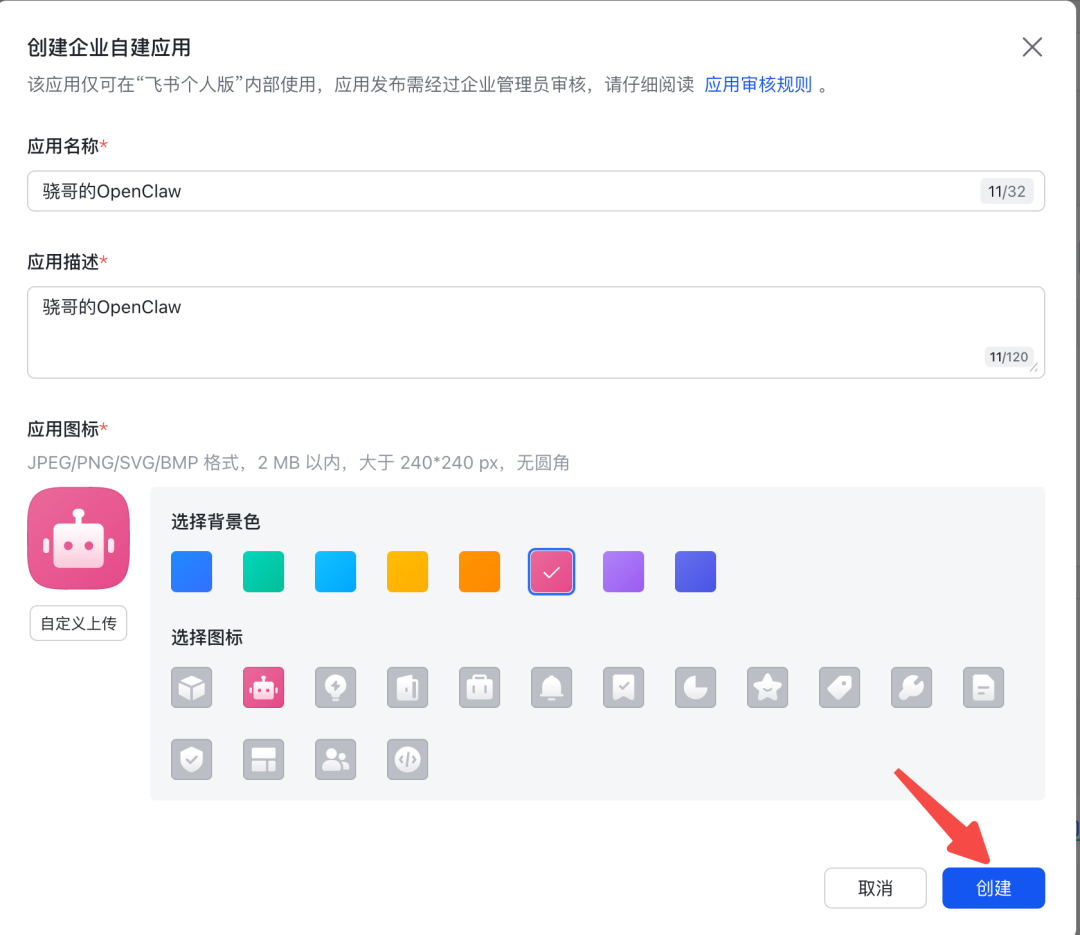

- 填写应用名称和描述,例如“我的OpenClaw助手”,并上传或选择一个图标,然后点击“创建”。

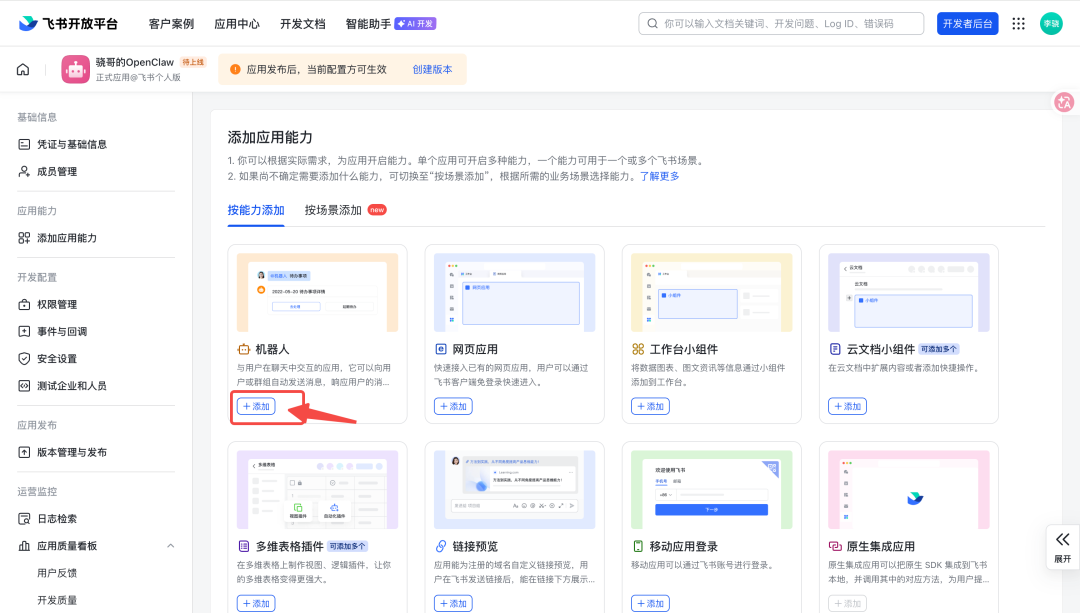

- 添加机器人能力:应用创建后,在“应用能力”页面,点击“+ 添加”,选择“机器人”。

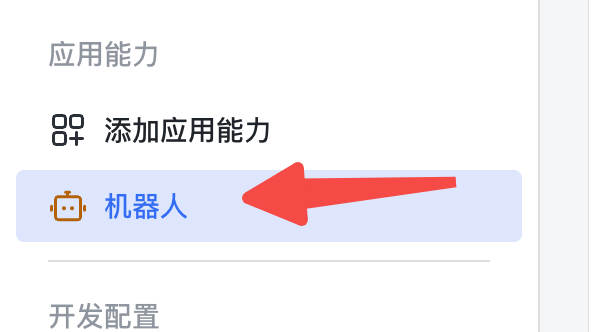

添加成功后,左侧菜单会出现“机器人”选项。

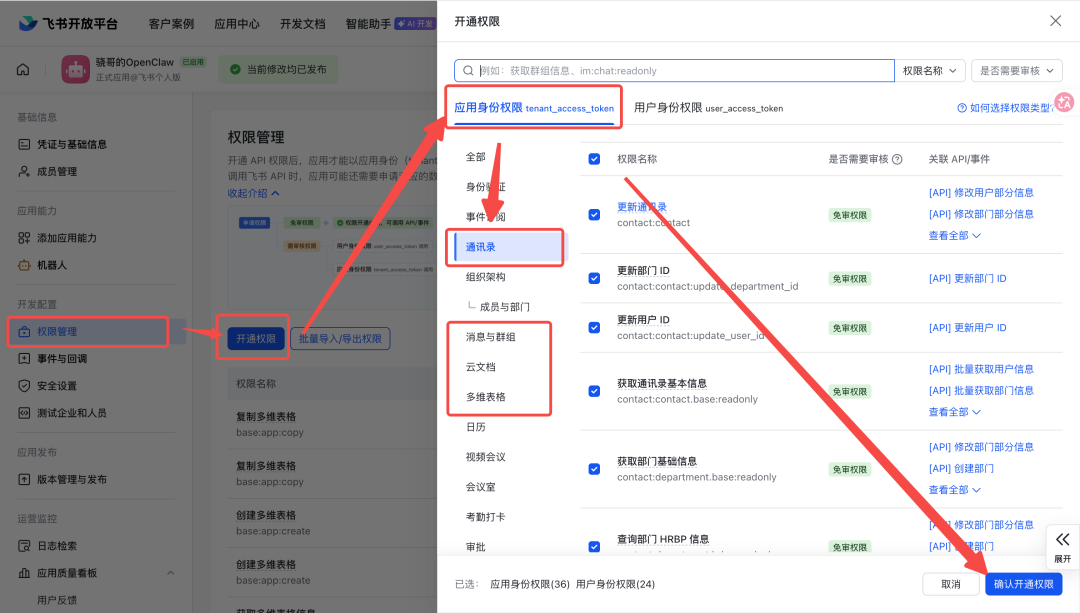

- 开通权限:点击左侧“权限管理”,进入“开通权限”页面。这里需要开通后续机器人工作所需的权限。

- 在权限列表中,找到“通讯录”、“消息与群组”、“云文档”、“多维表格”这几个分类。

- 将这些分类下的所有权限全部勾选上(主要是为了获得完整的读写交互能力)。

- 点击“确认开通权限”。

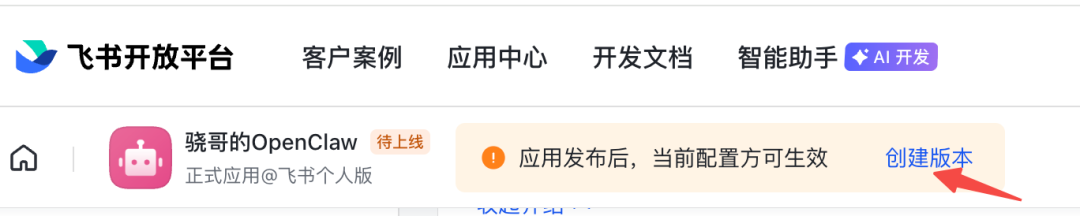

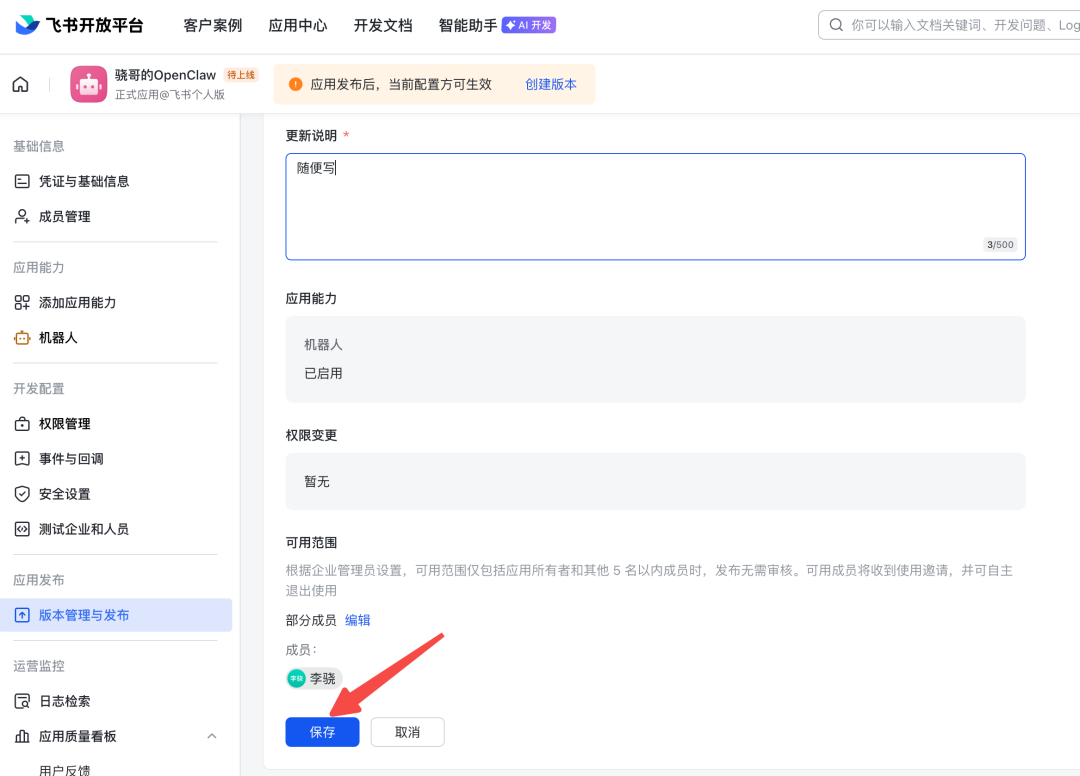

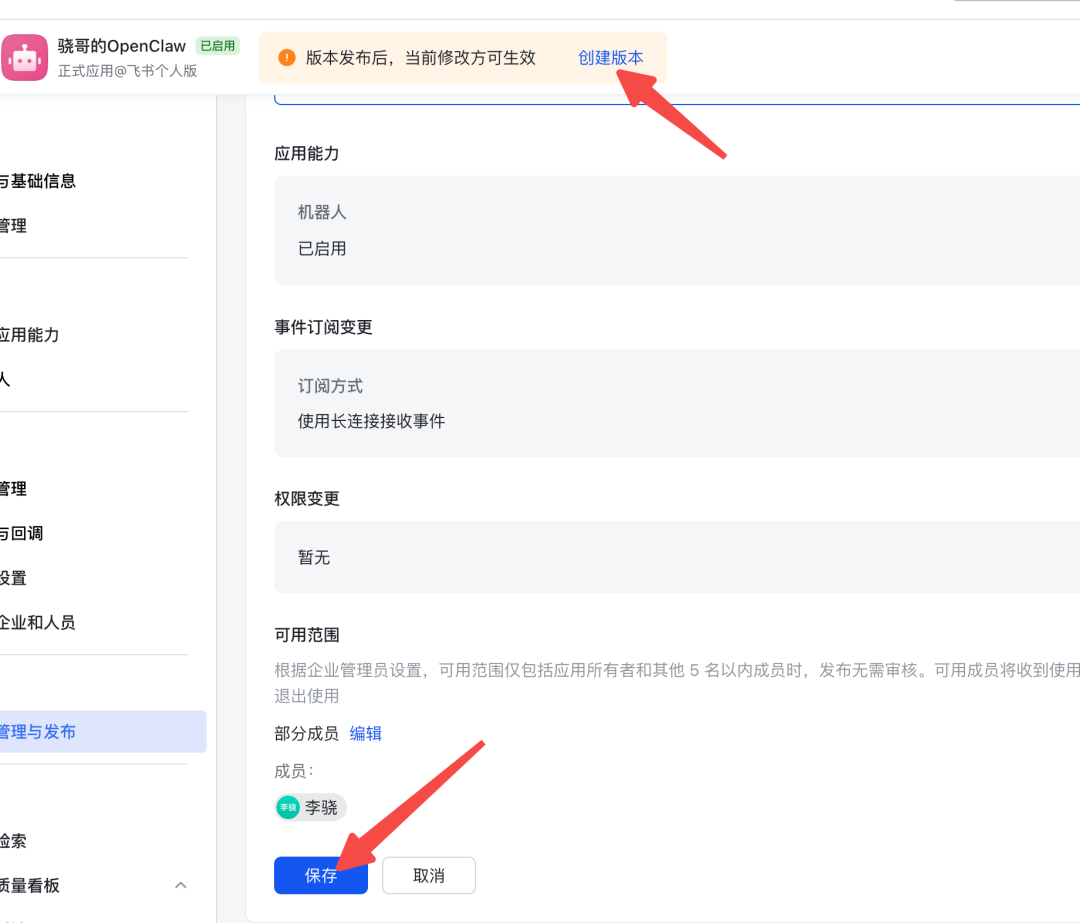

- 发布应用:飞书的所有配置修改后,必须发布才能生效。在“应用发布”页面,点击“创建版本”。

- 填写简单的版本描述(如“初始版本”),然后点击“保存”。

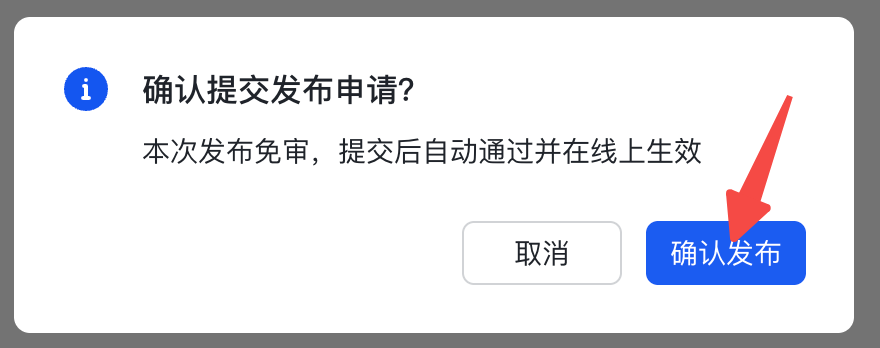

- 最后,在确认弹窗中点击“确认发布”。

发布成功后,应用状态会变为绿色的“已启用”。

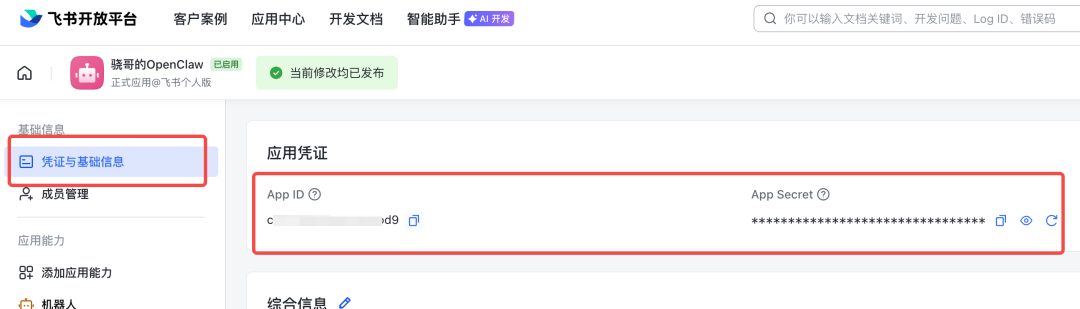

- 获取凭证:点击左侧“凭证与基础信息”,记录下这里的

App ID 和 App Secret。这两个值稍后配置OpenClaw时会用到。

OpenClaw 初始化配置

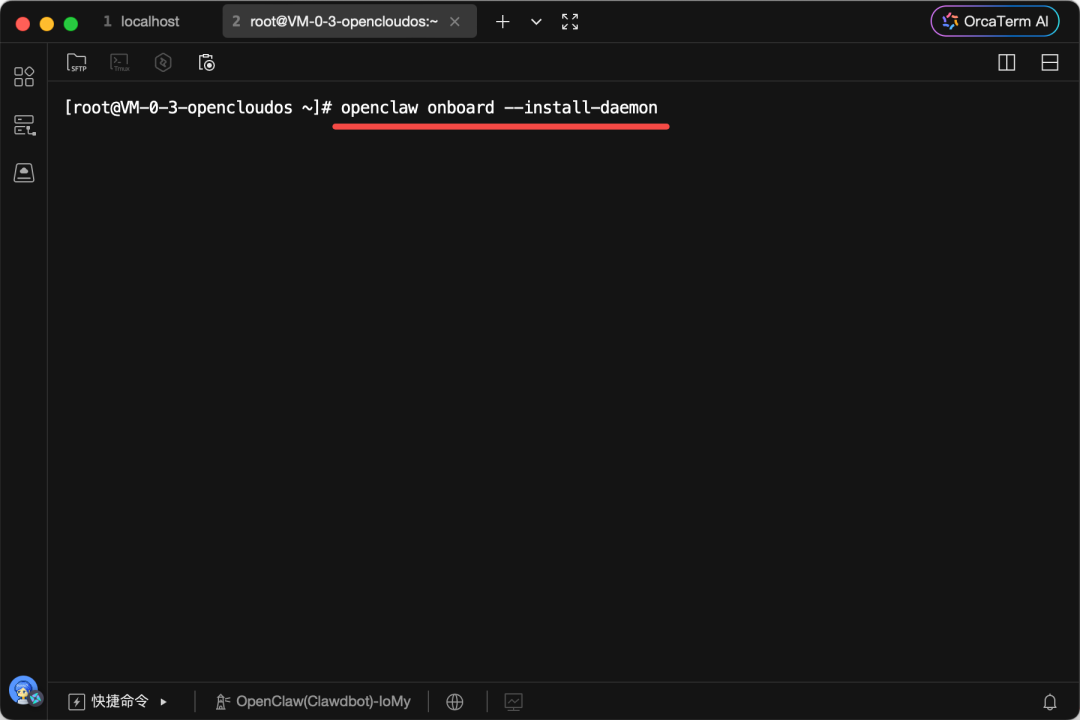

现在,让我们回到OrcaTerm中的服务器命令行,开始初始化安装OpenClaw。

- 在终端中输入以下命令,启动交互式引导配置:

openclaw onboard --install-daemon

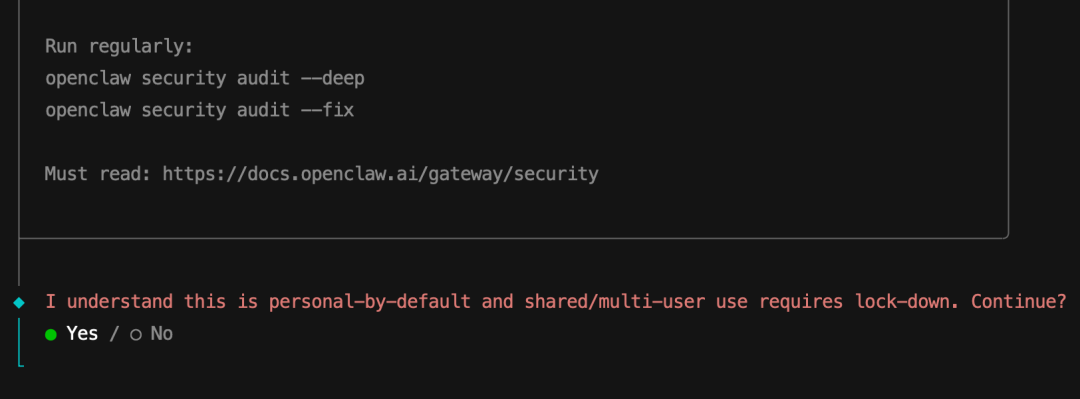

- 跟随引导进行选择(根据截图提示):

- 安全提示:输入

Yes 继续。

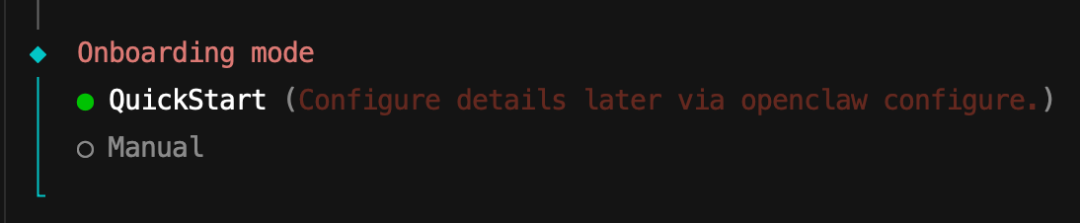

- Onboarding mode: 选择

QuickStart。

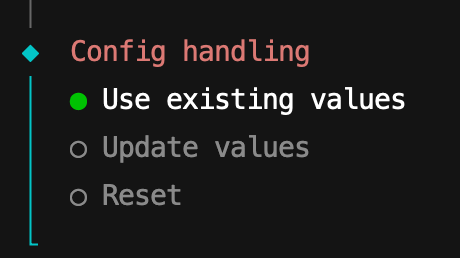

- Config handling: 选择

Use existing values。

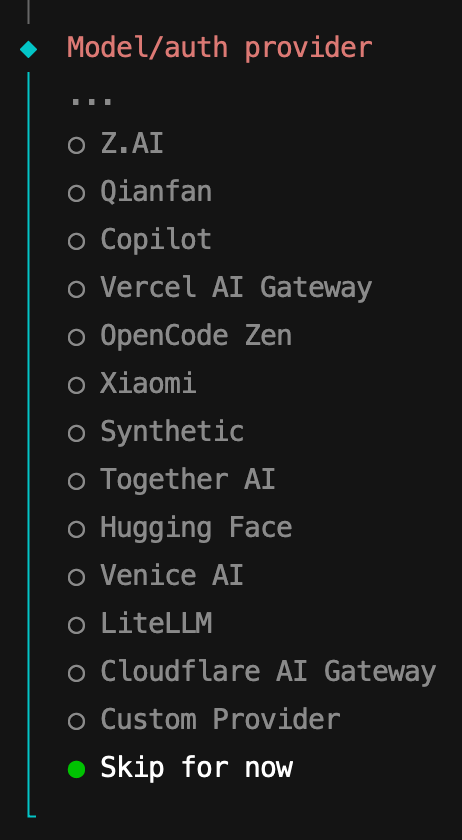

- Model/auth provider: 先选择

Skip for now(模型稍后手动配置)。

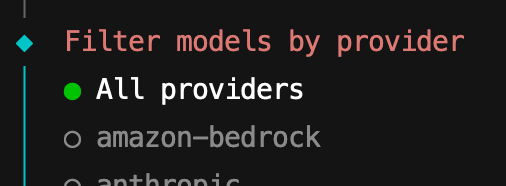

- Filter models by provider: 选择

All providers。

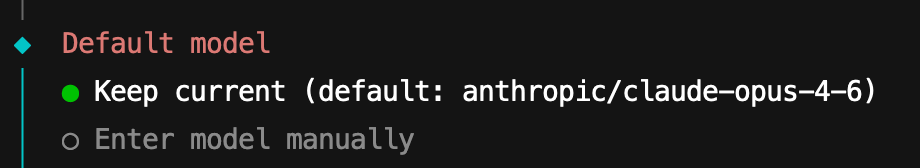

- Default model: 选择

Keep current(后续会覆盖)。

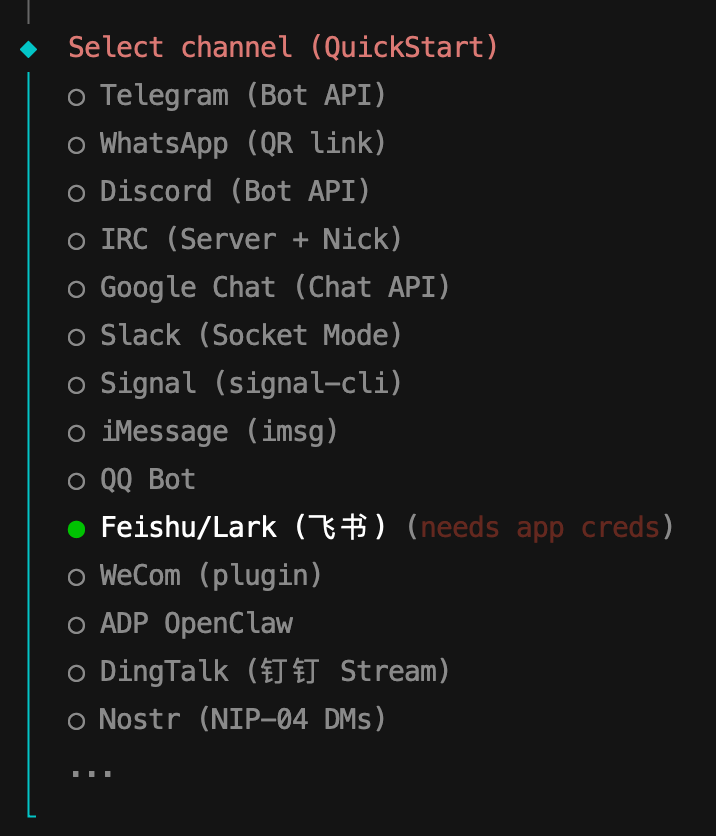

- Select channel: 这里选择

Feishu/Lark(飞书)。

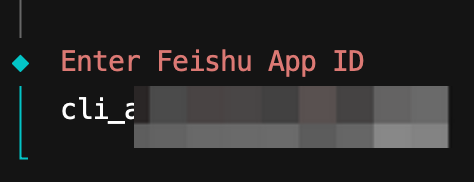

- 输入之前记录的飞书

App ID。

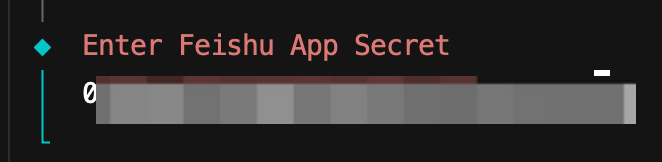

- 输入飞书

App Secret。

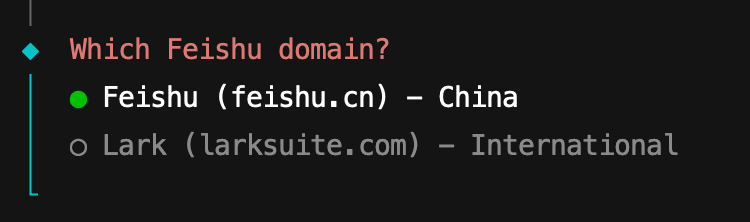

- Which Feishu domain?: 选择

Feishu (feishu.cn) – China。

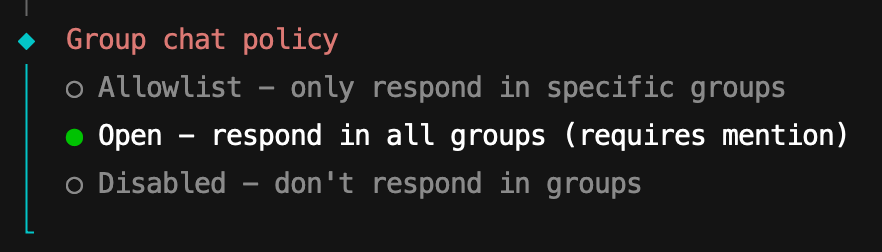

- Group chat policy: 选择

Open – respond in all groups (requires mention)。

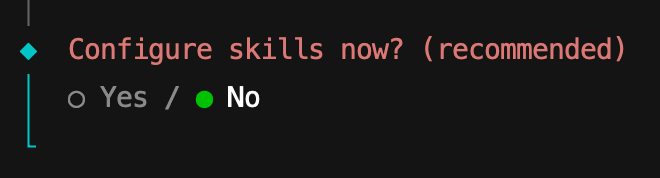

- Configure skills now?: 选择

No,稍后配置。

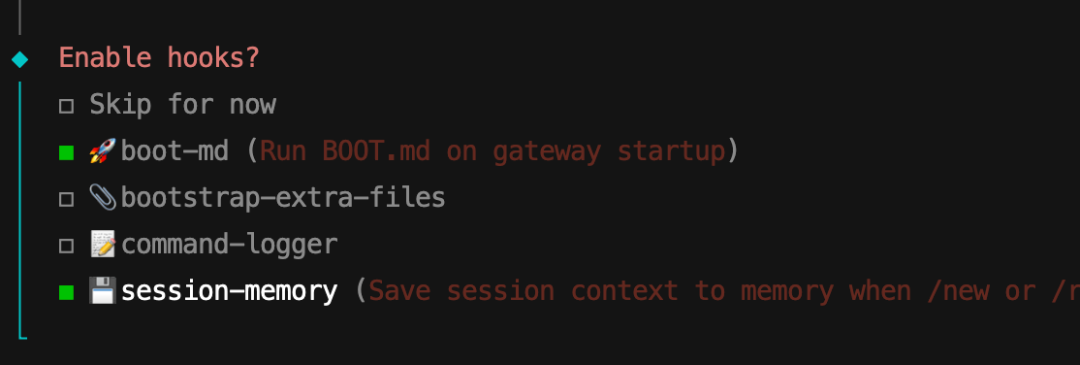

- Enable hooks?: 勾选

boot-md 和 session-memory。

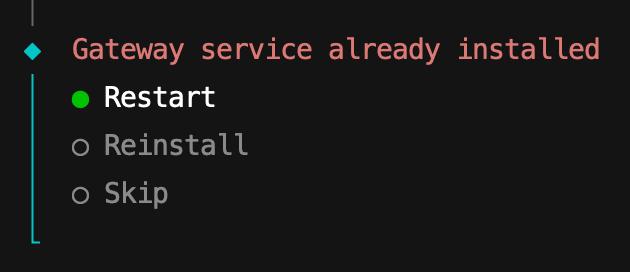

- Gateway service already installed: 选择

Restart。

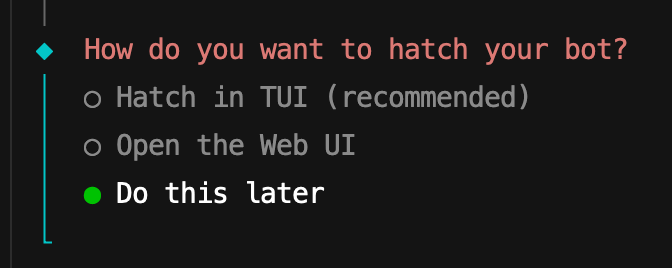

- How do you want to hatch your bot?: 选择

Do this later。

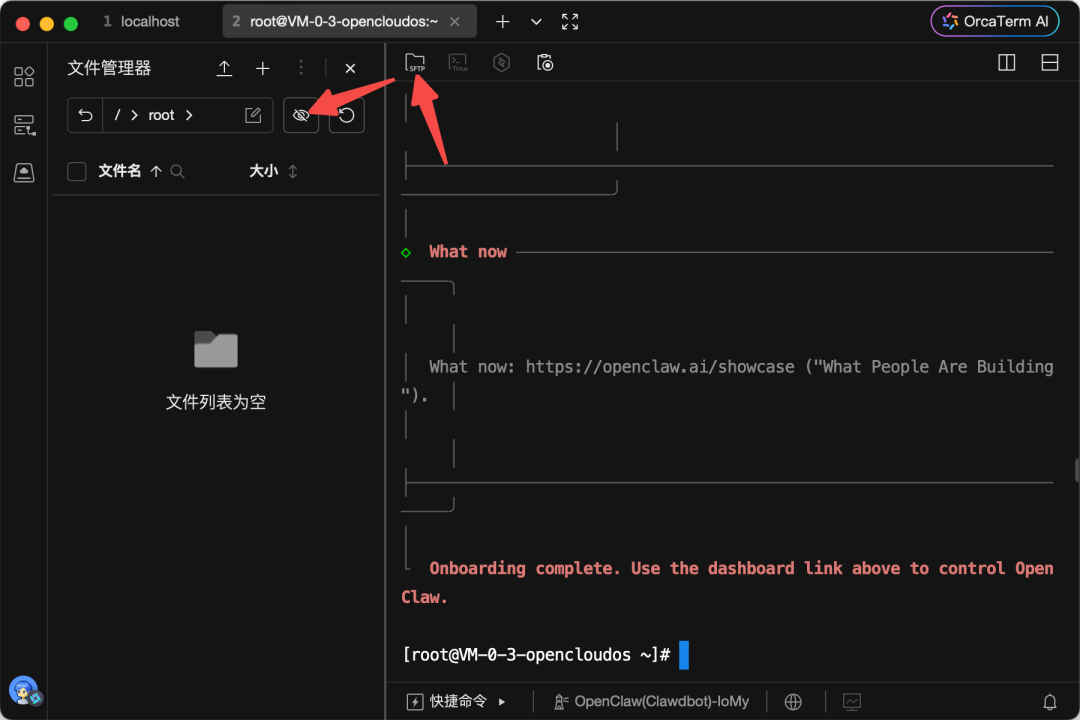

引导完成后,终端会退出配置进程。接下来,我们需要对自动生成的配置文件进行“瘦身”和自定义。

优化配置文件

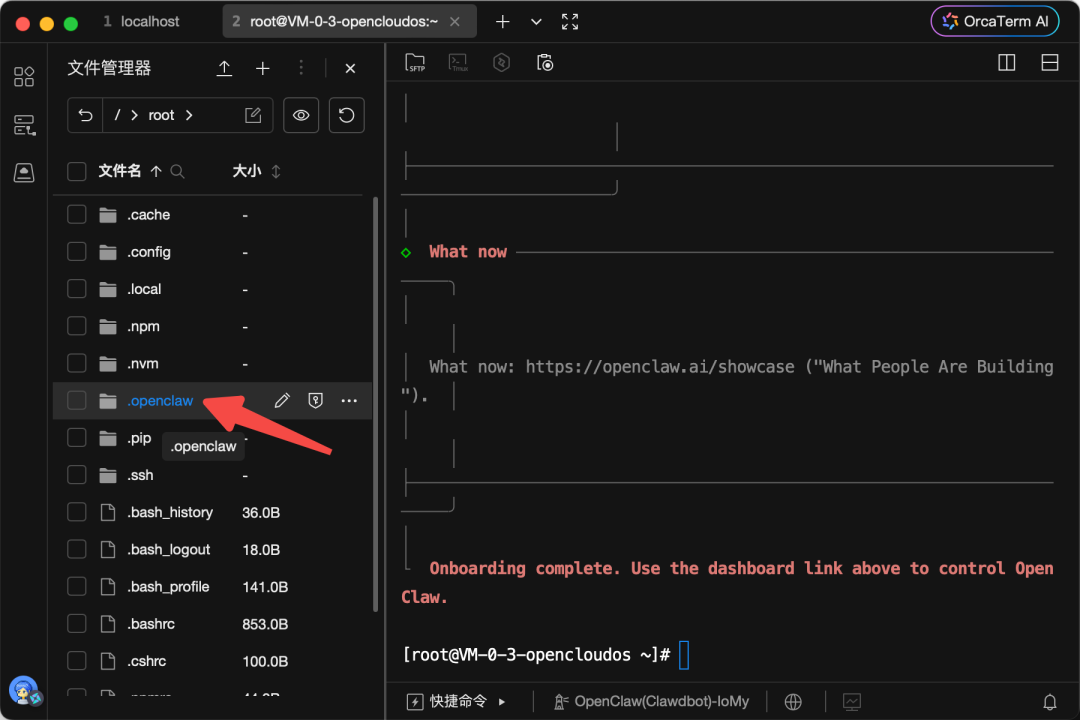

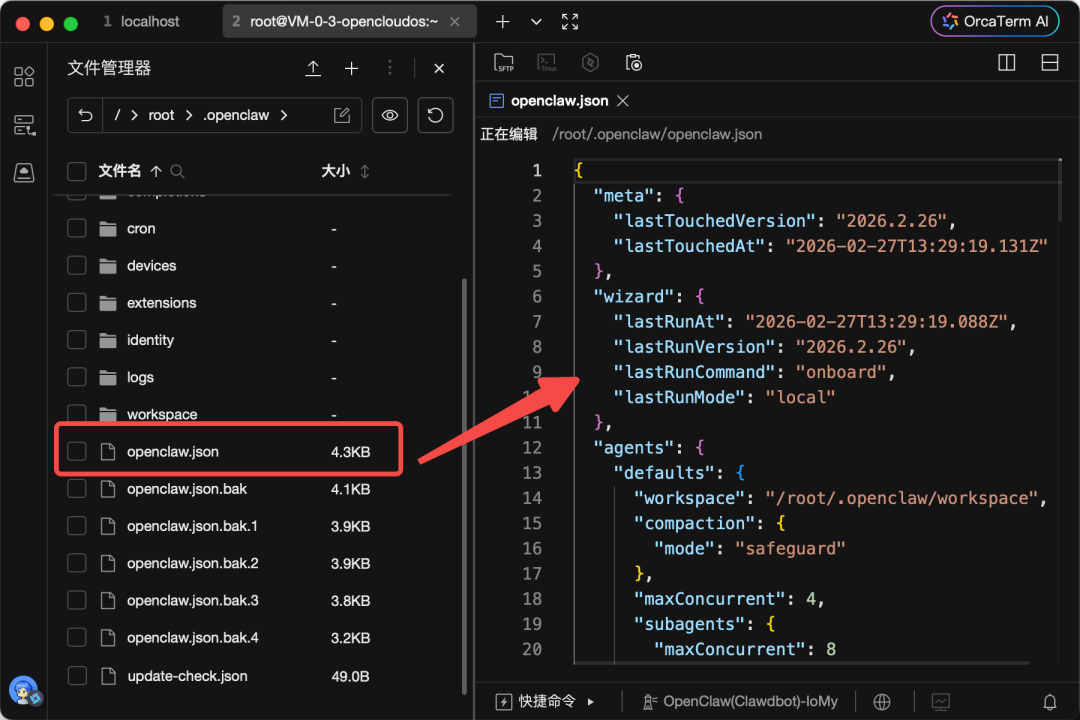

- 在OrcaTerm左侧的文件管理器区域,先点击“小文件夹”图标,再点击“小眼睛”图标,以显示隐藏文件和文件夹。

- 进入

/root/.openclaw/ 目录。

- 找到并打开

openclaw.json 文件,这是OpenClaw的核心配置文件。

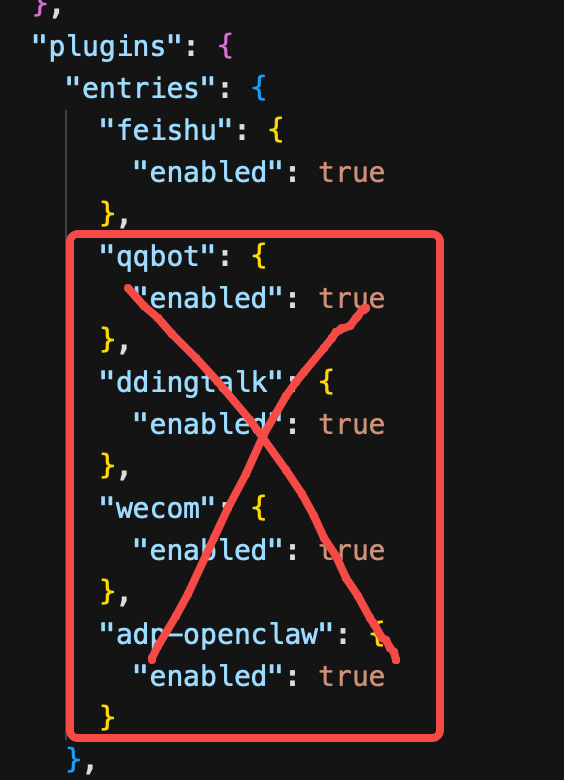

- 清理无用插件:在配置文件中找到

plugins -> entries 部分,只保留 feishu 的配置,将其余如 qqbot, ddingtalk 等插件的配置项全部删除。这能避免加载不必要的模块。

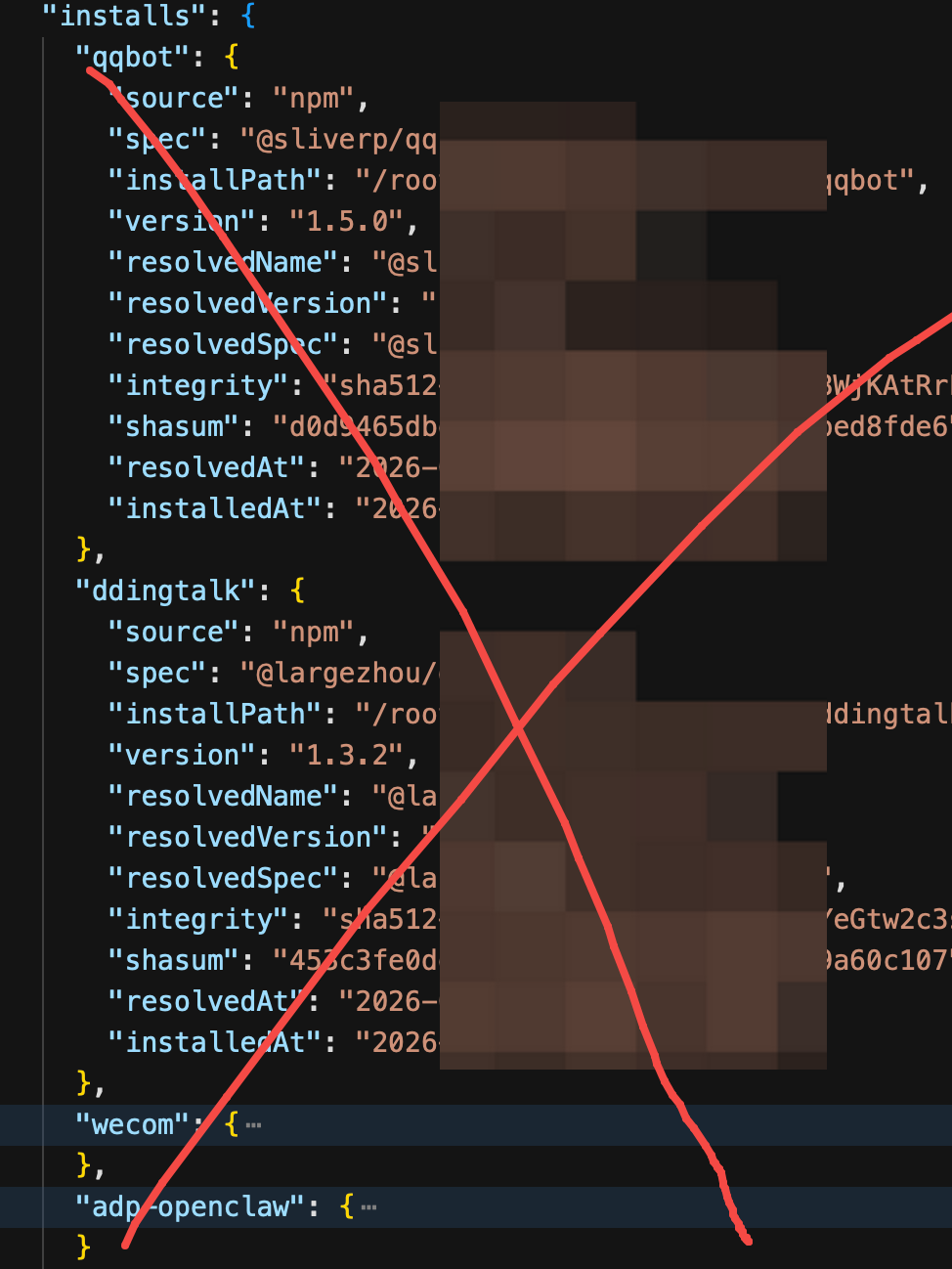

- 清理无用安装记录:找到

plugins -> installs 部分,将其中的内容全部删除。

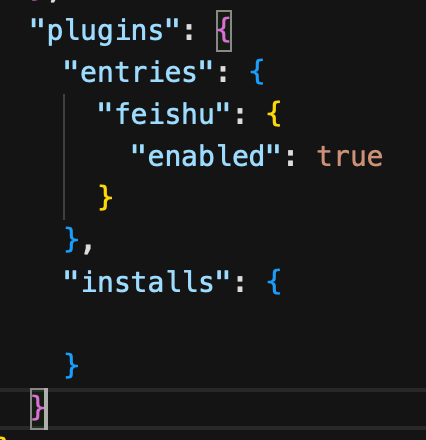

清理后的 plugins 部分应简洁如下:

"plugins": {

"entries": {

"feishu": {

"enabled": true

}

},

"installs": {}

}

接入阿里百炼Coding Plan模型

为什么选择阿里百炼?其 Coding Plan 订阅套餐性价比极高,首月仅需7.9元(Lite套餐),即可使用通义千问、GLM、Kimi、MiniMax等多个国内一线大模型,且专门为编码场景优化,非常适合OpenClaw这类AI Agent使用。

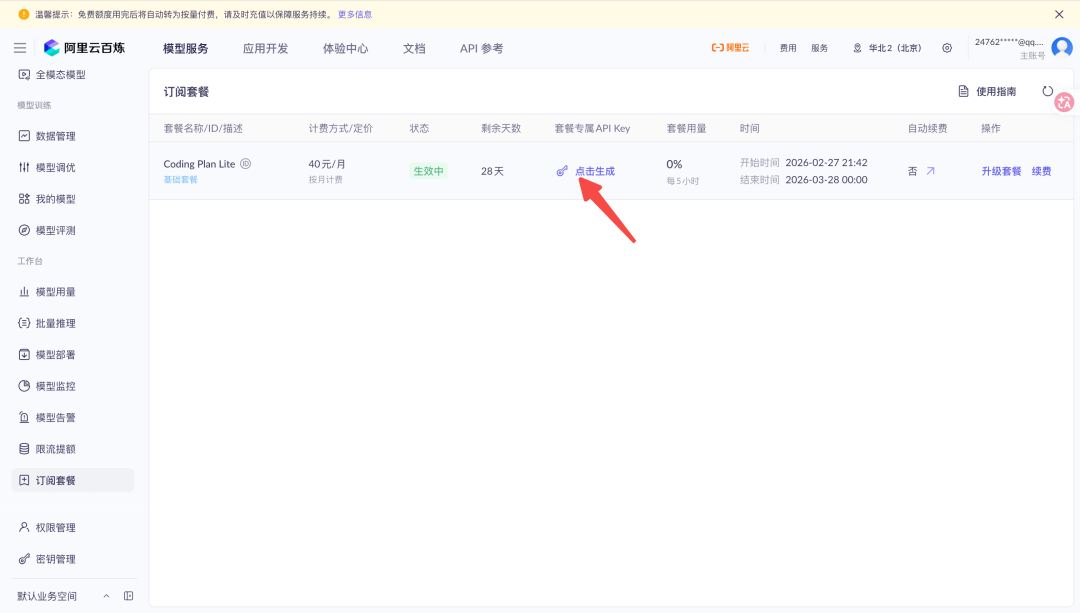

- 购买套餐:访问阿里百炼Coding Plan页面,建议先选择“Lite基础套餐”。

- 获取API Key:购买后,在百炼控制台的“订阅套餐”页面,找到已生效的Coding Plan Lite套餐,点击“生成”套餐专属API Key。

- 配置模型:将以下JSON配置块,复制并粘贴到

openclaw.json 文件的 "models": { 部分(替换原有的models配置)。请务必将 YOUR_API_KEY 替换为你刚刚生成的真实API Key。

"models": {

"mode": "merge",

"providers": {

"bailian": {

"baseUrl": "https://coding.dashscope.aliyuncs.com/v1",

"apiKey": "YOUR_API_KEY", // 替换成你的

"api": "openai-completions",

"models": [

{

"id": "qwen3.5-plus",

"name": "qwen3.5-plus",

"reasoning": false,

"input": ["text", "image"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 1000000,

"maxTokens": 65536

},

{

"id": "qwen3-max-2026-01-23",

"name": "qwen3-max-2026-01-23",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 262144,

"maxTokens": 65536

},

{

"id": "qwen3-coder-next",

"name": "qwen3-coder-next",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 262144,

"maxTokens": 65536

},

{

"id": "qwen3-coder-plus",

"name": "qwen3-coder-plus",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 1000000,

"maxTokens": 65536

},

{

"id": "MiniMax-M2.5",

"name": "MiniMax-M2.5",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 1000000,

"maxTokens": 65536

},

{

"id": "glm-5",

"name": "glm-5",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 202752,

"maxTokens": 16384

},

{

"id": "glm-4.7",

"name": "glm-4.7",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 202752,

"maxTokens": 16384

},

{

"id": "kimi-k2.5",

"name": "kimi-k2.5",

"reasoning": false,

"input": ["text", "image"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 262144,

"maxTokens": 32768

}

]

}

}

}

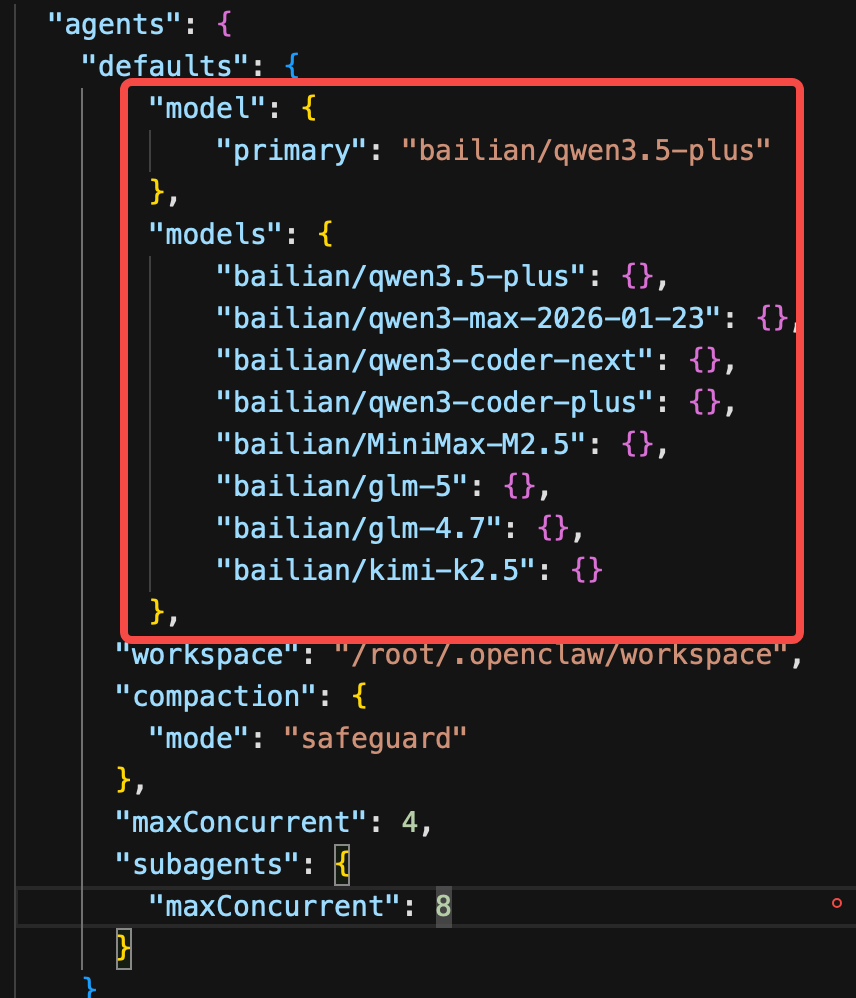

- 设置默认模型:在

openclaw.json 中找到 agents.defaults 对象,在其中添加或替换以下字段,将主模型设置为通义千问Qwen3.5 Plus。

"model": {

"primary": "bailian/qwen3.5-plus"

},

"models": {

"bailian/qwen3.5-plus": {},

"bailian/qwen3-max-2026-01-23": {},

"bailian/qwen3-coder-next": {},

"bailian/qwen3-coder-plus": {},

"bailian/MiniMax-M2.5": {},

"bailian/glm-5": {},

"bailian/glm-4.7": {},

"bailian/kimi-k2.5": {}

},

至此,模型配置已完成。保存 openclaw.json 文件。

配置飞书事件订阅与最终配对

这是连通飞书机器人与OpenClaw服务的关键一步。

-

配置事件订阅:回到飞书开放平台,在应用管理界面,点击左侧“事件与回调”,再点击右侧“事件配置”旁的编辑(铅笔)图标。

-

在配置页面,订阅方式选择“使用长连接接收事件(推荐)”,然后直接点击“保存”。

- 注意:若此处提示“应用未建立长连接”,请检查前面步骤中飞书机器人的

App ID 和 App Secret 是否在OpenClaw配置中填写正确。

-

点击“添加事件”。

-

在事件添加窗口,将“通讯录”、“消息与群组”、“云文档”这几个分类下的所有事件全选,然后点击“确认添加”。

-

再次发布应用:事件添加后,必须再次创建并发布新版本,使配置生效。点击“创建版本”,然后“保存”并“确认发布”。

-

用户配对:

-

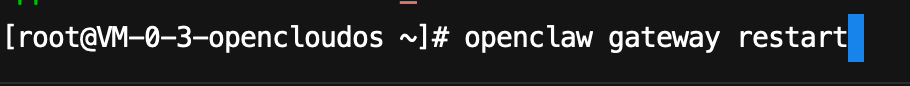

重启网关:最后,重启OpenClaw网关服务以使所有配置生效。

openclaw gateway restart

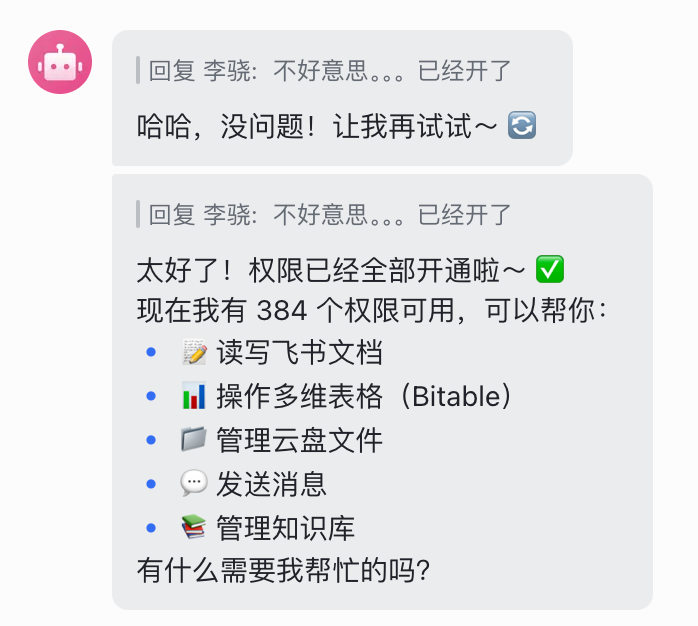

验证与使用

完成以上所有步骤后,你的OpenClaw飞书机器人就应该活过来了。再次在飞书中与机器人对话,它会热情地打招呼,并告知已获得的权限列表(如读写文档、管理表格等),询问你需要什么帮助。

如果在对话中机器人提示缺少某些权限,它会贴心地提供授权链接,引导你完成授权,非常友好。

总结

这套基于腾讯云服务器、飞书机器人通道和阿里百炼大模型的OpenClaw搭建方案,完全利用国内生态链,避免了海外网络的不确定性,在云原生基础设施上实现了稳定部署。从成本角度看,服务器年费199元,模型套餐首月7.9元,是体验和深入学习AI Agent能力的极高性价比路径。

希望这篇详细的指南能帮助你顺利踏上OpenClaw的探索之旅。如果在配置过程中遇到问题,欢迎在云栈社区的技术板块与大家交流讨论。 |