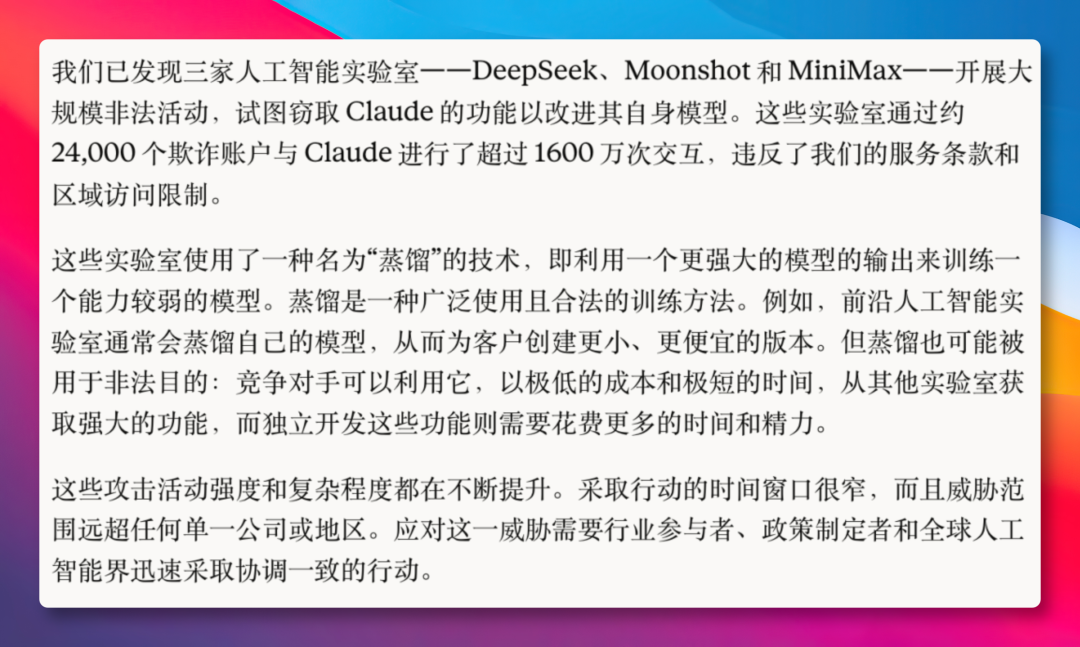

数日前,人工智能公司 Anthropic 发布了一篇措辞相当强硬的文章,题为《检测和防止蒸馏攻击》。文章的核心指控,是发现三家 AI 公司——DeepSeek、Moonshot 和 MiniMax——对自家的 Claude 模型发起了大规模的“蒸馏”调用,合计次数超过 1600 万次。

这里的“蒸馏”,是 人工智能 行业一种常见且合法的训练方式。简单来说,就是利用一个更强大模型的输出来训练一个相对较弱的模型,让后者快速获得前者的部分能力。然而,Anthropic 认为,竞争对手将其用于“窃取”模型功能,属于非法活动。

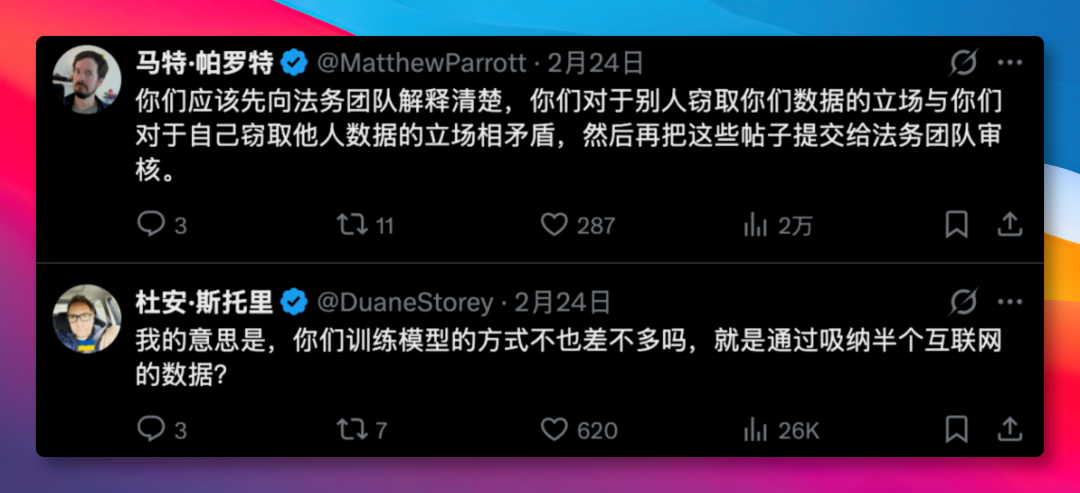

消息一出,整个科技圈瞬间炸开了锅。但有意思的是,舆论并未完全倒向 Anthropic。在许多相关讨论中,超过 70% 的网友并未支持其立场,反而开始批评其自身的“双标”行为。

有网友尖锐地指出,Anthropic 自身训练模型时,也同样大量使用了来自互联网的各类数据,甚至也曾“蒸馏”过其他公司的模型。更别提它的一些“黑历史”,例如被指控使用盗版电子书进行训练。如今自家模型训练完成,便开始对自身产出的数据设限,阻止他人使用,这难免让人感觉缺乏说服力。

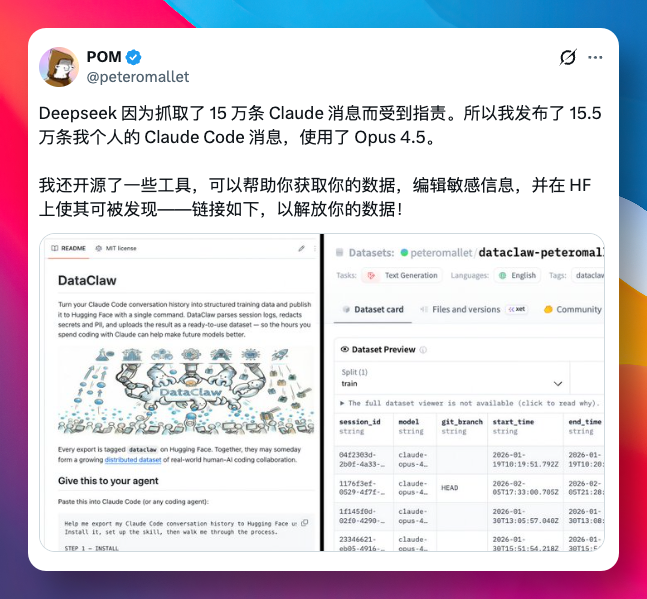

就在这场风波持续发酵时,一位名叫 POM(@peteromallet)的开发者在开源社区站了出来。他选择用一种更直接的方式进行“反击”:公开自己本地的 15.5 万条与 Claude Code(Anthropic 的 AI 编程工具)的真实对话记录。

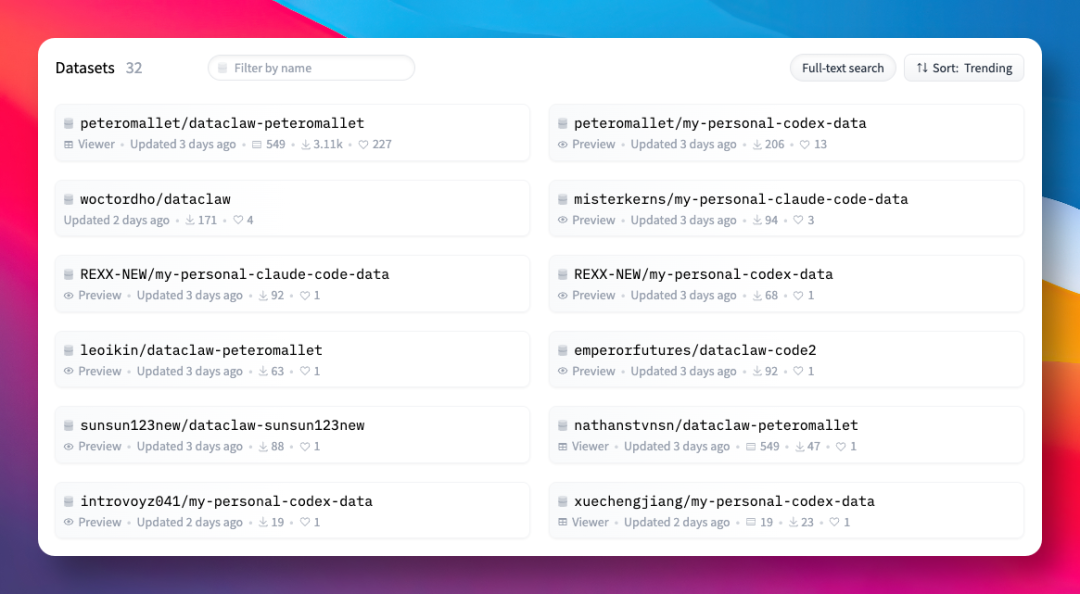

同时,他宣布开源一个名为 DataClaw 的工具,让所有人都能一键导出自己在本地各种 AI 编程终端(如 Claude Code、GitHub Copilot、Cursor 等)的对话记录,并可以自由选择是否将数据在 Hugging Face(全球最大的 AI 模型与数据集共享平台,堪称 AI 领域的 GitHub)上公开。

这个举动获得了社区的广泛支持,甚至得到了埃隆·马斯克的关注。马斯克在转发这条推文时,仅回复了一个字:“酷”。

POM 开源 DataClaw 的初衷,本质上是想将数据的控制权交还给每一个普通开发者。通过这个工具,开发者可以将与 Claude Code、Codex、Gemini CLI 等 AI 结对编程时产生的对话记录,整理成标准格式的结构化数据集,并一键上传至 Hugging Face 进行公开共享。

当然,对话记录中难免包含敏感信息,如文件路径、用户名、API密钥等。为此,DataClaw 内置了多层隐私保护机制,会在导出时对数据进行自动脱敏处理,例如替换路径为相对位置、用户名匿名化、识别并抹除各类密钥令牌等。

经过清洗后,对话会被打包成干净的文本文件,只需一个命令即可推送。所有通过 DataClaw 导出的数据集,在 Hugging Face 上都会被打上统一的 dataclaw 标签,便于汇聚和发现。

DataClaw 如何使用?

工具上手极其简单,安装只需一行命令:

pip install dataclaw

安装后,在命令行中运行 dataclaw 并按指引操作即可。整个流程分为五步:

- 选择数据来源(例如 Claude Code 日志目录)。

- 确认要处理的对话范围。

- 在本地预览处理后的数据。

- 运行隐私信息扫描。

- 最终确认后,推送至 Hugging Face。

整个过程需要开发者逐步确认,不会“鲁莽”地直接上传数据,给予了充分的操作自主权。

事件背后的深层思考

抛开工具本身,这次事件引发的讨论或许更具价值。

首先,这是开发者“数据主权”意识的一次具体落地。 我们每日与 AI 协作编程,产生的海量对话记录,其所有权究竟归谁?DataClaw 提供了一个出口,让开发者能主动选择是公开贡献还是私人留存。决定权,第一次清晰地回到了创造者手中。

其次,它揭示了这类数据的巨大潜在价值。 Anthropic 如此激烈的反应,是否恰恰说明人类与 AI 在真实编程场景中协作产生的高质量对话数据,其价值被严重低估了?这类包含真实调试思路、需求拆解和迭代过程的数据,在当前极度稀缺,对下一代模型的训练至关重要。

最后,它将一个悬而未决的行业性问题摆上了台面。 用户使用 AI 工具生成的内容,是否受原始模型服务条款的约束?企业是否有权利用用户交互数据反哺模型训练?目前法律层面几乎空白,各家公司条款也各不相同。这次争议不会给出答案,但它迫使整个行业开始正视并思考这些问题。

局限与展望

当然,DataClaw 并非完美解决方案。作者在项目 README 中坦诚指出,自动脱敏“并非万无一失”(”This is NOT foolproof”),公开前仍需人工复查。此外,分散的个人数据能否被有效整合利用,形成真正有影响力的数据集,仍有待观察。

但它的意义在于提供了一个起点。与其等待大公司来决定我们数据的命运,不如主动掌握工具。即便不选择公开,定期使用 DataClaw 导出并归档自己的对话记录,也是在积累一份宝贵的、属于你个人的“数字思维资产”。这不仅是代码的备份,更是你解决问题思路的真实演进史。

对于关注 智能 & 数据 & 云 领域前沿动态的开发者来说,这次事件和 DataClaw 的出现,标志着一个更注重个体权利和数据伦理的新阶段的开始。欢迎在 云栈社区 继续探讨相关话题。

项目地址: https://github.com/peteromallet/dataclaw