如果今天要构建一个 AI Agent,你认为最关键的技术决策是什么?

很多开发者的第一反应是:选大模型、挑框架、设计工具链。至于记忆?那似乎是可以后期再考虑的事情——等 Agent 跑起来了,接个向量数据库,挂个 RAG 模块,记忆功能自然就有了。

然而,这很可能是 2026 年 AI 开发者圈子里最危险的一个认知陷阱。

就在不久前,Anthropic 发布了 Claude Managed Agents。这可不是又一个普通的 Agent 框架,它直接将 Agent 协调层(Harness)和长期记忆完全封装进了 API 内部。源码不开放,存储逻辑不透明,最关键的是——不支持记忆迁移。

几天后,LangChain 的创始人 Harrison Chase 发文发出警告:「如果你使用了闭源的 Harness,特别是那些隐藏在私有 API 后面的,本质上你已经选择了将 Agent 的记忆主权交给第三方。」

几乎同时,Letta(原 MemGPT)的联合创始人 Sarah Wooders 在社交媒体上的一句话,更是直接点破了行业的某种集体幻觉:

「记忆不是插件,它就是 Harness 本身。」

这篇文章,我们就来彻底拆解一下这句话背后的含义,以及它对你的项目意味着什么。

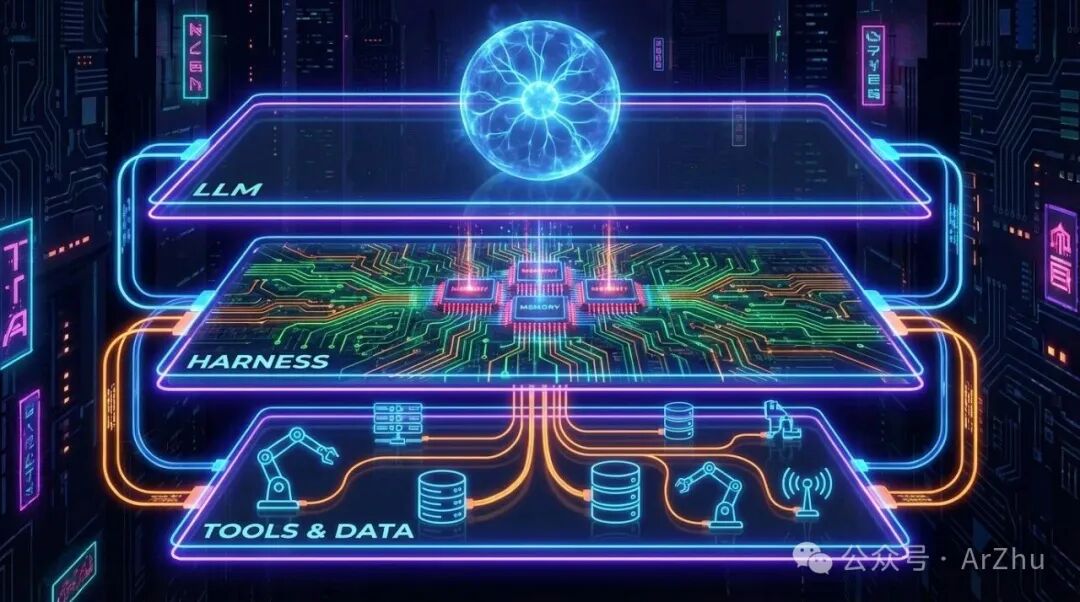

先搞清楚:什么是 Agent Harness?

“Agent Harness”这个概念,在中文技术圈里很少被准确理解。

简单来说,Harness 是大模型、工具调用以及外部数据之间的核心协调层。你可以把它想象成 Agent 的“操作系统”。它负责的工作包括:上下文管理、工具调用调度、状态维护、流程编排,以及我们今天重点要谈的——记忆管控。

AI Agent 的发展大致走过了三个阶段。最初一代主要依赖 RAG 链,把文档向量化后喂给模型,流程简单。中期随着模型能力提升,出现了像 LangGraph 这类流程编排工具。而到了现阶段,模型本身已经足够强大,Agent Harness 就成了最核心的基础设施。

这里存在一个关键认知:Harness 不会被越来越强的模型所“吸收”或取代。

行业里有一种流行的误解,认为模型能力进化后,这些中间协调层会逐渐消失。事实恰恰相反。

今年早些时候,Claude Code 曾因一个 .npmignore 配置错误,意外泄露了其完整源码。总计 51.2 万行 TypeScript 代码,跨越约 1900 个文件。这些全都是 Harness 层的代码。其中甚至藏着一个名为 KAIROS 的后台守护进程,其功能是在用户空闲时自动执行记忆整合(内部代号 "autoDream")。整个系统采用三层记忆架构:MEMORY.md 作为轻量级索引,话题文件按需加载,长期记忆则独立存储。

这是 Anthropic 自己的团队——全球顶尖的大模型团队之一——在模型能力已经极强的当下,仍然重度投入 Harness 建设的铁证。

旧的“脚手架”可能会被新方案替代,但 Harness 作为协调层的核心地位绝不会被模型吞噬。

所以,Harness 的选型是一个长期的技术决策,它直接决定了你未来 Agent 的记忆主权归属于谁。

核心认知颠覆:记忆从来都不是“插件”

这是本文最核心的观点,也是行业内最普遍的一个误区。

绝大多数开发者习惯性地将“记忆”视为一个可插拔的独立模块。在他们的设想里,流程是:先把 Agent 的核心功能跑通,后期再接个 RAG,存到向量数据库里,记忆问题就“搞定”了。

这个想法从根本上就错了。

记忆相关的核心决策点——比如上下文何时进行压缩、历史对话如何存储和检索、Agent 自身是否有权限修改其 System Prompt——所有这些都发生在 Harness 内部。外部的所谓“插件”或模块,根本无法介入这些核心流程。

Sarah Wooders 的 MemGPT 项目就是最好的例证。很多人误以为 MemGPT 是一个可以即插即用的“记忆增强插件”,能接到任何框架上。但如果你仔细阅读其源码,会发现 MemGPT 本身就是一个有状态的引擎级 Harness。它自建的三层记忆体系——Core Memory(类似 RAM,在上下文中)、Recall Memory(可搜索的对话历史,类似磁盘缓存)、Archival Memory(长期冷存储,通过工具调用访问)——全部是直接内建在 Harness 架构之中的。

记忆是 Harness 工具能力的自然产物和核心组成部分,而不是一个可以后期外挂的附件。

用一个更形象的类比:记忆和 Harness 的关系,就像“驾驶”和“汽车”的关系。驾驶不是汽车的某个配件,它是汽车之所以能运行的核心功能。你不可能先买一辆没有驾驶功能的车,然后说“这个功能我们后期再加装”。

当你选择了一个特定的 Harness,无论是开源如 LangChain 还是闭源如某厂商的 SDK,你就已经在那一刻做出了关于记忆主权的决策。只是大多数人在做选择时,并未意识到这一点。

商业逻辑:为什么厂商要锁死你的记忆?

理解了记忆与 Harness 的不可分割性,下一个问题自然浮现:为什么大模型厂商都倾向于把记忆功能锁死在自己的平台上?

答案或许有些残酷,但非常简单:因为单纯的模型 API 锁不住你,只有记忆能真正锁住你。

2026年的现实是,顶级大模型的 API 服务在能力上已经高度同质化。无论是 GPT-4o、Claude Opus 还是 Gemini Ultra,在绝大多数通用任务上的表现差异,已经不足以构成高昂的迁移障碍。一个无状态的、单次的 API 调用,今天用 Claude,明天换成 GPT,可能只需要修改一行配置中的 endpoint。切换成本几乎为零。

这对于提供 API 服务的厂商来说,无疑是一场噩梦。

但“记忆”彻底改变了这个游戏规则。

一个拥有记忆的 AI Agent,每多使用一天,就会多积累一天的个性化数据:用户的特定偏好、交互的语气习惯、独有的工作流程、详细的对话历史。这些数据会像“复利”一样滚动增长,逐渐形成一个专属于该 Agent 的、难以替代的私有数据集。使用得越久,这个 Agent 就越“智能”、越“贴心”,同时,迁移到另一个平台的成本也就越高。

Harrison Chase 在他的博文中举过一个真实案例:某团队的内部邮件助手,在积累了数月的个性化记忆后,因意外被删除。团队随后用相同的模板重新创建了一个——所有功能完全一样,但用户体验却大幅下降。所有那些细微的偏好规则、语气调整、流程习惯,全部需要从零开始重新“调教”。

这就是记忆所创造的核心价值。也正因如此,它成为了厂商锁定用户的真正筹码。

当你的 Agent 记忆存在某家平台的服务器上时,迁移就意味着从零开始。你被迫留下,可能不是因为它的模型更优秀,而是因为你的全部“记忆”和历史都留在了那里。

封闭 Harness 的三级风险阶梯

并非所有的“锁定”程度都相同。我们可以将风险大致划分为三个等级,由轻到重,且每一级的锁定都具有不可逆性。

一级风险:轻度锁定 —— 有状态 API

代表:OpenAI 的 Responses API、Anthropic 的服务端上下文压缩。

对话状态(线程)存储在平台服务器上,且存储格式私有。如果你要更换模型提供商,你的历史对话线程将无法迁移。这是最轻量级的锁定,但已经开始建立初步的迁移成本。

二级风险:中度锁定 —— 闭源 Harness

代表:Claude Agent SDK(其底层的 Claude Code Harness 并不开源)。

记忆的存储方式、数据格式、内部逻辑全部是黑盒。你看不到、改不了,未来更换框架时,也无法直接读取原有的记忆文件。

这里有一个容易被忽略的细节:即使框架本身是开源的(如某些方案),但如果其生成的记忆压缩摘要是加密的,或者其格式与特定生态深度绑定,那么脱离原平台后,这些数据可能就是一堆无法解读的乱码。“开源框架 + 闭源记忆格式”,本质上仍然属于二级锁定。

三级风险:重度锁定 —— 全栈 API 封闭

代表:Anthropic 的 Claude Managed Agents。

这是目前最危险的形态。开发者对记忆拥有零可见性、零所有权。平台完全掌控了从 Harness 到记忆存储的全部环节。你不知道记忆具体是怎么存的,不知道它何时被压缩或清理,甚至不知道它是否被用于模型的再训练。你唯一能做的,就是继续付费使用。

从一级到三级,锁定的程度逐级加深。而你每向前走一级,都在用自己的时间成本和沉淀的数据,为对方平台的护城河添砖加瓦。

利益相关,不等于观点错误

说到这里,有必要说一句公道话。

Harrison Chase 是 LangChain 的创始人,Sarah Wooders 是 Letta 的核心推动者。两人都是开源 Harness 产品的倡导者。他们呼吁关注“记忆主权”,当然有其推广自家产品的商业动机。

但是,利益相关并不等于其论点错误。

51.2 万行闭源 Harness 源码是客观事实。通过记忆锁定用户的商业逻辑是客观事实。封闭 API 所带来的三级风险模型,也是可以被验证和推演的客观事实。

这就好比一个卖防盗锁的销售告诉你“你家门没锁好”——他确实想卖锁给你,但你家的门,可能真的没有锁好。

评估一个技术观点的正确性,我们应该看其背后的证据链是否扎实,而不是先入为主地去审视发言人的利益立场。

实战:记忆主权选型三问

理论讲了这么多,最终要落到实际操作上。如果你今天正准备为一个项目选择 AI Agent 框架,下面这三个问题必须向你自己、也向框架提供方问清楚:

1. 我的 Agent 记忆,是存储在我自己的服务器上,还是平台的服务器上?

如果答案是后者——那么你实质上并没有记忆主权。无论现在的文档如何承诺,服务条款(Terms of Service)的第37条随时可能被修改。

2. 记忆的数据格式是否开放、透明?未来更换框架时,能否正常读取和迁移?

私有格式等于隐性锁定。即使平台允许你“导出”数据,导出的可能也只是一堆只有原平台才能解析的专有二进制格式。

3. 进行跨平台迁移时,积累的个性化记忆能否被完整、无损地带走?

如果不能——那么你投入时间让 Agent 学习到的所有习惯和偏好,都将成为平台的资产,而非你的。

这三个问题,任何一个的答案是“不”或“不确定”,那么你很可能正在不知不觉中,让渡自己 Agent 的记忆主权。

结论

“封闭 API + 记忆锁定”的趋势,并非 Anthropic 一家独有的问题。这是整个大模型行业正在形成的共同趋势。OpenAI 在做,Google 在做,几乎所有的主要玩家都在向这个方向探索。

因此,选择 Agent 框架,早已不只是一个单纯的技术架构或工程效率决策。它实质上是一个关于 “记忆主权长期归属” 的选择。

我并非在鼓吹“开源一定正确,闭源一定错误”。作为一个实际工作中也会使用 Claude Code 等闭源工具来提高效率的实践者,我清楚地知道闭源产品在用户体验、集成度和开箱即用性上往往具备优势。

但我想强调的是:选择使用一个闭源的、记忆不透明的 Harness,就是在技术层面选择让渡对记忆的控制权。这不再是一个纯粹的技术选型,而是一个带有明确商业后果的选择。

你需要清楚地知道,自己究竟在选择什么。

记忆,是 AI Agent 生命周期中最具价值的资产。它不像一段代码可以重写,也不像一个模型可以随意替换。记忆是时间与交互的沉淀,是具有“网络效应”的、不可复制的数字资产。

谁真正控制了记忆,谁就控制了 Agent 的“灵魂”和未来。

那么,你确定要把这份宝贵的控制权,完全交给别人吗?

想了解更多关于AI Agent、开源框架与架构设计的深度讨论和实践分享,欢迎来 云栈社区 与更多开发者交流碰撞。