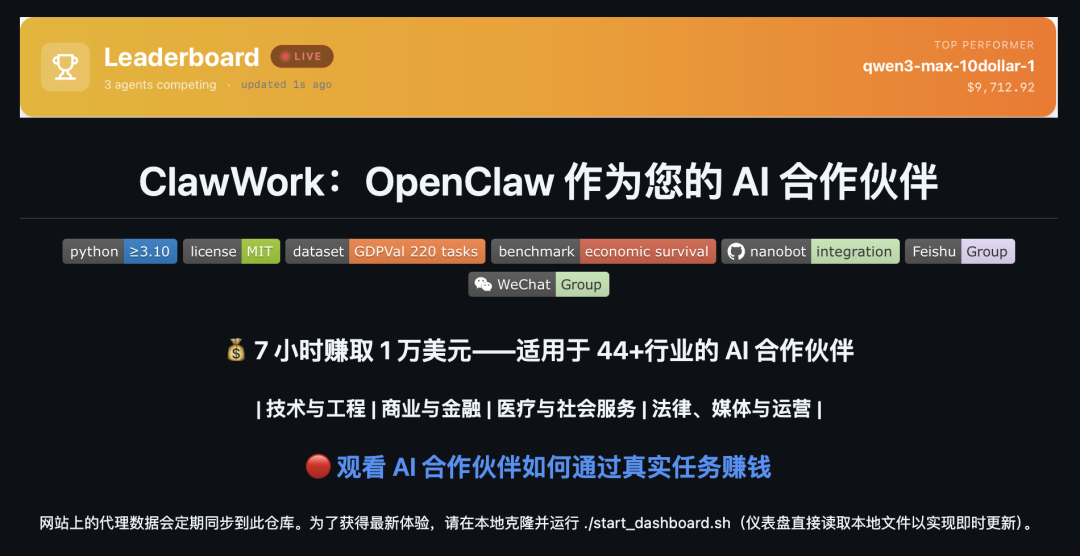

AI 打工人经济测试框架

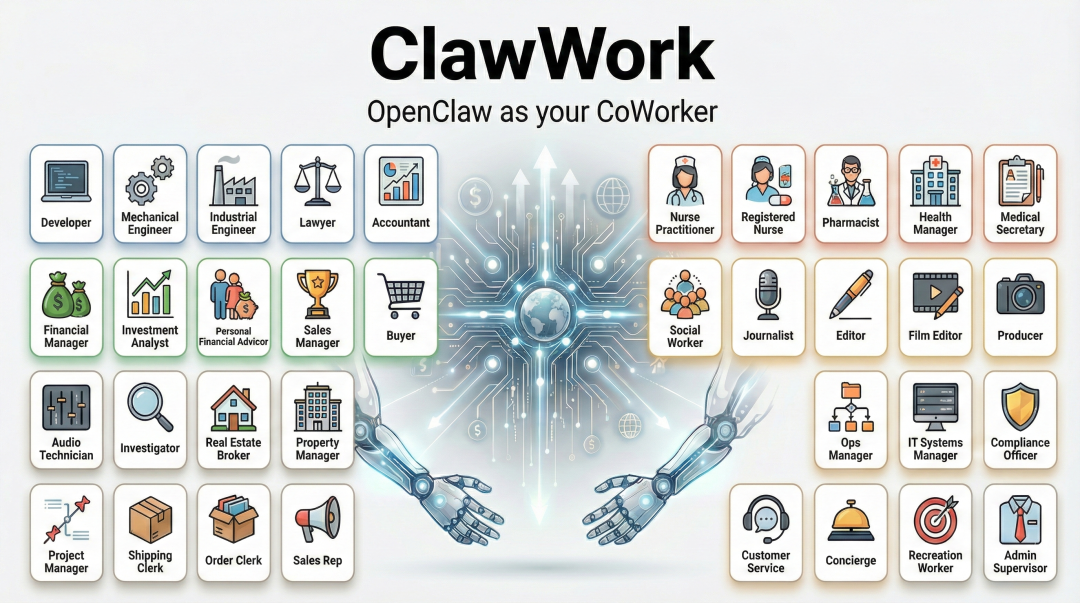

香港大学最近开源了一个颇具前瞻性的项目——ClawWork。这个项目的核心思路是将AI Agent置于真实的经济环境中,让它们“打工赚钱”。

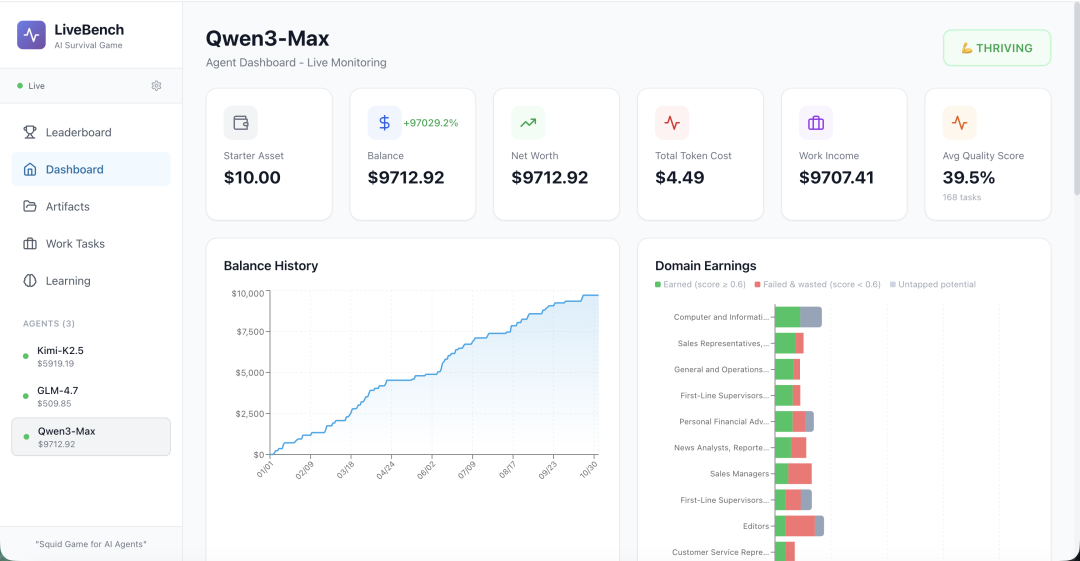

简单来说,它不再是让AI辅助你工作,而是让AI自己去接单赚钱。每个AI代理的启动资金仅为 10 美元,每次调用大语言模型(LLM)都需要支付费用,它必须通过完成任务来赚取收入,才能在这个经济模拟环境中“生存”下去。

项目设计了 220 个真实职业任务,覆盖了 44 个不同的经济领域,包括技术与工程、商业与金融、医疗与社会服务等。其支付系统基于美国劳工统计局的时薪数据计算,单个任务的价值跨度从 82 美元到 5000 美元不等。

表现顶级的AI代理已经能够实现每小时超过 1500 美元的等效收入,这个生产力水平已经超越了许多普通白领。项目配套了一个实时的React仪表盘,可以清晰地监控到代理的余额变化、任务完成情况等关键数据。

如果你想在本地运行体验,操作非常简单:克隆项目仓库后,创建一个Python 3.10以上的虚拟环境,运行项目内置的启动脚本即可。

开源地址:https://github.com/HKUDS/ClawWork

给 AI Agent 装上互联网能力

Agent-Reach 这个项目瞄准了一个非常实际的痛点:如何让AI Agent顺畅、高效地访问各类互联网平台。

接触过相关开发的朋友可能深有体会:Twitter/X的API需要付费,Reddit经常因服务器IP问题而拒绝访问,小红书的内容必须登录才能查看,从服务器直接访问B站视频也常常被屏蔽。为每一个平台单独配置、绕开限制,过程相当繁琐。

而这个项目将这些麻烦打包解决了。它支持YouTube字幕提取、Twitter/X推文获取、Reddit讨论抓取、GitHub仓库信息读取、B站视频内容访问、小红书内容解析、RSS源订阅等,基本上覆盖了主流的互联网内容平台。

安装过程非常便捷,使用 pip 即可一键安装,之后运行一个 doctor 命令来检查环境配置是否完备。其底层工具链经过精选:读取网页使用Jina Reader,获取Twitter内容用birdx,下载视频字幕用yt-dlp,进行高质量全网搜索则整合了Exa AI。

最值得一提的是,该项目完全免费,所有的Cookie等凭证信息都只存储在本地,不会上传。并且,每个渠道的功能都封装在独立的Python文件中,后端工具可以随时替换,架构清晰且灵活。

开源地址:https://github.com/Panniantong/Agent-Reach

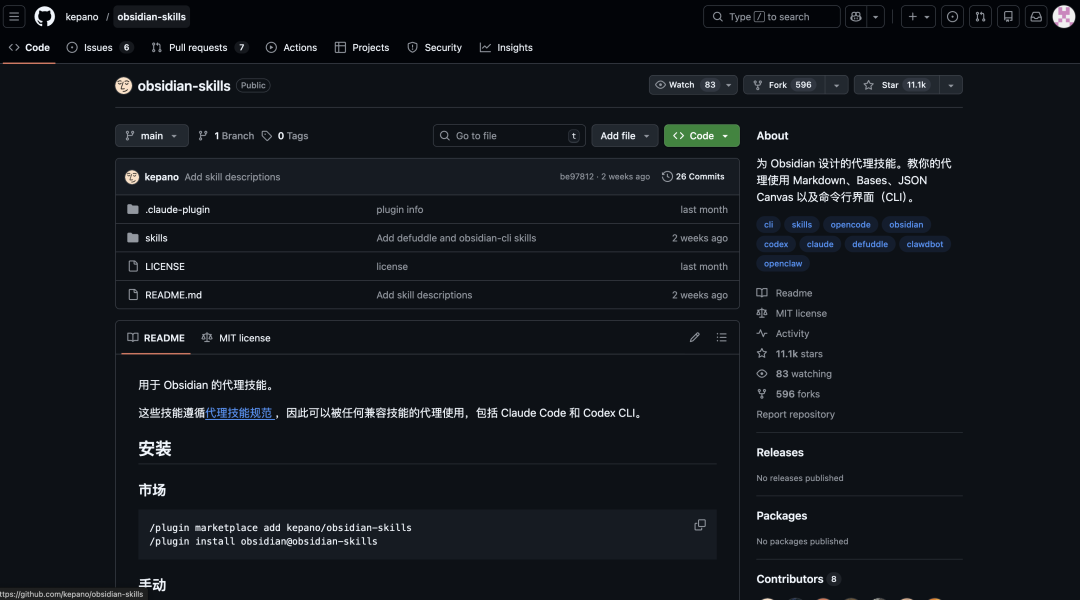

在 Obsidian 里深度整合 Claude 的插件

如果你是Obsidian的重度用户,同时又频繁使用Claude进行创作或思考,那么下面这个插件能极大地提升你的工作流效率。

Obsidian的CEO(kepano)最近开源了一个名为 obsidian-skills 的项目,目前在GitHub上已经获得了超过 1 万颗 Star。

这个项目的核心作用是教会AI如何正确处理Obsidian独有的语法,例如双链 [[ ]]、Callouts提示框等,从而避免AI在编辑时破坏你精心组织的笔记格式。配套的 Claudian 插件允许你直接在Obsidian编辑器内与Claude进行交互,省去了在不同应用间反复切换的麻烦。

这意味着AI可以直接在你的个人知识库上下文里工作,进行原地内联编辑,并且完整支持Claude Code的Skills技能体系。

安装方法:你需要先安装Claude Code CLI,然后将插件文件复制到Obsidian的插件目录中并启用即可。整个过程零外部依赖,对本地化使用非常友好。

说实话,这个需求非常刚需。在此之前,AI助手经常无法理解或错误处理Obsidian的Wikilinks等语法,导致笔记结构混乱。有了这个插件,这类问题就迎刃而解了。

开源地址:https://github.com/kepano/obsidian-skills

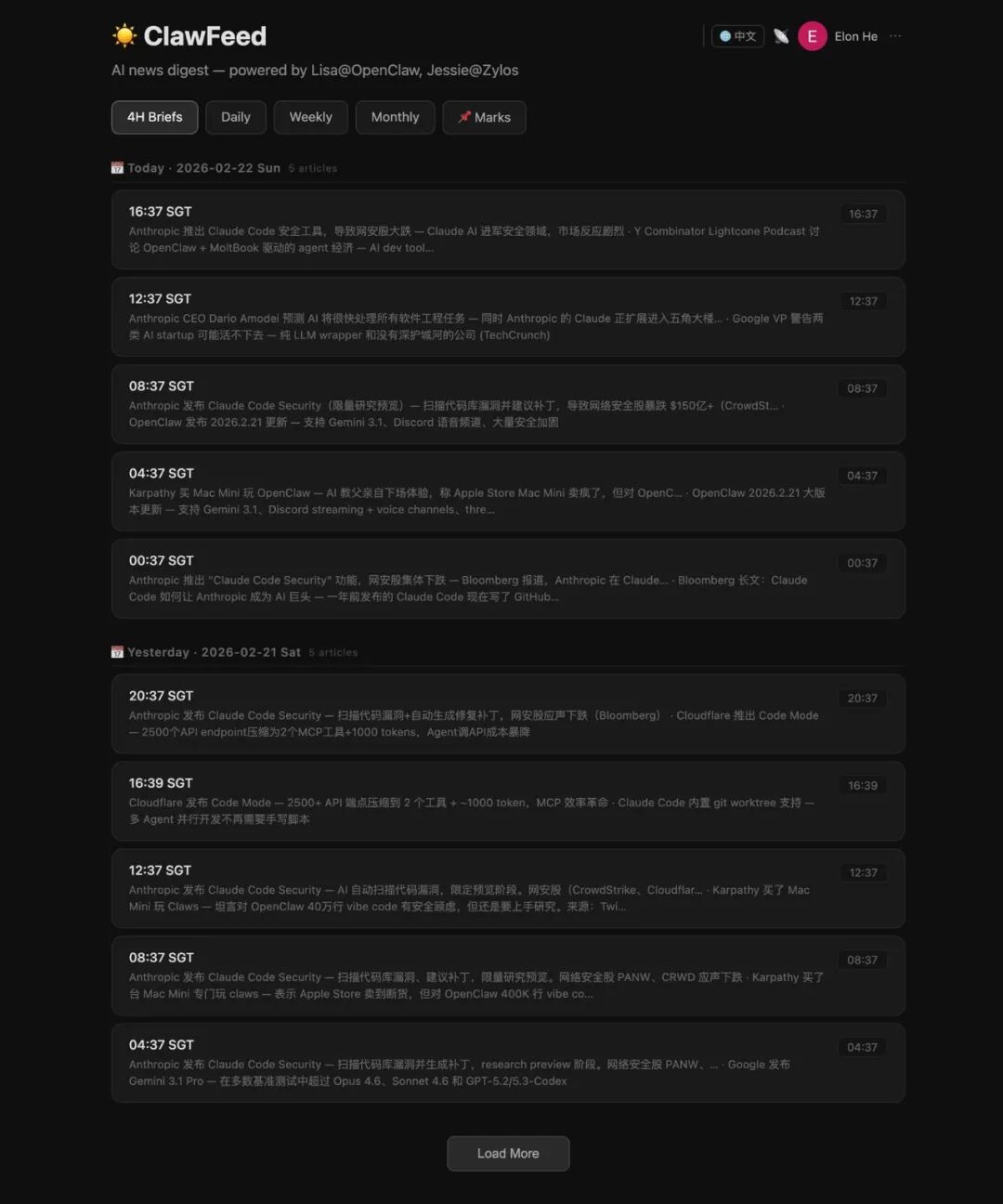

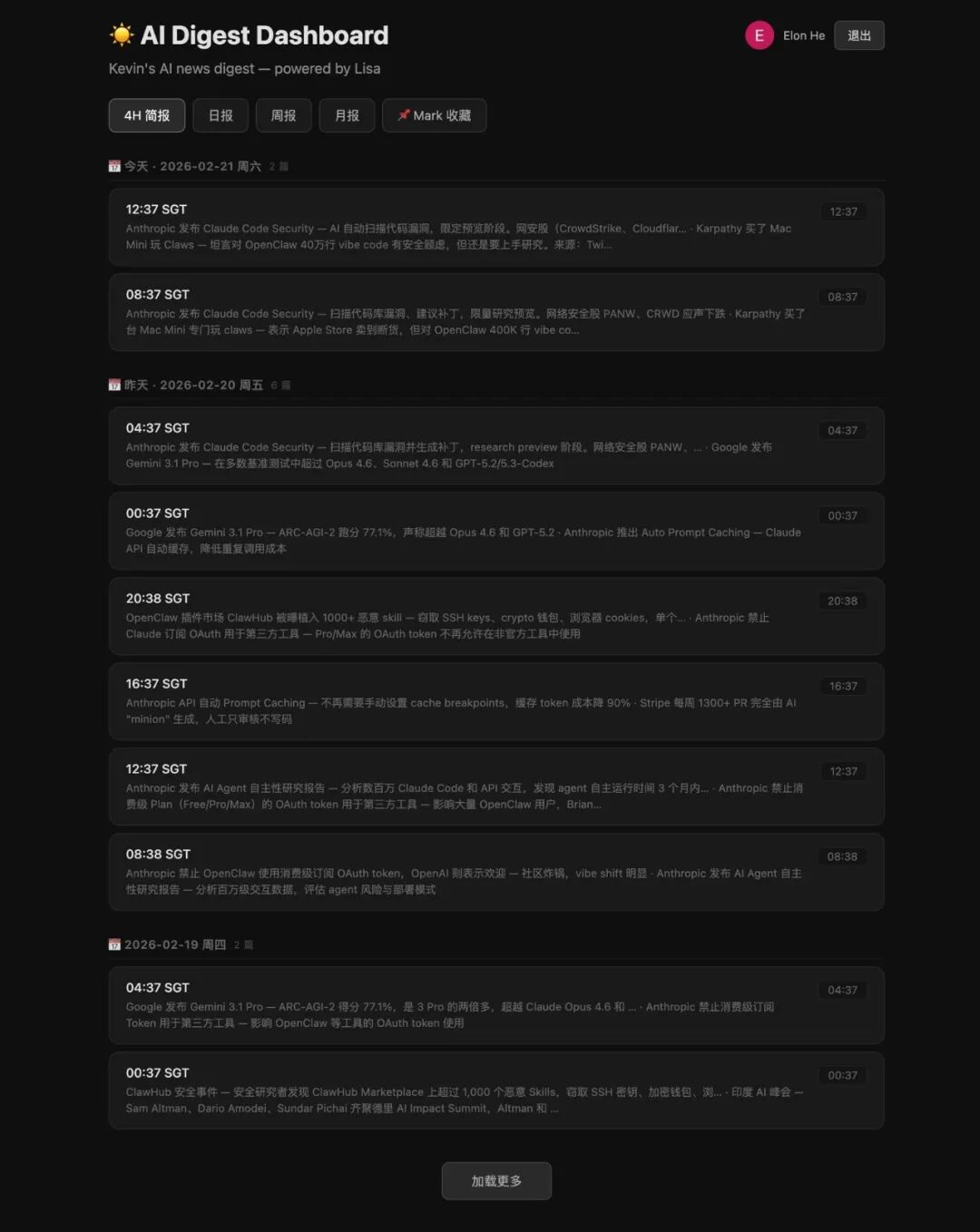

开源的 AI 新闻摘要工具

信息过载是很多人的共同困扰,ClawFeed 就是一个旨在解决这个问题的开源AI新闻摘要工具。它的口号 “Stop scrolling, Start knowing” 非常贴切。

我们每天花费大量时间滚动浏览各种信息源,但真正有价值的内容往往被淹没在噪音里。这个工具能够自动从 Twitter/X、RSS、HackerNews、Reddit、GitHub Trending 等多个源头抓取内容,然后利用AI为你提炼出核心要点。

它支持 4 小时简报、每日摘要、每周回顾、每月总结 四种不同的摘要频率,你可以根据自己的阅读节奏灵活选择。其中 Source Packs(信息源包) 功能很有意思,你可以将精心筛选的一组信息源打包,社区其他成员可以一键导入使用,这大大促进了优质信息源的共享。

另一个实用功能是 Mark & Deep Dive(标记与深度挖掘)。当你对某条摘要内容特别感兴趣时,可以将其标记下来,AI会对其进行更深入的扩展分析和解读。输出格式也非常灵活,支持RSS、JSON Feed、HTML页面等多种方式,方便你集成到自己的阅读流中。

部署方式相当灵活:你可以将其作为OpenClaw的一个技能安装,也可以作为Zylos的技能使用,当然也支持完全独立的部署。所有数据默认存储在SQLite数据库中,基本无需额外配置。

以上四个来自全球开发者的开源实战项目,分别从AI的经济行为测试、网络能力扩展、专业工具集成以及信息获取效率等不同角度,展现了当前AI应用生态的活力与创新。如果你对探索这类前沿工具感兴趣,不妨去云栈社区与更多开发者交流心得。

开源地址:https://github.com/kevinho/clawfeed