一句话总结:不用重新训练,就能在各种数据集、各种服装类型、甚至动漫角色上实现高质量虚拟试穿,OmniVTON++ 做到了!

传统虚拟试穿方法通常针对特定数据集优化,面临三大挑战:

- 服装对齐难:平铺商品图 → 人体穿着状态,几何形变复杂

- 结构一致性差:试穿后人体姿态、肢体比例容易失真

- 边界不连续:服装与皮肤/背景交界处容易出现伪影

更关键的是,现有方法往往需要针对新场景重新训练,部署成本高、泛化能力弱。由中国海洋大学、南京理工大学、新加坡管理大学以及哈尔滨工业大学(深圳)的研究团队联合提出的OmniVTON++ 的核心思想很直接:既然训练成本高,那干脆不训练了——通过精心设计的推理时模块,实现「即插即用」的通用试穿。在保持 SOTA 效果的同时,实现了前所未有的泛化能力。

如果你也在做 AIGC、虚拟人、电商视觉相关方向,强烈建议关注这个工作,代码开源后可以第一时间在 云栈社区 等平台交流实践经验。

相关链接

论文介绍

随着数字时尚和电商领域的快速发展,虚拟试穿技术成为了行业关注的焦点。但现有的虚拟试穿方法大多依赖于特定的训练集,这就像给模型戴上了一副“有色眼镜”,只能适应特定的场景和数据分布。一旦输入数据的分布发生变化,比如光照、背景或服装形态不同,模型的效果就会大打折扣。为了打破这种局限,研究团队提出了 OmniVTON++这一创新性的通用虚拟试穿框架,旨在实现无需针对性训练就能在多种复杂场景下实现高质量的试穿效果。

方法概述

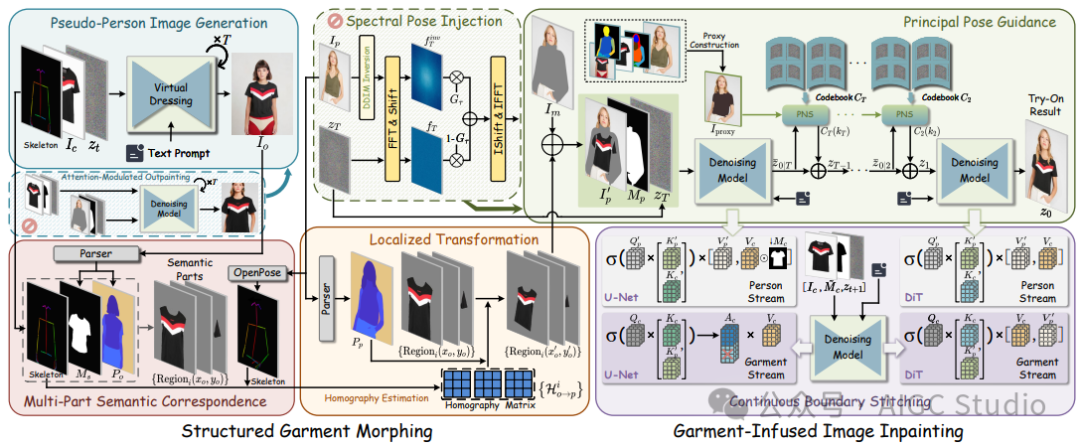

整个框架围绕三大核心模块构建:结构化服装变形(SGM)、主成分姿态引导(PPG)、以及连续边界缝合与 DiT 适配(CBS & PIR)。这套组合拳,让基于扩散模型的生成过程变得可控且精准。

结构化服装变形(SGM)

要把平铺的衣服自然地“穿”在不同姿态的人身上,几何对齐是关键的第一步。研究团队提出了结构化服装变形(Structured Garment Morphing, SGM)方法。在之前的版本中,团队使用 Outpainting 策略,但效果不稳定。

在 ++ 版本中,他们引入了一个预训练的服装中心虚拟试穿模块(Virtual Dressing),先生成一张标准姿态(A-pose)的“伪人像”,就像找了个虚拟模特先穿上衣服,为后续变形提供稳定的几何参考。

然后,利用人体骨架和解析图,将衣服划分为躯干、左右手臂等解剖学部位,再针对每个部位,通过单应性矩阵(Homography Matrix)进行局部变形。这种“分而治之”的策略,比传统的全局 TPS 变换更能处理大角度的姿态变化。

主成分姿态引导(PPG)

在扩散模型的采样过程中,如何确保生成的人体姿态不走样是一个难题。训练型模型通常靠大量数据来解决这个问题,而 OmniVTON++ 引入了主成分姿态引导(Principal Pose Guidance, PPG)机制。

简单来说,PPG 会将输入的人体姿态编码成一个低维的、稳定的“姿态代码本”。在去噪过程的每一步,这个代码本都会作为条件输入,引导模型朝着正确的姿态方向生成。通过这种方式,模型在保证姿态绝对准确的同时,给服装纹理的生成留下了足够的自由度,就像给姿态戴上了一个“精准的指南针”,确保在生成过程中姿态始终稳定。

连续边界缝合与 DiT 适配(CBS & PIR)

由于 SGM 是分块变形的,拼接处难免会有断裂。连续边界缝合(Continuous Boundary Stitching, CBS)通过双流注意力机制,让人物流和服装流在生成时互相“沟通”,从而消除接缝。

此外,针对 FLUX 等基于 Transformer 架构 的扩散模型(DiT),作者还解决了一个深层难题:位置索引重对齐(Positional Index Realignment, PIR)。在 DiT 中,不同输入的 Token 如果共享旋转位置编码(RoPE)会产生歧义,导致衣服长到背景里。PIR 通过重新分配索引范围,让模型能清晰分辨“这是衣服”和“这是人体”,完美解决了 DiT 架构下的试穿伪影。关于这类模型架构的深入解析,可以参考 技术文档 中的相关内容。

实验

研究团队在 VITON-HD、DressCode 和 DeepFashion2 等多个主流基准上进行了严苛的测试。

在性能表现方面,在 VITON-HD 数据集上,基于 FLUX 底座的 OmniVTON++ 取得了 FID 6.618 的惊人成绩。要知道,很多需要海量数据训练的模型,FID 还在 10 甚至 20 左右徘徊。

在跨场景泛化方面,在复杂的街拍场景(StreetTryOn)中,OmniVTON++ 展现了极强的鲁棒性,FID 指标全面领先。

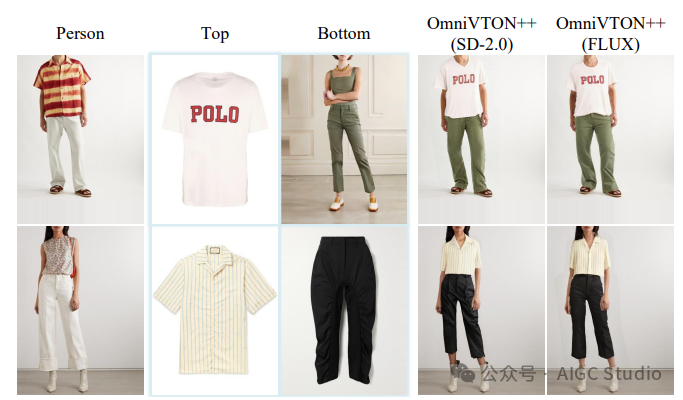

此外,除了常规的单人试穿,OmniVTON++ 还支持多人试穿、多件叠穿以及动漫换装等多种高阶玩法。

- 多人试穿:同一张图中多个人可以同时换装,互不干扰。

- 多件叠穿:可以同时更换上衣和下装,解决“套装”试穿难题。

- 动漫换装:可以直接给二次元角色穿上三次元的衣服,且画风毫不违和,这为同人创作和游戏设计提供了巨大的想象空间。

结论

OmniVTON++ 的出现,标志着虚拟试穿技术正在从“特定场景微调”向“通用零样本推理”跨越。它不仅在技术指标上表现强悍,更重要的是其 Training-free 的特性极大降低了应用门槛。

对于开发者和研究者来说,这意味着不再需要昂贵的算力去针对每个新场景训练模型,只需调用现成的扩散模型并加上这套精心设计的插件逻辑,就能获得工业级的试穿效果。这不仅在电商领域有巨大应用潜力,也为数字人、游戏、影视特效等领域的AIGC应用打开了新思路。相信该框架开源后,会成为相关领域一个重要的基础工具。