在上篇文章中,我们探讨了Function Calling、RAG、Search这三个基础概念,它们是理解AI交互逻辑的基石。今天,我们将视角转向更高阶、更接近应用落地的四个核心术语:Memory、Workflow、Skills以及MCP(Model Context Protocol)。它们分别代表了AI实现长时记忆、自动化流程、专业化能力以及跨系统互联的关键支撑,是构建复杂、实用AI应用的四大支柱。后续内容将以此为基础,深入探讨这些技术的组合应用与实战。

下面,我们逐一拆解。

一、Memory:AI的记忆中枢

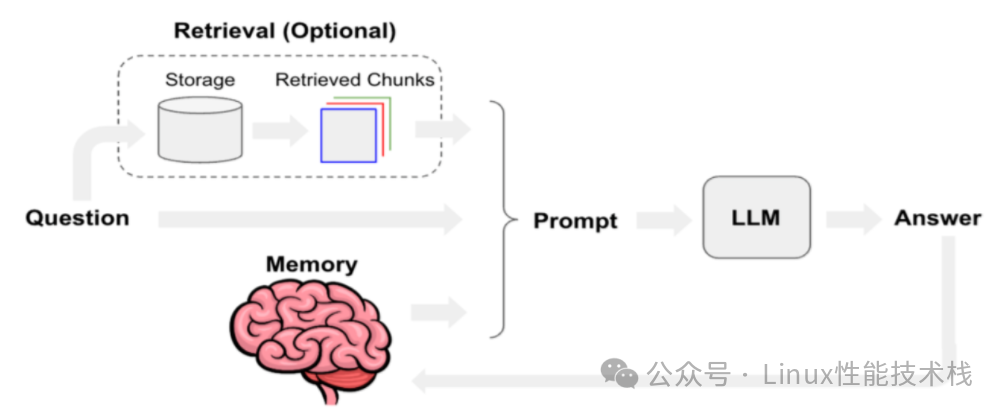

Memory,即AI的记忆模块。它并非一个独立的大模型,而是大模型应用中负责存储、管理和调用历史交互信息与任务数据的核心组件。你可以将其理解为AI的“大脑记忆区”,专门解决传统对话模型“聊完即忘”、无法关联上下文的问题,让AI能够记住用户偏好、对话历史、任务进度,从而实现连贯且个性化的智能交互。

举个例子:当你让AI助手规划旅行时,前半段沟通了目的地和预算,后半段它就能直接基于这些信息推荐景点和行程,无需你重复说明。这背后,就是Memory在发挥作用。没有Memory的AI只能进行单次、孤立的应答;有了Memory,AI才能提供多轮、长期、懂你的智能服务。

Memory的核心逻辑

其核心逻辑可归纳为三点:分层存储、动态调用、持续更新。通过将信息分类管理,并在需要时精准提取,确保AI始终基于完整的情境做出响应。

- 信息存储:将交互过程中的对话上下文、用户偏好、任务状态等信息,区分为短期临时记忆(如当前会话)和长期固定记忆(如用户习惯)进行分类存储。

- 动态提取:当AI响应用户新请求时,会自动从记忆库中检索相关的历史信息,与当前输入结合,形成一个完整的理解背景。

- 更新优化:随着交互持续进行,记忆内容会实时更新,淘汰过时或无效的临时信息,强化关键的长期信息,避免信息冗余拖累响应效率。

简而言之,Memory就像是AI的智能记事本,既记“流水账”,也存“个人档案”,让AI从一个只会单次应答的工具,转变为懂你需求的智能伙伴。

Memory的关键特点

- 记忆分层,兼顾效率与精准:短期记忆专注当前对话,保证响应速度;长期记忆存储固定偏好,保障交互个性化。二者结合,平衡了效率与精度。

- 上下文连贯,适配多轮交互:无论对话多长、步骤多复杂,都能精准衔接前后信息,不会出现逻辑断层或需求遗忘。

- 轻量化调用,不影响响应速度:采用高效的存储与检索机制,即使记忆内容增多,也不会显著拖慢AI的响应速度。

- 个性化适配,贴合用户需求:能够沉淀用户专属信息(如常用格式、写作风格),让AI的输出更贴合个人或企业的特定要求。

二、Workflow:AI的任务执行蓝图

Workflow,即AI工作流。它是将复杂任务分解为一系列有序步骤,并预设执行规则与分支逻辑的标准化流程框架,是实现任务自动化的核心。简单说,它就是AI完成复杂任务的“行动路线图”,明确规定先做什么、后做什么、满足什么条件时执行什么操作,使得多步骤任务能够自动流转,无需人工步步跟进。

例如,在企业报销流程中,没有Workflow需要人工提交、核对、审批。而基于Workflow,AI可以自动执行“提交申请 → 核验票据 → 根据规则审批 → 归档并触发打款”这一系列步骤,遇到异常情况自动转入分支处理,实现全流程自动化。

Workflow的核心逻辑

其核心逻辑围绕任务拆解、步骤编排、条件判断和自动流转展开。

- 任务拆解:将一个宏大的、复杂的任务,分解为多个单一、可执行的基础原子操作。

- 步骤编排:根据任务的内在逻辑,设定各个原子操作的执行顺序和衔接关系。

- 条件判断:设置分支规则,例如“步骤A成功则进入B,失败则重试或转人工”。

- 自动流转:所有步骤按照既定规则自动执行,形成从启动到闭环的自动化流水线。

Workflow就像是给AI一本详细的“标准作业程序”(SOP),让复杂混乱的操作变得有章可循,从依赖人工驱动转向系统自动驱动。

Workflow的关键特点

- 流程标准化,执行无偏差:将任务固化为一套标准流程,确保每次执行都遵循相同的规则,避免因人为操作或AI随机性导致的输出不一致。

- 支持分支与循环,适配复杂场景:可配置复杂的分支逻辑和循环机制,以应对任务中的各种异常情况和重复性操作,灵活适配办公、运维、业务处理等多种场景。

- 全流程自动化,减少人工干预:从任务触发到结果产出全程自动运行,仅在极少数异常情况下需人工介入,极大提升效率,降低人力成本。

- 执行可追溯,方便优化调整:完整记录每个步骤的执行状态、结果与耗时,便于问题定位和基于数据的流程持续优化。

三、Skills:AI的专业技能库

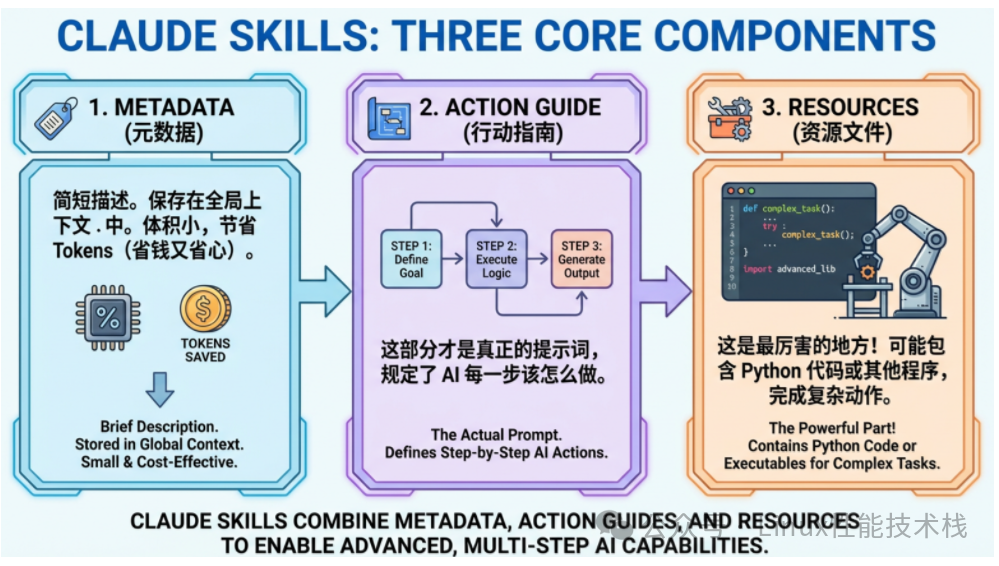

Skills,即AI技能。它是将某一特定领域的实用能力封装而成的标准化、可复用的功能单元,是AI从通用对话走向垂直领域专业化的关键载体。通俗地讲,每个Skill就是AI掌握的一项“手艺”或“绝活”,让AI能完成专业任务,而不仅仅是进行文字交流。

例如,AI可以具备“文档总结”、“图像生成”、“数据清洗”、“邮件自动发送”等Skills。当用户需要相应功能时,直接触发对应技能即可,就像人类调用不同的专业技能一样。这使得AI的实用价值大大增强。

Skills的核心逻辑

其核心在于能力封装、指令触发和精准执行,实现“即插即用”。

- 能力封装:将某个垂直领域的单一操作(如PDF解析、代码格式化、调用某API)打包成一个独立的、标准化的技能模块。

- 指令触发:用户通过自然语言下达指令,或AI在工作流中判断需要时,自动匹配并调用对应的技能。

- 精准执行:技能被调用后,严格按预设逻辑运行,输出标准化的结果,并能无缝接入到其他任务环节中。

Skills让AI从一个“博而不精”的通才,转变为拥有多种“专业工具箱”的专家。

Skills的关键特点

- 专业化,聚焦垂直能力:每个Skill只专注于一个细分领域,其输出结果比通用AI模型更加精准、可靠,更符合专业要求。

- 可复用,降低开发成本:封装好的技能可以在不同的应用、不同的工作流中被反复调用,避免了重复开发,显著降低了构建AI应用的成本。

- 易扩展,灵活新增能力:可以根据业务需求,随时为AI“安装”新的Skills(如新增“会议纪要提取”、“竞品数据监控”),让AI的能力持续进化。

- 即插即用,适配性强:可以很方便地集成到如 LangChain、Agent等主流AI应用框架中,快速赋予应用专业能力。

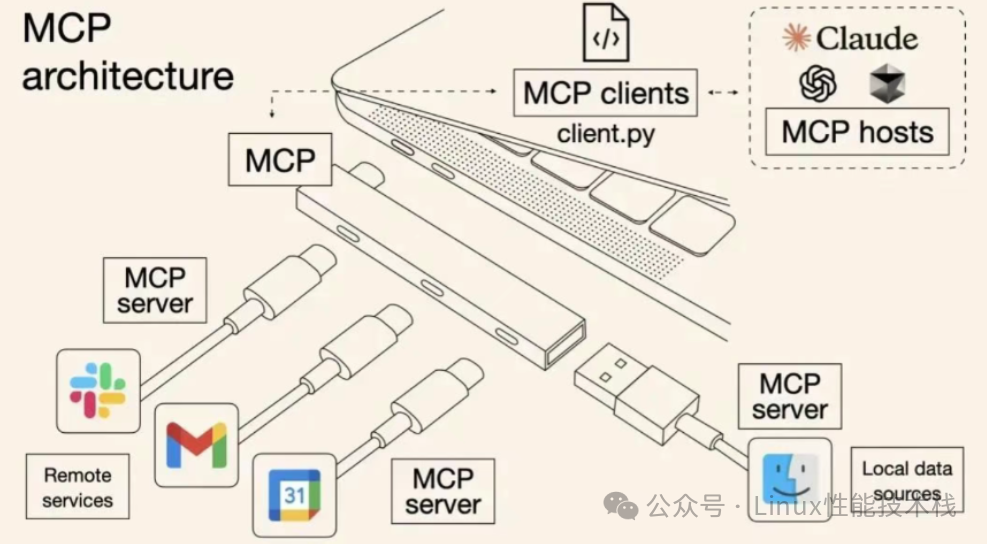

四、MCP:模型上下文协议

MCP(Model Context Protocol,模型上下文协议)是Anthropic于2024年底推出的一项开放标准。它的核心定位是统一大模型与外部数据源、工具服务之间的通信协议,旨在解决因“数据孤岛”导致的AI能力受限问题。简单理解,MCP就是AI连接万物的“标准化插头”和“通信语言”,让AI应用能够安全、便捷地访问和操作本地及远程的各类资源(文件、数据库、API等),是支撑AI Agent实现高度自动化的关键底层设施。

MCP的核心优势与价值

- 开放标准,打破垄断:作为开放协议,它不绑定任何特定厂商或框架,有利于生态发展,实现跨平台、跨模型的通用兼容。

- 避免重复造轮子:开发者可以直接复用社区已有的MCP服务(Server),快速为AI Agent增添新能力,无需从零开发对接逻辑。

- 打破数据孤岛:让AI能直接、安全地与本地文件、企业系统、互联网API进行交互,而非仅通过上传、复制等低效方式。

- 赋能AI Agent自动化:作为Agent的“服务发现中心”,为其提供可用工具和数据源的实时信息,使Agent能自主决策并调用资源,完成复杂任务。

MCP与Function Calling的核心区别

两者都用于增强AI与外部世界的交互,但定位和层级不同。Function Calling是单个大模型“内置”的对外调用机制;而MCP是“模型之上”的、统一各种资源接入的“开放协议”。

| 类别 |

MCP (模型上下文协议) |

Function Calling (函数调用) |

| 性质 |

开放的通信标准 |

模型内置的功能调用机制 |

| 范围 |

通用型,支持多数据源、多功能集成 |

特定型,通常适配单一数据源/功能场景 |

| 目标 |

统一接口,实现多组件互操作 |

扩展单个大模型的外部调用能力 |

| 实现 |

基于标准化协议,跨框架通用 |

依赖特定大模型原生实现,无统一标准 |

| 开发复杂度 |

低,一次开发,多场景兼容 |

高,常需为不同任务开发专属函数 |

| 复用性 |

高,标准化能力可跨应用、跨模型复用 |

低,函数多为特定任务设计,复用性差 |

| 灵活性 |

高,支持动态适配、按需扩展 |

低,功能扩展需重新开发并对接模型 |

| 常见场景 |

复杂场景,如跨平台数据访问、多Agent协同 |

简单场景,如单一工具调用、单数据源查询 |

补充说明:一个强大的AI Agent会同时利用MCP(获取有哪些资源可用)和Function Calling(执行具体的资源调用操作),三者形成“协议 + 机制 + 智能体”的协同关系。

MCP的核心架构与工作原理

MCP采用经典的客户端-服务器(C/S)架构,主要由五大组件协同工作:

- MCP Hosts(主机):运行大模型的应用本身,如Claude Desktop、Cursor IDE等,它们是MCP协议的发起方和使用者。

- MCP Clients(客户端):内嵌在Host中的组件,与MCP Server保持一对一连接,是模型与服务器之间的通信桥梁。

- MCP Servers(服务器):架构的核心,负责向客户端提供上下文信息、工具列表和提示词资源,是安全访问资源的核心管控节点。

- 本地资源:MCP Server可安全访问的本地计算机资源,如文件系统、本地数据库等。

- 远程资源:MCP Server可通过网络访问的外部资源,如Web API、云数据库、Slack、Gmail等服务。

这种架构使得AI应用可以通过标准化的方式,动态发现并利用部署在本地或远程的无数个MCP Server所提供的能力。

总结

用一句话概括:Memory是AI的记忆中枢,为智能交互提供信息支撑;Workflow是AI的执行蓝图,让复杂任务自动化有序流转;Skills是AI的专业本领,赋予其垂直领域的实战能力;而MCP则是AI的“万能连接器”,通过标准化协议为AI应用打通连接万物、互联互通的接口。

理解这四大核心技术,是设计和开发下一代智能、自动、实用的AI应用的关键。它们共同构成了现代 AI Agent 和复杂AI系统的基石。对这类前沿技术的深入探讨和实践分享,欢迎持续关注 云栈社区 的相关板块,这里聚集了大量开发者共同交流成长。在接下来的内容中,我们将探讨如何将这些技术组合使用,一步步进入实战落地环节。