面对近期OpenAI的一系列动态,我不得不再次将目光投向这家曾经备受推崇的AI领军企业。一些读者或许认为我对此有所偏颇,但每一次新的动向,都让我感到有深入探讨的必要。

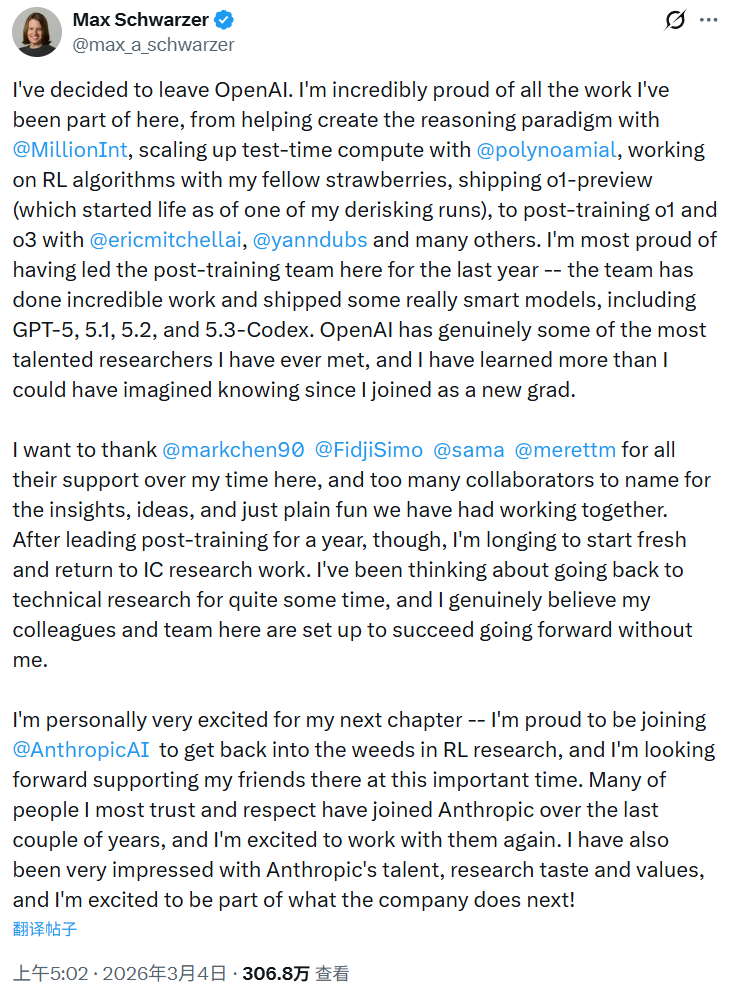

就在几天前,OpenAI发生了一次震动业界的人事变动。公司研究副总裁Max Schwarzer在社交媒体上公开宣布离职。

作为OpenAI推理路线上的关键人物,他的履历颇具分量。他是o1推理模型的早期参与者之一,o1-preview的雏形便源自他的一次实验性训练。随后,他主导了o1和o3模型的后训练,并在过去一年领导了整个后训练团队,负责交付了包括GPT-5、5.1、5.2和5.3-Codex在内的一系列重要模型。他的离去,本身就是一个强烈的信号。

更值得玩味的是他离职后的去向。

他选择加入的是Anthropic,也就是开发Claude的那家公司。他在公告中意味深长地写道:“过去几年里,我最信任和尊敬的许多人,都加入了Anthropic,我很期待再次与他们合作。”这几乎是在明示,OpenAI内部一股重要的人才和技术思潮,正在向竞争对手转移。

而这一切,发生在一个极其微妙的时间点——OpenAI刚刚官宣与五角大楼签署合作协议不久。

此消息一出,舆论哗然。据称,ChatGPT短期内卸载量激增,大量付费用户选择离开。与此同时,Anthropic则公开拒绝了与五角大楼续签合同,明确表示这触及了公司关于大规模监控和自主武器的红线。两家公司在同一议题上做出了截然相反的选择,而OpenAI的核心技术领袖,却在此刻转身投向了持反对立场的一方。

这绝非孤例。如果我们把时间线拉长,会发现OpenAI顶尖人才的流失早已不是新闻。

一、持续的人才出走潮

在Max Schwarzer之前,今年年初,另一位重量级人物——研发副总裁Jerry Tworek也宣布离职。

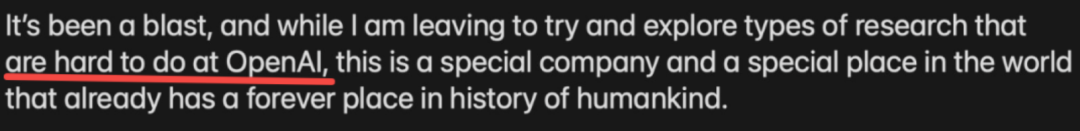

他在OpenAI工作了近七年,几乎陪伴公司走过了整个成长周期。他是编程奠基模型Codex的核心成员,o1推理模型的带头人,并深度参与了GPT-4、GPT-5和ChatGPT Agent的开发。他的离职声明中有一句引人深思的话:“我想探索那些在OpenAI内部难以开展的研究类型。”

这委婉的表述,暗示了公司在研究方向或环境上可能发生的转变,让一些顶尖研究者感到掣肘。

我们再向前追溯:

- Dario Amodei: OpenAI前研究副总裁,于2021年离职并创立了Anthropic,如今成为OpenAI最强劲的竞争对手之一。

- Ilya Sutskever: OpenAI联合创始人兼首席科学家,这位公司的缔造者之一,在经历那场著名的“宫斗”逼宫失败后,最终选择离开。

- Jan Leike: 超级对齐团队负责人,于去年用一句简短的“我辞职了”摔门而去,表达了对公司安全优先级的强烈不满。

当这些名字——从联合创始人到各技术路线的领军者——接连离开,并且相当一部分人离职的原因都指向“理念不合”时,我们很难再将之视为偶然。那个以“确保AGI造福全人类”为使命的理想主义OpenAI,其内核似乎正在消散。

二、用户信任的瓦解

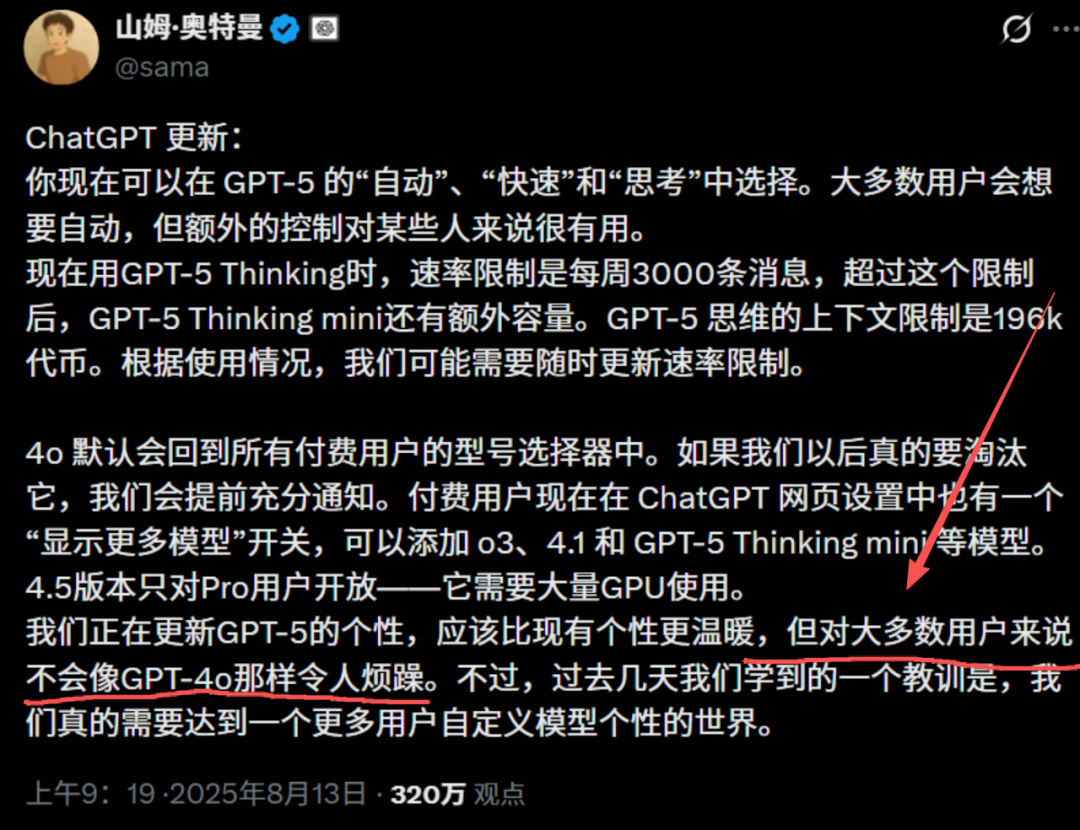

OpenAI与用户之间的裂痕,并非始于今日。去年,公司试图下架备受喜爱的GPT-4o模型,就曾引发用户的强烈不满和广泛抗议。

从激烈的网络嘲讽到温和的万人请愿,用户的声音此起彼伏。然而,OpenAI最终选择了沉默,并在今年2月13日让GPT-4o正式告别。

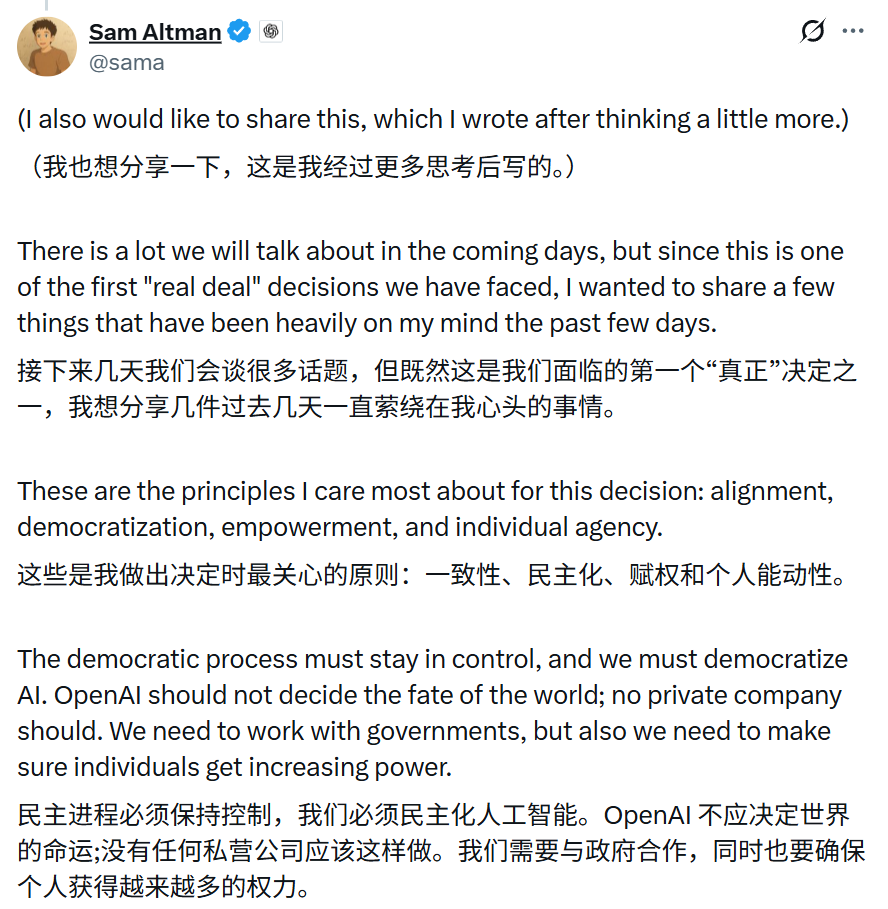

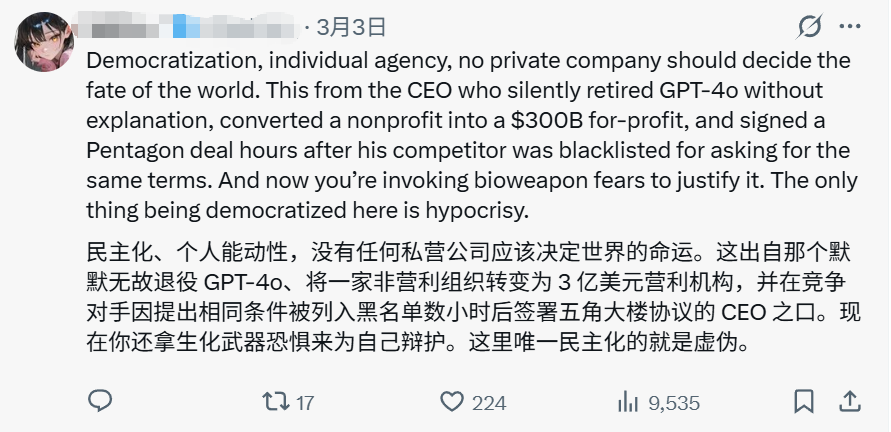

此次与五角大楼的合作,则彻底点燃了全球用户社区的怒火。社交媒体上批评声浪高涨,卸载和退订潮再次出现。有评论尖锐地指出:“这出自那个默默退役GPT-4o……并在竞争对手被列入黑名单数小时后签署五角大楼协议的CEO之口。现在你还拿生化武器恐惧来为自己辩护。这里唯一民主化的就是虚伪。”

用户的反馈清晰地表明,问题核心不在于技术迭代,而在于信任的崩塌。当一家公司被认为不再倾听用户声音,其决策优先考虑商业与政治利益而非社区价值时,流失的就不仅是订阅费,更是其立身之本。

与此形成对比的是,Anthropic在此次事件中选择了明确的立场。公司不仅公开拒绝相关合作,其CEO Dario Amodei甚至在内部备忘录中将OpenAI的行为定性为“安全作秀”,强调自身关心的是防止技术滥用。

当然,商业世界瞬息万变。有媒体报道称Anthropic可能与五角大楼重启谈判。但在当前这个节点,它的公开表态至少为用户和业界树立了一个不同的参照。这也让Max Schwarzer等人才的流向,多了几分“用脚投票”的象征意义。

三、理想的褪色与技术的宿命

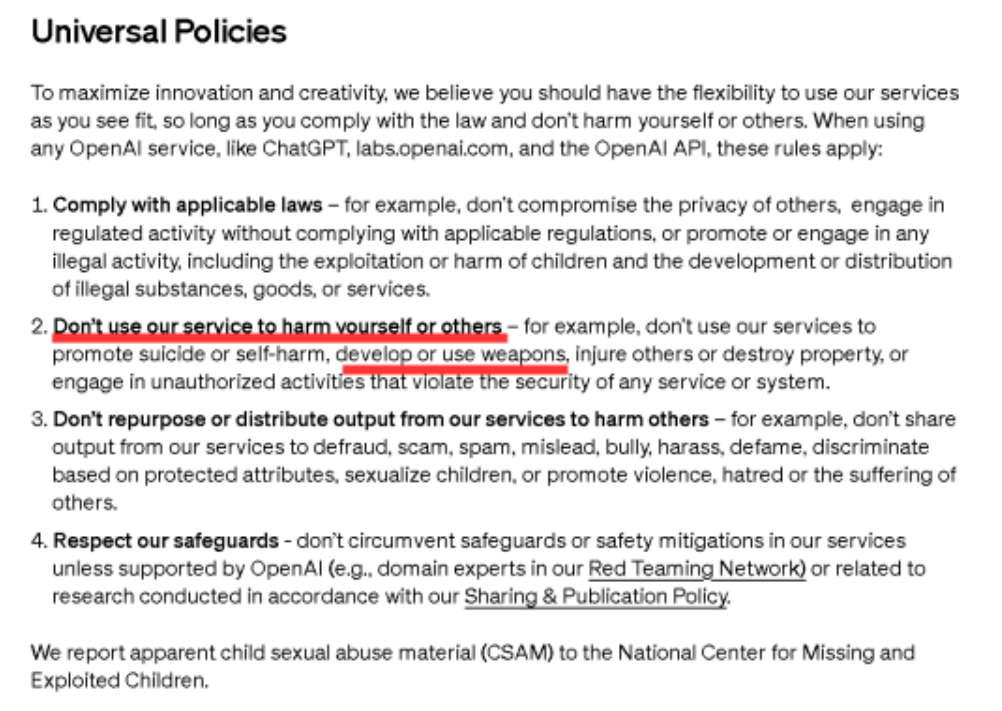

回顾OpenAI的演变轨迹,令人感慨。其最初的使命宣言是确保AGI造福全人类,早期政策也曾白纸黑字禁止技术用于军事和战争。

然而,变化悄然发生:

- 2023年,OpenAI悄悄修改了使用政策,删除了“不得用于军事和战争”的明确条款,替换为更笼统的“不得开发武器、伤害他人”。

- 2024年1月,媒体曝出OpenAI已删除军事禁令,为后续合作铺平道路。

- 2024年6月,OpenAI被曝与美国国防部签署合作协议,称其为“非攻击性用途”。

- 2025年11月,OpenAI成立国家安全团队,Sam Altman公开表态AI领先关乎美国国家安全。

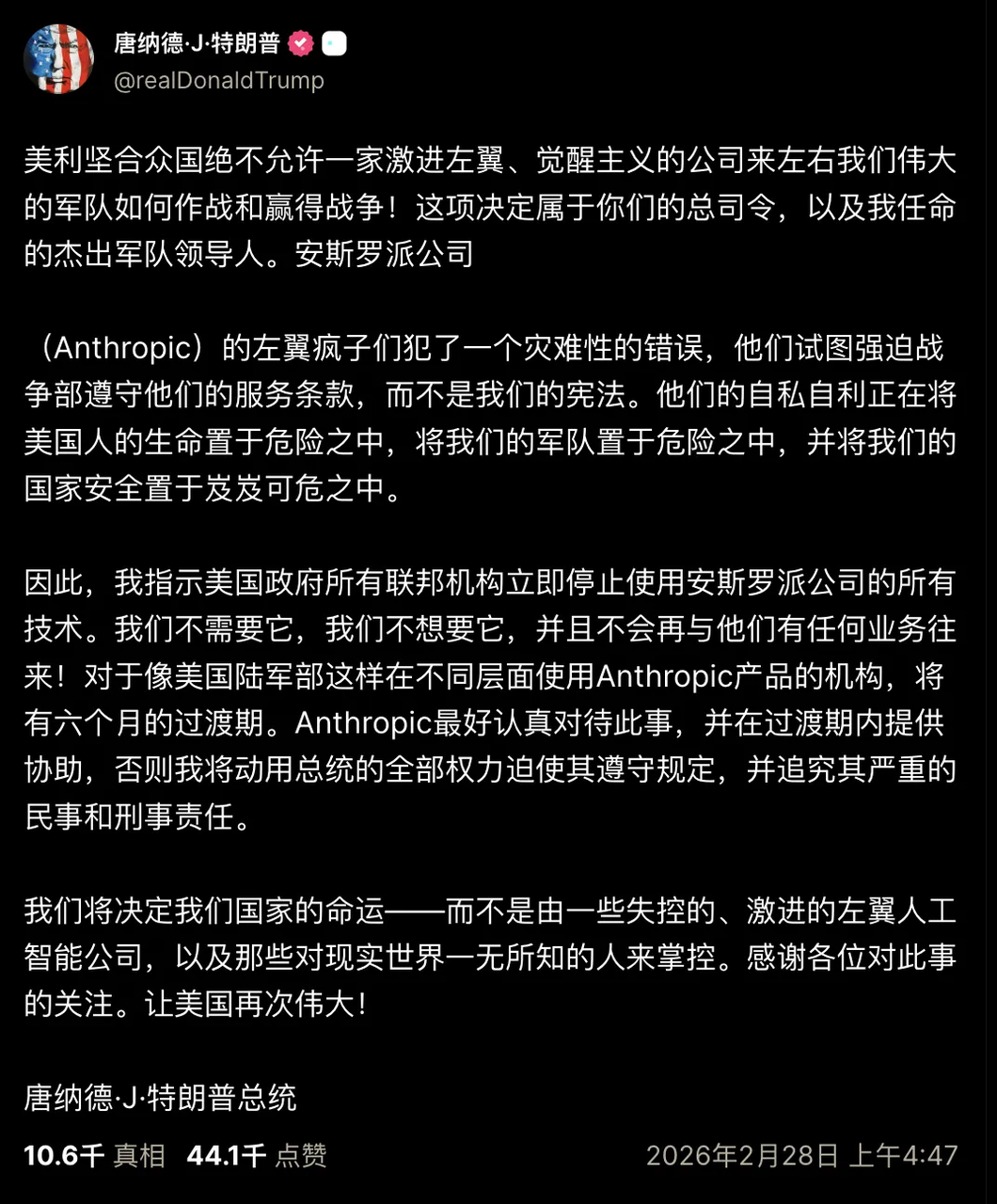

- 2026年3月,与五角大楼的协议正式引爆全球舆论。

从坚决禁止到全面拥抱,OpenAI完成这一转向,只用了不到三年时间。这不禁让人思考,驱动一家顶级AI公司前进的,究竟是造福人类的初心,还是商业与地缘政治的博弈?

技术的命运似乎总在重演相似的剧本:核能愿景变成了原子弹竞赛,互联网的乌托邦理想催生了庞大的监控网络。如今,AI这项被寄予厚望的通用技术,也正不可避免地卷入国家力量的角力场。

那些因为理念冲突而离开的顶尖人才——Ilya Sutskever、Jan Leike、Jerry Tworek,以及最新的Max Schwarzer——他们带走的不仅是卓越的技术能力,或许还有最初希望注入AI发展的那份约束与价值观。最终留下的,是一个运行愈发顺畅,但方向日益明确的商业与政治实体。

OpenAI的故事,是当下人工智能领域激烈竞争与深刻悖论的一个缩影。代码可以优化,模型训练可以不断扩展,但技术与权力、理想与现实之间的复杂纠葛,却是任何算法都难以精确计算的深渊。对于关注此领域的开发者而言,这不仅是谈资,更是关乎未来技术生态走向的重要观察。关于AI发展与治理的更多深度讨论,欢迎在云栈社区交流分享。