消息队列的顺序性,是分布式系统中高频且核心的技术需求。无论是订单的创建、支付、发货流程,还是日志的时序采集,都要求消息按照生产的先后顺序被接收和消费。一旦顺序错乱,可能导致业务逻辑异常、数据不一致等严重问题。

消息队列的顺序性保障并非单一环节的工作,而是贯穿生产消息、服务端接收、消费消息全链路的系统工程。同时,服务端 Broker 异常下线、消费者异常下线等突发场景,也会直接冲击顺序性,需要有针对性的容错机制设计。本文将从全链路视角,拆解顺序性的实现逻辑,并分析异常场景的影响与应对方案。

一、先明确核心:消息顺序性的定义与本质

消息队列的顺序性,其本质是保证「消息的消费顺序与生产顺序完全一致」。从业务视角可分为两类,对应不同的保障难度:

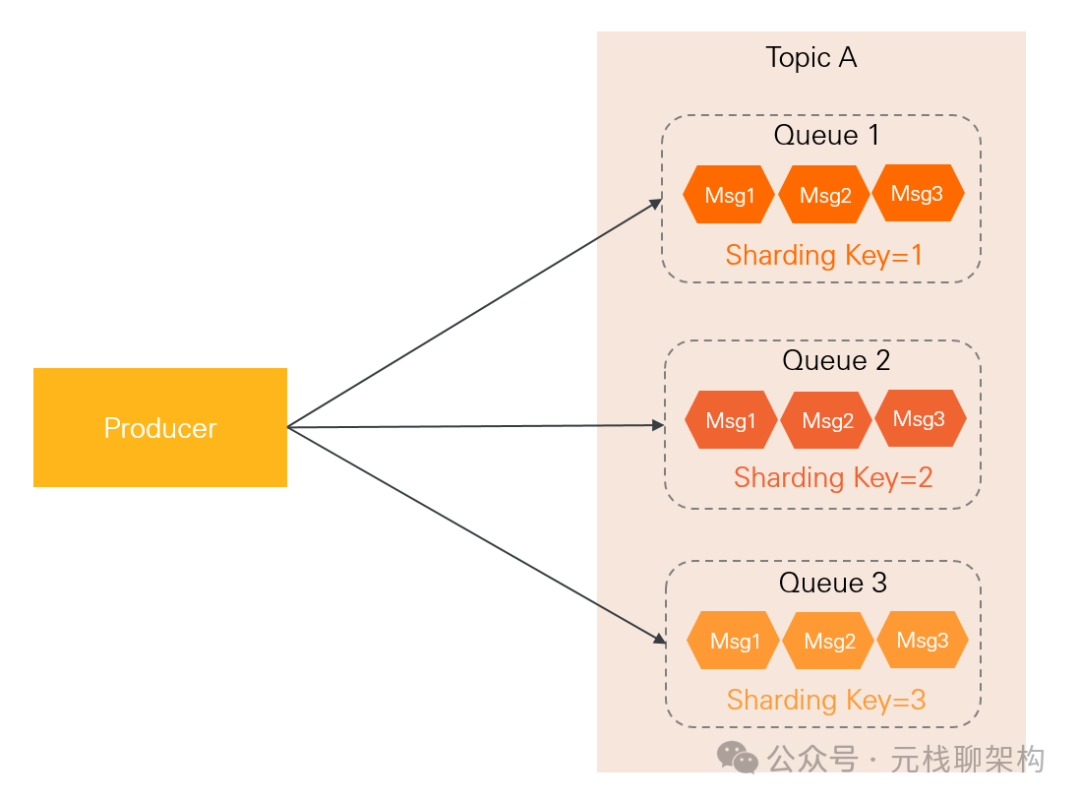

- 局部顺序:同一业务维度的消息需保证顺序(如同一订单的创建、支付、发货消息),不同业务维度的消息顺序可无关;

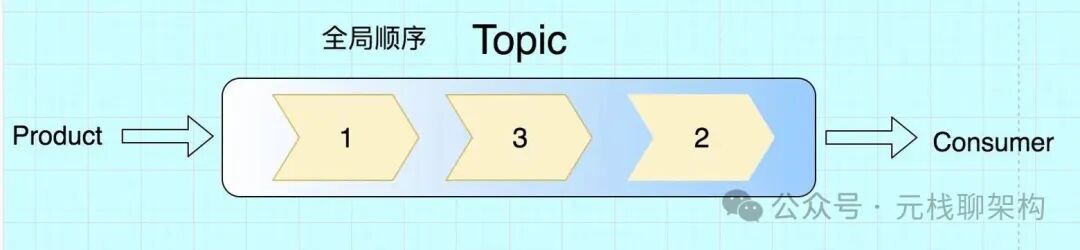

- 全局顺序:所有消息(无论业务维度)需严格按照生产时间先后顺序消费,适用于对时序要求极高的场景(如系统审计日志)。

顺序性的底层核心逻辑是:消息需以线性方式流转——生产端按顺序发送、服务端按顺序接收存储、消费端按顺序读取处理。任何环节的并行打乱、数据丢失、重试错乱,都会破坏顺序性。

二、全链路拆解:各环节如何保障消息顺序性

消息从生产到消费,需经过「生产端发送 → 服务端接收存储 → 消费端读取处理」三个核心环节。每个环节的设计都直接影响顺序性,三者协同才能实现端到端的顺序保障。

2.1 生产消息角度:有序发送是前提

生产端是消息顺序的源头。如果生产端本身发送消息的顺序就已经错乱,后续环节再怎么优化也无法挽回。生产端保障顺序性的核心是「有序发送+原子性提交」,关键要做好以下两点:

第一,单线程/串行发送,避免并行打乱顺序。

生产端若采用多线程并行发送,不同线程发送的消息可能出现时序错乱。例如,线程1发送订单创建消息,线程2发送同一订单的支付消息,由于线程调度差异,可能出现支付消息先于创建消息发送到服务端。

因此,对于需要保障顺序的业务,生产端需针对同一业务维度,采用单线程发送,或通过锁机制保证串行发送,确保消息按业务逻辑顺序提交到发送队列。

第二,禁止异步乱序重试,保证失败后重试的顺序性。

生产端发送消息可能失败(如网络波动)。若采用异步重试、随机重试,可能导致失败的消息在后续重试时,被插入到正常发送的消息之后,从而破坏顺序。

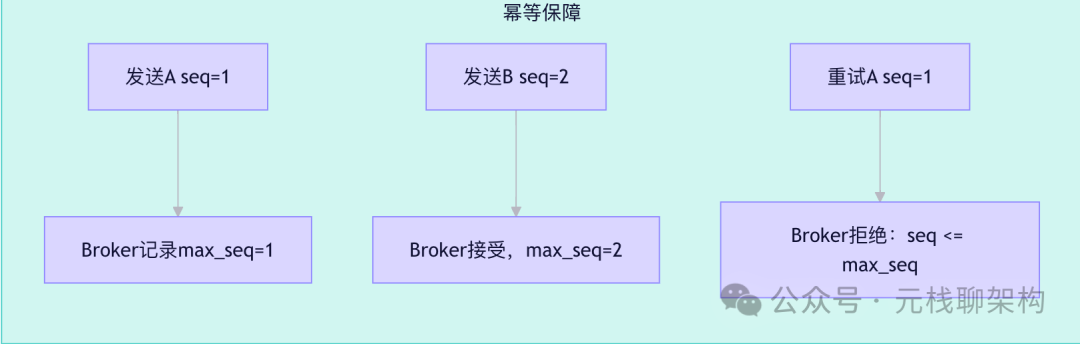

第三,幂等性防止重试乱序。

网络抖动或超时常常导致生产者重试。若无幂等机制,可能造成:消息 A 发送超时 → 重试;消息 B 先成功写入;消息 A 重试成功 → A 在 B 之后落盘 → 逻辑乱序。为此,现代消息队列引入协议级幂等:Kafka 基于 PID + Sequence Number,Broker 拒绝非单调递增的序列号;Pulsar 通过 producerName + sequenceId 实现类似机制;RocketMQ 无内置幂等 Producer,依赖业务层去重或事务消息。

正确的做法是:失败消息采用同步重试(或有序异步重试),且重试消息需插入到原发送顺序的对应位置,而非直接追加到队列末尾。同时,需避免生产端批量发送时的消息排序错乱(如批量消息需按业务顺序组装后再发送)。

补充说明:主流消息队列(如 Kafka、RocketMQ、Pulsar)本身不约束生产端的发送顺序,顺序性的基础依赖生产端的业务设计。若生产端本身乱序发送,服务端和消费端无法反向矫正。

2.2 服务端接收角度:有序存储是核心

服务端 Broker 是消息的中转和存储中心,其接收、存储消息的方式,直接决定了消息能否保持生产顺序。即使生产端有序发送,若 Broker 乱序接收、无序存储,顺序性也会被破坏。

Broker 保障顺序性的核心逻辑是「单物理队列线性存储」,结合有序接收机制,具体实现分为三点:

第一,有序接收,拒绝乱序写入。

Broker 接收消息时,需严格按照消息的发送时序接收。对于来自同一生产端、同一业务维度的消息,需保证先接收的消息先写入存储。若出现网络延迟导致后发送的消息先到达 Broker,需通过消息的时序标识(如生产时间戳、全局唯一序号)排序后再存储,避免乱序写入。

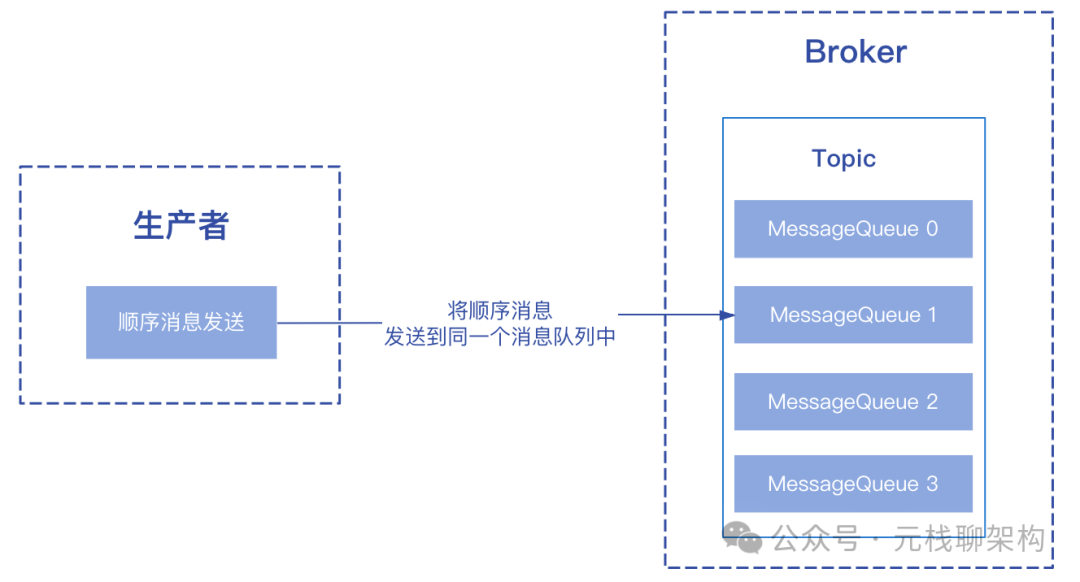

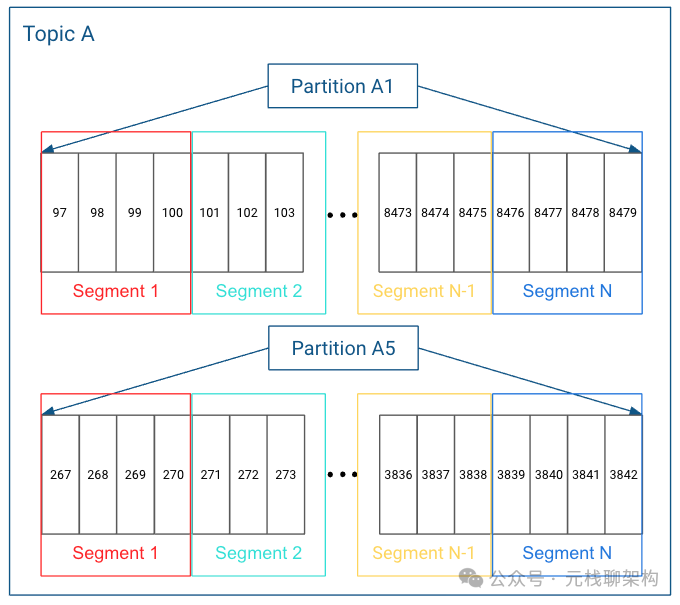

第二,单物理队列线性存储,杜绝并行存储打乱顺序。

Broker 的底层存储单元(如 Kafka 的 Partition、RocketMQ 的 Message Queue、Pulsar 的 Ledger)均为线性结构,消息按 FIFO(先进先出)方式写入和存储。同一物理队列内,消息的存储顺序与生产顺序完全一致,这是顺序性的核心保障。

这里需区分逻辑队列与物理队列:逻辑队列(如 Topic)是业务层面的抽象,可对应多个物理队列;而顺序性的保障依赖物理队列,只有单个物理队列才能保证线性存储,多个物理队列并行存储会导致消息乱序(后续消费环节会详细说明)。

第三,原子性存储,避免消息丢失或部分写入。

若 Broker 写入消息时出现异常(如磁盘 IO 失败),需保证消息要么全部写入成功,要么全部失败,避免部分消息写入导致的顺序断裂。同时,需采用日志式存储(如 Kafka 的日志文件、RocketMQ 的 CommitLog),确保消息写入后不可篡改,进一步保障顺序性。

Broker 有序接收与存储的架构逻辑如下:

2.3 消费消息角度:有序读取处理是闭环

消费端是消息顺序性的最终体现。即使生产端有序发送、Broker 有序存储,若消费端乱序读取、并行处理,也会导致顺序错乱。消费端保障顺序性的核心是「单线程有序读取+串行处理」,关键做好以下三点:

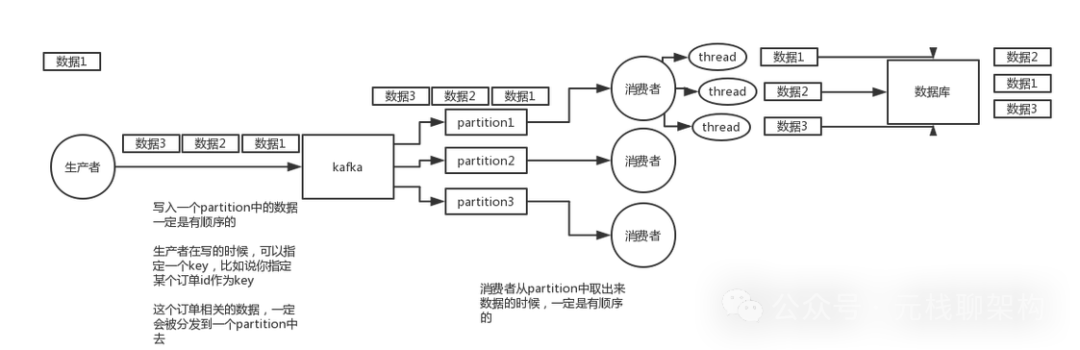

第一,单线程读取同一物理队列,遵循 FIFO 原则。

消费端需针对每个物理队列,采用单线程读取。因为物理队列内的消息是有序存储的,单线程读取能保证读取顺序与存储顺序一致。若采用多线程读取同一物理队列,不同线程读取的消息顺序可能错乱(如线程1读取队列第2条消息,线程2读取第1条消息)。

第二,串行处理消息,禁止并行处理同一业务维度消息。

消费端读取消息后,需按读取顺序串行处理,避免多线程并行处理导致的顺序错乱。例如,读取到订单创建消息后,需处理完成再处理同一订单的支付消息。若并行处理,可能出现支付消息先处理完成,导致业务逻辑异常。

第三,禁止跳过消息、乱序确认,保证消费进度连续。

消费端需按顺序处理消息,不可跳过某条消息处理后续消息。同时,消息确认(ACK)需遵循顺序性——只有当前消息处理完成并确认后,才能读取下一条消息,避免前一条消息处理失败,后一条消息已读取处理,导致顺序断裂。这涉及到对网络确认机制的精确管理。

消费端有序处理的架构逻辑如下:

三、异常场景分析:服务端视角如何在故障中维持顺序写入?

Broker 作为消息存储和中转核心,若异常下线(如节点宕机、网络中断),会导致两个核心问题:一是未存储的消息丢失,二是已存储的消息无法被读取,进而破坏顺序性。若 Broker 集群部署,还可能出现主从切换导致的顺序错乱。

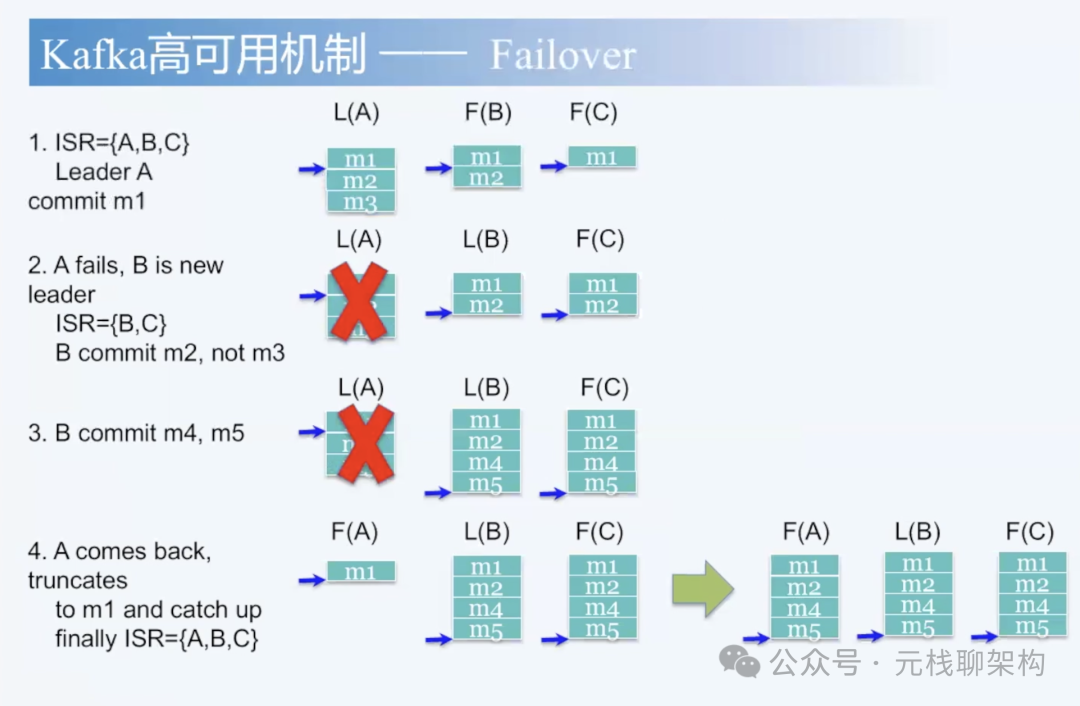

3.1 Kafka:Leader 切换下的顺序边界

Kafka 采用 Leader-Follower 架构,所有读写经由 Partition Leader。当 Leader Broker 宕机:

- Controller 触发 ISR(In-Sync Replicas)内新 Leader 选举;

- 新 Leader 继承原日志高水位(HW),不会回退已提交消息;

- 只要配置

unclean.leader.election.enable=false(默认),绝不选举数据落后的副本为 Leader。

已确认消息顺序不变,新写入接续末端,无乱序。若 ISR 为空且启用 unclean 选举,则可能丢失消息并造成逻辑断裂。

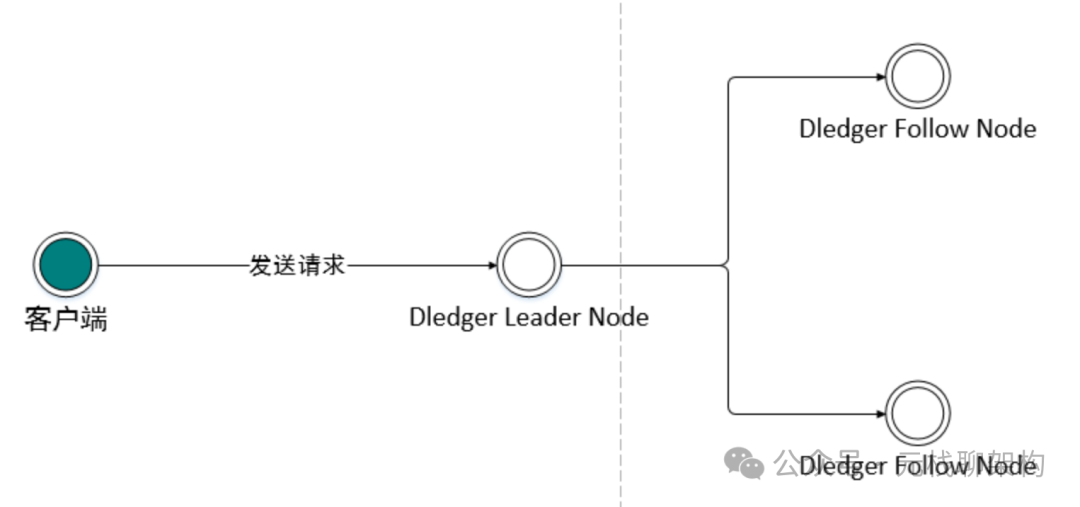

3.2 RocketMQ:Raft 协议下的强一致性

RocketMQ 4.5+ 推荐使用 Dledger(基于 Raft)实现多副本:

- 写入需多数派确认;

- Leader 宕机后,新 Leader 必须包含所有已提交日志(Raft 安全性);

- CommitLog 全局顺序写,ConsumeQueue 按 QueueId 索引,逻辑队列视图一致。

故障切换后,MessageQueue 的消息序列连续、完整、有序。

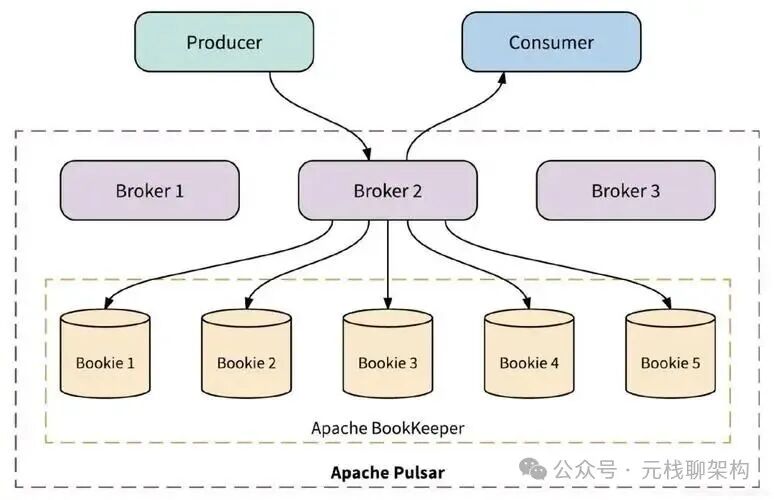

3.3 Pulsar:存算分离架构的天然优势

Pulsar 将计算(Broker)与存储(BookKeeper)分离:

- Broker 无状态,仅负责路由;

- 消息实际写入 BookKeeper 的 Ledger,由多个 Bookie 多副本存储;

- Broker 宕机 → 客户端重连任意 Broker → 从 BookKeeper 读取相同 Ledger。

Broker 故障对消息顺序零影响。只要 BookKeeper 集群满足 Quorum,写入即可恢复,日志严格有序。

四、异常场景分析:消费者视角如何在异常中维持顺序处理?

消费者异常下线(如消费端节点宕机、进程崩溃),会导致消息消费中断。若消费进度管理不当,重启后可能出现重复消费、漏消费,进而破坏顺序性。例如,消费者处理完消息 A,未确认 ACK 就下线,重启后重新读取消息 A,同时读取消息 B,导致消息 A 重复处理,或消息 A 未处理完成就处理消息 B。

消费者异常下线的核心影响在于:消费进度丢失/错乱、消息重复消费、顺序处理断裂。应对方案围绕「消费进度持久化+有序恢复」展开。

应对方案:

- 消费进度持久化存储,避免进度丢失:消费端将消费进度(如已处理的最后一条消息的偏移量、序号)持久化到本地磁盘或远程存储(如 Redis、MySQL)。异常下线后,重启时可从持久化存储中读取最新消费进度,继续从下一条消息开始处理,避免重复消费和漏消费。

- 顺序 ACK,确保进度与处理顺序一致:消费端需遵循「处理完成一条,确认一条」的原则。只有当前消息处理完成并持久化消费进度后,再确认 ACK,避免未处理完成的消息被标记为已消费,重启后漏处理。同时,禁止批量 ACK(批量 ACK 可能导致部分消息未处理就被确认)。

- 重启后有序恢复,避免乱序处理:消费者重启后,先读取持久化的消费进度,定位到最后一条已处理消息,再从 Broker 读取下一条消息,按顺序处理。禁止重启后直接从队列头部读取消息(会导致重复消费和顺序错乱)。

- 消费组容错,避免单点故障:采用消费组部署,多个消费者节点组成消费组,每个消费者负责处理部分物理队列。若某个消费者下线,消费组会触发重平衡,将该消费者负责的物理队列分配给其他消费者继续处理,确保消费不中断,同时保证每个物理队列仍由单线程处理,不破坏顺序性。

五、总结

消息顺序性是全链路保障的结果:生产端有序发送、Broker 有序接收存储、消费端有序读取处理,三者缺一不可,任何环节的疏漏都会破坏顺序性。

异常场景的核心矛盾在于:Broker 下线导致消息丢失/乱序,消费者下线导致消费进度错乱。容错机制的核心是「数据持久化+有序恢复+集群容错」。

最后,顺序性与吞吐量之间需要平衡:全局顺序需牺牲吞吐量(单物理队列+单线程消费),局部顺序则可通过物理队列分片,在保障同一业务维度顺序的前提下,兼顾系统吞吐量。深入理解这些底层逻辑,能帮助我们在云栈社区这类技术论坛中进行更高效的技术选型与架构设计。