本文编译自 ScienceAI,约3000字,总结了从构建一个以研究为导向的人工智能代理中学到的经验教训,以及科学家在使用代理进行科学探索时应考虑的核心原则。

20世纪初,苹果联合创始人史蒂夫·乔布斯曾将计算机形容为“我们大脑的自行车”。这个灵感来源于他小时候在《Scientific American》杂志上看到的一幅图,显示骑自行车的人比任何动物都更节能。

相比之下,AI可能更像飞机——速度更快,但也更难驾驭,一旦失误,后果可能更为严重。科学家们或许能从中获益,因为科学研究的本质就是一场探索未知的旅程。然而,在新的工作范式下,挑战与挫折也接踵而至。

为了高效且安全地驾驭这个新时代的工具,研究人员需要一套“操作手册”。真正的问题从来不是机器是否会取代科学家,而是当科学家掌握了这些工具后,他们将蜕变成怎样的形态。

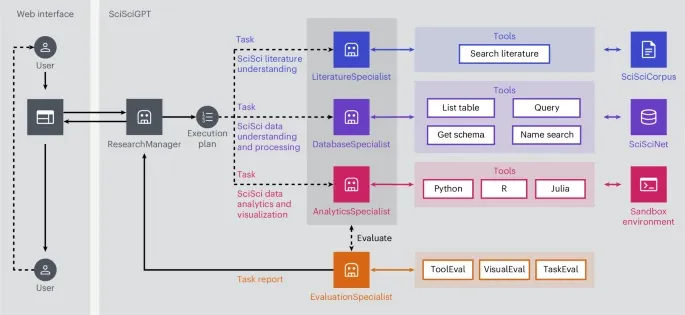

这些思考源自 SciSciGPT 开发团队的分享。SciSciGPT 是一个由多个专业AI模块协同工作的研究流程系统。其核心是 ResearchManager 代理,它负责协调整个工作流:将研究人员通过聊天界面输入的自然语言查询拆解为具体任务,然后分配给专门负责文献综述、数据提取或数据分析的特定代理。

图 1:SciSciGPT 模块化设计的示意图。

在他们的案例研究中,SciSciGPT 成功创建了大学合作网络的可视化,并测试了能否从存储库数据中复现某篇论文中的图表。它完成这些研究任务的速度更快,结果也比经验丰富的研究人员手动使用AI工具更为高效。

基于此,团队总结了构建研究型AI代理的五条关键准则。

准则一:协作优先于自动化

当前的一个趋势是追求科学研究的完全自动化,朝着“AI科学家”或“自动实验室”的方向发展。这些流程或许复杂精密,但科学绝非流水线作业。它建立在解释、辩论与责任之上,人类的判断不可或缺。

以牛顿的棱镜实验为例。一个全自动系统可以轻松完成这个实验:测量白光通过棱镜后的色散,并将数据拟合到某个模型中。但牛顿所做的截然不同:他反转了实验设置,将色散后的彩色光束重新汇聚成白光。这一跳跃性的设计果断地证明了颜色是光的属性,而非棱镜的产物。

图 2:牛顿棱镜实验。

这一行为——判断一个看似异常的现象是本质而非需要消除的误差——是一种解释上的飞跃,而非单纯的计算。自动化工作流在设计上倾向于平滑异常、优化流程以求稳定,而科学家则善于利用“意外”的力量。

随着AI日益成为研究的核心,科学将同时面临技术与公众信任的转折点。在这个公众对科学信心本就脆弱的时代,正是需要通过将透明度、可追溯性和问责制嵌入发现流程的基础设施,来巩固科学基石、更新社会契约的时刻。全面自动化或许能快速产出答案,却可能削弱赋予这些答案公信力的根基。

研究团队坚信,人类科学家应始终保留对问题界定、验证路径和最终结论的权威与责任。纵观历史,人类文明就是一段不断发现的旅程。当AI能够为发现做出贡献时,核心问题不再是机器单独能做什么,而是如何设计它们,以确保科学过程的问责性与可重复性。

准则二:速度意味着变革

当失败的代价不再像过去那样高昂时,许多大胆的探索计划就变得合乎理性。过去因成本或时间限制而难以测试的假设,现在变得切实可行。

基因组学的发展完美诠释了这一转变:第一个人类基因组的解码耗费了十多年时间和数十亿美元;如今,测序成本已低于1000美元,仅需数小时即可完成。这一转变将整个领域从单基因研究推向了全基因组范围的广泛探索。速度的提升带来了新的视角,让研究人员能够洞察科学领域内原本难以察觉的关联。

速度也将改变学术发表的话语权。降低的技术门槛和时间成本使得小型实验室、新手乃至个人研究者都能完成以往需要大型团队数月协调才能完成的分析。然而,加速发现的同一股力量也可能放大错误。缺乏反思的“快速科学”有可能导致错误在更大规模上汇聚。这进一步凸显了人机协作模式的重要性,而非追求完全取代人的自动化。

准则三:让代理更加专业化

SciSciGPT 是一个自然的起点:科学学(Science of Science)本身数据丰富、方法论多样,且以研究“研究”本身为对象。但同样的原则适用于各个学科。每个领域都有其基石——教科书、核心数据集、专用工具和行业标准。

AI研究代理在不同学科的表现可能各异,但应遵循相同的基本原则:结果应可追溯,方法应可验证,职责应明确分配。制定这些规则需要跨领域的协调,目标是建立一个共享的公私协作框架。例如,建立记录代理决策的统一日志标准,使得一个实验室运行的分析能够被另一个实验室审计或复现。

图 3:一些实验室正试图通过“AI科学家”来端到端地自动化整个研究项目。

SciSciGPT 团队的研究表明,AI对科学的助益广泛存在于各学科,但他们通过分析大学课程大纲发现了一个系统性的不匹配:人工智能教育主要集中于计算机科学、数学和工程领域,而本应同等受益的学科——从医学、心理学到经济学——提供的相关培训却少得多。

与此并存的是,学术界仍主要围绕各系的壁垒进行组织,随着知识负担的加重,学科间的交流鸿沟可能进一步加深。科学政策的制定者应认识到这一点,支持那些促进AI专家与领域科学家持续合作的跨学科机构架构。

准则四:信任必须主动构建

骑自行车与驾驶飞机失事的后果天差地别——这正是研究者在面对AI代理时需要正视的尺度差异。随着AI能力的增长,其失败带来的可能不仅是个别研究者的不便;它们可能误导整个领域,转移科研资金,甚至削弱公众对科学的信任。

大型语言模型(LLM)的一个关键优势是强大的文本生成能力。这意味着LLM可以用纯文本详尽记录其所做的一切。在SciSciGPT项目中,系统生成的每一步、每一行代码和每一个决策都被自动记录了下来。这产生了海量的日志数据,但其潜力是变革性的。即便是最优秀的学生做实验笔记,也无法期望如此完整地记录和重建导致最终结果的每一个操作步骤。

但这带来了另一个挑战:信息过载。

优秀的设计可以解决这个问题:通过结构化的溯源来突出决策的“原因”而不仅仅是“做了什么”,并利用分层摘要使关键的偏差和决策一目了然。

如果现有的工具无法提供足够的透明度,那么可能需要自行构建。AI需要配备严谨的科学溯源和审计追踪工具。如果做得好,AI代理能为科学最深层的挑战之一——可重复性危机——提供一个强有力的回应方案。

准则五:正视AI带来的机遇与风险

飞机的出现催生了飞行员职业,AI的普及亦然。

AI代理可能会提出一些起初看起来陌生甚至怪异的想法——无论是理论构建、异常发现还是假设设计。关键在于,科学家是否受过训练,将这些视为需要过滤的“噪音”,还是值得深究的“信号”。结果可能导向一场人机协同进化:那些最能适应并善用AI的科学家,可能成为引领明日发现的先锋。

然而,这对科学家个人和整个科学界都构成风险。对个人而言,风险在于关键技能的流失。依赖GPS导航很方便,但久而久之司机会对路线记忆模糊。同样,智能体可能极大提升研究者的生产力,却也可能让他们在面对需要挑战AI结论的情况时准备不足。

在这种环境下,如果许多研究者都依赖相同或相似的AI工具栈,科学界将面临同质化的风险。人们时常担忧,AI虽然可能提升个体研究的质量,但可能会减少集体智慧的多样性。除非研究者们有意识地加以抵消,否则科研产出的思路和方法将极大地趋于收敛。

从长远看,培养多样化的思维和方法至关重要。这需要拥抱多元化的模型——采用不同的理论框架或思维方式——并建立鼓励从多视角看待问题和奖励提出异议的制度和规范。

重塑科学的视角

像SciSciGPT这样的系统,目前仍在模仿和加速现有的科研发现模式,拓宽了可探索问题的范围。但人类与AI协同发现的未来,不必拘泥于我们熟悉的形式。

回想一下,当钢筋混凝土出现时,建筑师最初用它来模仿砖石结构,将新的骨架隐藏在旧的设计之下。真正的突破发生在他们意识到墙体不再需要承重的那一刻:建筑可以被玻璃幕墙包裹,从而催生了纽约联合国秘书处大厦等现代主义标志。

这是一种重要的思维转变,在AI代理逐渐普及的当下必须牢记。

回到最初的比喻:将移动的能耗与体重对比,骑自行车者处于效率的顶端。而乘坐飞机看似成本高昂、效率不高,却大胆地开辟了曾经难以想象的疆域。前者提醒我们以效率和超越为目标进行设计;后者则警示我们,一套完善的信任体系与操作规则是多么必要。

相关论文链接:https://www.nature.com/articles/s41586-025-09922-y

原文观点链接:https://www.nature.com/articles/d41586-026-00665-y

在 云栈社区 的智能 & 数据 & 云板块,我们持续关注着AI如何重塑各行各业,包括科学研究本身。人机协作的范式正在快速演进,掌握其原则,方能成为新时代负责任的“飞行员”。