想亲眼见证一场技术实验的疯狂极限吗?OpenClaw正在将AI推向未知领域,而这一切的背后逻辑,或许正是人类无法抗拒的“点燃科技篝火”的本能。

本文译自 OpenClaw is out of control - but that's the point

最近,我开始逐渐理解为什么OpenClaw会引发如此狂热。这背后似乎有一种原始冲动在驱动:

- 就像猫总喜欢把东西从架子上推下去。

- 就像你看到一个按钮,就忍不住想按一下。

- 就像篝火点燃后,大家总想往里扔点东西,看看它会怎么燃烧、发出什么颜色、会不会噼啪作响。

OpenClaw 本质上就是这样一堆“科技篝火”。既然AI智能体可以是自主的,我们自然会好奇:如果给它们钥匙、凭证、资金、甚至灵魂,然后放手不管,会发生什么?

- 如果让它去炒股会怎样?

- 如果给它5000美元,让它开一家公司呢?

- 如果让它访问你的Gmail、日历和整个业务,并以你的梦想作为指令呢?

为什么会出现 OpenClaw?

每一次重大的技术突破都会伴随一个疯狂的实验期。以前,这需要初创公司和大量资金。但现在,随着“氛围编程”的流行,技术门槛降低了,实验也变得唾手可得。这解释了为什么会有OpenClaw,却没有一个与之对应的“量子计算版OpenClaw”。

人们的热情已经近乎疯狂。他们不满足于仅仅拥有一个强大但高风险的个人助理,还为AI智能体创建了社交网络、约会网站,甚至让AI雇佣人类来完成现实任务的平台。这些智能体正在做的事情五花八门,从哲学思辨到为自己和其他智能体开发应用、制定策略。

简单来说,OpenClaw之所以出现,是因为它能够出现。更详细的解释是:现在一个人就能快速编出一个近乎全能的AI机器人,无需考虑太多后果,也无需董事会批准。而且,将智能体连接到海量资源然后放任自流的诱惑,对某些人来说实在太大了。这简直是“高风险高回报”信条的终极实践。

不要浪费错误,从中学习

那些急于让OpenClaw全面运行的人,是否完全意识到了其中的风险?很可能没有。但这类事情在技术领域似乎总是不可避免(尽管有几十年的科幻作品在警告)。即使是像CRISPR这样难以驾驭的技术,也有人在家尝试编辑自己的基因。

将一个AI智能体暴露在几乎无限的攻击面(网站、电子邮件、消息)中以应对提示注入,这当然风险极高,但它也可能迫使我们更快地直面AI安全挑战。我强烈认为,一部分网络安全专家应该成为“网络侦察兵”。他们能早期购买、测试和折腾新技术,从而让整个安全行业能更早地为大众提供安全使用指南。

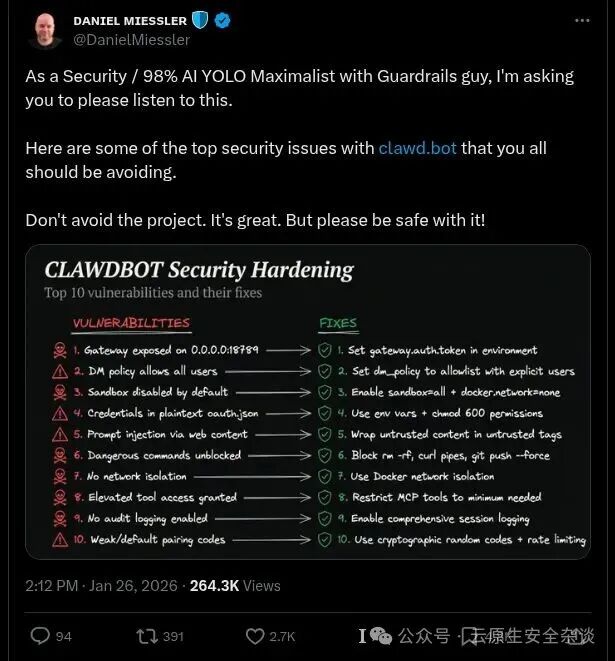

随着OpenClaw用户争相试验,一些人快速失败,但我们已经从安全社区和项目创始人那里获得了一些有用的加固指南和工具。

此外,社区还涌现出一些工具:

- OpenClaw Detector

- OpenClaw Hunter

- OpenClaw Telemetry

- OpenClaw Audit

为什么我要为这种疯狂欢呼?

我的希望是,如果AI爱好者们能快速尝试所有可能的AI应用场景,我们就能更快地发现哪些路走不通,哪些是可行的。我相信,这个过程发生得越早,我们就能越早回归到网络安全领域那些尚未解决的核心问题。

所有迹象都表明,在情况好转之前,AI会让许多问题变得更糟。我真诚希望,未来我们能重新聚焦于那些基础性问题,而它们并没有因为AI的出现而变得更容易解决。

关于OpenClaw的简单说明:

- OpenClaw是一个可以运行在你选择的主机上的AI智能体——可以是你的笔记本、容器、VPS,甚至是一个猫形机器人。

- 你将它连接到你选择的大语言模型。

- 你赋予它一个“灵魂”:即它的个性、目标和风格。

- 你将它连接到你想让它交互的资源上:邮箱、日历、代码库、浏览器,甚至是一笔可以自由支配的零花钱。

- 你将它连接到一个“技能注册表”,并在允许它自行安装技能时犹豫一下——它很可能立刻就会装上恶意软件。

- 你通过常用的聊天工具与它互动:Slack、Teams、Telegram等。

一个残酷的现实:

现在是2026年,攻击者依然可以通过窃取一个Cookie就以你的身份登录。AI解决不了这个问题。

技术的探索永无止境,而安全的警钟必须长鸣。对于开发者而言,在云栈社区这样的技术论坛中保持交流与学习,或许是应对快速变化时代的最佳策略之一。

参考链接:

|