代理工作流的兴起,正让代码验证成为新的关键瓶颈。传统的共享测试环境,根本无法应对机器智能带来的海量拉取请求洪流。面对这一挑战,团队需要一种能够快速、低成本为每个PR提供隔离且真实运行环境的新方案。对于那些已经在使用 Istio 等服务网格的团队来说,实现这一目标有着独特的优势——路由能力可能就是破解难题的关键,能够显著加速验证流程并提升开发效率。

译自:The agent pull request flood is here. If you run Istio, you’re halfway to solving it.[1]

作者:Arjun Iyer

“代理拉取请求的洪流已经到来。如果你在运行 Istio,那么你已经成功解决了一半的难题。” 这不是危言耸听,而是许多工程团队正在面对的严峻现实。代理工作流的广泛应用使得代码生成变得廉价而快速,但随之而来的,是一个全新的基础设施问题。

在简单的单体应用中,或许仅靠持续集成流水线中的单元测试就足以验证代码。但在复杂的云原生分布式系统中,在真实环境中验证行为变得至关重要。短短几个月内,行业讨论的焦点已经从“代理擅长写代码,但我们的流水线还没受到影响”,迅速转变为“我们快被PR淹没了”。验证,已然成为分布式系统开发的瓶颈。

“如果你验证代码的速度,赶不上代理编写代码的速度,那么你的整个流水线效率将退化到它最初为人工速度设计的水平。”

这场洪流的影响并不均衡。Stripe、Ramp等AI工作流的早期采用者,已经目睹了合并到主分支的代码量呈指数级增长。他们很早就意识到,生成代码只是成功的一半。如果你不能像代理编写代码一样快速地验证代码,你的流水线将退化到其设计处理的人工级别吞吐量。

对于那些希望追赶的组织而言,答案可能就藏在现有的技术栈中。如果你的平台目前正在运行像 Istio 这样的服务网格,那么恭喜你,你已经手握解决一半验证瓶颈的钥匙。

AI速度错觉与集成瓶颈

最近的《CircleCI 2026年软件交付现状报告》证实了许多开发者的切身感受:流水线正因其自身的成功而堵塞。报告显示,尽管平均工作流吞吐量同比增长了59%,但这些增长高度集中。顶部的精英团队正在以空前的规模运作,前5%团队的吞吐量几乎翻倍,增长了97%。

然而,对于大多数组织而言,情况并不乐观。中位数团队在AI辅助开发的特征分支上吞吐量增长了15.2%,但其主分支的吞吐量却实际下降了6.8%。这揭示了一个矛盾:开发者和他们的AI代理正在生成远多于以往的代码,但团队却在审查、验证和集成这些代码上举步维艰。

传统的共享预发布环境,从未被设计用来处理这种级别的并发。它们是为人工节奏设计的。对于一个50人的工程团队,每天生成2-3个拉取请求,其基础设施的承载能力可能就在每天100-150个PR左右。当遭遇机器智能带来的流量高峰时,这里迅速成为瓶颈点——队列的增长速度远远超过了其消耗速度。

未能升级其验证基础设施的组织会发现,AI投资所承诺的速度优势,正在漫长的排队等待中消磨殆尽。而那些取得成功的团队早已认识到,构建可扩展的验证基础设施,是解锁代理工作流真正投资回报率的唯一途径。

代理工作流的真正瓶颈

为何这个瓶颈如此具有破坏性?关键在于,当机器的指数级输出能力,遇上了为线性人工吞吐量设计的基础设施时,矛盾就会彻底爆发。代理可以指数级增加拉取请求的数量,但传统的预发布队列和人工审查流程根本无力招架,最终导致难以置信的代码积压。

由于流水线无法处理负载,开发者被迫人为限制其AI代理的速度。他们不会提交所有代理生成的代码,而是让代理依赖有限的单元测试和模拟,以绕开拥堵的预发布环境,直到开发的后期阶段。这种不完美的模式,对于对整个系统架构有深刻理解、能直觉判断修改影响的人类开发者或许可行。但AI代理并非如此,它们经常生成一些能通过局部单元测试,但一旦放入更广泛的系统架构中就会失败的“新奇”代码。因此,对于AI代理而言,与真实运行环境建立快速反馈循环来验证其代码,不是“锦上添花”,而是“不可或缺”。

这意味着,AI代理本应具备的巨大吞吐潜力,被人为地限制在了为人类速度设计的线性基础设施上。同时,这也意味着那些最终通过的代码,出错的可能性更高。CircleCI的报告强调了这种集成失败的成本:大多数团队主分支构建的成功率已降至70.8%。

环境复制的“数学灾难”

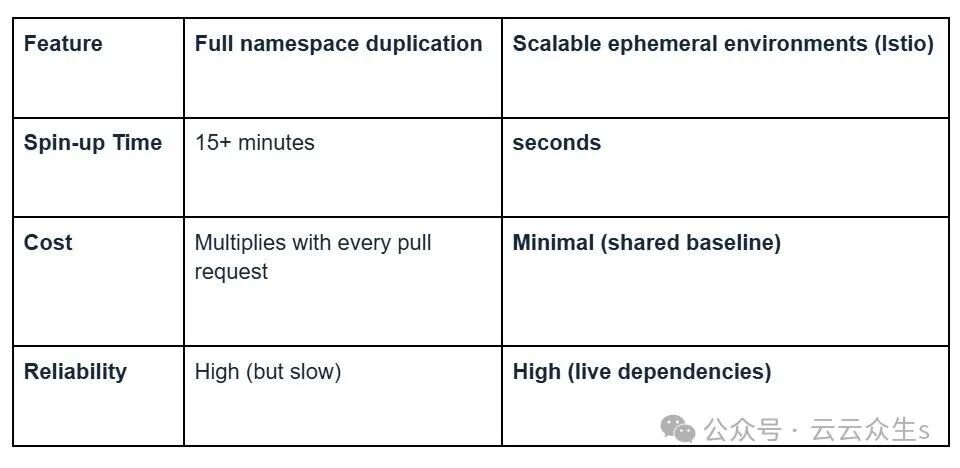

为了将代理工作流增加的输出转化为实际的生产力,并消除验证瓶颈,基础设施需要为每个代理或拉取请求提供一个隔离且真实的运行环境。传统上,平台团队会为每个PR启动一个新的Kubernetes命名空间,甚至是一个隔离的集群。虽然这提供了必要的准确性,但在代理的规模下,这种做法的数学模型完全崩溃。

复制每个数据库、消息队列和微服务,往往需要15分钟甚至更长时间。当你将这个启动开销乘以每天可能产生的上千个拉取请求时,基础设施成本会爆炸式增长。更重要的是,长达15分钟的部署延迟,将严重限制AI代理快速迭代和学习的能力。

另一种绕过完整集群复制的常见方法,是将负担转移到运行本地化容器集合的“重型”虚拟机上。例如,一个团队通过动态生成Docker Compose文件并在隔离的云实例中运行集成测试。由于测试依赖共享状态,一个触及核心文件的提交,就可能触发上百个重型云实例同时启动,并花费数小时进行顺序测试。

无论是启动上千个完整的Kubernetes命名空间,还是编排重型虚拟机群来运行本地化容器,结果都是一样的:部署延迟迅速累积,而AI工作流的速度在遇到线性基础设施瓶颈时,被迫减慢。

面向代理规模的可扩展瞬时环境

上述因素叠加意味着,唯一可行的解决方案是一种新型的、可扩展的瞬时环境模型。为了处理机器速度级的并发,环境必须在几秒钟内启动,并在不复制整个集群高昂成本的前提下,提供真实的运行环境。

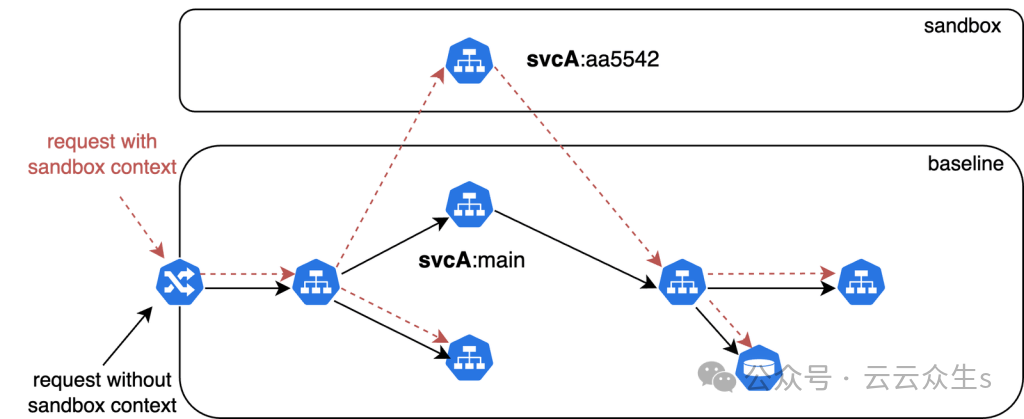

可扩展瞬时环境模型的核心理念不是复制一切,而是仅部署已更改的微服务,作为轻量级沙箱。架构的其余部分,包括所有重型的数据库和稳定的下游服务,都从一个共享的“基线”环境中复用。测试流量通过动态路由,在已更改的沙箱服务和稳定的基线服务之间灵活流转。

这种方法提供了与完整复制环境完全相同的高保真运行环境。代码是针对真实的、实时的依赖项进行测试的。关键区别在于资源占用:通过仅部署被修改的服务,环境在几秒钟内(而非几分钟)即可启动,并且只消耗一小部分计算资源。

在这种模型下,AI代理可以验证其代码、获得即时反馈,并以大规模并发且零资源争用的方式进行迭代。

用智能路由跳出“暂存队列”

实施这种共享基线架构需要高级的流量控制能力。从头开始构建这类环境的自动化部署和生命周期管理,是一项巨大的工程任务。然而,对于已经在运行 Istio 等服务网格的团队来说,他们具有一个显著的优势。

因为这些工具已经内置了所需的精确路由功能,实施上述可扩展瞬时环境变得水到渠成。底层的服务网格或入口控制器,只需处理将测试流量动态路由到轻量级沙箱的任务,同时确保所有常规生产流量不受干扰地流向稳定的基线服务。

以下是在 Istio 中配置此类路由的一个示例:

apiVersion: networking.istio.io/v1

kind: VirtualService

metadata:

name: location

namespace: hotrod-istio

spec:

hosts:

- location

http:

- match:

- headers:

baggage:

regex: ^.*\b(sd-routing-key|sd-sandbox)\s*=[^,]*\bqwblp48fpmb30\b.*$

- headers:

tracestate:

regex: ^.*\b(sd-routing-key|sd-sandbox)\s*=[^,]*\bqwblp48fpmb30\b.*$

route:

- destination:

host: local-location-location-9f4477c8.hotrod-istio.svc.cluster.local

port:

number: 8081

- route:

- destination:

host: location

当请求带有特定的路由标识头(例如对应某个PR的ID)时,Istio 会将其拦截,并直接路由到为该PR部署的服务沙箱版本。

这一切得以实现的关键赋能机制是“上下文传播”。在深度的微服务调用链中,标识沙箱路由的标头必须在每个服务之间自动传递。OpenTelemetry(Otel)的 Baggage 传播机制无缝地处理了这一点,路由值随着追踪上下文一起流动,跨越服务边界,而无需任何单个服务显式地转发它。

通过利用这些现成的基础能力,平台团队可以相对容易地采用可扩展瞬时环境解决方案。这些方案能自动编排沙箱服务的部署,并在其现有的服务网格中配置路由规则。这使得AI代理能够针对实时集群依赖项验证自己的工作,并获得即时反馈,从而彻底消除集成瓶颈。

结语

AI代理工作流正在成为软件开发的新标准,它们已经暴露了传统代码验证和审查模型的根本性局限。那些将构建可扩展验证基础设施作为首要任务的团队,与尚未行动的团队之间的差距已经显现,并且只会越来越大。

已经运行 Istio 等服务网格的团队,在这个赛道上拥有显著的先发优势。他们已经具备了流量路由的核心能力,这使得集成 Signadot 这类可扩展瞬时环境解决方案变得异常顺畅。这能帮助他们迅速解决AI代理PR验证的难题,避免其演变为一场全面的交付危机。在探索这类前沿的云原生与DevOps解决方案时,不妨关注像 云栈社区 这样的技术交流平台,与更多同行交流实践心得。

引用链接

[1] The agent pull request flood is here. If you run Istio, you’re halfway to solving it.: https://thenewstack.io/ai-agents-istio-validation/

[2] 新的基础设施问题: https://thenewstack.io/enabling-autonomous-agents-with-environment-virtualization/

[3] Ramp: https://thenewstack.io/ramps-inspect-shows-closed-loop-ai-agents-are-softwares-future/

[4] 代理编写代码: https://thenewstack.io/the-future-of-agentic-coding-is-multiplayer/

[5] CircleCI 2026年软件交付现状报告: https://circleci.com/resources/2026-state-of-software-delivery/

[6] 拉取请求: https://thenewstack.io/what-github-pull-requests-reveal-about-your-teams-dev-habits/

[7] 平台团队可以轻松采用: https://thenewstack.io/platform-teams-adopt-these-7-developer-productivity-drivers/

[8] Signadot: https://www.signadot.com/?utm_source=tns&utm_medium=sponsorship&utm_campaign=q1_26_sponsored_content