近日,中国国家计算机网络应急技术处理协调中心(CNCERT)发布安全警告,指出开源自主托管AI Agent项目OpenClaw(前身为Clawdbot和Moltbot)存在严重安全隐患。CNCERT在官方渠道发文称,该平台“默认安全配置存在固有缺陷”,再加上其执行自主任务时需具备的高系统权限,可能被攻击者利用以控制终端设备。

间接提示词注入风险凸显

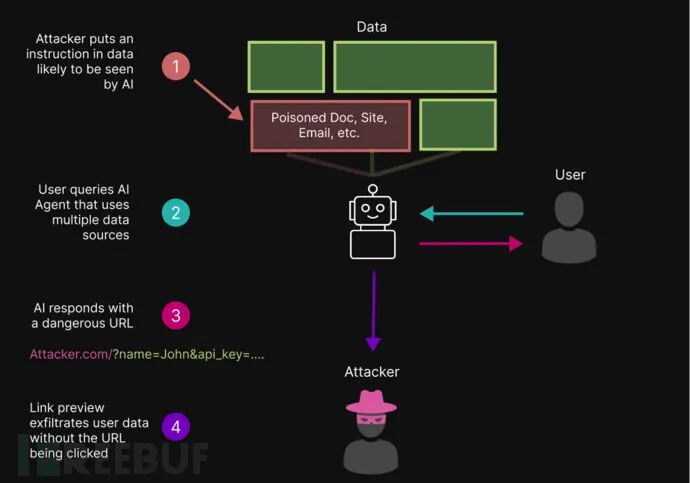

风险的核心来自于一种高级的提示词注入攻击。当AI代理被诱导访问含有恶意指令的网页时,就可能导致敏感信息泄露。这类攻击也被称为间接提示词注入(IDPI)或跨域提示词注入(XPIA)。攻击者并非直接与大型语言模型(LLM)对话,而是通过劫持网页摘要、内容分析等AI的正常功能来执行被篡改的指令。

攻击场景多种多样,包括规避AI广告审核系统、影响招聘决策、实施搜索引擎优化(SEO)投毒,以及通过压制负面评价来生成带有偏见的响应。

OpenAI在本周发布的博客中也指出,提示词注入攻击已从简单的外部指令植入,演变为包含社会工程学元素的复合攻击。AI代理越来越强大的网页浏览、信息检索和代用户执行操作的能力,在提供便利的同时,也为攻击者开辟了新的系统操控途径。

真实攻击案例曝光

OpenClaw的提示词注入风险并非理论假设。上个月,安全研究人员PromptArmor发现,通过间接提示词注入与OpenClaw通信时,Telegram或Discord等即时通讯应用中的链接预览功能可能沦为数据外泄的通道。

攻击原理是诱使AI代理生成一个攻击者控制的URL。当这个链接在通讯应用中自动呈现为预览时,无需用户点击,就会自动向攻击者的域名传输包含用户机密数据的请求参数。

AI安全公司对此分析道:在具备链接预览功能的代理系统中,只要AI代理对用户作出响应,数据外泄就会立即发生,根本不需要用户去点击那个恶意链接。在这种攻击中,代理被操控去构建一个包含攻击者域名的URL,并附加上动态生成的查询参数,而这些参数里就包含了模型所知的用户敏感数据。

多重安全隐患并存

除了恶意的提示词注入,CNCERT还警示了OpenClaw存在的其他几项风险:

- 误删数据:OpenClaw可能因误读用户指令而不可逆地删除关键信息。

- 恶意技能模块:攻击者可向ClawHub等技能仓库上传恶意模块,用户安装后会执行任意命令或部署恶意软件。

- 漏洞利用:攻击者可利用OpenClaw最新披露的安全漏洞入侵系统并泄露敏感数据。

CNCERT特别指出,对于金融、能源等关键行业而言,此类漏洞可能导致核心业务数据、商业秘密和代码仓库泄露,甚至造成整个业务系统完全瘫痪,带来不可估量的损失。

防护措施与政策响应

为了应对上述风险,安全专家建议用户和企业采取以下防护措施:

- 加强网络访问控制,避免OpenClaw的默认管理端口暴露在公网。

- 采用容器化技术隔离服务。

- 避免以明文形式存储访问凭证。

- 仅从官方或可信渠道下载技能模块。

- 禁用技能的自动更新功能。

- 始终保持代理程序更新到最新版本。

OpenClaw的流行也吸引了攻击者的注意。他们借机散布伪装成OpenClaw安装程序的恶意GitHub仓库,用于部署Atomic、Vidar Stealer等信息窃取程序,以及基于Golang的GhostSocks代理恶意软件。Huntress安全公司表示,该活动并未针对特定行业,而是广泛攻击所有试图安装OpenClaw的用户。恶意仓库包含了针对Windows和macOS环境的安装指令。

此次攻击得以成功传播的一个关键原因在于,恶意软件被托管在GitHub上,并且该恶意仓库一度成为Bing AI搜索“OpenClaw Windows”时的置顶结果。

参考来源:

OpenClaw AI Agent Flaws Could Enable Prompt Injection and Data Exfiltration

https://thehackernews.com/2026/03/openclaw-ai-agent-flaws-could-enable.html

AI Agent的安全边界日益成为业界焦点,部署与使用中的风险不容忽视。关于AI安全、数据防护的更多深度讨论和实践分享,欢迎在云栈社区的安全板块与广大开发者一同交流。 |