前几天需要部署一个服务,便请同事帮忙,顺便问了他一个困扰我许久的问题:“Docker 和 K8s 到底是个啥?”

这两个概念我之前也查过资料,知道它们是为了“打包完整环境、实现一次构建,到处运行”。但坦白说,我的理解一直停留在表面,那些名词——镜像、容器、Pod、集群、节点——我都听过,却始终没能把它们的关系在脑子里串联起来。

同事当时用一个非常生活化的比喻给我解释,我瞬间就明白了。下面我就把这个清晰的思路分享给大家。

镜像:一个打包好的系统快照

你可以把 Docker 镜像理解成一个完整的系统快照。这个快照里面打包了运行一个应用所需的一切:

- 基础操作系统(例如 Ubuntu, Alpine Linux)

- 运行时环境(例如 Python 3.11、Node.js 20)

- 应用依赖的所有第三方库

- 你自己的应用程序代码

- 相关的配置文件

关键点在于,这个镜像是静态的、只读的。它就像一张已经刻录好的光盘,内容一旦生成就不会改变。

容器:运行起来的快照

容器,就是把上面提到的那个静态镜像给运行起来。

镜像(静态快照) --docker run--> 容器(运行中的进程)

容器是动态的、可写的。你可以在运行的容器里创建新文件、修改配置。但是请注意,这些修改仅限于容器生命周期内;一旦你销毁这个容器,所有改动都会消失(除非你通过“卷”将数据挂载到宿主机或外部存储)。

一个镜像可以同时运行出多个独立的容器实例,就像同一张系统安装光盘可以给无数台电脑安装系统一样。

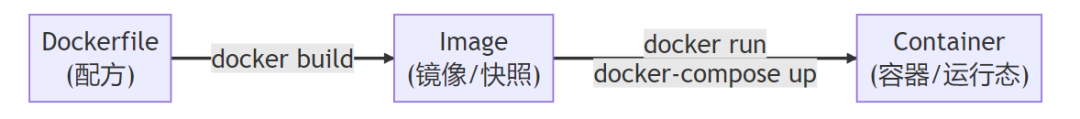

Dockerfile 与 docker-compose

理清了镜像和容器的关系,Dockerfile 和 docker-compose 就很好理解了:

- Dockerfile:它是定义如何“烹饪”出镜像的配方。

- docker-compose:它是定义如何编排和运行一组相关联容器的说明书。

举个例子,假设你写了一个 Python Web 服务,你的 Dockerfile 可能长这样:

# Dockerfile

FROM python:3.11-slim

WORKDIR /app

COPY requirements.txt .

RUN pip install -r requirements.txt

COPY . .

CMD ["python", "main.py"]

这份“配方”清晰地告诉 Docker 引擎:

- 基于官方的 Python 3.11 精简版镜像开始。

- 安装

requirements.txt 中列出的所有依赖包。

- 将当前目录的所有代码复制到镜像中。

- 指定容器启动时自动执行

python main.py。

当你执行 docker build 命令时,Docker 就会严格按照这个配方,一步一步地构建出最终的镜像文件。这就是现代容器化技术的基础。

为什么说“到处运行”?

Docker 的核心价值,正是解决了开发运维中经典的“在我机器上能跑,到你那就出问题”的困境。

在传统部署方式中,你需要操心一系列环境问题:服务器是 CentOS 还是 Ubuntu?系统里装的是 Python 3.8 还是 3.11?依赖库的版本是否匹配?环境变量配置对了没有?

而有了 Docker,所有这些环境依赖都被一起打包进了镜像。无论目标服务器是哪种 Linux 发行版,只要安装了 Docker 引擎,同一个镜像就能跑出一模一样的结果,真正实现了环境的一致性。

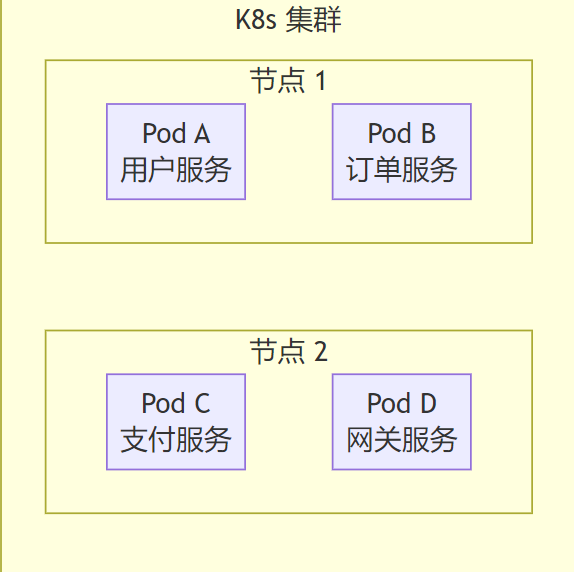

Pod:K8s 调度的最小单元

当我们从单机 Docker 进入到集群化的 Kubernetes 世界时,就引入了一个新的核心概念:Pod。

Pod 是 Kubernetes 自己定义的概念,它是 K8s 进行调度和管理的最小单元。一个 Pod 里面可以包含一个或多个容器。

你可能会问:Docker 已经管理容器了,为什么 K8s 不直接调度容器,还要额外抽象出 Pod 这一层?

这是因为在实际生产环境中,经常有多个容器需要紧密协作,组成一个“超级进程”。例如,一个主应用容器可能需要搭配一个 Sidecar 容器来收集日志。它们通常需要:

- 共享网络:彼此可以通过

localhost 直接通信。

- 共享存储:访问同一个文件目录。

- 同生共死:一起被调度、启动和销毁。

把这些容器放进同一个 Pod,K8s 就会保证它们被调度到同一台物理节点上,并满足上述资源共享的需求。当然,在大多数常见的微服务架构下,一个 Pod 里通常只运行一个业务容器,一个服务对应一个 Pod。

K8s 到底负责做什么?

Kubernetes 作为容器编排平台,核心工作就是管理这些 Pod 以及它们背后的资源:

- 调度:智能决定将 Pod 分配到集群中哪个最合适的节点上运行。

- 扩缩容:根据流量负载,自动增加或减少 Pod 的副本数量。

- 自愈:监控 Pod 的健康状态,如果某个 Pod 崩溃,会自动重启它或重新调度。

- 服务发现与网络:为 Pod 分配集群内唯一的 IP,并管理服务间通信。

- 存储编排:自动挂载指定的本地或云存储,管理数据的持久化。

简单来说,Docker 解决的是“如何打包和单机运行应用”的问题,而 Kubernetes 解决的是“如何在大规模集群中自动化部署、管理和扩展成千上万个容器化应用”的问题。

当你的应用只有几个容器,在一两台机器上跑跑,手动管理或许还行。但当你需要管理几十台服务器、数百个服务实例时,一个像 K8s 这样的自动化编排工具就不可或缺了。

我们可以用一条链来总结整个技术栈的层次关系:

Dockerfile → Image → Container → Pod → Node → Cluster

配方 快照 运行态 调度单元 机器 集群

概念本身并不复杂,真正的挑战往往来自于实际落地时遇到的各种具体问题和细节配置。但只要你脑中建立了这个清晰的基础模型,遇到问题时就至少能知道应该从哪个层面去排查和思考了。希望这个比喻能帮你更直观地理解 Docker 和 Kubernetes。如果你想深入探讨更多的云原生实践,欢迎到 云栈社区 与大家一起交流。