这些年,我们的数据越来越多,模型越来越复杂,从ARIMA到LSTM再到Transformer,但时间序列策略的“半衰期”似乎越来越短。回测结果往往亮眼,实盘表现却归于平庸。

为什么我们拟合历史的能力在增强,而面对未来的能力却在减弱?问题或许不在模型本身的复杂度上,而在于我们追求的目标。一味追求精确的“点预测”,可能从一开始就是一条走不远的道路。

点预测:被高估的确定性

“点预测”是统计学中对未来的一个具体数值判断,比如预测明天股价会涨1.2%,或者波动率是15%。它倾向于把复杂的未来压缩成一个单一数值,从而放弃了所有关于不确定性的信息。与之相对的另一种思路,是给出一个概率分布,例如预测有70%的概率上涨,且涨幅落在0.5%到2%之间。

诺贝尔经济学奖得主罗伯特·莫顿有一个经典论断,揭示了金融市场中可预测性的天然上限:

在信息充分传播的市场中,任何基于公开信息的预测能力都会被套利行为迅速抹平。

金融时间序列的点预测之所以格外困难,首要原因是信噪比极低。 价格波动中充斥着大量噪声,真正的信号往往非常微弱。在某些频率和资产上,可预测的部分可能连1%都不到。如果用一个高维的复杂函数去强行拟合这样一个低信噪比的过程,模型很容易在训练集上“学会”噪声模式,导致在测试集或实盘中失效。

另一个深层原因在于,我们实际上只有一个历史样本。 物理学实验可以重复进行,但金融历史只有一条已实现的路径。我们无法知道,如果历史重来一次,价格究竟会如何演变。一个在单一路径上表现优异的模型,在另一条可能的世界线中可能一败涂地。正如塔勒布在讨论不确定性时所强调的:

我们只能看到历史展开的一条路径,却无法知道其他可能的路径是什么样的。

从这两个角度来看,执着于追求精确的点预测,本身可能就是一个困难重重甚至方向有偏的目标。那么,我们是否可以换一个思路?

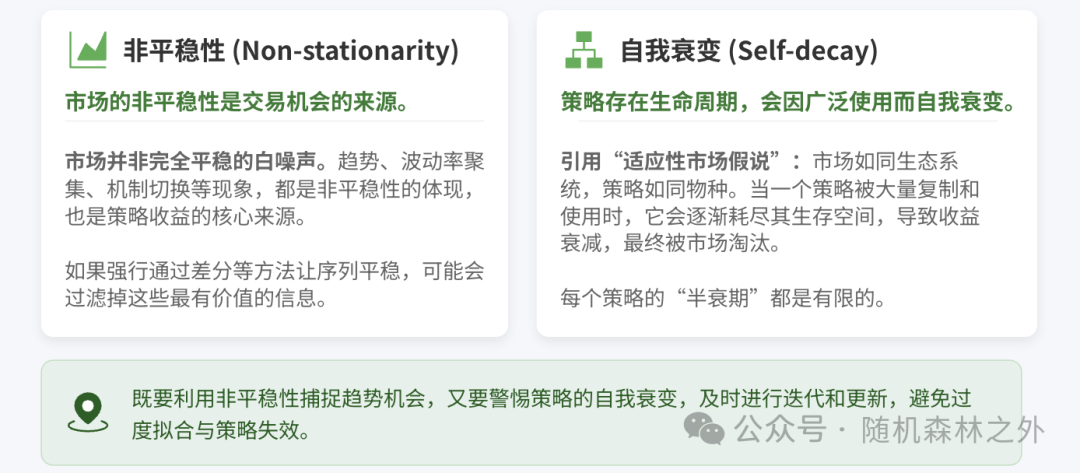

市场底层逻辑:非平稳与自我衰变

如果点预测这条路不好走,理解市场的底层特征或许能给我们新的启示。

许多教科书会告诉你,建模前要先做差分让序列变得平稳。但如果市场真的是完全平稳的,收益率序列就会接近白噪声,许多交易机会也就随之消失了。实际上,趋势、机制切换、波动率聚集等现象,恰恰是策略收益的重要来源,而它们本质上都是非平稳性的体现。如果强行将序列平稳化,很可能把最有价值的信息一并过滤掉。

MIT金融学教授罗闻全提出的“适应性市场假说”提供了一个生动的类比。他将市场比作一个生态系统,各种交易策略就像是其中的物种,在环境中繁衍、竞争、优胜劣汰。当一个策略被广泛复制和使用时,它会逐渐耗尽自己的“生存空间”——市场这个生态系统已经进化到不再适合它了。可以说,每个策略都有其有限的“半衰期”。

在一个本质非平稳且会自我调整的环境中,我们或许不再需要那个“更准”的点预测数字,而是需要一种能够感知并量化自身不确定性的概率预测,学会判断自己的预测在什么时候可能“不准”。

从信号到策略:量化不确定性的路径

面对点预测的困境,将不确定性进行量化是一条值得探索的路径。

1. 用不确定性来过滤信号

震荡市中模型信号反复被打脸,是很多趋势策略的痛点。传统模型总是输出一个方向信号,但无法告诉你这个信号有多可靠。一个实用的方法是使用模型集合,例如用不同的随机种子初始化训练多个结构相同的模型。当这些模型对当前市场状态的意见高度一致时(比如绝大部分都看多),信号相对可信;当它们分歧巨大时,无论平均信号看起来多强,都应该保持谨慎。

这里需要区分两种不确定性:认知不确定性和偶然不确定性。

- 认知不确定性源于模型自身的知识盲区,即它“没见过”这种市场状态。这时或许应该减仓观望。

- 偶然不确定性则源于市场本身的固有噪音,在趋势策略中,高波动有时反而意味着机会。

我们可以用模型集合预测结果的标准差来近似认知不确定性,用单个模型内部的预测方差来近似偶然不确定性。

2. 用分布来管理仓位

对于低频CTA策略,真正的趋势机会相对稀缺,月频级别可能只有几十次。在小样本场景下,参数调整极易过拟合。高斯过程回归的输出不是一个点估计,而是一个完整的概率分布,它同时给出预测均值和预测方差,后者直接反映了模型对这次预测的信心程度。

我们可以将凯利公式的一个变体应用于仓位管理:仓位与预测收益成正比,与预测方差成反比。这意味着,当模型自身感到“不确定”时,无论信号强度如何,仓位都会自动降低。模型学会了“主动收手”,而不是硬着头皮执行。 当然,高斯过程的可靠性严重依赖于核函数的选择和超参数的优化,这需要交叉验证或贝叶斯优化等方法来确定,并定期检视其是否仍适应市场结构。

此外,计算效率(可用稀疏近似优化)和资产间时变的相关性结构也是实际应用中需要处理的难点。

3. 用状态切换来识别市场环境

让一个为趋势市设计的模型在震荡市中运行,结果往往不理想。识别市场状态切换至关重要。我们可以使用贝叶斯变点检测方法,实时监控收益率或波动率序列,持续计算“当前发生了状态切换”的后验概率。当这个概率超过某个阈值时,就有统计证据表明市场可能进入了新阶段。

相比于传统的固定滚动窗口方法,变点检测能更精准地识别状态切换的实际发生时点。 基于这个信息,策略可以进行调整,例如从趋势跟踪转为空仓观望,或切换到均值回归模式。当然,也需要关注检测延迟(可结合其他指标双重确认)和过度切换(可设置“冷却期”)的问题。

延伸与落地:概率思维融入实盘

这种概率化的思路不仅适用于生成交易信号,更能贯穿策略的各个环节。

1. 风险管理:从点估计到分布估计

策略能走多远,很大程度上取决于风险管理的精细程度。如何判断当前风险是否可控?

传统做法是计算一个滚动窗口的历史波动率,乘以系数作为风险限额。问题在于,窗口长度选择主观,且过去真的能代表未来吗?用概率预测的思路可以做得更细致。以波动率预测为例,GARCH族模型的价值不仅在于它预测的“数字”,更在于它输出的条件分布。这个分布告诉我们,在当前环境下,未来波动率落在各个区间的概率。实盘中,可以基于此动态调整仓位,例如当预测分布的上四分位数超过阈值时,自动降低杠杆。

相关性估计同理。多资产组合的风险分散效果取决于资产间的相关性,而相关性是时变的。DCC-GARCH这类模型能输出相关系数及其估计误差区间。当误差区间扩大时,表明我们对相关性的判断不可靠,这本身就是一个风控信号,提示应降低组合杠杆或增加现金比例。

尾部风险预测场景更为直接。极值理论不关心“最可能发生的损失”,而是直接对分布尾部进行建模。它可以回答一个更实际的问题:在95%的置信水平下,未来一天的最大可能亏损是多少?这比“预期亏损”的点估计更有操作意义,因为它直接关联到止损线和保证金管理决策。

2. 策略诊断:从直觉判断到统计证据

策略上线后,一个现实问题是:它还能有效多久?

常见做法是观察近期收益曲线,回撤大了就怀疑失效。但这种方法容易误判。有时回撤只是市场环境暂时不利,策略逻辑未变;有时策略已失效,但回撤尚未显化。

引入概率思维,可以采用结构断裂检验来监测因子表现。以因子IC序列为例,CUSUM检验会持续计算一个统计量,当其超过阈值时,意味着IC序列的均值可能发生了结构性变化。输出结果不是“有效或无效”的二元判断,而是“失效的概率有多高”。我们可以将此概率作为调节策略权重的因子,概率越高,分配给该策略的资金越少。

同样可以用于收益归因。利用状态空间模型将策略收益分解为市场暴露、风格暴露和残差Alpha贡献。当残差Alpha的分布发生漂移时,模型会输出结构突变的置信度。这有助于区分“策略逻辑仍在,只是市场不对”和“策略逻辑本身已经失效”,比单纯凭直觉看曲线更可靠。

3. 组合构建:从固定规则到自适应

目标波动率策略是一个典型应用。设定一个目标波动率(如年化15%),每日根据预测波动率调整仓位,使预期波动率等于目标值。这里的核心是波动率预测,应使用GARCH或已实现波动率模型输出的分布,而非一个点估计。当预测波动率高于目标时降仓,低于目标时加仓。该策略历史上表现出更好的风险调整后收益,关键在于利用了波动率的可预测性。

动态再平衡的时机选择也能做得更精细。传统再平衡是固定频率,但不同市场状态下效果差异很大。在趋势市中,过早再平衡会牺牲收益;在震荡市中,不及时再平衡会导致风险偏离。我们可以用时序模型判断当前市场状态,例如用隐马尔可夫模型或变点检测输出“当前处于趋势市”的概率,并据此动态调整再平衡频率。

4. 另类数据处理:从原始信号到结构化特征

另类数据的价值,往往在于从中提取出的稳定结构性特征。以供应链货运数据为例,每周的原始数值噪声很大。利用HP滤波或小波变换可将其分解为趋势项和周期项。趋势项可能对应企业基本面的长期变化,周期项可能反映季节性。这两条新序列的时序特性比原始数据更稳定,更适合作为因子输入。

概率思维也能用于识别领先滞后关系。假设有一条另类数据与某股票收益率序列,你想验证数据是否领先于股价。格兰杰因果检验输出的不是简单的“是或否”,而是统计显著性水平(P值),它告诉我们这个领先关系有多可靠。只有当这个概率超过某个阈值(如95%)时,才将数据纳入预测模型,从而避免将随机相关性误判为因果关系。

在大数据监控场景中,概率方法更为高效。假设需要监控上千只股票的另类数据,人工盯盘不现实。为每个序列建立SARIMA或Prophet基线模型,每日计算“当前观测值偏离基线”的概率。当此概率超过阈值时触发警报,这可能是数据质量问题,也可能是基本面发生了重要变化。这种方法的优势在于,它将“异常”的定义从固定阈值升级为概率判断,更能适应不同序列自身的波动特性。

上述应用的背后逻辑是共通的:努力刻画不确定性的区间,并将这个区间直接映射到仓位、杠杆、频率、阈值等具体的决策变量上。 这套思路的核心,是告诉我们“应该在多大程度上相信自己的判断”。

从预测到感知

如果我们应对市场的方式,与市场的根本属性相悖,那么可能从一开始就走错了方向。

比起寻找一个“永恒有效”的圣杯规律,更重要的是建立一套能够感知规律变化、并随之自适应调整的系统。这套系统意味着几个关键转变:

- 目标层: 从预测价格点位,转向量化不确定性。

- 信号层: 从输出单一数值,转向输出一个概率分布。

- 仓位层: 从固定杠杆,转向基于不确定性动态调整。

- 策略层: 从单一策略永恒运行,转向基于状态识别进行切换。

- 诊断层: 从直觉经验判断,转向用统计证据持续监测状态。

在量化交易中,我们既是市场的观察者,也是参与者。当资金规模尚小时,我们更像是信息的被动接收者。但随着规模增长,交易行为本身就会成为市场演化的一部分。那时,重要的或许不再是预测的绝对精度,而是对自身判断局限性的清醒认知,以及在云栈社区这样的技术交流平台中持续学习和迭代的能力。

概率预测与贝叶斯思维,正是构建这种认知与适应能力的底层工具。它们并非万能,但相比于盲目追求那个永远难以捉摸的“精确点”,这条道路或许更值得深入探索。

正如罗闻全教授的比喻:市场如同生态系统,物种会进化、会灭绝,但生态系统本身持续运转。我们能做的,是学会在这个不断变化的生态中,识别方向、调整姿态、持续进化。