最近收听了张小珺采访AI科学家谢赛宁的播客,这场长达7小时、从下午持续到凌晨的深度对谈,引发了我许多思考,特此记录与分享。

张小珺是谁?她是中国科技商业领域最具辨识度的深度访谈者之一,财经作者,播客《张小珺Jùn|商业访谈录》的主理人。她的访谈对象几乎覆盖了中国科技圈的核心人物——从旷视印奇到星海图高继扬,她擅长用长时间、高密度的对话,把那些通常藏在PPT和新闻稿背后的真实想法“逼”出来。

她说过一句话: “如果我的访谈能陪你走一段孤独的未知的路,也许有一天可以离目的地更近一点,我就很温暖。”

这场没有预设剧本的马拉松式对话,或许为我们揭开了当前人工智能浪潮下最值得深思的一层帷幕。

对面坐着的人叫谢赛宁。

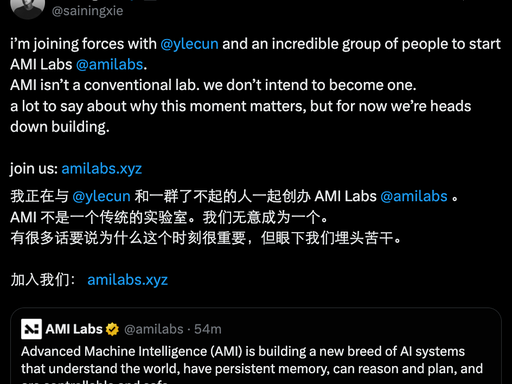

这个名字你可能不熟悉,但如果你体验过Sora,或者看过任何AI生成的视频,那么你正在接触的技术底层——Diffusion Transformers(DiT)——正是他参与奠基的。他的论文被引用近10万次,曾与何恺明合作开创了ResNeXt、MoCo等里程碑式的工作。就在这场访谈前不久,他与图灵奖得主杨立昆(Yann LeCun)共同创立了AMI Labs,在没有任何产品的情况下完成了10.3亿美元的种子轮融资,投前估值35亿美元——创下欧洲有史以来最大的种子轮纪录。

而这次播客,是他第一次接受公开深度访谈。

从下午2点开始,他们聊了整整7个小时,谈话覆盖了世界模型、硅谷的现状、两次拒绝OpenAI联创Ilya的邀请、与杨立昆和李飞飞的故事、研究品味与《金刚经》,以及那个科幻迷都懂的终极答案——42。

这不是一篇技术论文的解读,而是一位顶级AI科学家的思想全景图。

一、“普通的一个”——谢赛宁是谁?

在AI圈,谢赛宁是一个非常特别的存在。

他并非那种自幼便天赋异禀、注定改变世界的天才。他自嘲是“the normal one”——普通的一个。

1990年出生,上海交通大学ACM班毕业。大学期间,他的关键词不是“刻苦钻研”,而是——打游戏。

用他自己的话说,在交大ACM班那个人才济济的地方,他就是“混日子”的那一个。

但人生的轨迹,往往不是线性的。

“最糟糕的研究是,你一开始定义了一个问题,说这是我的想法,最终发表的论文其想法却与开始时天差地别。”

这是谢赛宁后来从何恺明那里学到的研究哲学,但某种程度上,也是他自己人生的写照。他的每一步选择,都充满了看似随机的转向:

- 放弃了微软亚洲研究院的实习机会,全凭兴趣。

- 博士申请截止前几天才被导师“捞起” ,差点错过加州大学圣地亚哥分校。

- 在Meta的FAIR实验室待了4年,之后又去了Google DeepMind。

- 现在,他是纽约大学的教授。

如果画一条他的人生轨迹线,你会发现它不是一根直线,而是一个充满“随机梯度下降”的优化过程——不断探索、试错、修正,最终收敛到一个令人惊叹的位置。

而这种“非线性”,恰恰是他认为好的研究应该有的样子。

二、与何恺明的友谊:顶级研究是怎样诞生的?

谈到谢赛宁的学术生涯,绕不开一个名字——何恺明。

何恺明是ResNet的提出者,深度学习领域引用量最高的研究者之一。如果说深度学习有一个“名人堂”,他一定是其中最耀眼的成员之一。

谢赛宁与何恺明在Meta FAIR期间建立了深厚的合作关系,共同完成了ResNeXt等影响深远的工作。但让谢赛宁印象最深的,不是这些最终成果,而是过程。

他回忆说,真正的顶级研究,并非你坐下来想出一个绝妙的点子,然后线性地执行到底。现实恰恰相反:

你需要花大量时间做看似无用的事——复现基线、尝试各种改动、在无数失败中寻找微弱的信号。真正的创新点子,往往在探索后期才突然涌现。

ResNeXt就是这样诞生的。在漫长的探索期之后,从无到有,仅用了一个月。

这让他总结出一条反直觉的研究方法论:

如果一个研究项目从头到尾想法都没变过,那它大概率是一篇无聊的论文。

这种观点放在今天的学术界,堪称一记重锤。太多研究者(尤其是博士生)被教导要“效率优先”,在最短时间内发表论文。但谢赛宁认为,评价一个研究者,应该看长期积分而非单点估计。一篇“签名式工作”的价值,远超十篇平庸论文之和。

这就像一个比喻:好的研究就像好的投资——你不需要每次都赢,但你需要确保赢的那几次,赢得足够大。

三、两次拒绝Ilya:为什么说No比说Yes更难?

整场访谈中最令人惊讶的故事之一,是谢赛宁两次拒绝了Ilya Sutskever的邀请。

Ilya Sutskever——OpenAI的联合创始人、首席科学家,被公认为当今世界最重要的AI研究者之一。能被Ilya亲自邀请,对绝大多数研究者而言,是梦寐以求的机会。

但谢赛宁说了两次No。

第一次是2018年。 Ilya邀请他加入OpenAI。谢赛宁选择了Meta FAIR——因为当时的FAIR更像一个纯粹的研究圣地,而OpenAI的方向与他的研究理念存在根本分歧。

第二次是2024年。 Ilya离开OpenAI后创立了新公司SSI(Safe Superintelligence Inc.),再次向谢赛宁发出邀请。谢赛宁再次婉拒。

“Ilya给我打电话,我什么也没说,我只是拒绝了。”

为什么?

核心原因只有一个:路线之争。

谢赛宁坚定地认为,以大语言模型(LLM)为核心的路线,并非通向真正通用智能(AGI)的正途。他看重的是多模态与视觉优先——让AI像人类一样,通过观察和理解物理世界来获得智能,而不是仅仅通过阅读互联网上的文字。

而Ilya的路径,无论是在OpenAI还是后来的SSI,都更偏向于在语言模型的基础上深化。

这不是个人恩怨,而是信仰之争。

在一个“唯恐错过”的时代,说No需要的不是勇气,而是清醒。

四、“语言是毒药”——硅谷被催眠了?

如果说整场访谈有一个最震撼的观点,那一定是这句:

“Language is actually a poison. 语言实际上是一种毒药。”

什么意思?谢赛宁的逻辑链条是这样的:

第一步:人类智能的根基不是语言,而是视觉。

他引用了一个经典的科学事实:人类大脑皮层70%的区域在处理视觉信号。不只是人类——整个动物界的智能爆发,都始于5亿年前的寒武纪大爆发,而那次大爆发的核心驱动力就是——眼睛的诞生。

换句话说,在语言出现之前的几亿年里,生物已经通过视觉建立了对物理世界的深刻理解:重力、碰撞、因果、空间……这些“常识”不需要语言来表达,但它们是智能的真正基石。

第二步:语言是一个有损压缩的通信协议。

语言是什么?本质上,它是人类为了沟通而发明的工具。为了高效传递信息,语言不得不丢弃大量关于物理世界的细节。你可以用语言描述“一个苹果从树上掉下来”,但你无法通过这句话真正体验重力——那种加速度、空气的阻力、落地时的震动。

所以谢赛宁说:

“如果AI只学习语言数据,就像一个人只读书却从不睁眼看世界——它获得的是二手的、被过滤过的知识,而非对现实的直接理解。”

第三步:大语言模型让整个行业上瘾了。

这就是他所说的“毒药”的深层含义。ChatGPT的巨大成功,让整个硅谷都陷入了一种“LLM催眠状态”——所有的资源、人才、注意力,全部涌向了大语言模型。

“Silicon Valley is very LLM-pilled. 硅谷已经深陷于LLM,完全被它催眠了。”

他用了一个更激烈的比喻:

“如果语言是拐杖,而你一直拄着它走路,你的腿部肌肉永远也锻炼不出来。如果语言是鸦片,你持续服用,终将被毁掉。”

这种观点在当下的AI圈近乎“异端”。当所有人都在讨论GPT-5、Claude、Gemini时,谢赛宁站出来说:这条路,可能走不到终点。

这需要极大的学术自信,也需要敢于对抗主流潮流的勇气。

五、世界模型:不是预测下一个词,而是预测下一个世界

说完了“什么是错的”,那么谢赛宁认为“什么是对的”?

答案是:世界模型(World Model)。

但首先要澄清一个普遍的误解:世界模型 ≠ Sora。

很多人听到“世界模型”,第一反应是OpenAI的视频生成模型Sora——它不是号称“世界模拟器”吗?

谢赛宁明确区分了两者:

|

语言模型 |

视频生成模型(如Sora) |

世界模型 |

| 预测什么 |

下一个token(词) |

下一帧像素 |

下一个状态(在抽象空间中) |

| 核心能力 |

语言理解与生成 |

视觉内容生成 |

理解、预测、规划 |

| 关键区别 |

操作离散符号 |

操作原始像素 |

操作抽象表征 |

世界模型的关键词是:抽象与预测。

想象一下你在走路。你的大脑不需要“渲染”出前方每一个像素的图像,然后才决定下一步怎么走。你的大脑做的是:

- 把眼前的场景抽象为一个内部表征(前面有台阶、右边有人、地面有水)

- 基于你的行动意图,预测下一步会发生什么(如果我往右走,会撞到人)

- 基于预测结果,进行规划(所以我应该往左走)

这就是世界模型的工作方式。它不是在像素层面做生成,而是在一个更高、更抽象的“表征空间”里做预测和规划。

谢赛宁和杨立昆推崇的核心架构是JEPA(Joint Embedding Predictive Architecture,联合嵌入预测架构)——其核心思想正是:在抽象的表征空间中进行预测,而不是在原始数据层面进行重建。

为什么这很重要?

因为只有在抽象空间中的预测,才能支持真正的规划(Planning)。而规划——根据当前状态和目标,搜索最优的行动序列——才是通向真正智能的关键。

你让ChatGPT写一首诗,它会给你一个很好的结果。但你让它规划“如何从北京到上海,中间要经过南京办一件事,而且预算只有500块”——它的“思考”本质上是在做文字接龙,而不是真正的搜索与规划。

这就是语言模型(依靠思维链推理)和世界模型(依靠模型预测控制进行规划)的根本区别。

六、AMI Labs:25个人,10亿美金,零产品

理念讲完,谢赛宁并非空谈。2024年底,图灵奖得主杨立昆离开Meta,与谢赛宁等人在巴黎创立了AMI Labs(Advanced Machine Intelligence Labs)。

这家公司的基本数据令人瞠目:

- 团队人数:仅25人

- 产品:零

- 种子轮融资:10.3亿美元

- 投前估值:35亿美元

- 投资方:英伟达、贝索斯家族投资机构、淡马锡等顶级资本

25个人,没有任何产品,就拿到了10亿美金。

这背后是什么?

一方面是FOMO(害怕错过)情绪的集中爆发。正如一些行业观察者所分析的:那些错过了OpenAI早期投资机会的资本,不想再错过第二个潜在巨头。即使投错的概率很大,也要在这些“有顶级团队、有颠覆性理念但尚无成果”的方向下重注。

另一方面,是杨立昆+谢赛宁这个组合的顶级号召力。杨立昆是AI领域“三巨头”之一,图灵奖得主;谢赛宁是计算机视觉领域最高产、最有影响力的年轻研究者之一。两人联手探索一条与主流背道而驰的路径,本身就是一个极具吸引力的故事。

谢赛宁在访谈中还提到了一个有趣的细节:他当初选择去Google兼职的一个重要原因是——

“我去谷歌做这份工作,是因为我想看看谷歌的人在做什么,这样我就知道在学术界不该做什么。”

这不是凡尔赛,这是一种战略性的差异化思维。在所有科技巨头都在大语言模型上疯狂堆砌资源的时代,作为学术研究者或初创公司,在同一条赛道上正面竞争无异于以卵击石。

所以,找到巨头们不做或做不好的事,然后全力做好它——这才是明智的策略。

AMI Labs的使命正是:不做大语言模型,专注世界模型。

他们的目标是打造一个能够真正理解现实世界、具备长期记忆和规划能力的智能系统,潜在应用方向包括AI眼镜、机器人等需要与物理世界深度交互的场景。

当然,这也是一场巨大的赌注。正如访谈中提到的,这个方向可能需要5到10年才能看到实质性成果。在这个追求“快速迭代与变现”的时代,这种时间尺度本身就是一种反叛。

七、杨立昆往事与李飞飞之问

访谈中,谢赛宁还聊到了与几位AI大牛的交往故事。

杨立昆:一场关于“表征的世界”的共鸣

谢赛宁回忆,他与杨立昆的深层连接,始于对“表征学习”的共同执着。他认为,从他早期的深度监督网络到近期的DiT、RAE,所有研究的核心主线只有一条——如何学习更好的表征。而杨立昆长期倡导的JEPA架构,本质也是关于“如何在表征空间中进行预测”。两人在这个“表征的世界”里找到了高度共鸣,这也是AMI Labs诞生的思想基石。

李飞飞:为什么中文世界出不了OpenAI?

访谈中还提到了另一位华人AI巨星——李飞飞。谢赛宁与李飞飞曾讨论一个尖锐但重要的问题:为什么中文世界出不了OpenAI? 这个问题背后涉及学术体制、创业环境、文化心态等多重复杂因素,虽未在访谈中展开,但其本身已足够令每一位中国AI从业者深思。

八、Research Taste与《金刚经》

访谈进行到后半段,话题愈发深入——他们开始聊研究品味(Research Taste)和《金刚经》。

这是整场对话中最出人意料的环节之一。一位顶尖AI科学家,在探讨技术前沿时,引用了一部佛教经典。

谢赛宁认为,做研究最重要的能力或许不是纯粹的技术实力,而是品味——即知道什么问题值得深究,什么方向值得长期投入。这种品味无法通过标准课程习得,它来自于大量的阅读、思考、与聪明人的交流,更来自于对“无用之事”的包容与探索。

而《金刚经》中“应无所住而生其心”的思想,与他对研究的理解暗合——不执着于某一个具体的想法或方向,保持开放心态,让真正的洞察在自由的探索中自然涌现。

这种思想在如今追逐排行榜、抢发论文的AI研究界堪称一股清流。谢赛宁的观点是:

真正改变世界的研究,需要耐心、品味和不功利的探索精神。

九、“我们需要下载人类”——数据瓶颈的终极挑战

当被问到世界模型需要什么样的数据时,谢赛宁给出了一个令人震撼的回答:

“We need to download humanity. 我们需要下载人类。”

这不是修辞,而是一个严肃的技术判断。他指出了一个惊人的对比:一个四个月大的婴儿,仅仅通过眼睛接收的视觉信息量,就已经超过了当前最顶级LLM(如GPT-4)的全部训练数据。

想想这意味着什么。GPT-4训练用了互联网上几乎所有的优质文本,达数万亿token。但一个婴儿在4个月内通过视觉接收的信息量就超过了这个数字。

这说明:文本数据只是人类知识冰山的一角。

互联网上的文字,本质是人类经验的一个极度压缩的投影。真正的“知识”——关于物理世界的常识、人类行为与情感的理解、时空直觉——绝大部分从未被写成文字。

因此,要构建真正理解世界的AI,我们需要的数据不是“下载互联网”,而是“下载人类”——囊括人类的视觉体验、身体感知、社交互动等全方位数据。

这就引出了一个巨大的技术、伦理与法律挑战:这样的数据从何而来?如何收集?如何处理隐私与版权问题?

谢赛宁坦言,这是世界模型路线面临的最大瓶颈之一,但也正因如此,它才是一个真正值得解决的、根本性问题。

十、“42”——终极答案与未竟之问

访谈的尾声,落在了“42”上。

如果你读过《银河系漫游指南》,你一定知道这个梗:一台超级计算机用750万年计算出了“生命、宇宙以及一切的终极答案”——答案是42。但问题是:没有人知道那个终极问题是什么。

谢赛宁用这个经典的科幻意象来收束整场对话:

“42是终极问题的答案,但我们可能都没机会问清终极问题本身。”

这已不仅仅是关于AI技术的思考,更是关于人类存在的哲学叩问。

我们创造AI,终极目的究竟是什么?是为了让工具更高效,还是为了探索智能的本质、意识的起源,以及“理解”二字的真正含义?

谢赛宁选择了一条少有人走的路。当世界都在优化“下一个token预测”时,他和杨立昆在追问一个更底层的问题:机器如何才能真正理解这个世界?

这条路更长、更艰难、也更不确定。但如果他们是对的——哪怕只是部分正确——那将意味着AI发展史上一次深刻的范式转移。

后记

回顾这场7小时的对话,最打动我的或许不是那些惊人的观点或数字,而是一种稀缺的态度。

在一个被FOMO驱动的行业里,谢赛宁展现了一种罕见的定力。

- 当所有人涌向LLM时,他说“语言是毒药”。

- 当OpenAI联创亲自邀约时,他两次说“No”。

- 当行业追求快速变现时,他规划“5到10年”。

- 当众人比拼评测分数时,他强调“品味比技术更重要”。

他并非为了标新立异而唱反调,每一个观点都建立在扎实的研究积累与深刻的独立思考之上。

当然,他可能是错的。世界模型的路线可能最终被证明行不通,LLM或许能演化出真正的理解,AMI Labs也可能耗尽巨资却无产品问世。

但科学的进步,从来都需要有人敢于在“共识之外”下注。

正如谢赛宁自己所言:“如果一个研究从始到终想法都没变过,那它大概率是无聊的。”

真正精彩的故事,总是充满了意想不到的转折。

而关于智能的故事,显然还远未到终章。这场发生在开发者广场的广泛讨论,也远未结束。