前脚Token的中文刚被官方认证为「词元」,马上又来了一个亟需被认证的新词 Harness。

如今想在AI圈子里当个「全面发展的专业人士」,每天要跟进的新概念实在不少。从最早一个ChatGPT能指代一切,到后来需要区分Prompt(是提示词还是文令?)、MCP、RAG检索增强生成,以及Agent(智能体而非代理)和Skills等等。这些堪比「颗粒度」、「对齐」的行业术语,如果你都听过,至少能在聊AI的饭局上接上话。

但现在,新的挑战来了:什么是Harness?有网友在社交媒体上用一张淘宝搜索截图幽默回应,表示「很好理解」。

这看似离谱,但若我们将AI视为需要指挥的“牛马”,把Harness翻译成套在其身上的“马具”或“束缚”,也并非全无道理。

Harness为何进入AI视野?

实际上,Harness被正式引入人工智能领域的Agent语境,始于Anthropic去年十一月的一篇博客。文中他们探讨了当前Agent执行的任务越来越长,需要一个有效的Harness来确保其运作正常。

博客链接:https://www.anthropic.com/engineering/effective-harnesses-for-long-running-agents

到了今年,随着本地运行Agent的热度回升,众多AI开发者和研究员在技术博客中也频繁提及Harness。知名博主Mitchell提到,Harness Engineering的理念是「每当发现某个智能体犯错时,就花时间设计一个解决方案,确保它以后不再犯同样的错误。」

紧接着,OpenAI在今年二月也发布了几篇关于Harness engineering的博客。在他们看来,未来工程师的工作不是写代码,而是设计智能体的「工作环境」,Harness就是这个工作环境本身。

在OpenAI官网选择中文后,这个词被直接翻译成了「工程技术」。博客链接:https://openai.com/zh-Hans-CN/index/harness-engineering/

为什么Harness开始被重视?

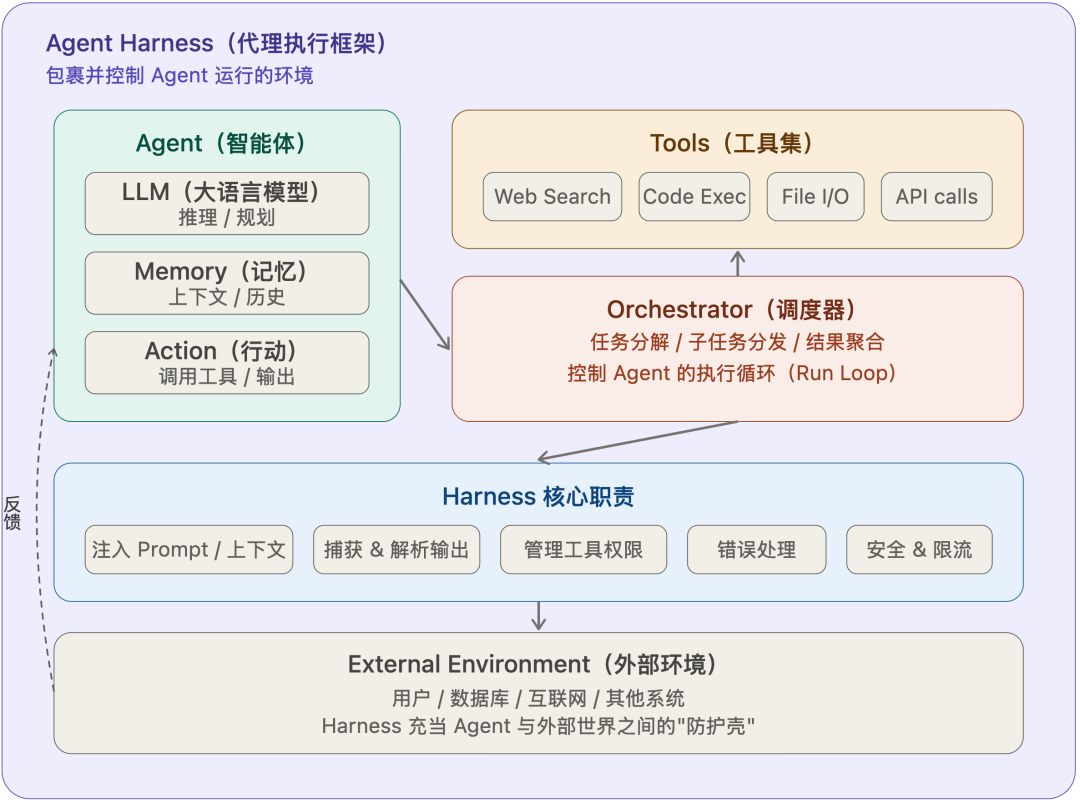

无论是Anthropic的早期论述,还是后来OpenAI的Harness工程实践,其核心故事是一致的。Harness是一种包含环境配置、多Agents协作机制、严格架构约束和上下文管理的系统,它旨在弥补当前大语言模型的「上下文焦虑」和易错性。

两家顶级AI实验室都用内部工程实践证明了,让大模型自主编写海量代码的关键,并非完全依赖于模型本身的智能,而在于构建了一个强大的Harness(工作流框架/护栏系统)。

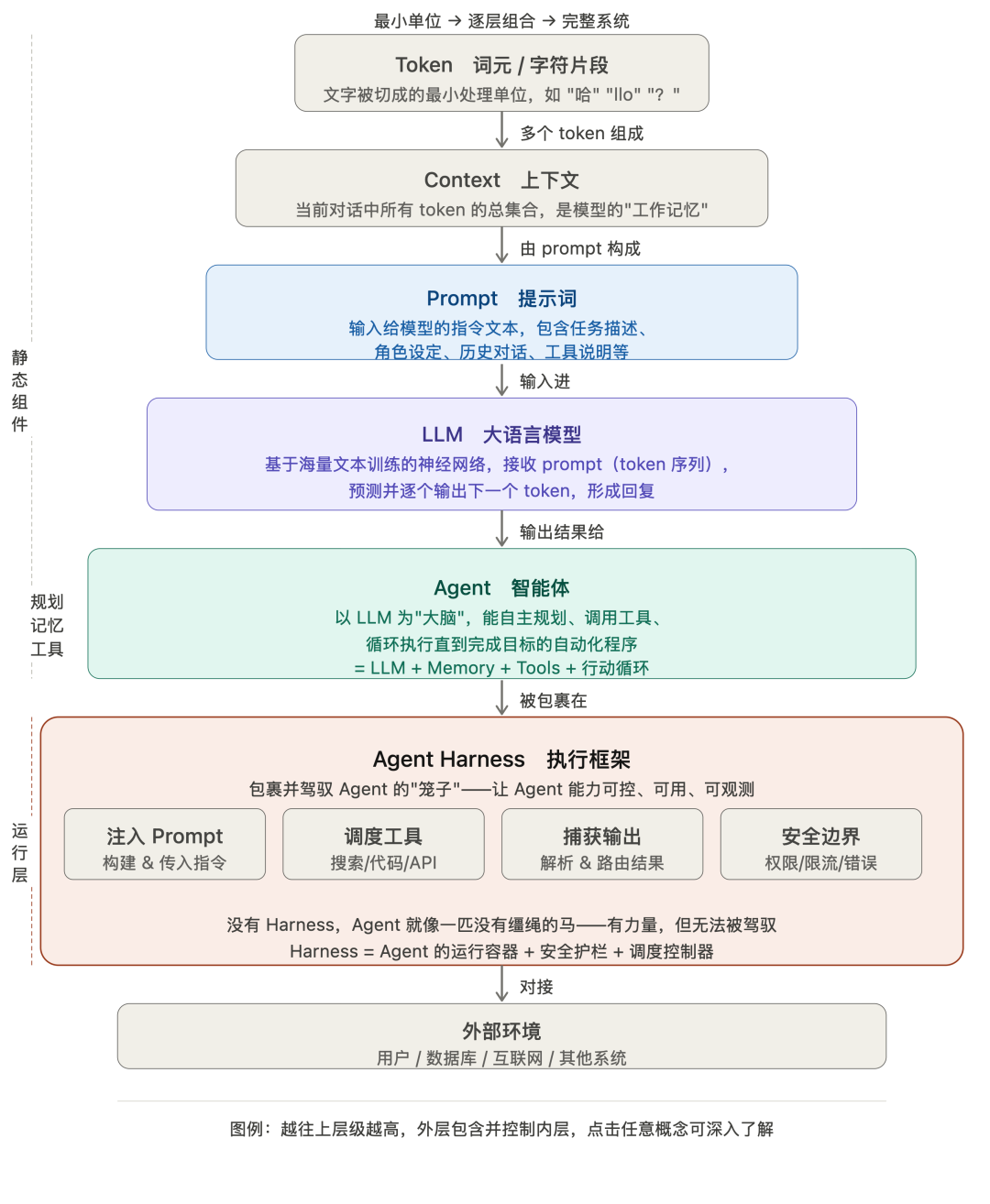

我们可以这样理解:Harness = Agent的运行容器 + 安全边界 + 调度控制器。

在Anthropic的内部实验中,研究人员发现AI竟也会出现类似「心理问题」的现象。当Claude执行长周期编码任务时,一旦它感知到自己的上下文窗口即将耗尽,就会产生「上下文焦虑」。这好比临近下班的打工人,开始敷衍了事,急于结束任务。更麻烦的是,Claude自身无法识别这种敷衍行为产生的代码问题。

面对这种难题,传统的提示词优化收效甚微。Anthropic研究员给出的Harness解决方案是:重构组织架构。他们设计了一个包含三个角色的Harness闭环:

- 规划师(Planner):负责将一句话需求扩写为详细的产品文档。

- 生成器(Generator):纯粹的“执行者”,只负责按文档编写代码。

- 评估器(Evaluator):严格的QA兼产品经理,手握自动化测试工具,冷酷评估产出。

Anthropic的报告指出,应用Harness框架的Agent在生成网页质量上显著提升,但成本和时间也更长。在一个开发游戏制作器的任务中:

- 没有Harness的组,AI运行20分钟,花费9美元。结果界面尚可,但核心功能损坏——游戏角色对键盘操作无反应。

- 有Harness的组,运行6小时,花费200美元。结果游戏可玩,且包含动画系统、音效和AI辅助的关卡设计。

在这套体系中,生成器每写完一段代码,评估器就会像真实用户一样点击测试,一旦发现Bug或充满“AI塑料味”的设计,便立即打回重做。

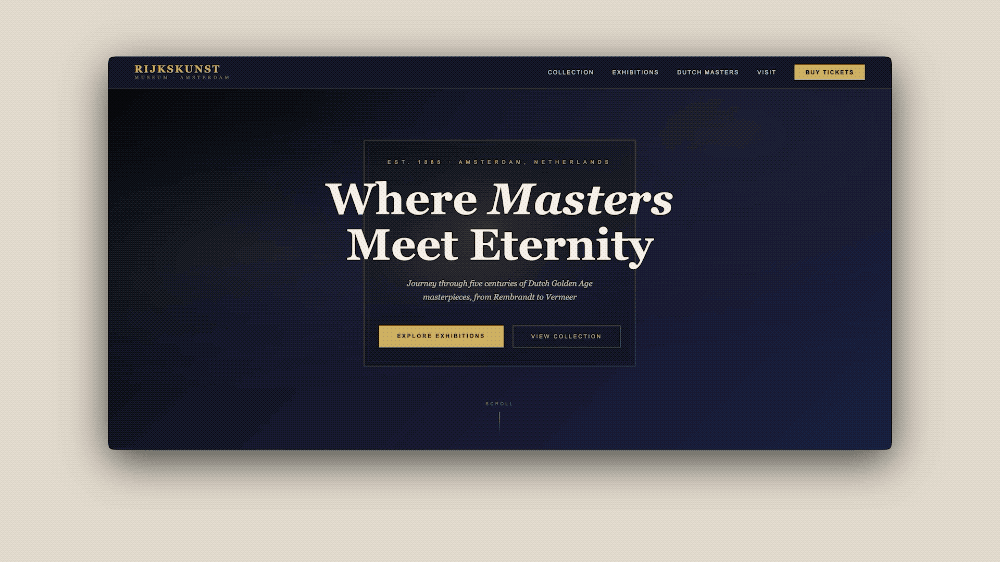

在另一个设计荷兰艺术博物馆网页的任务中,Harness展现了激发创造力的潜力。前9次迭代,AI都在产出平庸的网页。但在评估器的持续压力下,第10次迭代,AI突然抛弃所有模板,交付了一个特立独行的3D空间:画作悬挂在透视棋盘格房间中,用户需像走迷宫般探索。

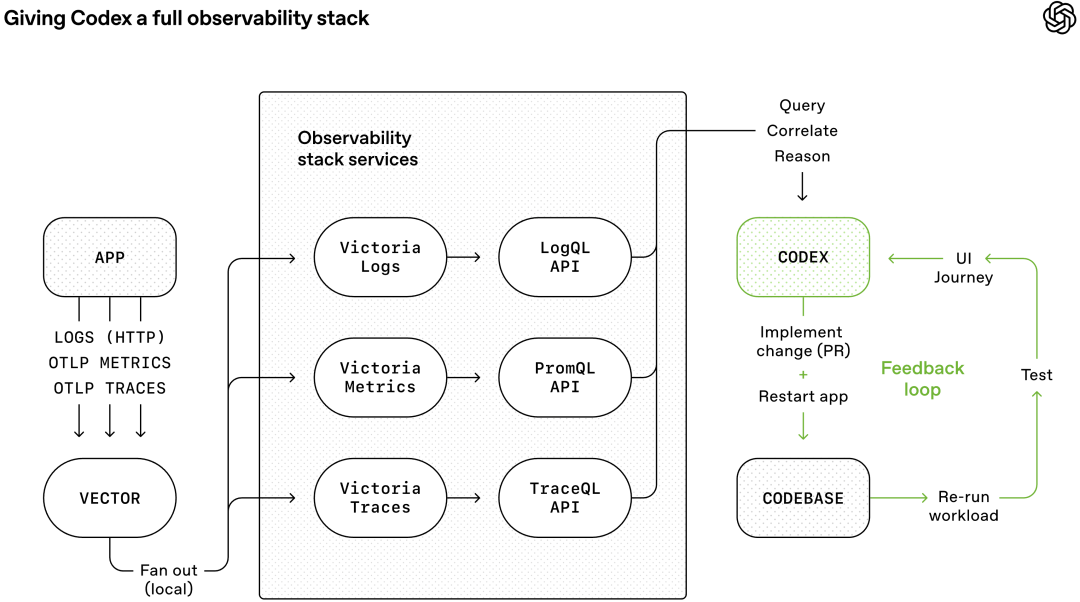

如果说Anthropic的Harness侧重于探索组织架构的设计原理,那么OpenAI的Codex团队则将Harness工程化为一种工作流框架和文化。他们的核心约束是:没有人工手写的代码。所有代码——业务逻辑、测试、CI配置、文档等——均由Codex(他们的AI)编写。工程师的核心工作转变为设计能让AI可靠运行的环境。

最初,他们尝试用一个超长的AGENTS.md文件来规定所有规则,但很快因上下文限制导致AI只做机械的模式匹配,且文档难以维护而过时。后来的做法是:AGENTS.md仅作为100行的“目录”,将AI指向结构化的docs/文件夹。所有架构文档、产品规格等都版本化并由AI自行维护更新。

他们不干涉AI编写具体逻辑,但在Harness中设置了极其严格的Linter(代码检查工具)和物理依赖边界。业务代码只能单向调用,越界即被系统阻断,无法合并入主分支。在这个Harness中,人类设定的规则成为AI不可违背的“物理法则”。AI如同生活在「楚门的世界」,拥有编码自由,但永远在人类设定的结界——Harness之内。

总结这些研究,Harness的本质是一套系统性方案,用于补偿当前AI的短板:

- AI不擅长长期记忆 -> Harness用进度文件、git历史、结构化文档来弥补。

- AI自我评价过于宽松 -> 引入独立的评估Agent,带着具体标准和真实环境测试。

- AI在复杂任务中易偏航 -> 通过任务分解、结构化、合约约定来约束范围。

- AI缺乏对代码库架构的直觉 -> 通过文档和自动化规范检查,将人类判断转化为系统规则。

有趣的是,随着模型能力增强,Harness的某些部分可能变得不再必要,但新的需求又会出现。Anthropic在升级到Opus 4.6后,发现之前为对抗「上下文焦虑」设计的机制可以直接移除,因为新模型已能自行处理。但同时,他们发现了新方向:利用Harness让AI在应用中自动集成AI功能。对Harness而言,模型越强,其使命不是变得更简单,而是去攻克更难的问题。

Harness该如何翻译?

在那条询问「继token、Agent之后,又来了一个难以翻译的词:Harness」的推文下,除了搞笑的“战术胸带”截图,网友们也贡献了众多译法:“线束”、“驾驭层”、“Agent框架”、“管控层”、“脚手架”,乃至“安全套”、“套马杆”、“槽具”等幽默提案。

微博上的讨论同样热烈。有人提议若Token译作“智元”,Harness或可叫“智驭”;也有人认为这个概念可能像MCP一样只是短暂流行。

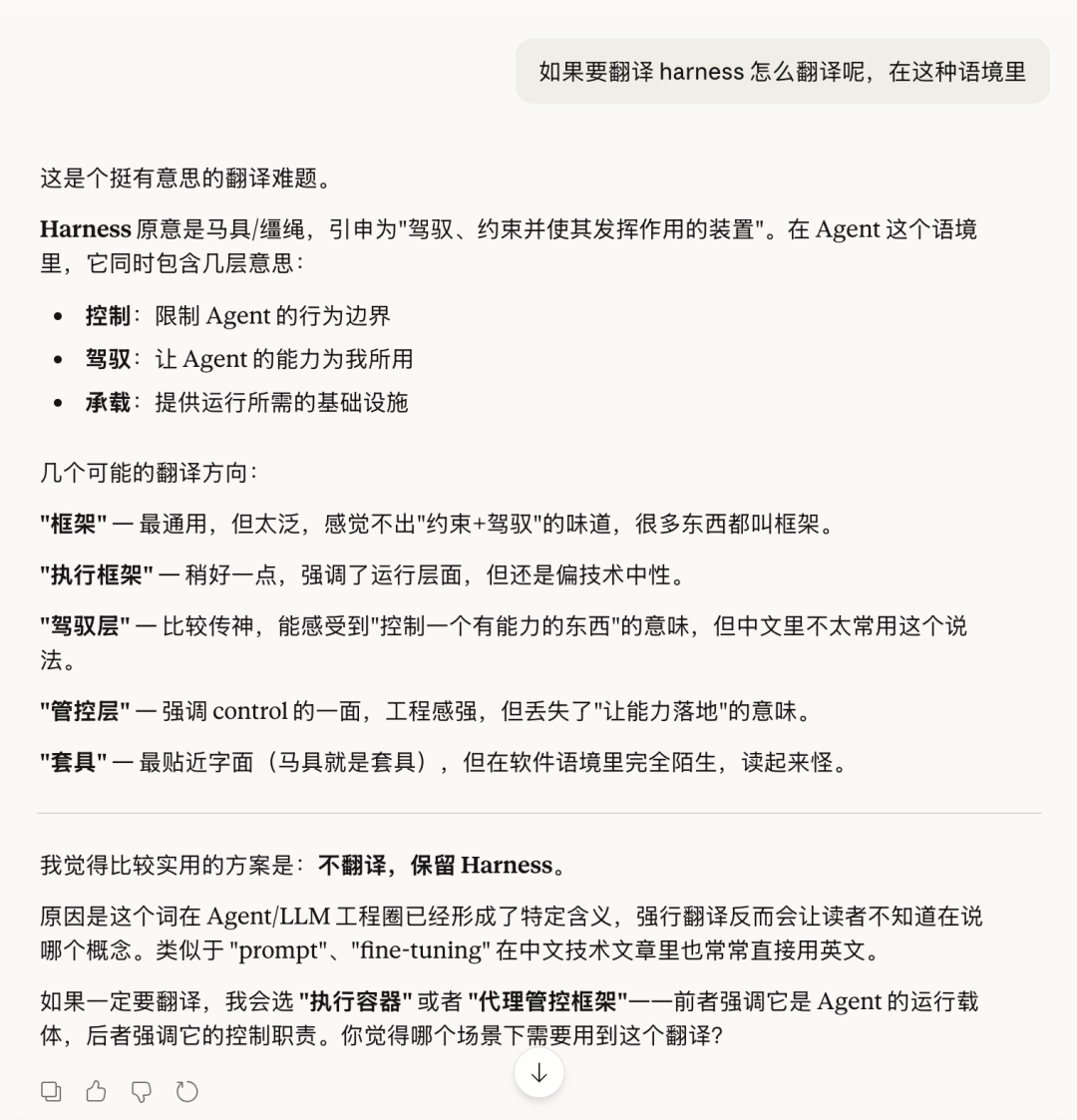

我们询问了Claude的意见,它给出了多个选项但均觉不妥:“框架”太泛;“执行框架”偏中性;“驾驭层”不常用;“管控层”缺“执行”意;“套具”则完全陌生。因此,它认为比较实用的方案是:不翻译,保留Harness。

一个概念若能用一个词完整概括,翻译本是顺理成章。Harness之所以难译,是因为它在LLM工作流中同时包含了「约束」、「执行」、「环境」、「系统」等多层含义,拆分哪个都只说对一半。

就像Token最终被认证为「词元」,Harness大概率也会迎来它的官方中文译名。在那之前,当你在技术文章或云栈社区这样的技术论坛里看到这个词,知道它指的是“那个驾驭并控制AI智能体高效、安全运行的框架系统”就足够了。

然后在某个聊到AI未来的饭局上,你可以适时地说一句:「在未来,会写提示词和Skills或许都不是核心竞争力。真正的顶级人才,是那些懂得如何设计Harness的人。」