逼真且高效的 3D 服装生成,一直是计算机视觉和数字时尚领域一个颇具挑战性的目标。

现有的方法通常依赖于大型视觉语言模型(VLMs),先生成 2D 缝纫样板的序列化表示,然后再利用如 GarmentCode 这类服装建模框架将其转换为可模拟的 3D 网格。这类方法虽然能产生质量不错的成果,但也普遍面临推理速度慢的瓶颈,往往需要 30 秒到 1 分钟的时间。

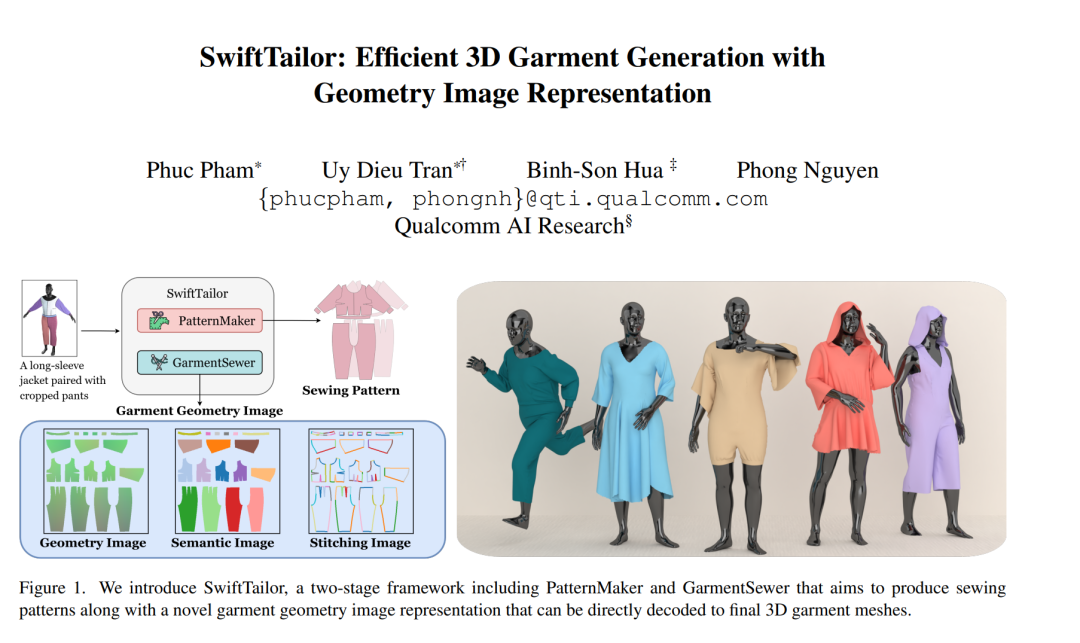

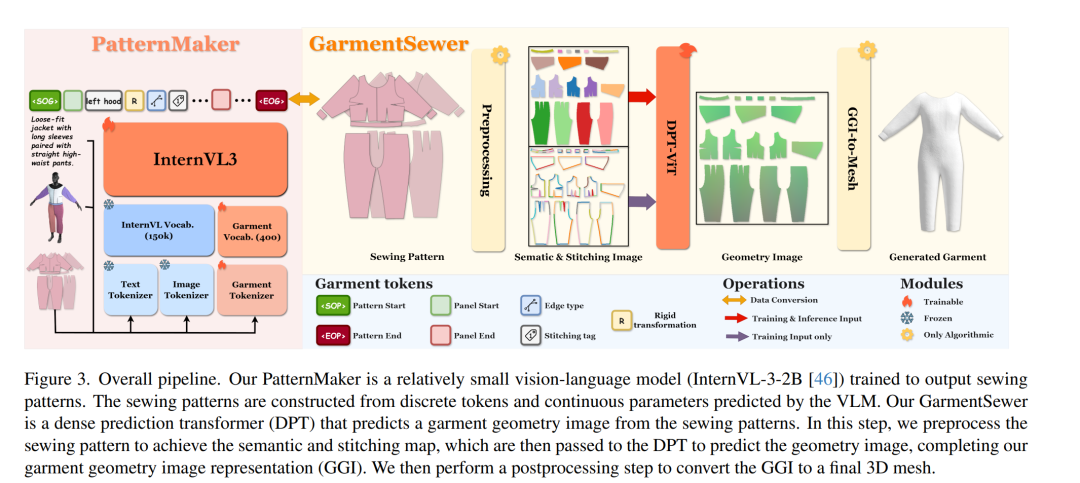

面对这一问题,高通 AI 研究院的研究人员提出了 SwiftTailor。这是一个新颖的两阶段框架,旨在通过一种紧凑的几何图像表示,将缝纫样板推理和基于几何的网格生成统一起来,从而大幅提升效率。

整个框架包含两个轻量级模块:

- PatternMaker:一个高效的视觉语言模型,能够从文本描述等多种输入模态中预测缝纫样板。

- GarmentSewer:一个高效的密集预测 Transformer (DPT),负责将这些样板转换为一种新颖的“服装几何图像”(Garment Geometry Image)。这种图像能在统一的 UV 空间中,编码所有服装裁片的 3D 表面信息。

最终的 3D 网格通过一个高效的逆映射过程重建。这个过程结合了重新网格化(Remeshing)和动态缝合算法,可以直接组装服装,从而避免了传统物理仿真的巨大计算开销。

在 Multimodal GarmentCodeData 数据集上进行的大量实验表明,SwiftTailor 在显著缩短推理时间的同时,依然保持了最先进的生成准确度和视觉逼真度。这为下一代高效、可解释的 3D 服装生成提供了一个颇具潜力的解决方案。

这项研究将服装的几何信息高效地编码为图像格式进行处理,是实现实时、高质量数字内容创作方向上一次有意义的探索。在计算机视觉领域,特别是在 AIGC 推动下对 3D 生成效率要求日益增高的背景下,此类结合几何先验与神经网络的方法,或许能启发更多在智能与数据云平台上的应用创新。 |