这两天我注意到一个挺有意思的开源项目,名字很直白,就叫 Academic Research Skills。

说实话,第一眼看到我并没太当回事。现在市面上打着“学术写作助手”或“论文生成器”旗号的工具太多了,许多产品的核心卖点说到底还是那一句话:帮你更快地产出一篇看起来像模像样的文章。

但这个项目很不一样。它没有把重点放在“替你写”,反而从一开始就在强调一个核心理念:AI 是副驾驶,不是机长。项目作者在 GitHub 上写得很清楚,这套工具不会替你决定研究问题、选择方法或得出结论。它的主要任务是接手那些在科研流程中最耗时、最琐碎、也最容易出错的“脏活累活”,比如系统性地查找文献、核对参考文献、检验数据一致性、检查逻辑是否断裂。

这个定位立刻让它显得与众不同。真正让许多研究者感到头疼的,往往不是“某一段话不会写”,而是整个科研与写作的流程太过碎片化。你得收集材料、整理文献综述、搭建论文框架、撰写正文、检查引用格式、修改排版,最后还要应对审稿人的各种意见。最折磨人的地方,常常不是你卡在某个句子上,而是脑子里仿佛同时打开了十几个任务窗口,需要在它们之间不断来回切换。

而这套 Academic Research Skills 所做的,正是把这堆零散的“窗口”整合成一条清晰、可管理的自动化流水线。

它将完整的论文产出流程拆解成了 10个明确的阶段:从最初的研究(research)、写作(write),到诚信核查(integrity check)、同行评审(review)、修改(revise),再到最终的诚信复检(final integrity check)和定稿(finalize)。整个过程并非写完即止,而是强制性地将“核查—评审—修改—再核查”这套确保质量的闭环流程融入其中,甚至还包含了苏格拉底式的修改辅导环节。

我认为这个项目最“狠”的地方,不在于它会写,而在于它非常警惕文章“写得太像真的,但实际是假的”。

项目中专门设置了一个 预审前诚信核查(Pre-review Integrity Check) 阶段,用于执行参考文献真实性验证、数据核对以及论点逻辑检查。根据 GitHub 上展示的示例,在一次预审诚信报告中,这套流程甚至揪出了 15条虚构的文献引用和3个统计学错误。仅凭这一点,它就与市面上许多只追求“成文速度”的所谓论文生成器拉开了本质上的距离。

说白了,在当下的学术写作中,最危险的或许不是写得慢,而是“一本正经地胡说八道”,并且看上去还毫无破绽。尤其是随着AI辅助写作的普及,最容易“翻车”的地方往往不再是语句不通顺,而是AI可能煞有介事地为你编造参考文献、捏造数据、虚构出处。这样的论文表面上结构完整,但稍微深究,根基可能不堪一击。

显然,Academic Research Skills 深刻意识到了这一点,因此它将“先核查,再送审”设置为一个无法绕过的前置步骤。这个设计思路我非常认同,因为很多时候,一个优秀的学术辅助工具最该解决的,或许不是“如何帮你写得更快”,而是“如何避免让你在学术诚信问题上栽跟头”。

另一个值得玩味的细节是它的模拟评审机制。它的评审阶段并非走个过场,而是构建了一个模拟的 五人审稿团:包括主编视角、几位扮演不同侧重点的审稿人,甚至还特意安排了一个专门负责挑刺和唱反调的 “魔鬼代言人(Devil's Advocate)”。你可以将其理解为那种让作者又爱又恨的审稿人——他们不负责鼓励你,唯一任务就是找出你论文中每一个可能的漏洞。

听起来有点夸张?但仔细想想,这恰恰高度还原了真实的投稿与审稿过程。很多论文最终的失败,并非源于内容贫乏,而是败在“作者自以为表述清晰,但读者或审稿人一眼看去全是逻辑漏洞”。有一个这样专门“找茬”的角色提前介入,远比收到一堆客套的“写得不错,建议稍作润色”的反馈要有价值得多。

此外,在流程的最后,它能够直接导出 MD、DOCX、LaTeX 等多种格式的文档,并支持 APA 7、IEEE、Chicago 等主流学术引用格式,甚至可以进一步编译成PDF。对于写过论文的人来说,立刻就能明白这一步的实用性有多强。有时候,写作本身并不会让人崩溃,真正让血压飙升的,往往是最后那繁琐无比、却又必须精确无误的格式调整。

当然,这个项目也并非没有门槛。GitHub 页面上写得很坦白:完整运行一遍这10个阶段的流程,将会消耗相当大量的 Token(AI计算单位)。因此,作者推荐在 Claude Code 这类支持长流程、多智能体(Agent)协作的环境中使用。换句话说,它不是一个“点击即出稿”的轻量级玩具,而更像是一套为认真、严谨的学术研究量身打造的工作流增强工具。

因此,看完这个 开源项目,我最大的感受并不是“又有AI要来取代科研工作者了”。恰恰相反,我的感受是:终于有人不再把学术写作简单理解为“生成一篇文章”,而是将其视为一个需要反复迭代、严格校验、充满协作的生产过程。 它试图改变的,不是写作这一孤立环节,而是整条科研的“流水线”。

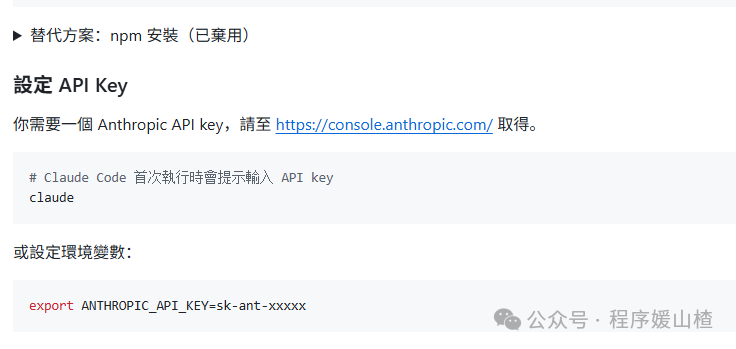

对于如何上手,项目也给出了清晰的指引。安装主要通过原生安装程序完成,无需预先配置 Node.js 环境:

# macOS / Linux

curl -fsSL https://claude.ai/install.sh | bash

# Windows(PowerShell)

irm https://claude.ai/install.ps1 | iex

安装后,你需要配置 Anthropic API Key 才能使用:

# Claude Code 首次执行时会提示输入 API key

claudef

# 或者,你也可以直接设置环境变量

export ANTHROPIC_API_KEY=sk-ant-xxxxx

项目地址:Imbad0202/academic-research-skills

像这样专注于提升研究过程可靠性与系统性的工具,值得被更多投身于学术工作的开发者和研究者了解与讨论。如果你对AI如何深度融入专业工作流感兴趣,不妨到云栈社区的 人工智能 或 开源实战 板块看看,那里经常有关于前沿工具和实用技巧的深度交流。