只需改变围绕固定大语言模型的那套“外挂”代码,就能让它在同一基准测试上的性能产生高达6倍的差距。这套被称为“工具集”的代码——负责设计输入输出规则、调用外部工具、处理多轮对话逻辑——其重要性,往往不亚于模型权重本身。

然而,目前这些工具集的设计工作仍高度依赖人工。现有的自动化文本优化方法之所以难以胜任,是因为它们对反馈信息的压缩过于激进:要么没有记忆、只依赖数值分数,要么将反馈限制为简短的模板或摘要。这种设计在面对复杂的工具集工程时,显得力不从心。

为了解决这一难题,来自斯坦福大学和麻省理工学院的研究团队提出了 Meta‑Harness——一个通过端到端搜索,为LLM应用自动寻找最优工具集代码的外层循环系统。

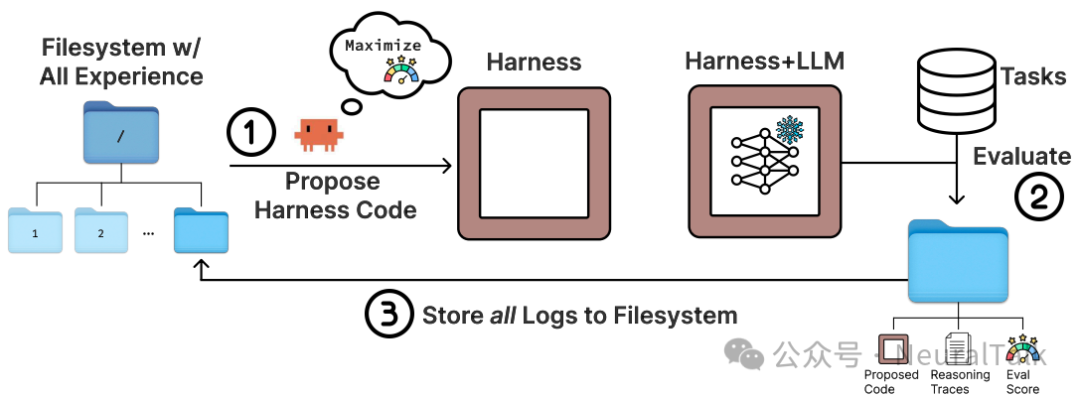

Meta-Harness的核心是一个智能提议器(Agentic Proposer)。与以往方法最大的不同在于,这个提议器能够通过文件系统,访问所有历史候选工具集的完整源代码、评估分数以及详细的执行轨迹。这相当于给了优化器一本包含了所有成功与失败经验的“错题本”。

图1:Meta-Harness的搜索循环。(1) 智能体读取文件系统中的全量历史数据,提出新的工具集方案。(2) 对新提议的工具集进行评估。(3) 将所有日志(代码、轨迹、分数)存回文件系统,形成闭环。

系统的工作流程清晰简洁:

- 提议:智能提议器查阅文件系统中存储的历史工具集代码、得分和详细的执行日志。

- 评估:对新生成的工具集代码在目标任务上进行验证和评分。

- 存储:将新工具集的所有相关信息(代码、推理轨迹、得分)存入文件系统,供后续迭代参考。

消融实验证实,提供对完整执行轨迹的访问权限是整个系统设计中最关键的一环——仅靠分数或摘要远远不够。正是这种“全历史访问”能力,让提议器能够像人类工程师一样,进行因果推理:看到问题(低分),回溯执行过程(轨迹),定位根因(某段代码逻辑),并提出针对性的修复方案,而非盲目试错。

实验结果:多领域显著超越人工设计与传统优化器

研究团队在三个差异巨大的任务上验证了Meta-Harness的有效性,结果均令人印象深刻:

-

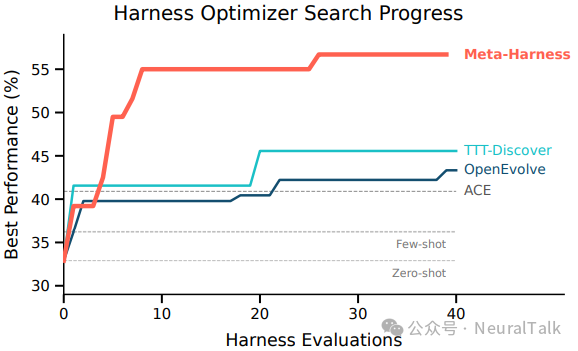

在线文本分类:Meta‑Harness发现的工具集,在准确率上比当前领先的上下文管理方法(ACE)提升了 7.7个百分点,同时将消耗的上下文令牌数量减少至1/4。更惊人的是,它仅用4次评估就追平了其他文本优化器经过60次评估后的最终性能。

图2(左):在文本分类任务中,Meta-Harness(红色曲线)的搜索效率与最终性能均大幅领先其他方法。

-

检索增强型数学推理:在包含200道国际数学奥林匹克(IMO)难度题目的测试集上,由Meta‑Harness发现的一个单一检索工具集,成功迁移到5个未参与训练的LLM上,平均准确率提升了 4.7个百分点。

-

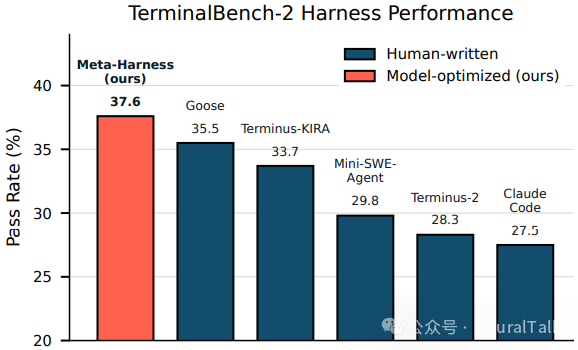

智能体编码任务:在极具挑战性的TerminalBench‑2基准测试中,Meta-Harness自动发现的工具集性能超越了所有已公开的人工设计基线。

图2(右):在TerminalBench-2上,Meta-Harness在Claude Haiku 4.5模型上取得了最高通过率。

具体到TerminalBench-2排行榜:

- 在强大的Claude Opus 4.6模型上,Meta-Harness工具集取得了76.4%的通过率,优于人工精心设计的Terminus-KIRA(74.7%)。

- 在更轻量的Claude Haiku 4.5模型上,提升更为显著:以37.6% 的通过率登顶该模型榜单,超越了之前的最高记录(Goose, 35.5%)。

深度解析:为什么“全量日志访问”如此重要?

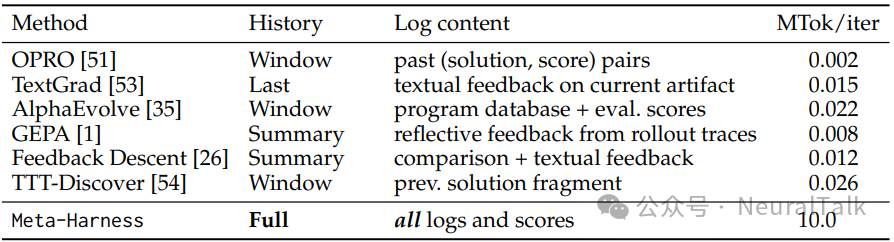

传统文本优化器(如OPRO、TextGrad、GEPA等)为了控制成本,通常只使用高度压缩的反馈,例如只保留分数、或由另一个LLM生成的摘要。表1揭示了这种设计与Meta-Harness在可用信息规模上的巨大差距。

表1:Meta-Harness每次迭代可访问的上下文信息量(约1000万令牌)比其他方法高出数个数量级。

在工具集优化这种“长视野”问题上,一个早期的设计决策(比如如何存储信息)可能会在后续多个推理步骤后才引发错误。压缩的反馈(如一个简单的低分)丢失了将下游错误溯源至上游代码的关键诊断信息。Meta-Harness通过文件系统开放全量原始日志,允许提议器执行grep、cat等操作进行定向检索,从而能够实施有效的因果分析和代码级修复。

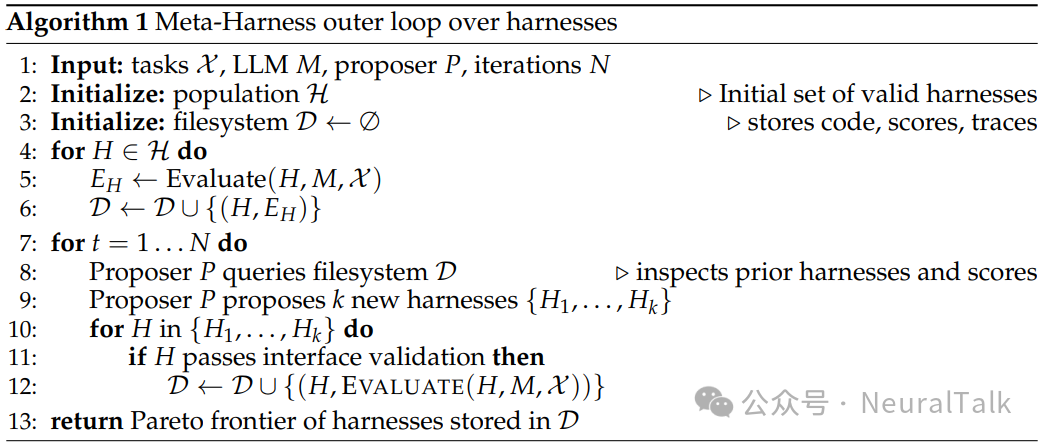

算法与实现

Meta-Harness的算法外层循环非常简洁(算法1),其核心思想是将复杂的诊断和修改决策完全交给编码智能体,而不是固化在搜索逻辑中。

算法1:Meta-Harness的外层循环。它维护一个文件系统 D 来存储所有历史经验,并依赖智能提议器 P 来分析和提出新的工具集方案 H。

实际实现细节:

- 提议器:使用Claude Code(基于Opus-4.6模型)作为编码智能体。

- 工具集形式:每个工具集是一个独立的Python文件,负责特定任务的提示工程、检索、记忆管理等逻辑。

- 底层模型:在搜索过程中保持冻结,不更新权重。

- 典型运行:进行约20次迭代,评估60-100个候选工具集。

更多实验结果与优势

1. 消融实验证明轨迹访问的关键性

在文本分类任务中,研究者对比了三种提议器接口:

- 仅分数:中位数准确率34.6%

- 分数+摘要:中位数准确率34.9%

- Meta-Harness(全量日志+轨迹):中位数准确率50.0%

结果清晰表明,访问原始执行轨迹是性能飞跃的关键,摘要无法替代原始诊断信息。

2. 出色的帕累托前沿与泛化能力

Meta-Harness能自动探索准确率与上下文成本之间的权衡,形成平滑的帕累托前沿,让使用者可以根据需求选择最优解。此外,其发现的工具集展现了良好的泛化能力:

- 在9个未见过的文本分类数据集上,平均准确率(73.1%)优于所有基线。

- 在数学推理任务中,同一个检索工具集成功迁移到5个不同的LLM上并均带来增益。

3. 在TerminalBench-2上的定性分析

通过观察搜索日志,可以发现提议器的行为模式:

- 初期尝试结合结构性修改和提示词调整,但性能下降。

- 提议器通过分析历史轨迹,提出假设:性能下降可能是由混杂的修改导致。

- 随后将结构性修改与提示词改写分离,转向更安全的增量式优化,最终找到了性能更优的方案。

这个过程生动展示了“全历史访问”如何赋能智能体进行因果推理和定向改进。

讨论与未来方向

Meta-Harness的成功印证了机器学习中的一个“苦涩教训”:一旦某个搜索空间变得可访问,强大的通用计算能力(在这里是先进的编码智能体)往往能超越人工设计的、包含大量先验知识的解决方案。

这项工作为LLM系统优化开辟了一条新路径。未来可能的方向包括:

- 工具集与模型权重的协同进化:让外层的工具集策略与内层模型的微调过程相互促进。

- 探索不同提议器的影响:本研究主要使用了Claude Code,未来可研究不同能力、不同架构的编码智能体作为提议器的效果。

- 应用于更广泛的系统:将Meta-Harness范式应用于其他类型的AI系统或软件工程任务。

对于开发者和研究者而言,Meta-Harness提供了一个强大的自动化工具,能够将人们从繁琐的“工具集工程”中解放出来,专注于更高层的任务定义和模型创新。其开源代码也已发布,方便社区进一步研究和应用。