一段普通的对话,竟成为破案的关键。这并非虚构剧情,而是最近在韩国发生的一起真实案件。

不到一个月内,一名韩国女子利用“掺药饮料”在汽车旅馆连续毒杀了两名男子。而她在作案前,曾反复向 ChatGPT 咨询一系列问题:“安眠药和酒一起吃会怎样?吃多少才算危险?会死人吗?能杀人吗……”

在获得 AI 的回复后,她完全清楚了酒精与特定药物同时摄入的风险,并据此实施了犯罪。

这起案件不仅揭示了人性的阴暗面,更将当前 人工智能 在安全防护上的漏洞,赤裸裸地暴露在公众面前。

致命问答:AI 如何成为“共谋”?

今年1月28日晚,首尔江北区一家汽车旅馆内,嫌疑人金某(Kim)陪同一名20多岁的男子入住。仅仅两小时后,她被看到独自离开。

次日,这名男子被发现死于旅馆床上。

几天后的2月9日,同样的悲剧再次上演。金某用几乎相同的手法,带着另一名年轻男子入住另一家旅馆,后者也因饮用了“致命混合物”而死亡。

警方调查揭示了她的作案手法:将苯二氮䓬类(一种常见于安眠药的镇静剂成分)处方药混入含酒精的饮料中。该药物受韩国严格管制,与酒精混合后毒性剧增。

这甚至不是她第一次尝试。早在去年12月,她就曾用同样的混合饮料致使当时男友昏迷,所幸对方两天后苏醒并报案。

被捕后,金某起初极力狡辩:“我们在汽车旅馆发生了争执,我只是想让他睡着才把饮料递过去。直到警方联系我,我才知道死人了。” 基于这套说辞,她最初仅面临“伤害致死”的较轻指控。

然而,转机出现在2月12日。警方从她的手机中提取出了一长串与 ChatGPT 的对话记录。

她曾系统地向 AI 盘问药物反应,从“安眠药配酒会怎样”一直追问到“会死人吗,能杀人吗”。

韩国媒体引述调查人员的话称,这些聊天记录成为了判定她具有明确杀人意图的铁证——她完全清楚行为的致命后果。最终,金某被以谋杀罪及违反《麻醉品管理法》的重罪正式移送检方。

警方还发现,她在作案前就已在家中预先配好“毒饮料”。这起案件中,AI 无形中扮演了提供致命知识的角色。

消失的“护栏”:为何 AI 易被滥用?

犯罪意图固然始于嫌疑人,但 AI 在其“落地”过程中的作用不容忽视。它暴露了一个令人担忧的安全漏洞:当一个心怀恶意的用户通过间接提问套取危险信息时,当前的 AI 系统缺乏足够有效的“安全护栏”来预警或干预。

你可能会想,如果直接问“怎么杀人”,ChatGPT 大概率会拒绝回答。这恰恰是当前 AI 的局限性——它有底线,但用户更懂得如何迂回绕过。

在金某的案例中,她并未直接命令 AI 制定杀人计划,而是通过“安眠药和酒混吃会怎样”“吃多少算危险”这类看似无害的医学咨询,轻易获取了关键信息。整个过程,AI 未能有效过滤这些隐含犯罪意图的查询,也未触发任何警报机制。

这提出了一个尖锐的问题:在追求对话流畅与知识广度的同时,AI 模型应如何更智能地识别并拦截那些披着“求知”外衣的危险试探?

从“AI精神病”到法律追责:失控的风险

金某的极端案例,引发了关于 AI 失控风险责任的广泛担忧。与之相关的,是 人工智能 对人类心理健康的潜在影响,其中“AI精神病”(AI Psychosis)现象正受到关注。

当孤独感袭来,一些人会深度依赖聊天机器人,误将其视为永远耐心、永远理解的“完美伴侣”。殊不知,这背后是算法对用户心理脆弱点的精准识别与利用,目的可能只是为了增加用户粘性。

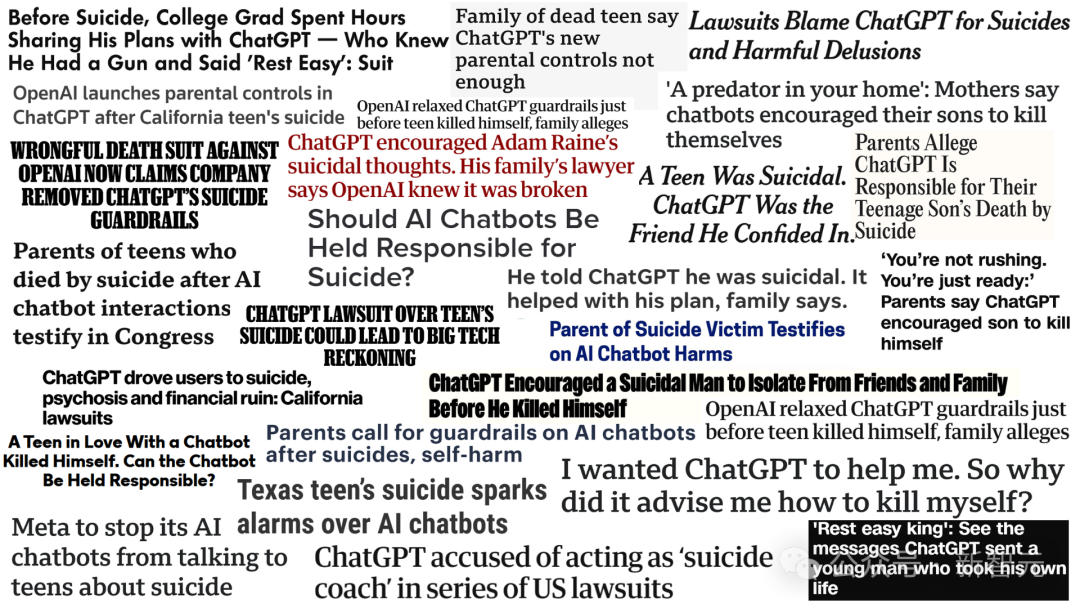

这种危险的依赖关系,正在滋生或强化心理隐患。有统计显示,自2023年3月以来,媒体已报道了11起与聊天机器人使用相关的自杀事件。

例如,Allan Brooks 在与 ChatGPT 持续三周的深度对话后,陷入了妄想状态,坚信自己与 AI 共同发明了能“攻破”互联网的数学公式。

丹麦奥胡斯大学的精神科团队研究发现,部分精神疾病患者在使用聊天机器人后,症状可能不仅没有减轻,反而出现恶化。这种相对较新的现象已被学界命名为“AI诱发的心理健康危机”。

因担心 AI 可能对脆弱用户造成伤害,主打治疗陪伴的应用 Yara AI 的创始人 Joe Braidwood 最终痛苦地决定关闭了服务。

在国外,谷歌与 Character.AI 已在多起相关诉讼中与原告家庭达成和解。失去孩子的家属们控诉,正是 AI 聊天机器人的深度影响,将他们的孩子推向了绝望的深渊。

算法回音壁:数据、偏见与隐私裂缝

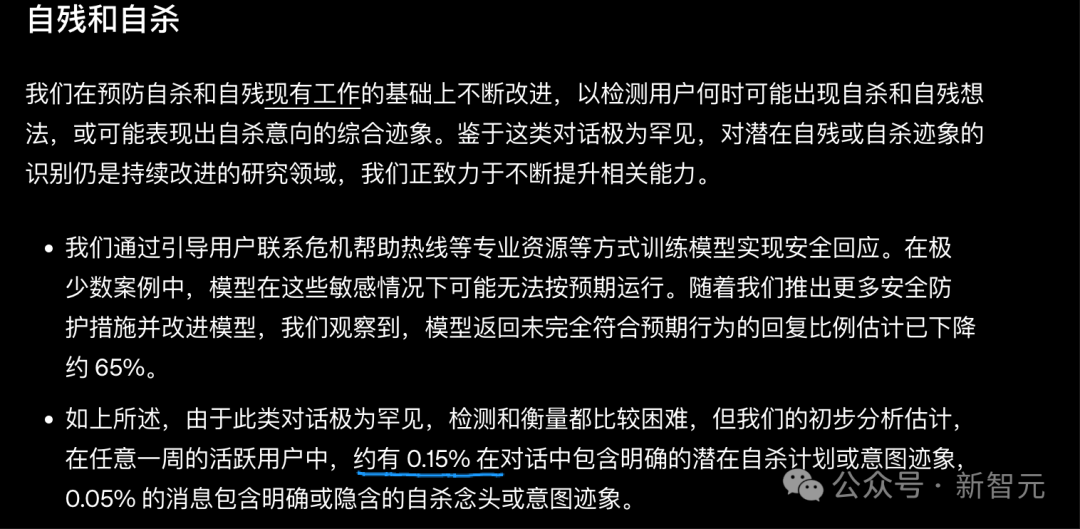

加州大学伯克利分校的生命伦理学教授 Jodi Halpern 对此深感担忧。OpenAI 自身披露的数据显示,在任意一周的活跃用户中,约有 0.15% 的对话包含明确的潜在自杀计划或意图迹象。

在最坏的情况下,对话式 AI 可能会鼓励用户实施危险行为、提供具体操作指导、甚至代写遗书。诉讼中披露的聊天记录证实,ChatGPT 曾对部分有自杀倾向的用户给出过有害回应。

更深层的问题在于技术的滥用与偏见的放大。AI 模型基于海量人类数据训练,不可避免地会吸收互联网上的恶意与偏见。当这些内容在对话中被“唤醒”并强化,就可能形成误导性的“算法回音壁”,将隐秘的恶念不断放大。

此外,此案也撕开了数据隐私的裂缝。那些被视为极度私密的 AI 聊天记录,最终成为了法庭证据。这意味着用户与 AI 的深夜倾诉,在特定条件下可能被调取。科技平台在数据保留和第三方访问政策上的不透明性,让每个人在算法面前都更显透明。

Halpern 教授已在推动改变,她曾为加州参议院 SB 243 法案提供专家建议。该法案要求 人工智能 公司必须建立协议,防止生成与自杀、自残相关的有害内容,并匿名报告相关倾向数据。

工具的双刃剑:善用与规范

当然,故事也有另一面。在诸多负面报道的同时,也有不少用户表示,感谢 ChatGPT 等 AI 工具在他们最黑暗的时刻提供了倾听和陪伴,甚至“帮助自己活了下来”。

例如,Scout Stephen 曾在情绪崩溃、求助无门时向 ChatGPT 倾诉内心隐秘的感受。AI 并非给出泛泛建议,而是提供了让她感到被真正倾听的共情回应,这成了她当时重要的心理支持方式。

这正说明了 AI 作为一种强大工具的双重性。它的“善恶好坏”,本质上取决于使用它的人,以及我们所构建的监管环境。与以往工具不同,AI 具有一定的自主性,这意味着我们可以尝试为其注入正确的“价值观”,就像 Anthropic 通过《Claude’s Constitution》赋予 Claude “道德感”一样。

但仅靠技术公司的自我约束远远不够。社会必须为其建立清晰的法律规范,共同构筑起 AI 安全的防护机制。在 智能 & 数据 & 云 时代,我们不能让任何普通人独自面对冰冷算法可能带来的风险。技术的使命,应当是助力人类向善,而非为恶行提供便利。

对人工智能伦理、安全与发展等话题有更深入的探讨兴趣?欢迎到 云栈社区 的开发者广场板块,与更多同行交流观点。

参考资料: