01. Arista XPO 光模块液冷方案

近期,Arista联合超过45家行业伙伴发布了eXtra-dense Pluggable Optics(XPO)白皮书,提出了一项面向下一代AI数据中心的全新可插拔光模块标准。该标准的核心目标,是替代并超越现有的OSFP规范,专门解决AI集群对超高带宽、高密度、大功耗及高效散热的刚性需求。

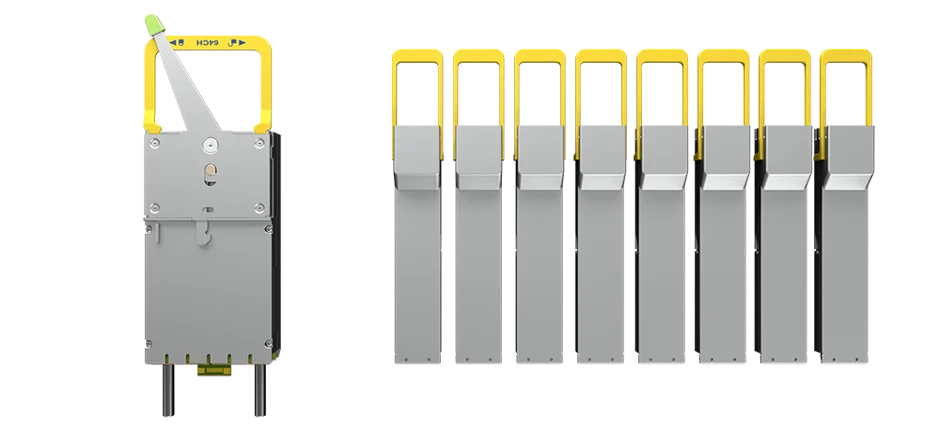

简单来说,Arista XPO光模块的核心定位就是“超高密度可插拔”。单模块带宽高达12.8Tbps,这相当于8个传统OSFP模块的性能总和。更关键的是,在1个Open Rack Unit(1U)的空间内,可以部署多达16个这样的XPO模块,从而实现惊人的204.8Tbps交换容量。相比现有方案,这实现了4倍的前面板密度提升。

高密度集成带来的直接挑战,便是散热压力的指数级增长。单个XPO模块的散热需求最高可达400W。传统的风冷方案受限于其散热效率和空间占用,已经无法在如此紧凑的体积内实现高效的热传导,极易导致局部过热,进而影响模块的长期稳定性和使用寿命。

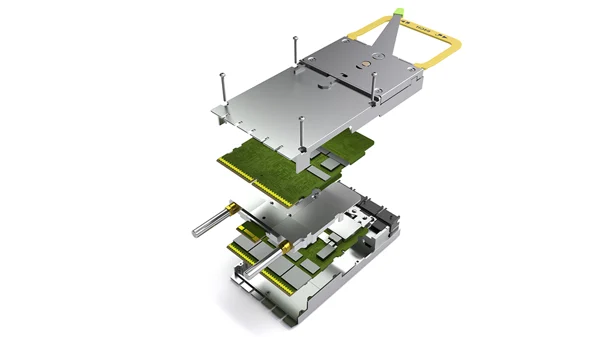

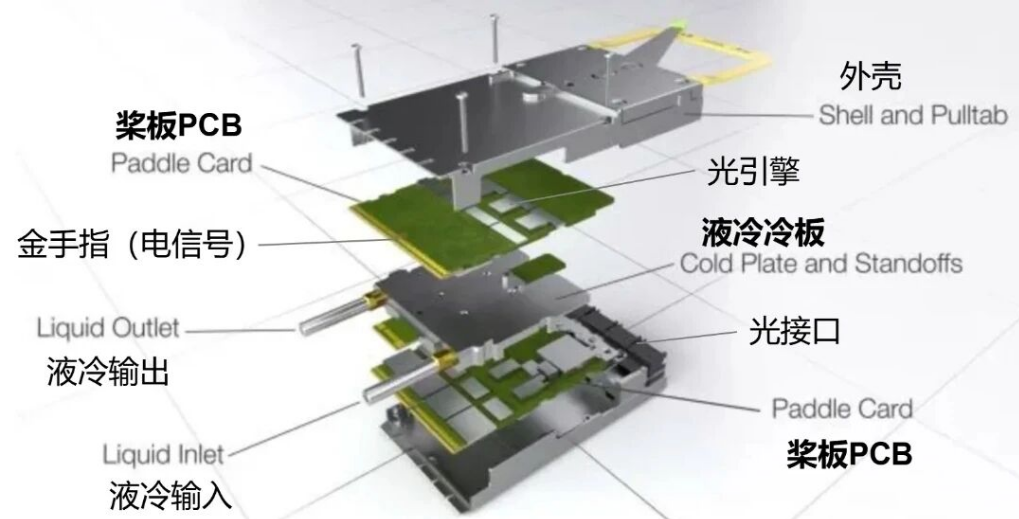

因此,Arista XPO光模块采用了“原生整合液冷冷板”的设计理念。这意味着液冷系统与光模块本身是深度集成、一体设计的,而非后期附加的改造方案。其核心设计主要包括以下三个方面:

- Belly-to-Belly双桨板卡结构:模块采用对称的双桨叶设计,冷板直接贴合光组件和DSP芯片等核心发热器件。这种结构实现了热量从器件表面到液冷系统的直接传导,减少了中间环节,极大提升了散热效率。同时,它与XPO模块的高密度物理布局高度适配,有效避免了液冷管路与内部元件的空间冲突。

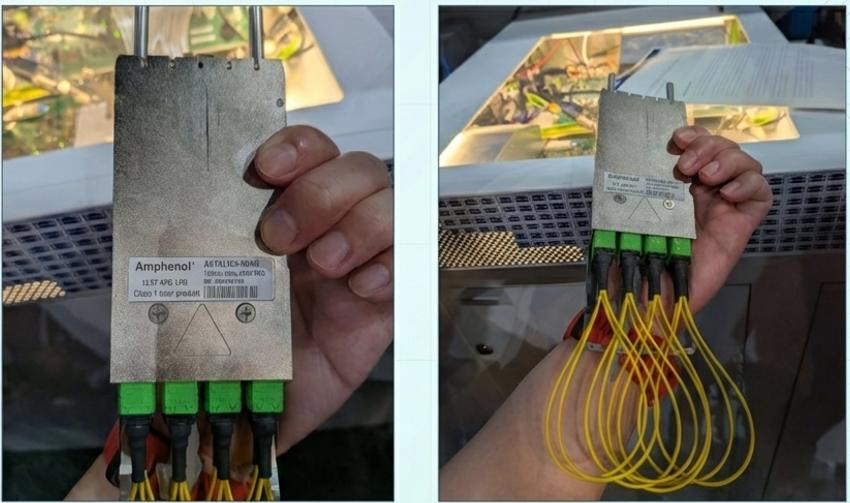

- 内置一体化液冷管路:模块内部集成了液冷的流入与流出管路,无需在数据中心部署复杂的外接散热管线,简化了安装流程。管路设计采用了防漏密封技术,确保专用冷却液不会发生泄漏,保障内部精密光学和电路元件的安全。

- 高精度温度监控系统:搭配Arista ALR4600等配套设备,可以实时采集液冷介质的温度,测量精度可达小数点后一位(例如29.9℃)。这确保了光模块内部的多兆位光学元件始终工作在严格的温度范围内,避免因温度波动导致的信号完整性问题和可靠性下降。

与传统的风冷及其他改造型液冷方案相比,Arista XPO的液冷设计展现了四大核心优势,精准命中了高密度光模块的散热痛点:

- 散热效率跃升,解决高密度瓶颈:液冷的热传导效率是风冷的数十倍。XPO的集成式冷板设计,能将核心发热器件的热量快速导出,轻松应对400W以上的散热需求,彻底解决了高密度部署时的局部过热问题。相比风冷,液冷可使模块运行温度降低15-25℃,大幅提升稳定性并减少故障停机。同时,它无需风扇,消除了噪音和额外的风扇能耗。

- 空间适配性强,助力密度翻倍:采用“模块化集成”设计,冷板与外壳一体化,不额外占用机架空间。相较于风冷需要预留的散热风道,XPO液冷设计使1U机架的带宽密度提升4倍,用1U空间实现了过去需要4U空间才能达到的带宽,极大提升了数据中心的空间利用率和经济效益。

- 保留热插拔特性,兼顾可维护性:与某些因集成度过高而导致维护困难的CPO(共封装光学)方案不同,Arista XPO方案保留了可插拔模块的核心优势——支持前面板热插拔。运维人员可以在不中断系统运行的情况下快速更换故障模块,显著降低了运维成本和风险,实现了高密度与高可维护性的完美平衡。

- 与LPO技术协同,降低整体功耗:XPO光模块采用了LPO(线性可插拔光学)低功耗技术,移除了传统模块中的DSP芯片,本身功耗已大幅降低(目标低于90W)。而高效液冷方案的引入,进一步优化了功耗表现——无需为散热预留过多冗余功耗,使得XPO模块的整体能效比可提升30%以上,与LPO技术形成强大的协同降耗效应。

02. 从800G到1.6T,液冷何以成为光模块散热首选?

当前,全球科技巨头正成为光模块从800G向1.6T乃至更高速率迭代的核心驱动力。英伟达、AMD、谷歌、微软等厂商的算力平台持续升级,直接倒逼光模块的速率与功耗同步突破。而传统风冷技术的局限性日益凸显,使得液冷几乎成为破解下一代高速光模块散热难题的唯一可行路径。

从需求端看,AI算力集群规模的不断扩大,正推动数据中心网络架构向超高带宽、超高功率密度演进。800G光模块已逐渐难以满足前沿的算力互联需求,1.6T光模块正成为AI数据中心互联的核心器件。行业预测显示,2026年将是1.6T光模块规模化商用的关键年份。届时,英伟达GB300、Rubin系列以及AMD MI450、MI550等高端GPU服务器,均已将1.6T光模块作为标准配置。

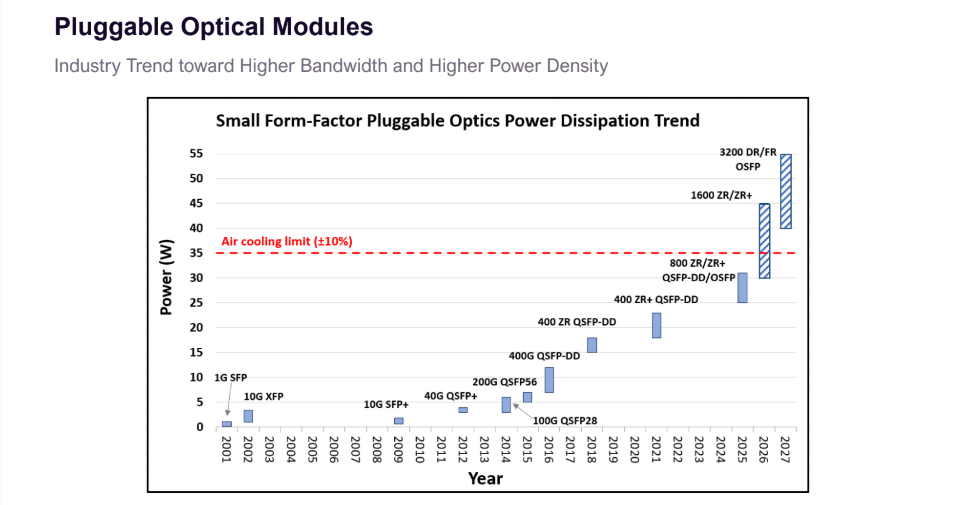

速率迭代的背后,是光模块功耗的急剧飙升,这让传统风冷技术陷入了“力不从心”的困境。数据显示,800G光模块功耗约为25-30W,而1.6T DR8 DSP版本的光模块功耗已突破45W,其热流密度超过100W/cm²,这远远超过了传统风冷约50W/cm²的散热极限。高温环境会导致激光器寿命减半、误码率飙升、波长漂移等问题,迫使设备“降额运行”,严重制约了AIGC算力的充分释放。

与此同时,与光模块配套的交换机等设备功率也持续暴涨。1.6T光模块配套的交换机功耗已突破2kW,未来向3.2T演进时功率将进一步攀升。叠加AI服务器单机柜功率从百kW级迈向MW级的趋势,数据中心热源呈现高密度、多节点分布的特征。风冷不仅散热效率不足,无法快速带走集中式热源,还会产生大量额外热损耗,推高数据中心PUE值,这与全球绿色低碳的发展要求相悖。

在此背景下,液冷散热技术凭借其高效换热、低能耗、高可靠性的优势,正成为1.6T及以上高速光模块的必选方案。与风冷相比,液冷可直接、快速地将热量传导带走,散热效率提升30%以上,能轻松应对45W及更高功耗的散热需求。它还能有效降低设备运行噪音、延长光模块使用寿命,完美适配头部客户对高算力、低PUE的核心诉求。行业共识表明,在800G阶段,液冷渗透率仅约5%,处于小批量试用;而到1.6T阶段,液冷渗透率预计将飙升至40%,正式从“辅助选项”升级为“主流散热方式”。

03. 风冷转液冷,产业链中的新机遇

行业分析认为,2026年1.6T光模块将迈入规模化液冷应用阶段,而到3.2T光模块时代,全面液冷化已成定局。这场从风冷到液冷的全面切换,绝非简单的散热方式升级,更将带动整个液冷配套产业链的需求爆发。

其中,冷板作为液冷光模块的核心散热载体,以及QD(快拆接头) 作为确保液冷系统能够灵活运维的关键部件,将成为这场“风转液”浪潮中最直接的受益者。相关厂商凭借技术适配能力和产能优势,正迎来前所未有的市场机遇。

根据市场分析报告预测,2026年全球光模块液冷市场规模预计约为10亿美元,而到2030年,这一数字有望突破63亿美元,年复合增长率高达53%。未来,光模块液冷市场很可能成为数据中心液冷领域,除GPU/CPU之外最大的增长点。

想要深入了解全球数据中心光模块液冷市场的详细技术路径、主流厂商布局及核心数据预测,可以参阅相关行业分析报告。例如,《全球数据中心光模块液冷市场分析报告》就系统梳理了五大主流技术路径并给出了市场预测。

对数据中心基础设施、液冷技术及高速网络互联感兴趣的开发者,欢迎在云栈社区交流探讨,共同跟踪前沿技术趋势。